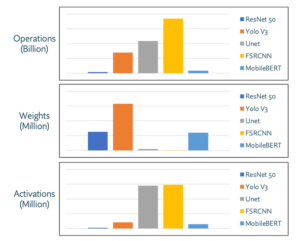

ความจริงก็คือเราเป็นเพียงจุดเริ่มต้นของการปฏิวัติปัญญาประดิษฐ์ (AI) ความสามารถของ AI กำลังเริ่มแสดงให้เห็นสิ่งที่จะเกิดขึ้นในอนาคต ตัวอย่างเช่น รถยนต์ใช้โมเดลโครงข่ายประสาทเทียมขนาดใหญ่ที่ซับซ้อนเพื่อไม่เพียงแต่เข้าใจสภาพแวดล้อมเท่านั้น แต่ยังเพื่อควบคุมและควบคุมตัวเองด้วย สำหรับแอปพลิเคชันใดๆ จะต้องมีข้อมูลการฝึกอบรมเพื่อสร้างเครือข่ายที่เป็นประโยชน์ ขนาดของทั้งการฝึกอบรมและการอนุมานกำลังเติบโตอย่างรวดเร็ว เนื่องจากมีการรวมข้อมูลที่เป็นประโยชน์ในโลกแห่งความเป็นจริงไว้ในแบบจำลอง มาดูการเติบโตของโมเดลในช่วงหลายปีที่ผ่านมาเพื่อทำความเข้าใจว่าสิ่งนี้ขับเคลื่อนความต้องการพลังการประมวลผลสำหรับการฝึกอบรมและการอนุมานได้อย่างไร

ในการนำเสนอที่ Ansys 2021 Ideas Digital Forum รองประธานฝ่ายวิศวกรรมของ Cerebras, Dhiraj Mallik ได้ให้ข้อมูลเชิงลึกเกี่ยวกับการเติบโตของโมเดลโครงข่ายประสาทเทียม ในช่วงสองปีที่ผ่านมา ขนาดของโมเดลเพิ่มขึ้น 1000 เท่า จาก BERT Base (110 MB) เป็น GPT-3 (175 GB) และที่สำคัญคือรุ่น MSFT-1T ขนาด 1 TB รุ่น GPT-3 ซึ่งเป็นหัวข้อที่น่าสนใจในตัวมันเอง ได้รับการฝึกฝนกับฮาร์ดแวร์ทั่วไปโดยใช้ GPU 1024 ตัวเป็นเวลา 4 เดือน เป็นรูปแบบการประมวลผลภาษาธรรมชาติ (NLP) ที่ใช้ข้อมูลข้อความส่วนใหญ่บนอินเทอร์เน็ตและแหล่งข้อมูลอื่นๆ ได้รับการพัฒนาโดย Open AI และปัจจุบันเป็นพื้นฐานสำหรับ OpenAI Codex ซึ่งเป็นแอปพลิเคชันที่สามารถเขียนโค้ดโปรแกรมที่มีประโยชน์ในหลายภาษาจากคำแนะนำภาษาธรรมดาจากผู้ใช้ GPT-3 สามารถใช้เขียนบทความสั้น ๆ ที่ผู้อ่านส่วนใหญ่ไม่สามารถบอกได้ว่าเขียนโดยโปรแกรม AI

ดังที่คุณเห็นข้างต้น การใช้ GPU 1024 ตัวเป็นเวลา 4 เดือนนั้นเป็นไปไม่ได้ ในการบรรยายของเขาในหัวข้อ “Delivering Unprecedented AP Acceleration: Beyond Moore's Law” Dhiraj ชี้ให้เห็นว่าความก้าวหน้าที่จำเป็นในการสนับสนุนการเติบโตของเซมิคอนดักเตอร์ในระดับนี้ไปไกลเกินกว่าที่เราเคยเห็นในกฎของ Moore เพื่อตอบสนองต่อความต้องการของตลาดที่รับรู้นี้ Cerebras ได้เปิดตัว WSE-1 ซึ่งเป็นกลไก AI ขนาดเวเฟอร์ในปี 2019 ซึ่งใหญ่กว่าชิปใดๆ ที่เคยผลิตถึง 56 เท่า หนึ่งปีครึ่งต่อมาพวกเขาได้ประกาศเปิดตัว WSE-2 ซึ่งเป็นชิปที่ใหญ่ที่สุดอีกครั้งหนึ่งซึ่งทุกๆ ตัวสร้างขึ้นด้วย:

- ทรานซิสเตอร์ 6 ล้านล้านตัว

- คอร์ AI ที่ปรับให้เหมาะสมแล้ว 850,000 คอร์

- 40 GB RAM

- แบนด์วิธหน่วยความจำ 20 เพตาไบต์/วินาที

- แบนด์วิธแฟบริค 220 เพตาไบต์

- สร้างด้วยกระบวนการ N7 ของ TSMC

- เวเฟอร์ประกอบด้วย 84 ดาย แต่ละอันกว้าง 550 มม2.

ระบบ CS-2 ที่ห่อหุ้ม WSE-2 สามารถรองรับโมเดล AI ที่มีพารามิเตอร์ 120 ล้านล้านพารามิเตอร์ สิ่งที่น่าประทับใจยิ่งกว่าคือระบบ CS-2 สามารถสร้างเป็นคลัสเตอร์ 192 ยูนิตได้ เพื่อให้ได้รับประสิทธิภาพที่เพิ่มขึ้นเกือบเชิงเส้น Cerebras ได้พัฒนาระบบย่อยหน่วยความจำที่แยกหน่วยความจำและการคำนวณเพื่อให้มีการปรับขนาดที่ดีขึ้นและปริมาณงานที่ดีขึ้นสำหรับโมเดลที่มีขนาดใหญ่มาก Cerebras ยังได้พัฒนาการปรับให้เหมาะสมสำหรับความเบาบางในชุดฝึกซ้อม ซึ่งช่วยประหยัดเวลาและพลังงาน

การนำเสนอของ Dhiraj ให้รายละเอียดเพิ่มเติมเกี่ยวกับความสามารถ โดยเฉพาะอย่างยิ่งในด้านการขยายขนาดอย่างมีประสิทธิภาพด้วยโมเดลที่ใหญ่กว่าเพื่อรักษาปริมาณงานและความจุ จากมุมมองของเซมิคอนดักเตอร์ ยังน่าสนใจที่จะเห็นว่า Cerebras วิเคราะห์การตกของ IR การโยกย้ายด้วยไฟฟ้า และสัญญาณ ESD ในการออกแบบที่มีขนาด 2 ลำดับความสำคัญที่ใหญ่กว่าสิ่งอื่นๆ ที่เคยพยายามโดยอุตสาหกรรมเซมิคอนดักเตอร์ได้อย่างไร Dhiraj พูดถึงวิธีที่ในแต่ละระดับของการออกแบบ ไม่ว่าจะเป็นไทล์ บล็อก และเวเฟอร์เต็ม Cerebras ใช้ Ansys RedHawk-SC กับ CPU หลายตัวเพื่อส่งสัญญาณ IR แบบคงที่และไดนามิก RedHawk-SC ยังใช้สำหรับการตรวจสอบการโยกย้ายด้วยไฟฟ้ากำลังและสัญญาณ ในทำนองเดียวกัน พวกเขาใช้ Ansys Pathfinder สำหรับความต้านทาน ESD และการตรวจสอบความหนาแน่นกระแส

ด้วยชิ้นส่วนซิลิคอนขนาดใหญ่ถึง 7 นาโนเมตร การตัดสินใจเกี่ยวกับเครื่องมือจึง “สร้างหรือพัง” อย่างแท้จริง การสร้างซิลิคอนที่พลิกโฉมนี้จำเป็นต้องอาศัยตัวเลือกที่ได้รับการพิจารณาเป็นอย่างดีในกระบวนการพัฒนา และแน่นอนว่าความสามารถที่ไม่มีใครเทียบได้คือข้อกังวลหลัก อย่างไรก็ตาม ดังที่การนำเสนอของ Dhiraj แสดงให้เห็นอย่างชัดเจน ระดับพลังการประมวลผลที่เพิ่มขึ้นของ CS-2 นั้นจำเป็นต่อการจัดการอัตราการเติบโตที่เราเห็นในโมเดล AI/ML ไม่ต้องสงสัยเลยว่าเราจะได้เห็นนวัตกรรมที่เกินจินตนาการของเราในปัจจุบันในด้าน AI เช่นเดียวกับที่เว็บและระบบคลาวด์ได้เปลี่ยนแปลงเทคโนโลยีและแม้แต่สังคม เราก็สามารถคาดหวังการพัฒนาเทคโนโลยี AI ใหม่ที่จะเปลี่ยนแปลงโลกของเราในรูปแบบที่น่าทึ่ง หากคุณสนใจที่จะเรียนรู้เพิ่มเติมเกี่ยวกับซิลิคอน Cerebras โปรดดูการนำเสนอของ Dhiraj บน Ansys IDEAS Digital Forum ที่ www.ansys.com/ideas.

แชร์โพสต์นี้ผ่าน: ที่มา: https://semiwiki.com/eda/303587-neural-network-growth-requires-unprecedented-semiconductor-scaling/

- 000

- 110

- 2019

- 2021

- 84

- AI

- ประกาศ

- การใช้งาน

- AREA

- บทความ

- การก่อสร้าง

- ความจุ

- รถยนต์

- เปลี่ยนแปลง

- การตรวจสอบ

- ชิป

- เมฆ

- รหัส

- ปัจจุบัน

- ข้อมูล

- ออกแบบ

- รายละเอียด

- พัฒนาการ

- ดิจิตอล

- หล่น

- ชั้นเยี่ยม

- สิ่งแวดล้อม

- ผ้า

- พอดี

- เต็ม

- อนาคต

- GPUs

- การเจริญเติบโต

- การเจริญเติบโต

- ฮาร์ดแวร์

- สรุป ความน่าเชื่อถือของ Olymp Trade?

- HTTPS

- อุตสาหกรรม

- อินเทอร์เน็ต

- IT

- ภาษา

- ภาษา

- ใหญ่

- กฏหมาย

- การเรียนรู้

- ชั้น

- ส่วนใหญ่

- ตลาด

- แบบ

- เดือน

- ภาษาธรรมชาติ

- ประมวลผลภาษาธรรมชาติ

- ใกล้

- เครือข่าย

- เครือข่าย

- ประสาท

- เครือข่ายประสาท

- NLP

- เปิด

- OpenAI

- การดำเนินการ

- คำสั่งซื้อ

- อื่นๆ

- การปฏิบัติ

- มุมมอง

- อำนาจ

- ผลิต

- โครงการ

- การเขียนโปรแกรม

- ผู้อ่าน

- คำตอบ

- วิ่ง

- ขนาด

- ขนาดไอ

- ปรับ

- สารกึ่งตัวนำ

- สั้น

- ขนาด

- สังคม

- สนับสนุน

- ระบบ

- ระบบ

- พูดคุย

- เทคโนโลยี

- ก้าวสู่อนาคต

- เวลา

- การฝึกอบรม

- ผู้ใช้

- เว็บ

- ความหมายของ

- โลก

- ปี

- ปี