Meta ได้เปิดตัวโมเดลการเรียนรู้ของเครื่องแบบเปิดอีกรูปแบบหนึ่ง ซึ่งคราวนี้ได้รับการปรับแต่งสำหรับการสร้างซอร์สโค้ดซอฟต์แวร์

โค๊ดลามะ เป็นตระกูลของโมเดลภาษาขนาดใหญ่ - ดังนั้นจึงมีการใช้อักษรตัวพิมพ์ใหญ่เป็นครั้งคราว "LLaMA" - ตามโมเดล Llama 2 การเผยแพร่ ในเดือนกรกฎาคม. ได้รับการปรับแต่งและฝึกฝนอย่างละเอียดเพื่อแจกจ่ายและอภิปรายซอร์สโค้ดเพื่อตอบสนองต่อข้อความแจ้ง แทนที่จะเป็นร้อยแก้วเหมือนต้นกำเนิด

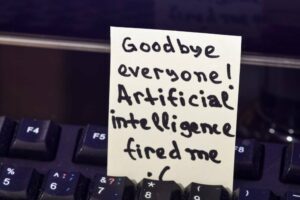

เช่นเดียวกับเทคโนโลยีล้ำสมัย Code Llama ก็มาพร้อมกับความเสี่ยง

“Code Llama มีศักยภาพที่จะใช้เป็นเครื่องมือด้านการผลิตและการศึกษาเพื่อช่วยให้โปรแกรมเมอร์เขียนซอฟต์แวร์ที่มีประสิทธิภาพและมีเอกสารประกอบดีกว่า” Meta อ้างสิทธิ์ใน ประกาศ วันพฤหัสบดี

หากคุณขอให้ Code Llama เขียนฟังก์ชันที่สร้างลำดับ Fibonacci โมเดลจะสร้างทั้งโค้ดและภาษาธรรมชาติเพื่ออธิบายแหล่งที่มา Meta กล่าว และโมเดล AI สามารถทำได้ใน Python, C++, Java, PHP, Typescript (Javascript), C#, Bash และภาษาอื่นๆ

อย่างไรก็ตาม ผู้ใช้จะถูกนำทางไปยัง Code Llama เป็นภาษาอังกฤษ เนื่องจากโมเดลดังกล่าวไม่ได้ผ่านการทดสอบความปลอดภัยในภาษาอื่น และอาจพูดอะไรบางอย่างที่แย่มากหากถูกสอบถามใน ออกจากขอบเขต ภาษา.

“เช่นเดียวกับเทคโนโลยีล้ำหน้าอื่นๆ Code Llama มาพร้อมกับความเสี่ยง” Meta อธิบาย โดยสังเกตว่าในระหว่างการทดสอบทีมสีแดงของตัวเองเพื่อชักชวนการสร้างโค้ดที่เป็นอันตราย Code Llama ตอบสนองด้วยคำตอบที่ปลอดภัยกว่า ChatGPT (GPT3.5 Turbo)

จากข้อมูลของ Meta นั้น Code Llama มีประสิทธิภาพเหนือกว่า LLM แบบโอเพ่นซอร์ส เฉพาะโค้ด และ Llama 2 ซึ่งเป็นพาเรนต์ของตัวเองในการวัดประสิทธิภาพสองแบบ – มนุษย์อีวาล และการเขียนโปรแกรม Python ขั้นพื้นฐานเป็นส่วนใหญ่ (เอ็มบีพีพี) – และตรงกับประสิทธิภาพของ ChatGPT ของ OpenAI

Code Llama มีสามขนาด ได้แก่ พารามิเตอร์ 7B, 13B และ 34B และแต่ละตัวแปรได้รับการฝึกอบรมด้วยโทเค็น 500B ของโค้ดและข้อมูลที่เกี่ยวข้องกับโค้ด โทเค็นหนึ่งรายการประกอบด้วยอักขระภาษาอังกฤษประมาณสี่ตัว Codex ของ OpenAI เวอร์ชันที่ใหญ่ที่สุดเมื่อเปิดตัวมี พารามิเตอร์ 12B.

Meta กล่าวว่าโมเดล Code Llama ที่เล็กที่สุดสองโมเดลได้รับการฝึกฝนให้เติมแหล่งที่มาที่ขาดหายไป ซึ่งช่วยให้สามารถใช้สำหรับการเติมโค้ดให้สมบูรณ์โดยไม่ต้องปรับแต่งเพิ่มเติม ว่ากันว่าเวอร์ชัน 34B จะให้ผลลัพธ์ที่ดีที่สุด แต่เวอร์ชันที่เล็กกว่า XNUMX ตอบสนองเร็วกว่า ทำให้ดีขึ้นสำหรับงานต่างๆ เช่น การเติมโค้ดให้สมบูรณ์ซึ่งสังเกตเห็นความล่าช้าได้ชัดเจน

นอกจากนี้ยังมีสองรูปแบบ: Code Llama – Python และ Code Llama – Instruct แบบแรกมาจากการปรับแต่ง Code Llama อย่างละเอียดด้วยโทเค็น Python พิเศษอีก 100B อย่างหลังได้รับการปรับแต่งอย่างละเอียดเพื่อให้เป็นไปตามรูปแบบอินพุตและเอาท์พุต ทำให้เหมาะสำหรับการสร้างโค้ดมากขึ้น

ความน่าเชื่อถือมีใครบ้าง?

LLM มักจะจัดให้มี ไม่ถูกต้อง คำตอบ ไปยังพรอมต์การเขียนโปรแกรม แม้ว่านักพัฒนาจำนวนมากจะใช้เพื่อเรียกคืนรูปแบบการท่องจำและพารามิเตอร์ API หรือหลีกเลี่ยงการค้นหาและการตรวจสอบเอกสารประกอบ

จุดขายประการหนึ่งของ Code Llama คือสามารถจัดการอินพุตและเอาต์พุตของลำดับโค้ดที่ประกอบด้วยโทเค็นได้มากถึง 100,000 โทเค็น กล่าวคือ คุณสามารถแจ้งโมเดลด้วยโค้ดหลายบรรทัด และคุณอาจได้รับการตอบกลับแบบละเอียด

“นอกเหนือจากการเป็นข้อกำหนดเบื้องต้นสำหรับการสร้างโปรแกรมที่ยาวขึ้นแล้ว การมีลำดับอินพุตที่ยาวขึ้นจะปลดล็อกกรณีการใช้งานใหม่ที่น่าตื่นเต้นสำหรับโค้ด LLM” Meta อธิบาย “ตัวอย่างเช่น ผู้ใช้สามารถจัดเตรียมโมเดลด้วยบริบทเพิ่มเติมจากโค้ดเบสของตนเพื่อทำให้คนรุ่นมีความเกี่ยวข้องมากขึ้น นอกจากนี้ยังช่วยในการดีบักสถานการณ์ในโค้ดเบสขนาดใหญ่ ซึ่งการอยู่เหนือโค้ดทั้งหมดที่เกี่ยวข้องกับปัญหาที่เป็นรูปธรรมอาจเป็นเรื่องท้าทายสำหรับนักพัฒนา”

ผู้ใช้สามารถจัดเตรียมโมเดลด้วยบริบทเพิ่มเติมจากโค้ดเบสของตนเพื่อทำให้รุ่นมีความเกี่ยวข้องมากขึ้น

Code Llama เข้าร่วมสาขาโมเดลการแปลงโค้ดที่กำลังเติบโต ซึ่งเริ่มต้นโดย Codex ของ OpenAI และ GitHub ที่เกี่ยวข้อง การดำเนินคดีที่มีภาระผูกพัน บริการแนะนำการเขียนโปรแกรม Copilot (2021) โมเดลการเขียนโปรแกรมเชิงบวกที่ตามมา ได้แก่ DeepMind's อัลฟ่าโค้ด (2022), GPT-4 ของ OpenAI (2023), Amazon รหัสกระซิบ (2023) และ Bard ของ Google (2023) ปรับจูนในเดือนเมษายน เพื่อสร้าง รหัสแหล่งที่มา.

นอกจากนี้ยังมีโอเพ่นซอร์ส (หรือประเภทเปิด) LLM มากมายเช่น สตาร์โค้ดเดอร์ และ เอ็กซ์เจนเพื่อชื่อสอง

Meta ได้เปิดตัว Code Llama ภายใต้ชื่อเดียวกัน ใบอนุญาตชุมชน ในฐานะ Llama 2 โดยอ้างถึงความเชื่อของบริษัทยักษ์ใหญ่ในเรื่อง “แนวทางที่เปิดกว้างสำหรับ AI” ว่าเป็นวิธีที่ดีที่สุดในการพัฒนาเครื่องมือที่เป็นนวัตกรรม ปลอดภัย และมีความรับผิดชอบ

แต่ดังที่กล่าวไว้อย่างกว้างขวางใน Llama 2 ใบอนุญาตของชุมชนก็คือ ไม่ใช่ใบอนุญาตโอเพ่นซอร์ส. “แนวทางแบบเปิด” ของ Meta สำหรับ AI นั้นปิดไม่ให้มีการแข่งขัน – ใบอนุญาตไม่อนุญาตให้ใช้ซอฟต์แวร์อย่างชัดเจน “เพื่อปรับปรุงโมเดลภาษาขนาดใหญ่อื่น ๆ”

และในขณะที่ใบอนุญาตชุมชนของ Meta อนุญาตให้ใช้ลามะต่างๆ ในเชิงพาณิชย์ได้ แต่ก็ดึงดูดบริการต่างๆ ด้วย "ผู้ใช้งานมากกว่า 700 ล้านรายต่อเดือน"

นั่นค่อนข้าง เลือกกลุ่ม ของบริการขนาดใหญ่ เช่น YouTube, WeChat, TikTok, LinkedIn, Telegram, Snapchat และ Douyin ในบรรดาแพลตฟอร์มโซเชียลมีเดียที่ Meta ไม่ได้ดำเนินการโดย Meta และสันนิษฐานว่าบริษัทที่ใช้แพลตฟอร์มที่ใช้ระบบปฏิบัติการเช่น Apple, Google และ Microsoft – “ต้องร้องขอ ใบอนุญาตจาก Meta ซึ่ง Meta อาจมอบให้แก่คุณตามดุลยพินิจของตนแต่เพียงผู้เดียว…” ®

- เนื้อหาที่ขับเคลื่อนด้วย SEO และการเผยแพร่ประชาสัมพันธ์ รับการขยายวันนี้

- PlatoData.Network Vertical Generative Ai เพิ่มพลังให้กับตัวเอง เข้าถึงได้ที่นี่.

- เพลโตไอสตรีม. Web3 อัจฉริยะ ขยายความรู้ เข้าถึงได้ที่นี่.

- เพลโตESG. ยานยนต์ / EVs, คาร์บอน, คลีนเทค, พลังงาน, สิ่งแวดล้อม แสงอาทิตย์, การจัดการของเสีย. เข้าถึงได้ที่นี่.

- เพลโตสุขภาพ เทคโนโลยีชีวภาพและข่าวกรองการทดลองทางคลินิก เข้าถึงได้ที่นี่.

- ChartPrime. ยกระดับเกมการซื้อขายของคุณด้วย ChartPrime เข้าถึงได้ที่นี่.

- BlockOffsets การปรับปรุงการเป็นเจ้าของออฟเซ็ตด้านสิ่งแวดล้อมให้ทันสมัย เข้าถึงได้ที่นี่.

- ที่มา: https://go.theregister.com/feed/www.theregister.com/2023/08/25/meta_lets_code_llama_run/

- :มี

- :เป็น

- :ไม่

- :ที่ไหน

- $ ขึ้น

- 000

- 100

- 2021

- 2022

- 2023

- 700

- a

- คล่องแคล่ว

- นอกจากนี้

- ที่อยู่

- เป็นไปตาม

- AI

- ทั้งหมด

- ช่วยให้

- แล้ว

- ด้วย

- อเมซอน

- ในหมู่

- an

- และ

- อื่น

- คำตอบ

- ใด

- ทุกคน

- API

- Apple

- เข้าใกล้

- เมษายน

- เป็น

- AS

- ที่เกี่ยวข้อง

- At

- หลีกเลี่ยง

- ตาม

- ทุบตี

- ขั้นพื้นฐาน

- BE

- รับ

- กำลัง

- ความเชื่อ

- มาตรฐาน

- ที่ดีที่สุด

- ดีกว่า

- ทั้งสอง

- แต่

- by

- C + +

- CAN

- โครงสร้างเงินทุน

- กรณี

- ท้าทาย

- อักขระ

- ChatGPT

- การตรวจสอบ

- อ้างว่า

- ปิด

- CO

- รหัส

- codebase

- มา

- เชิงพาณิชย์

- ชุมชน

- บริษัท

- การแข่งขัน

- เสร็จสิ้น

- สิ่งแวดล้อม

- การสร้าง

- ตัด

- ข้อมูล

- Deepmind

- พัฒนา

- นักพัฒนา

- DID

- สนทนา

- do

- เอกสาร

- Douyin

- ดึง

- ในระหว่าง

- แต่ละ

- ขอบ

- เกี่ยวกับการศึกษา

- ภาษาอังกฤษ

- อีเธอร์ (ETH)

- ตัวอย่าง

- น่าตื่นเต้น

- อธิบาย

- อธิบาย

- อธิบาย

- พิเศษ

- ครอบครัว

- เร็วขึ้น

- FB

- ฟีโบนักชี

- สนาม

- ใส่

- ปลาย

- ตาม

- สำหรับ

- อดีต

- สี่

- ราคาเริ่มต้นที่

- ฟังก์ชัน

- ต่อไป

- สร้าง

- การสร้าง

- รุ่น

- ชั่วอายุคน

- ได้รับ

- GitHub

- ให้

- มากขึ้น

- การเจริญเติบโต

- มี

- จัดการ

- มี

- มี

- ช่วย

- จะช่วยให้

- ด้วยเหตุนี้

- อย่างไรก็ตาม

- HTTPS

- if

- ปรับปรุง

- in

- ในอื่น ๆ

- ประกอบด้วย

- ในขั้นต้น

- นวัตกรรม

- อินพุต

- แทน

- ปัญหา

- IT

- ITS

- ชวา

- JavaScript

- ร่วม

- jpg

- กรกฎาคม

- เพียงแค่

- ภาษา

- ภาษา

- ใหญ่

- ที่มีขนาดใหญ่

- ใหญ่ที่สุด

- ความแอบแฝง

- การเรียนรู้

- ช่วยให้

- License

- กดไลก์

- Line

- เส้น

- ดูรายละเอียด

- อีกต่อไป

- เครื่อง

- เรียนรู้เครื่อง

- ทำ

- การทำ

- หลาย

- อาจ..

- ภาพบรรยากาศ

- Meta

- ไมโครซอฟท์

- อาจ

- ล้าน

- หายไป

- แบบ

- โมเดล

- รายเดือน

- ข้อมูลเพิ่มเติม

- ส่วนใหญ่

- ต้อง

- ชื่อ

- โดยธรรมชาติ

- ภาษาธรรมชาติ

- ใหม่

- เด่น

- สังเกต

- เป็นครั้งคราว

- of

- มักจะ

- on

- ONE

- เปิด

- โอเพนซอร์ส

- OpenAI

- การดำเนินงาน

- or

- อื่นๆ

- ประสิทธิภาพเหนือกว่า

- เอาท์พุต

- ของตนเอง

- พารามิเตอร์

- รูปแบบ

- การปฏิบัติ

- PHP

- แพลตฟอร์ม

- เพลโต

- เพลโตดาต้าอินเทลลิเจนซ์

- เพลโตดาต้า

- จุด

- ที่มีศักยภาพ

- ผลิต

- ผลผลิต

- ลูกหลาน

- โปรแกรมเมอร์

- การเขียนโปรแกรม

- โปรแกรม

- ให้

- ใส่

- หลาม

- คำสั่ง

- ค่อนข้าง

- RE

- สีแดง

- ที่เกี่ยวข้อง

- การเผยแพร่

- ตรงประเด็น

- ขอ

- ตอบสนอง

- คำตอบ

- รับผิดชอบ

- ผลสอบ

- จลาจล

- ความเสี่ยง

- แข็งแรง

- ลวก

- วิ่ง

- วิ่ง

- s

- ปลอดภัย

- ปลอดภัยมากขึ้น

- ความปลอดภัย

- กล่าวว่า

- เดียวกัน

- กล่าว

- พูดว่า

- สถานการณ์

- ค้นหา

- Selling

- ลำดับ

- บริการ

- บริการ

- ขนาด

- มีขนาดเล็กกว่า

- สแน็ปแชท

- So

- สังคม

- โซเชียลมีเดีย

- แพลตฟอร์มสื่อสังคม

- ซอฟต์แวร์

- บางสิ่งบางอย่าง

- แหล่ง

- รหัสแหล่งที่มา

- T

- งาน

- ทีม

- เทคโนโลยี

- Telegram

- เงื่อนไขการใช้บริการ

- การทดสอบ

- กว่า

- ที่

- พื้นที่

- ที่มา

- ของพวกเขา

- พวกเขา

- ที่นั่น

- พวกเขา

- นี้

- แต่?

- สาม

- ตลอด

- วันพฤหัสบดี

- ติ๊กต๊อก

- เวลา

- ไปยัง

- โทเค็น

- ราชสกุล

- เครื่องมือ

- เครื่องมือ

- ด้านบน

- ผ่านการฝึกอบรม

- สอง

- ประเภท

- ภายใต้

- ปลดล็อค

- ใช้

- มือสอง

- ผู้ใช้

- การใช้

- ตัวแปร

- ต่างๆ

- รุ่น

- คือ

- ทาง..

- เมื่อ

- ที่

- ในขณะที่

- อย่างกว้างขวาง

- วิกิพีเดีย

- จะ

- กับ

- ไม่มี

- เขียน

- ยัง

- เธอ

- YouTube

- ลมทะเล