บทนำ

หลังจากที่โมเดล Llama และ Mistral เปิดตัว LLM แบบโอเพ่นซอร์สก็ได้รับความสนใจจาก OpenAI ตั้งแต่นั้นมา มีหลายรุ่นที่ได้รับการเผยแพร่โดยใช้สถาปัตยกรรม Llama และ Mistral ซึ่งมีประสิทธิภาพเทียบเท่ากับรุ่นที่เป็นกรรมสิทธิ์ เช่น GPT-3.5 Turbo, Claude, Gemini ฯลฯ อย่างไรก็ตาม โมเดลเหล่านี้มีขนาดใหญ่เกินกว่าจะใช้ในฮาร์ดแวร์ของผู้บริโภค

แต่เมื่อเร็ว ๆ นี้ LLM ประเภทใหม่ได้เกิดขึ้น เหล่านี้คือ LLM ในหมวดหมู่พารามิเตอร์ย่อย 7B พารามิเตอร์ที่น้อยลงทำให้มีขนาดกะทัดรัดเพียงพอที่จะใช้งานในฮาร์ดแวร์ของผู้บริโภค ในขณะเดียวกันก็รักษาประสิทธิภาพที่เทียบเคียงได้กับรุ่น 7B โมเดลต่างๆ เช่น Tiny-Llama-1B, Phi-2 ของ Microsoft และ Qwen-3b ของ Alibaba สามารถทดแทนโมเดลขนาดใหญ่ได้อย่างดีเยี่ยมเพื่อใช้งานในเครื่องหรือปรับใช้บน Edge ในขณะเดียวกัน การปรับแต่งอย่างละเอียดถือเป็นสิ่งสำคัญในการดึงเอาสิ่งที่ดีที่สุดจากโมเดลพื้นฐานสำหรับงานดาวน์สตรีมใดๆ

ที่นี่ เราจะมาดูวิธีปรับแต่งฐานแบบละเอียด โมเดลลามะจิ๋ว บนชุดข้อมูล Alpaca ที่ทำความสะอาดแล้ว

วัตถุประสงค์การเรียนรู้

- ทำความเข้าใจการปรับแต่งอย่างละเอียดและวิธีการต่างๆ

- เรียนรู้เกี่ยวกับเครื่องมือและเทคนิคในการปรับแต่งอย่างละเอียดอย่างมีประสิทธิภาพ

- เรียนรู้เกี่ยวกับ WandB สำหรับการบันทึกบันทึกการฝึกอบรม

- ปรับแต่ง Tiny-Llama บนชุดข้อมูล Alpaca ใน Colab

บทความนี้เผยแพร่โดยเป็นส่วนหนึ่งของไฟล์ Blogathon วิทยาศาสตร์ข้อมูล

สารบัญ

LLM Fine Tuning คืออะไร?

การปรับแต่งอย่างละเอียดเป็นกระบวนการของการสร้างแบบจำลองที่ได้รับการฝึกอบรมล่วงหน้าเพื่อเรียนรู้ความรู้ใหม่ โมเดลที่ได้รับการฝึกล่วงหน้าคือโมเดลสำหรับวัตถุประสงค์ทั่วไปที่ได้รับการฝึกกับข้อมูลจำนวนมาก อย่างไรก็ตาม ในกรณีส่วนใหญ่ โมเดลจะไม่สามารถทำงานได้ตามที่ตั้งใจไว้ และการปรับแต่งอย่างละเอียดเป็นวิธีที่มีประสิทธิภาพมากที่สุดในการทำให้โมเดลปรับให้เข้ากับกรณีการใช้งานเฉพาะ ตัวอย่างเช่นฐาน ปริญญามหาบัณฑิต ทำได้ดีในการสร้างข้อความใน QA แบบเทิร์นเดียว แต่ต้องเจอกับการสนทนาแบบหลายเทิร์น เช่น โมเดลแชท

โมเดลพื้นฐานจำเป็นต้องได้รับการฝึกอบรมเกี่ยวกับการถอดเสียงบทสนทนาเพื่อให้สามารถสนทนาแบบหลายรอบได้ การปรับแต่งอย่างละเอียดถือเป็นสิ่งสำคัญในการปั้นโมเดลที่ได้รับการฝึกล่วงหน้าให้เป็นอวตารต่างๆ คุณภาพของโมเดลที่ได้รับการปรับแต่งอย่างละเอียดนั้นขึ้นอยู่กับคุณภาพของข้อมูลและความสามารถของโมเดลพื้นฐาน มีหลายวิธีในการปรับแต่งโมเดลอย่างละเอียด เช่น LoRA, QLoRA ฯลฯ

มาดูแนวคิดเหล่านี้โดยย่อ

ลอร่า

LoRA ย่อมาจาก Low-rank Adaptation ซึ่งเป็นเทคนิคการปรับแต่งยอดนิยมที่เราเลือกพารามิเตอร์ที่ฝึกได้สองสามตัว แทนที่จะอัปเดตพารามิเตอร์ทั้งหมดผ่านการประมาณระดับต่ำของเมทริกซ์น้ำหนักดั้งเดิม โมเดล LoRA สามารถปรับแต่งได้อย่างละเอียดเร็วขึ้นบนฮาร์ดแวร์ที่เน้นการประมวลผลน้อยกว่า

คิวลอรา

QLoRA หรือ Quantized LoRA เป็นอีกก้าวหนึ่งจาก LoRA แทนที่จะเป็นโมเดลที่มีความแม่นยำเต็มรูปแบบ ระบบจะคำนวณปริมาณน้ำหนักของโมเดลเพื่อลดความแม่นยำของจุดลอยตัวก่อนที่จะใช้ LoRA การหาปริมาณเป็นกระบวนการของการลดค่าบิตที่สูงขึ้นไปเป็นค่าที่ต่ำลง กระบวนการหาปริมาณ 4 บิตเกี่ยวข้องกับการหาปริมาณน้ำหนัก 16 บิตเป็นค่าทศนิยม 4 บิต

การหาปริมาณโมเดลจะช่วยลดขนาดโมเดลลงอย่างมาก โดยมีความแม่นยำเทียบเท่ากับโมเดลดั้งเดิม ใน QLoRA เราใช้โมเดลเชิงปริมาณแล้วใช้ LoRA กับโมเดลดังกล่าว โมเดลสามารถหาปริมาณได้หลายวิธี เช่น ผ่าน llama.cpp, AWQ, บิตแซนด์ไบต์ เป็นต้น

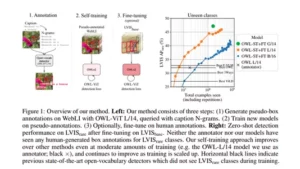

การปรับแต่งแบบละเอียดด้วย Unsloth

Unsloth เป็นแพลตฟอร์มโอเพ่นซอร์สสำหรับการปรับแต่งโมเดลภาษาขนาดใหญ่ยอดนิยมได้รวดเร็วยิ่งขึ้น รองรับ LLM ยอดนิยม รวมถึง Llama-2 และ Mistral และอนุพันธ์ของพวกมัน เช่น Yi, Open-hermes ฯลฯ โดยใช้เมล็ดไทรทันแบบกำหนดเองและกลไก back-prop แบบแมนนวลเพื่อปรับปรุงความเร็วของการฝึกฝนโมเดล

ที่นี่ เราจะใช้ Unsloth เพื่อปรับแต่งโมเดล Tiny-Llama แบบควอนตัมแบบ 4 บิตแบบละเอียดบน สัตว์ขนยาวในอเมริกาคล้ายแกะ ชุดข้อมูล แบบจำลองนี้กำหนดปริมาณด้วยบิตและไบต์ และเคอร์เนลได้รับการปรับให้เหมาะสมด้วย Triton ของ OpenAI

การบันทึกด้วย WandB

ในแมชชีนเลิร์นนิง การบันทึกเมตริกการฝึกอบรมและการประเมินผลถือเป็นสิ่งสำคัญ ทำให้เราเห็นภาพการวิ่งรถไฟได้ครบถ้วน น้ำหนักและอคติ (WandB) เป็นไลบรารีโอเพ่นซอร์สสำหรับการแสดงภาพและติดตามการทดลองการเรียนรู้ของเครื่อง มีเว็บแอปเฉพาะสำหรับแสดงภาพเมตริกการฝึกอบรมแบบเรียลไทม์ นอกจากนี้ยังช่วยให้เราจัดการโมเดลการผลิตจากส่วนกลางได้อีกด้วย เราจะใช้ WandB เพื่อติดตามการดำเนินการปรับแต่ง Tiny-Llama เท่านั้น

หากต้องการใช้ WandB ให้สมัครบัญชีฟรีและสร้าง คีย์ API.

ตอนนี้เรามาเริ่มปรับแต่งโมเดลของเรากันดีกว่า

จะปรับแต่ง Tiny-Llama ได้อย่างไร?

การปรับแต่งอย่างละเอียดเป็นงานที่ต้องใช้การประมวลผลอย่างหนัก ต้องใช้เครื่องที่มี VRAM ขนาด 10-15 GB หรือคุณสามารถใช้รันไทม์ Tesla T4 GPU ฟรีของ Colab ได้

ตอนนี้ติดตั้ง Unsloth และ WandB

%%capture

import torch

major_version, minor_version = torch.cuda.get_device_capability()

!pip install wandb

if major_version >= 8:

# Use this for new GPUs like Ampere, Hopper GPUs (RTX 30xx, RTX 40xx, A100, H100, L40)

!pip install "unsloth[colab_ampere] @ git+https://github.com/unslothai/unsloth.git"

else:

# Use this for older GPUs (V100, Tesla T4, RTX 20xx)

!pip install "unsloth[colab] @ git+https://github.com/unslothai/unsloth.git"

passสิ่งต่อไปคือการโหลดโมเดลที่ฝึกล่วงหน้าเชิงปริมาณ 4 บิตด้วย Unsloth

from unsloth import FastLanguageModel

import torch

max_seq_length = 4096 # Choose any! We auto support RoPE Scaling internally!

dtype = None # None for auto detection. Float16 for Tesla T4, V100, Bfloat16 for Ampere+

load_in_4bit = True # Use 4bit quantization to reduce memory usage. Can be False.

model, tokenizer = FastLanguageModel.from_pretrained(

model_name = "unsloth/tinyllama-bnb-4bit", # "unsloth/tinyllama" for 16bit loading

max_seq_length = max_seq_length,

dtype = dtype,

load_in_4bit = load_in_4bit,

)สิ่งนี้จะติดตั้งโมเดลในเครื่อง ขนาดโมเดล 4 บิตจะอยู่ที่ประมาณ 760 MB

ตอนนี้สมัคร กพ ไปเป็นโมเดล Tiny-Llama 4 บิต

model = FastLanguageModel.get_peft_model(

model,

r = 32, # Choose any number > 0 ! Suggested 8, 16, 32, 64, 128

target_modules = ["q_proj", "k_proj", "v_proj", "o_proj",

"gate_proj", "up_proj", "down_proj",],

lora_alpha = 32,

lora_dropout = 0, # Currently only supports dropout = 0

bias = "none", # Currently only supports bias = "none"

use_gradient_checkpointing = True, # @@@ IF YOU GET OUT OF MEMORY - set to True @@@

random_state = 3407,

use_rslora = False, # We support rank stabilized LoRA

loftq_config = None, # And LoftQ

)เตรียมข้อมูล

ขั้นตอนต่อไปคือการเตรียมชุดข้อมูลสำหรับการปรับแต่งอย่างละเอียด อย่างที่ผมได้กล่าวไปก่อนหน้านี้เราจะใช้น้ำยาทำความสะอาด ชุดข้อมูลอัลปาก้า- นี่คือชุดข้อมูล Alpaca ดั้งเดิมเวอร์ชันที่ล้างข้อมูลแล้ว มันเป็นไปตามรูปแบบคำสั่ง-อินพุต-การตอบสนอง นี่คือตัวอย่างข้อมูล Alpaca

เอาล่ะ มาเตรียมข้อมูลของเรากันดีกว่า

@title prepare data

#alpaca_prompt = """Below is an instruction that describes a task, paired with an input that

provides further context.

Write a response that appropriately completes the request.

### Instruction:

{}

### Input:

{}

### Response:

{}"""

EOS_TOKEN = tokenizer.eos_token

def formatting_prompts_func(examples):

instructions = examples["instruction"]

inputs = examples["input"]

outputs = examples["output"]

texts = []

for instruction, input, output in zip(instructions, inputs, outputs):

# Must add EOS_TOKEN, otherwise your generation will go on forever!

text = alpaca_prompt.format(instruction, input, output) + EOS_TOKEN

texts.append(text)

return { "text" : texts, }

pass

from datasets import load_dataset

dataset = load_dataset("yahma/alpaca-cleaned", split = "train")

dataset = dataset.map(formatting_prompts_func, batched = True,)ตอนนี้ ให้แบ่งข้อมูลออกเป็นข้อมูลการฝึกและข้อมูลประเมิน ฉันใช้ข้อมูลการประเมินขนาดเล็ก เนื่องจากข้อมูลการประเมินขนาดใหญ่ทำให้การฝึกอบรมช้าลง

dataset_dict = dataset.train_test_split(test_size=0.004)กำหนดค่า WandB

ตอนนี้ ให้กำหนดค่า Weights and Biases ในรันไทม์ปัจจุบันของคุณ

# @title wandb init

import wandb

wandb.login()ระบุคีย์ API เพื่อเข้าสู่ระบบ WandB เมื่อได้รับแจ้ง

ตั้งค่าตัวแปรสภาพแวดล้อม

%env WANDB_WATCH=all

%env WANDB_SILENT=trueโมเดลรถไฟ

จนถึงตอนนี้ เราได้โหลดโมเดล 4 บิต สร้างการกำหนดค่า LoRA เตรียมชุดข้อมูล และกำหนดค่า WandB ขั้นตอนต่อไปคือการฝึกโมเดลกับข้อมูล เพื่อสิ่งนั้น เราจำเป็นต้องกำหนดเทรนเนอร์จากไลบรารี Trl เราจะใช้ SFtrainer จาก Trl แต่ก่อนหน้านั้น ให้เริ่มต้น WandB และกำหนดข้อโต้แย้งการฝึกอบรมที่เหมาะสม

import os

from trl import SFTTrainer

from transformers import TrainingArguments

from transformers.utils import logging

import wandb

logging.set_verbosity_info()

project_name = "tiny-llama"

entity = "wandb"

# os.environ["WANDB_LOG_MODEL"] = "checkpoint"

wandb.init(project=project_name, name = "tiny-llama-unsloth-sft")ข้อโต้แย้งการฝึกอบรม

args = TrainingArguments(

per_device_train_batch_size = 2,

per_device_eval_batch_size=2,

gradient_accumulation_steps = 4,

evaluation_strategy="steps",

warmup_ratio = 0.1,

num_train_epochs = 1,

learning_rate = 2e-5,

fp16 = not torch.cuda.is_bf16_supported(),

bf16 = torch.cuda.is_bf16_supported(),

optim = "adamw_8bit",

weight_decay = 0.1,

lr_scheduler_type = "linear",

seed = 3407,

output_dir = "outputs",

report_to="wandb", # enable logging to W&B

# run_name="tiny-llama-alpaca-run", # name of the W&B run (optional)

logging_steps=1, # how often to log to W&B

logging_strategy = 'steps',

save_total_limit=2,

)นี่เป็นสิ่งสำคัญสำหรับการฝึกอบรม เพื่อให้การใช้งาน GPU ต่ำ ให้ฝึก แบทช์ประเมิน และขั้นตอนการสะสมการไล่ระดับสีต่ำ logging_steps คือจำนวนขั้นตอนก่อนที่ตัววัดจะถูกบันทึกลงใน WandB

ตอนนี้เริ่มต้น SFTTrainer

trainer = SFTTrainer(

model = model,

tokenizer = tokenizer,

train_dataset = dataset_dict["train"],

eval_dataset=dataset_dict["test"],

dataset_text_field = "text",

max_seq_length = max_seq_length,

dataset_num_proc = 2,

packing = True, # Packs short sequences together to save time!

args = args,

)เอาล่ะ เริ่มการฝึกได้เลย

trainer_stats = trainer.train()

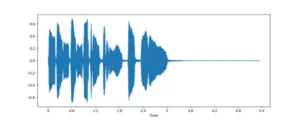

wandb.finish()ในระหว่างการฝึกซ้อม WandB จะติดตามการฝึกซ้อมและการวัดผล คุณไปที่ลิงก์แดชบอร์ดที่ให้มาและดูแบบเรียลไทม์

นี่คือภาพหน้าจอจากการวิ่งของฉันบนสมุดบันทึก Colab

ความเร็วการฝึกจะขึ้นอยู่กับปัจจัยหลายประการ รวมถึงขนาดข้อมูลการฝึกและการประเมิน ขนาดแบตช์การฝึกและการประเมิน และจำนวนยุค หากคุณพบปัญหาการใช้งาน GPU ให้ลองลดขนาดขั้นตอนการสะสมแบบแบตช์และการไล่ระดับสี ขนาดชุดรถไฟ = ชุด_ขนาด_ต่อ_อุปกรณ์ * การไล่ระดับสี_สะสม_ขั้นตอน และจำนวนขั้นตอนการเพิ่มประสิทธิภาพ = ข้อมูลการฝึกอบรมทั้งหมด/ขนาดชุดงาน คุณสามารถเล่นกับพารามิเตอร์และดูว่าอันไหนทำงานได้ดีกว่า

คุณสามารถเห็นภาพการสูญเสียการฝึกอบรมและการประเมินผลการฝึกอบรมของคุณได้บนแดชบอร์ด WandB

การสูญเสียรถไฟ

การสูญเสียการประเมิน

การอ้างอิง

คุณสามารถบันทึกอะแดปเตอร์ LoRA ไว้ในเครื่องหรือส่งไปยัง HuggingFace Repository

model.save_pretrained("lora_model") # Local saving

# model.push_to_hub("your_name/lora_model", token = "...") # Online savingคุณยังสามารถโหลดโมเดลที่บันทึกไว้จากดิสก์และใช้เพื่ออนุมานได้

if False:

from unsloth import FastLanguageModel

model, tokenizer = FastLanguageModel.from_pretrained(

model_name = "lora_model", # YOUR MODEL YOU USED FOR TRAINING

max_seq_length = max_seq_length,

dtype = dtype,

load_in_4bit = load_in_4bit,

)

inputs = tokenizer(

[

alpaca_prompt.format(

"capital of France?", # instruction

"", # input

"", # output - leave this blank for a generation!

)

]*1, return_tensors = "pt").to("cuda")

outputs = model.generate(**inputs, max_new_tokens = 64, use_cache = True)

tokenizer.batch_decode(outputs)สำหรับการสตรีมการตอบสนองของโมเดล

from transformers import TextStreamer

text_streamer = TextStreamer(tokenizer)

_ = model.generate(**inputs, streamer = text_streamer, max_new_tokens = 64)ดังนั้น ทั้งหมดนี้เกี่ยวกับการปรับแต่งโมเดล Tiny-Llama ด้วยการบันทึก WandB อย่างละเอียด

ที่นี่คือ สมุดบันทึก Colab สำหรับเดียวกัน

สรุป

LLM ขนาดเล็กอาจเป็นประโยชน์สำหรับการปรับใช้บนฮาร์ดแวร์ที่จำกัดการประมวลผล เช่น คอมพิวเตอร์ส่วนบุคคล โทรศัพท์มือถือ และอุปกรณ์สวมใส่อื่นๆ เป็นต้น การปรับแต่งอย่างละเอียดช่วยให้โมเดลเหล่านี้ทำงานได้ดีขึ้นในงานดาวน์สตรีม ในบทความนี้ เราได้เรียนรู้วิธีปรับแต่งโมเดลภาษาฐานบนชุดข้อมูลอย่างละเอียด

ประเด็นที่สำคัญ

- การปรับแต่งอย่างละเอียดเป็นกระบวนการในการสร้างแบบจำลองที่ได้รับการฝึกอบรมมาล่วงหน้าเพื่อปรับให้เข้ากับงานใหม่ที่เฉพาะเจาะจง

- Tiny-Llama เป็น LLM ที่มีพารามิเตอร์เพียง 1.1 พันล้านพารามิเตอร์และได้รับการฝึกอบรมเกี่ยวกับโทเค็น 3 ล้านล้านโทเค็น

- มีหลายวิธีในการปรับแต่ง LLM เช่น LoRA และ QLoRA

- Unsloth เป็นแพลตฟอร์มโอเพ่นซอร์สที่ให้บริการ LLM ที่ปรับให้เหมาะสมกับ CUDA เพื่อเร่งความเร็วในการปรับแต่ง LLM อย่างละเอียด

- Weights and Biases (WandB) เป็นเครื่องมือสำหรับติดตามและจัดเก็บการทดลอง ML

คำถามที่พบบ่อย

ก. การปรับแต่งอย่างละเอียดในบริบทของแมชชีนเลิร์นนิง โดยเฉพาะอย่างยิ่งการเรียนรู้เชิงลึก เป็นเทคนิคที่คุณนำโมเดลที่ได้รับการฝึกมาล่วงหน้ามาปรับใช้กับงานใหม่ที่เฉพาะเจาะจง

ตอบ คุณสามารถปรับแต่ง LLM ขนาดเล็กได้ฟรีบน Colab เหนือ Tesla T4 GPU ด้วย QLoRA

A. การปรับแต่งอย่างละเอียดช่วยเพิ่มขีดความสามารถของ LLM ในการทำงานขั้นปลาย เช่น บทบาทสมมติ การสร้างโค้ด ฯลฯ

A. Tiny-Llama ฝึกฝนด้วยโทเค็น 3 ล้านล้านโทเค็นเป็น LLM ที่มีพารามิเตอร์ 1.1B โมเดลนี้ใช้สถาปัตยกรรม Llama-2 ดั้งเดิม

A. Unsloth เป็นเครื่องมือโอเพ่นซอร์สที่ให้การปรับแต่ง LLM แบบละเอียดได้เร็วและมีประสิทธิภาพยิ่งขึ้นโดยการปรับแต่งเคอร์เนล GPU ด้วย Triton

สื่อที่แสดงในบทความนี้ไม่ได้เป็นของ Analytics Vidhya และถูกใช้ตามดุลยพินิจของผู้เขียน

ที่เกี่ยวข้อง

- เนื้อหาที่ขับเคลื่อนด้วย SEO และการเผยแพร่ประชาสัมพันธ์ รับการขยายวันนี้

- PlatoData.Network Vertical Generative Ai เพิ่มพลังให้กับตัวเอง เข้าถึงได้ที่นี่.

- เพลโตไอสตรีม. Web3 อัจฉริยะ ขยายความรู้ เข้าถึงได้ที่นี่.

- เพลโตESG. คาร์บอน, คลีนเทค, พลังงาน, สิ่งแวดล้อม แสงอาทิตย์, การจัดการของเสีย. เข้าถึงได้ที่นี่.

- เพลโตสุขภาพ เทคโนโลยีชีวภาพและข่าวกรองการทดลองทางคลินิก เข้าถึงได้ที่นี่.

- ที่มา: https://www.analyticsvidhya.com/blog/2024/02/fine-tuning-a-tiny-llama-model-with-unsloth/

- :มี

- :เป็น

- :ไม่

- :ที่ไหน

- $ ขึ้น

- 1

- 11

- 12

- ลด 15%

- 16

- 1b

- 258

- 32

- 7

- 8

- a

- A100

- สามารถ

- เกี่ยวกับเรา

- ลงชื่อเข้าใช้

- ขุม

- ความถูกต้อง

- ปรับ

- การปรับตัว

- เพิ่ม

- ทั้งหมด

- ช่วยให้

- ด้วย

- จำนวน

- an

- การวิเคราะห์

- การวิเคราะห์ วิทยา

- และ

- ใด

- API

- app

- ใช้

- การประยุกต์ใช้

- เหมาะสม

- อย่างเหมาะสม

- สถาปัตยกรรม

- เป็น

- ข้อโต้แย้ง

- รอบ

- บทความ

- AS

- At

- รถยนต์

- อวตาร

- b

- ฐาน

- ตาม

- BE

- รับ

- ก่อน

- ด้านล่าง

- เป็นประโยชน์

- ประโยชน์ที่ได้รับ

- ที่ดีที่สุด

- ดีกว่า

- อคติ

- อคติ

- พันล้าน

- บิต

- บิต

- ว่างเปล่า

- บล็อกกาธอน

- สั้น

- นำมาซึ่ง

- แต่

- by

- CAN

- ความสามารถในการ

- ความสามารถ

- เมืองหลวง

- กรณี

- หมวดหมู่

- พูดคุย

- Choose

- ชั้น

- รหัส

- กะทัดรัด

- เทียบเคียง

- สมบูรณ์

- เสร็จสิ้น

- คอมพิวเตอร์

- แนวความคิด

- องค์ประกอบ

- การกำหนดค่า

- ผู้บริโภค

- ฮาร์ดแวร์สำหรับผู้บริโภค

- สิ่งแวดล้อม

- การสนทนา

- สร้าง

- ที่สร้างขึ้น

- สำคัญมาก

- ปัจจุบัน

- ขณะนี้

- ประเพณี

- แดช หรือ Dash

- หน้าปัด

- ข้อมูล

- ชุดข้อมูล

- ทุ่มเท

- ลึก

- การเรียนรู้ลึก ๆ

- กำหนด

- ขึ้นอยู่กับ

- ขึ้นอยู่กับ

- ปรับใช้

- ปรับใช้

- สัญญาซื้อขายล่วงหน้า

- อธิบาย

- การตรวจพบ

- การหารือ

- ต่าง

- ดุลพินิจ

- do

- ลง

- ก่อน

- ขอบ

- มีประสิทธิภาพ

- อย่างมีประสิทธิภาพ

- ที่มีประสิทธิภาพ

- อื่น

- ภาวะฉุกเฉิน

- ทำให้สามารถ

- พบ

- เครื่องยนต์

- ช่วย

- พอ

- เอกลักษณ์

- สิ่งแวดล้อม

- ยุค

- โดยเฉพาะอย่างยิ่ง

- จำเป็น

- ฯลฯ

- อีเธอร์ (ETH)

- การประเมินผล

- ตัวอย่าง

- ตัวอย่าง

- การทดลอง

- สำรวจ

- ปัจจัย

- ล้มเหลว

- เท็จ

- ไกล

- เร็วขึ้น

- สองสาม

- น้อยลง

- ลอย

- ที่ลอย

- ดังต่อไปนี้

- สำหรับ

- รูป

- ฝรั่งเศส

- ฟรี

- ราคาเริ่มต้นที่

- ต่อไป

- เมถุน

- จุดประสงค์ทั่วไป

- รุ่น

- ได้รับ

- ไป

- กำหนด

- จะช่วยให้

- Go

- GPU

- GPUs

- ยิ่งใหญ่

- ฮาร์ดแวร์

- มี

- โปรดคลิกที่นี่เพื่ออ่านรายละเอียดเพิ่มเติม

- จุดสูง

- สูงกว่า

- ถือ

- สรุป ความน่าเชื่อถือของ Olymp Trade?

- ทำอย่างไร

- อย่างไรก็ตาม

- HTTPS

- กอดใบหน้า

- i

- if

- การดำเนินการ

- นำเข้า

- สำคัญ

- ปรับปรุง

- in

- รวมทั้ง

- อินพุต

- ปัจจัยการผลิต

- ติดตั้ง

- แทน

- คำแนะนำการใช้

- ตั้งใจว่า

- เข้าไป

- ที่เกี่ยวข้องกับการ

- ปัญหา

- IT

- jpg

- เก็บ

- การเก็บรักษา

- คีย์

- ความรู้

- kumar

- ภาษา

- ใหญ่

- ที่มีขนาดใหญ่

- นำไปสู่

- เรียนรู้

- ได้เรียนรู้

- การเรียนรู้

- ทิ้ง

- น้อยลง

- ช่วยให้

- ห้องสมุด

- กดไลก์

- ไฟแก็ซ

- เชิงเส้น

- LINK

- ดูรายละเอียด

- llm

- โหลด

- โหลด

- ในประเทศ

- ในท้องถิ่น

- เข้าสู่ระบบ

- เข้า

- การเข้าสู่ระบบ

- ปิด

- ต่ำ

- ลด

- เครื่อง

- เรียนรู้เครื่อง

- ทำ

- การทำ

- จัดการ

- คู่มือ

- ความกว้างสูงสุด

- ภาพบรรยากาศ

- หน่วยความจำ

- กล่าวถึง

- วิธีการ

- ตัวชี้วัด

- ML

- โทรศัพท์มือถือ

- โทรศัพท์มือถือ

- แบบ

- โมเดล

- ข้อมูลเพิ่มเติม

- มีประสิทธิภาพมากขึ้น

- มากที่สุด

- หลาย

- ต้อง

- my

- ชื่อ

- จำเป็นต้อง

- ใหม่

- ถัดไป

- ไม่มี

- สมุดบันทึก

- จำนวน

- of

- มักจะ

- เก่ากว่า

- on

- ออนไลน์

- เพียง

- โอเพนซอร์ส

- OpenAI

- การเพิ่มประสิทธิภาพ

- การปรับให้เหมาะสม

- การเพิ่มประสิทธิภาพ

- or

- เป็นต้นฉบับ

- OS

- อื่นๆ

- มิฉะนั้น

- ของเรา

- ออก

- เอาท์พุต

- เอาท์พุท

- เกิน

- เป็นเจ้าของ

- แพ็ค

- จับคู่

- พารามิเตอร์

- พารามิเตอร์

- ส่วนหนึ่ง

- ส่ง

- ดำเนินการ

- ที่มีประสิทธิภาพ

- ส่วนบุคคล

- คอมพิวเตอร์ส่วนบุคคล

- โทรศัพท์

- ภาพ

- เวที

- เพลโต

- เพลโตดาต้าอินเทลลิเจนซ์

- เพลโตดาต้า

- เล่น

- จุด

- ยอดนิยม

- เป็นไปได้

- ความแม่นยำ

- เตรียมการ

- เตรียม

- กระบวนการ

- การผลิต

- เป็นเจ้าของ

- ให้

- การตีพิมพ์

- ผลัก

- Q & A

- คุณภาพ

- R

- อันดับ

- เรียลไทม์

- ลด

- ลด

- การลดลง

- การเผยแพร่

- กรุ

- ขอ

- ต้อง

- การวิจัย

- คำตอบ

- การตอบสนอง

- กลับ

- บทบาท

- RTX

- วิ่ง

- เดียวกัน

- ลด

- ที่บันทึกไว้

- ประหยัด

- ปรับ

- วิทยาศาสตร์

- เห็น

- เมล็ดพันธุ์

- เลือก

- ชุด

- สั้น

- แสดง

- ลงชื่อ

- ตั้งแต่

- ขนาด

- ขนาด

- ช้า

- เล็ก

- มีขนาดเล็กกว่า

- โดยเฉพาะ

- ความเร็ว

- แยก

- ยืน

- เริ่มต้น

- ขั้นตอน

- ขั้นตอน

- ที่พริ้ว

- การต่อสู้

- เป็นกอบเป็นกำ

- อย่างเช่น

- สนับสนุน

- รองรับ

- เอา

- นำ

- งาน

- งาน

- เทคนิค

- เทคนิค

- เทสลา

- ทดสอบ

- ข้อความ

- การสร้างข้อความ

- กว่า

- ที่

- พื้นที่

- ของพวกเขา

- พวกเขา

- แล้วก็

- ที่นั่น

- ล้อยางขัดเหล่านี้ติดตั้งบนแกน XNUMX (มม.) ผลิตภัณฑ์นี้ถูกผลิตในหลายรูปทรง และหลากหลายเบอร์ความแน่นหนาของปริมาณอนุภาคขัดของมัน จะทำให้ท่านได้รับประสิทธิภาพสูงในการขัดและการใช้งานที่ยาวนาน

- พวกเขา

- สิ่ง

- นี้

- ตลอด

- เวลา

- ไปยัง

- ร่วมกัน

- โทเค็น

- ราชสกุล

- เกินไป

- เอา

- เครื่องมือ

- เครื่องมือ

- ไฟฉาย

- รวม

- ลู่

- การติดตาม

- รถไฟ

- ผ่านการฝึกอบรม

- การฝึกอบรม

- หม้อแปลง

- ล้านล้าน

- ไทรทัน

- จริง

- ลอง

- การปรับปรุง

- us

- การใช้

- ใช้

- มือสอง

- ความคุ้มค่า

- รุ่น

- ผ่านทาง

- เยี่ยมชมร้านค้า

- เห็นภาพ

- คือ

- ทาง..

- วิธี

- we

- อุปกรณ์ที่สวมใส่

- เว็บ

- webp

- น้ำหนัก

- ดี

- คือ

- อะไร

- ความหมายของ

- เมื่อ

- ที่

- ในขณะที่

- จะ

- กับ

- โรงงาน

- เขียน

- เธอ

- ของคุณ

- ลมทะเล