ค่าของข้อมูลมีความสำคัญตามเวลา การประมวลผลตามเวลาจริงทำให้การตัดสินใจที่ขับเคลื่อนด้วยข้อมูลมีความแม่นยำและสามารถดำเนินการได้ในไม่กี่วินาทีหรือนาทีแทนที่จะเป็นชั่วโมงหรือเป็นวัน Change data capture (CDC) หมายถึงกระบวนการระบุและบันทึกการเปลี่ยนแปลงที่ทำกับข้อมูลในฐานข้อมูล จากนั้นจึงส่งการเปลี่ยนแปลงเหล่านั้นแบบเรียลไทม์ไปยังระบบดาวน์สตรีม การบันทึกทุกการเปลี่ยนแปลงจากธุรกรรมในฐานข้อมูลต้นทางและย้ายไปยังเป้าหมายตามเวลาจริงทำให้ระบบซิงโครไนซ์ และช่วยให้มีกรณีการใช้งานการวิเคราะห์แบบเรียลไทม์และการย้ายฐานข้อมูลที่ไม่มีเวลาหยุดทำงาน ต่อไปนี้เป็นประโยชน์บางประการของ CDC:

- ช่วยลดความจำเป็นในการอัปเดตการโหลดจำนวนมากและหน้าต่างแบทช์ที่ไม่สะดวก โดยเปิดใช้งานการโหลดส่วนเพิ่มหรือการสตรีมการเปลี่ยนแปลงข้อมูลตามเวลาจริงไปยังพื้นที่เก็บข้อมูลเป้าหมายของคุณ

- ช่วยให้มั่นใจได้ว่าข้อมูลในหลาย ๆ ระบบยังคงซิงค์กัน นี่เป็นสิ่งสำคัญอย่างยิ่งหากคุณตัดสินใจเรื่องเวลาในสภาพแวดล้อมข้อมูลความเร็วสูง

คาฟคาคอนเน็ค เป็นคอมโพเนนต์โอเพ่นซอร์สของ Apache Kafka ที่ทำงานเป็นฮับข้อมูลส่วนกลางสำหรับการรวมข้อมูลอย่างง่ายระหว่างฐานข้อมูล ที่เก็บคีย์-ค่า ดัชนีการค้นหา และระบบไฟล์ เดอะ รีจิสทรี AWS Glue Schema ช่วยให้คุณค้นหา ควบคุม และพัฒนาสคีมาสตรีมข้อมูลได้จากส่วนกลาง Kafka Connect และ Schema Registry ผสานรวมเพื่อรวบรวมข้อมูลสคีมาจากตัวเชื่อมต่อ Kafka Connect มีกลไกในการแปลงข้อมูลจากประเภทข้อมูลภายในที่ใช้โดย Kafka Connect เป็นประเภทข้อมูลที่แสดงเป็น Avro, Protobuf หรือ JSON Schema AvroConverter, ProtobufConverter และ JsonSchemaConverter ลงทะเบียน schema ที่สร้างโดยตัวเชื่อมต่อ Kafka (แหล่งที่มา) ที่สร้างข้อมูลไปยัง Kafka โดยอัตโนมัติ ตัวเชื่อมต่อ (ซิงค์) ที่ใช้ข้อมูลจาก Kafka จะได้รับข้อมูลสคีมานอกเหนือจากข้อมูลสำหรับแต่ละข้อความ ซึ่งช่วยให้ตัวเชื่อมต่อซิงก์ทราบโครงสร้างของข้อมูลเพื่อให้มีความสามารถ เช่น การรักษาสคีมาของตารางฐานข้อมูลในแค็ตตาล็อกข้อมูล

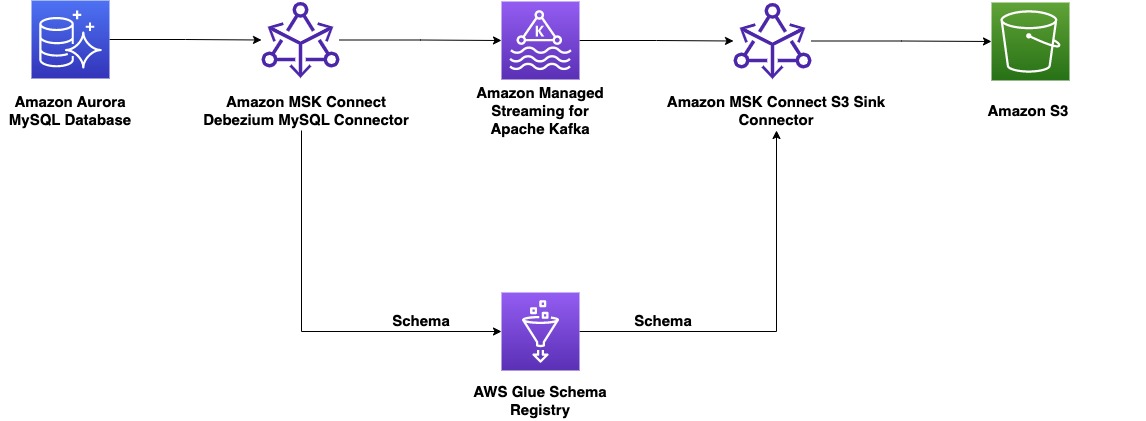

โพสต์สาธิตวิธีสร้าง CDC แบบ end-to-end โดยใช้ การเชื่อมต่อ Amazon MSKซึ่งเป็นบริการที่มีการจัดการของ AWS เพื่อปรับใช้และเรียกใช้แอปพลิเคชัน Kafka Connect และ AWS Glue Schema Registry ซึ่งช่วยให้คุณค้นหา ควบคุม และพัฒนาสคีมาสตรีมข้อมูลได้จากส่วนกลาง

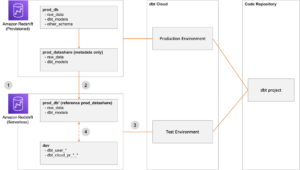

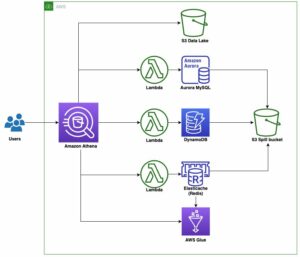

ภาพรวมโซลูชัน

ในด้านผู้ผลิต สำหรับตัวอย่างนี้ เราเลือก MySQL-compatible อเมซอน ออโรร่า ฐานข้อมูลเป็นแหล่งข้อมูล และเรามี ดีเบเซียม ตัวเชื่อมต่อ MySQL เพื่อดำเนินการ CDC ตัวเชื่อมต่อ Debezium ตรวจสอบฐานข้อมูลอย่างต่อเนื่องและผลักดันการเปลี่ยนแปลงระดับแถวไปยังหัวข้อ Kafka ตัวเชื่อมต่อจะดึงสคีมาจากฐานข้อมูลเพื่อทำให้ระเบียนเป็นอนุกรมในรูปแบบไบนารี ถ้าไม่มีสคีมาในรีจิสทรี สคีมาจะถูกลงทะเบียน หากมีสคีมาแต่ซีเรียลไลเซอร์กำลังใช้เวอร์ชันใหม่ รีจิสทรีสคีมาจะตรวจสอบ โหมดที่เข้ากัน ของสคีมาก่อนที่จะอัปเดตสคีมา ในการแก้ปัญหานี้ เราใช้ โหมดความเข้ากันได้ย้อนหลัง. รีจิสทรีของสคีมาส่งคืนข้อผิดพลาดหากเวอร์ชันใหม่ของสคีมาไม่รองรับเวอร์ชันเก่า และเราสามารถกำหนดค่า Kafka Connect ให้ส่งข้อความที่เข้ากันไม่ได้ไปยังคิวจดหมายเสียได้

ในด้านผู้บริโภค เราใช้ บริการจัดเก็บข้อมูลอย่างง่ายของ Amazon ตัวเชื่อมต่อ Sink (Amazon S3) เพื่อยกเลิกการซีเรียลไลซ์บันทึกและจัดเก็บการเปลี่ยนแปลงไปยัง Amazon S3 เราสร้างและใช้งานตัวเชื่อมต่อ Debezium และซิงก์ Amazon S3 โดยใช้ MSK Connect

ตัวอย่างสคีมา

สำหรับโพสต์นี้ เราใช้สคีมาต่อไปนี้เป็นเวอร์ชันแรกของตาราง:

เบื้องต้น

ก่อนกำหนดค่าตัวเชื่อมต่อผู้ผลิตและผู้บริโภค MSK เราต้องตั้งค่าแหล่งข้อมูล คลัสเตอร์ MSK และการลงทะเบียนสคีมาใหม่ก่อน เราให้บริการ การก่อตัวของ AWS Cloud เทมเพลตเพื่อสร้างทรัพยากรสนับสนุนที่จำเป็นสำหรับโซลูชัน:

- ฐานข้อมูล Aurora ที่เข้ากันได้กับ MySQL เป็นแหล่งข้อมูล ในการดำเนินการ CDC เราเปิดการบันทึกแบบไบนารีใน กลุ่มพารามิเตอร์คลัสเตอร์ DB.

- กลุ่ม MSK เพื่อให้การเชื่อมต่อเครือข่ายง่ายขึ้น เราใช้ VPC เดียวกันสำหรับฐานข้อมูล Aurora และคลัสเตอร์ MSK

- การลงทะเบียนสคีมาสองรายการเพื่อจัดการสคีมาสำหรับคีย์ข้อความและค่าข้อความ

- ที่ฝากข้อมูล S3 หนึ่งถังเป็นอ่างข้อมูล

- ปลั๊กอิน MSK Connect และการกำหนดค่าผู้ปฏิบัติงานที่จำเป็นสำหรับการสาธิตนี้

- หนึ่ง อเมซอน อีลาสติก คอมพิวท์ คลาวด์ (Amazon EC2) เพื่อเรียกใช้คำสั่งฐานข้อมูล

ในการตั้งค่าทรัพยากรในบัญชี AWS ของคุณ ให้ทำตามขั้นตอนต่อไปนี้ในภูมิภาค AWS ที่รองรับ Amazon MSK, MSK Connect และ AWS Glue Schema Registry:

- Choose เรียกใช้ Stack:

- Choose ถัดไป.

- สำหรับ ชื่อกอง, ใส่ชื่อที่เหมาะสม.

- สำหรับ รหัสผ่านฐานข้อมูลให้ป้อนรหัสผ่านที่คุณต้องการสำหรับผู้ใช้ฐานข้อมูล

- เก็บค่าอื่นๆ เป็นค่าเริ่มต้น

- Choose ถัดไป.

- ในหน้าถัดไป เลือก ถัดไป.

- ตรวจสอบรายละเอียดในหน้าสุดท้ายและเลือก ฉันรับทราบว่า AWS CloudFormation อาจสร้างทรัพยากร IAM.

- Choose สร้าง stack.

ปลั๊กอินแบบกำหนดเองสำหรับตัวเชื่อมต่อต้นทางและปลายทาง

ปลั๊กอินแบบกำหนดเองคือชุดของไฟล์ JAR ที่มีการใช้งานตัวเชื่อมต่อ ตัวแปลง หรือตัวแปลงตั้งแต่หนึ่งตัวขึ้นไป Amazon MSK จะติดตั้งปลั๊กอินบนผู้ปฏิบัติงานของคลัสเตอร์ MSK Connect ที่ตัวเชื่อมต่อทำงานอยู่ ในส่วนของการสาธิตนี้ สำหรับเครื่องมือเชื่อมต่อต้นทาง เราใช้โอเพ่นซอร์ส JARs ตัวเชื่อมต่อ Debezium MySQLและสำหรับเครื่องมือเชื่อมต่อปลายทาง เราใช้ใบอนุญาตของชุมชนคอนฟลูเอนเซอร์ JAR ตัวเชื่อมต่อ Sink ของ Amazon S3. ปลั๊กอินทั้งสองยังเพิ่มด้วยไลบรารีสำหรับ Avro Serializers และ Deserializers ของ AWS Glue Schema Registry ปลั๊กอินแบบกำหนดเองเหล่านี้ถูกสร้างขึ้นแล้วโดยเป็นส่วนหนึ่งของเทมเพลต CloudFormation ที่ปรับใช้ในขั้นตอนก่อนหน้า

ใช้ AWS Glue Schema Registry กับตัวเชื่อมต่อ Debezium บน MSK Connect เป็นตัวสร้าง MSK

ก่อนอื่น เราปรับใช้ตัวเชื่อมต่อต้นทางโดยใช้ปลั๊กอิน Debezium MySQL เพื่อสตรีมข้อมูลจาก Amazon Aurora รุ่นที่รองรับ MySQL ฐานข้อมูลไปยัง Amazon MSK ทำตามขั้นตอนต่อไปนี้:

- บนคอนโซล Amazon MSK ในบานหน้าต่างนำทาง ภายใต้ MSK เชื่อมต่อเลือก เชื่อมต่อ.

- Choose สร้างตัวเชื่อมต่อ.

- Choose ใช้ปลั๊กอินที่กำหนดเองที่มีอยู่ จากนั้นเลือกปลั๊กอินแบบกำหนดเองที่มีชื่อขึ้นต้น

msk-blog-debezium-source-plugin. - Choose ถัดไป.

- ใส่ชื่อที่เหมาะสมเช่น

debezium-mysql-connectorและคำอธิบายเพิ่มเติม - สำหรับ คลัสเตอร์ Apache Kafkaเลือก คลัสเตอร์ MSK และเลือกคลัสเตอร์ที่สร้างโดยเทมเพลต CloudFormation

- In การกำหนดค่าตัวเชื่อมต่อให้ลบค่าเริ่มต้นและใช้คู่คีย์-ค่าการกำหนดค่าต่อไปนี้และด้วยค่าที่เหมาะสม:

- ชื่อ – ชื่อที่ใช้สำหรับตัวเชื่อมต่อ

- ฐานข้อมูล.ชื่อโฮสต์ – เอาต์พุต CloudFormation สำหรับ จุดสิ้นสุดของฐานข้อมูล.

- ฐานข้อมูลผู้ใช้และฐานข้อมูลรหัสผ่าน – พารามิเตอร์ที่ส่งผ่านในเทมเพลต CloudFormation

- ฐานข้อมูลhistory.kafka.bootstrap.servers – เอาต์พุต CloudFormation สำหรับ คาฟคา บูตสแตรป.

- key.converter.region และ value.converter.region - ภูมิภาคของคุณ

การตั้งค่าเหล่านี้บางส่วนเป็นค่าทั่วไปและควรระบุสำหรับตัวเชื่อมต่อใดๆ ตัวอย่างเช่น:

- connector.class คือคลาส Java ของตัวเชื่อมต่อ

- task.max คือจำนวนงานสูงสุดที่ควรสร้างสำหรับตัวเชื่อมต่อนี้

การตั้งค่าบางอย่าง (database.*, transforms.*) เฉพาะสำหรับตัวเชื่อมต่อ Debezium MySQL อ้างถึง คุณสมบัติการกำหนดค่าตัวเชื่อมต่อที่มา Debezium MySQL สำหรับข้อมูลเพิ่มเติม

การตั้งค่าบางอย่าง (key.converter.* และ value.converter.*) เฉพาะสำหรับ Schema Registry เราใช้ AWSKafkaAvroConverter จาก ไลบรารี AWS Glue Schema Registry เป็นตัวแปลงรูปแบบ ในการกำหนดค่า AWSKafkaAvroConverterเราใช้ค่าของคุณสมบัติค่าคงที่ของสตริงใน AWSSchemaRegistryConstants ระดับ:

key.converterและvalue.converterควบคุมรูปแบบของข้อมูลที่จะเขียนไปยัง Kafka สำหรับตัวเชื่อมต่อต้นทางหรืออ่านจาก Kafka สำหรับตัวเชื่อมต่อ Sink เราใช้AWSKafkaAvroConverterสำหรับรูปแบบ Avrokey.converter.registry.nameและvalue.converter.registry.nameกำหนดว่าจะใช้รีจิสทรีสคีมาใดkey.converter.compatibilityและvalue.converter.compatibilityกำหนดรูปแบบความเข้ากันได้

เอ่ยถึง การใช้ Kafka Connect กับ AWS Glue Schema Registry สำหรับข้อมูลเพิ่มเติม

- ต่อไป เรากำหนดค่า ความจุของตัวเชื่อมต่อ. เราเลือกได้ จัดสรร และปล่อยให้คุณสมบัติอื่นเป็นค่าเริ่มต้น

- สำหรับ การกำหนดค่าผู้ปฏิบัติงานให้เลือกการกำหนดค่าผู้ปฏิบัติงานแบบกำหนดเองที่มีชื่อขึ้นต้น

msk-gsr-blogสร้างขึ้นโดยเป็นส่วนหนึ่งของเทมเพลต CloudFormation - สำหรับ สิทธิ์การเข้าถึง, ใช้ AWS Identity และการจัดการการเข้าถึง บทบาท (IAM) ที่สร้างโดยเทมเพลต CloudFormation

MSKConnectRole. - Choose ถัดไป.

- สำหรับ Securityให้เลือกค่าเริ่มต้น

- Choose ถัดไป.

- สำหรับ บันทึกการจัดส่งให้เลือก ส่งไปยัง Amazon CloudWatch Logs และเรียกดูกลุ่มบันทึกที่สร้างโดยเทมเพลต CloudFormation (

msk-connector-logs). - Choose ถัดไป.

- ตรวจสอบการตั้งค่าและเลือก สร้างตัวเชื่อมต่อ.

หลังจากนั้นไม่กี่นาที ตัวเชื่อมต่อจะเปลี่ยนเป็นสถานะกำลังทำงาน

ใช้ AWS Glue Schema Registry กับตัวเชื่อมต่อ S3 Sink ที่ทำงานบน MSK Connect ในฐานะผู้ใช้ MSK

เราปรับใช้ตัวเชื่อมต่อซิงก์โดยใช้ปลั๊กอินซิงก์ Confluent S3 เพื่อสตรีมข้อมูลจาก Amazon MSK ไปยัง Amazon S3 ทำตามขั้นตอนต่อไปนี้:

-

- บนคอนโซล Amazon MSK ในบานหน้าต่างนำทาง ภายใต้ MSK เชื่อมต่อเลือก เชื่อมต่อ.

- Choose สร้างตัวเชื่อมต่อ.

- Choose ใช้ปลั๊กอินที่กำหนดเองที่มีอยู่ และเลือกปลั๊กอินแบบกำหนดเองที่มีชื่อขึ้นต้น

msk-blog-S3sink-plugin. - Choose ถัดไป.

- ใส่ชื่อที่เหมาะสมเช่น

s3-sink-connectorและคำอธิบายเพิ่มเติม - สำหรับ คลัสเตอร์ Apache Kafkaเลือก คลัสเตอร์ MSK และเลือกคลัสเตอร์ที่สร้างโดยเทมเพลต CloudFormation

- In การกำหนดค่าตัวเชื่อมต่อลบค่าดีฟอลต์ที่มีให้ และใช้คู่คีย์-ค่าคอนฟิกูเรชันต่อไปนี้ด้วยค่าที่เหมาะสม:

-

- ชื่อ – ชื่อเดียวกับที่ใช้สำหรับตัวเชื่อมต่อ

- s3.bucket.name – เอาต์พุต CloudFormation สำหรับ ชื่อที่เก็บข้อมูล.

- s3.region, key.converter.region และ value.converter.region - ภูมิภาคของคุณ

-

- ต่อไป เรากำหนดค่า ความจุของตัวเชื่อมต่อ. เราเลือกได้ จัดสรร และปล่อยให้คุณสมบัติอื่นเป็นค่าเริ่มต้น

- สำหรับ การกำหนดค่าผู้ปฏิบัติงานให้เลือกการกำหนดค่าผู้ปฏิบัติงานแบบกำหนดเองที่มีชื่อขึ้นต้น

msk-gsr-blogสร้างขึ้นโดยเป็นส่วนหนึ่งของเทมเพลต CloudFormation - สำหรับ สิทธิ์การเข้าถึงให้ใช้บทบาท IAM ที่สร้างโดยเทมเพลต CloudFormation

MSKConnectRole. - Choose ถัดไป.

- สำหรับ Securityให้เลือกค่าเริ่มต้น

- Choose ถัดไป.

- สำหรับ บันทึกการจัดส่งให้เลือก ส่งไปยัง Amazon CloudWatch Logs และเรียกดูกลุ่มบันทึกที่สร้างโดยเทมเพลต CloudFormation

msk-connector-logs. - Choose ถัดไป.

- ตรวจสอบการตั้งค่าและเลือก สร้างตัวเชื่อมต่อ.

หลังจากนั้นไม่กี่นาที ตัวเชื่อมต่อกำลังทำงานอยู่

ทดสอบสตรีมบันทึก CDC แบบ end-to-end

ตอนนี้ทั้งตัวเชื่อมต่ออ่างล้างจาน Debezium และ S3 พร้อมใช้งานแล้ว ให้ทำตามขั้นตอนต่อไปนี้เพื่อทดสอบ CDC จากต้นทางถึงปลายทาง:

- บนคอนโซล Amazon EC2 ให้ไปที่ กลุ่มความปลอดภัย หน้า.

- เลือกกลุ่มความปลอดภัย

ClientInstanceSecurityGroupและเลือก แก้ไขกฎขาเข้า. - เพิ่มกฎขาเข้าที่อนุญาตการเชื่อมต่อ SSH จากเครือข่ายท้องถิ่นของคุณ

- เกี่ยวกับ อินสแตนซ์ หน้า เลือกอินสแตนซ์

ClientInstanceและเลือก เชื่อมต่อ. - เกี่ยวกับ การเชื่อมต่ออินสแตนซ์ EC2 เลือกแท็บ เชื่อมต่อ.

- ตรวจสอบให้แน่ใจว่าไดเร็กทอรีการทำงานปัจจุบันของคุณคือ

/home/ec2-userและมีไฟล์create_table.sql,alter_table.sql,initial_insert.sqlและinsert_data_with_new_column.sql. - สร้างตารางในฐานข้อมูล MySQL ของคุณโดยเรียกใช้คำสั่งต่อไปนี้ (ระบุชื่อโฮสต์ฐานข้อมูลจากเอาต์พุตเทมเพลต CloudFormation):

- เมื่อได้รับแจ้งให้ใส่รหัสผ่าน ให้ป้อนรหัสผ่านจากพารามิเตอร์เทมเพลต CloudFormation

- แทรกข้อมูลตัวอย่างลงในตารางด้วยคำสั่งต่อไปนี้:

- เมื่อได้รับแจ้งให้ใส่รหัสผ่าน ให้ป้อนรหัสผ่านจากพารามิเตอร์เทมเพลต CloudFormation

- บนคอนโซล AWS Glue ให้เลือก การลงทะเบียนสคีมา ในบานหน้าต่างนำทาง จากนั้นเลือก แบบแผน.

- นำทางไปยัง

db1.sampledatabase.moviesเวอร์ชัน 1 เพื่อตรวจสอบสคีมาใหม่ที่สร้างขึ้นสำหรับตารางภาพยนตร์:

โฟลเดอร์ S3 แยกต่างหากจะถูกสร้างขึ้นสำหรับแต่ละพาร์ติชันของหัวข้อ Kafka และข้อมูลสำหรับหัวข้อจะถูกเขียนลงในโฟลเดอร์นั้น

- บนคอนโซล Amazon S3 ให้ตรวจสอบข้อมูลที่เขียนในรูปแบบ Parquet ในโฟลเดอร์สำหรับหัวข้อ Kafka ของคุณ

สคีมาวิวัฒนาการ

หลังจากกำหนดสคีมาเริ่มต้นแล้ว แอปพลิเคชันอาจต้องพัฒนาเมื่อเวลาผ่านไป เมื่อสิ่งนี้เกิดขึ้น ผู้บริโภคดาวน์สตรีมจึงจำเป็นอย่างยิ่งที่จะต้องสามารถจัดการกับข้อมูลที่เข้ารหัสด้วยสคีมาทั้งเก่าและใหม่ได้อย่างราบรื่น โหมดความเข้ากันได้ช่วยให้คุณควบคุมว่าสคีมาสามารถเปลี่ยนแปลงหรือไม่สามารถพัฒนาเมื่อเวลาผ่านไปได้อย่างไร โหมดเหล่านี้สร้างสัญญาระหว่างแอปพลิเคชันที่ผลิตและใช้งานข้อมูล สำหรับข้อมูลโดยละเอียดเกี่ยวกับโหมดความเข้ากันได้ต่างๆ ที่มีอยู่ใน AWS Glue Schema Registry โปรดดูที่ รีจิสทรี AWS Glue Schema. ในตัวอย่างของเรา เราใช้การรวมย้อนกลับเพื่อให้แน่ใจว่าผู้บริโภคสามารถอ่านทั้งเวอร์ชันปัจจุบันและเวอร์ชันก่อนหน้าของสคีมา ทำตามขั้นตอนต่อไปนี้:

- เพิ่มคอลัมน์ใหม่ลงในตารางโดยเรียกใช้คำสั่งต่อไปนี้:

- แทรกข้อมูลใหม่ลงในตารางโดยใช้คำสั่งต่อไปนี้:

- บนคอนโซล AWS Glue ให้เลือก การลงทะเบียนสคีมา ในบานหน้าต่างนำทาง จากนั้นเลือก แบบแผน.

- นำทางไปยังสคีมา

db1.sampledatabase.moviesเวอร์ชัน 2 เพื่อตรวจสอบเวอร์ชันใหม่ของสคีมาที่สร้างขึ้นสำหรับภาพยนตร์ตารางภาพยนตร์ รวมถึงคอลัมน์ประเทศที่คุณเพิ่ม:

- บนคอนโซล Amazon S3 ให้ตรวจสอบข้อมูลที่เขียนในรูปแบบ Parquet ในโฟลเดอร์สำหรับหัวข้อ Kafka

ทำความสะอาด

เพื่อช่วยป้องกันการเรียกเก็บเงินที่ไม่ต้องการไปยังบัญชี AWS ของคุณ ให้ลบทรัพยากร AWS ที่คุณใช้ในโพสต์นี้:

- บนคอนโซล Amazon S3 ให้ไปที่บัคเก็ต S3 ที่สร้างโดยเทมเพลต CloudFormation

- เลือกไฟล์และโฟลเดอร์ทั้งหมดแล้วเลือก ลบ.

- ป้อน ลบอย่างถาวรตามที่กำหนด แล้วเลือก ลบวัตถุ.

- บนคอนโซล AWS CloudFormation ให้ลบสแต็กที่คุณสร้างขึ้น

- รอให้สถานะสแต็กเปลี่ยนเป็น DELETE_COMPLETE.

สรุป

โพสต์นี้สาธิตวิธีใช้ Amazon MSK, MSK Connect และ AWS Glue Schema Registry เพื่อสร้างสตรีมบันทึก CDC และพัฒนาสกีมาสำหรับสตรีมข้อมูลเมื่อความต้องการทางธุรกิจเปลี่ยนแปลงไป คุณสามารถใช้รูปแบบสถาปัตยกรรมนี้กับแหล่งข้อมูลอื่นที่มีตัวเชื่อมต่อ Kafka ที่แตกต่างกัน สำหรับข้อมูลเพิ่มเติม โปรดดูที่ ตัวอย่างการเชื่อมต่อ MSK.

เกี่ยวกับผู้เขียน

กัลยาณยากี เป็นผู้เชี่ยวชาญด้าน Big Data & Analytics อาวุโสของ Amazon Web Services เขาช่วยลูกค้าออกแบบและสร้างโซลูชันบนระบบคลาวด์ที่ปรับขนาดได้ มีประสิทธิภาพ และปลอดภัยบน AWS

กัลยาณยากี เป็นผู้เชี่ยวชาญด้าน Big Data & Analytics อาวุโสของ Amazon Web Services เขาช่วยลูกค้าออกแบบและสร้างโซลูชันบนระบบคลาวด์ที่ปรับขนาดได้ มีประสิทธิภาพ และปลอดภัยบน AWS

- เนื้อหาที่ขับเคลื่อนด้วย SEO และการเผยแพร่ประชาสัมพันธ์ รับการขยายวันนี้

- เพลโตบล็อคเชน Web3 Metaverse ข่าวกรอง ขยายความรู้. เข้าถึงได้ที่นี่.

- ที่มา: https://aws.amazon.com/blogs/big-data/build-an-end-to-end-change-data-capture-with-amazon-msk-connect-and-aws-glue-schema-registry/

- :เป็น

- $ ขึ้น

- 1

- 10

- 11

- 7

- 8

- a

- สามารถ

- เกี่ยวกับเรา

- เข้า

- ลงชื่อเข้าใช้

- ถูกต้อง

- รับทราบ

- ที่เพิ่ม

- นอกจากนี้

- ทั้งหมด

- การอนุญาต

- ช่วยให้

- แล้ว

- อเมซอน

- Amazon EC2

- Amazon Web Services

- การวิเคราะห์

- และ

- อาปาเช่

- Apache Kafka

- การใช้งาน

- ใช้

- เหมาะสม

- สถาปัตยกรรม

- เป็น

- AS

- แสงเงินแสงทอง

- อัตโนมัติ

- ใช้ได้

- AWS

- การก่อตัวของ AWS Cloud

- AWS กาว

- BE

- ก่อน

- ประโยชน์ที่ได้รับ

- ระหว่าง

- ใหญ่

- ข้อมูลขนาดใหญ่

- บูต

- สร้าง

- ธุรกิจ

- by

- CAN

- ความสามารถในการ

- จับ

- จับ

- กรณี

- แค็ตตาล็อก

- CDC

- ส่วนกลาง

- เปลี่ยนแปลง

- การเปลี่ยนแปลง

- โหลด

- ตรวจสอบ

- การตรวจสอบ

- Choose

- ชั้น

- Cluster

- คอลัมน์

- ชุมชน

- ความเข้ากันได้

- เข้ากันได้

- สมบูรณ์

- ส่วนประกอบ

- คำนวณ

- องค์ประกอบ

- ทางแยก

- เชื่อมต่อ

- การเชื่อมต่อ

- ปลอบใจ

- คงที่

- บริโภค

- ผู้บริโภค

- ผู้บริโภค

- อย่างต่อเนื่อง

- สัญญา

- ควบคุม

- ประเทศ

- สร้าง

- ที่สร้างขึ้น

- วิกฤติ

- ปัจจุบัน

- ประเพณี

- ลูกค้า

- ข้อมูล

- การรวมข้อมูล

- ที่ขับเคลื่อนด้วยข้อมูล

- ฐานข้อมูล

- ฐานข้อมูล

- วัน

- การตัดสินใจ

- ค่าเริ่มต้น

- ค่าเริ่มต้น

- กำหนด

- การส่งมอบ

- ทดลอง

- แสดงให้เห็นถึง

- แสดงให้เห็นถึง

- ปรับใช้

- นำไปใช้

- ลักษณะ

- ปลายทาง

- รายละเอียด

- รายละเอียด

- ต่าง

- ค้นพบ

- ไม่

- หล่น

- แต่ละ

- ขจัด

- การเปิดใช้งาน

- จบสิ้น

- ทำให้มั่นใจ

- เพื่อให้แน่ใจ

- เข้าสู่

- สิ่งแวดล้อม

- ความผิดพลาด

- โดยเฉพาะอย่างยิ่ง

- อีเธอร์ (ETH)

- ทุกๆ

- คาย

- ตัวอย่าง

- ที่มีอยู่

- ที่มีอยู่

- สองสาม

- สาขา

- เนื้อไม่มีมัน

- ไฟล์

- สุดท้าย

- ชื่อจริง

- ดังต่อไปนี้

- สำหรับ

- ฟอร์ม

- รูป

- ราคาเริ่มต้นที่

- สร้าง

- สร้าง

- บัญชีกลุ่ม

- กลุ่ม

- จัดการ

- การจัดการ

- ที่เกิดขึ้น

- มี

- ช่วย

- จะช่วยให้

- อย่างสูง

- ประวัติ

- เจ้าภาพ

- ชั่วโมง

- สรุป ความน่าเชื่อถือของ Olymp Trade?

- ทำอย่างไร

- HTML

- ที่ http

- HTTPS

- Hub

- AMI

- ระบุ

- เอกลักษณ์

- การดำเนินงาน

- สำคัญ

- in

- รวมทั้ง

- ดัชนี

- ข้อมูล

- แรกเริ่ม

- ติดตั้ง

- ตัวอย่าง

- แทน

- รวบรวม

- บูรณาการ

- ภายใน

- IT

- ชวา

- jpg

- JSON

- Kafka

- คีย์

- ทราบ

- ทิ้ง

- ห้องสมุด

- ได้รับใบอนุญาต

- กดไลก์

- โหลด

- โหลด

- ในประเทศ

- นาน

- ทำ

- ทำให้

- การทำ

- การจัดการ

- เจ้านาย

- แม็กซ์

- สูงสุด

- กลไก

- ข่าวสาร

- ข้อความ

- อาจ

- นาที

- แบบ

- โหมด

- จอภาพ

- ข้อมูลเพิ่มเติม

- Movies

- การย้าย

- หลาย

- MySQL

- ชื่อ

- นำทาง

- การเดินเรือ

- จำเป็นต้อง

- จำเป็น

- ความต้องการ

- เครือข่าย

- ใหม่

- ถัดไป

- จำนวน

- of

- เก่า

- on

- ONE

- โอเพนซอร์ส

- อื่นๆ

- เอาท์พุต

- หน้า

- คู่

- บานหน้าต่าง

- พารามิเตอร์

- พารามิเตอร์

- ส่วนหนึ่ง

- ผ่าน

- รหัสผ่าน

- แบบแผน

- ดำเนินการ

- อย่างถาวร

- เลือก

- เพลโต

- เพลโตดาต้าอินเทลลิเจนซ์

- เพลโตดาต้า

- เสียบเข้าไป

- ปลั๊กอิน

- โพสต์

- ป้องกัน

- ก่อน

- กระบวนการ

- การประมวลผล

- ก่อ

- ผู้ผลิต

- คุณสมบัติ

- ให้

- ให้

- ให้

- อ่าน

- จริง

- เรียลไทม์

- รับ

- ระเบียน

- บันทึก

- หมายถึง

- ภูมิภาค

- ทะเบียน

- ลงทะเบียน

- รีจิสทรี

- กรุ

- เป็นตัวแทนของ

- แหล่งข้อมูล

- รับคืน

- บทบาท

- กฎ

- วิ่ง

- วิ่ง

- เดียวกัน

- ที่ปรับขนาดได้

- ได้อย่างลงตัว

- ค้นหา

- วินาที

- ปลอดภัย

- ความปลอดภัย

- ระดับอาวุโส

- มีความละเอียดอ่อน

- แยก

- บริการ

- บริการ

- ชุด

- การตั้งค่า

- น่า

- ง่าย

- ลดความซับซ้อน

- ทางออก

- โซลูชัน

- บาง

- แหล่ง

- แหล่งที่มา

- ผู้เชี่ยวชาญ

- โดยเฉพาะ

- ที่ระบุไว้

- กอง

- ที่เริ่มต้น

- Status

- ขั้นตอน

- ขั้นตอน

- การเก็บรักษา

- จัดเก็บ

- ร้านค้า

- กระแส

- ที่พริ้ว

- ลำธาร

- โครงสร้าง

- เหมาะสม

- ที่สนับสนุน

- รองรับ

- ซิงค์.

- ระบบ

- ระบบ

- ตาราง

- เป้า

- งาน

- เทมเพลต

- ทดสอบ

- ที่

- พื้นที่

- ที่มา

- พวกเขา

- ล้อยางขัดเหล่านี้ติดตั้งบนแกน XNUMX (มม.) ผลิตภัณฑ์นี้ถูกผลิตในหลายรูปทรง และหลากหลายเบอร์ความแน่นหนาของปริมาณอนุภาคขัดของมัน จะทำให้ท่านได้รับประสิทธิภาพสูงในการขัดและการใช้งานที่ยาวนาน

- เวลา

- ไวต่อเวลา

- ชื่อหนังสือ

- ไปยัง

- หัวข้อ

- การทำธุรกรรม

- กลับ

- ชนิด

- ภายใต้

- ที่ไม่พึงประสงค์

- การปรับปรุง

- ใช้

- ผู้ใช้งาน

- ความคุ้มค่า

- ความคุ้มค่า

- รุ่น

- เว็บ

- บริการเว็บ

- ที่

- จะ

- หน้าต่าง

- กับ

- ผู้ปฏิบัติงาน

- แรงงาน

- การทำงาน

- โรงงาน

- เขียน

- ของคุณ

- ลมทะเล