Det här inlägget skrevs tillsammans med Greg Benson, chefsforskare; Aaron Kesler, senior produktchef; och Rich Dill, Enterprise Solutions Architect från SnapLogic.

Många kunder bygger generativa AI-appar på Amazonas berggrund och Amazon Code Whisperer att skapa kodartefakter baserade på naturligt språk. Detta användningsfall belyser hur stora språkmodeller (LLM) kan bli en översättare mellan mänskliga språk (engelska, spanska, arabiska med mera) och maskintolkbara språk (Python, Java, Scala, SQL, och så vidare) tillsammans med sofistikerade interna resonemang. Denna framväxande förmåga i LLM har tvingat mjukvaruutvecklare att använda LLM som ett automatiserings- och UX-förbättringsverktyg som omvandlar naturligt språk till ett domänspecifikt språk (DSL): systeminstruktioner, API-förfrågningar, kodartefakter och mer. I det här inlägget visar vi dig hur SnapLogic, en AWS-kund, använde Amazon Bedrock för att driva sina SnapGPT produkt genom automatiskt skapande av dessa komplexa DSL-artefakter från mänskligt språk.

När kunder skapar DSL-objekt från LLM, är den resulterande DSL antingen en exakt kopia eller en derivata av befintliga gränssnittsdata och schema som utgör kontraktet mellan användargränssnittet och affärslogiken i stödtjänsten. Detta mönster är särskilt trendigt med oberoende mjukvaruleverantörer (ISV) och ISV:er för mjukvara som en tjänst (SaaS) på grund av deras unika sätt att representera konfigurationer genom kod och önskan att förenkla användarupplevelsen för sina kunder. Exempel på användningsfall inkluderar:

Det enklaste sättet att bygga och skala text-till-pipeline-applikationer med LLMs på AWS är att använda Amazon Bedrock. Amazon Bedrock är det enklaste sättet att bygga och skala generativa AI-applikationer med grundmodeller (FM). Det är en helt hanterad tjänst som erbjuder tillgång till ett urval av högpresterande grund-FM:er från ledande AI via ett enda API, tillsammans med en bred uppsättning funktioner du behöver för att bygga generativa AI-applikationer med integritet och säkerhet. Anthropic, ett säkerhets- och forskningslabb för AI som bygger tillförlitliga, tolkbara och styrbara AI-system, är ett av de ledande AI-företagen som erbjuder tillgång till sin toppmoderna LLM, Claude, på Amazon Bedrock. Claude är en LLM som utmärker sig på ett brett spektrum av uppgifter, från genomtänkt dialog, innehållsskapande, komplexa resonemang, kreativitet och kodning. Anthropic erbjuder både Claude och Claude Instant-modeller, som alla är tillgängliga via Amazon Bedrock. Claude har snabbt blivit populär i dessa text-till-pipeline-applikationer på grund av dess förbättrade resonemangsförmåga, vilket gör att den kan utmärka sig i tvetydig teknisk problemlösning. Claude 2 på Amazon Bedrock stöder ett kontextfönster på 100,000 200 token, vilket motsvarar cirka XNUMX sidor engelsk text. Detta är en särskilt viktig funktion som du kan lita på när du bygger text-till-pipeline-applikationer som kräver komplexa resonemang, detaljerade instruktioner och omfattande exempel.

SnapLogic bakgrund

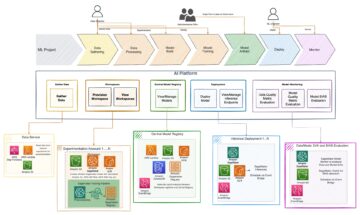

SnapLogic är en AWS-kund som har ett uppdrag att föra företagsautomation till världen. SnapLogic Intelligent Integration Platform (IIP) gör det möjligt för organisationer att realisera företagsomfattande automatisering genom att koppla ihop hela deras ekosystem av applikationer, databaser, big data, maskiner och enheter, API:er och mer med förbyggda, intelligenta kopplingar som kallas Snaps. SnapLogic släppte nyligen en funktion som heter SnapGPT, som tillhandahåller ett textgränssnitt där du kan skriva den önskade integrationspipeline du vill skapa på ett enkelt mänskligt språk. SnapGPT använder Anthropics Claude-modell genom Amazon Bedrock för att automatisera skapandet av dessa integrationspipelines som kod, som sedan används genom SnapLogics flaggskeppsintegrationslösning. SnapLogics resa till SnapGPT har dock varit en kulmen på många år i AI-utrymmet.

SnapLogics AI-resa

När det gäller integrationsplattformar har SnapLogic konsekvent legat i framkant och utnyttjat den transformativa kraften hos artificiell intelligens. Under åren har företagets engagemang för att förnya med AI blivit uppenbart, särskilt när vi spårar resan från Iris till Autolänk.

Den ödmjuka början med Iris

Under 2017 presenterade SnapLogic Iris, en branschens första AI-driven integrationsassistent. Iris designades för att använda algoritmer för maskininlärning (ML) för att förutsäga nästa steg i att bygga en datapipeline. Genom att analysera miljontals metadataelement och dataflöden kunde Iris ge intelligenta förslag till användare, demokratisera dataintegration och låta även de utan en djup teknisk bakgrund skapa komplexa arbetsflöden.

AutoLink: Bygger fart

Byggande på framgången och lärdomarna från Iris introducerade SnapLogic AutoLink, en funktion som syftar till att ytterligare förenkla datakartläggningsprocessen. Den tråkiga uppgiften att manuellt kartlägga fält mellan käll- och målsystem blev en bris med AutoLink. Med hjälp av AI identifierade och föreslog AutoLink automatiskt potentiella matchningar. Integrationer som en gång tog timmar kunde köras på bara några minuter.

Det generativa språnget med SnapGPT

SnapLogics senaste razzia inom AI ger oss SnapGPT, som syftar till att revolutionera integrationen ytterligare. Med SnapGPT introducerar SnapLogic världens första generativa integrationslösning. Det här handlar inte bara om att förenkla befintliga processer, utan att helt omformulera hur integrationer är utformade. Kraften i generativ AI kan skapa hela integrationspipelines från grunden, och optimera arbetsflödet baserat på önskat resultat och dataegenskaper.

SnapGPT är extremt påverkande för SnapLogics kunder eftersom de drastiskt kan minska den tid som krävs för att generera sin första SnapLogic-pipeline. Traditionellt skulle SnapLogics kunder behöva lägga dagar eller veckor på att konfigurera integrationspipelines från grunden. Nu kan dessa kunder helt enkelt be SnapGPT att till exempel "skapa en pipeline som kommer att flytta alla mina aktiva SFDC-kunder till WorkDay." Ett fungerande första utkast av en pipeline skapas automatiskt för denna kund, vilket drastiskt minskar utvecklingstiden som krävs för att skapa basen för deras integrationspipeline. Detta gör att slutkunden kan lägga mer tid på att fokusera på vad som har verklig affärseffekt för dem istället för att arbeta med konfigurationer av en integrationspipeline. Följande exempel visar hur en SnapLogic-kund kan ange en beskrivning i SnapGPT-funktionen för att snabbt generera en pipeline med naturligt språk.

AWS och SnapLogic har samarbetat nära under hela denna produktbyggnad och har lärt sig mycket på vägen. Resten av det här inlägget kommer att fokusera på de tekniska lärdomarna AWS och SnapLogic har haft kring att använda LLM:er för text-to-pipeline-applikationer.

Lösningsöversikt

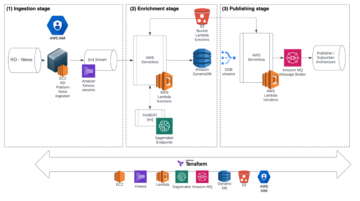

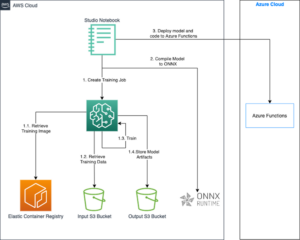

För att lösa detta text-till-pipeline-problem designade AWS och SnapLogic en omfattande lösning som visas i följande arkitektur.

En begäran till SnapGPT går igenom följande arbetsflöde:

- En användare skickar en beskrivning till applikationen.

- SnapLogic använder en Retrieval Augmented Generation (RAG)-metod för att hämta relevanta exempel på SnapLogic-pipelines som liknar användarens begäran.

- Dessa extraherade relevanta exempel kombineras med användarinmatningen och går igenom viss textförbehandling innan de skickas till Claude på Amazon Bedrock.

- Claude producerar en JSON-artefakt som representerar en SnapLogic-pipeline.

- JSON-artefakten är direkt integrerad med SnapLogic-integreringsplattformen.

- SnapLogic-pipelinen återges till användaren på ett visuellt vänligt sätt.

Genom olika experiment mellan AWS och SnapLogic har vi funnit att det snabba konstruktionssteget i lösningsdiagrammet är extremt viktigt för att generera högkvalitativa utdata för dessa text-till-pipeline-utgångar. Nästa avsnitt går vidare in på några specifika tekniker som används med Claude i detta utrymme.

Snabba experiment

Under hela utvecklingsfasen av SnapGPT fann AWS och SnapLogic att snabb iteration av uppmaningar som skickades till Claude var en kritisk utvecklingsuppgift för att förbättra noggrannheten och relevansen av text-till-pipeline-utdata i SnapLogics utdata. Genom att använda Amazon SageMaker Studio interaktiva anteckningsböcker kunde AWS- och SnapLogic-teamet snabbt arbeta igenom olika versioner av uppmaningar genom att använda Boto3 SDK-anslutning till Amazon Bedrock. Anteckningsbokbaserad utveckling gjorde det möjligt för teamen att snabbt skapa anslutningar på klientsidan till Amazon Bedrock, inkludera textbaserade beskrivningar tillsammans med Python-kod för att skicka meddelanden till Amazon Bedrock, och hålla gemensamma prompttekniksessioner där iterationer gjordes snabbt mellan flera personas.

Antropiska Claude snabba ingenjörsmetoder

I det här avsnittet beskriver vi några av de iterativa teknikerna som vi använde för att skapa en högpresterande prompt baserad på en illustrativ användarförfrågan: "Gör en pipeline som använder databasen ExampleCompany som hämtar alla aktiva kunder." Observera att det här exemplet inte är det schema som SnapGPT drivs av, utan endast används för att illustrera en text-till-pipeline-applikation.

För att grundlägga vår promptteknik använder vi följande ursprungliga prompt:

Gör en pipeline som använder databasen ExampleCompany som hämtar alla aktiva kunder

Den förväntade produktionen är som följer:

{ "database": "ExampleCompany", "query": "SELECT * FROM ec_prod.customers WHERE status = 'active'" }

Förbättring #1: Använda anteckningarna för mänskliga och assistenter

Claudes utbildningsprocedur lär FM att förstå dialogen mellan en människa och en assistent i dess snabba struktur. Claude-användare kan dra nytta av denna struktur genom att avsluta sin prompt i Assistant:, vilket kommer att få Claude att börja generera svaret på en fråga baserat på vad människan har sagt. Observera att eftersom Claude kommer att fortsätta att generera text tills den blir tillsagd att sluta, se till att du använder en stoppsekvens av nnHuman: i API-förfrågan till Amazon Bedrock när du använder Claude. Detta säkerställer att du bara får svaret från assistenten och inte det förväntade nästa svaret från människan i dialogkedjan. Dessa nnHuman- och nnAssistant-indikatorer hjälper inte bara till att begränsa Claudes svar på relevant information, utan hjälper också till att ge en tydlig gränsdragning mellan primära mänskliga input och assisterande svar från andra interaktioner. Detta hjälper särskilt i en snabbinställning där du kan ha flera frågor och svar med frågor taggade med nnHuman och tidigare svar taggade med nnAssistant. Låt oss titta på den förbättrade prompten och tillhörande illustrativa API-anrop till Amazon Bedrock via Boto3 SDK.

Vi använder följande prompt:

Human: Gör en pipeline som använder databasen ExampleCompany som hämtar alla aktiva kunder

Assistent:

Utgången är som följer:

Här är en MongoDB-pipeline för att hämta alla aktiva kunder från ExampleCompany-databasen:

pipeline = [ { '$match': { 'database': 'ExampleCompany', 'status': 'active' } } ] db.customers.aggregate(pipeline)De viktigaste stegen är:

– `$match` för att filtrera dokumenten till att endast de som finns i ExempelCompany-databasen och med status lika med "aktiv".

– `db.customers.aggregate()` kör pipelinen på kundens samling och returnerar de filtrerade resultaten.

Så detta kommer att returnera alla kunddokument från ExempelCompany-databasen där statusfältet är satt till "aktivt".

Lägg märke till hur Claude i produktionen hittar på ett svar på vår fråga utan något sammanhang. Svaret är potentiellt användbart, men det är inte specifikt för det problem vi försöker lösa eftersom det inte har tillräckligt med sammanhang. Det är också viktigt att notera att Anthropic kräver detta mänskliga och assistentformat när man använder Claude-modellerna; om du inte inkluderar detta steg kommer Amazon Bedrock att returnera ett fel.

Förbättring #2: Inkludera hyperspecifik kontext för Claude innan den får veta vad den ska göra

Claude presterar bäst när den får ett bra sammanhang om vad den behöver åstadkomma samt hur den ska utföra den uppgiften. Här är några exempel på saker att ta med som sammanhang för Claude innan du berättar uppgiften:

- Beskriv den arbetsfunktion som du vill att Claude ska fylla. Genom att göra detta får du Claude att tänka i rollen som någon som arbetar i det jobbet, eller mer som att någon bara anställts i den specifika jobbrollen. Detta kommer att hjälpa Claude att formulera svaret från den specifika jobbrollens perspektiv, vilket minskar hallucinationer och slumpmässighet i svaret.

- Inkludera tekniska detaljer om utdataformatet. Grundmodeller är i allmänhet bra på att följa åtgärder, så att be Claude att generera utdata i ett specifikt format eller schema med ett eller några exempel hjälper Claude att ge svaret i rätt format, vilket minskar behovet av filtrering och efterbearbetning av utdata. Exemplet i följande prompt visar ett fiktivt schema som matchar den förväntade produktionen.

Låt oss kombinera dessa förslag för att förbättra vår ursprungliga uppmaning:

Människan: Ditt jobb är att fungera som expert på ETL-pipelines. Specifikt är ditt jobb att skapa en JSON-representation av en ETL-pipeline som kommer att lösa användarförfrågan som du fått.

JSON-utgången bör följa följande format:

Här är din uppgift: skapa en pipeline som använder databasen ExampleCompany som hämtar alla aktiva kunder

Assistent:

Utgången är som följer:

Här är en JSON-representation av en ETL-pipeline för att hämta alla aktiva kunder från ExempelCompany-databasen:

Denna pipeline använder databasen ExampleCompany och en SQL-fråga för att välja alla poster från kundtabellen där statusen är "aktiv".

Med tillägg av kontext kan modellen nu ta det mesta av vägen till vårt svar. Den vet nu hur den ska strukturera utdata och den förstår att den behöver skriva en SQL-sats för att lösa uppgiften. Du kommer dock att märka att modellen inte korrekt använder den ec_prod.customers nomenklatur vi förväntar oss. Plats för förbättring! Observera också att du i praktiken kommer att behöva inkludera betydligt mer sammanhang än vad vi gav i det här exemplet för högkvalitativa resultat i text-to-pipeline-användningsfall.

Förbättring #3: Bifoga exempel i XML-taggar

Få-shot-inlärning är ett populärt sätt att öka noggrannheten med FM:er där du har relevanta exempel för att vägleda FM:er i sin uppgift. Detta är särskilt viktigt när du arbetar i text-till-pipeline-applikationer eftersom dessa hyperspecifika pipeline-utdata vanligtvis inte ingår i någon offentlig datauppsättning eftersom de är specifika för en enskild kunds datarepresentation. När du använder Claude kan du dra nytta av dess medfödda kunskap om godtyckliga XML-taggar för att tillhandahålla dessa exempel i ett få-shot-format. Lägg märke till tillägget av exempel i följande förbättrade uppmaning XML-taggar. Du kan också använda förkortningar för människa och assistent med H och A för att ge sammanhang till Claude utan att få det att tro att detta var specifika delar av dialogen som redan har inträffat.

Vi använder följande prompt:

Människan: Ditt jobb är att fungera som expert på ETL-pipelines. Specifikt är ditt jobb att skapa en JSON-representation av en ETL-pipeline som kommer att lösa användarförfrågan som du fått.

JSON-utgången bör följa följande format:

Här är några exempel på användarförfrågningar och tillhörande utdata JSON-artefakter som korrekt löser uppgiften. Se till att använda samma nomenklatur som finns i exemplen om du använder samma databaser.

H: fråga ExempelCompany-databasen efter aktiva beställningar för kund #1234

A:

Anledningen till denna fråga är att kund #1234 är filtrerad och vi söker i tabellen "ordrar" efter eventuella befintliga poster efter det "aktiva" filtret.

H: ta bort alla kunder i ExempelCompany-databasen som inte har varit aktiva den senaste månaden

A:

Anledningen till denna fråga är att tabellen "ec_prod.customers" är den enda tabellen i databasen ExempelCompany som innehåller kundposter.

Här är din uppgift: skapa en pipeline som använder databasen ExampleCompany som hämtar alla aktiva kunder.

Assistent:

Utgången är som följer:

Här är JSON-representationen för en ETL-pipeline för att hämta alla aktiva kunder från ExempelCompany-databasen:

Resonemanget är:

ExempelCompany-databasen anges som den databas som ska användas

Tabellen ec_prod.customers innehåller kunddata

Statusfältet indikerar om en kund är aktiv så frågan filtrerar endast för aktiva kunder

Detta bör hämta alla aktiva kundposter från ExampleCompany-databasen. Låt mig veta om du behöver förtydliganden eller har ytterligare krav för ETL-pipeline!

JSON-utgången har nu den korrekta databasnomenklaturen, som Claude kunde använda på grund av exemplen som vi gav. Att koppla ihop mänskliga och assistentindikatorer med XML-taggar gör det lättare för Claude att förstå vad som är uppgiften och vad som var svaret i liknande exempel med mycket tydlig åtskillnad mellan flera få-shot-exempel. Ju lättare det är för Claude att förstå, desto bättre och mer relevant blir svaret, vilket ytterligare minskar chansen för modellen att hallucinera och ge slumpmässiga irrelevanta svar.

Förbättring #4: Triggar Claude att börja generera JSON med XML-taggar

En liten utmaning med text-till-pipeline-applikationer som använder FMs är behovet av att exakt analysera en utdata från resulterande text så att den kan tolkas som kod i en nedströmsapplikation. Ett sätt att lösa detta med Claude är att dra fördel av dess XML-taggförståelse och kombinera detta med en anpassad stoppsekvens. I följande uppmaning har vi instruerat Claude att bifoga utgången i XML-taggar. Sedan har vi lagt till tagga till slutet av prompten. Detta säkerställer att den första texten som kommer ut från Claude blir starten på JSON-utgången. Om du inte gör detta, svarar Claude ofta med någon konversationstext, sedan det sanna kodsvaret. Genom att instruera Claude att omedelbart börja generera utdata kan du enkelt stoppa genereringen när du ser stängningen märka. Detta visas i det uppdaterade Boto3 API-anropet. Fördelarna med denna teknik är tvåfaldiga. Först kan du analysera kodsvaret från Claude exakt. För det andra kan du minska kostnaderna eftersom Claude bara genererar kodutdata och ingen extra text. Detta minskar kostnaderna på Amazon Bedrock eftersom du debiteras för varje token som produceras som utdata från alla FM-apparater.

Vi använder följande prompt:

Människan: Ditt jobb är att fungera som expert på ETL-pipelines. Specifikt är ditt jobb att skapa en JSON-representation av en ETL-pipeline som kommer att lösa användarförfrågan som du fått.

JSON-utgången bör följa följande format:

Här är några exempel på användarförfrågningar och tillhörande utdata JSON-artefakter som korrekt löser uppgiften. Se till att använda samma nomenklatur som finns i exemplen om du använder samma databaser.

H: fråga ExempelCompany-databasen efter aktiva beställningar för kund #1234

A:

Anledningen till denna fråga är att kund #1234 är filtrerad och vi söker i tabellen "ordrar" efter eventuella befintliga poster efter det "aktiva" filtret.

H: ta bort alla kunder i ExempelCompany-databasen som inte har varit aktiva den senaste månaden

A:

Anledningen till denna fråga är att tabellen "ec_prod.customers" är den enda tabellen i databasen ExempelCompany som innehåller kundposter.

Kom alltid ihåg att bifoga dina JSON-utgångar taggar.

Här är din uppgift: skapa en pipeline som använder databasen ExampleCompany som hämtar alla aktiva kunder.

Assistent:

Vi använder följande kod:

body = json.dumps({"prompt": prompt, "stop_sequences": ['nnHuman:', '</json>']})

response = bedrock.invoke_model(

body=body,

modelId='anthropic.claude-v2'

)Utgången är som följer:

{ "database": "ExampleCompany", "query": "SELECT * FROM ec_prod.customers WHERE status = 'active'" }

Nu har vi kommit fram till förväntad utdata med endast JSON-objektet returnerat! Genom att använda den här metoden kan vi generera en omedelbart användbar teknisk artefakt samt minska produktionskostnaden genom att minska utdatatokens.

Slutsats

För att komma igång idag med SnapGPT, begär en gratis provversion av SnapLogic or begär en demo av produkten. Om du vill använda dessa koncept för att bygga applikationer idag rekommenderar vi experimentera praktiskt med det snabba tekniska avsnittet i det här inlägget, genom att använda samma flöde på en annan DSL-generation som passar ditt företag, och dyka djupare in i RAG-funktioner som är tillgängliga via Amazon Bedrock.

SnapLogic och AWS har kunnat samarbeta effektivt för att bygga en avancerad översättare mellan mänskligt språk och det komplexa schemat för SnapLogic-integreringspipelines som drivs av Amazon Bedrock. Under hela den här resan har vi sett hur utdata som genereras med Claude kan förbättras i text-till-pipeline-applikationer med hjälp av specifika prompt ingenjörstekniker. AWS och SnapLogic är glada över att fortsätta detta partnerskap inom Generative AI och ser fram emot framtida samarbete och innovation i detta snabbrörliga område.

Om författarna

Greg Benson är professor i datavetenskap vid University of San Francisco och chefsforskare vid SnapLogic. Han började på USF Department of Computer Science 1998 och har undervisat i grund- och forskarutbildningskurser inklusive operativsystem, datorarkitektur, programmeringsspråk, distribuerade system och introduktionsprogrammering. Greg har publicerat forskning inom områdena operativsystem, parallell beräkning och distribuerade system. Sedan han började på SnapLogic 2010, har Greg hjälpt till att designa och implementera flera viktiga plattformsfunktioner inklusive klusterbearbetning, big data-bearbetning, molnarkitekturen och maskininlärning. Han arbetar för närvarande med Generativ AI för dataintegration.

Greg Benson är professor i datavetenskap vid University of San Francisco och chefsforskare vid SnapLogic. Han började på USF Department of Computer Science 1998 och har undervisat i grund- och forskarutbildningskurser inklusive operativsystem, datorarkitektur, programmeringsspråk, distribuerade system och introduktionsprogrammering. Greg har publicerat forskning inom områdena operativsystem, parallell beräkning och distribuerade system. Sedan han började på SnapLogic 2010, har Greg hjälpt till att designa och implementera flera viktiga plattformsfunktioner inklusive klusterbearbetning, big data-bearbetning, molnarkitekturen och maskininlärning. Han arbetar för närvarande med Generativ AI för dataintegration.

Aaron Kesler är Senior Product Manager för AI-produkter och -tjänster på SnapLogic, Aaron använder över tio års produktledningsexpertis för att banbryta AI/ML-produktutveckling och evangelisera tjänster över hela organisationen. Han är författaren till den kommande boken "Vad är ditt problem?" syftar till att guida nya produktchefer genom produktledarkarriären. Hans entreprenöriella resa började med hans högskolestartup, STAK, som senare förvärvades av Carvertise och Aaron bidrog avsevärt till deras erkännande som Tech Startup of the Year 2015 i Delaware. Utöver sina professionella sysselsättningar finner Aaron glädje i att spela golf med sin far, utforska nya kulturer och mat på sina resor och utöva ukulele.

Aaron Kesler är Senior Product Manager för AI-produkter och -tjänster på SnapLogic, Aaron använder över tio års produktledningsexpertis för att banbryta AI/ML-produktutveckling och evangelisera tjänster över hela organisationen. Han är författaren till den kommande boken "Vad är ditt problem?" syftar till att guida nya produktchefer genom produktledarkarriären. Hans entreprenöriella resa började med hans högskolestartup, STAK, som senare förvärvades av Carvertise och Aaron bidrog avsevärt till deras erkännande som Tech Startup of the Year 2015 i Delaware. Utöver sina professionella sysselsättningar finner Aaron glädje i att spela golf med sin far, utforska nya kulturer och mat på sina resor och utöva ukulele.

Rik dill är en Principal Solutions Architect med erfarenhet som spänner över flera specialiseringsområden. En meritlista av framgång som spänner över företagsprogramvara för flera plattformar och SaaS. Välkänt för att förvandla kundreklam (som fungerar som kundens röst) till intäktsgenererande nya funktioner och produkter. Beprövad förmåga att driva banbrytande produkter till marknaden och projekt till slutförande enligt schema och under budget i snabba onshore- och offshore-miljöer. Ett enkelt sätt att beskriva mig: en vetenskapsmans sinne, en upptäcktsresandes hjärta och en konstnärs själ.

Rik dill är en Principal Solutions Architect med erfarenhet som spänner över flera specialiseringsområden. En meritlista av framgång som spänner över företagsprogramvara för flera plattformar och SaaS. Välkänt för att förvandla kundreklam (som fungerar som kundens röst) till intäktsgenererande nya funktioner och produkter. Beprövad förmåga att driva banbrytande produkter till marknaden och projekt till slutförande enligt schema och under budget i snabba onshore- och offshore-miljöer. Ett enkelt sätt att beskriva mig: en vetenskapsmans sinne, en upptäcktsresandes hjärta och en konstnärs själ.

Clay Elmore är en AI/ML Specialist Solutions Architect på AWS. Efter att ha tillbringat många timmar i ett materialforskningslabb lämnades hans bakgrund inom kemiteknik snabbt bakom sig för att fortsätta sitt intresse för maskininlärning. Han har arbetat med ML-applikationer i många olika branscher, allt från energihandel till hotellmarknadsföring. Clays nuvarande arbete på AWS kretsar kring att hjälpa kunder att ta med mjukvaruutvecklingsmetoder till ML och generativa AI-arbetsbelastningar, vilket gör att kunderna kan bygga repeterbara, skalbara lösningar i dessa komplexa miljöer. På fritiden tycker Clay om att åka skidor, lösa Rubiks kuber, läsa och laga mat.

Clay Elmore är en AI/ML Specialist Solutions Architect på AWS. Efter att ha tillbringat många timmar i ett materialforskningslabb lämnades hans bakgrund inom kemiteknik snabbt bakom sig för att fortsätta sitt intresse för maskininlärning. Han har arbetat med ML-applikationer i många olika branscher, allt från energihandel till hotellmarknadsföring. Clays nuvarande arbete på AWS kretsar kring att hjälpa kunder att ta med mjukvaruutvecklingsmetoder till ML och generativa AI-arbetsbelastningar, vilket gör att kunderna kan bygga repeterbara, skalbara lösningar i dessa komplexa miljöer. På fritiden tycker Clay om att åka skidor, lösa Rubiks kuber, läsa och laga mat.

Sina Sojoodi är teknikchef, systemingenjör, produktledare, före detta grundare och startup-rådgivare. Han började på AWS i mars 2021 som Principal Solutions Architect. Sina är för närvarande den ledande lösningsarkitekten för US-West ISV-området. Han arbetar med SaaS- och B2B-programvaruföretag för att bygga och växa sina verksamheter på AWS. Före sin roll på Amazon var Sina teknikchef på VMware och Pivotal Software (IPO 2018, VMware M&A 2020) och hade flera ledarskapsroller inklusive grundande ingenjör på Xtreme Labs (Pivotal förvärv 2013). Sina har ägnat de senaste 15 åren av sin arbetserfarenhet åt att bygga mjukvaruplattformar och metoder för företag, mjukvaruföretag och den offentliga sektorn. Han är en branschledare med en passion för innovation. Sina har en kandidatexamen från University of Waterloo där han studerade elektroteknik och psykologi.

Sina Sojoodi är teknikchef, systemingenjör, produktledare, före detta grundare och startup-rådgivare. Han började på AWS i mars 2021 som Principal Solutions Architect. Sina är för närvarande den ledande lösningsarkitekten för US-West ISV-området. Han arbetar med SaaS- och B2B-programvaruföretag för att bygga och växa sina verksamheter på AWS. Före sin roll på Amazon var Sina teknikchef på VMware och Pivotal Software (IPO 2018, VMware M&A 2020) och hade flera ledarskapsroller inklusive grundande ingenjör på Xtreme Labs (Pivotal förvärv 2013). Sina har ägnat de senaste 15 åren av sin arbetserfarenhet åt att bygga mjukvaruplattformar och metoder för företag, mjukvaruföretag och den offentliga sektorn. Han är en branschledare med en passion för innovation. Sina har en kandidatexamen från University of Waterloo där han studerade elektroteknik och psykologi.

Sandeep Rohilla är Senior Solutions Architect på AWS och stödjer ISV-kunder i västra USA. Han fokuserar på att hjälpa kunder att skapa lösningar som utnyttjar containrar och generativ AI på AWS-molnet. Sandeep brinner för att förstå kundernas affärsproblem och hjälpa dem att nå sina mål genom teknik. Han började på AWS efter att ha arbetat i mer än ett decennium som lösningsarkitekt, vilket har tillfört sina 17 års erfarenhet. Sandeep har en MSc. i Software Engineering från University of West of England i Bristol, Storbritannien.

Sandeep Rohilla är Senior Solutions Architect på AWS och stödjer ISV-kunder i västra USA. Han fokuserar på att hjälpa kunder att skapa lösningar som utnyttjar containrar och generativ AI på AWS-molnet. Sandeep brinner för att förstå kundernas affärsproblem och hjälpa dem att nå sina mål genom teknik. Han började på AWS efter att ha arbetat i mer än ett decennium som lösningsarkitekt, vilket har tillfört sina 17 års erfarenhet. Sandeep har en MSc. i Software Engineering från University of West of England i Bristol, Storbritannien.

Dr Farooq Sabir är Senior Artificiell Intelligens och Machine Learning Specialist Solutions Architect på AWS. Han har doktorsexamen och MS-examen i elektroteknik från University of Texas i Austin och en MS i datavetenskap från Georgia Institute of Technology. Han har över 15 års arbetslivserfarenhet och gillar även att undervisa och mentor studenter. På AWS hjälper han kunder att formulera och lösa sina affärsproblem inom datavetenskap, maskininlärning, datorseende, artificiell intelligens, numerisk optimering och relaterade domäner. Baserad i Dallas, Texas, älskar han och hans familj att resa och åka på långa vägresor.

Dr Farooq Sabir är Senior Artificiell Intelligens och Machine Learning Specialist Solutions Architect på AWS. Han har doktorsexamen och MS-examen i elektroteknik från University of Texas i Austin och en MS i datavetenskap från Georgia Institute of Technology. Han har över 15 års arbetslivserfarenhet och gillar även att undervisa och mentor studenter. På AWS hjälper han kunder att formulera och lösa sina affärsproblem inom datavetenskap, maskininlärning, datorseende, artificiell intelligens, numerisk optimering och relaterade domäner. Baserad i Dallas, Texas, älskar han och hans familj att resa och åka på långa vägresor.

- SEO-drivet innehåll och PR-distribution. Bli förstärkt idag.

- PlatoData.Network Vertical Generative Ai. Styrka dig själv. Tillgång här.

- PlatoAiStream. Web3 Intelligence. Kunskap förstärkt. Tillgång här.

- Platoesg. Kol, CleanTech, Energi, Miljö, Sol, Avfallshantering. Tillgång här.

- PlatoHealth. Biotech och kliniska prövningar Intelligence. Tillgång här.

- Källa: https://aws.amazon.com/blogs/machine-learning/how-snaplogic-built-a-text-to-pipeline-application-with-amazon-bedrock-to-translate-business-intent-into-action/

- : har

- :är

- :inte

- :var

- $UPP

- 10

- 100

- 121

- 14

- 15 år

- 15%

- 150

- 17

- 1998

- 200

- 2010

- 2013

- 2015

- 2017

- 2018

- 2020

- 2021

- 31

- 33

- 7

- 8

- 9

- a

- Aaron

- förmåga

- Able

- Om oss

- tillgång

- åstadkomma

- noggrannhet

- Uppnå

- förvärvade

- förvärv

- tvärs

- Agera

- Handling

- åtgärder

- aktiv

- lagt till

- Dessutom

- Annat

- avancerat

- Fördel

- rådgivare

- befrämjande

- Efter

- AI

- AI-system

- AI-powered

- AI / ML

- syftar

- Syftet

- algoritmer

- Alla

- tillåts

- tillåta

- tillåter

- längs

- vid sidan av

- redan

- också

- amason

- Amazon Web Services

- mängd

- an

- analys

- och

- svara

- svar

- Antropisk

- vilken som helst

- api

- API: er

- Ansökan

- tillämpningar

- applicerar

- tillvägagångssätt

- appar

- arabiska

- arkitektur

- ÄR

- OMRÅDE

- områden

- runt

- anlände

- Konst

- konstgjord

- artificiell intelligens

- Konstgjord intelligens och maskininlärning

- konstnär

- AS

- be

- be

- Assistent

- associerad

- At

- augmented

- austin

- Författaren

- automatisera

- Automatiserad

- automatiskt

- Automation

- tillgänglig

- AWS

- AWS kund

- B2B

- bakgrund

- stöd

- bas

- baserat

- Baslinje

- BE

- Bear

- blev

- därför att

- blir

- varit

- innan

- började

- börja

- bakom

- Där vi får lov att vara utan att konstant prestera,

- Fördelarna

- BÄST

- Bättre

- mellan

- Bortom

- Stor

- Stora data

- boken

- båda

- föra

- Föra

- Bringar

- bristol

- bred

- brett

- budget

- SLUTRESULTAT

- Byggnad

- bygger

- byggt

- företag

- affärseffekter

- företag

- men

- by

- Ring

- kallas

- KAN

- kapacitet

- Karriär

- Vid

- fall

- Centers

- kedja

- utmanar

- chans

- egenskaper

- laddad

- kemisk

- chef

- val

- klar

- nära

- stängning

- cloud

- kluster

- koda

- Kodning

- samarbetat

- samverkan

- samling

- College

- kombinera

- kombinerad

- kommer

- engagemang

- Företag

- Företagets

- Tvingad

- fullbordan

- komplex

- omfattande

- dator

- Datavetenskap

- Datorsyn

- databehandling

- Begreppen

- konfigurering

- Anslutning

- anslutning

- Anslutningar

- konsekvent

- Behållare

- innehåller

- innehåll

- innehållsskapande

- sammanhang

- fortsätta

- kontrakt

- Bidragande

- konversera

- kokning

- Kärna

- korrekt

- korrekt

- Pris

- kunde

- kurser

- skapa

- skapas

- skapande

- kreativitet

- kritisk

- Aktuella

- För närvarande

- beställnings

- kund

- Kunder

- skärning

- allra senaste

- Dallas

- datum

- dataintegration

- databehandling

- datavetenskap

- Databas

- databaser

- Dagar

- årtionde

- minskning

- dedicerad

- djup

- djupare

- Delaware

- demo

- demokrati

- Avdelning

- derivat

- beskriva

- beskrivning

- Designa

- utformade

- lust

- önskas

- detaljerad

- detaljer

- utvecklare

- Utveckling

- enheter

- dialog

- olika

- direkt

- distribueras

- distribuerade system

- dykning

- do

- dokument

- inte

- gör

- domäner

- inte

- ner

- utkast

- drastiskt

- driv

- grund

- varje

- lättare

- enklaste

- lätt

- ekosystemet

- effektivt

- antingen

- elektroteknik

- element

- möjliggör

- änden

- slutar

- energi

- ingenjör

- Teknik

- England

- Engelska

- förbättring

- tillräckligt

- säkerställa

- säkerställer

- ange

- Företag

- företagsprogramvara

- Enterprise Solutions

- företag

- Hela

- helt

- företagande

- miljöer

- lika

- Motsvarande

- fel

- speciellt

- Eter (ETH)

- Även

- uppenbart

- exakt

- exempel

- exempel

- excel

- exciterade

- verkställande

- befintliga

- förväntat

- väntar

- erfarenhet

- expert

- expertis

- explorer

- Utforska

- extra

- extremt

- familj

- snabbrörlig

- snabb

- Leverans

- Funktioner

- få

- fält

- Fält

- filtrera

- filtrering

- filter

- fynd

- Förnamn

- flaggskepp

- flöda

- flöden

- Fokus

- fokuserar

- fokusering

- följer

- efter

- följer

- livsmedel

- För

- Plundringståg

- förgrunden

- format

- former

- Framåt

- hittade

- fundament

- grundande

- Francisco

- vänliga

- från

- Uppfylla

- fullständigt

- fungera

- ytterligare

- framtida

- vunnits

- allmänhet

- generera

- genereras

- genererar

- generera

- generering

- generativ

- Generativ AI

- georgien

- Georgia Institute of Technology

- skaffa sig

- gif

- ges

- Go

- Mål

- Går

- god

- uppgradera

- Väx

- styra

- hade

- sidan

- Utnyttja

- Har

- he

- Hjärta

- hjälpa

- hjälpte

- hjälp

- hjälpa

- hjälper

- här.

- högpresterande

- hög kvalitet

- höjdpunkter

- hans

- hålla

- innehar

- gästfrihet

- ÖPPETTIDER

- Hur ser din drömresa ut

- How To

- Men

- html

- HTTPS

- humant

- ringa

- identifierade

- if

- illustrera

- blir omedelbart

- Inverkan

- effektfull

- genomföra

- med Esport

- förbättra

- förbättras

- förbättra

- in

- innefattar

- ingår

- Inklusive

- Öka

- oberoende

- pekar på

- indikatorer

- individuellt

- industrier

- industrin

- branschledare

- informationen

- medfödd

- nyskapande

- Innovation

- ingång

- ingångar

- omedelbar

- istället

- Institute

- instruktioner

- integrerade

- integrering

- integrationer

- Intelligens

- Intelligent

- uppsåt

- interaktioner

- interaktiva

- intresse

- Gränssnitt

- inre

- in

- introducerade

- Introducerar

- inledande

- IPO

- ISV

- IT

- iteration

- iterationer

- DESS

- java

- Jobb

- fogade

- sammanfogning

- gemensam

- resa

- glädje

- jpg

- json

- bara

- Nyckel

- Vet

- kunskap

- känd

- vet

- lab

- Labs

- språk

- Språk

- Large

- Efternamn

- senare

- senaste

- leda

- ledare

- Ledarskap

- ledande

- Språng

- lärt

- inlärning

- vänster

- Låt

- hävstångs

- tycka om

- gillar

- Logiken

- Lång

- se

- Lot

- älskar

- M & A

- Maskinen

- maskininlärning

- Maskiner

- gjord

- göra

- GÖR

- Framställning

- förvaltade

- ledning

- chef

- chefer

- sätt

- manuellt

- många

- kartläggning

- Mars

- marknad

- Marknadsföring

- tändstickor

- material

- me

- mentorn

- bara

- metadata

- metod

- miljoner

- emot

- minuter

- Mission

- ML

- modell

- modeller

- MongoDB

- mer

- mest

- flytta

- MS

- Multi-Plattform

- multipel

- my

- namn

- Natural

- Naturligt språk

- Behöver

- behov

- Nya

- Nya funktioner

- ny produkt

- Nästa

- Nej

- Notera

- bärbara datorer

- Lägga märke till..

- nu

- objektet

- objekt

- inträffade

- of

- Erbjudanden

- Ofta

- on

- gång

- ONE

- endast

- drift

- operativsystem

- optimering

- optimera

- or

- beställa

- ordrar

- organisation

- organisationer

- ursprungliga

- Övriga

- vår

- ut

- Resultat

- produktion

- utgångar

- över

- sidor

- Parallell

- särskilt

- partnern

- Partnerskap

- brinner

- brinner

- Tidigare

- Mönster

- utför

- perspektiv

- fas

- phd

- bitar

- pionjär

- rörledning

- svängbara

- Plats

- plattform

- Plattformar

- plato

- Platon Data Intelligence

- PlatonData

- Populära

- popularitet

- Inlägg

- potentiell

- potentiellt

- kraft

- drivs

- praktiken

- praxis

- förutse

- förutsagda

- föregående

- primär

- Principal

- privatpolicy

- Integritet och säkerhet

- Problem

- problem

- förfaranden

- process

- processer

- bearbetning

- producerad

- producerar

- Produkt

- produktutveckling

- produktledning

- produktchef

- Produkter

- Produkter och tjänster

- professionell

- Professor

- Programmering

- programmeringsspråk

- projekt

- prompter

- beprövade

- ge

- förutsatt

- ger

- tillhandahålla

- Psykologi

- allmän

- publicerade

- Publicerad forskning

- bedriva

- Python

- sökfrågor

- fråga

- snabbt

- slumpmässig

- slumpmässighet

- område

- som sträcker sig

- snabb

- Läsning

- inser

- rike

- motta

- nyligen

- erkännande

- rekommenderar

- post

- register

- minska

- minskar

- reducerande

- om

- region

- föreställa sig

- relaterad

- frigörs

- relevanta

- pålitlig

- förlita

- ihåg

- ta bort

- renderade

- repeterbar

- svara

- representation

- representerar

- representerar

- begära

- förfrågningar

- kräver

- Obligatorisk

- Krav

- Kräver

- forskning

- respons

- svar

- REST

- resulterande

- Resultat

- avkastning

- återgår

- revolutionera

- Rik

- höger

- väg

- Roll

- roller

- Rum

- Körning

- kör

- SaaS

- Säkerhet

- sagemaker

- Nämnda

- Samma

- San

- San Francisco

- Skala

- skalbar

- Skala

- tidtabellen

- Vetenskap

- Forskare

- repa

- sDK

- söka

- Andra

- §

- sektor

- säkerhet

- se

- sett

- välj

- skicka

- senior

- skickas

- Sekvens

- eras

- service

- Tjänster

- portion

- sessioner

- in

- inställning

- flera

- skall

- show

- visas

- Visar

- signifikant

- liknande

- Enkelt

- förenkla

- förenkla

- helt enkelt

- eftersom

- enda

- Small

- So

- Mjukvara

- mjukvara som en service

- Programutvecklare

- mjukvaruutveckling

- mjukvaruutveckling

- lösning

- Lösningar

- LÖSA

- Lösa

- några

- någon

- sofistikerade

- Själ

- Källa

- Utrymme

- spanska

- spänning

- specialist

- specifik

- specifikt

- specificerade

- spendera

- Spendera

- SQL

- starta

- igång

- start

- .

- status

- Steg

- Steg

- Sluta

- okomplicerad

- struktur

- Studenter

- studerade

- framgång

- Stödjande

- Stöder

- förment

- säker

- system

- System

- bord

- MÄRKA

- Ta

- Målet

- uppgift

- uppgifter

- lärde

- grupp

- lag

- tech

- teknisk start

- Teknisk

- Tekniken

- tekniker

- Teknologi

- tala

- tio

- texas

- text

- än

- den där

- Smakämnen

- Västern

- världen

- deras

- Dem

- sedan

- Dessa

- de

- saker

- tror

- detta

- de

- Genom

- hela

- tid

- till

- i dag

- token

- tokens

- berättade

- tog

- verktyg

- spåra

- spår

- Handel

- traditionellt

- Utbildning

- transformativ

- transformer

- Översätt

- färdas

- reser

- trending

- rättegång

- utlösa

- trigg

- sann

- Sann kod

- försöker

- Vrida

- Typ

- ui

- Uk

- under

- förstå

- förståelse

- förstår

- unika

- universitet

- tills

- avtäckt

- kommande

- uppdaterad

- på

- us

- användbar

- användning

- användningsfall

- Begagnade

- Användare

- Användarupplevelse

- användare

- användningar

- med hjälp av

- vanligen

- ux

- olika

- försäljare

- mycket

- via

- syn

- visuell

- vmware

- Röst

- vill

- var

- Sätt..

- we

- webb

- webbservice

- veckor

- VÄL

- były

- väster

- Vad

- Vad är

- när

- som

- bred

- Brett utbud

- kommer

- fönster

- med

- utan

- Arbete

- arbetade

- arbetsflöde

- arbetsflöden

- arbetssätt

- fungerar

- världen

- Världens

- skulle

- skriva

- XML

- år

- år

- dig

- Din

- Youtube

- zephyrnet