Začenjamo opažati, kako se v generativni umetni inteligenci (AI) pojavljajo zelo zgodnje faze tehnološkega sklopa. Na stotine novih zagonskih podjetij hiti na trg, da bi razvili temeljne modele, zgradili aplikacije, ki temeljijo na umetni inteligenci, in vzpostavili infrastrukturo/orodja.

Veliko vročih tehnoloških trendov postane preveč razglašeno, veliko preden jih trg dohiti. Toda generativni razcvet umetne inteligence spremljajo resnični dobički na resničnih trgih in resnična privlačnost resničnih podjetij. Modela, kot sta Stable Diffusion in ChatGPT, postavljata zgodovinske rekorde glede rasti uporabnikov, več aplikacij pa je doseglo 100 milijonov dolarjev letnega prihodka manj kot leto dni po lansiranju. Vzporedne primerjave prikazujejo modele AI boljši od ljudi pri nekaterih nalogah za več vrst velikosti.

Torej je dovolj zgodnjih podatkov, ki nakazujejo, da se dogaja velika preobrazba. Česar ne vemo in kar je zdaj postalo kritično vprašanje, je: Kje na tem trgu bo nastala vrednost?

V zadnjem letu smo se srečali z desetinami ustanoviteljev startupov in operaterjev v velikih podjetjih, ki se neposredno ukvarjajo z generativno umetno inteligenco. To smo opazili prodajalci infrastrukture so verjetno največji zmagovalci na tem trgu doslej, saj zajamejo večino dolarjev, ki tečejo skozi sklad. Podjetja za aplikacije zelo hitro povečujejo svoje prihodke, vendar imajo pogosto težave z zadrževanjem, diferenciacijo izdelkov in bruto maržami. In večina ponudniki modelov, čeprav so odgovorni za sam obstoj tega trga, še niso dosegli velikega komercialnega obsega.

Z drugimi besedami, podjetja, ki ustvarjajo največjo vrednost – tj. usposabljanje generativnih modelov AI in njihovo uporabo v novih aplikacijah – niso zajela večine tega. Napovedati, kaj se bo zgodilo naprej, je veliko težje. Vendar menimo, da je ključna stvar, ki jo je treba razumeti, kateri deli sklada so resnično različni in jih je mogoče braniti. To bo imelo velik vpliv na strukturo trga (tj. horizontalni v primerjavi z vertikalnim razvojem podjetja) in gonila dolgoročne vrednosti (npr. marže in zadrževanje). Doslej smo imeli težave pri iskanju strukturne obrambe kjerkoli v skladu, zunaj tradicionalnih jarkov za prvotne.

Neverjetno smo optimistični glede generativne umetne inteligence in verjamemo, da bo imela velik vpliv v industriji programske opreme in širše. Cilj te objave je začrtati dinamiko trga in začeti odgovarjati na širša vprašanja o generativnih poslovnih modelih umetne inteligence.

Tehnološki sklad na visoki ravni: Infrastruktura, modeli in aplikacije

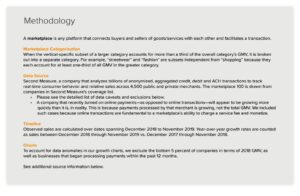

Da bi razumeli, kako se oblikuje trg generativne umetne inteligence, moramo najprej opredeliti, kako je sklad videti danes. Tukaj je naš predhodni pogled.

Sklad lahko razdelimo na tri plasti:

- Aplikacije ki integrirajo generativne modele umetne inteligence v izdelek, namenjen uporabniku, bodisi izvajajo lastne cevovode modelov (»end-to-end apps«) bodisi se zanašajo na API tretje osebe

- Modeli ki poganjajo izdelke AI, ki so na voljo bodisi kot lastniški API-ji bodisi kot odprtokodne kontrolne točke (ki pa zahtevajo rešitev za gostovanje)

- Infrastruktura prodajalci (tj. platforme v oblaku in proizvajalci strojne opreme), ki izvajajo delovne obremenitve usposabljanja in sklepanja za generativne modele umetne inteligence

Pomembno je omeniti: to ni zemljevid trga, ampak okvir za analizo trga. V vsaki kategoriji smo našteli nekaj primerov znanih prodajalcev. Nismo poskušali biti izčrpni ali našteti vseh neverjetnih generativnih aplikacij AI, ki so bile izdane. Tu se tudi ne bomo poglabljali v orodja MLops ali LLMops, ki še niso visoko standardizirana in jih bomo obravnavali v prihodnji objavi.

Prvi val generativnih aplikacij umetne inteligence začenja dosegati obseg, vendar se bori z zadrževanjem in diferenciacijo

V predhodnih tehnoloških ciklih je bila običajna modrost, da morate za izgradnjo velikega, neodvisnega podjetja imeti v lasti končnega kupca – ne glede na to, ali so to pomenili posamezne potrošnike ali kupce B2B. Mamljivo je verjeti, da bodo največja podjetja na področju generativne umetne inteligence tudi aplikacije za končne uporabnike. Zaenkrat ni jasno, da je tako.

Seveda je bila rast generativnih aplikacij AI osupljiva, ki jo poganjajo same novosti in množica primerov uporabe. Pravzaprav se zavedamo vsaj treh kategorij izdelkov, ki so že presegle 100 milijonov dolarjev letnega prihodka: ustvarjanje slik, pisanje besedil in pisanje kode.

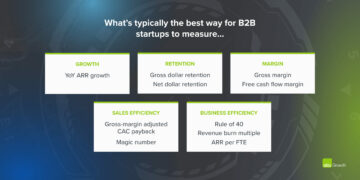

Vendar samo rast ni dovolj za izgradnjo trajnih podjetij s programsko opremo. Najpomembneje je, da mora biti rast donosna - v smislu, da uporabniki in stranke, ko se prijavijo, ustvarjajo dobiček (visoke bruto marže) in ostanejo dolgo časa (veliko zadrževanje). V odsotnosti močne tehnične diferenciacije aplikacije B2B in B2C ustvarjajo dolgoročno vrednost za stranke prek omrežnih učinkov, zadrževanja podatkov ali gradnje vedno bolj zapletenih delovnih tokov.

V generativni AI te predpostavke ne držijo nujno. Pri podjetjih za aplikacije, s katerimi smo govorili, obstaja širok razpon bruto marž – v nekaj primerih celo do 90 %, pogosteje pa celo do 50–60 %, kar je v veliki meri posledica stroškov sklepanja modela. Rast na vrhu lijaka je bila neverjetna, vendar ni jasno, ali bodo trenutne strategije pridobivanja strank prilagodljive – že opažamo, da sta se učinkovitost plačanega pridobivanja in zadrževanje začela zmanjševati. Številne aplikacije so tudi relativno nediferencirane, saj se zanašajo na podobne osnovne modele umetne inteligence in niso odkrile očitnih omrežnih učinkov ali podatkov/potekov dela, ki bi jih konkurenti težko podvojili.

Torej še ni očitno, da je prodaja aplikacij za končne uporabnike edina ali celo najboljša pot do izgradnje trajnostnega generativnega podjetja z umetno inteligenco. Marže bi se morale izboljšati, ko se povečata konkurenca in učinkovitost jezikovnih modelov (več o tem spodaj). Zadržanje bi se moralo povečati, ko turisti z umetno inteligenco zapuščajo trg. In obstaja močan argument, da imajo vertikalno integrirane aplikacije prednost pri spodbujanju diferenciacije. Toda treba je še marsikaj dokazati.

Če pogledamo naprej, nekaj velikih vprašanj, s katerimi se soočajo podjetja, ki se ukvarjajo z ustvarjanjem aplikacij za umetno inteligenco, vključujejo:

- Vertikalna integracija (»model + aplikacija«). Uporaba modelov AI kot storitve omogoča razvijalcem aplikacij, da hitro ponavljajo z majhno ekipo in zamenjajo ponudnike modelov, ko tehnologija napreduje. Po drugi strani pa nekateri razvijalci trdijo, da izdelek is model in da je usposabljanje iz nič edini način za ustvarjanje obrambnosti — tj. z nenehnim ponovnim usposabljanjem na lastniških podatkih o izdelkih. Vendar pa gre za ceno veliko višjih kapitalskih zahtev in manj spretne produktne ekipe.

- Funkcije gradnje v primerjavi z aplikacijami. Generativni izdelki AI imajo številne različne oblike: namizne aplikacije, mobilne aplikacije, vtičniki Figma/Photoshop, razširitve za Chrome, celo roboti Discord. Izdelke umetne inteligence je preprosto integrirati tam, kjer uporabniki že delajo, saj je uporabniški vmesnik na splošno le besedilno polje. Katera od teh bodo postala samostojna podjetja – in katera bodo prevzela prvotna podjetja, kot sta Microsoft ali Google, ki že vključujejo AI v svoje linije izdelkov?

- Upravljanje skozi cikel hype. Ni še jasno, ali je odliv del trenutne serije generativnih izdelkov umetne inteligence ali je artefakt zgodnjega trga. Ali če bo val zanimanja za generativno umetno inteligenco upadel, ko se bo hype umiril. Ta vprašanja imajo pomembne posledice za podjetja, ki uporabljajo aplikacije, vključno s tem, kdaj pritisniti stopalko za plin pri zbiranju sredstev; kako agresivno vlagati v pridobivanje strank; katerim uporabniškim segmentom dati prednost; in kdaj razglasiti, da je izdelek primeren za trg.

Ponudniki modelov so izumili generativno umetno inteligenco, vendar niso dosegli velikega komercialnega obsega

To, kar zdaj imenujemo generativni AI, ne bi obstajalo brez briljantnega raziskovalnega in inženirskega dela, opravljenega na mestih, kot so Google, OpenAI in Stability. Z novimi arhitekturami modelov in junaškimi prizadevanji za povečanje cevovodov usposabljanja imamo vsi koristi od osupljivih zmogljivosti trenutnih velikih jezikovnih modelov (LLM) in modelov za generiranje slik.

Vendar je prihodek, povezan s temi podjetji, še vedno relativno majhen v primerjavi z uporabo in hrupom. Pri ustvarjanju slik je Stable Diffusion doživel eksplozivno rast skupnosti, ki jo podpira ekosistem uporabniških vmesnikov, gostujoče ponudbe in metod natančnega prilagajanja. Toda Stability daje svoje glavne kontrolne točke brezplačno kot temeljno načelo njihovega poslovanja. V modelih naravnega jezika prevladuje OpenAI z GPT-3/3.5 in ChatGPT. Ampak relativno Doslej obstaja nekaj ubijalskih aplikacij, zgrajenih na OpenAI, cene pa so že padlo enkrat.

To je lahko le začasen pojav. Stabilnost je novo podjetje, ki se še ni osredotočilo na monetizacijo. OpenAI ima potencial, da postane obsežno podjetje, ki bo zaslužilo znaten delež vseh prihodkov kategorije NLP, ko bo ustvarjenih več ubijalskih aplikacij – še posebej, če bodo njihove integracija v Microsoftov portfelj izdelkov gre gladko. Glede na veliko uporabo teh modelov obsežni prihodki morda ne zaostajajo.

Obstajajo pa tudi protiutežne sile. Modele, izdane kot odprtokodne, lahko gosti kdorkoli, vključno z zunanjimi podjetji, ki ne nosijo stroškov, povezanih z obsežnim usposabljanjem modelov (do več deset ali sto milijonov dolarjev). In ni jasno, ali lahko kateri koli zaprtokodni model ohrani svojo prednost za nedoločen čas. Na primer, opažamo, da se LLM-ji, ki so jih zgradila podjetja, kot so Anthropic, Cohere in Character.ai, približujejo stopnjam zmogljivosti OpenAI, ki so usposobljeni na podobnih zbirkah podatkov (tj. internetu) in s podobnimi arhitekturami modelov. Primer stabilne difuzije kaže na to if odprtokodni modeli dosežejo zadostno raven zmogljivosti in podpore skupnosti, potem bodo lastniške alternative morda težko konkurirale.

Morda je najbolj jasen zaključek za ponudnike modelov doslej ta, da je komercializacija verjetno povezana z gostovanjem. Povpraševanje po lastniških API-jih (npr. iz OpenAI) hitro narašča. Storitve gostovanja za odprtokodne modele (npr. Hugging Face in Replicate) se pojavljajo kot uporabna vozlišča za preprosto skupno rabo in integracijo modelov — in imajo celo nekaj posrednih omrežnih učinkov med proizvajalci modelov in potrošniki. Obstaja tudi močna hipoteza, da je mogoče monetizirati s finimi nastavitvami in pogodbami o gostovanju s podjetniškimi strankami.

Poleg tega pa se ponudniki modelov soočajo s številnimi velikimi vprašanji:

- Komercializacija. Obstaja splošno prepričanje, da se bodo modeli AI sčasoma zbližali v zmogljivosti. Po pogovoru z razvijalci aplikacij je jasno, da se to še ni zgodilo, z močnimi voditelji tako v besedilnih kot slikovnih modelih. Njihove prednosti ne temeljijo na edinstvenih arhitekturah modelov, ampak na visokih kapitalskih zahtevah, lastniških podatkih o interakciji izdelkov in redkem talentu AI. Bo to služilo kot trajna prednost?

- Tveganje diplomiranja. Zanašanje na ponudnike modelov je odličen način, da podjetja za aplikacije začnejo in celo razširijo svoje poslovanje. Vendar pa obstaja spodbuda, da zgradijo in/ali gostijo lastne modele, ko dosežejo obseg. Številni ponudniki modelov imajo zelo izkrivljeno porazdelitev strank, pri čemer nekaj aplikacij predstavlja večino prihodkov. Kaj se zgodi, če/ko te stranke preidejo na interni razvoj umetne inteligence?

- Je denar pomemben? Obljube generativne umetne inteligence so tako velike – in tudi potencialno tako škodljive – da so se številni ponudniki modelov organizirali kot družbe javnega interesa (B corps), izdali omejene deleže dobička ali kako drugače vključili javno dobro v svoje poslanstvo. To ni prav nič oviralo njihovih prizadevanj za zbiranje sredstev. Vendar obstaja smiselna razprava o tem, ali večina ponudnikov modelov dejansko želeli za zajemanje vrednosti in če bi morali.

Prodajalci infrastrukture se dotaknejo vsega in žanjejo nagrade

Skoraj vse v generativnem AI gre na neki točki skozi GPE (ali TPU), ki gostuje v oblaku. Ne glede na to, ali gre za ponudnike modelov/raziskovalne laboratorije, ki izvajajo delovne obremenitve za usposabljanje, gostiteljska podjetja, ki izvajajo sklepanje/natančno uravnavanje, ali podjetja za aplikacije, ki izvajajo kombinacijo obojega — LEPOTE so življenjska sila generativne umetne inteligence. Prvič po zelo dolgem času je napredek najbolj moteče računalniške tehnologije močno vezan na računalništvo.

Posledično veliko denarja na trgu generativne umetne inteligence končno steče k infrastrukturnim podjetjem. Da dam nekaj zelo grobe številke okoli tega: ocenjujemo, da podjetja za aplikacije v povprečju porabijo okoli 20–40 % prihodkov za sklepanje in natančno prilagajanje na stranko. To se običajno plača neposredno ponudnikom oblaka za računalniške instance ali ponudnikom modelov tretjih oseb – ti pa porabijo približno polovico svojega prihodka za infrastrukturo v oblaku. Torej je razumno ugibati, da je 10-20 % Skupni prihodki v generativni AI danes gre ponudnikom oblakov.

Poleg tega so zagonska podjetja, ki usposabljajo svoje modele, zbrala milijarde dolarjev tveganega kapitala – večina (do 80–90 % v zgodnjih krogih) se običajno porabi tudi pri ponudnikih v oblaku. Mnoga javna tehnološka podjetja porabijo na stotine milijonov na leto za usposabljanje modelov, bodisi pri zunanjih ponudnikih oblakov ali neposredno pri proizvajalcih strojne opreme.

To je tisto, čemur bi v tehničnem smislu rekli "veliko denarja" - zlasti za nastajajoči trg. Večino porabijo pri Big 3 oblaki: Amazon Web Services (AWS), Google Cloud Platform (GCP) in Microsoft Azure. Ti ponudniki oblakov skupaj porabiti več kot 100 milijard USD na leto v kapitalske stroške, da zagotovijo najbolj celovite, zanesljive in stroškovno konkurenčne platforme. Zlasti pri generativni umetni inteligenci imajo koristi tudi od omejitev ponudbe, ker imajo prednostni dostop do redke strojne opreme (npr. grafični procesorji Nvidia A100 in H100).

Zanimivo pa je, da začenjamo opažati, da se pojavlja verodostojna konkurenca. Izzivalci, kot je Oracle, so napredovali z velikimi kapitalskimi izdatki in prodajnimi spodbudami. In nekaj zagonskih podjetij, kot sta Coreweave in Lambda Labs, je hitro zraslo z rešitvami, namenjenimi posebej razvijalcem velikih modelov. Tekmujejo glede stroškov, razpoložljivosti in prilagojene podpore. Izpostavljajo tudi bolj zrnate abstrakcije virov (tj. vsebnike), medtem ko veliki oblaki ponujajo samo instance VM zaradi omejitev virtualizacije GPE.

V zakulisju, ki izvaja veliko večino delovnih obremenitev umetne inteligence, je morda največji zmagovalec generativne umetne inteligence doslej: Nvidia. Podjetje prijavljenih 3.8 $ Milijarde prihodkov GPU podatkovnega centra v tretjem četrtletju njegovega proračunskega leta 2023, vključno s pomembnim delom za generativne primere uporabe AI. Z desetletji vlaganj v arhitekturo GPE, robustnega programskega ekosistema in globoke uporabe v akademski skupnosti so zgradili močne jarke okoli tega posla. Ena nedavna analiza ugotovili, da so grafični procesorji Nvidia citirani v raziskovalnih člankih 90-krat več kot najboljša zagonska podjetja za čipe AI skupaj.

Obstajajo tudi druge možnosti strojne opreme, vključno z Googlovimi tenzorskimi procesnimi enotami (TPU); grafični procesorji AMD Instinct; AWS Inferentia in Trainium čipi; in pospeševalniki umetne inteligence zagonskih podjetij, kot so Cerebras, Sambanova in Graphcore. Intel, ki zamuja, prav tako vstopa na trg s svojimi vrhunskimi čipi Habana in grafičnimi procesorji Ponte Vecchio. Toda doslej je nekaj teh novih čipov zavzelo pomemben tržni delež. Dve izjemi, ki si ju je treba ogledati, sta Google, katerega TPU-ji so postali priljubljeni v skupnosti Stable Diffusion in v nekaterih velikih poslih GCP, in TSMC, za katerega se verjame, da proizvaja vse čipov, navedenih tukaj, vključno z grafičnimi procesorji Nvidia (Intel za izdelavo svojih čipov uporablja mešanico lastnih tovarn in TSMC).

Z drugimi besedami, infrastruktura je donosna, trajna in na videz ubranljiva plast v nizu. Velika vprašanja, na katera morajo odgovoriti infra podjetja, vključujejo:

- Ohranjanje delovnih obremenitev brez stanja. Nvidia GPU so enaki, kjerkoli jih najamete. Večina delovnih obremenitev umetne inteligence je brez stanja, v smislu, da sklepanje modela ne zahteva priloženih baz podatkov ali shrambe (razen za same uteži modela). To pomeni, da so delovne obremenitve AI morda bolj prenosljive v oblakih kot običajne delovne obremenitve aplikacij. Kako lahko v tem kontekstu ponudniki oblakov ustvarijo lepljivost in strankam preprečijo, da bi skočile na najcenejšo možnost?

- Preživeti konec pomanjkanja čipov. Cene za ponudnike v oblaku in za samo Nvidio so bile podprte s skromnimi zalogami najbolj zaželenih grafičnih procesorjev. En ponudnik nam je povedal, da je maloprodajna cena za A100 dejansko enaka povečal od lansiranja, kar je zelo nenavadno za računalniško strojno opremo. Kako bo to vplivalo na ponudnike oblakov, ko bo ta omejitev ponudbe sčasoma odpravljena s povečano proizvodnjo in/ali sprejetjem novih platform strojne opreme?

- Se lahko oblak izzivalcev prebije? Trdno verjamemo v to navpični oblaki bo prevzela tržni delež od Big 3 z bolj specializiranimi ponudbami. Na področju umetne inteligence so izzivalci do zdaj dosegli pomemben oprijem z zmerno tehnično diferenciacijo in podporo Nvidie, za katero so prvotni ponudniki oblakov hkrati največje stranke in nastajajoči konkurenti. Dolgoročno vprašanje je, ali bo to dovolj za premagovanje prednosti velikih treh v obsegu?

Torej ... kje bo nabrana vrednost?

Seveda še ne vemo. Toda na podlagi prvih podatkov, ki jih imamo za generativno umetno inteligenco, v kombinaciji z naše izkušnje s prejšnjimi podjetji AI/ML, naša intuicija je naslednja.

Zdi se, da danes v generativni AI ni nobenih sistemskih jarkov. Kot približek prvega reda aplikacije nimajo močne diferenciacije izdelkov, ker uporabljajo podobne modele; modeli se soočajo z nejasno dolgoročno diferenciacijo, ker so usposobljeni za podobne nize podatkov s podobno arhitekturo; ponudniki v oblaku nimajo globoke tehnične diferenciacije, ker poganjajo iste grafične procesorje; in celo strojna podjetja proizvajajo svoje čipe v istih tovarnah.

Obstajajo seveda standardni jarki: nizki jarki (»Imam ali lahko zberem več denarja kot ti!«), jarki dobavne verige (»Jaz imam grafične procesorje, ti jih nimaš!«), ekosistemski jarki (« Vsi že uporabljajo mojo programsko opremo!«), algoritemskih jarkov (»Mi smo bolj pametni od vas!«), distribucijskih jarkov (»Že imam prodajno ekipo in več strank kot vi!«) in jarkov podatkovnih cevovodov (»Jaz« prebrskal sem več interneta kot ti!«). Toda nobeden od teh jarkov ni dolgoročno obstojen. In še prezgodaj je reči, ali močni, neposredni omrežni učinki prevzemajo katero koli plast sklada.

Na podlagi razpoložljivih podatkov ni jasno, ali bo v generativnem AI obstajala dolgoročna dinamika, ko zmagovalec dobi vse.

To je čudno. Toda za nas je to dobra novica. Potencialno velikost tega trga je težko razumeti – nekje vmes vso programsko opremo in vsa človeška prizadevanja — zato pričakujemo veliko, veliko igralcev in zdravo konkurenco na vseh ravneh sklada. Pričakujemo tudi uspeh tako horizontalnih kot vertikalnih podjetij, pri čemer najboljši pristop narekujejo končni trgi in končni uporabniki. Na primer, če je primarna diferenciacija v končnem izdelku sama umetna inteligenca, je verjetno, da bo zmagala vertikalizacija (tj. tesno povezovanje uporabniško usmerjene aplikacije z domačim modelom). Če pa je AI del večjega nabora funkcij z dolgim repom, je bolj verjetno, da bo prišlo do horizontalizacije. Seveda bi morali sčasoma videti tudi gradnjo bolj tradicionalnih jarkov - in morda bomo celo videli nove vrste jarkov.

Ne glede na to smo prepričani, da generativna umetna inteligenca spremeni igro. Vsi se učimo pravil v realnem času, obstaja ogromna količina vrednosti, ki bo odklenjena, in tehnološko okolje bo posledično videti veliko, veliko drugačno. In tukaj smo za to!

Vse slike v tej objavi so bile ustvarjene s programom Midjourney.

- Distribucija vsebine in PR s pomočjo SEO. Okrepite se še danes.

- Platoblockchain. Web3 Metaverse Intelligence. Razširjeno znanje. Dostopite tukaj.

- vir: https://a16z.com/2023/01/19/who-owns-the-generative-ai-platform/

- $ 100 milijonov

- $3

- 1

- a

- A100

- O meni

- akademsko

- pospeševalniki

- dostop

- doseže

- pridobitev

- čez

- dejansko

- Sprejetje

- napredek

- Prednost

- Prednosti

- po

- Sporazumi

- naprej

- AI

- AI platforma

- primeri uporabe ai

- AI / ML

- algoritmični

- vsi

- omogoča

- sam

- že

- alternative

- Neverjetno

- Amazon

- Amazon Web Services

- Amazonske spletne storitve (AWS)

- AMD

- znesek

- analizirati

- in

- enoletno

- odgovor

- kdo

- API-ji

- aplikacija

- zdi

- uporaba

- aplikacije

- Uporaba

- pristop

- aplikacije

- Arhitektura

- trdijo

- Argument

- okoli

- umetni

- Umetna inteligenca

- Umetna inteligenca (AI)

- povezan

- razpoložljivost

- Na voljo

- povprečno

- AWS

- Sklepanje AWS

- Azure

- B2B

- B2C

- temeljijo

- Nosijo

- ker

- postanejo

- pred

- zadaj

- prepričanje

- Verjemite

- Menimo

- verniki

- spodaj

- koristi

- BEST

- med

- Poleg

- Big

- največji

- Billion

- milijardah

- boom

- bote

- zavezuje

- Pasovi

- Break

- briljantno

- širši

- izgradnjo

- Building

- zgrajena

- Bikovski

- poslovni

- podjetja

- kupci

- klic

- Zmogljivosti

- Kapital

- zajemanje

- Zajemanje

- primeru

- primeri

- kategorije

- Kategorija

- center

- nekatere

- izzivalec

- Spremembe

- značaja

- ChatGPT

- najcenejša

- čip

- čipi

- Krom

- praksa

- jasno

- bližje

- Cloud

- oblačna infrastruktura

- Platforma v oblaku

- Koda

- skupaj

- kombinacija

- kombinirani

- kako

- komercialna

- komercializacija

- Skupno

- skupnost

- Podjetja

- podjetje

- v primerjavi z letom

- tekmujejo

- Tekmovanje

- tekmovalci

- kompleksna

- celovito

- Izračunajte

- računalništvo

- omejitve

- Potrošniki

- Zabojniki

- ozadje

- stalno

- konvencionalne

- zbližati

- pisanje

- Core

- Korporacije

- strošek

- stroški

- Tečaj

- ustvarjajo

- ustvaril

- Ustvarjanje

- verodostojno

- kritično

- Trenutna

- stranka

- Stranke, ki so

- ciklov

- datum

- Podatkovno središče

- baze podatkov

- nabor podatkov

- ponudba

- Ponudba

- desetletja

- globoko

- Povpraševanje

- desktop

- Razvoj

- Razvijalci

- Razvoj

- devs

- drugačen

- različne oblike

- razlikovati

- Difuzija

- neposredna

- neposredno

- neskladje

- odkril

- Razprava

- moteče

- distribucija

- Distribucije

- deljeno

- tem

- dolarjev

- prevladuje

- dont

- desetine

- pogon

- vozi

- vozniki

- vožnjo

- dinamično

- dinamika

- vsak

- prej

- Zgodnje

- Zaslužek

- enostavno

- ekosistem

- Edge

- Učinki

- učinkovitosti

- prizadevanja

- bodisi

- smirkovim

- Inženiring

- dovolj

- zagotovitev

- Podjetje

- podjetniške stranke

- zlasti

- oceniti

- Tudi

- sčasoma

- vse

- Primer

- Primeri

- pričakovati

- izkušnje

- razširitve

- zunanja

- Obraz

- s katerimi se sooča

- Padec

- Feature

- Lastnosti

- Nekaj

- Najdi

- iskanje

- prva

- prvič

- davek

- fit

- Flip

- Teče

- Tokovi

- osredotočena

- po

- sile

- Obrazci

- je pokazala,

- Fundacija

- ustanoviteljev

- Okvirni

- brezplačno

- iz

- Zbiranje sredstev

- Prihodnost

- zaslužek

- igra

- GAS

- splošno

- ustvarjajo

- generacija

- generativno

- Generativna AI

- dobili

- dana

- daje

- Cilj

- goes

- dogaja

- dobro

- Google Cloud

- Google Cloud Platform

- GPU

- Grafične kartice

- prijem

- veliko

- bruto

- Grow

- Pridelovanje

- goji

- Rast

- Pol

- se zgodi

- se je zgodilo

- se zgodi

- Trdi

- strojna oprema

- škodljiva

- zdravo

- tukaj

- visoka

- več

- zelo

- zgodovinski

- hit

- držite

- gospodarstvo

- Horizontalno

- gostitelj

- gostila

- gostovanje

- HOT

- Kako

- HTTPS

- velika

- človeškega

- Stotine

- sto milijonov

- hype

- slika

- generiranje slik

- slike

- vpliv

- posledice

- Pomembno

- izboljšanje

- in

- V drugi

- Spodbuda

- spodbude

- vključujejo

- Vključno

- Vključena

- vključujoč

- Povečajte

- povečal

- Poveča

- vedno

- neverjetno

- Navdušen

- Neodvisni

- individualna

- Industrija

- Infrastruktura

- inherentno

- integrirati

- integrirana

- integracija

- Intel

- Intelligence

- interakcije

- obresti

- vmesniki

- Internet

- intuicija

- Izmišljeno

- Invest

- naložbe

- Izdala

- IT

- sam

- Ključne

- Vedite

- Labs

- Pomanjkanje

- Pokrajina

- jezik

- velika

- obsežne

- v veliki meri

- večja

- Zadnja

- Lansko leto

- Pozen

- kosilo

- plast

- plasti

- Voditelji

- učenje

- pustite

- Stopnja

- ravni

- Verjeten

- Meje

- linije

- Seznam

- Navedeno

- Long

- dolgo časa

- dolgoročna

- Poglej

- POGLEDI

- Sklop

- nizka

- donosen

- je

- vzdrževati

- velika

- Večina

- Znamka

- Proizvajalci

- več

- map

- marže

- Tržna

- tržni zemljevid

- Tržna struktura

- Prisotnost

- ogromen

- množično

- max širine

- smiselna

- pomeni

- Metode

- Microsoft

- Microsoft Azure

- MidJourney

- milijonov

- milijoni

- Mission

- MLOps

- Mobilni

- mobile-aplikacije

- Model

- modeli

- Monetizacija

- monetizirati

- Denar

- več

- Najbolj

- več

- nastajajoče

- naravna

- Naravni jezik

- nujno

- Nimate

- mreža

- Novo

- nova strojna oprema

- novice

- Naslednja

- Spreten

- nlp

- roman

- Novost

- Številka

- številke

- Nvidia

- Očitna

- ponudba

- Ponudbe

- ONE

- odprite

- open source

- OpenAI

- operaterji

- Možnost

- možnosti

- Oracle

- naročila

- Organizirano

- Ostalo

- drugače

- zunaj

- Premagajte

- lastne

- lastnik

- plačana

- članki

- del

- zlasti

- deli

- vozovnice

- pot

- performance

- mogoče

- Prilagojene

- pojav

- plinovod

- Kraj

- Mesta

- platforma

- Platforme

- platon

- Platonova podatkovna inteligenca

- PlatoData

- igralci

- pletora

- plugins

- Točka

- mogoče

- Prispevek

- potencial

- potencialno

- moč

- napovedovanje

- preprečiti

- Cena

- Cene

- primarni

- Predhodna

- Prednost

- obravnavati

- Proizvajalci

- Izdelek

- proizvodnja

- Izdelki

- Dobiček

- donosno

- dobiček

- Napredek

- Obljuba

- lastniško

- Dokaži

- Ponudnik

- ponudniki

- javnega

- dal

- četrtletje

- vprašanje

- vprašanja

- hitro

- dvigniti

- postavljeno

- območje

- hitro

- dosežejo

- dosegel

- pravo

- v realnem času

- razumno

- nedavno

- evidence

- relativno

- sprosti

- zanesljiv

- Odstranjeno

- Najem

- predstavlja

- zahteva

- Zahteve

- Raziskave

- vir

- odgovorna

- povzroči

- zadrževanje

- prihodki

- prihodki

- Tveganje

- robusten

- kroge

- pravila

- Run

- tek

- prodaja

- Prodajne spodbude

- Enako

- razširljive

- Lestvica

- Gladina

- Škrlatnost

- prizori

- videnje

- segmentih

- Prodaja

- Občutek

- služijo

- Storitev

- Storitve

- nastavite

- nastavitev

- več

- Oblikujte

- Delite s prijatelji, znanci, družino in partnerji :-)

- Delnice

- shouldnt

- Prikaži

- podpisati

- pomemben

- Podoben

- saj

- Velikosti

- majhna

- gladko

- So

- doslej

- Software

- Rešitev

- rešitve

- nekaj

- nekje

- vir

- specializirani

- posebej

- preživeti

- porabljen

- Stabilnost

- stabilna

- sveženj

- postopka

- stati

- samostojna

- standardna

- Začetek

- začel

- Začetek

- zagon

- Ustanavljanjem

- Držijo

- Še vedno

- shranjevanje

- strategije

- močna

- strukturno

- Struktura

- Boj

- uspeh

- dovolj

- Predlaga

- dobavi

- podpora

- Podprti

- prenapetost

- trajnostno

- Preklop

- sistemsko

- Bodite

- ob

- talent

- pogovor

- ciljno

- Naloge

- skupina

- tech

- Tech podjetja

- tehnični

- Tehnologija

- začasna

- Pogoji

- O

- njihove

- sami

- stvar

- tretja

- tretjih oseb

- 3

- skozi

- vezana

- tesno

- čas

- krat

- do

- danes

- tudi

- vrh

- na dotik

- vleko

- tradicionalna

- usposobljeni

- usposabljanje

- Preoblikovanje

- ogromno

- Trends

- Res

- tsmc

- OBRAT

- Vrste

- tipično

- ui

- Konec koncev

- osnovni

- razumeli

- edinstven

- enote

- nenavadno

- us

- Uporaba

- uporaba

- uporabnik

- Uporabniki

- vrednost

- Popravljeno

- prodajalci

- podjetje

- tveganega kapitala

- preko

- Poglej

- Watch

- Wave

- web

- spletne storitve

- dobro znana

- Kaj

- ali

- ki

- medtem

- WHO

- široka

- Širok spekter

- Wikipedia

- bo

- zmago

- Zmagovalci

- modrost

- brez

- besede

- delo

- delovnih tokov

- pisanje

- leto

- zefirnet