Meta je izdala še en nekakšen model odprtega strojnega učenja, tokrat prilagojen za ustvarjanje izvorne kode programske opreme.

Šifra Llama je družina velikih jezikovnih modelov – od tod občasna uporaba velikih začetnic »LLaMA« – temelji na modelu Llama 2 sprosti julija. Natančno je nastavljen in usposobljen za oddajanje in razpravo o izvorni kodi kot odgovor na besedilne pozive, namesto v prozi, kot je bil njegov prednik.

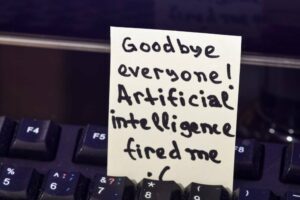

Kot pri vseh vrhunskih tehnologijah tudi Code Llama prinaša tveganja

"Code Llama ima potencial, da se uporablja kot produktivno in izobraževalno orodje za pomoč programerjem pri pisanju bolj robustne, dobro dokumentirane programske opreme," je trdila Meta v napoved Četrtek.

Če prosite Code Llama, naj napiše funkcijo, ki proizvede Fibonaccijevo zaporedje, bo model ustvaril kodo in naravni jezik, ki pojasnjuje vir, pravi Meta. In model AI lahko to stori v Pythonu, C++, Javi, PHP, Typescript (Javascript), C#, Bash in drugih jezikih.

Uporabniki pa so napoteni, naj kodo Llama naslovijo v angleščini, saj model ni bil testiran varnosti v drugih jezikih in bi lahko povedal nekaj groznega, če bi ga vprašali v izven obsega jezik.

»Kot pri vseh najsodobnejših tehnologijah tudi Code Llama prinaša tveganja,« pojasnjuje Meta in ugotavlja, da se je Code Llama med testiranjem lastne rdeče ekipe za spodbujanje ustvarjanja zlonamerne kode odzvala z varnejšimi odgovori kot ChatGPT (GPT3.5 Turbo).

Glede na Meta je Code Llama boljši od odprtokodnih LLM-jev, specifičnih za kodo, in svojega matičnega Llama 2 na dveh merilih – HumanEval in večinoma osnovno programiranje Python (MBPP) – in se ujema z zmogljivostjo ChatGPT OpenAI.

Code Llama je na voljo v treh velikostih – parametri 7B, 13B in 34B – in vsaka različica je bila usposobljena s 500B žetonov kode in s kodo povezanih podatkov. En žeton je v angleščini približno štiri znake. Največja različica kodeksa OpenAI, ko je bila izdana, je imela 12B parametri.

Dva najmanjša modela Code Llama, pravi Meta, sta bila usposobljena za zapolnitev manjkajočega vira, kar omogoča, da ju lahko uporabimo za dokončanje kode brez nadaljnjega natančnega prilagajanja. Različica 34B naj bi zagotavljala najboljše rezultate, vendar se manjši dve odzivata hitreje, zaradi česar sta boljši za naloge, kot je dokončanje kode, kjer je zakasnitev opazna.

Obstajata tudi dve različici: Code Llama – Python in Code Llama – Instruct. Prvo izvira iz natančne nastavitve Code Llama z dodatnimi 100 B žetonov kode Python. Slednji je bil natančno nastavljen, da se drži vhodnih in izhodnih vzorcev, zaradi česar je bolj primeren za ustvarjanje kode.

Zanesljivost, kdo?

LLM pogosto zagotavljajo nepravilna odgovori na pozive za programiranje, čeprav jih kljub temu mnogi razvijalci uporabljajo za priklic vzorcev na pamet in parametrov API ali za izogibanje iskalnim poizvedbam in preverjanjem dokumentacije.

Ena od prodajnih prednosti Code Llama je, da lahko obravnava vnos in izhod kodnih zaporedij, ki so sestavljena iz do 100,000 žetonov. To pomeni, da lahko model pozovete s številnimi vrsticami kode in morda dobite podroben odgovor.

»Poleg tega, da so predpogoj za generiranje daljših programov, daljša vhodna zaporedja odklenejo vznemirljive nove primere uporabe za kodo LLM,« je pojasnil Meta. »Uporabniki lahko na primer zagotovijo modelu več konteksta iz svoje baze kode, da bodo generacije bolj ustrezne. Pomaga tudi pri scenarijih odpravljanja napak v večjih bazah kode, kjer je lahko razvijalcem izziv ostati na vrhu vse kode, povezane s konkretno težavo.«

Uporabniki lahko modelu zagotovijo več konteksta iz svoje kodne baze, da bodo generacije ustreznejše

Code Llama se pridružuje rastočemu polju modelov, ki se razumejo s kodo, ki so bili prvotno zasajeni s Codexom OpenAI in povezanim GitHubom pravdno obremenjeno Storitev za predloge programiranja Copilot (2021). Programsko pozitivni modeli, ki so sledili, vključujejo DeepMindove AlphaCode (2022), GPT-4 OpenAI (2023), Amazon Šepetalec kod (2023) in Googlov Bard (2023), uglašen aprila za ustvarjanje izvorno kodo.

Poleg tega obstajajo različni odprtokodni (ali nekakšni odprti) LLM-ji, kot je StarCoder in XGen, če omenimo dve.

Meta je pod istim imenom izdala Code Llama licenco skupnosti kot Llama 2, pri čemer navaja prepričanje mega-korporacije v "odprt pristop do umetne inteligence" kot najboljši način za razvoj orodij, ki so inovativna, varna in odgovorna.

Toda kot je bilo na splošno ugotovljeno pri Llami 2, je licenca skupnosti ni odprtokodna licenca. Metin "odprt pristop" do AI je zaprt za konkurenco - licenca izrecno ne dovoljuje uporabe programske opreme "za izboljšanje katerega koli drugega velikega jezikovnega modela."

In medtem ko Metina licenca skupnosti dovoljuje komercialno uporabo njenih različnih lam, potegne črto pri storitvah z "več kot 700 milijoni mesečnih aktivnih uporabnikov."

To raje izberite skupino mega-storitev – YouTube, WeChat, TikTok, LinkedIn, Telegram, Snapchat in Douyin, med platformami družbenih medijev, ki jih še ne upravlja Meta, in verjetno podjetja, ki uporabljajo platforme, ki temeljijo na operacijskem sistemu, kot so Apple, Google in Microsoft – morajo zahtevati licenco Mete, ki vam jo lahko Meta podeli po lastni presoji…” ®

- Distribucija vsebine in PR s pomočjo SEO. Okrepite se še danes.

- PlatoData.Network Vertical Generative Ai. Opolnomočite se. Dostopite tukaj.

- PlatoAiStream. Web3 Intelligence. Razširjeno znanje. Dostopite tukaj.

- PlatoESG. Avtomobili/EV, Ogljik, CleanTech, Energija, Okolje, sončna energija, Ravnanje z odpadki. Dostopite tukaj.

- PlatoHealth. Obveščanje o biotehnologiji in kliničnih preskušanjih. Dostopite tukaj.

- ChartPrime. Izboljšajte svojo igro trgovanja s ChartPrime. Dostopite tukaj.

- BlockOffsets. Posodobitev okoljskega offset lastništva. Dostopite tukaj.

- vir: https://go.theregister.com/feed/www.theregister.com/2023/08/25/meta_lets_code_llama_run/

- :ima

- : je

- :ne

- :kje

- $GOR

- 000

- 100

- 2021

- 2022

- 2023

- 700

- a

- aktivna

- Poleg tega

- Naslov

- držijo

- AI

- vsi

- omogoča

- že

- Prav tako

- Amazon

- med

- an

- in

- Še ena

- odgovori

- kaj

- kdo

- API

- Apple

- pristop

- april

- SE

- AS

- povezan

- At

- izogibanje

- temeljijo

- bash

- Osnovni

- BE

- bilo

- počutje

- prepričanje

- meril

- BEST

- Boljše

- tako

- vendar

- by

- C + +

- CAN

- Kapitalizacija

- primeri

- izziv

- znaki

- ChatGPT

- Pregledi

- trdil,

- zaprto

- CO

- Koda

- Koda

- prihaja

- komercialna

- skupnost

- Podjetja

- Tekmovanje

- dokončanje

- ozadje

- Oblikovanje

- rezanje

- datum

- Deepmind

- Razvoj

- Razvijalci

- DID

- razpravlja

- do

- Dokumentacija

- douyin

- riše

- med

- vsak

- Edge

- izobraževalne

- Angleščina

- Eter (ETH)

- Primer

- zanimivo

- razložiti

- pojasnjujejo

- Pojasni

- dodatna

- družina

- hitreje

- FB

- Fibonaccijevo

- Polje

- izpolnite

- konec

- sledili

- za

- Nekdanji

- štiri

- iz

- funkcija

- nadalje

- ustvarjajo

- ustvarjajo

- generacija

- generacije

- dobili

- GitHub

- odobri

- več

- Pridelovanje

- imel

- ročaj

- Imajo

- ob

- pomoč

- Pomaga

- zato

- Vendar

- HTTPS

- if

- izboljšanje

- in

- V drugi

- vključujejo

- na začetku

- inovativne

- vhod

- Namesto

- vprašanje

- IT

- ITS

- Java

- JavaScript

- Pridružuje

- jpg

- julij

- samo

- jezik

- jeziki

- velika

- večja

- Največji

- Latenca

- učenje

- Lets

- Licenca

- kot

- vrstica

- linije

- Llama

- več

- stroj

- strojno učenje

- Znamka

- Izdelava

- več

- Maj ..

- mediji

- Meta

- Microsoft

- morda

- milijonov

- manjka

- Model

- modeli

- mesečno

- več

- večinoma

- morajo

- Ime

- naravna

- Naravni jezik

- Novo

- opozoriti

- Opažam

- občasno

- of

- pogosto

- on

- ONE

- odprite

- open source

- OpenAI

- deluje

- or

- Ostalo

- Presega

- izhod

- lastne

- parametri

- vzorci

- performance

- PHP

- Platforme

- platon

- Platonova podatkovna inteligenca

- PlatoData

- točke

- potencial

- proizvaja

- produktivnost

- prednik

- Programerji

- Programiranje

- programi

- zagotavljajo

- dal

- Python

- poizvedbe

- precej

- RE

- Rdeča

- povezane

- sprosti

- pomembno

- zahteva

- Odzove

- Odgovor

- odgovorna

- Rezultati

- Riot

- tveganja

- robusten

- grobo

- Run

- tek

- s

- varna

- varnejši

- Varnost

- Je dejal

- Enako

- pravijo,

- pravi

- scenariji

- Iskalnik

- Prodaja

- Zaporedje

- Storitev

- Storitve

- velikosti

- manj

- snapchat

- So

- socialna

- družbeni mediji

- Socialni medijski

- Software

- Nekaj

- vir

- Izvorna koda

- T

- Naloge

- skupina

- Tehnologija

- Telegram

- Pogoji

- Testiranje

- kot

- da

- O

- Vir

- njihove

- Njih

- Tukaj.

- jih

- ta

- čeprav?

- 3

- skozi

- četrtek

- tik Tok

- čas

- do

- žeton

- Boni

- orodje

- orodja

- vrh

- usposobljeni

- dva

- Tipkovnica

- pod

- odklene

- uporaba

- Rabljeni

- Uporabniki

- uporabo

- Variant

- različnih

- različica

- je

- način..

- kdaj

- ki

- medtem

- pogosto

- Wikipedia

- bo

- z

- brez

- pisati

- še

- jo

- youtube

- zefirnet