S Terraformom v 5 minutah zaženite sodoben nabor podatkov

S Terraformom v 5 minutah zaženite sodoben nabor podatkov

Kaj je Modern Data Stack in kako ga namestite? Ta vodnik vas bo motiviral, da na tej poti začnete z navodili za nastavitev za Airbyte, BigQuery, dbt, Metabase in vse ostalo, kar potrebujete z uporabo programa Terraform.

By Tuan Nguyen, Član tehničnega direktorja in član uprave pri Joon Solutions.

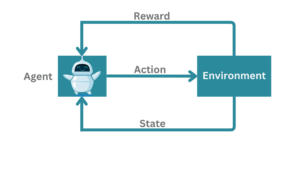

Moderna arhitektura podatkovnega sklada (slika avtorja).

Kaj je sodoben podatkovni sklad

Sodobni podatkovni sklad (MDS) je nabor tehnologij, zaradi katerih sodobno podatkovno skladišče deluje 10–10,000-krat bolje kot podedovano podatkovno skladišče. Navsezadnje MDS prihrani čas, denar in trud. Štirje stebri MDS so a podatkovni konektorA skladišče podatkov v oblakuA podatkovni transformatorIn BI & raziskovanje podatkov orodje.

Enostavno integracija je omogočeno z upravljanimi in odprtokodnimi orodji, ki vnaprej sestavijo na stotine konektorjev, pripravljenih za uporabo. Tisto, kar je nekoč za redno gradnjo in vzdrževanje zahtevala skupina podatkovnih inženirjev, je zdaj mogoče nadomestiti z orodjem za preproste primere uporabe. Upravljane rešitve, kot je Šiv in Fivetran, skupaj z odprtokodnimi rešitvami, kot je Airbyte in Meltano, poskrbijo za to.

Uporaba stolpčno podatkovno skladišče v oblaku je bil v zadnjem času trend zaradi svoje visoke zmogljivosti in stroškovne učinkovitosti. Namesto da plačujete 100 USD na leto za lokalno bazo podatkov MPP (množična vzporedna obdelava), lahko začnete plačevati od 100 USD (ali manj) na mesec. Izvorna podatkovna skladišča v oblaku naj bi bila 10–10,000-krat hitrejša od tradicionalnih OLTP. Priljubljene možnosti v tej kategoriji so BigQuery, Snowflakein Redshift.

V starih časih je bila obdelava podatkov v podatkovnem skladišču ozko grlo zaradi omejitev tehnologije. Posledično so morala podjetja dati prednost ETL namesto ELT, da bi zmanjšala delovno obremenitev podatkovnega skladišča. Z napredkom izvornih podatkovnih skladišč v oblaku pa je veliko orodja za transformacijo v skladišču podatkov postajajo priljubljeni. Najbolj opazna v tej kategoriji sta dbt (orodje za gradnjo podatkov) in Dataform.

BI orodja uporabljal tudi za nekatere transformacije za zmanjšanje delovne obremenitve podedovanih podatkovnih skladišč. Vendar se je s sodobnim skladom podatkov fokus orodij BI premaknil (po mojem mnenju) na demokratizacijo dostopa do podatkov, samopostrežnih storitev in odkrivanja podatkov. Nekatera orodja, za katera mislim, da gredo v pravo smer, so Looker, Metabazain Superset.

Naša arhitektura

Začetek uporabe Modern Data Stack je lahko zastrašujoč, saj je vključenih veliko različnih orodij in procesov. Namen tega članka je, da vam pomaga čim bolj nemoteno začeti to pot. Pripravljalnih korakov je veliko, a traja le pet minut da zavrtite vse vire, ko končate.

Uporabljali bomo Terraform, odprtokodno orodje infrastrukture kot kode za zagotavljanje vsega v Google Cloudu. Če sledite spodnjim navodilom, bodo ustvarjeni viri.

- Projekt Google Cloud z omogočenim potrebnim API-jem

- Zaužitje: primerek GCE, ki izvaja Airbyte

- Skladiščenje: nabori podatkov BigQuery

- Orkestracija (neobvezno): primerek GCE, ki izvaja Airflow

- BI in odkrivanje podatkov: primerek GCE, ki izvaja Metabase

- Računi storitev za različne storitve in njihove vezave dovoljenj IAM

Odkrij več

Ustvarite račun Google Cloud in omogočite obračunavanje

Koda Terraform v tem projektu bo sodelovala z Google Cloud Platform. Zato je naš prvi korak ustvarjanje Google računa in omogoči zaračunavanje. Upoštevajte ID obračuna v naslednji obliki na strani za obračun: ######-######-######. To vrednost boste potrebovali v naslednjem koraku.

Namestite Google Cloud CLI

Namestite Google Cloud SDK po navodilih tukaj za vaš zadevni OS. Ko imate gcloud CLI nameščen, zaženite naslednji ukaz v terminalskem oknu in sledite navodilom. To bo Terraformu omogočilo uporabo privzete poverilnice za preverjanje pristnosti.

gcloud auth aplikacija-privzeta prijava

Namestite terraform

Sledite navodilom tukaj za lokalno namestitev Terraform CLI. Nato zaženite naslednji ukaz, da preverite namestitev:

terraform -v

Moral bi videti nekaj takega:

Terraform v1.0.0 na darwin_amd64 + register ponudnika.terraform.io/hashicorp/google v3.71.0

Razcepite ali klonirajte ta repo lokalno

Ti lahko razcepi ta repo v svoj račun ali ga klonirajte na vaš lokalni računalnik. Če želite klonirati repo, zaženite naslednje:

git klon https://github.com/tuanchris/modern-data-stack cd modern-data-stack

Ustvarite terraform.tfvars datoteka

Ustvarite terraform.tfvars datoteko z naslednjo vsebino:

# ID obračuna iz prvega koraka billing_id = ######-######-###### # ID mape, pod katero želite, da je vaš projekt # Pustite prazno, če uporabljate a personal account folder_id = "" # ID organizacije, pod katero želite, da je vaš projekt # Pustite prazno, če uporabljate osebni račun org_id = "" # Projekt za ustvarjanje project_id = ""

Opozorilo: Te vrednosti veljajo za občutljive. Ne objavite te datoteke in datoteke *.tfstate datoteke v javni repo.

Prilagodite vrednosti v spremenljivke.tf

Spremenljivke v spremenljivke.tf bo uporabljen za konfiguracije virov.

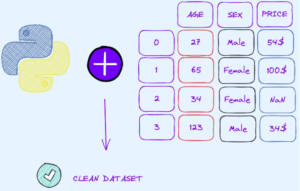

Slika avtorja.

Tip stroja lahko prilagodite za različne storitve, tako da spremenite spremenljivke. Če ne želite uporabljati nobene storitve, jo komentirajte v gce.tf Datoteka.

Ustvarite lahko tudi različne nabore podatkov za svoje izvorne sisteme, tako da jih dodate v slovar naborov izvornih podatkov.

Ustvarite sodoben sklad podatkov

Nazadnje, da zagotovite vse te vire v Google Cloudu, zaženite naslednji ukaz:

uporabi terraform

Slika avtorja.

Preučite izhod v terminalu in se prepričajte, da so vse nastavitve virov takšne, kot želite. Vrsta ja in udaril vpišite.

Terraform bo ustvaril projekt Google Cloud z našim sodobnim skladom podatkov. Celoten postopek bo trajal približno 2–3 minute. Traja dodatne 2–3 minute, da se storitve namestijo na instance VM. Celoten postopek bo trajal le 5 minut ali manj.

Uporaba sodobnega podatkovnega sklada

Pridobite storitvene račune za različne storitve

Slika avtorja.

Google priporoča uporabo drugega storitvenega računa za različne storitve. Koda terraform v projektu je ustvarila različne račune za različne že uporabljene tehnologije. Če želite pridobiti račun storitve za določeno storitev, zaženite naslednji ukaz:

terraform izhod [service_name]_sa_key

Privzeto dovoljenje za vse te račune je vloge/bigquery.admin. To lahko prilagodite v iam.tf Datoteka.

Vrednost, ki ste jo dobili nazaj, je kodirana base64. Če želite spremeniti to vrednost nazaj v format JSON, zaženite naslednji ukaz:

echo "[vrednost iz prejšnjega ukaza]" | osnova64 -d

Storitveni račun JSON lahko uporabite za preverjanje pristnosti dostopa storitve do virov vašega projekta.

Opozorilo: Kdor koli s tem računom storitve lahko dostopa do vašega projekta.

Zaužijte podatke z Airbyte

Airbyte je odlično orodje za integracijo odprtokodnih podatkov. Za dostop do uporabniškega vmesnika Airbyte najprej pridobite ukaz gcloud SSH.

Slika avtorja.

Dobili boste ukaz, podoben temu:

gcloud beta compute ssh --zone "asia-southeast1-a" "tf-airbyte-demo-airbyte" --project "tf-airbyte-demo"

Nato ukazu dodajte naslednje za lokalno posredovanje uporabniškega vmesnika Airbyte:

-- -L 8000:lokalni gostitelj:8000 -L 8001:lokalni gostitelj:8001 -N -f

Vaš končni ukaz bo videti takole:

gcloud beta compute ssh --zone "asia-southeast1-a" "tf-airbyte-demo-airbyte" --projekt "tf-airbyte-demo" -- -L 8000:localhost:8000 -L 8001:localhost:8001 - N -f

Opomba: Ne pozabite izbrisati znaka za novo vrstico po kopiranju iz uporabniškega vmesnika GCP.

Če se je primerek Airbyte končal z zagonom, lahko do njega dostopate tako, da odprete brskalnik in obiščete localhost: 8000. Če ne, počakajte pet minut, da primerek dokonča namestitev.

Slika avtorja.

Zdaj lahko integrirate svoje vire, dodate cilj BigQuery z uporabo airbyte_sa_keyin v hipu imejte svoje podatke v BigQueryju.

Do namestitve Airbyte lahko dostopate na /airbyte/ znotraj VM.

Modelirajte podatke z dbt

DBT (data build tool) je zmogljivo odprtokodno orodje za pretvorbo podatkov, ki uporablja SQL. Podatkovnim analitikom omogoča, da opravijo delo, ki je bilo prej rezervirano za podatkovne inženirje. Pomaga tudi ustvariti povsem novo delovno mesto, imenovano Analytics Engineer, ki je hibrid podatkovnega analitika in podatkovnega inženirja. Več o položaju si lahko preberete v mojem blogu tukaj.

Slika avtorja.

Za razliko od Airbyte, Airflow in Metabase za zagon dbt ne potrebujete strežnika. Registrirate se lahko za brezplačen (za vedno) račun z enim sedežem tako, da obiščete njihovo spletna stran.

Orkestrirajte potek dela z Airflow

Pretok zraka je v bitkah preizkušeno orodje za orkestracijo poteka dela, ki ga je ustvaril Airbnb. Upajmo, da vam s sodobnim skladom podatkov ne bo treba veliko uporabljati Airflow. Vendar pa je v nekaterih primerih, ko je potrebno nekaj prilagajanja, lahko Airflow vaše orodje.

Za dostop do uporabniškega vmesnika pridobite ukaz SSH, podoben zgornjemu razdelku z Airbyte. Za posredovanje vrat uporabite naslednji ukaz:

gcloud beta compute ssh --zone "asia-southeast1-a" "tf-airbyte-demo-airflow" --projekt "tf-airbyte-demo" -- -L 8080:localhost:8080 -N -f

Zdaj lahko dostopate do namestitve Airflow na localhost: 8080. Privzeto uporabniško ime in geslo sta admin in admin.

Slika avtorja.

Do zračne napeljave lahko dostopate na /zračni tok/ znotraj VM.

Vizualizirajte podatke z Metabase

Metabaza je odprtokodno orodje za vizualizacijo in odkrivanje podatkov. Je super uporabniku prijazen in enostaven za začetek.

Za dostop do uporabniškega vmesnika Metabase pridobite ukaz SSH, podoben zgornjemu razdelku z Airbyte. Nato uporabite naslednji ukaz za posredovanje vrat:

gcloud beta compute ssh --zone "asia-southeast1-a" "tf-airbyte-demo-metabase" --project "tf-airbyte-demo" -- -L 3000:localhost:3000 -N -f

Slika avtorja.

Čiščenje

Da bi se izognili kakršnim koli neželenim stroškom, ne pozabite počistiti virov, ustvarjenih v tem projektu z izvajanjem.

terraform uničiti

Opozorilo: S tem boste izbrisali vse obstoječe podatke in vire v projektu. Lahko pa tudi izklopite neuporabljeni GCE, da prihranite stroške.

prvotni. Poročeno z dovoljenjem.

Bio: Tuan Nguyen je tehnični direktor Joon Solutions, podjetja Data as Service. Njegove poklicne izkušnje se vrtijo pri oblikovanju in upravljanju skupin za podatkovno znanost, analitični infrastrukturi in primerih uporabe analitike. Zelo rad združuje svojo strast do podatkovne analitike in računalništva v oblaku, da pomaga podjetjem, da ostanejo konkurenčna v tem digitalnem dnevu. Ima široko paleto interesov, vključno z astronomijo, branjem, glasbo in IoT.

Povezano:

Vir: https://www.kdnuggets.com/2021/08/bootstrap-modern-data-stack-terraform.html

- "

- &

- dostop

- Račun

- Dodatne

- Airbnb

- vsi

- Analitik

- analitika

- Apache

- API

- Arhitektura

- okoli

- članek

- astronomija

- Preverjanje pristnosti

- avto

- beta

- bigquery

- zaračunavanje

- Blog

- svet

- član uprave

- meja

- brskalnik

- izgradnjo

- Building

- podjetja

- ki

- primeri

- Cloud

- računalništvo v oblaku

- Platforma v oblaku

- Koda

- Podjetja

- podjetje

- Izračunajte

- računalništvo

- vsebina

- stroški

- Ustvarjanje

- CTO

- datum

- dostop do podatkov

- Podatkovna analiza

- integracija podatkov

- znanost o podatkih

- vizualizacija podatkov

- podatkovno skladišče

- skladišča podatkov

- Baze podatkov

- dan

- globoko učenje

- uniči

- digitalni

- Direktor

- Odkritje

- inženir

- Inženirji

- Doživetja

- prva

- Osredotočite

- sledi

- format

- brezplačno

- Gold

- Google Cloud

- Grafične kartice

- vodi

- tukaj

- visoka

- Kako

- HTTPS

- Stotine

- Hybrid

- IAM

- slika

- Vključno

- Infrastruktura

- integracija

- vključeni

- Internet stvari

- IT

- UČITE

- učenje

- lokalna

- lokalno

- strojno učenje

- Izdelava

- srednje

- ML

- Denar

- Glasba

- na spletu

- odprite

- open source

- Mnenje

- možnosti

- Geslo

- performance

- platforma

- Popular

- Projekt

- javnega

- območje

- reading

- zmanjša

- vir

- viri

- Run

- tek

- Znanost

- Znanstveniki

- SDK

- Samopostrežba

- Storitve

- Enostavno

- rešitve

- Spin

- SQL

- Začetek

- začel

- bivanje

- zgodbe

- sistemi

- Tehnologije

- čas

- vrh

- Preoblikovanje

- preoblikovanje

- ui

- vrednost

- vizualizacija

- Počakaj

- Skladišče

- Kaj je

- delo

- potek dela

- X

- leto