V tej epizodi se Vijay Pande pogovarja z Jakobom Uszkoreitom, soustanoviteljem in izvršnim direktorjem podjetja Inceptive. Skupaj razpravljata o vseh stvareh AI.

Spodaj objavljamo prepis v celoti, če želite brati zraven.

***

Olivia Webb: Pozdravljeni in dobrodošli v Bio Eats World, podkastu na stičišču biologije, zdravstva in tehnologije. Sem Olivia Webb, vodja uredništva Bio + Health pri a16z. V tej epizodi smo se pogovarjali z Jakobom Uszkoreitom, nekdanjim sodelavcem Google Brain in soustanoviteljem podjetja Inceptive. Jakob je tudi eden od avtorjev temeljne raziskovalne naloge o umetni inteligenci Attention is All You Need, ki jo bomo povezovali v zapiskih oddaje. Jakob se je srečal z Vijayem Pandejem, ustanovnim partnerjem a16z Bio + Health, da bi se pogovarjal o vseh stvareh umetne inteligence: od njegovega časa pri Google Brainu do tega, kako ljudje in računalniki obdelujejo jezik, do Inceptiveovega prepričanja v obljubo RNA in kako Jakob verjame, da vstopamo na ozemlje prelomne točke z AI.

To je epizoda, ki je ne želite zamuditi – vendar je tudi razprava o AI na podiplomski ravni, zato bomo poleg epizode objavili prepis. Začnimo.

Uporabni algoritmi

Vijay Pande: Torej, Jakob, najlepša hvala, ker si na Bio Eats World. Super te je imeti.

Jakob Uszkoreit: Super je biti tukaj. Hvala, da ste me imeli.

Vijay Pande: Zlasti ker imate tako zanimivo zgodbo kot računalničar, podjetnik in ustanovitelj, bi bil vesel, da nas popeljete skozi svojo karierno pot, začnete kjer koli želite, toda tisto, kar vas je pripeljalo do Google Braina, je verjetno dober začetek .

Jakob Uszkoreit: Do neke mere se res spomnim, uh, da sem naletel na to težavo strojnega učenja, morda v najširšem smislu, [in] razumevanje jezika, nekoliko bolj specifično, kot težavo, ki se pojavlja v družini. Moj oče je torej računalniški znanstvenik in računalniški jezikoslovec in, veste, odraščanje stvari, kot so Turingovi stroji, niso bile nujno povsem tuje pojme dokaj zgodaj.

Vijay Pande: Ja, zveni, kot da bi bil v resnici pogovor za večerjo.

Jakob Uszkoreit: Bili so pogovori za večerjo. In tako so bili zlasti končni avtomati in kako so dejansko povezani s prodajnimi avtomati, veste, pogosti temi. Starejši ko sem postajal, bolj sem si želel zagotoviti, da bom dejansko naredil nekaj drugega. In tako sem na koncu precej pogledal v čisto matematiko in sorodna področja. [Jaz] sem se res precej osredotočil na optimizacijo, na optimizacijske algoritme, algoritme na splošno, na širšo teorijo kompleksnosti, preden sem ugotovil, da morda to ni najbolj praktična stvar in najbolj uporabna stvar, kar je, veste, nekako postalo malo rdeča nit skozi mojo kariero. In nato dobesedno naletel na pripravništvo pri Googlu leta 2005.

Dobil sem nekaj različnih možnosti [glede], kakšnim raziskovalnim projektom naj se pridružim, [in] med njimi so bili različni poskusi računalniškega vida, pa tudi projekt strojnega prevajanja, ki je v bistvu postal Google Translate. Ravno v tem času ali le malo pred tem je [Translate] lansiral svoj prvi izdelek, ki so ga resnično poganjali Googlovi notranji sistemi, ki so bili razviti, in v določenem smislu se je na mojo veliko žalost izkazalo, da Google Translate pri tisti čas je imel daleč najzanimivejše težave z algoritmi velikega obsega.

Takrat je bilo res zanimivo videti, kajti tisto, kar me je prepričalo, da sem prekinil doktorat in se dejansko vrnil k Googlu po tistem pripravništvu, je v resnici to, da je v mojem času tam postalo očitno, da če želiš delati na nečem v strojno učenje, ki ni bilo samo zanimivo in recimo intelektualno in znanstveno, vznemirljivo, zahtevno in spodbudno, ampak je prav tako veliko upalo, da bo takoj premaknilo iglo v industriji in izdelkih. V tistem času res ni bilo veliko krajev na svetu. In zagotovo takrat niso bili akademski laboratoriji, ampak mesta, kot je Google. In Google je bil tam in takrat dejansko zelo v ospredju tega. In tako, veste, takrat se mi je zdelo neverjetno zagnati moje prve obsežne algoritme za združevanje v gruče na tisočih strojih, in to je bilo povsem nemogoče narediti drugje.

Vijay Pande: Ko se pogovarjate z našimi starejšimi kolegi, je veliko romantike iz obdobja razcveta Bell Labs in vedno sem se spraševal, ali so Google Brain danes ena od bližjih različic. Kakšno je bilo okolje?

Jakob Uszkoreit: Tako se mi zdi, da je med tem časom in ko se je Google Brain zares začel, kar je približno pet let kasneje, prišlo do pomembnega premika. Preden sta se Brain and Translate začela, so ga veliko bolj vodili izdelki, ki so resnično naredili razliko, kot verjamem, da so bili Bell Labs. Med nami je bilo seveda lepo število nekdanjih študentov Bell Labs, vendar je bilo veliko bolj motivirano z neposredno uporabnostjo.

Zame je bilo pravzaprav neverjetno opazovati, kako se je strojno prevajanje spremenilo [iz nečesa, kar] je bilo dobro za smeh na zabavi, dobesedno. Če bi vas vprašali, kje delate? In rekli ste, Google. In potem so rekli, kaj delaš tam? In sprva so bili navdušeni. In potem ste rekli, oh, delam na Google Translate. In potem so se smejali in vprašali, ali bo to kdaj delovalo? Mislim, da ne. Toda istočasno bi rekel, da se je val strojnega učenja, renesančni val strojnega učenja pred globokim učenjem, začel umirjati. Veste, poglobljeno učenje je bilo nekaj, kar sem počel prej v šoli in mi je bilo všeč, vendar tega v tistih časih ni bilo nekaj, kar bi lahko zares uporabili.

Vijay Pande: Ja, še posebej zato, ker v akademskih krogih niste imeli toliko, da bi naredili izračune, ki bi jih morali narediti.

Jakob Uszkoreit: Seveda ne v akademskih krogih, ampak celo v Googlu. Čeprav je bila takrat v Prevajalniku najbolj zanimiva značilnost, rekel bi, da smo na koncu res verjeli v absolutno moč podatkov.

Zato nismo poskušali izdelati bolj zapletenih, bolj sofisticiranih algoritmov, ampak smo jih namesto tega čim bolj poenostavili in povečali ter jim nato omogočili, da se urijo na vedno več podatkih. Ampak tam smo dosegli zgornjo mejo. Poenostavitve, ki ste jih morali narediti, da bi jih prilagodili Googlovemu obsegu v tistem času, to je bil res naš cilj. Ampak potem, in to je bilo nekako eno od teh nihalnih gibov, ki je zanihala nazaj, iz akademskega sveta, kup ljudi s kupom GPU-jev – globoko učenje se je v določenem smislu vrnilo z maščevanjem. In nenadoma se je okolje prilagodilo, ker ni bilo jasno, kakšna bi bila neposredna pot v obsegu proizvodnje.

In tako se je celotno okolje premaknilo iz bolj usmerjenega v aplikacije in izdelke v nekaj, kar se je vsaj nekaj let zdelo veliko bolj akademsko. Še vedno je nekoliko drugačen od akademskih laboratorijev, ker bi si lahko privoščili veliko več grafičnih procesorjev, vendar veliko bolj v skladu s to idejo [biti] voden s strani publikacij, ki ga vodijo skoki in ne koraki. [To] se je spremenilo v zelo, zelo produktivno — in res neverjetno — vendar veliko bolj odprto [okolje].

Pozornost je vse, kar potrebujete

Vijay Pande: No, veste, ko že govorimo o publikacijah, je naravno mesto za razmišljanje, ko vi in ekipa objavite Pozornost je vse, kar potrebujete. In veste, to je bil tako temeljni dokument za toliko generativne umetne inteligence, saj je bil takrat prvič predstavljen transformatorski algoritem.

Jakob Uszkoreit: Dve leti pred objavo tega prispevka smo ugotovili, [da] je bilo tisto, kar je bilo takrat najsodobnejše za težave, kot je strojno prevajanje, ali [kar] se je pojavilo kot najsodobnejše, namreč LSTM ali RNN , Seq2Seq na splošno kot paradigma usposabljanja in kot nastavitev, pa tudi kot omrežna arhitektura – je imel neverjetne težave celo na najsodobnejših grafičnih procesorjih v tistem času, ko je prišlo do skaliranja v smislu podatkov.

Na primer, prvi nevronski strojni prevajalski sistem, ki ga je predstavil Google, GNMT, dejansko, kolikor vem, ni bil nikoli zares usposobljen na vseh podatkih o usposabljanju, ki smo jih imeli na voljo in smo jih predhodno izkopali za statistične sisteme, ki temeljijo na frazah. In to je bilo zato, ker se algoritmi preprosto niso dobro prilagajali v smislu količine podatkov. Torej, skratka, takrat nismo iskali strojnega prevajanja, ampak probleme, pri katerih smo interno v Googlu imeli na voljo še večje količine podatkov o usposabljanju. To so bili torej problemi, ki so nastali pri iskanju, kjer imate v bistvu še tri ali štiri stopnje velikosti. Veste, zdaj ni več na milijarde besed, ampak zlahka na bilijone, in nenadoma smo naleteli na ta vzorec, kjer so preprosta omrežja s posredovanjem podatkov, čeprav so naredila smešne poenostavljene predpostavke, kot je, to je samo vreča besed ali je samo vreča bigramov , in jih nekako povprečiš in jih pošlješ skozi velik MNLP, so dejansko prekašali RNN in LSTM, vsaj če so bili usposobljeni za več podatkov.

[In bili so] n-krat hitrejši, zlahka 10- do 20-krat hitrejši za treniranje. In tako bi jih lahko usposobili za veliko več podatkov. V nekaterih primerih [so bili] stokrat hitrejši za treniranje. In tako smo dosledno dejansko končali z modeli, ki so bili enostavnejši in ki niso mogli izraziti ali zajeti določenih pojavov, za katere vemo, da so vsekakor pogosti v jeziku.

Pa vendar, veste, bistvo je, da so bili cenejši za treniranje in [so] bili boljši.

Vijay Pande: Dajmo samo primer za ljudi, ki niso seznanjeni. Če rečem, pokaži mi vse restavracije v bližini, razen italijanske, za nekaj besed, ti bodo pokazale vse italijanske restavracije, kajne?

Jakob Uszkoreit: Točno tako. Pravzaprav je to, kar ste rekli, verjetno mogoče preurediti, da mi pokaže vse italijanske restavracije razen bližnjih. To je samo juha besed in jo lahko preuredite v nekaj, kar zagotovo pomeni nekaj drugega.

Vijay Pande: Da.

Jakob Uszkoreit: In potem se približate strukturi in bolj globalnim pojavom tako, da vnesete bigrame. Torej v bistvu skupine dveh zaporednih besed in podobne stvari. Vendar je jasno, da zagotovo v jezikih, kot je nemščina, kjer lahko glagol v bistvu postavite na sam konec stavka ...

Vijay Pande: In spremeni celoten pomen, kajne?

Jakob Uszkoreit: Spremeni ves pomen, točno, ja. Ne glede na to, kakšna je velikost vaših n-gramov – ali vaših majhnih besednih skupin –, vam na koncu ne bo uspelo. In postalo nam je jasno, da mora obstajati drugačen način, ki ne zahteva ponavljanja RNN v dolžini ali ponavljanja v zaporedju, recimo besed ali slikovnih pik, ampak ki dejansko obdeluje vhode in izhode na bolj vzporeden način in resnično navsezadnje zadosti prednostim sodobne strojne opreme za pospeševanje.

Vijay Pande: Pomislite, kot so vreča besed besede v naključnem vrstnem redu. LSTM ali dolgi kratkoročni spomin vam morda daje nekakšno [sposobnost, da] malo pogledate [v] preteklost, kajne? Toda transformatorji naredijo nekaj radikalno drugačnega. Kako transformatorji to dvignejo na naslednjo raven?

Jakob Uszkoreit: Vedno obstajata dva načina gledanja na to. Ena je skozi lečo učinkovitosti, drugi način, ki je morda nekoliko bolj intuitiven, pa je, da na to gledate z vidika, saj veste, koliko konteksta lahko ohranite. In kot ste rekli, LSTM ali ponavljajoče se nevronske mreže na splošno se skozi svoje vnose premikajo korak za korakom, na splošno, in medtem ko so v teoriji sposobni vzdrževati poljubno dolga kontekstna okna v vhode – preteklost – kaj se v praksi zgodi, da jim je dejansko zelo težko identificirati dogodke, recimo besede ali slikovne pike, ki so zelo oddaljeni v preteklosti in na koncu resnično vplivajo na pomen. Ponavadi se osredotočajo na stvari, ki so v bližini.

Transformator pa po drugi strani to v bistvu samo obrne na glavo in reče, ne, na vsakem koraku se to, kar počnemo, ne premika skozi vhod. Na vsakem koraku gledamo celoten vhod ali izhod in v bistvu postopno revidiramo predstavitve vsake besede ali vsake slikovne pike ali vsakega popravka ali vsake sličice videa, ko se v bistvu premikamo, ne v vhodnem prostoru , vendar v reprezentativnem prostoru.

Vijay Pande: Da.

Jakob Uszkoreit: In ta zamisel je imela nekaj pomanjkljivosti glede tega, kako bi jo umestili v sodobno strojno opremo, toda v primerjavi s ponavljajočimi se nevronskimi mrežami je imela predvsem prednosti, ker zdaj dejansko niste bili vezani na zaporedno računanje predstavitev, recimo besedo za besedo. Tisto, kar vas je v resnici zavezovalo, je, kako dobri bi morali biti? Koliko plasti te vrste vzporedne obdelave vseh pozicij, kjer lahko vse, kjer lahko vsi pari besed ali vsi pari slikovnih obližev delujejo takoj? Koliko revizij teh predstavitev si dejansko lahko »privoščim«?

Vijay Pande: Zelo zanimivo je tudi to, da je očitno navdih naravni jezik, vendar obstaja veliko struktur, ki bi jih želeli vnesti, kjer jih ne želite preučevati le zaporedno, kot je zaporedje DNK – in prešli bomo v biologijo dovolj kmalu – da želite imeti model celotne stvari.

Nekako smešno je z jezikom. Ko govorim ali ko vas poslušam, obdelujem vsako besedo, vendar sčasoma ne moram besed le tokenizirati v posamezne pomene, ampak moram nekako razviti to predstavitev. da? Želim si, da bi to naredili tako, kot to počnejo transformatorji. In morda je trik v tem, da so LSTM-ji bližje načinu, kako to počnemo ljudje, transformatorji pa so morda ravno takšni, kot bi morali to narediti, ali pa si želim, da bi to lahko storili.

Jakob Uszkoreit: Na prvi pogled mislim, da je to res, čeprav so na koncu dneva – introspektivni argumenti, kot so ti, subtilni in zapleteni.

Zato mislim, da mnogi od nas poznajo ta pojav, ko kričite ali vpijete z nekom, ki poskuša nekaj sporočiti čez prometno ulico. In tako slišite nekaj, kar govorijo, in to ni kratko zaporedje besed, in v bistvu niste ničesar razumeli. Toda pol sekunde kasneje si nenadoma razumel celoten stavek. Pravzaprav namiguje na dejstvo, da čeprav smo prisiljeni pisati in izgovarjati jezik v zaporedju – samo zaradi časovne puščice – ni tako jasno, da naše globlje razumevanje res teče v tem zaporedju.

Sestavljanje ekipe

Vijay Pande: Če kdo preučuje celo papir Pozornost je vse, kar potrebujete ali kako deluje transformator, je veliko delov. In zdi se, da je verjetno že presegla točko, ko bi lahko ena oseba sama učinkovito opravila to delo v katerem koli kratkem času.

Jakob Uszkoreit: Absolutno.

Vijay Pande: Torej zdaj resnično potrebujete ekipo ljudi, ki opravlja te vrste stvari. Kakšna je sociologija tega? Kako nastane kaj takega?

Jakob Uszkoreit: Osebno menim, da je ta poseben primer res čudovit primer nečesa, kar se izjemno dobro prilega bolj, recimo temu, industrijskemu pristopu k znanstvenim raziskavam. Ker imaš čisto prav. To ni bila ena velika iskra domišljije in ustvarjalnosti, ki je sprožila vse skupaj.

To je bil res cel kup prispevkov, ki so bili na koncu vsi potrebni. Imeti okolje, knjižnico, ki je bila pozneje tudi odprtokodna, z imenom Tensor2Tensor, ki je dejansko vključevala implementacije. Pa ne kakršnih koli implementacij, ampak izjemno dobre implementacije, hitre implementacije vseh vrst trikov globokega učenja.

Ampak potem tudi vse do teh mehanizmov pozornosti, ki so izšli iz prejšnjih publikacij – kot je razgradljivi model pozornosti, [ki je bil] objavljen prej – vendar so bili potem dejansko združeni z izboljšavami in inovacijami, izumi okoli optimizatorjev. Mislim, da ne boste našli ljudi, ki so resnično med vodilnimi svetovnimi strokovnjaki za vse to hkrati in ki so resnično enako strastni do vseh teh vidikov.

Vijay Pande: In še posebej je tu začetna ideja, tam je njena izvedba, tam je njeno prilagajanje. Doseganje takšnega obsega kjerkoli drugje kot v velikem podjetju trenutno verjetno ni izvedljivo samo zaradi stroškov.

Jakob Uszkoreit: Mislim, da morda vidik velikega podjetja pravzaprav ni tako ključen.

Vijay Pande: Ja?

Jakob Uszkoreit: Vidik podjetja je tisti, ki bi ga cenil višje. Veliko podjetje zagotovo ne boli, če potrebujete na tisoče in tisoče TPU-jev ali GPE-jev ali karkoli že imate. Globoki žepi za take stvari nikoli ne škodijo. Toda obenem verjamem, da je struktura spodbud okoli tovrstnih raziskovalnih raziskav v industriji veliko bolj primerna za tovrstne projekte. In mislim, da je to dejansko nekaj, kar vidimo, ko gledamo generativne projekte umetne inteligence na vseh področjih.

Vijay Pande: ja In po vašem bi lahko bil zagon.

Jakob Uszkoreit: Vsekakor bi lahko bil startup. In mislim, da zdaj vidimo, da uporaba strojne opreme za pospeševanje postaja vsaj cenovno dostopnejša. In obstajajo zagonska podjetja, ki si zelo tekmujejo, ko gre za generativno umetno inteligenco, usmerjeno v ustvarjanje slik ali besedil.

Skok na vede o življenju

Vijay Pande: Rad bi prešel v to, kar počnete zdaj. Ste izvršni direktor podjetja Inceptive, ki uporablja AI v biologiji RNK za terapevtiko RNK. Kako ste prestopili v vede o življenju? Površno gledano, če govorimo o jezikovnih modelih za večerjo [mizo] in nato v Googlovi kavarni ... zdi se, da bi to lahko bil skok na naslednjo generacijo terapevtikov. Kako je do vsega tega prišlo?

Jakob Uszkoreit: Ne bi se mogel bolj strinjati. Z moje strani je to neverjetna učna izkušnja. Že kar nekaj časa se mi je biologija zdela taka težava, pri kateri se ne zdi nepredstavljivo, da obstajajo meje, kako daleč lahko gremo v smislu, recimo, razvoja zdravil in neposrednega oblikovanja s tradicionalno biologijo kot hrbtenico našega lotite se oblikovanja – ali odkrivanja metod za oblikovanje – zdravil prihodnosti.

Zdi se, da je globoko učenje, zlasti v velikem obsegu, iz vrste razlogov potencialno zelo primerno orodje tukaj. In eden od teh razlogov je dejansko nekaj, kar pogosto ni nujno označeno kot prednost, to je dejstvo, da je to velika črna škatla, ki jo lahko preprosto vržete v nekaj. In ni res, da ga lahko kar vržeš. To je nekaj, kar moraš znati vreči.

Vijay Pande: In tudi ni ravno črna. O tem se lahko kasneje prepirava.

Jakob Uszkoreit: Ja točno. Točno tako. Toda na koncu dneva, če se vrnemo k analogiji z jezikom, nikoli nismo uspeli v celoti, v tem smislu, razumeti in konceptualizirati jezika do te mere, da bi lahko rekli, oh, zdaj bom šel in vam povedal to teorijo za jezikom, nato pa boste lahko implementirali algoritem, ki jo "razume". Nikoli nismo prišli do te točke. Namesto tega smo morali prekiniti in narediti korak nazaj ter si po mojem mnenju do neke mere priznati, da to morda ni bil najbolj pragmatičen pristop. Namesto tega bi morali poskusiti pristope, ki ne zahtevajo te ravni konceptualnega razumevanja. In mislim, da bi lahko enako veljalo za dele biologije.

Uporaba umetne inteligence za pomik biologije dlje

Vijay Pande: Zanimivo, o takih stvareh sva se že pogovarjala. Pomislite na prejšnje stoletje, [ki je bilo] v veliki meri stoletje fizike in računa. Obstaja določena miselnost, kjer obstaja način, kako lahko zelo elegantno poenostaviš stvari, tako da imaš lahko eno samo enačbo, kot je Einsteinova enačba polja, ki opisuje toliko, in to je zelo preprosta enačba v zelo zapletenem jeziku. Govorili ste o tem, da ta Feynmanov pristop, skoraj tako kot sociologija fizike, morda ne velja tukaj v biologiji, kajne?

Jakob Uszkoreit: Morda ne velja, vsaj iz dveh razlogov, ki jih vidim na tej točki. Prva je, da je vpletenih preveč igralcev. In čeprav je res, da morda lahko vse skupaj zreduciramo na Schrodingerjevo enačbo in jo preprosto rešimo, se zgodi, da je ne samo računsko nerešljivo, ampak bi morali vedeti tudi za vse te različne igralce, česar trenutno ne vemo. . Niti blizu. To je torej en vidik.

In potem je drugi v bistvu računsko nerešljiva, kjer je redukcija v določenem smislu šla tako daleč, da čeprav vse vrne nazaj na eno samo stvar, nam ne pomaga, ker naši računalniški pristopi v bistvu uporabljajo te osnove za izdelavo napovedi so preprosto prepočasne, da bi te napovedi naredile za sisteme, ki so dovolj veliki, da bi res bili pomembni za življenje.

Vijay Pande: ja Torej ne gre za enačbo n-teles, vendar je še vedno prisoten občutek formalizma – morda gre za formalizem, ki bolj temelji na podatkih, ali bolj za Bayesov formalizem. Kako se to vključi v to, kar bi radi počeli? Kako to vpliva na uporabo umetne inteligence in drugih vrst novih algoritmov?

Jakob Uszkoreit: Mislim, da obstaja nekaj različnih vidikov. Na koncu dneva je po mojem mnenju eden od pomembnih zaključkov tega, kar trenutno vidimo v generativni AI, ta, da nam ni več treba trenirati na podatkih, ki niso le popolnoma čisti, ampak tudi natančno iz domene in od vrst nalog, ki bi se jih pozneje želeli lotiti. Toda namesto tega je lahko dejansko bolj koristno ali celo edini način, ki smo ga doslej našli, da dejansko poskušamo trenirati na vsem, kar najdete, kar je vsaj malo povezano. In nato učinkovito uporabite informacije, pridobljene iz teh podatkov, da na koncu dobite tako imenovane temeljne modele, ki jih lahko nato natančno prilagodite vsem vrstam posebnih nalog z veliko manjšimi, veliko bolj sprejemljivimi količinami čistejših podatkov.

Mislim, da nekoliko podcenjujemo, kar moramo vedeti o pojavih na splošno. Če želite zgraditi zelo dober velik jezikovni model, morate razumeti, da obstaja nekaj, kar se imenuje internet, in v njem je veliko besedila. Pravzaprav morate razumeti kar nekaj o tem, kako najti to besedilo, kaj ni besedilo in tako naprej, da lahko nato iz tega v bistvu izluščite podatke o usposabljanju, ki jih nato uporabite.

Verjamem, da bodo okoli biologije zelo neposredno podobni izzivi. Veliko vprašanje je: kaj so poskusi, ki jih lahko povečamo tako, da lahko opazujemo življenje v zadostnem obsegu z ravno dovolj zvestobo – vendar veliko manj specifičnostjo, pri tem pa upoštevamo težave, ki jih poskušate sčasoma rešiti – tako, da lahko v bistvu iz tega vzamemo podatke, ki jih potrebujemo, da lahko začnemo graditi te temeljne modele, ki jih lahko nato uporabimo, natančno nastavljene in posebej zasnovane, da se resnično približamo težavam, ki se jih želimo lotiti.

Del generiranja podatkov je zagotovo eden izmed njih. Arhitekture in dejansko imeti modele in omrežne arhitekture, ki posnemajo tisto, kar vemo, o, na primer, fiziki pod njimi, bodo še vedno ostale neverjetno zmogljiv način dejanskega varčevanja z računanjem in tudi zmanjševanja še vedno ogromnega apetita po podatkih, ki jih bodo ti modeli morali imeti , na izvedljivo raven. In tako verjamem, da je zanimivo omeniti, da je veliko trenutnih aplikacij modelov, recimo transformatorjev, za katere [je] ugotovljeno, da se precej dobro prilagajajo drugim modalitetam, drugim domenam, jeziku, viziji, ustvarjanju slik, itd., itd., in njihova uporaba v biologiji v bistvu ignorira dejstvo, da vemo, da obstaja nekaj, kot je čas, in da se zakoni fizike, vsaj kolikor nam je znano, ne zdijo kar tako spreminjajo čez čas.

Proces zvijanja beljakovin, zanemarjanje dejstva, da obstaja na tone in tone igralcev – spremljevalcev in še česa – je pravzaprav v določenem smislu dokaj poljubno ločen problem od preostale kinetike proteinov. To je ravno toliko kinetike kot preostanek kinetike ali preostanek življenja tega proteina, te molekule. In zakaj torej poskušamo usposabljati modele posebej za enega in morda vsaj ignorirati podatke, ki jih morda imamo o drugem? V tem primeru, morda natančneje, ali se nekateri modeli napovedovanja strukture beljakovin, ki jih imamo danes, že implicitno naučijo nekaj o kinetiki zaradi dejstva, da počasi začenjajo sprejemati, saj veste, obstoj časa?

Razvijanje novih arhitektur

Vijay Pande: Ena od zanimivih stvari, o katerih razmišljam o tem, kje ste trenutno, je, da se večina globokih nevronskih mrež ali drugih vrst umetne inteligence v biologiji, z nekaj redkimi izjemami, počuti, kot da vzame nekaj, kar je izumljeno nekje drugje, in to prenese naprej. Kot da bomo za slike uporabili konvolucijske nevronske mreže. Mogoče za majhne molekule … v mojem laboratoriju na Stanfordu smo uporabili grafične nevronske mreže in več konvolucijskih nevronskih mrež. Toda resnično razviti algoritem izrecno za biološki problem je precej redko. In vedno sem domneval, da je tako, ker je preprosto težko imeti nabor veščin ekipe, ki je močna na področju biologije in računalništva. Vendar me zanima vaše mnenje. Ali pa je razvoj novih arhitektur le redek?

Jakob Uszkoreit: No, mislim, da na koncu dneva vidimo, da nove arhitekture, čeprav jih motivirajo specifični problemi, če resnično naredijo razliko, so običajno uporabne tudi drugje. Po drugi strani pa to ne pomeni, da na poti do tja skrbna izbira motivacijskih aplikacij in domen ne bi pomenila velike razlike. In mislim, da zagotovo.

Menim, da je eden od ključnih izzivov tukaj v resnici ta, da v biologiji še nismo v režimu, kjer imamo množice podatkov, čeprav je to v primerjavi s tem, kar smo imeli pred časom, neverjetno. Vendar še nismo v tem režimu, kjer bi to samo ležalo na ekvivalentu spleta in ga lahko nekoliko filtriramo, prenesemo in zaključimo z njim. Toda namesto tega mislim, da ga moramo ustvariti v razumno veliki meri. In tega ne bodo storili strokovnjaki za globoko učenje, vsaj večina ne.

In verjamem, da se mora to zgoditi v koraku z resnim razumevanjem posebnosti omenjenih podatkov, kajne? Vrste hrupa, na katere naletite tam. Dejstvo, da so ti dejansko ustvarjeni v zelo velikih skaliranih skupinah, visoko zmogljivih poskusih, vendar še vedno poskusih, ki jih različni izvajalci izvajajo na različne dni in tako naprej in tako naprej. In kjer ljudje z več globokega učenja dovolj tesno sodelujejo z ljudmi z biološkim ozadjem, se naučijo dovolj o tem, kar vemo o osnovnih pojavih, [bodo] v bistvu dobili navdih za preizkušanje zanimivih novih pristopov.

Vijay Pande: Všeč mi je bilo, ko ste govorili le o primeru papirja Pozornost je vse, kar potrebujete, o tem, kako ste želeli dobiti to raznoliko skupino ljudi, katerih strasti so bile, veste, dokaj pravokotne drug od drugega. In v nekem smislu, ko to počnete pri biologiji in še posebej pri tem, kar počnete pri Inceptiveu, morate vse to delo vložiti tudi v ustvarjanje podatkov. In ustvarjanje podatkov v resnici pomeni, če smo zelo jasni, izvajanje bioloških poskusov v velikem obsegu. Sam vhodni del je zelo drag in zelo tehničen, in kot ste rekli, ima toliko načinov, da gre narobe. Toda sliši se, kot da gradite na kulturi, ki ste jo delali prej, zdaj pa je samo več strokovnjakov z različnimi strastmi, ki se usklajujejo na podoben način.

Jakob Uszkoreit: Resnično potrebujem, [in] ljudje to potrebujejo. Kolikor vem, je to najbolj obetavna pot. [Ne gre] za cilj, v določenem smislu, za model cevovoda, kjer so določeni podatki v laboratoriju, v katerem so bili ustvarjeni, glede na naše najboljše znanje o temeljnih vidikih življenja. In nato začne izvajati obstoječe pristope globokega učenja na njem in jih nato prilagajati. Toda namesto tega dejansko imeti ljudi, ki so v določenem smislu lahko med prvimi ljudmi, ki resnično delajo v disciplini, ki trenutno še nima velikega imena.

Morda je najmanjši skupni imenovalec radovednost, ki presega tisto, kar veste, kar ste se že naučili in za kar ste morda porabili večino svojega časa. Ugotavljamo, da tako kot na mnogih drugih področjih, v resnici iščemo skupino ljudi z zelo različnimi ozadji, ki pa jim je skupna radovednost.

Kam gre AI?

Vijay Pande: Kaj mislite, kje je umetna inteligenca trenutno za tiste težje težave, za načrtovanje zdravil, zdravstveno varstvo itd.? Kaj je treba narediti? Kdaj bo tam?

Jakob Uszkoreit: Pričakoval bi – in vedno je zelo nevarno napovedovati prihodnost –, da bi bil zelo presenečen, če v naslednjih treh letih ne bi dejansko videli [prelomne] točke, ko gre za učinke v resničnem svetu strojno učenje, obsežno poglobljeno učenje pri razvoju zdravil, načrtovanje zdravil. Kje natančno bodo najprej, seveda verjamem, da se jih bo veliko zgodilo v zvezi z RNA, terapevtiki RNA in cepivi. To zagotovo ne bo edino področje, ki ga bo to prizadelo, vsekakor pa mislim, da smo na poti na ozemlje prelomne točke.

Vijay Pande: Povedal si zanimivo točko. Kaj je drugače pri RNA? Ker mislim, da je še posebej zanimivo, ne samo to, da ste šli iz Google Braina v biologijo, ampak ste šli posebej v RNA. Kaj vas privlači pri RNA, še posebej morda z vidika AI ali ML?

Jakob Uszkoreit: Ena stvar, ki je zanimiva pri RNA, je kombinacija med, kot smo videli, zelo široko uporabnostjo – čeprav je še vedno ozka v smislu ene same indikacije – toda če samo pogledamo ta val postopkov odobritve, ki se je začel in se je začel, je precej jasno, da je uporabnost zelo, zelo široka, skupaj s strukturno preprostim problemom - to je nekoliko dvoumno. In strukturno preprosto ni v stavku, da je napovedovanje strukture RNK preprosto, ampak je strukturno preprosto v smislu, da je biopolimer s štirimi različnimi bazami. Ne govorimo o več kot 20 aminokislinah. To je nekaj, kar je mogoče proizvesti dokaj učinkovito.

Obstaja nekaj izzivov, toda sinteza je nekaj, kar se lahko poveča in se hitro poveča, in te stvari se resnično združijo, da omogočijo to hitro povratno zanko, na katero mislim, da se pogosto omenja, vendar se zelo redko, vsaj kolikor jaz vem, dejansko izvaja in izvedljivo ob koncu dneva.

Vijay Pande: Ja, verjetno gre za hitrejšo povratno zanko, še posebej glede na to, kako ji sledite.

Jakob Uszkoreit: ja In glede na to, da verjamem, da moramo ustvariti levji delež podatkov za usposabljanje modelov, ki jih usposabljamo, resnično vlagamo Inceptive v ustvarjanje takih podatkov v velikem obsegu. Rekel bi, da razmeroma dokaj ogromen obseg, glede na to, da se zdi, da je RNA daleč najboljša kombinacija, ko gre za strukturno preprostost, pa tudi razširljivost sinteze in tega eksperimentiranja. Tu je ogromen potencial, ki do sedaj ni bil izkoriščen.

Vijay Pande: Ja, in mislim, da je še posebej potencialna sposobnost teh hitrih ciklov, tako nekako predkliničnih in zato hitreje priti na kliniko in biti na kliniki [krajše časovno obdobje].

Jakob Uszkoreit: Vsekakor. To je tisto, kar res upamo. Vidimo tudi morda zgodnje namige, ki kažejo, da bi to lahko bilo res in nad čimer smo seveda zelo, zelo navdušeni.

Vijay Pande: Razmišljanje o zadnjih 10 letih je bilo neverjetno, veste, od leta 2012 do danes. Kaj mislite, kako bo videti naslednjih 10 let? Kaj mislite, kje smo z AI čez 10 let? Na splošno ali posebej za biografijo?

Jakob Uszkoreit: Mislim, da če je res res, da vstopamo na to ozemlje prelomne točke, ko bomo čez 10 let pogledali nazaj, se bo zdelo, da je revolucija vsaj tako velika in obsežna kot tista, za katero mislimo, da smo jo videli v zadnjih 10 let. Vsaj. Zdaj mislim, da bo prišlo do bistvene razlike in to je, da ni povsem jasno, kako široko revolucija, ki smo ji priča v zadnjih 10 letih, vpliva na življenja vseh. Obstajajo nekatera področja, iskalniki ali pomoč pri pisanju itd., kjer je to očitno, vendar ni jasno, kako široko uporabna je ta revolucija. Verjamem, da je zelo res, vendar tega še ne vidimo. Mislim, da se bo revolucija, ki ji bomo v naslednjih 10 letih priča posebej v zvezi z biologijo ali ki jo bomo gledali nazaj čez 10 let, res razlikovala glede na njen globok vpliv na vsa naša življenja .

Tudi če odmislimo aplikacije za načrtovanje in odkrivanje zdravil, obstajajo tako neverjetne aplikacije v in okoli znanstvenih odkritij, kjer si zdaj lahko predstavljate, da lahko s spletnim vmesnikom ustvarite molekule, ki so v določenih organizmih z zelo veliko verjetnostjo, da bodo odgovori na določena vprašanja in ustvari bolj zanesljive odčitke kot, saj veste, tisto, kar ste lahko dobili prej. Tudi če samo izpustimo celotno zapletenost, kako bo to na koncu vplivalo na paciente in vse, mislim, da je precej jasno, da bodo ta orodja hitro pospešila področja, kot je biologija.

Vijay Pande: To se zdi odličen kraj za konec. Najlepša hvala, Jakob, da si se pridružil Bio Eats World.

Jakob Uszkoreit: Najlepša hvala, ker ste me imeli.

Olivia Webb: Hvala, ker ste se pridružili Bio Eats World. Bio Eats World gostim in produciram jaz, Olivia Webb, s pomočjo ekipe Bio + Health pri a16z in urejam Phil Hegseth. Bio Eats World je del mreže podcastov a16z.

Če imate vprašanja o epizodi ali želite predlagati teme za prihodnjo epizodo, pošljite e-pošto Nenazadnje, če uživate v Bio Eats World, nam pustite oceno in recenzijo, kjerkoli poslušate poddaje.

Upoštevajte, da je vsebina tukaj samo v informativne namene, je ne smete jemati kot pravni, poslovni, davčni ali naložbeni nasvet ali je uporabljati za ocenjevanje katere koli naložbe ali varnosti in ni namenjena vlagateljem ali potencialnim vlagateljem v kateri koli sklad a16z . Za več podrobnosti si oglejte a16z.com/disclosures.

***

Tukaj izražena stališča so stališča posameznega citiranega osebja družbe AH Capital Management, LLC (»a16z«) in niso stališča družbe a16z ali njenih podružnic. Nekatere informacije, vsebovane tukaj, so bile pridobljene iz virov tretjih oseb, vključno s portfeljskimi družbami skladov, ki jih upravlja a16z. Čeprav so vzeti iz virov, za katere menijo, da so zanesljivi, a16z ni neodvisno preveril takih informacij in ne daje nobenih zagotovil o trajni točnosti informacij ali njihovi ustreznosti za dano situacijo. Poleg tega lahko ta vsebina vključuje oglase tretjih oseb; a16z ni pregledal takšnih oglasov in ne podpira nobene oglaševalske vsebine v njih.

Ta vsebina je na voljo samo v informativne namene in se je ne smete zanašati kot pravni, poslovni, naložbeni ali davčni nasvet. Glede teh zadev se morate posvetovati s svojimi svetovalci. Sklici na katere koli vrednostne papirje ali digitalna sredstva so samo v ilustrativne namene in ne predstavljajo naložbenega priporočila ali ponudbe za zagotavljanje investicijskih svetovalnih storitev. Poleg tega ta vsebina ni namenjena nobenim vlagateljem ali bodočim vlagateljem niti ji ni namenjena in se nanjo v nobenem primeru ne smete zanašati, ko se odločate za vlaganje v kateri koli sklad, ki ga upravlja a16z. (Ponudba za vlaganje v sklad a16z bo podana le z memorandumom o zasebni plasiranju, pogodbo o vpisu in drugo ustrezno dokumentacijo katerega koli takega sklada in jo je treba prebrati v celoti.) Vse naložbe ali portfeljske družbe, omenjene, navedene ali opisane niso reprezentativne za vse naložbe v vozila, ki jih upravlja a16z, in ni nobenega zagotovila, da bodo naložbe donosne ali da bodo imele druge naložbe v prihodnosti podobne značilnosti ali rezultate. Seznam naložb skladov, ki jih upravlja Andreessen Horowitz (razen naložb, za katere izdajatelj ni dal dovoljenja a16z za javno razkritje, ter nenapovedanih naložb v digitalna sredstva, s katerimi se javno trguje), je na voljo na https://a16z.com/investments /.

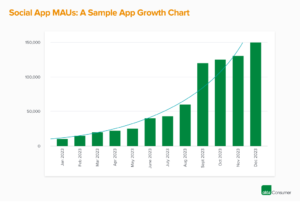

Grafi in grafi, ki so navedeni znotraj, so izključno informativne narave in se nanje ne bi smeli zanašati pri sprejemanju kakršnih koli investicijskih odločitev. Pretekla uspešnost ni pokazatelj prihodnjih rezultatov. Vsebina govori samo od navedenega datuma. Vse projekcije, ocene, napovedi, cilji, obeti in/ali mnenja, izražena v tem gradivu, se lahko spremenijo brez predhodnega obvestila in se lahko razlikujejo ali so v nasprotju z mnenji, ki so jih izrazili drugi. Za dodatne pomembne informacije obiščite https://a16z.com/disclosures.

- Distribucija vsebine in PR s pomočjo SEO. Okrepite se še danes.

- Platoblockchain. Web3 Metaverse Intelligence. Razširjeno znanje. Dostopite tukaj.

- vir: https://a16z.com/2023/01/11/bio-eats-world-using-ai-to-take-bio-farther/

- 10

- 2012

- a

- a16z

- sposobnost

- Sposobna

- O meni

- o IT

- absolutna

- absolutno

- Akademija

- akademsko

- pospeši

- plin

- natančnost

- čez

- dejansko

- prilagojeno

- Poleg tega

- Dodatne

- priznati

- Prednost

- Prednosti

- Oglaševanje

- nasveti

- svetovanje

- svetovalne storitve

- vplivajo

- podružnice

- cenovno

- po

- Sporazum

- AI

- ai raziskave

- algoritem

- algoritmi

- vsi

- skupaj

- že

- Čeprav

- vedno

- Neverjetno

- med

- Med nami

- znesek

- zneski

- in

- Andreessen

- Andreessen Horowitz

- Še ena

- odgovor

- kdo

- kjerkoli

- apetit

- primerno

- uporaba

- aplikacije

- Uporabi

- Uporaba

- pristop

- pristopi

- odobritev

- APT

- OBMOČJE

- območja

- trdijo

- Argumenti

- okoli

- vidik

- vidiki

- Sredstva

- domnevajo

- Zagotavljanje

- pozornosti

- Privlači

- Avtorji

- Na voljo

- Avenue

- povprečno

- nazaj

- Hrbtenica

- ozadje

- ozadja

- torba

- Vreča besed

- V bistvu

- Bajezijski

- ker

- postanejo

- postajajo

- pred

- zadaj

- počutje

- prepričanje

- Verjemite

- Menimo

- meni

- Bell

- spodaj

- koristno

- BEST

- Boljše

- med

- Poleg

- Big

- milijardah

- bio + zdravje

- biologija

- Bit

- črna

- svet

- Bottom

- zavezuje

- Pasovi

- Brain

- Prinaša

- široka

- splošno

- izgradnjo

- Building

- Bunch

- poslovni

- se imenuje

- Kapital

- zajemanje

- Kariera

- previdno

- knjigovodska

- primeru

- primeri

- strop

- Stoletje

- ceo

- nekatere

- Zagotovo

- izzivi

- izziv

- spremenite

- Spremembe

- lastnosti

- cenejša

- izbiri

- okoliščinah

- trdijo

- jasno

- Ambulanta

- Zapri

- tesno

- bližje

- grozdenje

- So-ustanovitelj

- sodelavci

- kombinacija

- kombinirani

- kako

- prihajajo

- Skupno

- komunicirajo

- Podjetja

- podjetje

- primerjalno

- v primerjavi z letom

- tekmuje

- kompleksna

- kompleksnost

- zapleten

- računanje

- Izračunajte

- računalnik

- Računalništvo

- Računalniška vizija

- računalniki

- koncepti

- idejni

- zaporedna

- predstavljajo

- vsebina

- ozadje

- nasprotno

- prispevkov

- Pogovor

- pogovorov

- usklajevanje

- strošek

- bi

- par

- skupaj

- Tečaj

- ustvarjajo

- ustvaril

- Ustvarjanje

- ustvarjalnost

- ključnega pomena

- Kultura

- radovednost

- radovedna

- Trenutna

- Trenutno

- ciklov

- Oče

- Nevarno

- datum

- Podatkov usmerjenih

- Datum

- dan

- Dnevi

- Odločitev

- globoko

- globoko učenje

- globoke nevronske mreže

- globlje

- vsekakor

- opisano

- Oblikovanje

- zasnovan

- Podrobnosti

- Razvoj

- razvili

- Razvoj

- DID

- se razlikujejo

- Razlika

- drugačen

- težko

- digitalni

- Digitalna sredstva

- Večerja

- neposredna

- neposredno

- Razkrije

- odkrivanje

- Odkritje

- razpravlja

- Razprava

- oddaljeni

- razne

- DNK

- Dokumentacija

- Ne

- tem

- domena

- domen

- dont

- navzdol

- prenesi

- pomanjkljivosti

- vozi

- drog

- razvoj zdravil

- Droge

- vsak

- Zgodnje

- enostavno

- Uredništvo

- učinkovito

- Učinki

- učinkovitosti

- prizadevanja

- bodisi

- drugje

- E-naslov

- objem

- smirkovim

- omogočajo

- srečanje

- srečanje

- potrdi

- trajno

- Motorji

- ogromno

- dovolj

- zagotovitev

- Celotna

- popolnoma

- celota

- Podjetnik

- okolje

- enačbe

- Enakovredna

- zlasti

- ocene

- itd

- oceniti

- Tudi

- dogodki

- sčasoma

- VEDNO

- vsi

- vse

- točno

- Primer

- Razen

- razburjen

- zanimivo

- izključuje

- obstoječih

- ekspanziven

- drago

- izkušnje

- Strokovnjaki

- express

- izražena

- pošteno

- seznanjeni

- družina

- zanimivo

- FAST

- hitreje

- izvedljivo

- Feature

- povratne informacije

- Nekaj

- Polje

- Področja

- filter

- Najdi

- konec

- prva

- fit

- Osredotočite

- osredotočena

- ospredju

- tuji

- prej

- je pokazala,

- Fundacija

- Ustanovitelj

- ustanovitve

- FRAME

- iz

- polno

- v celoti

- Sklad

- Osnove

- Skladi

- smešno

- Poleg tega

- Prihodnost

- splošno

- ustvarjajo

- generacija

- generativno

- Generativna AI

- nemški

- dobili

- pridobivanje

- Daj

- dana

- daje

- Globalno

- Go

- dogaja

- dobro

- google Translate

- Googlova

- Grafične kartice

- diplomiral

- graf

- graf nevronskih mrež

- grafi

- veliko

- skupina

- Skupine

- Pridelovanje

- Pol

- se zgodi

- se zgodi

- Trdi

- strojna oprema

- ob

- Glava

- vodil

- Zdravje

- zdravstveno varstvo

- pomoč

- tukaj

- visoka

- več

- nasveti

- hit

- upa

- v upanju,

- Horowitz

- gostila

- Kako

- Kako

- HTTPS

- velika

- Ljudje

- Hurt

- Ideja

- identificirati

- slika

- generiranje slik

- slike

- domišljija

- vpliv

- izvajati

- Izvajanje

- izvajali

- Pomembno

- nemogoče

- navdušeni

- Izboljšave

- in

- V drugi

- Spodbuda

- vključujejo

- vključeno

- Vključno

- Neverjetno

- neverjetno

- neodvisno

- individualna

- industrijske

- Industrija

- Pregibna točka

- Podatki

- Informacijsko

- začetna

- novosti

- vhod

- Navdih

- navdih

- Namesto

- interakcijo

- Zanimivo

- vmesnik

- notranji

- Internet

- križišče

- intuitivno

- Izmišljeno

- izumi

- Invest

- vlaganjem

- naložbe

- naložbe

- Vlagatelji

- vključeni

- vprašanje

- Izdajatelj

- Vprašanja

- IT

- Italijanski

- sam

- pridružite

- pridružil

- Potovanje

- skoči

- vzdrževanje

- Ključne

- Otrok

- Vedite

- znanje

- lab

- Labs

- jezik

- jeziki

- velika

- obsežne

- večja

- Zadnja

- začela

- Zakoni

- plasti

- vodi

- vodi

- skoki

- UČITE

- naučili

- učenje

- pustite

- odhodu

- Pravne informacije

- dolžina

- Lens

- najem

- Stopnja

- življenje

- Life Sciences

- vrstica

- LINK

- Seznam

- Poslušanje

- malo

- živi

- Long

- Poglej

- si

- POGLEDI

- Sklop

- ljubezen

- ljubil

- stroj

- strojno učenje

- strojno prevajanje

- Stroji

- je

- vzdrževati

- Znamka

- IZDELA

- Izdelava

- upravlja

- upravljanje

- Način

- več

- ogromen

- materiali

- math

- Matter

- Zadeve

- kar pomeni,

- pomeni

- Memorandum

- Spomin

- omenjeno

- Metode

- morda

- moti

- minirano

- ML

- Model

- modeli

- sodobna

- molekula

- več

- Najbolj

- motivirani

- premikanje

- gibanja

- premikanje

- Ime

- in sicer

- naravna

- Naravni jezik

- nujno

- potrebno

- Nimate

- mreže

- mreža

- omrežij

- Nevronski

- nevronske mreže

- Novo

- Naslednja

- hrup

- Opombe

- Številka

- opazujejo

- pridobljeni

- ponudba

- ponujanje

- ONE

- odprite

- Mnenje

- Komentarji

- optimizacija

- možnosti

- Da

- naročila

- Ostalo

- drugi

- Splošni

- lastne

- parov

- Papir

- paradigma

- vzporedno

- del

- zlasti

- zlasti

- partner

- deli

- zabava

- strastno

- preteklosti

- Patch

- Obliži

- pot

- bolniki

- Vzorec

- ljudje

- performance

- Obdobje

- Dovoljenje

- oseba

- Osebno

- osebje

- pojav

- FILA

- Fizika

- plinovod

- pixel

- Kraj

- Mesta

- platon

- Platonova podatkovna inteligenca

- PlatoData

- igralci

- prosim

- žepi

- Podcast

- Poddaje

- Točka

- Pogled na točko

- Bazeni

- Portfelj

- pozicije

- mogoče

- potencial

- potencialno

- moč

- poganja

- močan

- Praktično

- praksa

- pragmatično

- Ravno

- napoved

- Napovedi

- precej

- prejšnja

- prej

- v prvi vrsti

- Predhodna

- zasebna

- verjetno

- problem

- Težave

- Postopek

- Procesi

- obravnavati

- Proizvedeno

- Izdelek

- proizvodnja

- Izdelki

- donosno

- Projekt

- Napovedi

- projekti

- Obljuba

- obetaven

- možnosti

- zaščiteni

- Beljakovine

- zagotavljajo

- če

- publikacije

- javno

- objavljeno

- Založništvo

- namene

- dal

- Dajanje

- vprašanje

- vprašanja

- radikalno

- naključno

- hitro

- hitro

- REDKO

- ocena

- dosežejo

- Preberi

- beri skupaj

- pravo

- resnični svet

- realizirano

- uresničevanje

- Razlogi

- Priporočilo

- ponovitev

- Rdeča

- zmanjša

- zmanjšanje

- reference

- besedilu

- Režim

- povezane

- pomembno

- zanesljiv

- ostajajo

- ne pozabite

- Renesansa

- zastopanje

- predstavnik

- zahteva

- Raziskave

- restavracije

- Rezultati

- pregleda

- Pregledal

- popravki

- Revolucija

- RNA

- Run

- tek

- Je dejal

- Enako

- shranjevanje

- Prilagodljivost

- Lestvica

- skaliranje

- <span style="color: #f7f7f7;">Šola</span>

- Znanost

- ZNANOSTI

- Znanstvena raziskava

- Znanstvenik

- Iskalnik

- Iskalniki

- drugi

- Vrednostni papirji

- varnost

- videnje

- Zdi se,

- višji

- Občutek

- stavek

- Zaporedje

- Storitve

- nastavite

- Kompleti

- nastavitev

- več

- Delite s prijatelji, znanci, družino in partnerji :-)

- premik

- Kratke Hlače

- kratkoročno

- shouldnt

- Prikaži

- pomemben

- Podoben

- podobno

- Enostavno

- preprostost

- poenostavitev

- poenostavitev

- hkrati

- saj

- sam

- Sedenje

- Razmere

- Velikosti

- počasi

- Počasi

- majhna

- manj

- So

- doslej

- SOLVE

- nekaj

- nekdo

- Nekaj

- nekoliko

- nekje

- Kmalu

- prefinjeno

- Viri

- Vesolje

- Spark

- gledano

- Govori

- specifična

- posebej

- specifičnosti

- porabljen

- stati

- Stanford

- Začetek

- začel

- Začetek

- zagon

- Ustanavljanjem

- state-of-the-art

- Statistično

- Korak

- Koraki

- Še vedno

- Zgodba

- ulica

- močna

- strukturno

- Struktura

- Študije

- študija

- kamen

- predmet

- naročnina

- uspeh

- taka

- dovolj

- presenečen

- sistem

- sistemi

- miza

- Bodite

- Takeaways

- ob

- Pogovor

- pogovor

- ciljno

- Cilji

- Naloge

- davek

- skupina

- tech

- tehnični

- Pogoji

- tvorjenje besedila

- O

- Prihodnost

- informacije

- svet

- njihove

- sami

- terapevtiki

- Tukaj.

- zato

- v njem

- stvar

- stvari

- Razmišljanje

- tretjih oseb

- mislil

- tisoče

- 3

- skozi

- vsej

- pretočnost

- čas

- krat

- do

- danes

- skupaj

- tokenizirati

- Tone

- tudi

- orodje

- orodja

- Teme

- s katerimi se trguje

- tradicionalna

- Vlak

- usposobljeni

- usposabljanje

- Prepis

- transformatorji

- Prehod

- prevesti

- prevod

- trillions

- Res

- turing

- Obrnjen

- Vrste

- Konec koncev

- pod

- osnovni

- razumeli

- razumevanje

- razumel

- neizkoriščen

- us

- uporaba

- cepiva

- vrednost

- Vozila

- prodajni avtomati

- preverjeno

- zelo raznolika

- Video

- Poglej

- ogledov

- Vizija

- hotel

- Wave

- načini

- web

- dobrodošli

- Kaj

- Kaj je

- ali

- ki

- medtem

- WHO

- bo

- okna

- v

- brez

- priča

- priča

- Čudovit

- beseda

- besede

- delo

- deluje

- deluje

- svet

- svetu

- bi

- pisati

- pisanje

- Napačen

- let

- Vaša rutina za

- zefirnet