Первый стартап Джоша Лоспиносо в области кибербезопасности был приобретен в 2017 году компаниями Raytheon/Forcepoint. Его второй, Shift5, работает с американскими военными, железнодорожными операторами и авиакомпаниями, включая JetBlue. Выпускник Вест-Пойнта 2009 года и стипендиат Родса, 36-летний бывший армейский капитан провел более десяти лет авторские хакерские инструменты для Агентства национальной безопасности и Киберкомандования США.

Лоспиносо недавно рассказал подкомитету Сената по вооруженным силам, как искусственный интеллект может помочь защитить военные операции. Генеральный директор / программист обсудил эту тему с Associated Press, а также то, как уязвимости программного обеспечения в системах вооружений представляют собой серьезную угрозу для вооруженных сил США. Интервью было отредактировано для ясности и длины.

В: В своих показаниях вы описали две основные угрозы технологиям с искусственным интеллектом: одна — кража. Это говорит само за себя. Другой — отравление данных. Вы можете это объяснить?

A: Один из способов думать об отравлении данных — это цифровая дезинформация. Если злоумышленники смогут обрабатывать данные, которые видят технологии с поддержкой ИИ, они могут серьезно повлиять на то, как эта технология работает.

В: Происходит ли отравление данных?

A: Мы не видим его широко. Но это произошло. Один из самых известных случаев произошел в 2016 году. Microsoft выпустила чат-бота в Твиттере под названием Tay, который узнал об этом из разговоров в Интернете. Злоумышленники сговорились публиковать в Твиттере оскорбительные, оскорбительные выражения. Тай начал генерировать воспалительный контент. Microsoft отключила его.

В: ИИ — это не только чат-боты. Это уже давно стало неотъемлемой частью кибербезопасности, верно?

О: ИИ используется в фильтрах электронной почты, чтобы попытаться пометить и отделить нежелательную почту и фишинговые приманки. Другим примером являются конечные точки, такие как антивирусная программа на вашем ноутбуке или программное обеспечение для обнаружения вредоносных программ, работающее в сети. Конечно, наступательные хакеры также используют ИИ, чтобы попытаться обойти эти системы классификации. Это называется состязательный ИИ.

Вопрос: Давайте поговорим о военных программных системах. Тревожный 2018 год Отчет Управления по подотчетности правительства сказал, что почти все недавно разработанные системы вооружений имеют критически важные уязвимости. И в Пентагоне думают о том, чтобы внедрить ИИ в такие системы?

О: Здесь есть две проблемы. Во-первых, нам необходимо надлежащим образом обезопасить существующие системы вооружений. Это технический долг, который у нас есть, и на его погашение уйдет очень много времени. Кроме того, есть новый рубеж защиты алгоритмов ИИ — новые вещи, которые мы будем устанавливать. В отчете GAO на самом деле не говорилось об ИИ. Так что забудьте об ИИ на секунду. Если бы эти системы остались такими, какие они есть, они по-прежнему очень уязвимы.

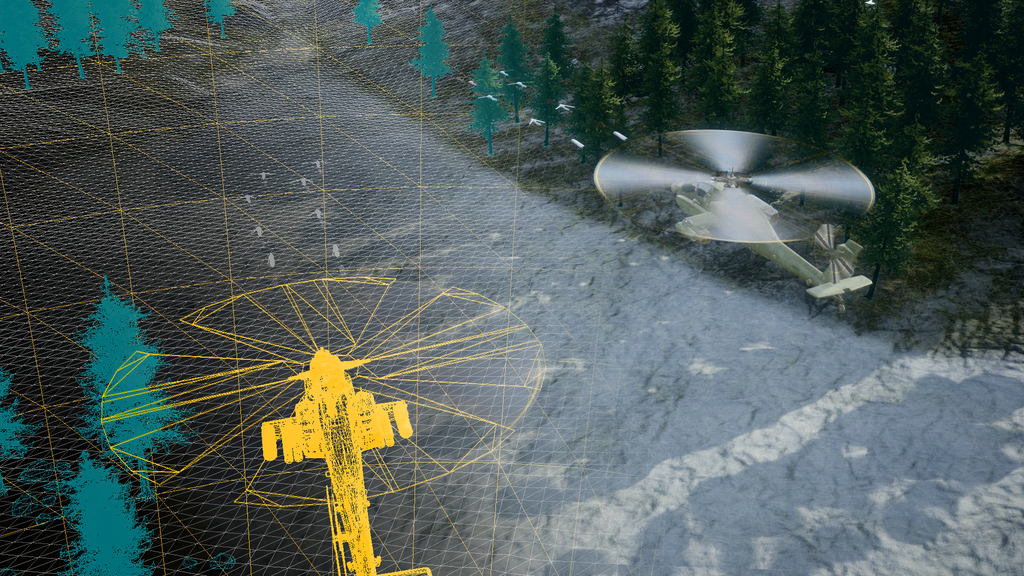

Мы обсуждаем расширение возможностей и добавление возможностей с поддержкой ИИ для таких вещей, как улучшенное обслуживание и операционная аналитика. Все здорово. Но мы строим на вершине карточного домика. Многим системам уже несколько десятков лет, они оснащены цифровыми технологиями. Самолеты, наземная техника, космические средства, подводные лодки. Теперь они взаимосвязаны. Мы обмениваемся данными. Системы уязвимы, их трудно обновить, и они могут быть атакованы. Как только злоумышленник получает доступ, игра окончена.

Иногда проще создать новую платформу, чем перепроектировать цифровые компоненты существующих систем. Но есть роль ИИ в обеспечении безопасности этих систем. ИИ можно использовать для защиты, если кто-то попытается их скомпрометировать.

Вопрос: Вы свидетельствовали, что приостановка исследований в области ИИ, как утверждают некоторые, была бы плохой идеей, потому что это благоприятствовало бы Китаю и другим конкурентам. Но у вас также есть опасения по поводу безудержного стремления к продуктам ИИ. Почему?

A: Ненавижу звучать фаталистично, но случай так называемого «сгорающего использования», похоже, применим. Продукт, спешащий на рынок, часто загорается (взламывается, выходит из строя, наносит непреднамеренный ущерб). И мы говорим: «Парень, нам нужно было встроить систему безопасности». Я ожидаю, что темпы развития ИИ ускорятся, и нам может не хватить паузы, чтобы сделать это безопасным и ответственным образом. По крайней мере, Белый дом и Конгресс обсуждают эти вопросы.

В: Похоже, что несколько компаний, в том числе оборонных, спешат объявить о полусырых продуктах ИИ.

О: Каждая технологическая компания и многие нетехнологические компании совершили резкий поворот в сторону ИИ. Грядут экономические потрясения. Бизнес-модели коренным образом изменятся. Неудачи уже происходят или не за горами, и бизнес-лидеры стараются не попасть впросак.

В: А как насчет использования ИИ для принятия военных решений, таких как наведение целей?

Ответ: Я категорически не думаю, что алгоритмы искусственного интеллекта — данные, которые мы собираем, — готовы к прайм-тайму для принятия решений системой смертоносного оружия. Мы просто далеки от этого.

- SEO-контент и PR-распределение. Получите усиление сегодня.

- ПлатонАйСтрим. Анализ данных Web3. Расширение знаний. Доступ здесь.

- Чеканка будущего с Эдриенн Эшли. Доступ здесь.

- Покупайте и продавайте акции компаний PREIPO® с помощью PREIPO®. Доступ здесь.

- Источник: https://www.defensenews.com/artificial-intelligence/2023/05/29/adversarial-ai-a-threat-to-military-systems-shift5s-lospinoso-says/

- :имеет

- :является

- :нет

- 2016

- 2017

- 2018

- 70

- a

- в состоянии

- О нас

- ускорять

- доступ

- отчетность

- приобретенный

- добавить

- адекватно

- состязательный

- агентство

- AI

- ай исследование

- самолет

- Авиакомпании

- алгоритмы

- Все

- уже

- причислены

- an

- и

- анонсировать

- Другой

- антивирус

- Применить

- МЫ

- вооруженный

- армия

- искусственный

- искусственный интеллект

- AS

- Активы

- связанный

- At

- Плохой

- BE

- , так как:

- было

- начал

- широко

- строить

- Строительство

- построенный

- Группа

- бизнес

- но

- by

- под названием

- CAN

- возможности

- Карты

- случаев

- случаев

- пойманный

- изменение

- Chatbot

- chatbots

- Китай

- ясность

- классификация

- Сбор

- приход

- Компании

- Компания

- конкурентов

- компоненты

- скомпрометированы

- Обеспокоенность

- Конгресс

- содержание

- Беседы

- может

- курс

- выработать

- критической

- кибер-

- Информационная безопасность

- данным

- Долг

- десятилетие

- десятилетия

- Принятие решений

- решения

- Защита

- описано

- обнаружение

- развитый

- Развитие

- Интернет

- обсуждается

- обсуждающий

- дезинформация

- do

- приносит

- легче

- Экономические

- достаточно

- Каждая

- пример

- существующий

- ожидать

- Объяснять

- не удается

- далеко

- в пользу

- фильтры

- Для пожарных

- Во-первых,

- Что касается

- Бывший

- от

- Граница

- принципиально

- Доходы

- игра

- GAO

- порождать

- получить

- будет

- большой

- земля

- взломанa

- Хакеры

- взлом

- было

- произошло

- Случай

- Жесткий

- Есть

- стремительный

- помощь

- здесь

- его

- горизонт

- Вилла / Бунгало

- Как

- HTTPS

- i

- идея

- if

- изображений

- Влияние

- улучшенный

- in

- В том числе

- устанавливать

- рефлексологии

- Интеллекта

- взаимосвязано

- Интервью

- в

- вопросы

- IT

- JetBlue

- всего

- язык

- портативный компьютер

- Лидеры

- узнали

- наименее

- Длина

- такое как

- Длинное

- много времени

- сделанный

- техническое обслуживание

- основной

- Создание

- вредоносных программ

- обнаружение вредоносных программ

- многих

- рынок

- Microsoft

- может быть

- военный

- Наша миссия

- Модели

- БОЛЕЕ

- Названный

- национальный

- Национальная безопасность

- Управление национальной безопасности

- почти

- Необходимость

- сетей

- Новые

- Новая Платформа

- роман

- сейчас

- произошло

- of

- наступление

- Офис

- оффлайн

- .

- Старый

- on

- консолидировать

- ONE

- онлайн

- работает

- оперативный

- Операционный отдел

- Операторы

- or

- Другое

- внешний

- за

- Темп

- Пауза

- ОПЛАТИТЬ

- пятиугольник

- фишинг

- Стержень

- Платформа

- Платон

- Платон Интеллектуальные данные

- ПлатонДанные

- Точка

- нажмите

- Простое число

- Основной

- Продукт

- Продукция

- FitPartner™

- для защиты

- Нажимать

- Полагая

- рельс

- готовый

- на самом деле

- недавно

- офиса

- выпустил

- отчету

- исследованиям

- ответственный

- правую

- Роли

- торопить

- s

- Сказал

- сообщили

- говорит

- Во-вторых

- сектор

- безопасный

- обеспечение

- безопасность

- посмотреть

- видя

- кажется

- Сенат

- Услуги

- должен

- So

- уже

- Software

- некоторые

- Кто-то

- Звук

- Space

- потраченный

- ввод в эксплуатацию

- остались

- По-прежнему

- подкомиссия

- предмет

- такие

- обмен

- система

- системы

- взять

- Говорить

- направлены

- технологии

- Технологическая компания

- Технический

- технологии

- Технологии

- свидетельствовала

- свидетельство

- чем

- который

- Ассоциация

- кража

- Их

- тогда

- Там.

- Эти

- они

- вещи

- think

- мышление

- этой

- те

- угроза

- угрозы

- время

- в

- приняли

- топ

- к

- стараться

- Tweet

- два

- нам

- модернизация

- использование

- используемый

- пользователей

- Транспорт

- очень

- Уязвимости

- Уязвимый

- законопроект

- Путь..

- we

- Оружие

- ЧТО Ж

- запад

- Что

- белый

- Белый дом

- зачем

- работает

- бы

- являетесь

- ВАШЕ

- зефирнет