Introducere

Mașinile și avioanele fără șofer nu mai sunt lucrurile viitorului. Numai în orașul San Francisco, două companii de taxi au înregistrat colectiv 8 milioane de mile de conducere autonomă până în august 2023. Și peste 850,000 de vehicule aeriene autonome, sau drone, sunt înregistrate în Statele Unite – fără a se număra pe cele deținute de armată.

Dar există preocupări legitime cu privire la siguranță. De exemplu, într-o perioadă de 10 luni care sa încheiat în mai 2022, National Highway Traffic Safety Administration raportate aproape 400 de accidente care au implicat automobile folosind o formă de control autonom. În urma acestor accidente au murit șase persoane, iar cinci au fost grav rănite.

Modul obișnuit de a aborda această problemă – numit uneori „testare prin epuizare” – implică testarea acestor sisteme până când sunteți mulțumit că sunt în siguranță. Dar nu poți fi niciodată sigur că acest proces va descoperi toate defectele potențiale. „Oamenii efectuează teste până când și-au epuizat resursele și răbdarea”, a spus Sayan Mitra, un informatician la Universitatea din Illinois, Urbana-Champaign. Cu toate acestea, testarea singură nu poate oferi garanții.

Mitra și colegii săi pot. Echipa lui a reușit dovedi il siguranţă a capacităților de urmărire a benzii pentru mașini și sisteme de aterizare pentru aeronave autonome. Strategia lor este acum folosită pentru a ajuta dronele să aterizeze pe portavioane, iar Boeing plănuiește să o testeze pe un avion experimental în acest an. „Metoda lor de a oferi garanții de siguranță end-to-end este foarte importantă”, a spus Corina Pasareanu, un cercetător de la Universitatea Carnegie Mellon și Centrul de Cercetare Ames al NASA.

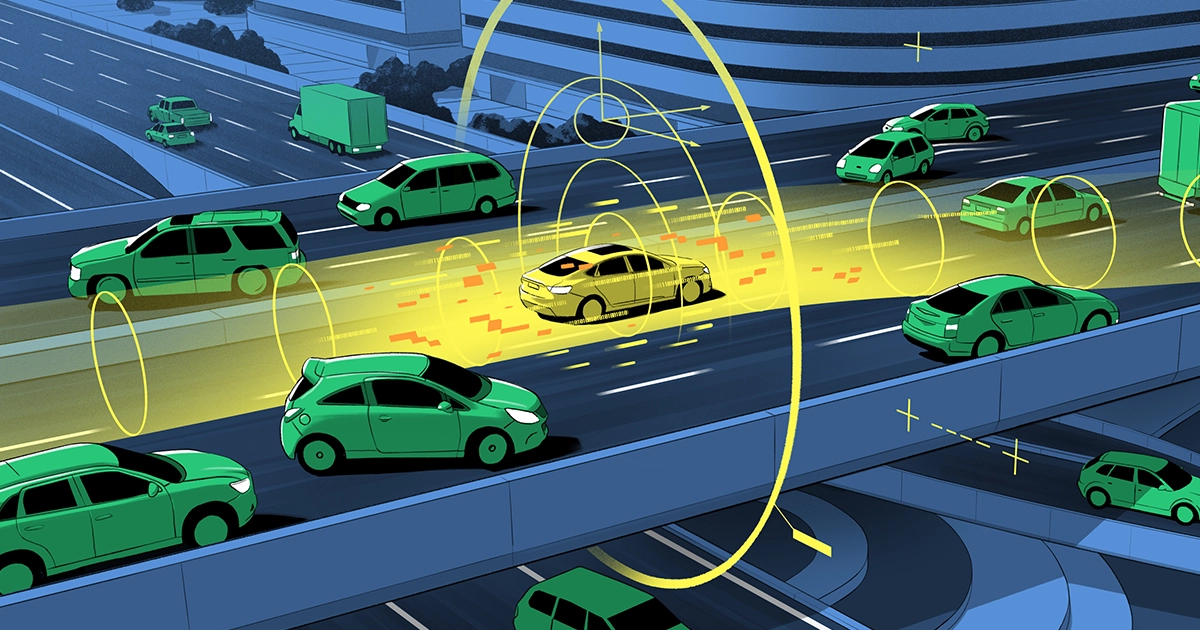

Munca lor presupune garantarea rezultatelor algoritmilor de învățare automată care sunt utilizați pentru a informa vehiculele autonome. La un nivel înalt, multe vehicule autonome au două componente: un sistem perceptiv și un sistem de control. Sistemul de percepție vă spune, de exemplu, cât de departe este mașina dvs. de centrul benzii sau în ce direcție se îndreaptă un avion și care este unghiul său față de orizont. Sistemul funcționează prin transmiterea datelor brute de la camere și alte instrumente senzoriale către algoritmi de învățare automată bazați pe rețele neuronale, care recreează mediul în afara vehiculului.

Aceste evaluări sunt apoi trimise la un sistem separat, modulul de control, care decide ce să facă. Dacă se apropie un obstacol, de exemplu, acesta decide dacă acţionează frânele sau virează în jurul lui. Conform Luca Carlone, profesor asociat la Institutul de Tehnologie din Massachusetts, în timp ce modulul de control se bazează pe o tehnologie bine stabilită, „aceasta ia decizii pe baza rezultatelor percepției și nu există nicio garanție că acele rezultate sunt corecte”.

Pentru a oferi o garanție de siguranță, echipa Mitra a lucrat la asigurarea fiabilității sistemului de percepție al vehiculului. Ei au presupus mai întâi că este posibil să se garanteze siguranța atunci când este disponibilă o redare perfectă a lumii exterioare. Apoi au determinat cât de multă eroare introduce sistemul de percepție în recrearea împrejurimilor vehiculului.

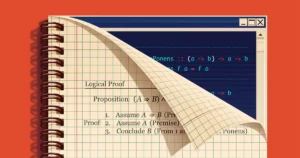

Cheia acestei strategii este de a cuantifica incertitudinile implicate, cunoscute sub numele de bandă de eroare – sau „necunoscutele cunoscute”, după cum a spus Mitra. Acest calcul vine din ceea ce el și echipa lui numesc un contract de percepție. În ingineria software, un contract este un angajament că, pentru o intrare dată într-un program de calculator, rezultatul se va încadra într-un interval specificat. A stabili această gamă nu este ușor. Cât de precisi sunt senzorii mașinii? Câtă ceață, ploaie sau strălucire solară poate tolera o dronă? Dar dacă poți menține vehiculul într-un interval specificat de incertitudine și dacă determinarea acelui interval este suficient de precisă, echipa Mitra a demonstrat că îi poți asigura siguranța.

Introducere

Este o situație familiară pentru oricine are un vitezometru imprecis. Dacă știți că dispozitivul nu se oprește niciodată cu mai mult de 5 mile pe oră, puteți evita în continuare viteza, rămânând întotdeauna cu 5 mph sub limita de viteză (așa cum este indicată de vitezometrul dvs. nedemn de încredere). Un contract de percepție oferă o garanție similară a siguranței unui sistem imperfect care depinde de învățarea automată.

„Nu ai nevoie de percepție perfectă”, a spus Carlone. „Vrei doar să fie suficient de bun pentru a nu pune siguranța în pericol.” Cele mai mari contribuții ale echipei, a spus el, sunt „introducerea întregii idei de contracte de percepție” și furnizarea de metode pentru construirea acestora. Ei au făcut acest lucru bazându-se pe tehnici din ramura informatică numită verificare formală, care oferă o modalitate matematică de a confirma că comportamentul unui sistem satisface un set de cerințe.

„Chiar dacă nu știm exact cum face rețeaua neuronală ceea ce face”, a spus Mitra, ei au arătat că este încă posibil să se dovedească numeric că incertitudinea ieșirii unei rețele neuronale se află în anumite limite. Și, dacă acesta este cazul, atunci sistemul va fi în siguranță. „Putem oferi apoi o garanție statistică dacă (și în ce măsură) o anumită rețea neuronală va îndeplini de fapt aceste limite.”

Compania aerospațială Sierra Nevada testează în prezent aceste garanții de siguranță în timp ce aterizează o dronă pe un portavion. Această problemă este într-un fel mai complicată decât conducerea mașinilor din cauza dimensiunii suplimentare implicate în zbor. „La aterizare, există două sarcini principale”, a spus Dragos Margineantu, tehnolog șef AI la Boeing, „alinierea avionului cu pista și asigurarea că pista este liberă de obstacole. Lucrarea noastră cu Sayan implică obținerea de garanții pentru aceste două funcții.”

„Simulările care utilizează algoritmul lui Sayan arată că alinierea [a unui avion înainte de aterizare] se îmbunătățește”, a spus el. Următorul pas, planificat pentru sfârșitul acestui an, este utilizarea acestor sisteme în timp ce aterizează efectiv un avion experimental Boeing. Una dintre cele mai mari provocări, a remarcat Margineantu, va fi să ne dăm seama a ceea ce nu știm – „determinarea incertitudinii în estimările noastre” – și să vedem cum afectează acest lucru siguranța. „Cele mai multe erori apar atunci când facem lucruri pe care credem că le știm – și se dovedește că nu le știm.”

- Distribuție de conținut bazat pe SEO și PR. Amplifică-te astăzi.

- PlatoData.Network Vertical Generative Ai. Împuterniciți-vă. Accesați Aici.

- PlatoAiStream. Web3 Intelligence. Cunoștințe amplificate. Accesați Aici.

- PlatoESG. carbon, CleanTech, Energie, Mediu inconjurator, Solar, Managementul deșeurilor. Accesați Aici.

- PlatoHealth. Biotehnologie și Inteligență pentru studii clinice. Accesați Aici.

- Sursa: https://www.quantamagazine.org/how-to-guarantee-the-safety-of-autonomous-vehicles-20240116/

- :are

- :este

- :nu

- ][p

- 000

- 2022

- 2023

- 400

- 8

- a

- Despre Noi

- accidente

- Conform

- precis

- ACM

- de fapt

- adresare

- administrare

- Industria aerospațială

- AI

- avioane

- Avion

- Algoritmul

- algoritmi

- aliniere

- TOATE

- singur

- mereu

- an

- și

- oricine

- Aplică

- SUNT

- în jurul

- AS

- evaluări

- Avocat Colaborator

- asumat

- At

- August

- automobile

- autonom

- autovehicule autonome

- disponibil

- evita

- GRUP

- bazat

- BE

- deoarece

- comportament

- fiind

- de mai jos

- Cea mai mare

- Boeing

- limite

- Branch firma

- dar

- by

- calcul

- apel

- denumit

- camere video

- CAN

- nu poti

- capacități

- mașină

- Carnegie Mellon

- Universitatea Carnegie Mellon

- purtătorii

- transporta

- masini

- caz

- Centru

- sigur

- provocări

- şef

- Oraș

- UMC

- colegii

- colectiv

- vine

- angajament

- Companii

- companie

- complicat

- componente

- calculator

- Informatică

- preocupările

- construirea

- contract

- contribuţii

- Control

- corecta

- socoteală

- În prezent

- de date

- Deciziile

- Grad

- depinde de

- determinare

- determinat

- dispozitiv

- FĂCUT

- decedat

- Dimensiune

- direcţie

- do

- face

- Dont

- desen

- conducere

- zbârnâi

- Drone

- uşor

- un capăt la altul

- încheiat

- Inginerie

- suficient de

- asigura

- asigurare

- Întreg

- Mediu inconjurator

- eroare

- Erori

- exact

- exemplu

- experimental

- suplimentar

- Cădea

- familiar

- departe

- hrănire

- First

- cinci

- defecte

- care zboară

- Ceață

- Pentru

- formă

- formal

- Francisco

- Gratuit

- din

- funcții

- viitor

- obtinerea

- dat

- bine

- garanta

- garanții

- întâmpla

- Avea

- he

- Rubrică

- ajutor

- Înalt

- Şosea

- lui

- orizont

- oră

- Cum

- Cum Pentru a

- Totuși

- HTML

- HTTPS

- idee

- IEEE

- if

- Illinois

- important

- îmbunătăţi

- in

- indicată

- Informa

- intrare

- instanță

- Institut

- în

- Prezintă

- implicat

- implică

- implicând

- problema

- IT

- ESTE

- doar

- A pastra

- Cheie

- Cunoaște

- cunoscut

- Țară

- aterizare

- Bandă

- mai tarziu

- învăţare

- legitim

- Nivel

- se află

- LIMITĂ

- autentificat

- mai lung

- maşină

- masina de învățare

- revistă

- Principal

- Efectuarea

- gestionate

- multe

- Massachusetts

- Institutul de tehnologie din Massachusetts

- matematic

- Mai..

- Întâlni

- pepene

- metodă

- Metode

- Militar

- milion

- MIT

- modul

- mai mult

- mult

- național

- aproape

- Nevoie

- reţea

- rețele

- neural

- rețele neuronale

- rețele neuronale

- NEVADA

- nu

- următor

- Nu.

- notat

- acum

- obstacol

- obstacole

- of

- de pe

- on

- ONE

- opereaza

- or

- Altele

- al nostru

- afară

- producție

- exterior

- deţinute

- Răbdare

- oameni

- pentru

- percepţie

- Perfect

- perioadă

- plan

- Avioane

- planificat

- Planurile

- Plato

- Informații despre date Platon

- PlatoData

- posibil

- potenţial

- anterior

- Problemă

- proces

- Profesor

- Program

- Dovedi

- s-au dovedit

- furniza

- furnizează

- furnizarea

- pune

- RAIN

- gamă

- Crud

- date neprelucrate

- înregistrată

- încredere

- tencuială

- Cerinţe

- cercetare

- Resurse

- respect

- rezultat

- REZULTATE

- Risc

- pistei

- sigur

- Siguranţă

- Said

- San

- San Francisco

- satisfăcut

- Ştiinţă

- Om de stiinta

- vedere

- senzori

- trimis

- distinct

- Serios

- set

- Arăta

- a arătat

- asemănător

- situație

- SIX

- So

- Software

- Inginerie software

- solar

- unele

- uneori

- specificată

- viteză

- Statele

- statistic

- ședere

- conduce

- Pas

- Încă

- Strategie

- sigur

- sistem

- sisteme

- sarcini

- echipă

- tehnici de

- tehnolog

- Tehnologia

- spune

- test

- Testarea

- teste

- decât

- acea

- Viitorul

- lor

- Lor

- apoi

- Acolo.

- Acestea

- ei

- lucruri

- crede

- acest

- în acest an

- aceste

- deşi?

- Prin

- la

- Unelte

- trafic

- se transformă

- Două

- incertitudini

- Incertitudine

- descoperi

- Unit

- Statele Unite

- universitate

- până la

- viitoare

- utilizat

- folosind

- ca de obicei

- vehicul

- Vehicule

- Verificare

- foarte

- vrea

- Cale..

- modalități de

- we

- WebP

- au fost

- Ce

- cand

- dacă

- care

- în timp ce

- voi

- cu

- în

- Apartamente

- a lucrat

- lume

- an

- tu

- Ta

- zephyrnet