1Departamentul de Fizică, Universitatea din Waterloo, Waterloo, ON, N2L 3G1, Canada

2Institutul de calcul cuantic, Waterloo, ON, N2L 3G1, Canada

3Institutul Perimetru pentru Fizică Teoretică, Waterloo, Ontario, N2L 2Y5, Canada

4Xanadu, Toronto, ON, M5G 2C8, Canada

Găsiți această lucrare interesant sau doriți să discutați? Scite sau lasă un comentariu la SciRate.

Abstract

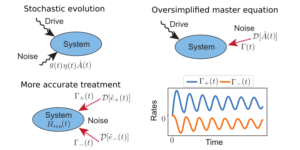

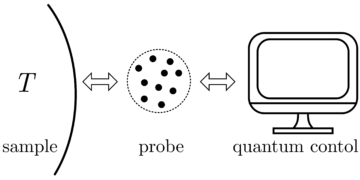

Succesul pe scară largă al rețelelor neuronale profunde a dezvăluit o surpriză în învățarea automată clasică: modelele foarte complexe se generalizează adesea bine, în timp ce în același timp supraajustează datele de antrenament. Acest fenomen de supraadaptare benignă a fost studiat pentru o varietate de modele clasice, cu scopul de a înțelege mai bine mecanismele din spatele învățării profunde. Caracterizarea fenomenului în contextul învățării automate cuantice ar putea îmbunătăți în mod similar înțelegerea noastră a relației dintre supraadaptare, supraparametrizare și generalizare. În această lucrare, oferim o caracterizare a supraajustării benigne în modelele cuantice. Pentru a face acest lucru, derivăm comportamentul unui model de caracteristici Fourier cu interpolare clasică pentru regresia semnalelor zgomotoase și arătăm cum o clasă de modele cuantice prezintă caracteristici analoge, legând astfel structura circuitelor cuantice (cum ar fi operațiile de codificare a datelor și de pregătire a stării). ) la supraparametrizare și supraadaptare în modele cuantice. Explicăm intuitiv aceste caracteristici în funcție de capacitatea modelului cuantic de a interpola date zgomotoase cu un comportament local „înțepător” și oferim un exemplu concret demonstrativ de supraadaptare benignă.

► Date BibTeX

► Referințe

[1] Michael A Nielsen. „Rețele neuronale și învățarea profundă”. Determinare Apăsaţi. (2015). url: http:///neuralnetworksanddeeplearning.com/.

http:///neuralnetworksanddeeplearning.com/

[2] Stuart Geman, Elie Bienenstock și René Doursat. „Rețelele neuronale și dilema părtinire/varianță”. Calculator neuronal. 4, 1–58 (1992).

https: / / doi.org/ 10.1162 / neco.1992.4.1.1

[3] Trevor Hastie, Robert Tibshirani, Jerome H Friedman și Jerome H Friedman. „Elementele învățării statistice: extragerea datelor, inferența și predicția”. Volumul 2. Springer. (2009).

https://doi.org/10.1007/978-0-387-84858-7

[4] Peter L. Bartlett, Andrea Montanari și Alexander Rakhlin. „Învățare profundă: un punct de vedere statistic”. Acta Numerica 30, 87–201 (2021).

https: / / doi.org/ 10.1017 / S0962492921000027

[5] Mihail Belkin. „Se potrivește fără teamă: fenomene matematice remarcabile de învățare profundă prin prisma interpolării”. Acta Numerica 30, 203–248 (2021).

[6] Peter L. Bartlett, Philip M. Long, Gábor Lugosi și Alexander Tsigler. „Suprafitting benign în regresie liniară”. Proc. Natl. Acad. Sci. 117, 30063–30070 (2020).

https: / / doi.org/ 10.1073 / pnas.1907378117

[7] Mikhail Belkin, Daniel Hsu, Siyuan Ma și Soumik Mandal. „Reconcilierea practicii moderne de învățare automată și a compromisului clasic de părtinire-varianță”. Proc. Natl. Acad. Sci. 116, 15849–15854 (2019).

https: / / doi.org/ 10.1073 / pnas.1903070116

[8] Mihail Belkin, Alexander Rakhlin și Alexandre B. Tsybakov. „Interpolarea datelor contrazice optimitatea statistică?”. În Proceedings of Machine Learning Research. Volumul 89, paginile 1611–1619. PMLR (2019). url: https:///proceedings.mlr.press/v89/belkin19a.html.

https:///proceedings.mlr.press/v89/belkin19a.html

[9] Vidya Muthukumar, Kailas Vodrahalli, Vignesh Subramanian și Anant Sahai. „Interpolarea inofensivă a datelor zgomotoase în regresie”. IEEE Journal on Selected Areas in Information Theory 1, 67–83 (2020).

https: / / doi.org/ 10.1109 / ISIT.2019.8849614

[10] Vidya Muthukumar, Adhyyan Narang, Vignesh Subramanian, Mikhail Belkin, Daniel Hsu și Anant Sahai. „Clasificare vs regresie în regimuri supraparametrizate: contează funcția de pierdere?”. J. Mach. Învăța. Res. 22, 1–69 (2021). url: http:///jmlr.org/papers/v22/20-603.html.

http: / / jmlr.org/ papers / v22 / 20-603.html

[11] Yehuda Dar, Vidya Muthukumar și Richard G. Baraniuk. „Un rămas bun de la compromisul părtinire-varianță? o privire de ansamblu asupra teoriei învățării automate supraparametrizate” (2021). arXiv:2109.02355.

arXiv: 2109.02355

[12] Marcello Benedetti, Erika Lloyd, Stefan Sack și Mattia Fiorentini. „Circuite cuantice parametrizate ca modele de învățare automată”. Sci. cuantică. Tehnol. 4, 043001 (2019).

https://doi.org/10.1088/2058-9565/ab4eb5

[13] K. Mitarai, M. Negoro, M. Kitagawa și K. Fujii. „Învățare cu circuite cuantice”. Fiz. Rev. A 98, 032309 (2018).

https: / / doi.org/ 10.1103 / physreva.98.032309

[14] Maria Schuld, Ville Bergholm, Christian Gogolin, Josh Izaac și Nathan Killoran. „Evaluarea gradienților analitici pe hardware-ul cuantic”. Fiz. Rev. A 99, 032331 (2019).

https: / / doi.org/ 10.1103 / physreva.99.032331

[15] Maria Schuld și Nathan Killoran. „Învățare automată cuantică în spații Hilbert caracteristice”. Fiz. Rev. Lett. 122, 040504 (2019).

https: / / doi.org/ 10.1103 / physrevlett.122.040504

[16] Vojtěch Havlíček, Antonio D. Córcoles, Kristan Temme, Aram W. Harrow, Abhinav Kandala, Jerry M. Chow și Jay M. Gambetta. „Învățare supravegheată cu spații de caracteristici îmbunătățite cuantic”. Nature 567, 209–212 (2019).

https://doi.org/10.1038/s41586-019-0980-2

[17] Seth Lloyd și Christian Weedbrook. „Învățare adversativă generativă cuantică”. Fiz. Rev. Lett. 121, 040502 (2018).

https: / / doi.org/ 10.1103 / physrevlett.121.040502

[18] Pierre-Luc Dallaire-Demers și Nathan Killoran. „Rețele adverse generative cuantice”. Fiz. Rev. A 98, 012324 (2018).

https: / / doi.org/ 10.1103 / physreva.98.012324

[19] Amira Abbas, David Sutter, Christa Zoufal, Aurelien Lucchi, Alessio Figalli și Stefan Woerner. „Puterea rețelelor neuronale cuantice”. Nat. Calculator. Sci. 1, 403–409 (2021).

https://doi.org/10.1038/s43588-021-00084-1

[20] Logan G. Wright și Peter L. McMahon. „Capacitatea rețelelor neuronale cuantice”. În 2020, Conferința privind laserele și electro-optica (CLEO). Paginile 1–2. (2020). url: https:///ieeexplore.ieee.org/document/9193529.

https:///ieeexplore.ieee.org/document/9193529

[21] Sukin Sim, Peter D. Johnson și Alán Aspuru-Guzik. „Expresibilitatea și capacitatea de încurcare a circuitelor cuantice parametrizate pentru algoritmi hibrizi cuantic-clasici”. Adv. Tehnologia cuantică. 2, 1900070 (2019).

https: / / doi.org/ 10.1002 / qute.201900070

[22] Thomas Hubregtsen, Josef Pichlmeier, Patrick Stecher și Koen Bertels. „Evaluarea circuitelor cuantice parametrizate: despre relația dintre acuratețea clasificării, expresibilitate și capacitatea de încurcare”. Quantum Mach. Intelege. 3, 1 (2021).

https: / / doi.org/ 10.1007 / s42484-021-00038-w

[23] Jarrod R McClean, Sergio Boixo, Vadim N Smelyanskiy, Ryan Babbush și Hartmut Neven. „Plașuri sterile în peisajele de antrenament al rețelelor neuronale cuantice”. Nat. comun. 9, 4812 (2018).

https://doi.org/10.1038/s41467-018-07090-4

[24] Marco Cerezo, Akira Sone, Tyler Volkoff, Lukasz Cicio și Patrick J Coles. „Platuri sterile dependente de funcția de cost în circuite cuantice parametrizate superficiale”. Nat. comun. 12, 1791 (2021).

https: / / doi.org/ 10.1038 / s41467-021-21728-w

[25] Matthias C. Caro, Elies Gil-Fuster, Johannes Jakob Meyer, Jens Eisert și Ryan Sweke. „Margini de generalizare dependente de codificare pentru circuite cuantice parametrizate”. Quantum 5, 582 (2021).

https://doi.org/10.22331/q-2021-11-17-582

[26] Hsin-Yuan Huang, Michael Broughton, Masoud Mohseni, Ryan Babbush, Sergio Boixo, Hartmut Neven și Jarrod R McClean. „Puterea datelor în învățarea automată cuantică”. Nat. comun. 12, 2631 (2021).

https://doi.org/10.1038/s41467-021-22539-9

[27] Matthias C. Caro, Hsin-Yuan Huang, M. Cerezo, Kunal Sharma, Andrew Sornborger, Lukasz Cicio și Patrick J. Coles. „Generalizare în învățarea automată cuantică din puține date de antrenament”. Nat. comun. 13, 4919 (2022).

https://doi.org/10.1038/s41467-022-32550-3

[28] Leonardo Banchi, Jason Pereira și Stefano Pirandola. „Generalizarea în învățarea automată cuantică: un punct de vedere al informațiilor cuantice”. PRX Quantum 2, 040321 (2021).

https: / / doi.org/ 10.1103 / PRXQuantum.2.040321

[29] Francisco Javier Gil Vidal și Dirk Oliver Theis. „Redundanță de intrare pentru circuite cuantice parametrizate”. Față. Fiz. 8, 297 (2020).

https: / / doi.org/ 10.3389 / fphy.2020.00297

[30] Maria Schuld, Ryan Sweke și Johannes Jakob Meyer. „Efectul codificării datelor asupra puterii expresive a modelelor variaționale de învățare cuantică-mașină”. Fiz. Rev. A 103, 032430 (2021).

https: / / doi.org/ 10.1103 / physreva.103.032430

[31] David Wierichs, Josh Izaac, Cody Wang și Cedric Yen-Yu Lin. „Reguli generale de schimbare a parametrilor pentru gradienții cuantici”. Quantum 6, 677 (2022).

https://doi.org/10.22331/q-2022-03-30-677

[32] Kendall și Atkinson. „O introducere în analiza numerică”. John Wiley & Sons. (2008).

[33] Ali Rahimi și Benjamin Recht. „Funcții aleatorii pentru mașinile cu nucleu la scară largă”. În avansuri în sistemele de procesare a informațiilor neuronale. Volumul 20. (2007). url: https:///papers.nips.cc/paper_files/paper/2007/hash/013a006f03dbc5392effeb8f18fda755-Abstract.html.

https://papers.nips.cc/paper_files/paper/2007/hash/013a006f03dbc5392effeb8f18fda755-Abstract.html

[34] Walter Rudin. „Teoremele de bază ale analizei Fourier”. John Wiley & Sons, Ltd. (1990).

https: / / doi.org/ 10.1002 / 9781118165621.ch1

[35] Song Mei și Andrea Montanari. „Eroarea de generalizare a regresiei caracteristicilor aleatoare: asimptotice precise și curba dublă de coborâre”. comun. Pure Appl. Matematică. 75, 667–766 (2022).

https: / / doi.org/ 10.1002 / cpa.22008

[36] Trevor Hastie, Andrea Montanari, Saharon Rosset și Ryan J. Tibshirani. „Surprize în interpolarea celor mai mici pătrate fără crestături”. Ann. Stat. 50, 949 – 986 (2022).

https:///doi.org/10.1214/21-AOS2133

[37] Tengyuan Liang, Alexander Rakhlin și Xiyu Zhai. „Cu privire la coborârea multiplă a interpolanților cu norme minime și a izometriei inferioare restrânse a nucleelor”. În Proceedings of Machine Learning Research. Volumul 125, paginile 1–29. PMLR (2020). url: http:///proceedings.mlr.press/v125/liang20a.html.

http:///proceedings.mlr.press/v125/liang20a.html

[38] Edward Farhi și Hartmut Neven. „Clasificarea cu rețele neuronale cuantice pe procesoare pe termen scurt” (2018). arXiv:1802.06002.

arXiv: 1802.06002

[39] Maria Schuld, Alex Bocharov, Krysta M. Svore și Nathan Wiebe. „Clasificatoare cuantice centrate pe circuit”. Fiz. Rev. A 101, 032308 (2020).

https: / / doi.org/ 10.1103 / physreva.101.032308

[40] Adrián Pérez-Salinas, Alba Cervera-Lierta, Elies Gil-Fuster și José I. Latorre. „Reîncărcarea datelor pentru un clasificator cuantic universal”. Quantum 4, 226 (2020).

https://doi.org/10.22331/q-2020-02-06-226

[41] Sofiene Jerbi, Lukas J Fiderer, Hendrik Poulsen Nautrup, Jonas M Kübler, Hans J Briegel și Vedran Dunjko. „Învățare automată cuantică dincolo de metodele nucleului”. Nat. comun. 14, 517 (2023).

https: / / doi.org/ 10.1038 / s41467-023-36159-y

[42] Casper Gyurik, Dyon Vreumingen, van și Vedran Dunjko. „Minimizarea riscului structural pentru clasificatorii liniari cuantici”. Quantum 7, 893 (2023).

https://doi.org/10.22331/q-2023-01-13-893

[43] Maria Schuld. „Modelele de învățare automată cuantică supravegheate sunt metode nucleu” (2021). arXiv:2101.11020.

arXiv: 2101.11020

[44] S. Shin, YS Teo și H. Jeong. „Codificarea exponențială a datelor pentru învățarea cuantică supravegheată”. Fiz. Rev. A 107, 012422 (2023).

https: / / doi.org/ 10.1103 / PhysRevA.107.012422

[45] Sophie Piccard. „Sur les ensembles de distances des ensembles de points d'un espace euclidien.”. Memorii de la Universitatea din Neuchatel. Secretariatul Universității. (1939).

[46] Dave Wecker, Matthew B. Hastings, Nathan Wiebe, Bryan K. Clark, Chetan Nayak și Matthias Troyer. „Rezolvarea modelelor de electroni puternic corelate pe un computer cuantic”. Fiz. Rev. A 92, 062318 (2015).

https: / / doi.org/ 10.1103 / PhysRevA.92.062318

[47] Ian D. Kivlichan, Jarrod McClean, Nathan Wiebe, Craig Gidney, Alán Aspuru-Guzik, Garnet Kin-Lic Chan și Ryan Babbush. „Simularea cuantică a structurii electronice cu adâncime liniară și conectivitate”. Fiz. Rev. Lett. 120, 110501 (2018).

https: / / doi.org/ 10.1103 / PhysRevLett.120.110501

[48] Martín Larocca, Frédéric Sauvage, Faris M. Sbahi, Guillaume Verdon, Patrick J. Coles și M. Cerezo. „Învățare automată cuantică invariantă în grup”. PRX Quantum 3, 030341 (2022).

https: / / doi.org/ 10.1103 / PRXQuantum.3.030341

[49] Johannes Jakob Meyer, Marian Mularski, Elies Gil-Fuster, Antonio Anna Mele, Francesco Arzani, Alissa Wilms și Jens Eisert. „Exploarea simetriei în învățarea automată cuantică variațională”. PRX Quantum 4, 010328 (2023).

https: / / doi.org/ 10.1103 / PRXQuantum.4.010328

[50] Martin Larocca, Nathan Ju, Diego García-Martín, Patrick J Coles și Marco Cerezo. „Teoria supraparametrizării în rețelele neuronale cuantice”. Nat. Calculator. Sci. 3, 542–551 (2023).

https://doi.org/10.1038/s43588-023-00467-6

[51] Yuxuan Du, Min-Hsiu Hsieh, Tongliang Liu și Dacheng Tao. „Puterea expresivă a circuitelor cuantice parametrizate”. Fiz. Rev. Res. 2, 033125 (2020).

https: / / doi.org/ 10.1103 / physrevresearch.2.033125

[52] Zoë Holmes, Kunal Sharma, M. Cerezo și Patrick J. Coles. „Conectarea expresibilității ansatz la magnitudini de gradient și platouri sterile”. PRX Quantum 3, 010313 (2022).

https: / / doi.org/ 10.1103 / PRXQuantum.3.010313

[53] Samson Wang, Enrico Fontana, Marco Cerezo, Kunal Sharma, Akira Sone, Lukasz Cicio și Patrick J Coles. „Plașuri sterile induse de zgomot în algoritmi cuantici variaționali”. Nat. comun. 12, 6961 (2021).

https://doi.org/10.1038/s41467-021-27045-6

[54] Abdulkadir Canatar, Evan Peters, Cengiz Pehlevan, Stefan M. Wild și Ruslan Shaydulin. „Lățimea de bandă permite generalizarea în modelele de nucleu cuantic”. Tranzacții în cercetarea învățării automate (2023). url: https:///openreview.net/forum?id=A1N2qp4yAq.

https:///openreview.net/forum?id=A1N2qp4yAq

[55] Hsin-Yuan Huang, Michael Broughton, Jordan Cotler, Sitan Chen, Jerry Li, Masoud Mohseni, Hartmut Neven, Ryan Babbush, Richard Kueng, John Preskill și Jarrod R. McClean. „Avantaj cuantic în învățarea din experimente”. Science 376, 1182–1186 (2022).

https:///doi.org/10.1126/science.abn7293

[56] Sitan Chen, Jordan Cotler, Hsin-Yuan Huang și Jerry Li. „Separații exponențiale între învățarea cu și fără memorie cuantică”. În 2021, cel de-al 62-lea simpozion anual IEEE privind fundamentele informaticii (FOCS). Paginile 574–585. (2022).

https: / / doi.org/ 10.1109 / FOCS52979.2021.00063

[57] Hsin-Yuan Huang, Richard Kueng și John Preskill. „Margini teoretice informaționale ale avantajului cuantic în învățarea automată”. Fiz. Rev. Lett. 126, 190505 (2021).

https: / / doi.org/ 10.1103 / PhysRevLett.126.190505

[58] Ville Bergholm, Josh Izaac, Maria Schuld, Christian Gogolin, M. Sohaib Alam, Shahnawaz Ahmed, Juan Miguel Arrazola, Carsten Blank, Alain Delgado, Soran Jahangiri, Keri McKiernan, Johannes Jakob Meyer, Zeyue Niu, Antal Száva și Nathan Killoran. „Pennylane: Diferențierea automată a calculelor hibride cuantice-clasice” (2018). arXiv:1811.04968.

arXiv: 1811.04968

[59] Peter L. Bartlett, Philip M. Long, Gábor Lugosi și Alexander Tsigler. „Suprafitting benign în regresie liniară”. Proc. Natl. Acad. Sci. 117, 30063–30070 (2020).

https: / / doi.org/ 10.1073 / pnas.1907378117

[60] Vladimir Koltchinskii și Karim Lounici. „Inegalități de concentrare și limite de moment pentru operatori de covarianță eșantion”. Bernoulli 23, 110 – 133 (2017).

https:///doi.org/10.3150/15-BEJ730

[61] Zbigniew Puchała și Jarosław Adam Miszczak. „Integrarea simbolică în raport cu măsura haar asupra grupului unitar”. Taur. Pol. Acad. Sci. 65, 21–27 (2017).

https:///doi.org/10.1515/bpasts-2017-0003

[62] Daniel A. Roberts și Beni Yoshida. „Haos și complexitate prin design”. J. Fizica de înaltă energie. 2017, 121 (2017).

https:///doi.org/10.1007/jhep04(2017)121

[63] Wallace C. Babcock. „Interferența de intermodulație în sistemele radio frecvența de apariție și controlul prin selecția canalului”. Bell Syst. tehnologie. j. 32, 63–73 (1953).

https: / / doi.org/ 10.1002 / j.1538-7305.1953.tb01422.x

[64] M. Atkinson, N. Santoro și J. Urrutia. „Seturi întregi cu sume și diferențe distincte și atribuiri de frecvență purtătoare pentru repetoare neliniare”. IEEE Trans. comun. 34, 614–617 (1986).

https:///doi.org/10.1109/TCOM.1986.1096587

[65] J. Robinson şi A. Bernstein. „O clasă de coduri binare recurente cu propagare limitată a erorilor”. IEEE Trans. Inf. 13, 106–113 (1967).

https: / / doi.org/ 10.1109 / TIT.1967.1053951

[66] RJF Fang și WA Sandrin. „Alocarea frecvenței purtătoare pentru repetoare neliniare”. COMSAT Technical Review 7, 227–245 (1977).

Citat de

[1] Alexey Melnikov, Mohammad Kordzanganeh, Alexander Alodjants și Ray-Kuang Lee, „Învățare automată cuantică: de la fizică la inginerie software”, Progrese în fizică X 8 1, 2165452 (2023).

[2] Mo Kordzanganeh, Pavel Sekatski, Leonid Fedichkin și Alexey Melnikov, „O familie de circuite cuantice universale în creștere exponențială”, Învățare automată: știință și tehnologie 4 3, 035036 (2023).

[3] Stefano Mangini, „Algoritmi cuantici variaționali pentru învățarea automată: teorie și aplicații”, arXiv: 2306.09984, (2023).

[4] Ben Jaderberg, Antonio A. Gentile, Youssef Achari Berrada, Elvira Shishenina și Vincent E. Elfving, „Let Quantum Neural Networks Choose Their Own Frequencies”, arXiv: 2309.03279, (2023).

[5] Yuxuan Du, Yibo Yang, Dacheng Tao și Min-Hsiu Hsieh, „Puterea dependentă de probleme a rețelelor neuronale cuantice privind clasificarea multiclasă”, Scrisori de revizuire fizică 131 14, 140601 (2023).

[6] S. Shin, YS Teo și H. Jeong, „Codificarea exponențială a datelor pentru învățarea supravegheată cuantică”, Revista fizică A 107 1, 012422 (2023).

[7] Elies Gil-Fuster, Jens Eisert și Carlos Bravo-Prieto, „Înțelegerea învățării automate cuantice necesită și regândirea generalizării”, arXiv: 2306.13461, (2023).

[8] Jason Iaconis și Sonika Johri, „Tensor Network Based Efficient Quantum Data Loading of Images”, arXiv: 2310.05897, (2023).

[9] Alice Barthe și Adrián Pérez-Salinas, „Gradienți și profiluri de frecvență ale modelelor de reîncărcare cuantică”, arXiv: 2311.10822, (2023).

[10] Tobias Haug și MS Kim, „Generalization with quantum geometry for learning unitaries”, arXiv: 2303.13462, (2023).

[11] Jonas Landman, Slimane Thabet, Constantin Dalyac, Hela Mhiri și Elham Kashefi, „Classically Approximating Variational Quantum Machine Learning with Random Fourier Features”, arXiv: 2210.13200, (2022).

[12] Berta Casas și Alba Cervera-Lierta, „Serii Fourier multidimensionale cu circuite cuantice”, Revista fizică A 107 6, 062612 (2023).

[13] Elies Gil-Fuster, Jens Eisert și Vedran Dunjko, „On the expressivity of embedding quantum kernels”, arXiv: 2309.14419, (2023).

[14] Lucas Slattery, Ruslan Shaydulin, Shouvanik Chakrabarti, Marco Pistoia, Sami Khairy și Stefan M. Wild, „Numerical evidence against advantage with quantum fidelity kernels on classical data”, Revista fizică A 107 6, 062417 (2023).

[15] Mo Kordzanganeh, Daria Kosichkina și Alexey Melnikov, „Rețele hibride paralele: o interacțiune între rețelele neuronale cuantice și clasice”, arXiv: 2303.03227, (2023).

[16] Aikaterini, Gratsea și Patrick Huembeli, „Efectul operatorilor de procesare și măsurare asupra puterii expresive a modelelor cuantice”, arXiv: 2211.03101, (2022).

[17] Shun Okumura și Masayuki Ohzeki, „Coeficientul Fourier al circuitelor cuantice parametrizate și problema platoului steril”, arXiv: 2309.06740, (2023).

[18] Massimiliano Incudini, Michele Grossi, Antonio Mandarino, Sofia Vallecorsa, Alessandra Di Pierro și David Windridge, „The Quantum Path Kernel: a Generalized Quantum Neural Tangent Kernel for Deep Quantum Machine Learning”, arXiv: 2212.11826, (2022).

[19] Jorja J. Kirk, Matthew D. Jackson, Daniel JM King, Philip Intallura și Mekena Metcalf, „Emergent Order in Classical Data Representations on Ising Spin Models”, arXiv: 2303.01461, (2023).

[20] Francesco Scala, Andrea Ceschini, Massimo Panella și Dario Gerace, „A General Approach to Dropout in Quantum Neural Networks”, arXiv: 2310.04120, (2023).

[21] Julian Berberich, Daniel Fink, Daniel Pranjić, Christian Tutschku și Christian Holm, „Training robust and generalizable quantum models”, arXiv: 2311.11871, (2023).

Citatele de mai sus sunt din ADS SAO / NASA (ultima actualizare cu succes 2023-12-21 00:40:54). Lista poate fi incompletă, deoarece nu toți editorii furnizează date de citare adecvate și complete.

On Serviciul citat de Crossref nu s-au găsit date despre citarea lucrărilor (ultima încercare 2023-12-21 00:40:53).

Acest Lucru este publicat în Quantum sub Creative Commons Atribuire 4.0 internațională (CC BY 4.0) licență. Drepturile de autor rămân la deținătorii de drepturi de autor originale, precum autorii sau instituțiile lor.

- Distribuție de conținut bazat pe SEO și PR. Amplifică-te astăzi.

- PlatoData.Network Vertical Generative Ai. Împuterniciți-vă. Accesați Aici.

- PlatoAiStream. Web3 Intelligence. Cunoștințe amplificate. Accesați Aici.

- PlatoESG. carbon, CleanTech, Energie, Mediu inconjurator, Solar, Managementul deșeurilor. Accesați Aici.

- PlatoHealth. Biotehnologie și Inteligență pentru studii clinice. Accesați Aici.

- Sursa: https://quantum-journal.org/papers/q-2023-12-20-1210/

- :are

- :este

- :nu

- 1

- 10

- 107

- 11

- 110

- 116

- 12

- 120

- 121

- 125

- 13

- 14

- 15%

- 16

- 17

- 1791

- 19

- 20

- 2008

- 2015

- 2017

- 2018

- 2019

- 2020

- 2021

- 2022

- 2023

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

- 31

- 32

- 33

- 35%

- 36

- 39

- 40

- 41

- 43

- 46

- 49

- 50

- 51

- 52

- 53

- 54

- 58

- 60

- 65

- 66

- 7

- 75

- 8

- 9

- 98

- a

- Abbas

- capacitate

- mai sus

- REZUMAT

- acces

- Conform

- precizie

- Adam

- avans

- Avantaj

- contradictorialității

- afilieri

- împotriva

- Ahmed

- alex

- Alexander

- algoritmi

- alice

- TOATE

- de asemenea

- an

- analiză

- analitic

- și

- Andrew

- Anna

- anual

- aplicatii

- abordare

- SUNT

- domenii

- AS

- încercare

- autor

- Autorii

- Automat

- b

- sterp

- bazat

- de bază

- BE

- fost

- comportament

- în spatele

- Clopot

- ben

- Benjamin

- Mai bine

- între

- Dincolo de

- necompletat

- limite

- Pauză

- Bryan

- taur

- by

- capacitate

- Capacitate

- Carlos

- casper

- chan

- Canal

- chen

- Alege

- mâncare

- creştin

- citând

- clasă

- clasificare

- Coduri

- comentariu

- Commons

- Completă

- complex

- complexitate

- calcule

- calculator

- Informatică

- tehnica de calcul

- beton

- Conferință

- Suport conectare

- context

- Control

- drepturi de autor

- corelat

- Craig

- curba

- Daniel

- de date

- data mining

- Dave

- David

- dec

- adânc

- învățare profundă

- rețele neuronale profunde

- Ea

- Dependent/ă

- adâncime

- deriva

- Amenajări

- În ciuda

- determinare

- Diego

- diferenţele

- discuta

- distinct

- do

- face

- dubla

- e

- Edward

- efect

- eficient

- Electronic

- element

- Încorporarea

- permite

- codare

- energie

- Inginerie

- erika

- eroare

- Eter (ETH)

- dovadă

- exemplu

- Exponatele

- experimente

- Explica

- exponențială

- expresiv

- familie

- adio

- frică

- Caracteristică

- DESCRIERE

- puțini

- fidelitate

- Pentru

- găsit

- Fundații

- Francisco

- Frecvență

- din

- faţă

- funcţie

- General

- generativ

- rețele adversare generative

- geometrie

- scop

- gradienți

- grup

- Piese metalice

- harvard

- Înalt

- Titularii

- Cum

- HTML

- http

- HTTPS

- huang

- Hibrid

- hibrid cuantic-clasic

- i

- IEEE

- imagini

- îmbunătăţi

- in

- inegalitățile

- informații

- Institut

- instituții

- integrare

- interesant

- ingerinţă

- Internațional

- Introducere

- Jackson

- JavaScript

- Jerome

- Ioan

- Johnson

- Iordania

- jurnal

- Ioan

- karim

- Kendall

- Kim

- Rege

- biserică

- pe scară largă

- lasere

- Nume

- AFLAȚI

- învăţare

- cel mai puțin

- Părăsi

- Sub vânt

- lăsa

- li

- Licență

- Limitat

- Lin

- legarea

- Listă

- încărcare

- la nivel local

- Logan

- Lung

- de pe

- LOWER

- Ltd

- maşină

- masina de învățare

- Masini

- marca

- Mary

- Martin

- matematica

- matematic

- materie

- Matthew

- Matthias

- Mai..

- mcclean

- măsura

- măsurare

- mecanisme

- Memorie

- metcalf

- Metode

- Meyer

- Michael

- ar putea

- Mihai

- minimizarea

- Minerit

- model

- Modele

- Modern

- moment

- Lună

- multiplu

- Natură

- În apropiere

- reţea

- rețele

- neural

- rețele neuronale

- rețele neuronale

- Nu.

- apariţie

- of

- de multe ori

- Oliver

- on

- Ontario

- deschide

- Operațiuni

- Operatorii

- or

- comandă

- original

- al nostru

- Prezentare generală

- propriu

- pagini

- Hârtie

- Paralel

- cale

- patrick

- Peter

- fenomen

- Fizică

- Plato

- Informații despre date Platon

- PlatoData

- puncte

- putere

- practică

- precis

- prezicere

- pregătire

- presa

- Problemă

- PROC

- Proceedings

- prelucrare

- procesoare

- Profiluri

- propagare

- furniza

- publicat

- editor

- editori

- Cuantic

- avantaj cuantic

- algoritmi cuantici

- Computer cuantic

- cuantic calcul

- informație cuantică

- învățarea cuantică a mașinilor

- R

- radio

- aleator

- recurent

- referințe

- regimuri

- regres

- relație

- relaţie

- rămășițe

- remarcabil

- Necesită

- cercetare

- respect

- limitat

- Dezvăluit

- revizuiască

- Richard

- Risc

- ROBERT

- robust

- norme

- Ryan

- s

- Scala

- SCI

- Ştiinţă

- Ştiinţă şi Tehnologie

- selectate

- selecţie

- serie

- Seturi

- superficial

- Sharma

- Arăta

- semnalele

- DA

- asemănător

- simulare

- simultan

- Software

- Inginerie software

- cântec

- spații

- Rotire

- pătrate

- punct de vedere

- Stat

- statistic

- stefan

- tare

- structura

- studiat

- succes

- Reușit

- astfel de

- potrivit

- sume

- învățare supravegheată

- surpriză

- Simpozion

- sisteme

- tech

- Tehnic

- Tehnologia

- durată

- lor

- teoretic

- teorie

- astfel

- Acestea

- acest

- Prin

- Titlu

- la

- Toronto

- Pregătire

- trans

- Tranzacții

- Trevor

- Tyler

- UN

- în

- înţelegere

- Universal

- universitate

- actualizat

- URL-ul

- varietate

- foarte

- vincent

- volum

- vs

- W

- Wang

- vrea

- a fost

- we

- BINE

- în timp ce

- pe scară largă

- Sălbatic

- cu

- fără

- Apartamente

- fabrică

- Wright

- X

- an

- zephyrnet