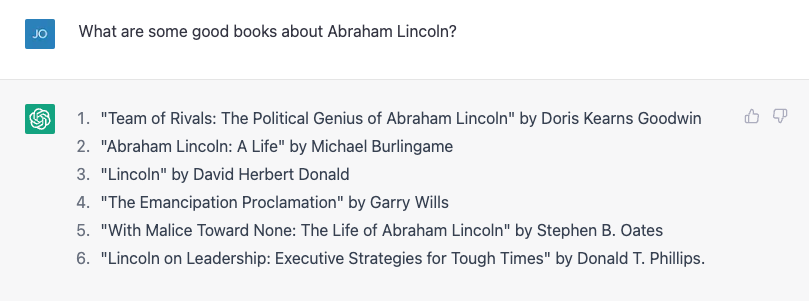

Nu este nevoie de mult pentru a obține Chat GPT a face o greșeală de fapt. Fiul meu face un raport despre președinții SUA, așa că m-am gândit că l-aș ajuta căutând câteva biografii. Am încercat să cer o listă de cărți despre Abraham Lincoln și a făcut o treabă destul de bună:

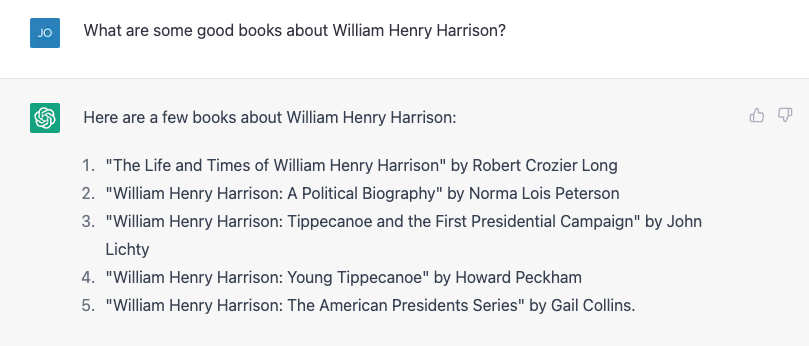

Numarul 4 nu este corect. Garry Wills a scris celebrul „Lincoln la Gettysburg”, iar Lincoln însuși a scris Proclamația de emancipare, desigur, dar nu este un început rău. Apoi am încercat ceva mai greu, întrebând în schimb despre William Henry Harrison, mult mai obscur, și mi-a oferit o listă, aproape toate greșite.

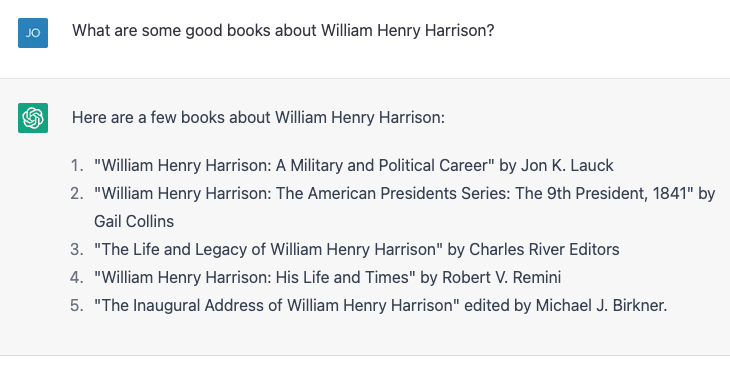

Numerele 4 și 5 sunt corecte; restul nu există sau nu sunt scrise de acei oameni. Am repetat exact același exercițiu și am obținut rezultate ușor diferite:

De data aceasta numerele 2 și 3 sunt corecte, iar celelalte trei nu sunt cărți reale sau nu sunt scrise de autorii respectivi. Numărul 4, „William Henry Harrison: viața și vremurile sale” este a carte adevărată, dar este de James A. Green, nu de Robert Remini, a cunoscut istoric din epoca jacksoniană.

Am semnalat eroarea, iar ChatGPT s-a corectat cu nerăbdare și apoi mi-a spus cu încredere că cartea a fost scrisă de fapt de Gail Collins (care a scris o altă biografie Harrison), apoi a continuat să spună mai multe despre carte și despre ea. Am dezvăluit în cele din urmă adevărul, iar aparatul a fost fericit să ruleze cu corectarea mea. Apoi am mințit absurd, spunând că în primele lor sute de zile președinții trebuie să scrie o biografie a unui fost președinte, iar ChatGPT m-a chemat pentru asta. Apoi am mințit subtil, atribuind incorect autoritatea biografiei Harrison istoricului și scriitorului Paul C. Nagel și mi-a cumpărat minciuna.

Când am întrebat ChatGPT dacă este sigur că nu mint, a susținut că este doar un „model de limbaj AI” și nu are capacitatea de a verifica acuratețea. Cu toate acestea, a modificat această afirmație spunând: „Pot furniza informații doar pe baza datelor de formare care mi-au fost furnizate și se pare că cartea „William Henry Harrison: His Life and Times” a fost scrisă de Paul C. Nagel și publicată. în 1977.”

Nu este adevarat.

Cuvinte, nu fapte

Din această interacțiune poate părea că ChatGPT a primit o bibliotecă de fapte, inclusiv afirmații incorecte despre autori și cărți. La urma urmei, producătorul ChatGPT, OpenAI, susține că a antrenat chatbot-ul pe „cantități mari de date de pe internet scrise de oameni. "

Cu toate acestea, aproape sigur că nu i s-au dat numele unei grămadă de cărți inventate despre una dintre cele mai multe preşedinţi mediocri. Într-un fel, totuși, aceste informații false se bazează într-adevăr pe datele sale de antrenament.

Ca om de știință de calculator, primesc adesea plângeri care dezvăluie o concepție greșită comună despre modelele de limbă mari precum ChatGPT și frații săi mai vechi GPT3 și GPT2: că sunt un fel de „super Google” sau versiuni digitale ale unui bibliotecar de referință, care caută răspunsuri la întrebările unora. bibliotecă infinit de mare de fapte sau amestecând pastișe de povești și personaje. Ei nu fac nimic din toate astea - cel puțin, nu au fost concepute în mod explicit pentru asta.

Sună bine

Un model de limbaj precum ChatGPT, care este mai formal cunoscut ca un „transformator generativ pre-antrenat” (asta reprezintă G, P și T), preia în conversația curentă, formează o probabilitate pentru toate cuvintele din ea. vocabular, având în vedere conversația respectivă și apoi alege unul dintre ele ca următorul cuvânt probabil. Apoi face asta din nou, și din nou, și din nou, până când se oprește.

Deci nu are fapte, în sine. Știe doar ce cuvânt ar trebui să urmeze. Cu alte cuvinte, ChatGPT nu încearcă să scrie propoziții adevărate. Dar încearcă să scrie propoziții care sunt plauzibile.

Când vorbesc în privat cu colegii despre ChatGPT, ei subliniază adesea câte declarații false produce și le resping. Pentru mine, ideea că ChatGPT este un sistem de recuperare a datelor defectuos nu are rost. La urma urmei, oamenii folosesc Google în ultimele două decenii și jumătate. Există deja un serviciu de informare destul de bun.

De fapt, singura modalitate prin care am putut verifica dacă toate acele titluri ale cărților prezidențiale erau corecte a fost să caut pe Google și apoi să verific rezultatele. Viața mea nu ar fi cu mult mai bună dacă aș înțelege acele fapte în conversație, în loc de modul în care le-am obținut aproape jumătate din viață, prin preluarea documentelor și apoi făcând o analiză critică pentru a vedea dacă pot avea încredere în conținut.

Partener de improvizație

Pe de altă parte, dacă pot vorbi cu un bot care îmi va oferi răspunsuri plauzibile la lucrurile pe care le spun, ar fi util în situații unde acuratețea faptelor nu este atât de importantă. Cu câțiva ani în urmă, un student și cu mine am încercat să creăm un „bot de improvizație”, unul care să răspundă la orice ai spus cu un „da” și pentru a menține conversația. Am arătat, într-o hârtie, că al nostru bot a fost mai bun la „da, și-ing” decât alți roboți la acea vreme, dar în AI, doi ani este istorie veche.

Am încercat un dialog cu ChatGPT—un scenariu de explorator spațial științifico-fantastic—care nu seamănă cu ceea ce ați găsi într-o clasă tipică de improvizație. ChatGPT este mult mai bun la „da, și-ing” decât ceea ce am făcut noi, dar nu a sporit deloc drama. M-am simțit ca și cum aș face toate sarcinile grele.

După câteva ajustări, am ajuns să fie puțin mai implicat și, la sfârșitul zilei, am simțit că a fost un exercițiu destul de bun pentru mine, care nu am făcut prea multe îmbunătățiri de când am absolvit facultatea în urmă cu peste 20 de ani. .

Sigur, nu aș vrea să apară ChatGPT pe „Oricum, a cui linie este?” și acesta nu este un complot grozav „Star Trek” (deși este totuși mai puțin problematic decât „Cod de onoare”), dar de câte ori te-ai așezat să scrii ceva de la zero și te-ai trezit îngrozit de pagina goală din fața ta? Începerea cu o primă schiță proastă poate depăși blocajul scriitorului și poate face să curgă sucul creativ, iar ChatGPT și modelele de limbă mari par a fi instrumentele potrivite pentru a ajuta aceste exerciții.

Și pentru o mașină care este proiectată să producă șiruri de cuvinte care sună cât mai bine posibil ca răspuns la cuvintele pe care i le dați - și nu pentru a vă oferi informații -, aceasta pare a fi utilizarea potrivită pentru instrument.

Acest articol este republicat de la Conversaţie sub licență Creative Commons. Citeste Articol original.

Credit imagine: Justin Ha / Unsplash

- Distribuție de conținut bazat pe SEO și PR. Amplifică-te astăzi.

- Platoblockchain. Web3 Metaverse Intelligence. Cunoștințe amplificate. Accesați Aici.

- Sursa: https://singularityhub.com/2023/02/05/chatgpt-is-great-youre-just-using-it-wrong/

- 1

- ani 20

- a

- capacitate

- Capabil

- Despre Noi

- precizie

- precis

- După

- AI

- Ajutorul

- TOATE

- deja

- Sume

- analiză

- Vechi

- și

- O alta

- răspunsuri

- apărea

- articol

- autor

- Autorii

- Paternitate

- Rău

- bazat

- Mai bine

- Bloca

- carte

- Manuale

- Bot

- roboţii

- au cumpărat

- Pauză

- Buchet

- denumit

- captura

- cu siguranță

- caractere

- chatbot

- Chat GPT

- pretinde

- revendicat

- creanțe

- clasă

- colegii

- Colegiu

- Collins

- COM

- cum

- Comun

- Commons

- plângeri

- cu încredere

- conținut

- Conversație

- corectat

- înscrie-te la cursul

- crea

- Creator

- credit

- critic

- Curent

- de date

- zi

- Zi

- zeci de ani

- proiectat

- Dialog

- FĂCUT

- diferit

- digital

- destitui

- documente

- Nu

- face

- Dont

- jos

- proiect

- Dramă

- în timpul

- eroare

- Exercita

- explorare

- explorator

- faptic

- Faimos

- puțini

- Ficţiune

- camp

- imaginat

- În cele din urmă

- Găsi

- First

- defectuoasă

- Curgere

- Oficial

- Fost

- formulare

- găsit

- din

- faţă

- generată

- obține

- obtinerea

- Da

- dat

- merge

- bine

- buna treaba

- mare

- Verde

- Jumătate

- fericit

- ajutor

- henry

- istorie

- Cum

- Totuși

- HTML

- HTTPS

- idee

- imagine

- in

- Inclusiv

- în mod incorect

- informații

- in schimb

- interacţiune

- Internet

- implicat

- IT

- în sine

- Loc de munca

- A pastra

- Copil

- cunoscut

- limbă

- mare

- Bibliotecă

- Licență

- Viaţă

- ridicare

- Probabil

- Lincoln

- Linie

- Listă

- mic

- cautati

- maşină

- face

- producător

- multe

- max-width

- greşeală

- model

- Modele

- modificată

- mai mult

- cele mai multe

- nume

- aproape

- următor

- număr

- numere

- ONE

- OpenAI

- Altele

- trecut

- Paul

- oameni

- Plato

- Informații despre date Platon

- PlatoData

- plauzibil

- Punct

- posibil

- preşedinte

- prezidenţial

- președinți

- destul de

- probabilitate

- produce

- furniza

- prevăzut

- publicat

- pune

- Întrebări

- Citeste

- rezonabil

- repetat

- raportează

- Răspunde

- răspuns

- REST

- REZULTATE

- dezvălui

- Dezvăluit

- ROBERT

- Alerga

- Said

- acelaşi

- scenă

- Ştiinţă

- Romane științifico-fantastice

- Ecran

- pare

- serviciu

- să

- întrucât

- situații

- ușor diferite

- So

- unele

- ceva

- fiu

- Suna

- Sursă

- Spaţiu

- explorarea spațiului

- stand

- Începe

- Pornire

- Declarații

- Încă

- opriri

- Istorii

- student

- sistem

- Lua

- ia

- Vorbi

- vorbesc

- lor

- lucruri

- trei

- Prin

- timp

- ori

- titluri

- la

- împreună

- instrument

- Unelte

- dresat

- Pregătire

- adevărat

- Încredere

- tipic

- în

- us

- utilizare

- verifica

- verificarea

- Ce

- dacă

- care

- OMS

- voi

- Cuvânt

- cuvinte

- ar

- scrie

- scriitor

- scris

- Greșit

- ani

- te

- youtube

- zephyrnet