Trăim în era datelor și perspectivelor în timp real, conduse de aplicații de streaming de date cu latență redusă. Astăzi, toată lumea se așteaptă la o experiență personalizată în orice aplicație, iar organizațiile inovează constant pentru a-și crește viteza de operare și de luare a deciziilor. Volumul de date sensibile la timp produse crește rapid, diferite formate de date fiind introduse în noile afaceri și cazuri de utilizare ale clienților. Prin urmare, este esențial pentru organizații să adopte o infrastructură de flux de date cu latență scăzută, scalabilă și fiabilă pentru a oferi aplicații de afaceri în timp real și experiențe mai bune pentru clienți.

Aceasta este prima postare a unei serii de bloguri care oferă modele arhitecturale comune în construirea de infrastructuri de streaming de date în timp real folosind Kinesis Data Streams pentru o gamă largă de cazuri de utilizare. Acesta își propune să ofere un cadru pentru a crea aplicații de streaming cu latență scăzută pe AWS Cloud folosind Fluxuri de date Amazon Kinesis și Servicii de analiză a datelor AWS create special.

În această postare, vom analiza modelele arhitecturale comune a două cazuri de utilizare: Analiza datelor în serie de timp și Microservicii bazate pe evenimente. În postarea ulterioară din seria noastră, vom explora modelele arhitecturale în construirea conductelor de streaming pentru tablouri de bord BI în timp real, agent centru de contact, date registru, recomandare personalizată în timp real, analiză de jurnal, date IoT, Captură de date și real. -date de marketing în timp. Toate aceste modele de arhitectură sunt integrate cu Amazon Kinesis Data Streams.

Streaming în timp real cu Kinesis Data Streams

Amazon Kinesis Data Streams este un serviciu de streaming de date nativ din cloud, fără server, care facilitează capturarea, procesarea și stocarea datelor în timp real la orice scară. Cu Kinesis Data Streams, puteți colecta și procesa sute de gigaocteți de date pe secundă din sute de mii de surse, permițându-vă să scrieți cu ușurință aplicații care procesează informații în timp real. Datele colectate sunt disponibile în milisecunde pentru a permite cazuri de utilizare a analizelor în timp real, cum ar fi tablouri de bord în timp real, detectarea anomaliilor în timp real și stabilirea prețurilor dinamice. În mod implicit, datele din Kinesis Data Stream sunt stocate timp de 24 de ore, cu opțiunea de a crește păstrarea datelor la 365 de zile. Dacă clienții doresc să proceseze aceleași date în timp real cu mai multe aplicații, atunci pot folosi caracteristica Enhanced Fan-Out (EFO). Înainte de această caracteristică, fiecare aplicație care consuma date din flux a partajat ieșirea de 2 MB/secundă/shard. Prin configurarea consumatorilor de flux pentru a utiliza fan-out îmbunătățit, fiecare consumator de date primește o conductă dedicată de 2 MB/secundă de debit de citire per shard pentru a reduce și mai mult latența în preluarea datelor.

Pentru disponibilitate și durabilitate ridicate, Kinesis Data Streams obține o durabilitate ridicată prin replicarea sincronă a datelor transmise în flux în trei zone de disponibilitate dintr-o regiune AWS și vă oferă opțiunea de a păstra datele până la 365 de zile. Pentru securitate, Kinesis Data Streams oferă criptare pe server, astfel încât să puteți îndeplini cerințe stricte de gestionare a datelor prin criptarea datelor dvs. în repaus și a punctelor finale ale interfeței Amazon Virtual Private Cloud (VPC) pentru a menține privat traficul dintre Amazon VPC și Kinesis Data Streams.

Kinesis Data Streams are integrări native cu alte servicii AWS, cum ar fi AWS Adeziv și Amazon EventBridge pentru a construi aplicații de streaming în timp real pe AWS. Consultați integrările Amazon Kinesis Data Streams pentru detalii suplimentare.

Arhitectură modernă de streaming de date cu Kinesis Data Streams

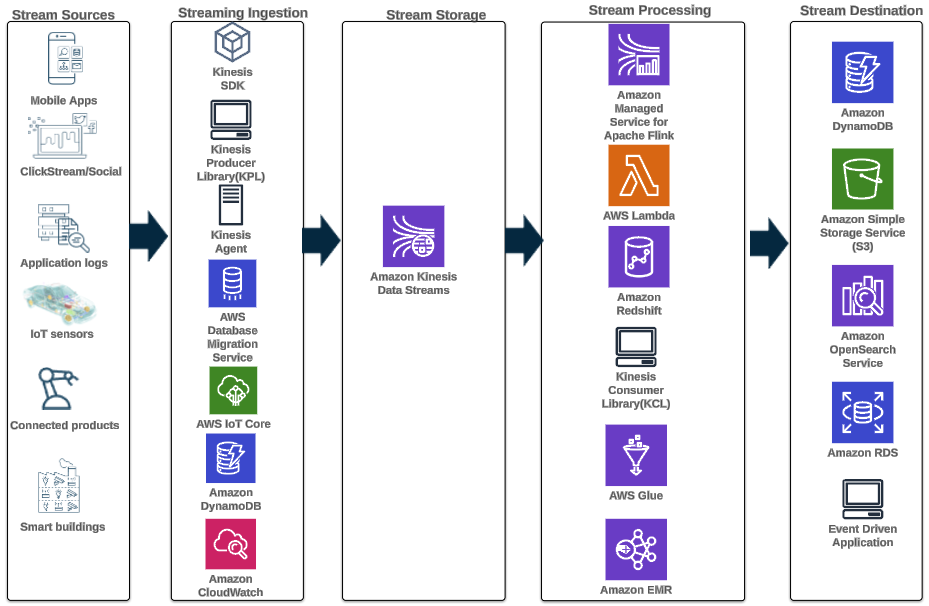

O arhitectură modernă de date în flux cu Kinesis Data Streams poate fi proiectată ca o stivă de cinci straturi logice; fiecare strat este compus din mai multe componente construite special care răspund cerințelor specifice, așa cum este ilustrat în următoarea diagramă:

Arhitectura constă din următoarele componente cheie:

- Surse de streaming - Sursa dvs. de date în flux include surse de date cum ar fi datele din fluxul de clic, senzorii, rețelele sociale, dispozitivele Internet of Things (IoT), fișierele jurnal generate prin utilizarea aplicațiilor dvs. web și mobile și dispozitive mobile care generează date semi-structurate și nestructurate ca fluxuri continue. la viteză mare.

- Ingestie de flux - Stratul de asimilare a fluxului este responsabil pentru ingerarea datelor în stratul de stocare a fluxului. Oferă capacitatea de a colecta date din zeci de mii de surse de date și de a le ingera în timp real. Puteți folosi Kinesis SDK pentru ingerarea datelor în flux prin intermediul API-urilor, the Biblioteca Producătorului Kinesis pentru construirea de producători de streaming de înaltă performanță și de lungă durată sau a Agent kinesis pentru colectarea unui set de fișiere și ingerarea lor în Kinesis Data Streams. În plus, puteți utiliza multe integrări pre-build, cum ar fi Serviciul de migrare a bazelor de date AWS (AWS DMS), Amazon DynamoDB, și AWS IoT Core pentru a ingera date într-un mod fără cod. De asemenea, puteți asimila date de pe platforme terțe, cum ar fi Apache Spark și Apache Kafka Connect

- Stocare în flux - Kinesis Data Streams oferă două moduri pentru a suporta transferul de date: La cerere și Aprovizionat. Modul la cerere, acum alegerea implicită, se poate scala elastic pentru a absorbi debite variabile, astfel încât clienții să nu fie nevoiți să-și facă griji cu privire la gestionarea capacității și să plătească în funcție de debitul de date. Modul On-Demand mărește automat de două ori capacitatea fluxului peste aportul maxim istoric de date pentru a oferi o capacitate suficientă pentru vârfuri neașteptate în absorbția de date. Alternativ, clienții care doresc un control granular asupra resurselor fluxului pot folosi modul Provisioned și pot crește și reduce în mod proactiv numărul de fragmente pentru a îndeplini cerințele lor de debit. În plus, Kinesis Data Streams poate stoca date de streaming până la 2 de ore în mod implicit, dar se poate extinde până la 24 zile sau 7 de zile, în funcție de cazurile de utilizare. Mai multe aplicații pot consuma același flux.

- Procesarea fluxului - Stratul de procesare a fluxului este responsabil pentru transformarea datelor într-o stare consumabilă prin validarea datelor, curățare, normalizare, transformare și îmbogățire. Înregistrările de streaming sunt citite în ordinea în care sunt produse, permițând analize în timp real, construirea de aplicații bazate pe evenimente sau ETL în flux (extragere, transformare și încărcare). Poți să folosești Serviciul gestionat Amazon pentru Apache Flink pentru procesarea fluxului de date complex, AWS Lambdas pentru procesarea datelor de flux fără stat și AWS Adeziv & Amazon EMR pentru calcul aproape în timp real. De asemenea, puteți crea aplicații personalizate pentru consumatori cu Biblioteca Kinesis Consumer, care se va ocupa de multe sarcini complexe asociate cu calculul distribuit.

- Destinație - Stratul de destinație este ca o destinație special creată în funcție de cazul dvs. de utilizare. Puteți transmite date direct către Amazon RedShift pentru depozitarea datelor și Amazon EventBridge pentru crearea de aplicații bazate pe evenimente. De asemenea, puteți utiliza Firehose Amazon Kinesis Data pentru integrarea în flux, în care puteți ilumina procesarea fluxului cu AWS Lambda și apoi puteți livra fluxuri procesate în destinații precum Amazon S3 lac de date, serviciu OpenSearch pentru analiză operațională, un depozit de date Redshift, baze de date No-SQL precum Amazon DynamoDB și baze de date relaționale precum Amazon RDS pentru a consuma fluxuri în timp real în aplicațiile de afaceri. Destinația poate fi o aplicație bazată pe evenimente pentru tablouri de bord în timp real, decizii automate bazate pe date procesate în flux, modificări în timp real și multe altele.

Arhitectură de analiză în timp real pentru serii de timp

Datele din seria temporală sunt o secvență de puncte de date înregistrate pe un interval de timp pentru măsurarea evenimentelor care se modifică în timp. Exemple sunt prețurile acțiunilor în timp, fluxurile de clic pe paginile web și jurnalele dispozitivului de-a lungul timpului. Clienții pot folosi datele din seria temporală pentru a monitoriza schimbările în timp, astfel încât să poată detecta anomalii, să identifice modele și să analizeze modul în care anumite variabile sunt influențate în timp. Datele din seria temporală sunt de obicei generate din mai multe surse în volume mari și trebuie colectate în mod eficient din punct de vedere al costurilor, aproape în timp real.

De obicei, există trei obiective principale pe care clienții doresc să le atingă în procesarea datelor din serii de timp:

- Obțineți informații în timp real asupra performanței sistemului și detectați anomaliile

- Înțelegeți comportamentul utilizatorului final pentru a urmări tendințele și a interoga/a crea vizualizări din aceste informații

- Aveți o soluție de stocare durabilă pentru a ingera și stoca atât datele de arhivă, cât și cele accesate frecvent.

Cu Kinesis Data Streams, clienții pot captura continuu terabytes de date din seria temporală din mii de surse pentru curățare, îmbogățire, stocare, analiză și vizualizare.

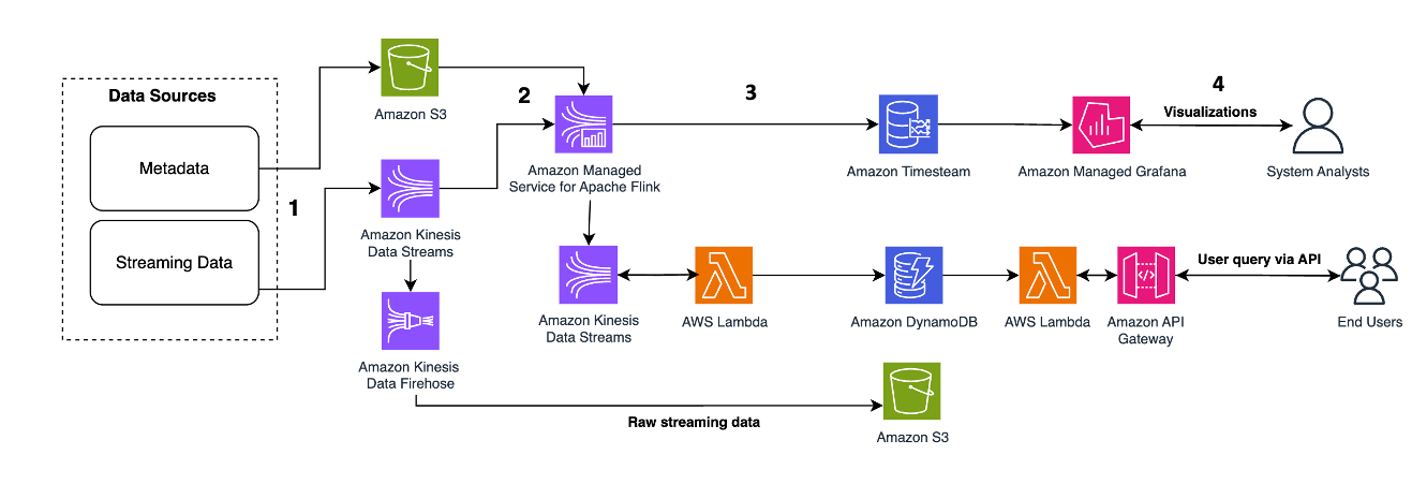

Următorul model de arhitectură ilustrează modul în care analiza în timp real poate fi realizată pentru datele Time Series cu Kinesis Data Streams:

Pașii fluxului de lucru sunt următorii:

- Ingestie și stocare de date - Kinesis Data Streams poate captura și stoca continuu terabytes de date din mii de surse.

- Procesarea fluxului - O aplicație creată cu Serviciul gestionat Amazon pentru Apache Flink poate citi înregistrările din fluxul de date pentru a detecta și curăța orice erori în datele din seria temporală și pentru a îmbogăți datele cu metadate specifice pentru a optimiza analiza operațională. Utilizarea unui flux de date la mijloc oferă avantajul utilizării datelor din seria temporală în alte procese și soluții în același timp. O funcție Lambda este apoi invocată cu aceste evenimente și poate efectua calcule de serie de timp în memorie.

- destinații – După curățare și îmbogățire, datele procesate din seria temporală pot fi transmise în flux Amazon Timestream baza de date pentru tablouri de bord și analiză în timp real sau stocată în baze de date precum DynamoDB pentru interogarea utilizatorului final. Datele brute pot fi transmise în flux către Amazon S3 pentru arhivare.

- Vizualizare și obțineți informații – Clienții pot interoga, vizualiza și crea alerte folosind Serviciul gestionat Amazon pentru Grafana. Grafana acceptă surse de date care sunt backend-uri de stocare pentru date din seria temporală. Pentru a vă accesa datele din Timestream, trebuie să instalați pluginul Timestream pentru Grafana. Utilizatorii finali pot interoga datele din tabelul DynamoDB cu Gateway API Amazon acționând ca un proxy.

A se referi la Procesare aproape în timp real cu Amazon Kinesis, Amazon Timestream și Grafana prezentând o conductă de streaming fără server pentru a procesa și stoca datele IoT de telemetrie ale dispozitivului într-un magazin de date optimizat în serie de timp, cum ar fi Amazon Timestream.

Îmbogățirea și reluarea datelor în timp real pentru microservicii de aprovizionare cu evenimente

Microserviciile reprezintă o abordare arhitecturală și organizațională a dezvoltării software în care software-ul este compus din mici servicii independente care comunică prin API-uri bine definite. Atunci când construiesc microservicii bazate pe evenimente, clienții doresc să obțină 1. scalabilitate ridicată pentru a gestiona volumul de evenimente primite și 2. fiabilitatea procesării evenimentelor și să mențină funcționalitatea sistemului în fața defecțiunilor.

Clienții folosesc modele de arhitectură de microservicii pentru a accelera inovația și timpul de lansare pe piață pentru noi funcții, deoarece face aplicațiile mai ușor de scalat și mai rapid de dezvoltat. Cu toate acestea, este o provocare să îmbogățiți și să redați datele dintr-un apel de rețea către un alt microserviciu, deoarece poate afecta fiabilitatea aplicației și poate face dificilă depanarea și urmărirea erorilor. Pentru a rezolva această problemă, aprovizionarea cu evenimente este un model de proiectare eficient care centralizează înregistrările istorice ale tuturor modificărilor de stare pentru îmbogățire și reluare și decuplează sarcinile de lucru citite de scriere. Clienții pot folosi Kinesis Data Streams ca magazin de evenimente centralizat pentru microservicii de aprovizionare cu evenimente, deoarece KDS poate gestiona 1/ gigaocteți de transfer de date pe secundă per flux și transmite datele în milisecunde, pentru a îndeplini cerințele de scalabilitate ridicată și aproape în timp real. latență, 2/ se integrează cu Flink și S3 pentru îmbogățirea și obținerea datelor în timp ce sunt complet decuplate de microservicii și 3/ permite reîncercarea și citirea asincronă într-un timp ulterioară, deoarece KDS păstrează înregistrarea datelor pentru o perioadă implicită de 24 de ore și, opțional până la 365 de zile.

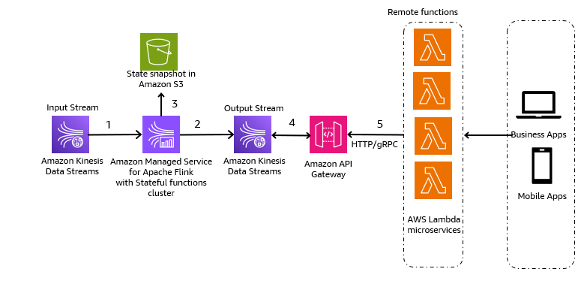

Următorul model arhitectural este o ilustrare generică a modului în care Kinesis Data Streams poate fi utilizat pentru microservicii de aprovizionare cu evenimente:

Pașii din fluxul de lucru sunt următorii:

- Ingerarea și stocarea datelor – Puteți agrega intrarea de la microservicii în fluxurile de date Kinesis pentru stocare.

- Procesarea fluxurilor - Funcții cu stare Apache Flink simplifică construirea de aplicații cu stare distribuite bazate pe evenimente. Poate primi evenimentele dintr-un flux de date Kinesis de intrare și poate direcționa fluxul rezultat către un flux de date de ieșire. Puteți crea un cluster de funcții cu stare cu Apache Flink pe baza logicii de afaceri a aplicației dvs.

- Instantaneu de stare în Amazon S3 – Puteți stoca instantaneul de stare în Amazon S3 pentru urmărire.

- Fluxuri de ieșire – Fluxurile de ieșire pot fi consumate prin funcțiile Lambda la distanță prin protocolul HTTP/gRPC prin API Gateway.

- Funcții la distanță Lambda – Funcțiile Lambda pot acționa ca microservicii pentru diverse aplicații și logici de afaceri pentru a servi aplicațiilor de afaceri și aplicațiilor mobile.

Pentru a afla cum și-au construit alți clienți microservicii bazate pe evenimente cu Kinesis Data Streams, consultați următoarele:

Considerente cheie și cele mai bune practici

Următoarele sunt considerații și cele mai bune practici de reținut:

- Descoperirea datelor ar trebui să fie primul pas în construirea aplicațiilor moderne de streaming de date. Trebuie să definiți valoarea afacerii și apoi să identificați sursele de date în flux și persoanele de utilizator pentru a obține rezultatele dorite de afaceri.

- Alegeți instrumentul de asimilare a datelor în flux pe baza sursei dvs. de date. De exemplu, puteți utiliza Kinesis SDK pentru ingerarea datelor în flux prin intermediul API-urilor, the Biblioteca Producătorului Kinesis pentru construirea de producători de streaming de înaltă performanță și de lungă durată, a Agent kinesis pentru colectarea unui set de fișiere și ingerarea lor în Kinesis Data Streams, AWS DMS pentru cazurile de utilizare în flux CDC și AWS IoT Core pentru ingerarea datelor de dispozitiv IoT în Kinesis Data Streams. Puteți ingera date de streaming direct în Amazon Redshift pentru a construi aplicații de streaming cu latență scăzută. De asemenea, puteți utiliza biblioteci terță parte, cum ar fi Apache Spark și Apache Kafka, pentru a ingera date de streaming în Kinesis Data Streams.

- Trebuie să alegeți serviciile de procesare a datelor în flux pe baza cazului de utilizare specific și a cerințelor de afaceri. De exemplu, puteți utiliza Amazon Kinesis Managed Service pentru Apache Flink pentru cazuri avansate de utilizare în flux cu mai multe destinații de streaming și procesare complexă a fluxului cu stare sau dacă doriți să monitorizați valorile de afaceri în timp real (cum ar fi fiecare oră). Lambda este bun pentru procesarea bazată pe evenimente și fără stat. Poți să folosești Amazon EMR pentru procesarea datelor în flux, pentru a utiliza cadrele de date mari open source preferate. AWS Glue este bun pentru procesarea datelor în flux aproape în timp real pentru cazuri de utilizare precum streaming ETL.

- Modul la cerere Kinesis Data Streams taxează în funcție de utilizare și crește automat capacitatea resurselor, astfel încât este bun pentru sarcinile de lucru în flux în flux și întreținerea fără mâini. Modul furnizat se încarcă în funcție de capacitate și necesită o gestionare proactivă a capacității, așa că este bun pentru încărcături de lucru de streaming previzibile.

- Aveți posibilitatea să utilizați Calculator partajat Kinesis pentru a calcula numărul de fragmente necesare pentru modul furnizat. Nu trebuie să vă preocupați de fragmentele cu modul la cerere.

- Când acordați permisiuni, decideți cine primește ce permisiuni pentru care resurse Kinesis Data Streams. Activați anumite acțiuni pe care doriți să le permiteți pentru acele resurse. Prin urmare, ar trebui să acordați numai permisiunile necesare pentru a efectua o sarcină. De asemenea, puteți cripta datele în repaus utilizând o cheie gestionată de client KMS (CMK).

- Poti actualizați perioada de păstrare prin consola Kinesis Data Streams sau folosind IncreaseStreamRetentionPeriod si DecreaseStreamRetentionPeriod operațiuni bazate pe cazurile dvs. specifice de utilizare.

- Kinesis Data Streams acceptă reharding. API-ul recomandat pentru această funcție este UpdateShardCount, care vă permite să modificați numărul de fragmente din flux pentru a vă adapta la modificările ratei fluxului de date prin flux. API-urile de redistribuire (Split and Merge) sunt utilizate de obicei pentru a gestiona fragmentele fierbinți.

Concluzie

Această postare a demonstrat diferite modele arhitecturale pentru construirea de aplicații de streaming cu latență scăzută cu Kinesis Data Streams. Vă puteți construi propriile aplicații de abur cu latență scăzută cu Kinesis Data Streams folosind informațiile din această postare.

Pentru modele arhitecturale detaliate, consultați următoarele resurse:

Dacă doriți să construiți o viziune și o strategie de date, consultați Totul bazat pe date AWS (D2E) program.

Despre Autori

Raghavarao Sodabathina este arhitect principal de soluții la AWS, concentrându-se pe Data Analytics, AI/ML și securitate în cloud. El se angajează cu clienții pentru a crea soluții inovatoare care abordează problemele de afaceri ale clienților și pentru a accelera adoptarea serviciilor AWS. În timpul liber, lui Raghavarao îi place să petreacă timpul cu familia sa, să citească cărți și să se uite la filme.

Raghavarao Sodabathina este arhitect principal de soluții la AWS, concentrându-se pe Data Analytics, AI/ML și securitate în cloud. El se angajează cu clienții pentru a crea soluții inovatoare care abordează problemele de afaceri ale clienților și pentru a accelera adoptarea serviciilor AWS. În timpul liber, lui Raghavarao îi place să petreacă timpul cu familia sa, să citească cărți și să se uite la filme.

Hang Zuo este Senior Product Manager în echipa Amazon Kinesis Data Streams la Amazon Web Services. Este pasionat de dezvoltarea unor experiențe intuitive de produse care rezolvă probleme complexe ale clienților și le permit clienților să-și atingă obiectivele de afaceri.

Hang Zuo este Senior Product Manager în echipa Amazon Kinesis Data Streams la Amazon Web Services. Este pasionat de dezvoltarea unor experiențe intuitive de produse care rezolvă probleme complexe ale clienților și le permit clienților să-și atingă obiectivele de afaceri.

Shwetha Radhakrishnan este arhitect de soluții pentru AWS, cu accent pe Data Analytics. Ea a creat soluții care stimulează adoptarea cloud-ului și ajută organizațiile să ia decizii bazate pe date în sectorul public. În afara serviciului, îi place să danseze, să petreacă timpul cu prietenii și familia și să călătorească.

Shwetha Radhakrishnan este arhitect de soluții pentru AWS, cu accent pe Data Analytics. Ea a creat soluții care stimulează adoptarea cloud-ului și ajută organizațiile să ia decizii bazate pe date în sectorul public. În afara serviciului, îi place să danseze, să petreacă timpul cu prietenii și familia și să călătorească.

Brittany Ly este arhitect de soluții la AWS. Ea se concentrează pe a ajuta clienții întreprinderilor în procesul lor de adoptare și modernizare a cloud-ului și are un interes în domeniul securității și al analizei. În afara serviciului, îi place să petreacă timpul cu câinele ei și să joace pickleball.

Brittany Ly este arhitect de soluții la AWS. Ea se concentrează pe a ajuta clienții întreprinderilor în procesul lor de adoptare și modernizare a cloud-ului și are un interes în domeniul securității și al analizei. În afara serviciului, îi place să petreacă timpul cu câinele ei și să joace pickleball.

- Distribuție de conținut bazat pe SEO și PR. Amplifică-te astăzi.

- PlatoData.Network Vertical Generative Ai. Împuterniciți-vă. Accesați Aici.

- PlatoAiStream. Web3 Intelligence. Cunoștințe amplificate. Accesați Aici.

- PlatoESG. carbon, CleanTech, Energie, Mediu inconjurator, Solar, Managementul deșeurilor. Accesați Aici.

- PlatoHealth. Biotehnologie și Inteligență pentru studii clinice. Accesați Aici.

- Sursa: https://aws.amazon.com/blogs/big-data/architectural-patterns-for-real-time-analytics-using-amazon-kinesis-data-streams-part-1/

- :are

- :este

- :nu

- :Unde

- $UP

- 1

- 100

- 24

- 7

- a

- capacitate

- Despre Noi

- accelera

- acces

- accesate

- Obține

- realizat

- Realizeaza

- realizarea

- peste

- act

- actorie

- acțiuni

- adapta

- plus

- Suplimentar

- În plus,

- adresa

- Adoptare

- avansat

- Avantaj

- După

- vârstă

- Agent

- agregat

- AI / ML

- isi propune

- Alerte

- TOATE

- permite

- Permiterea

- permite

- de asemenea

- Amazon

- Amazon Kinesis

- Amazon Timestream

- Amazon Web Services

- an

- analiză

- Google Analytics

- analiza

- și

- detectarea anomaliilor

- O alta

- Orice

- Apache

- Apache Kafka

- Apache Spark

- api

- API-uri

- aplicație

- aplicatii

- abordare

- Apps

- arhitectural

- arhitectură

- SUNT

- AS

- asociate

- At

- Automat

- în mod automat

- disponibilitate

- disponibil

- AWS

- AWS Adeziv

- AWS Lambdas

- bazat

- BE

- deoarece

- fost

- comportament

- fiind

- CEL MAI BUN

- Cele mai bune practici

- Mai bine

- între

- Mare

- Datele mari

- Blog

- Manuale

- atât

- construi

- Clădire

- construit

- afaceri

- Aplicații pentru afaceri

- întreprinderi

- dar

- by

- calcula

- apel

- CAN

- Capacitate

- captura

- pasă

- caz

- cazuri

- CDC

- Centru

- centralizat

- sigur

- provocare

- Schimbare

- Modificări

- taxe

- verifica

- alegere

- Alege

- curat

- Curățenie

- Cloud

- adoptarea norului

- Securitatea cloud

- Grup

- colecta

- Colectare

- Comun

- comunica

- complet

- complex

- componente

- compuse

- Calcula

- tehnica de calcul

- îngrijorat

- configurarea

- Considerații

- constă

- Consoleze

- mereu

- consuma

- consumate

- consumator

- Consumatorii

- contactați-ne

- centru de contact

- continuu

- continuu

- Control

- crea

- a creat

- critic

- client

- clienţii care

- personalizate

- Dans

- tablouri de bord

- de date

- analiza datelor

- Analiza datelor

- îmbogățirea datelor

- Lacul de date

- management de date

- puncte de date

- de prelucrare a datelor

- depozit de date

- Pe bază de date

- Baza de date

- baze de date

- Zi

- decide

- decizie

- Luarea deciziilor

- Deciziile

- decuplat

- dedicat

- Mod implicit

- defini

- livra

- demonstrat

- În funcție

- Amenajări

- proiectat

- dorit

- destinație

- destinații

- detaliat

- detalii

- detecta

- Detectare

- dezvolta

- în curs de dezvoltare

- Dezvoltare

- dispozitiv

- Dispozitive

- diferit

- dificil

- direct

- descoperire

- distribuite

- calcul distribuit

- do

- Câine

- Dont

- jos

- conduce

- condus

- durabilitate

- dinamic

- fiecare

- mai ușor

- cu ușurință

- uşor

- Eficace

- îmbrăţişare

- permite

- criptare

- Obiective

- se angajează

- sporită

- îmbogăți

- Afacere

- clienții întreprinderii

- Erori

- Eter (ETH)

- eveniment

- evenimente

- Fiecare

- toată lumea

- exemplu

- exemple

- se așteaptă

- experienţă

- Experiențe

- explora

- extinde

- extrage

- Față

- eşecuri

- familie

- Modă

- mai repede

- Favorite

- Caracteristică

- DESCRIERE

- camp

- Fişiere

- First

- cinci

- debit

- Concentra

- concentrat

- concentrându-se

- următor

- urmează

- Pentru

- Cadru

- cadre

- frecvent

- Prietenii lui

- din

- funcţie

- funcționalitate

- funcții

- mai mult

- Câştig

- poartă

- genera

- generată

- obtinerea

- GitHub

- oferă

- Goluri

- bine

- acordarea

- acordarea

- manipula

- Atârna

- he

- ajutor

- ajutor

- ei

- Înalt

- performanta ridicata

- lui

- istoric

- FIERBINTE

- oră

- ORE

- Cum

- Totuși

- HTML

- http

- HTTPS

- sute

- identifica

- if

- ilustrează

- Impactul

- in

- În altele

- include

- Intrare

- Crește

- crescând

- independent

- influențat

- informații

- Infrastructură

- infrastructură

- inovatoare

- Inovaţie

- inovatoare

- intrare

- perspective

- instala

- integra

- integrate

- integrare

- integrările

- interes

- interfaţă

- Internet

- internetul Lucrurilor

- în

- introdus

- intuitiv

- invocat

- IoT

- Dispozitiv IoT

- IT

- ESTE

- călătorie

- jpg

- Kafka

- A pastra

- Cheie

- Fluxuri de date Kinesis

- lac

- Latență

- mai tarziu

- strat

- straturi

- AFLAȚI

- carte mare

- biblioteci

- Bibliotecă

- ușoară

- ca

- viaţă

- încărca

- log

- logică

- logic

- iubeste

- menține

- întreținere

- face

- FACE

- Efectuarea

- gestionate

- administrare

- manager

- multe

- Marketing

- maxim

- măsurare

- Mass-media

- Întâlni

- Memorie

- Îmbina

- Metadata

- Metrici

- microservices

- De mijloc

- migrațiune

- milisecunde

- minte

- Mobil

- Aplicatii mobile

- dispozitive mobile

- mobile-aplicații

- mod

- Modern

- modernizare

- moduri de

- modifica

- monitor

- mai mult

- Filme

- multiplu

- trebuie sa

- nativ

- În apropiere

- Nevoie

- necesar

- nevoilor

- reţea

- Nou

- Funcții noi

- acum

- număr

- of

- oferi

- promoții

- on

- La cerere

- afară

- deschide

- open-source

- operaţie

- operațional

- Operațiuni

- Optimizați

- optimizate

- Opțiune

- or

- comandă

- de organizare

- organizații

- Altele

- al nostru

- afară

- rezultate

- producție

- exterior

- peste

- propriu

- parte

- pasionat

- Model

- modele

- Plătește

- pentru

- efectua

- performanță

- permisiuni

- Personalizat

- ţeavă

- conducte

- Platforme

- Plato

- Informații despre date Platon

- PlatoData

- Joaca

- conecteaza

- puncte

- Post

- practicile

- predictibil

- Prețuri

- de stabilire a prețurilor

- primar

- Principal

- anterior

- privat

- Proactivă

- Problemă

- probleme

- proces

- prelucrate

- procese

- prelucrare

- Produs

- producător

- Producătorii

- Produs

- manager de produs

- Program

- protocol

- furniza

- furnizează

- împuternicit

- public

- gamă

- repede

- rată

- Crud

- date neprelucrate

- Citeste

- Citind

- real

- în timp real

- date în timp real

- a primi

- primește

- Recomandare

- recomandat

- record

- inregistrata

- înregistrări

- reduce

- trimite

- regiune

- încredere

- de încredere

- la distanta

- necesar

- cerință

- Cerinţe

- Necesită

- resursă

- Resurse

- responsabil

- REST

- rezultând

- reține

- reține

- retenţie

- revizuiască

- Traseul

- acelaşi

- scalabilitate

- scalabil

- Scară

- cântare

- Al doilea

- sector

- securitate

- senior

- senzori

- Secvenţă

- serie

- servi

- serverless

- serviciu

- Servicii

- set

- comun

- ea

- să

- simbolizeazã

- Simplifică

- mic

- Instantaneu

- So

- Social

- social media

- Software

- de dezvoltare de software

- soluţie

- soluţii

- REZOLVAREA

- Sursă

- Surse

- Scânteie

- specific

- viteză

- petrece

- Cheltuire

- piroane

- împărţi

- stivui

- Stat

- Pas

- paşi

- stoc

- depozitare

- stoca

- stocate

- Strategie

- curent

- transmise în flux

- de streaming

- fluxuri

- strict

- ulterior

- astfel de

- suficient

- a sustine

- Sprijină

- sistem

- tabel

- Lua

- Sarcină

- sarcini

- echipă

- zeci

- acea

- informațiile

- Statul

- lor

- Lor

- apoi

- Acolo.

- prin urmare

- Acestea

- ei

- lucruri

- terț

- acest

- aceste

- mii

- trei

- Prin

- debit

- timp

- Seria de timp

- sensibil la timp

- la

- astăzi

- instrument

- urmări

- urmări

- Urmărire

- trafic

- Transforma

- Transformare

- transformare

- Traveling

- Tendinţe

- Două

- tipic

- Neașteptat

- pe

- Folosire

- utilizare

- carcasa de utilizare

- utilizat

- Utilizator

- folosind

- folosi

- validare

- valoare

- variabil

- diverse

- Viteză

- de

- Virtual

- viziune

- vizualizare

- imagina

- volum

- volume

- vrea

- Depozit

- depozitare

- vizionarea

- we

- web

- servicii web

- bine definit

- Ce

- cand

- care

- în timp ce

- OMS

- larg

- Gamă largă

- voi

- cu

- în

- Apartamente

- flux de lucru

- face griji

- scrie

- tu

- Ta

- zephyrnet

- zone