Prima startup de securitate cibernetică a lui Josh Lospinoso a fost achiziționată în 2017 de Raytheon/Forcepoint. Al doilea său, Shift5, lucrează cu armata americană, operatori feroviari și companii aeriene, inclusiv JetBlue. Absolvent în 2009 la West Point și Rhodes Scholar, fostul căpitan al armatei în vârstă de 36 de ani și-a petrecut mai mult de un deceniu instrumente de hacking de creație pentru Agenția de Securitate Națională și Comandamentul Cyber din SUA.

Lospinoso a spus recent unei subcomisii pentru serviciile armate a Senatului cum inteligența artificială poate ajuta la protejarea operațiunilor militare. CEO-ul/programatorul a discutat subiectul cu The Associated Press, precum și despre cum vulnerabilitățile software din sistemele de arme reprezintă o amenințare majoră pentru armata SUA. Interviul a fost editat pentru claritate și lungime.

Î: În mărturia dumneavoastră, ați descris două amenințări principale la adresa tehnologiilor AI: una este furtul. Asta se explică de la sine. Celălalt este otrăvirea datelor. Poți explica asta?

R: O modalitate de a gândi otrăvirea datelor este dezinformarea digitală. Dacă adversarii sunt capabili să creeze datele pe care le văd tehnologiile activate cu inteligența artificială, ei pot avea un impact profund asupra modului în care funcționează această tehnologie.

Î: Are loc otrăvirea datelor?

R: Nu vedem asta în linii mari. Dar s-a produs. Unul dintre cele mai cunoscute cazuri a avut loc în 2016. Microsoft a lansat un chatbot Twitter pe care l-a numit Tay, care a aflat din conversațiile pe care le-a avut online. Utilizatorii rău intenționați au conspirat să trimită un limbaj abuziv și ofensator. Tay a început să genereze conținut inflamator. Microsoft a luat-o offline.

Î: AI nu este doar chatbot. A fost de multă vreme parte integrantă a securității cibernetice, nu?

R: AI este folosită în filtrele de e-mail pentru a încerca să semnalizeze și să separe mesajele nedorite și momeli de phishing. Un alt exemplu sunt punctele finale, cum ar fi programul antivirus de pe laptopul dvs. sau software-ul de detectare a malware-ului care rulează în rețele. Desigur, hackerii ofensivi folosesc și AI pentru a încerca să învingă acele sisteme de clasificare. Asta se numește AI adversar.

Î: Să vorbim despre sistemele software militare. Un 2018 alarmant Raportul Biroului de Responsabilitate al Guvernului a spus că aproape toate sistemele de arme nou dezvoltate au vulnerabilități esențiale pentru misiune. Și Pentagonul se gândește să pună AI în astfel de sisteme?

R: Există două probleme aici. În primul rând, trebuie să asigurăm în mod adecvat sistemele de arme existente. Aceasta este o datorie tehnică pe care o avem, care va dura mult timp pentru a plăti. Apoi, există o nouă frontieră a securizării algoritmilor AI – lucruri noi pe care le-am instala. Raportul GAO nu prea vorbea despre AI. Așa că uită de AI pentru o secundă. Dacă aceste sisteme au rămas așa cum sunt, ele sunt încă profund vulnerabile.

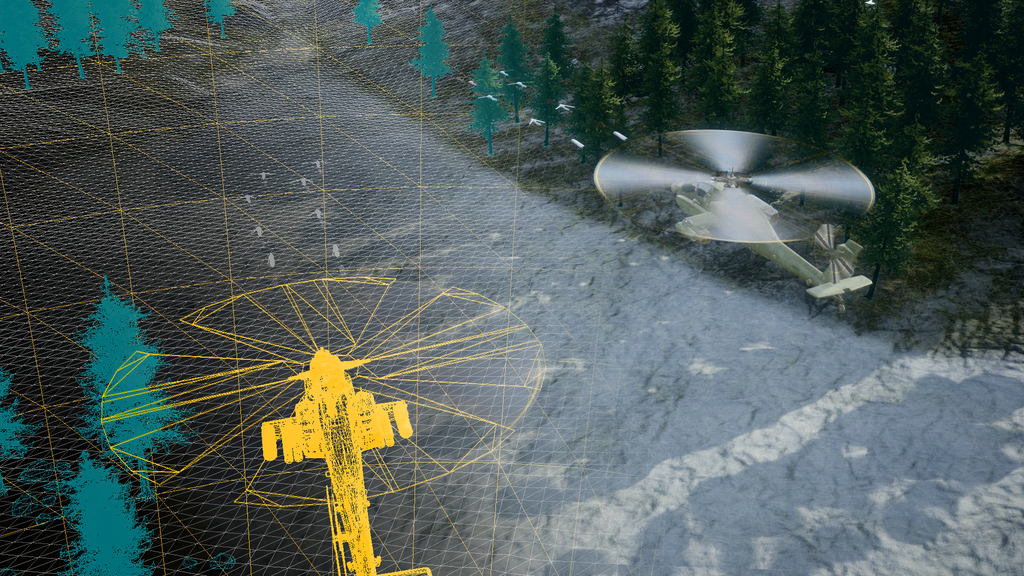

Discutăm să depășim limitele și să adăugăm capabilități activate de AI pentru lucruri precum întreținerea îmbunătățită și inteligența operațională. Toate grozave. Dar construim deasupra unui castel de cărți. Multe sisteme au o vechime de zeci de ani, echipate cu tehnologii digitale. Avioane, vehicule terestre, active spațiale, submarine. Acum sunt interconectate. Schimbăm datele în și în afara. Sistemele sunt poroase, greu de actualizat și ar putea fi atacate. Odată ce un atacator obține acces, jocul s-a terminat.

Uneori este mai ușor să construiești o nouă platformă decât să reproiectezi componentele digitale ale sistemelor existente. Dar există un rol pentru AI în securizarea acestor sisteme. AI poate fi folosit pentru a se apăra dacă cineva încearcă să-l compromită.

Î: Ați mărturisit că întreruperea cercetării AI, așa cum au îndemnat unii, ar fi o idee proastă, deoarece ar favoriza China și alți concurenți. Dar aveți și îngrijorări cu privire la graba cu capul către produsele AI. De ce?

R: Urăsc să par fatalist, dar așa-numitul caz de „utilizare în ardere” pare să se aplice. Un produs care se grăbește pe piață ia adesea foc (este spart, eșuează, provoacă daune neintenționate). Și spunem: „Băiete, ar fi trebuit să construim securitatea”. Mă aștept ca ritmul dezvoltării AI să se accelereze și s-ar putea să nu ne oprim suficient pentru a face acest lucru într-un mod sigur și responsabil. Cel puțin Casa Albă și Congresul discută aceste probleme.

Î: Se pare că o grămadă de companii – inclusiv din sectorul apărării – se grăbesc să anunțe produse AI pe jumătate preparate.

R: Fiecare companie de tehnologie și multe companii non-tehnologice au făcut aproape un pivot zguduitor către AI. Vin dislocări economice. Modelele de afaceri se vor schimba fundamental. Dislocările au loc deja sau sunt la orizont – iar liderii de afaceri încearcă să nu fie prinși pe picior.

Î: Cum rămâne cu utilizarea AI în luarea deciziilor militare, cum ar fi țintirea?

R: Nu cred, categoric nu cred că algoritmii de inteligență artificială – datele pe care le colectăm – sunt pregătiți pentru prime time pentru ca un sistem de arme letal să ia decizii. Suntem atât de departe de asta.

- Distribuție de conținut bazat pe SEO și PR. Amplifică-te astăzi.

- PlatoAiStream. Web3 Data Intelligence. Cunoștințe amplificate. Accesați Aici.

- Mintând viitorul cu Adryenn Ashley. Accesați Aici.

- Cumpărați și vindeți acțiuni în companii PRE-IPO cu PREIPO®. Accesați Aici.

- Sursa: https://www.defensenews.com/artificial-intelligence/2023/05/29/adversarial-ai-a-threat-to-military-systems-shift5s-lospinoso-says/

- :are

- :este

- :nu

- 2016

- 2017

- 2018

- 70

- a

- Capabil

- Despre Noi

- accelera

- acces

- responsabilitate

- dobândite

- adăugare

- adecvat

- contradictorialității

- agenție

- AI

- cercetare ai

- avioane

- Companii aeriene

- algoritmi

- TOATE

- deja

- de asemenea

- an

- și

- anunța

- O alta

- antivirus

- Aplică

- SUNT

- armat

- Armată

- artificial

- inteligență artificială

- AS

- Bunuri

- asociate

- At

- Rău

- BE

- deoarece

- fost

- început

- in linii mari

- construi

- Clădire

- construit

- Buchet

- afaceri

- dar

- by

- denumit

- CAN

- capacități

- Carduri

- caz

- cazuri

- prins

- Schimbare

- chatbot

- chatbots

- China

- claritate

- clasificare

- Colectare

- venire

- Companii

- companie

- concurenți

- componente

- compromis

- preocupările

- Congres

- conţinut

- conversații

- ar putea

- înscrie-te la cursul

- ambarcaţiunilor

- critic

- Cyber

- Securitate cibernetică

- de date

- Datorie

- deceniu

- zeci de ani

- Luarea deciziilor

- Deciziile

- Apărare

- descris

- Detectare

- dezvoltat

- Dezvoltare

- digital

- discutat

- discutarea

- dezinformare

- do

- face

- mai ușor

- Economic

- suficient de

- Fiecare

- exemplu

- existent

- aștepta

- Explica

- eșuează

- departe

- favoriza

- Filtre

- Incendiu

- First

- Pentru

- Fost

- din

- Frontieră

- fundamental

- câștig

- joc

- GAO

- genera

- obține

- merge

- mare

- Teren

- tocat

- hackeri

- hacking

- HAD

- sa întâmplat

- lucru

- Greu

- Avea

- cu capul înainte

- ajutor

- aici

- lui

- orizont

- casă

- Cum

- HTTPS

- i

- idee

- if

- imagini

- Impactul

- îmbunătățit

- in

- Inclusiv

- instala

- integrală

- Inteligență

- interconectate

- Interviu

- în

- probleme de

- IT

- jetBlue

- doar

- limbă

- laptop

- Liderii

- învățat

- cel mai puțin

- Lungime

- ca

- Lung

- perioadă lungă de timp

- făcut

- întreținere

- major

- Efectuarea

- malware

- detectarea programelor malware

- multe

- Piață

- Microsoft

- ar putea

- Militar

- Misiune

- Modele

- mai mult

- Numit

- național

- securitate naționala

- Agenția Națională de Securitate

- aproape

- Nevoie

- rețele

- Nou

- Platforma nouă

- roman

- acum

- a avut loc

- of

- ofensator

- Birou

- Offline

- de multe ori

- Vechi

- on

- dată

- ONE

- on-line

- opereaza

- operațional

- Operațiuni

- Operatorii

- or

- Altele

- afară

- peste

- Pace

- pauză

- Plătește

- pentagon

- Phishing

- Pivot

- platformă

- Plato

- Informații despre date Platon

- PlatoData

- Punct

- presa

- Prim

- Principal

- Produs

- Produse

- Program

- proteja

- împingerea

- Punând

- șină

- gata

- într-adevăr

- recent

- redesign

- eliberat

- raportează

- cercetare

- responsabil

- dreapta

- Rol

- grăbi

- s

- Said

- Spune

- spune

- Al doilea

- sector

- sigur

- asigurarea

- securitate

- vedea

- vedere

- pare

- Senat

- Servicii

- să

- So

- până acum

- Software

- unele

- Cineva

- Suna

- Spaţiu

- uzat

- lansare

- au stat

- Încă

- subcomitet

- subiect

- astfel de

- schimbarea

- sistem

- sisteme

- Lua

- Vorbi

- direcționare

- tech

- Compania Tech

- Tehnic

- Tehnologii

- Tehnologia

- a depus mărturie

- mărturie

- decât

- acea

- furt

- Lor

- apoi

- Acolo.

- Acestea

- ei

- lucruri

- crede

- Gândire

- acest

- aceste

- amenințare

- amenințări

- timp

- la

- a luat

- top

- spre

- încerca

- tweet

- stare de nervozitate

- Două

- ne

- upgrade-ul

- utilizare

- utilizat

- utilizatorii

- Vehicule

- foarte

- Vulnerabilitățile

- vulnerabil

- a fost

- Cale..

- we

- Armament

- BINE

- Vest

- Ce

- alb

- Casă albă

- de ce

- cu

- fabrică

- ar

- tu

- Ta

- zephyrnet