Nesta era de big data, as organizações em todo o mundo procuram constantemente formas inovadoras de extrair valor e insights dos seus vastos conjuntos de dados. Apache Spark oferece a escalabilidade e a velocidade necessárias para processar grandes quantidades de dados com eficiência.

Amazon EMR é a solução de big data em nuvem líder do setor para processamento de dados em escala de petabytes, análise interativa e aprendizado de máquina (ML) usando estruturas de código aberto, como Apache Spark, Colmeia Apache e Presto. O Amazon EMR é o melhor lugar para executar o Apache Spark. Você pode criar clusters Spark gerenciados com rapidez e facilidade a partir do Console de gerenciamento da AWS, Interface de linha de comando da AWS (AWS CLI) ou API do Amazon EMR. Você também pode usar recursos adicionais do Amazon EMR, incluindo Serviço de armazenamento simples da Amazon (Amazon S3) conectividade usando o Amazon EMR File System (EMRFS), integração com o Ponto Amazon EC2 mercado e o Cola AWS Data Catalog e EMR Managed Scaling para adicionar ou remover instâncias do seu cluster. Estúdio Amazon EMR é um ambiente de desenvolvimento integrado (IDE) que torna mais fácil para cientistas e engenheiros de dados desenvolver, visualizar e depurar aplicativos de engenharia e ciência de dados escritos em R, Python, Scala e PySpark. O EMR Studio fornece notebooks Jupyter totalmente gerenciados e ferramentas como Spark UI e YARN Timeline Service para simplificar a depuração.

Para desbloquear o potencial oculto nos dados, é essencial ir além da análise tradicional. Entre na IA generativa, uma tecnologia de ponta que combina ML com criatividade para gerar texto, arte e até código semelhantes aos humanos. Rocha Amazônica é a maneira mais direta de construir e dimensionar aplicativos generativos de IA com modelos básicos (FMs). O Amazon Bedrock é um serviço totalmente gerenciado que disponibiliza FMs da Amazon e de empresas líderes de IA por meio de uma API, para que você possa experimentar rapidamente uma variedade de FMs no playground e usar uma única API para inferência, independentemente dos modelos escolhidos, fornecendo você tem a flexibilidade de usar FMs de diferentes fornecedores e manter-se atualizado com as versões mais recentes dos modelos com alterações mínimas de código.

Nesta postagem, exploramos como você pode turbinar sua análise de dados com IA generativa usando Amazon EMR, Amazon Bedrock e o pyspark-ai biblioteca. A biblioteca pyspark-ai é um SDK em inglês para Apache Spark. Ele pega instruções em inglês e as compila em objetos PySpark como DataFrames. Isso facilita o trabalho com o Spark, permitindo que você se concentre na extração de valor dos seus dados.

Visão geral da solução

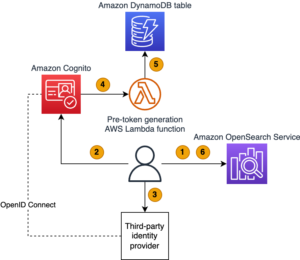

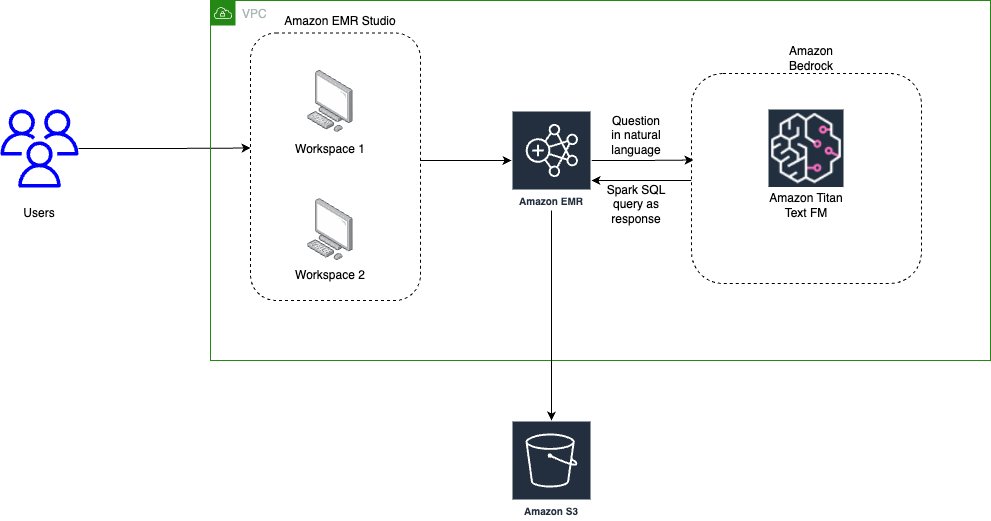

O diagrama a seguir ilustra a arquitetura para usar IA generativa com Amazon EMR e Amazon Bedrock.

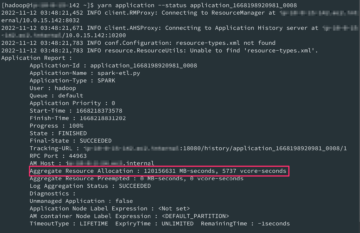

EMR Studio é um IDE baseado na Web para notebooks Jupyter totalmente gerenciados executados em clusters EMR. Interagimos com o EMR Studio Workspaces conectado a um cluster EMR em execução e executamos o notebook fornecido como parte desta postagem. Nós usamos o Táxi da cidade de Nova York dados para obter insights sobre várias viagens de táxi feitas pelos usuários. Fazemos as perguntas em linguagem natural sobre os dados carregados no Spark DataFrame. A biblioteca pyspark-ai usa então o Amazon Titan Text FM do Amazon Bedrock para criar uma consulta SQL com base na pergunta de linguagem natural. A biblioteca pyspark-ai pega a consulta SQL, executa-a usando Spark SQL e fornece resultados ao usuário.

Nesta solução, você pode criar e configurar os recursos necessários em sua conta AWS com um Formação da Nuvem AWS modelo. O modelo cria o Cola AWS banco de dados e tabelas, bucket S3, VPC e outros Gerenciamento de acesso e identidade da AWS (IAM) que são usados na solução.

O modelo foi projetado para demonstrar como usar o EMR Studio com o pacote pyspark-ai e o Amazon Bedrock e não se destina ao uso em produção sem modificação. Além disso, o modelo usa o us-east-1 Região e pode não funcionar em outras regiões sem modificação. O modelo cria recursos que incorrem em custos enquanto estão em uso. Siga as etapas de limpeza no final desta postagem para excluir os recursos e evitar cobranças desnecessárias.

Pré-requisitos

Antes de iniciar a pilha do CloudFormation, certifique-se de ter o seguinte:

- Uma conta da AWS que fornece acesso aos serviços da AWS

- Um usuário do IAM com uma chave de acesso e uma chave secreta para configurar a AWS CLI e permissões para criar uma função do IAM, políticas do IAM e pilhas no AWS CloudFormation

- O modelo Titan Text G1 – Express está atualmente em versão prévia, então você precisa ter acesso de visualização para usá-lo como parte desta postagem

Crie recursos com AWS CloudFormation

O CloudFormation cria os seguintes recursos AWS:

- Uma pilha VPC com sub-redes públicas e privadas para usar com o EMR Studio, tabelas de rotas e gateway NAT.

- Um cluster EMR com Python 3.9 instalado. Estamos usando uma ação de bootstrap para instalar o Python 3.9 e outros pacotes relevantes, como pyspark-ai e dependências do Amazon Bedrock. (Para mais informações, consulte o script de inicialização.)

- Um bucket S3 para o EMR Studio Workspace e armazenamento de notebook.

- Funções e políticas do IAM para configuração do EMR Studio, acesso ao Amazon Bedrock e execução de notebooks

Para começar, conclua as seguintes etapas:

A pilha do CloudFormation leva aproximadamente 20 a 30 minutos para ser concluída. Você pode monitorar seu progresso no console do AWS CloudFormation. Quando seu status for CREATE_COMPLETE, sua conta AWS terá os recursos necessários para implementar esta solução.

Criar estúdio EMR

Agora você pode criar um EMR Studio e Workspace para trabalhar com o código do notebook. Conclua as seguintes etapas:

- No console do EMR Studio, escolha Crie um estúdio.

- Introduzir o Nome do estúdio as

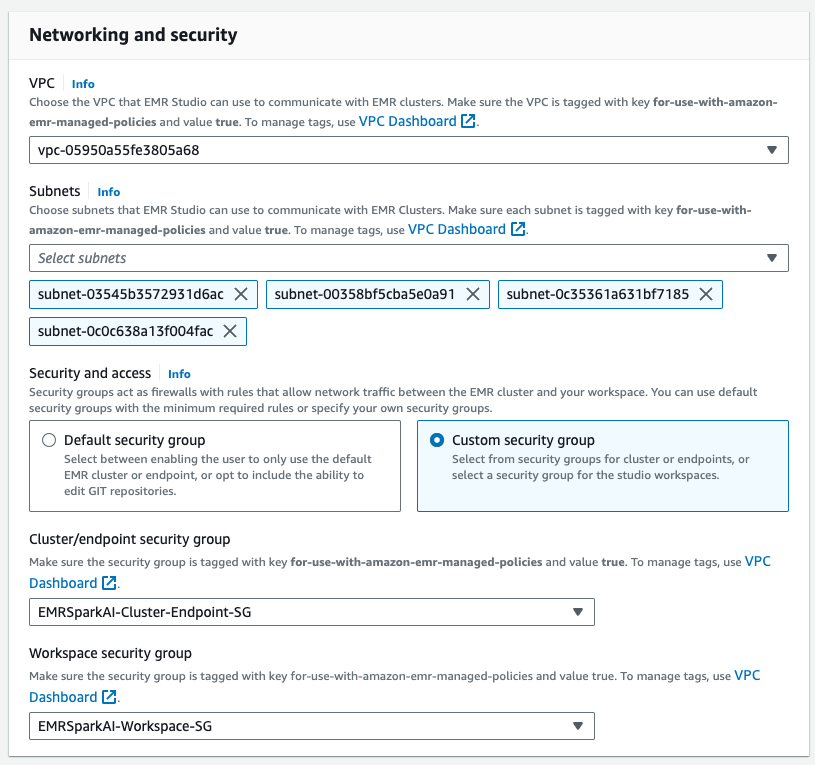

GenAI-EMR-Studioe forneça uma descrição. - No Rede e segurança seção, especifique o seguinte:

- Escolha VPC, escolha a VPC que você criou como parte da pilha do CloudFormation implantada. Obtenha o ID do VPC usando as saídas do CloudFormation para a chave VPCID.

- Escolha Sub-redes, escolha todas as quatro sub-redes.

- Escolha Segurança e acesso, selecione Grupo de segurança personalizado.

- Escolha Grupo de segurança de cluster/endpoint, escolha

EMRSparkAI-Cluster-Endpoint-SG. - Escolha Grupo de segurança do espaço de trabalho, escolha

EMRSparkAI-Workspace-SG.

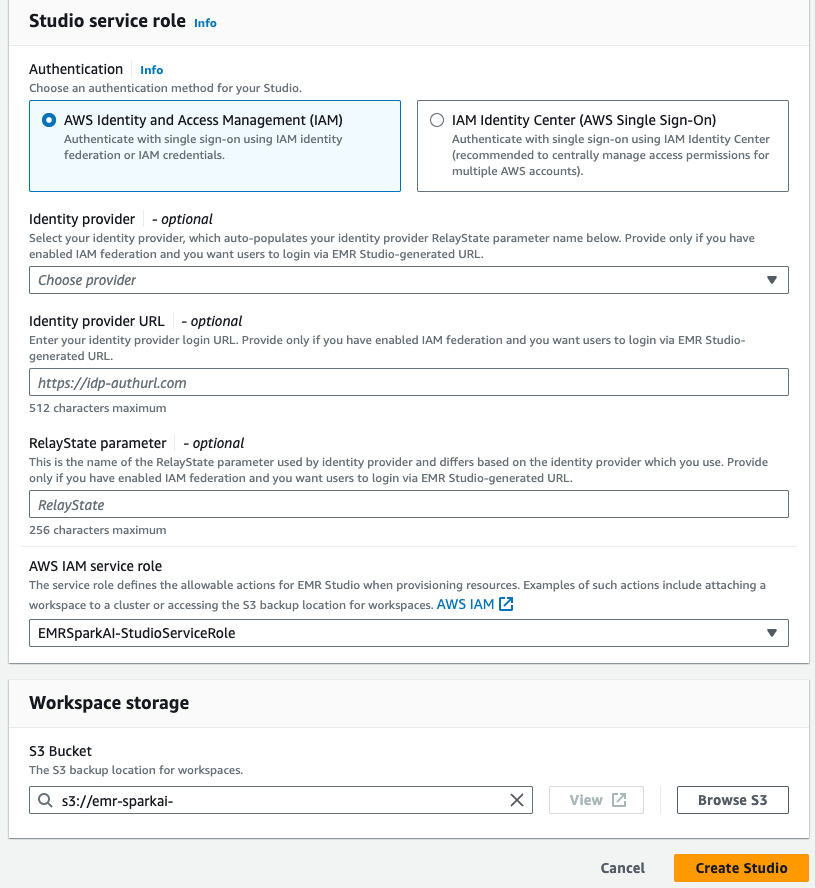

- No Função de serviço do Studio seção, especifique o seguinte:

- Escolha Autenticação, selecione AWS Identity and Access Management (IAM).

- Escolha Função de serviço AWS IAM, escolha

EMRSparkAI-StudioServiceRole.

- No Armazenamento do espaço de trabalho seção, navegue e escolha o bucket S3 para armazenamento começando com

emr-sparkai-<account-id>. - Escolha Criar estúdio.

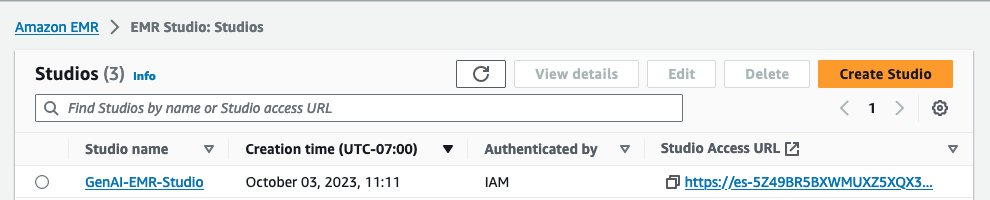

- Quando o EMR Studio for criado, escolha o link em URL de acesso ao estúdio para acessar o Estúdio.

- Quando você estiver no Studio, escolha Criar espaço de trabalho.

- Adicionar

emr-genaicomo o nome do espaço de trabalho e escolha Criar espaço de trabalho. - Quando o espaço de trabalho for criado, escolha seu nome para iniciá-lo (certifique-se de ter desabilitado todos os bloqueadores de pop-up).

Análise de big data usando Apache Spark com Amazon EMR e IA generativa

Agora que concluímos a configuração necessária, podemos começar a realizar análises de big data usando Apache Spark com Amazon EMR e IA generativa.

Como primeira etapa, carregamos um notebook que contém o código e os exemplos necessários para trabalhar com o caso de uso. Usamos o conjunto de dados NY Taxi, que contém detalhes sobre viagens de táxi.

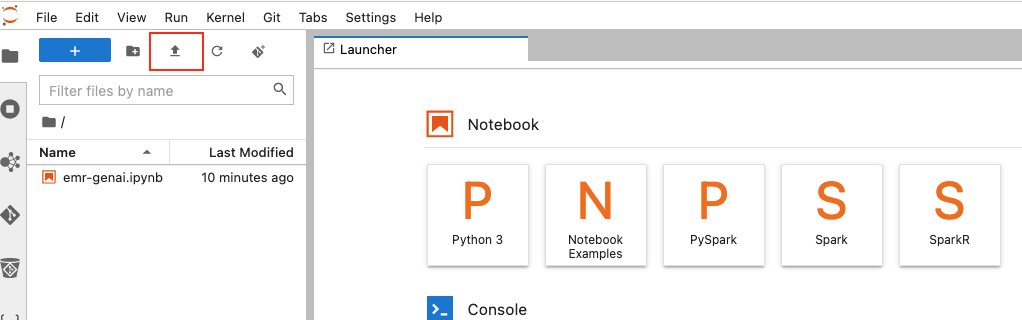

- Baixe o arquivo do caderno NYTaxi.ipynb e carregue-o em seu espaço de trabalho escolhendo o ícone de upload.

- Depois que o notebook for importado, abra-o e escolha

PySparkcomo o kernel.

IA PySpark por padrão, usa ChatGPT4.0 da OpenAI como modelo LLM, mas você também pode conectar modelos do Amazon Bedrock, JumpStart do Amazon SageMakere outros modelos de terceiros. Nesta postagem, mostramos como integrar o modelo Amazon Bedrock Titan para geração de consultas SQL e executá-lo com Apache Spark no Amazon EMR.

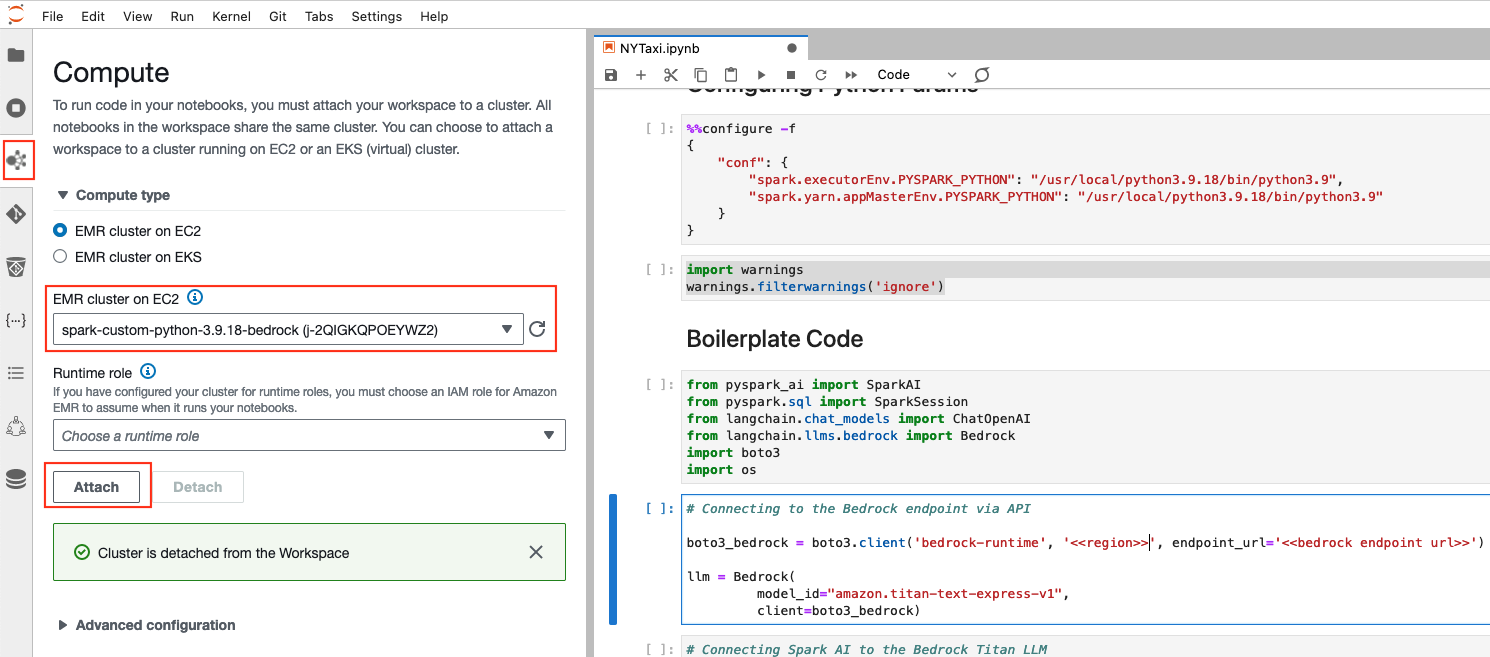

- Para começar a usar o notebook, você precisa associar o Workspace a uma camada de computação. Para isso, escolha o Computar ícone no painel de navegação e escolha o cluster EMR criado pela pilha do CloudFormation.

- Configure os parâmetros do Python para usar o pacote atualizado do Python 3.9 com o Amazon EMR:

- Importe as bibliotecas necessárias:

- Depois que as bibliotecas forem importadas, você poderá definir o modelo LLM do Amazon Bedrock. Neste caso, usamos amazon.titan-text-express-v1. Você precisa inserir o URL do endpoint da região e do Amazon Bedrock com base no seu acesso de visualização para o modelo Titan Text G1 – Express.

- Conecte o Spark AI ao modelo Amazon Bedrock LLM para geração de consultas SQL com base em perguntas em linguagem natural:

Aqui, inicializamos o Spark AI com verbose=False; você também pode definir verbose=True para ver mais detalhes.

Agora você pode ler os dados do táxi de Nova York em um DataFrame do Spark e usar o poder da IA generativa no Spark.

- Por exemplo, você pode perguntar a contagem do número de registros no conjunto de dados:

Recebemos a seguinte resposta:

Spark AI usa internamente LangChain e cadeia SQL, que esconde a complexidade dos usuários finais que trabalham com consultas no Spark.

O notebook tem mais alguns exemplos de cenários para explorar o poder da IA generativa com Apache Spark e Amazon EMR.

limpar

Esvazie o conteúdo do balde S3 emr-sparkai-<account-id>, exclua o EMR Studio Workspace criado como parte desta postagem e exclua a pilha do CloudFormation que você implantou.

Conclusão

Esta postagem mostrou como você pode turbinar sua análise de big data com a ajuda do Apache Spark com Amazon EMR e Amazon Bedrock. O pacote PySpark AI permite obter insights significativos de seus dados. Ele ajuda a reduzir o tempo de desenvolvimento e análise, reduzindo o tempo para escrever consultas manuais e permitindo que você se concentre no seu caso de uso comercial.

Sobre os autores

Saurabh Bhutyani é arquiteto de soluções especialista em análise principal na AWS. Ele é apaixonado por novas tecnologias. Ele ingressou na AWS em 2019 e trabalha com clientes para fornecer orientação arquitetônica para a execução de casos de uso de IA generativa, soluções de análise escaláveis e arquiteturas de malha de dados usando serviços da AWS como Amazon Bedrock, Amazon SageMaker, Amazon EMR, Amazon Athena, AWS Glue, AWS Lake Formation, e Amazon DataZone.

Saurabh Bhutyani é arquiteto de soluções especialista em análise principal na AWS. Ele é apaixonado por novas tecnologias. Ele ingressou na AWS em 2019 e trabalha com clientes para fornecer orientação arquitetônica para a execução de casos de uso de IA generativa, soluções de análise escaláveis e arquiteturas de malha de dados usando serviços da AWS como Amazon Bedrock, Amazon SageMaker, Amazon EMR, Amazon Athena, AWS Glue, AWS Lake Formation, e Amazon DataZone.

Harsh Vardhan é arquiteto de soluções sênior da AWS, especializado em análises. Ele tem mais de 8 anos de experiência trabalhando na área de big data e ciência de dados. Ele adora ajudar os clientes a adotar as melhores práticas e descobrir insights a partir de seus dados.

Harsh Vardhan é arquiteto de soluções sênior da AWS, especializado em análises. Ele tem mais de 8 anos de experiência trabalhando na área de big data e ciência de dados. Ele adora ajudar os clientes a adotar as melhores práticas e descobrir insights a partir de seus dados.

- Conteúdo com tecnologia de SEO e distribuição de relações públicas. Seja amplificado hoje.

- PlatoData.Network Gerativa Vertical Ai. Capacite-se. Acesse aqui.

- PlatoAiStream. Inteligência Web3. Conhecimento Amplificado. Acesse aqui.

- PlatãoESG. Carbono Tecnologia Limpa, Energia, Ambiente, Solar, Gestão de resíduos. Acesse aqui.

- PlatoHealth. Inteligência em Biotecnologia e Ensaios Clínicos. Acesse aqui.

- Fonte: https://aws.amazon.com/blogs/big-data/use-generative-ai-with-amazon-emr-amazon-bedrock-and-english-sdk-for-apache-spark-to-unlock-insights/

- :tem

- :é

- :não

- $UP

- 1

- 10

- 100

- 107

- 11

- 20

- 200

- 2019

- 320

- 500

- 521

- 7

- 8

- 9

- 990

- a

- Sobre

- Acesso

- gerenciamento de acesso

- Conta

- reconhecer

- Açao Social

- adicionar

- Adicional

- Adicionalmente

- adotar

- AI

- casos de uso ai

- Todos os Produtos

- Permitindo

- permite

- tb

- Amazon

- Amazona atena

- Amazon EMR

- Amazon Sage Maker

- Amazon Web Services

- quantidades

- an

- análise

- analítica

- e

- responder

- qualquer

- apache

- Apache Spark

- api

- aplicações

- aproximadamente

- arquitetônico

- arquitetura

- SOMOS

- Arte

- AS

- perguntar

- Jurídico

- At

- disponível

- evitar

- AWS

- Formação da Nuvem AWS

- Cola AWS

- Formação AWS Lake

- em caminho duplo

- baseado

- MELHOR

- melhores práticas

- Pós

- Grande

- Big Data

- Bootstrap

- construir

- negócio

- mas a

- botão

- by

- CAN

- casas

- casos

- catálogo

- cadeia

- Alterações

- acusações

- Escolha

- escolha

- Cidades

- Na nuvem

- big data na nuvem

- Agrupar

- código

- combina

- Empresas

- completar

- Efetuado

- complexidade

- Computar

- conectado

- Conectividade

- cônsul

- constantemente

- contém

- conteúdo

- custos

- crio

- criado

- cria

- criatividade

- Atualmente

- Clientes

- ponta

- dados,

- Análise de Dados

- informática

- ciência de dados

- banco de dados

- conjuntos de dados

- Data

- Padrão

- definir

- demonstrar

- dependências

- implantado

- derivar

- descrição

- projetado

- detalhes

- desenvolver

- Desenvolvimento

- diferente

- inválido

- descobrir

- do

- eficientemente

- sem esforço

- final

- Ponto final

- Engenharia

- Engenheiros

- Inglês

- garantir

- Entrar

- entrar

- Meio Ambiente

- Era

- essencial

- Éter (ETH)

- Mesmo

- exemplo

- exemplos

- vasta experiência

- experimentar

- explorar

- expresso

- extrato

- RÁPIDO

- Funcionalidades

- poucos

- campo

- Envie o

- final

- Primeiro nome

- Flexibilidade

- Foco

- seguir

- seguinte

- Escolha

- treinamento

- Foundation

- quatro

- enquadramentos

- da

- totalmente

- g1

- garner

- porta de entrada

- gerar

- geração

- generativo

- IA generativa

- ter

- Dando

- Go

- orientações

- Ter

- he

- ajudar

- ajuda

- ajuda

- oculto

- Esconder

- Como funciona o dobrador de carta de canal

- Como Negociar

- http

- HTTPS

- i

- IAM

- ÍCONE

- ID

- Identidade

- gerenciamento de identidade e acesso

- ilustra

- executar

- importar

- in

- Em outra

- Incluindo

- líder da indústria

- INFORMAÇÕES

- inovadores

- entrada

- insights

- instalar

- instâncias

- instruções

- integrar

- integrado

- integração

- Pretendido

- interagir

- interativo

- internamente

- para dentro

- IT

- ESTÁ

- ingressou

- jpg

- Guarda

- Chave

- Saber

- lago

- língua

- grande

- mais recente

- lançamento

- camada

- principal

- aprendizagem

- bibliotecas

- Biblioteca

- como

- Line

- LINK

- carregar

- máquina

- aprendizado de máquina

- fazer

- FAZ

- gerenciados

- de grupos

- manual

- mercado

- Posso..

- significativo

- malha

- mínimo

- minutos

- ML

- modelo

- modelos

- Monitore

- mais

- a maioria

- nome

- natural

- Linguagem Natural

- Navegação

- necessário

- você merece...

- necessário

- networking

- Novo

- Novas tecnologias

- caderno

- laptops

- agora

- número

- NY

- NYC

- objetos

- observação

- of

- Oferece

- on

- aberto

- open source

- or

- organizações

- Outros

- outputs

- Acima de

- Visão geral

- pacote

- pacotes

- pão

- parâmetros

- parte

- apaixonado

- realização

- permissões

- Lugar

- platão

- Inteligência de Dados Platão

- PlatãoData

- recreio

- plugue

- políticas

- pop-up

- Publique

- potencial

- poder

- práticas

- visualização

- Diretor

- privado

- processo

- em processamento

- Produção

- Progresso

- fornecer

- fornecido

- fornecedores

- fornece

- público

- Python

- consultas

- questão

- Frequentes

- rapidamente

- R

- Leia

- registros

- reduzir

- redução

- referir

- Independentemente

- região

- regiões

- relevante

- remover

- requeridos

- Recursos

- resposta

- Resultados

- passeios

- Tipo

- papéis

- Rota

- Execute

- corrida

- é executado

- sábio

- Scala

- AMPLIAR

- escalável

- Escala

- dimensionamento

- cenários

- Ciência

- cientistas

- Sdk

- pesquisar

- Segredo

- segurança

- Vejo

- selecionar

- senior

- serviço

- Serviços

- conjunto

- instalação

- mostrar

- mostrou

- simples

- simplificar

- solteiro

- So

- solução

- Soluções

- fonte

- Faísca

- especialista

- especializando

- velocidade

- SQL

- pilha

- Pilhas

- começo

- começado

- Comece

- Status

- Passo

- Passos

- armazenamento

- franco

- estudo

- sub-redes

- tal

- Sobrecarregar

- certo

- .

- mesa

- tomado

- toma

- Tecnologias

- Tecnologia

- modelo

- texto

- que

- A

- deles

- Eles

- então

- deles

- De terceiros

- isto

- pensamento

- Através da

- tempo

- linha do tempo

- titã

- para

- ferramentas

- topo

- tradicional

- ui

- para

- destravar

- Atualizada

- URL

- usar

- caso de uso

- usava

- Utilizador

- usuários

- usos

- utilização

- valor

- variedade

- vário

- Grande

- visualizar

- Caminho..

- maneiras

- we

- web

- serviços web

- Web-Based

- quando

- qual

- enquanto

- precisarão

- de

- dentro

- sem

- Atividades:

- trabalhar

- trabalho

- no mundo todo

- escrever

- escrito

- anos

- Iorque

- Você

- investimentos

- zefirnet