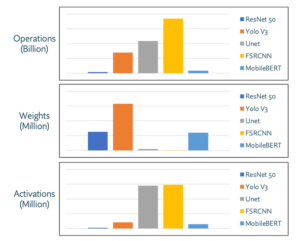

A verdade é que estamos apenas no início da revolução da Inteligência Artificial (IA). As capacidades da IA só agora começam a mostrar pistas do que o futuro reserva. Por exemplo, os carros estão usando modelos de redes neurais grandes e complexos não apenas para compreender o ambiente, mas também para se dirigirem e se controlarem. Para qualquer aplicação deve haver dados de treinamento para criar redes úteis. O tamanho das operações de treinamento e de inferência está crescendo rapidamente à medida que dados úteis do mundo real são incorporados aos modelos. Vejamos o crescimento dos modelos nos últimos anos para entender como isso impulsiona as necessidades de poder de processamento para treinamento e inferência.

Em apresentação no Ansys 2021 Ideas Digital Forum, o vice-presidente de engenharia da Cerebras, Dhiraj Mallik, forneceu alguns insights sobre o crescimento dos modelos de redes neurais. Nos últimos dois anos, o tamanho do modelo cresceu 1000X, de BERT Base (110 MB) para GPT-3 (175 GB). E em breve está o modelo MSFT-1T, com tamanho de 1 TB. O modelo GPT-3 – que é um tópico interessante por si só – foi treinado com hardware convencional usando 1024 GPUs durante 4 meses. É um modelo de processamento de linguagem natural (PNL) que usa a maior parte dos dados de texto da Internet e de outras fontes. Ele foi desenvolvido pela Open AI e agora é a base do OpenAI Codex, que é um aplicativo que pode escrever código de programação útil em diversas linguagens a partir de instruções em linguagem simples dos usuários. O GPT-3 pode ser usado para escrever artigos curtos que a maioria dos leitores não consegue perceber que foram escritos por um programa de IA.

Como você pode ver acima, não é viável executar 1024 GPUs por 4 meses. Em sua palestra intitulada “Oferecendo aceleração AP sem precedentes: além da Lei de Moore”, Dhiraj afirma que os avanços necessários para apoiar esse nível de crescimento de semicondutores vão muito além do que estamos acostumados a ver com a Lei de Moore. Em resposta a essa necessidade percebida do mercado, a Cerebras lançou seu mecanismo de IA em escala wafer WSE-1 em 2019 – 56 vezes maior do que qualquer chip já produzido. Um ano e meio depois, eles anunciaram o WSE-2, novamente o maior chip já construído com:

- 6 trilhões de transistores

- 850,000 núcleos de IA otimizados

- 40 GB RAM

- Largura de banda de memória de 20 petabytes/s

- Largura de banda de malha de 220 petabytes

- Construído com o processo N7 da TSMC

- Um wafer contém 84 matrizes, cada uma com 550 mm2.

O sistema CS-2 que encapsula o WSE-2 pode ajustar modelos de IA com 120 trilhões de parâmetros. O que é ainda mais impressionante é que os sistemas CS-2 podem ser integrados em clusters de 192 unidades para fornecer ganhos de desempenho quase lineares. A Cerebras desenvolveu um subsistema de memória que desagrega memória e computação para fornecer melhor dimensionamento e rendimento aprimorado para modelos extremamente grandes. A Cerebras também desenvolveu otimizações para dispersão em conjuntos de treinamento, o que economiza tempo e energia.

A apresentação de Dhiraj dá mais detalhes sobre suas capacidades, especialmente na área de escalonamento eficiente com modelos maiores para manter o rendimento e a capacidade. Do ponto de vista dos semicondutores, também é interessante ver como a Cerebras analisou a queda de IR, a eletromigração e a aprovação de ESD em um projeto que é 2 ordens de magnitude maior do que qualquer outra tentativa já tentada pela indústria de semicondutores. Dhiraj fala sobre como em cada nível do design – bloco, bloco e wafer completo – a Cerebras usou o Ansys RedHawk-SC em várias CPUs para sinalização de queda de IR estática e dinâmica. RedHawk-SC também foi usado para verificações de eletromigração de potência e eletromigração de sinal. Da mesma forma, eles usaram o Ansys Pathfinder para verificações de resistência ESD e densidade de corrente.

Com um pedaço de silício tão grande, de 7 nm, as decisões da ferramenta são literalmente “tudo ou nada”. Construir um silício tão disruptivo requer muitas escolhas muito bem ponderadas no processo de desenvolvimento, e uma capacidade incomparável é, obviamente, uma preocupação primária. No entanto, como a apresentação de Dhiraj mostra claramente, o nível de maior poder de processamento do CS-2 é necessário para gerir a taxa de crescimento que vemos nos modelos de IA/ML. Sem dúvida veremos inovações que estão além da nossa imaginação hoje no campo da IA. Tal como a web e a nuvem alteraram a tecnologia e até mesmo a sociedade, podemos esperar que o desenvolvimento de novas tecnologias de IA mude o nosso mundo de forma dramática. Se você estiver interessado em aprender mais sobre o silício Cerebras, dê uma olhada na apresentação de Dhiraj no Ansys IDEAS Digital Forum em www.ansys.com/ideas.

Compartilhe esta postagem via: Fonte: https://semiwiki.com/eda/303587-neural-network-growth-requires-unprecedented-semiconductor-scaling/

- 000

- 110

- 2019

- 2021

- 84

- AI

- anunciou

- Aplicação

- ÁREA

- artigos

- Prédio

- Capacidade

- carros

- alterar

- Cheques

- lasca

- Na nuvem

- código

- Atual

- dados,

- Design

- detalhe

- Desenvolvimento

- digital

- Cair

- Engenharia

- Meio Ambiente

- tecidos

- caber

- cheio

- futuro

- GPUs

- Crescente

- Growth

- Hardware

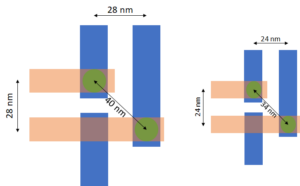

- Como funciona o dobrador de carta de canal

- HTTPS

- indústria

- Internet

- IT

- língua

- Idiomas

- grande

- Escritórios de

- aprendizagem

- Nível

- Maioria

- mercado

- modelo

- mês

- Linguagem Natural

- Processamento de linguagem natural

- Perto

- rede

- redes

- Neural

- rede neural

- PNL

- aberto

- OpenAI

- Operações

- ordens

- Outros

- atuação

- perspectiva

- poder

- Produzido

- Agenda

- Programação

- leitores

- resposta

- corrida

- Escala

- escala ai

- dimensionamento

- Semicondutor

- Baixo

- Tamanho

- Sociedade

- ajuda

- .

- sistemas

- negociações

- Equipar

- O Futuro

- tempo

- Training

- usuários

- web

- O que é a

- mundo

- ano

- anos