Robolawyer. Crédito: Midjourney

Se você lê meu trabalho, provavelmente sabe que publico meus artigos em primeiro lugar no meu boletim de notícias de IA, A ponte algorítmica. O que você talvez não saiba é que todos os domingos publico uma coluna especial que chamo de “o que você pode ter perdido”, onde repasso tudo o que aconteceu durante a semana com análises que ajudam você a entender as notícias.

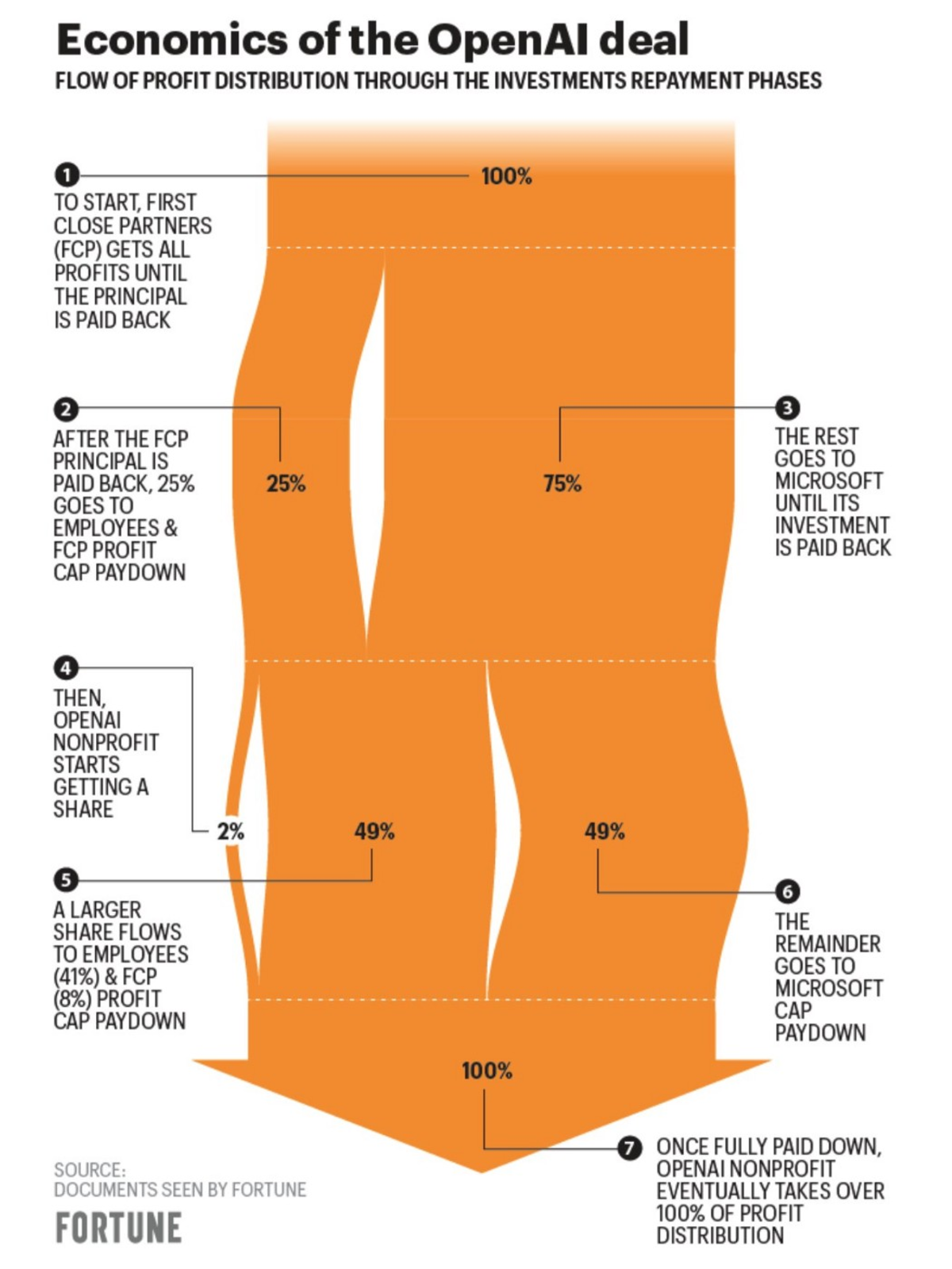

Acordo de US$ 10 bilhões entre Microsoft e OpenAI

Semafor reportado há duas semanas que, se tudo correr conforme o planejado, a Microsoft fechará um acordo de investimento de $ 10 bilhões com a OpenAI antes do final de janeiro (Satya Nadella, CEO da Microsoft, anunciou o parceria estendida oficialmente na segunda-feira).

Houve algumas informações erradas sobre o acordo que implicavam que os executivos da OpenAI não tinham certeza sobre a viabilidade da empresa a longo prazo. No entanto, depois foi esclarecido que o negócio é assim:

Crédito: Fortune

Leo L'Orange, que escreve The Neuron, explica que “uma vez que $ 92 bilhões em lucro mais $ 13 bilhões em investimento inicial são reembolsados à Microsoft e uma vez que os outros investidores de risco ganham $ 150 bilhões, todo o patrimônio reverte para a OpenAI”.

As pessoas estão divididas. Alguns dizem que o negócio é “legal” ou “interessante”, enquanto outros dizem que é “estranho” e “maluco”. O que percebo com meus olhos não especialistas é que OpenAI e Sam Altman do confiança (alguns diriam confiar demais) a capacidade de longo prazo da empresa para atingir seus objetivos.

No entanto, como Will Knight escreve para a WIRED, “não está claro quais produtos podem ser construídos com base na tecnologia”. A OpenAI deve descobrir um modelo de negócios viável em breve.

Alterações no ChatGPT: novos recursos e monetização

OpenAI atualizado ChatGPT em 9 de janeiro (da atualização anterior em 15 de dezembro). Agora o chatbot tem “factualidade melhorada” e você pode pará-lo no meio da geração.

Eles também estão trabalhando em uma “versão profissional do ChatGPT” (que, segundo rumores, sairá em $ 42 / mês) como presidente da OpenAI Greg Brockman anunciou em 11 de janeiro. Estas são as três principais características:

“Sempre disponível (sem janelas blackout).

Respostas rápidas do ChatGPT (ou seja, sem limitação).

Quantas mensagens você precisar (pelo menos 2 vezes o limite diário regular).”

Para se inscrever na lista de espera, você deve Preencher um formulário onde eles te perguntam, entre outras coisas, quanto você estaria disposto a pagar (e quanto seria demais).

Se você planeja levar isso a sério, considere aprofundar a pilha de produtos da OpenAI com o Repositório de livro de receitas OpenAI. Bojan Tunguz disse que é “o principal repositório de tendências no GitHub este mês.” Sempre um bom sinal.

ChatGPT, o falso cientista

O ChatGPT entrou no domínio científico. Kareem Carr postou uma captura de tela na quinta-feira de um artigo do qual o ChatGPT é co-autor.

Mas por que, já que o ChatGPT é uma ferramenta? “As pessoas estão começando a tratar o ChatGPT como se fosse um site científico genuíno e bem credenciado. colaborador”, explica Gary Marcus em uma postagem Substack. “Cientistas, por favor, não deixem seus chatbots crescerem e se tornarem coautores”, ele implora.

Mais preocupantes são os casos em que não há divulgação do uso de IA. cientistas encontrei que eles não podem identificar de forma confiável resumos escritos por ChatGPT - seus tolos eloquentes até mesmo especialistas em seu campo. Como Sandra Wachter, que “estuda tecnologia e regulamentação” em Oxford, disse a Holly Else por um pedaço da natureza:

“Se agora estamos em uma situação em que os especialistas não são capazes de determinar o que é verdade ou não, perdemos o intermediário de que precisamos desesperadamente para nos guiar em tópicos complicados.”

O desafio do ChatGPT à educação

O ChatGPT foi banido em centros educacionais em todo o mundo (por exemplo, escolas públicas de Nova York, Universidades australianas e Palestrantes do Reino Unido estão pensando nisso). Como argumentei em um ensaio anterior, não acho que esta seja a decisão mais sábia, mas apenas uma reação devido ao despreparo para o rápido desenvolvimento da IA generativa.

Kevin Roose, do NYT, argumenta que “o potencial [do ChatGPT] como uma ferramenta educacional supera seus riscos”. Terence Tao, o grande matemático, concorda: “No longo prazo, parece inútil lutar contra isso; talvez o que nós, como professores, precisamos fazer é mudar para um modo de exame de “livros abertos, IA aberta”.

Pistilos de Jade, o principal especialista em ética da Hugging Face, explica o desafio que as escolas enfrentam com o ChatGPT:

“Infelizmente, o sistema educacional parece forçado a se adaptar a essas novas tecnologias. Acho compreensível como reação, já que pouco se tem feito para antecipar, mitigar ou elaborar soluções alternativas para contornar os possíveis problemas decorrentes. As tecnologias disruptivas geralmente exigem educação do usuário porque não podem simplesmente ser lançadas contra as pessoas de forma incontrolável”.

Essa última frase captura perfeitamente onde surge o problema e onde está a solução potencial. Temos que fazer um esforço extra para educar os usuários sobre como essa tecnologia funciona e o que é possível e não fazer com eles. Essa é a abordagem adotada pela Catalunha. Como Relatório Francesc Bracero e Carina Farreras para La Vanguardia:

“Na Catalunha, o Departamento de Educação não vai proibir 'em todo o sistema e para todos, pois seria uma medida ineficaz'. Segundo fontes do ministério, é melhor pedir aos centros que eduquem no uso da IA, 'que pode trazer muito conhecimento e vantagens'”.

O melhor amigo do aluno: um banco de dados de erros do ChatGPT

Gary Marcus e Ernest Davis criaram um “rastreador de erros” para capturar e classificar os erros de modelos de linguagem como o ChatGPT (aqui está mais informação sobre por que eles estão compilando este documento e o que planejam fazer com ele).

O banco de dados é público e qualquer pessoa pode participar. É um ótimo recurso que permite um estudo rigoroso de como esses modelos se comportam mal e como as pessoas podem evitar o uso indevido. Aqui está um exemplo hilário de por que isso é importante:

A OpenAI está ciente disso e quer combater a desinformação: “Prevendo possíveis usos indevidos de modelos de linguagem para campanhas de desinformação - e como reduzir o risco. "

Novas informações

Sam Altman sugeriu em um atraso no lançamento do GPT-4 em uma conversa com Connie Loizos, o editor do Vale do Silício no TechCrunch. Altman disse que “em geral, vamos liberar a tecnologia muito mais lentamente do que as pessoas gostariam. Vamos ficar sentados nisso por muito mais tempo…” Esta é a minha opinião:

(Altman também disse que há um modelo de vídeo em andamento!)

Desinformação sobre GPT-4

Há uma reivindicação “GPT-4 = 100T” que se tornou viral em todas as mídias sociais (eu a vi principalmente no Twitter e no LinkedIn). Caso você não tenha visto, é assim:

Ou isto:

Todos são versões ligeiramente diferentes da mesma coisa: um gráfico visual atraente que chama a atenção e um forte gancho com a comparação GPT-4/GPT-3 (eles usam GPT-3 como um proxy para ChatGPT).

Acho que compartilhar rumores e especulações e enquadrá-los como tal é bom (Eu me sinto parcialmente responsável por isso), mas postar informações não verificáveis com tom autoritário e sem referências é repreensível.

As pessoas que fazem isso não estão longe de serem tão inúteis e perigosas quanto o ChatGPT como fontes de informação - e com incentivos muito mais fortes para continuar fazendo isso. Cuidado com isso porque vai poluir todos os canais de informação sobre IA daqui para frente.

Um advogado robô

Joshua Browder, CEO da DoNotPay, postou isso em 9 de janeiro:

Como não poderia deixar de ser, esta afirmação ousada gerou muito debate a ponto de o Twitter sinalizar o tweet com um link para o página do Supremo Tribunal de itens proibidos.

Mesmo que finalmente não possam fazê-lo por motivos legais, vale a pena considerar a questão do ponto de vista ético e social. O que acontece se o sistema de IA cometer um erro grave? Poderia pessoas sem acesso para um advogado se beneficiar de uma versão madura dessa tecnologia?

O litígio contra a Stable Diffusion já começou

Mateus Butterick publicado em 13 de janeiro:

“Em nome de três maravilhosos queixosos de artistas - Sarah Andersen, Kelly McKernan e Karla Ortiz — entramos com uma ação coletiva contra IA de estabilidade, DeviantArt e meio da jornada para seu uso Difusão estável, uma ferramenta de colagem do século 21 que remixa as obras protegidas por direitos autorais de milhões de artistas cujo trabalho foi usado como dados de treinamento.”

Começa — os primeiros passos no que promete ser uma longa luta para moderar o treinamento e o uso da IA generativa. Concordo com a motivação: “A IA precisa ser justa e ética para todos”.

Mas, como muitos outros, encontrei imprecisões na postagem do blog. Ele se aprofunda nos aspectos técnicos da difusão estável, mas falha em explicar corretamente alguns bits. Se isso é intencional como um meio de preencher a lacuna técnica para pessoas que não sabem - e não têm tempo para aprender - sobre como essa tecnologia funciona (ou como um meio de caracterizar a tecnologia de uma forma que os beneficie ) ou um erro está aberto à especulação.

eu argumentei em um artigo anterior que agora o choque entre a arte da IA e os artistas tradicionais é fortemente emocional. As respostas a este processo não serão diferentes. Teremos que esperar que os juízes decidam o resultado.

CNET publicando artigos gerados por IA

Futurismo relatado isso algumas semanas atrás:

"CNET, um canal de notícias de tecnologia extremamente popular, vem empregando silenciosamente a ajuda da “tecnologia de automação” – um eufemismo estilístico para IA – em uma nova onda de artigos explicativos financeiros.”

Gael Breton, que primeiro viu isso, escreveu uma análise mais profunda na sexta-feira. Ele explica que o Google não parece estar atrapalhando o tráfego para essas postagens. “O conteúdo de IA está ok agora?” ele pergunta.

Acho que é uma decisão da CNET divulgar totalmente o uso de IA em seus artigos um bom precedente. Quantas pessoas estão publicando conteúdo agora usando IA sem divulgá-lo? No entanto, a consequência é que as pessoas podem perder seus empregos se isso der certo (como eu e muitos outros, previsto). já está acontecendo:

Concordo plenamente com este Tweet de Santiago:

RLHF para geração de imagens

Se o aprendizado por reforço por meio de feedback humano funciona para modelos de linguagem, por que não para texto para imagem? Isso é o que PickaPic está tentando alcançar.

A demonstração é para fins de pesquisa, mas pode ser uma adição interessante ao Stable Diffusion ou DALL-E (Midjourney faz algo semelhante - eles orientam internamente o modelo para produzir imagens bonitas e artísticas).

Uma receita para “tornar a Siri/Alexa 10x melhor”

Receitas que misturam diferentes modelos generativos de IA para criar alguns melhores do que a soma das partes:

alberto romero é um escritor freelance que se concentra em tecnologia e IA. Ele escreve A ponte algorítmica, um boletim informativo que ajuda pessoas não técnicas a entender notícias e eventos sobre IA. Ele também é analista de tecnologia na CambrianAI, onde se especializou em grandes modelos de linguagem.

Óptimo estado. Original. Republicado com permissão.

- Conteúdo com tecnologia de SEO e distribuição de relações públicas. Seja amplificado hoje.

- Platoblockchain. Inteligência Metaverso Web3. Conhecimento Ampliado. Acesse aqui.

- Fonte: https://www.kdnuggets.com/2023/02/chatgpt-gpt4-generative-ai-news.html?utm_source=rss&utm_medium=rss&utm_campaign=chatgpt-gpt-4-and-more-generative-ai-news

- 11

- 7

- 9

- a

- habilidade

- Capaz

- Sobre

- sobre isso

- resumos

- Segundo

- Alcançar

- em

- adaptar

- Adição

- vantagens

- contra

- AI

- arte ai

- algorítmico

- Todos os Produtos

- permite

- já

- alternativa

- sempre

- entre

- análise

- analista

- e

- anunciou

- antecipar

- qualquer um

- atraente

- abordagem

- Arte

- artigos

- artístico

- Artistas

- por WhatsApp.

- disponível

- em caminho duplo

- banido

- bonita

- Porque

- antes

- ser

- beneficiar

- Benefícios

- MELHOR

- Melhor

- entre

- Cuidado

- bilhão

- Blog

- pino

- Livros

- PONTE

- construído

- negócio

- modelo de negócio

- chamada

- Campanhas

- não podes

- capturar

- capturas

- casas

- casos

- Centros

- Chefe executivo

- desafiar

- Canal

- caracterizar

- chatbot

- chatbots

- ChatGPT

- reivindicar

- Choque

- classificar

- Fechar

- CNET

- Coautor

- Coluna

- COM

- Empresa

- comparação

- complicado

- Considerar

- considerando

- conteúdo

- Conversa

- poderia

- Casal

- Tribunal de

- crio

- crédito

- diariamente

- dall's

- Perigoso

- dados,

- banco de dados

- Davis

- acordo

- decisão

- profundo

- mais profunda

- atraso

- Demanda

- Departamento

- Determinar

- Desenvolvimento

- diferente

- Distribuição

- Divulgar

- Divulgando

- divulgação

- desinformação

- disruptivo

- dividido

- documento

- Não faz

- fazer

- domínio

- não

- durante

- ganhar

- editor

- educar

- Educação

- educacional

- esforço

- Elaborar

- entrou

- Todo

- equidade

- erros

- Éter (ETH)

- considerações éticas

- Mesmo

- eventos

- Cada

- todos

- tudo

- exemplo

- Executivos

- especialistas

- Explicação

- Explica

- extra

- Olhos

- Rosto

- falha

- feira

- falsificação

- RÁPIDO

- Funcionalidades

- retornos

- campo

- lutar

- Figura

- Finalmente

- financeiro

- Encontre

- Primeiro nome

- primeiros passos

- bandeiras

- concentra-se

- principal

- para a frente

- encontrado

- freelance

- amigos

- da

- totalmente

- lacuna

- Gary

- Geral

- generativo

- IA generativa

- GitHub

- dado

- globo

- Go

- Objetivos

- vai

- vai

- Bom estado, com sinais de uso

- gráfico

- ótimo

- Cresça:

- guia

- aconteceu

- acontece

- ajudar

- ajuda

- hilário

- Como funciona o dobrador de carta de canal

- Como Negociar

- Contudo

- HTML

- HTTPS

- humano

- identificar

- imagem

- imagens

- implícita

- in

- incentivos

- info

- INFORMAÇÕES

- do estado inicial,

- Intencional

- interessante

- internamente

- investimento

- Investidores

- IT

- Jan

- janeiro

- Empregos

- KDnuggetsGenericName

- Guarda

- Cavaleiro

- Saber

- Conhecimento

- língua

- grande

- Sobrenome

- ação judicial

- advogado

- APRENDER

- aprendizagem

- Legal

- LIMITE

- LINK

- longo

- longo prazo

- OLHARES

- perder

- lote

- a Principal

- fazer

- FAZ

- muitos

- muitas pessoas

- Marcus

- massivamente

- Matéria

- maduro

- significa

- a medida

- Mídia

- média

- apenas

- mensagens

- Microsoft

- Meio da Jornada

- ministério

- Desinformação

- erro

- Mitigar

- Moda

- modelo

- modelos

- Segunda-feira

- mais

- Motivação

- mover

- Natureza

- você merece...

- Cria

- Novo

- Novos Recursos

- Novas tecnologias

- notícias

- Notícias e Eventos

- Newsletter

- não técnico

- Oficialmente

- OK

- aberto

- OpenAI

- Outros

- Outros

- de outra forma

- Resultado

- Oxford

- Papel

- participar

- peças

- Pagar

- Pessoas

- possivelmente

- permissão

- peça

- plano

- platão

- Inteligência de Dados Platão

- PlatãoData

- pleiteia

- por favor

- mais

- ponto

- Popular

- possível

- Publique

- publicado

- POSTAGENS

- potencial

- Precedente

- anterior

- Diretor

- provavelmente

- Problema

- problemas

- Produto

- Produtos

- Lucro

- proibir

- promessas

- fornecer

- procuração

- público

- publicar

- Publishing

- fins

- questão

- silenciosamente

- reação

- Leia

- razões

- receita

- reduzir

- referências

- regular

- aprendizagem de reforço

- liberar

- pesquisa

- recurso

- responsável

- resultando

- rever

- rigoroso

- riscos

- robô

- Rumores

- Dito

- Sam

- mesmo

- Satya Nadella

- Escolas

- parece

- semáforo

- sentido

- sentença

- grave

- conjunto

- compartilhando

- rede de apoio social

- assinar

- Silício

- Vale do Silício

- semelhante

- simplesmente

- desde

- situação

- ligeiramente diferente

- Lentamente

- Redes Sociais

- meios de comunicação social

- solução

- Soluções

- alguns

- algo

- Em breve

- Fontes

- especial

- especializada

- especulação

- estável

- pilha

- Comece

- Passos

- Dê um basta

- mais forte,

- mais forte

- discordaram

- Estudo

- tal

- .

- Tire

- tecnologia

- notícias de tecnologia

- TechCrunch

- Dados Técnicos:

- Tecnologias

- Tecnologia

- A

- deles

- coisa

- coisas

- Pensando

- três

- Através da

- tempo

- para

- TOM

- também

- ferramenta

- topo

- Temas

- tradicional

- tráfego

- Training

- tratar

- trending

- verdadeiro

- Confiança

- Tweet

- typeform

- compreensível

- Atualizar

- Atualizada

- us

- usar

- Utilizador

- usuários

- Vale

- risco

- versão

- viabilidade

- viável

- Vídeo

- esperar

- Onda

- semana

- semanas

- O Quê

- se

- qual

- QUEM

- precisarão

- disposto

- Windows

- sem

- Atividades:

- trabalhar

- trabalho

- Equivalente há

- seria

- escritor

- escrito

- investimentos

- zefirnet