As aplicações generativas de inteligência artificial (IA) construídas em torno de grandes modelos de linguagem (LLMs) demonstraram o potencial para criar e acelerar valor económico para as empresas. Exemplos de aplicações incluem pesquisa conversacional, assistência ao agente de suporte ao cliente, análise de suporte ao cliente, assistentes virtuais de autoatendimento, chatbots, geração de rich media, moderação de conteúdo, companheiros de codificação para acelerar o desenvolvimento de software seguro e de alto desempenho, insights mais profundos de fontes de conteúdo multimodal, aceleração das investigações e mitigações de segurança da sua organização, e muito mais. Muitos clientes procuram orientação sobre como gerenciar a segurança, a privacidade e a conformidade à medida que desenvolvem aplicativos generativos de IA. Compreender e abordar as vulnerabilidades, ameaças e riscos do LLM durante as fases de design e arquitetura ajuda as equipes a se concentrarem na maximização dos benefícios econômicos e de produtividade que a IA generativa pode trazer. Estar ciente dos riscos promove a transparência e a confiança em aplicações generativas de IA, incentiva uma maior observabilidade, ajuda a cumprir os requisitos de conformidade e facilita a tomada de decisões informadas pelos líderes.

O objetivo desta postagem é capacitar engenheiros de IA e aprendizado de máquina (ML), cientistas de dados, arquitetos de soluções, equipes de segurança e outras partes interessadas a terem um modelo mental comum e uma estrutura para aplicar as melhores práticas de segurança, permitindo que as equipes de IA/ML se movam rápido, sem trocar segurança por velocidade. Especificamente, esta postagem busca ajudar cientistas de IA/ML e de dados que podem não ter tido exposição anterior aos princípios de segurança a obter uma compreensão das principais práticas recomendadas de segurança e privacidade no contexto do desenvolvimento de aplicativos generativos de IA usando LLMs. Também discutimos preocupações comuns de segurança que podem minar a confiança na IA, conforme identificadas pelo Top 10 do Open Worldwide Application Security Project (OWASP) para aplicativos LLMe mostre maneiras de usar a AWS para aumentar sua postura de segurança e confiança enquanto inova com IA generativa.

Esta postagem fornece três etapas guiadas para arquitetar estratégias de gerenciamento de risco durante o desenvolvimento de aplicativos generativos de IA usando LLMs. Primeiro nos aprofundamos nas vulnerabilidades, ameaças e riscos que surgem da implementação, implantação e uso de soluções LLM e fornecemos orientação sobre como começar a inovar com a segurança em mente. Em seguida, discutiremos como construir uma base segura é essencial para a IA generativa. Por fim, conectamos isso com um exemplo de carga de trabalho LLM para descrever uma abordagem para arquitetura com segurança de defesa profunda através dos limites de confiança.

No final desta postagem, Engenheiros de IA/ML, cientistas de dados e tecnólogos preocupados com segurança serão capazes de identificar estratégias para arquitetar defesas em camadas para seus aplicativos generativos de IA, entender como mapear as preocupações de segurança do OWASP Top 10 para LLMs para alguns controles correspondentes e construir conhecimento fundamental para respondendo aos seguintes principais temas de perguntas de clientes da AWS para seus aplicativos:

- Quais são alguns dos riscos comuns de segurança e privacidade associados ao uso de IA generativa baseada em LLMs em meus aplicativos que posso causar maior impacto com esta orientação?

- Quais são algumas maneiras de implementar controles de segurança e privacidade no ciclo de vida de desenvolvimento para aplicativos generativos de AI LLM na AWS?

- Quais melhores práticas operacionais e técnicas posso integrar na forma como minha organização cria aplicativos generativos de AI LLM para gerenciar riscos e aumentar a confiança em aplicativos generativos de IA usando LLMs?

Melhore os resultados de segurança enquanto desenvolve IA generativa

A inovação com IA generativa usando LLMs exige começar com a segurança em mente para desenvolver resiliência organizacional, construir sobre uma base segura e integrar a segurança com uma abordagem de defesa em profundidade. Segurança é um responsabilidade compartilhada entre AWS e clientes da AWS. Todos os princípios do modelo de responsabilidade compartilhada da AWS são aplicáveis a soluções generativas de IA. Atualize sua compreensão do modelo de responsabilidade compartilhada da AWS conforme ele se aplica à infraestrutura, aos serviços e aos dados ao criar soluções LLM.

Comece com a segurança em mente para desenvolver resiliência organizacional

Comece com a segurança em mente para desenvolver resiliência organizacional para desenvolver aplicativos generativos de IA que atendam aos seus objetivos de segurança e conformidade. A resiliência organizacional baseia-se e amplia o definição de resiliência no AWS Well-Architected Framework incluir e preparar-se para a capacidade de uma organização se recuperar de interrupções. Considere sua postura de segurança, governança e excelência operacional ao avaliar a prontidão geral para desenvolver IA generativa com LLMs e sua resiliência organizacional a quaisquer impactos potenciais. À medida que a sua organização avança no uso de tecnologias emergentes, como IA generativa e LLMs, a resiliência organizacional geral deve ser considerada como a pedra angular de uma estratégia defensiva em camadas para proteger ativos e linhas de negócios contra consequências indesejadas.

A resiliência organizacional é substancialmente importante para aplicações LLM

Embora todos os programas de gestão de riscos possam beneficiar da resiliência, a resiliência organizacional é substancialmente importante para a IA generativa. Cinco dos 10 principais riscos identificados pelo OWASP para aplicações LLM dependem da definição de controles arquitetônicos e operacionais e da sua aplicação em escala organizacional para gerenciar riscos. Estes cinco riscos são o tratamento inseguro dos resultados, as vulnerabilidades da cadeia de abastecimento, a divulgação de informações sensíveis, a agência excessiva e o excesso de confiança. Comece a aumentar a resiliência organizacional socializando suas equipes para considerar a IA, o ML e a segurança de IA generativa um requisito central do negócio e uma prioridade máxima ao longo de todo o ciclo de vida do produto, desde o início da ideia, passando pela pesquisa, até o desenvolvimento, implantação e implementação do aplicativo. usar. Além da conscientização, suas equipes devem tomar medidas para levar em conta a IA generativa nas práticas de governança, garantia e validação de conformidade.

Crie resiliência organizacional em torno da IA generativa

As organizações podem começar a adotar maneiras de desenvolver suas capacidades e capacidades para IA/ML e segurança de IA generativa em suas organizações. Você deve começar estendendo seus programas existentes de segurança, garantia, conformidade e desenvolvimento para levar em conta a IA generativa.

A seguir estão as cinco principais áreas de interesse para IA organizacional, ML e segurança de IA generativa:

- Entenda o cenário de segurança de IA/ML

- Incluir diversas perspectivas nas estratégias de segurança

- Tomar medidas proativas para garantir atividades de pesquisa e desenvolvimento

- Alinhe incentivos com resultados organizacionais

- Prepare-se para cenários de segurança realistas em IA/ML e IA generativa

Desenvolva um modelo de ameaça em todo o seu ciclo de vida de IA generativo

As organizações que constroem com IA generativa devem concentrar-se na gestão de riscos, e não na eliminação de riscos, e incluir modelagem de ameaças dentro e planejamento de continuidade de negócios o planejamento, desenvolvimento e operações de cargas de trabalho generativas de IA. Trabalhe retroativamente a partir do uso de produção de IA generativa, desenvolvendo um modelo de ameaça para cada aplicativo usando riscos de segurança tradicionais, bem como riscos específicos de IA generativa. Alguns riscos podem ser aceitáveis para o seu negócio, e um exercício de modelagem de ameaças pode ajudar a sua empresa a identificar qual é o seu apetite aceitável pelo risco. Por exemplo, sua empresa pode não exigir 99.999% de tempo de atividade em um aplicativo de IA generativo, portanto, o tempo de recuperação adicional associado à recuperação usando Backup da AWS de Geleira Amazon S3 pode ser um risco aceitável. Por outro lado, os dados no seu modelo podem ser extremamente sensíveis e altamente regulamentados, portanto, o desvio de Serviço de gerenciamento de chaves AWS (AWS KMS) chave gerenciada pelo cliente (CMK) rotação e uso de Firewall de rede AWS ajudar a aplicar o Transport Layer Security (TLS) para o tráfego de entrada e saída para proteger contra a exfiltração de dados pode ser um risco inaceitável.

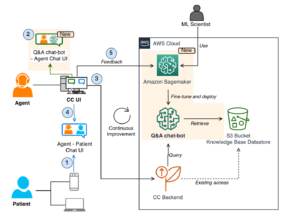

Avalie os riscos (inerentes versus residuais) do uso do aplicativo generativo de IA em um ambiente de produção para identificar os controles básicos e no nível do aplicativo corretos. Planeje a reversão e a recuperação de eventos de segurança de produção e interrupções de serviço, como injeção imediata, envenenamento de dados de treinamento, negação de serviço de modelo e roubo de modelo desde o início, e defina as mitigações que você usará ao definir os requisitos do aplicativo. Aprender sobre os riscos e controlos que precisam de ser implementados ajudará a definir a melhor abordagem de implementação para construir uma aplicação de IA generativa e fornecerá às partes interessadas e aos decisores informações para tomarem decisões de negócios informadas sobre o risco. Se você não estiver familiarizado com o fluxo de trabalho geral de IA e ML, comece revisando 7 maneiras de melhorar a segurança de suas cargas de trabalho de aprendizado de máquina para aumentar a familiaridade com os controles de segurança necessários para sistemas tradicionais de IA/ML.

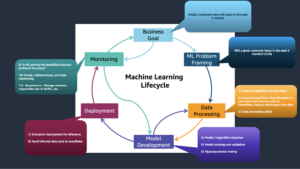

Assim como construir qualquer aplicativo de ML, construir um aplicativo de IA generativo envolve passar por um conjunto de estágios do ciclo de vida de pesquisa e desenvolvimento. Você pode querer revisar o Matriz de escopo de segurança de IA generativa da AWS para ajudar a construir um modelo mental para compreender as principais disciplinas de segurança que você deve considerar, dependendo da solução de IA generativa selecionada.

As aplicações de IA generativa que usam LLMs são normalmente desenvolvidas e operadas seguindo etapas ordenadas:

- Requisitos de aplicação – Identificar objetivos de negócios, requisitos e critérios de sucesso do caso de uso

- Seleção de modelos – Selecione um modelo básico que se alinhe aos requisitos do caso de uso

- Adaptação e ajuste fino do modelo – Prepare dados, projete prompts e ajuste o modelo

- Avaliação de modelo – Avalie modelos básicos com métricas específicas de caso de uso e selecione o modelo de melhor desempenho

- Implantação e integração – Implante o modelo básico selecionado em sua infraestrutura otimizada e integre-o com seu aplicativo generativo de IA

- Monitoramento de aplicativos – Monitore o desempenho do aplicativo e do modelo para permitir a análise da causa raiz

Garanta que as equipes entendam a natureza crítica da segurança como parte das fases de design e arquitetura do seu ciclo de vida de desenvolvimento de software no primeiro dia. Isso significa discutir a segurança em cada camada de sua pilha e ciclo de vida e posicionar a segurança e a privacidade como facilitadores para alcançar os objetivos de negócios. Arquitete os controles de ameaças antes de lançar seu aplicativo LLM e considere se os dados e as informações que você usará para adaptação e ajuste do modelo justificam a implementação de controles nos ambientes de pesquisa, desenvolvimento e treinamento. Como parte dos testes de garantia de qualidade, introduza ameaças sintéticas à segurança (como tentativa de envenenar dados de treinamento ou tentativa de extrair dados confidenciais por meio de engenharia de alerta maliciosa) para testar regularmente suas defesas e postura de segurança.

Além disso, as partes interessadas devem estabelecer uma cadência de revisão consistente para cargas de trabalho de IA de produção, ML e IA generativa e definir a prioridade organizacional na compreensão das compensações entre o controle humano e da máquina e os erros antes do lançamento. Validar e garantir que estas compensações sejam respeitadas nas aplicações LLM implementadas aumentará a probabilidade de sucesso na mitigação de riscos.

Crie aplicativos generativos de IA em bases seguras de nuvem

Na AWS, a segurança é nossa principal prioridade. A AWS foi projetada para ser a infraestrutura de nuvem global mais segura para criar, migrar e gerenciar aplicativos e cargas de trabalho. Isso é apoiado por nosso amplo conjunto de mais de 300 ferramentas de segurança em nuvem e pela confiança de nossos milhões de clientes, incluindo as organizações mais sensíveis à segurança, como governo, saúde e serviços financeiros. Ao criar aplicativos generativos de IA usando LLMs na AWS, você obtém benefícios de segurança do ambiente de computação em nuvem AWS seguro, confiável e flexível.

Use uma infraestrutura global da AWS para segurança, privacidade e conformidade

Ao desenvolver aplicativos com uso intensivo de dados na AWS, você pode se beneficiar de uma infraestrutura de região global da AWS, projetada para fornecer recursos que atendam aos seus principais requisitos de segurança e conformidade. Isto é reforçado pela nossa Compromisso de soberania digital da AWS, nosso compromisso em oferecer a você o conjunto mais avançado de controles e recursos de soberania disponíveis na nuvem. Estamos empenhados em expandir nossas capacidades para permitir que você atenda às suas soberania digital necessidades, sem comprometer o desempenho, a inovação, a segurança ou a escala da Nuvem AWS. Para simplificar a implementação das melhores práticas de segurança e privacidade, considere usar projetos de referência e infraestrutura como recursos de código, como o Arquitetura de referência de segurança da AWS (AWS SRA) e os votos de Arquitetura de referência de privacidade da AWS (AWS PRA). Leia mais sobre arquitetando soluções de privacidade, soberania por design e conformidade na AWS e usar serviços como Configuração da AWS, Artefato AWS e Gerente de auditoria da AWS para atender às suas necessidades de privacidade, conformidade, auditoria e observabilidade.

Entenda sua postura de segurança usando AWS Well-Architected e Cloud Adoption Frameworks

A AWS oferece orientações de práticas recomendadas desenvolvidas a partir de anos de experiência apoiando clientes na arquitetura de seus ambientes de nuvem com o Estrutura bem arquitetada da AWS e na evolução para obter valor comercial das tecnologias de nuvem com o Estrutura de adoção da nuvem AWS (AWS CAF). Entenda a postura de segurança de suas cargas de trabalho de IA, ML e IA generativa realizando uma revisão do Well-Architected Framework. As revisões podem ser realizadas usando ferramentas como o Ferramenta AWS Well-Architected, ou com a ajuda de sua equipe da AWS por meio Suporte empresarial da AWS. A ferramenta AWS Well-Architected integra insights automaticamente da Consultor confiável da AWS para avaliar quais são as melhores práticas em vigor e quais oportunidades existem para melhorar a funcionalidade e a otimização de custos. A ferramenta AWS Well-Architected também oferece lentes personalizadas com práticas recomendadas específicas, como o Lente de aprendizado de máquina para que você avalie regularmente suas arquiteturas em relação às melhores práticas e identifique áreas de melhoria. Verifique sua jornada rumo à realização de valor e à maturidade da nuvem, entendendo como os clientes da AWS adotam estratégias para desenvolver capacidades organizacionais no Estrutura de adoção da nuvem AWS para inteligência artificial, aprendizado de máquina e IA generativa. Você também pode encontrar benefícios em compreender sua preparação geral para a nuvem participando de um Avaliação de preparação para a nuvem AWS. A AWS oferece oportunidades adicionais de engajamento – peça à sua equipe de conta da AWS mais informações sobre como começar a usar o Centro de inovação de IA generativa.

Acelere sua segurança e aprendizado de IA/ML com orientação, treinamento e certificação de práticas recomendadas

A AWS também seleciona recomendações de Práticas recomendadas para segurança, identidade e conformidade e Documentação de segurança da AWS para ajudá-lo a identificar maneiras de proteger seus ambientes operacionais, de treinamento, desenvolvimento e testes. Se você está apenas começando, aprofunde-se no treinamento e certificação de segurança, considere começar com Fundamentos de segurança da AWS e os votos de Plano de aprendizagem de segurança da AWS. Você também pode usar o Modelo de maturidade de segurança da AWS para ajudar a orientá-lo a encontrar e priorizar as melhores atividades em diferentes fases de maturidade na AWS, começando com ganhos rápidos, passando por estágios básicos, eficientes e otimizados. Depois que você e suas equipes tiverem um conhecimento básico de segurança na AWS, recomendamos fortemente a revisão Como abordar a modelagem de ameaças e depois conduzir um exercício de modelagem de ameaças com suas equipes, começando com o Workshop de modelagem de ameaças para construtores programa de treinamento. Existem muitos outros Recursos de treinamento e certificação de segurança da AWS disponível.

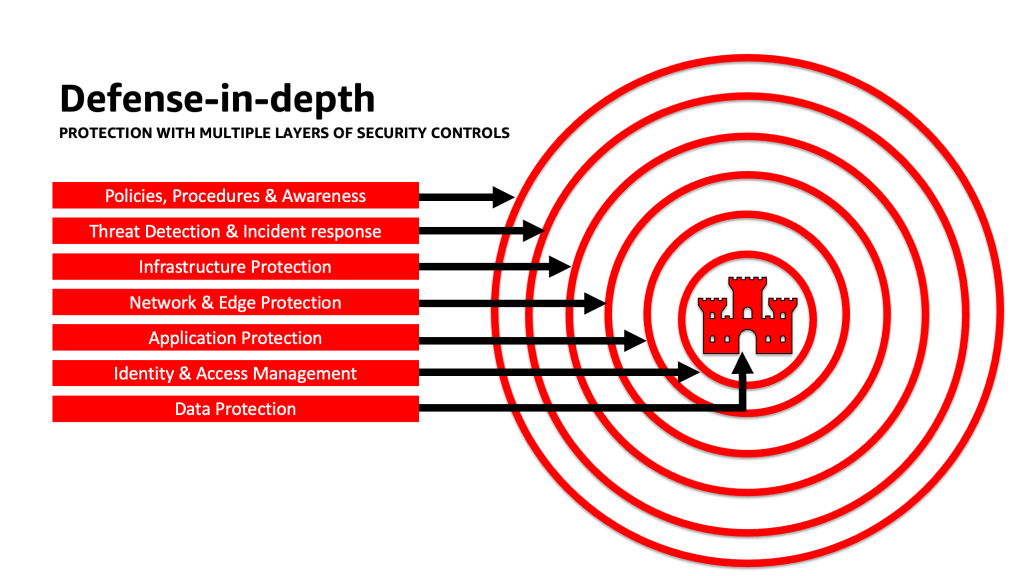

Aplique uma abordagem de defesa profunda para proteger aplicativos LLM

Aplicar uma abordagem de segurança de defesa profunda às suas cargas de trabalho, dados e informações generativas de IA pode ajudar a criar as melhores condições para atingir seus objetivos de negócios. As melhores práticas de segurança de defesa profunda atenuam muitos dos riscos comuns enfrentados por qualquer carga de trabalho, ajudando você e suas equipes a acelerar a inovação generativa de IA. Uma estratégia de segurança de defesa profunda usa diversas defesas redundantes para proteger suas contas, cargas de trabalho, dados e ativos da AWS. Isso ajuda a garantir que, se algum controle de segurança for comprometido ou falhar, existam camadas adicionais para ajudar a isolar ameaças e prevenir, detectar, responder e se recuperar de eventos de segurança. Você pode usar uma combinação de estratégias, incluindo serviços e soluções da AWS, em cada camada para melhorar a segurança e a resiliência de suas cargas de trabalho generativas de IA.

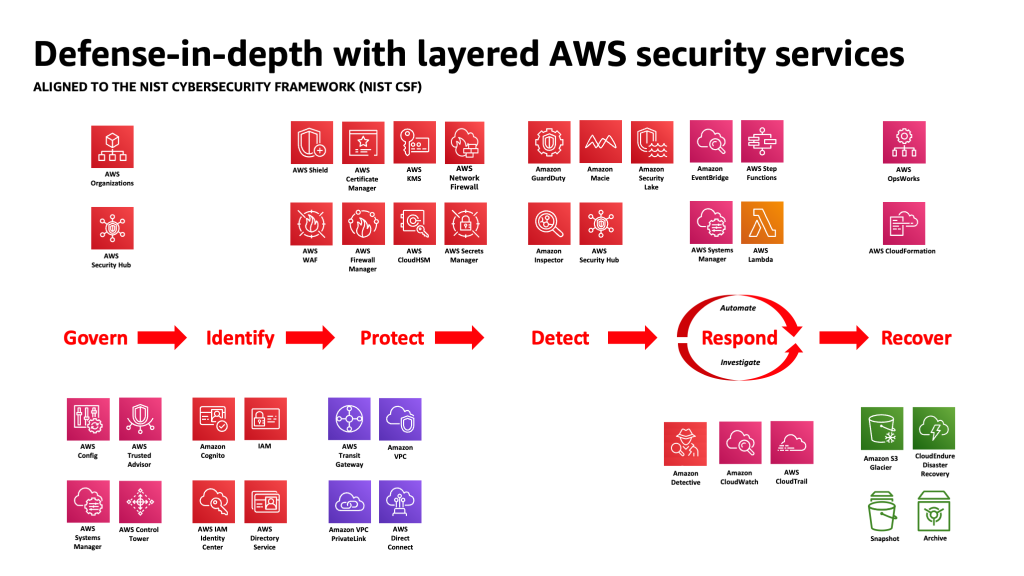

Muitos clientes da AWS alinham-se às estruturas padrão do setor, como o NIST Cybersecurity Framework. Essa estrutura ajuda a garantir que suas defesas de segurança tenham proteção nos pilares de Identificar, Proteger, Detectar, Responder, Recuperar e, mais recentemente, Governar. Essa estrutura pode então ser facilmente mapeada para serviços de segurança da AWS e também de terceiros integrados para ajudá-lo a validar cobertura e políticas adequadas para qualquer evento de segurança que sua organização encontrar.

Defesa em profundidade: proteja seu ambiente e, em seguida, adicione recursos aprimorados de segurança e privacidade específicos de IA/ML

Uma estratégia de defesa profunda deve começar protegendo primeiro suas contas e sua organização e, em seguida, adicionar recursos adicionais integrados de segurança e privacidade aprimorados de serviços como Rocha Amazônica e Amazon Sage Maker. Amazon tem mais de 30 serviços no portfólio de Segurança, Identidade e Conformidade que são integrados aos serviços de IA/ML da AWS e podem ser usados em conjunto para ajudar a proteger suas cargas de trabalho, contas e organização. Para se defender adequadamente contra o OWASP Top 10 for LLM, eles devem ser usados em conjunto com os serviços AWS AI/ML.

Comece implementando uma política de menor privilégio, usando serviços como Analisador de acesso do IAM para procure contas, funções e recursos excessivamente permissivos para restringir o acesso usando credenciais de curto prazo. Em seguida, certifique-se de que todos os dados em repouso sejam criptografados com AWS KMS, inclusive considerando o uso de CMKs, e que todos os dados e modelos tenham controle de versão e backup usando Serviço de armazenamento simples da Amazon (Amazon S3) versionamento e aplicação de imutabilidade em nível de objeto com Bloqueio de objeto do Amazon S3. Proteja todos os dados em trânsito entre serviços usando Gerenciador de certificados da AWS e / ou CA privada da AWSe mantê-lo dentro de VPCs usando AWS PrivateLink. Defina regras rígidas de entrada e saída de dados para ajudar a proteger contra manipulação e exfiltração usando VPCs com Firewall de rede AWS políticas. Considere inserir Firewall de aplicativos da Web da AWS (AWS WAF) Em frente a proteger aplicações web e APIs da bots maliciosos, Ataques de injeção de SQL, scripts entre sites (XSS), e aquisições de contas com Controle de Fraude. Registrando com AWS CloudTrail, Nuvem virtual privada da Amazon logs de fluxo (Amazon VPC) e Serviço Amazon Elastic Kubernetes Os registros de auditoria (Amazon EKS) ajudarão a fornecer análise forense de cada transação disponível para serviços como Detetive amazon. Você pode usar Inspetor da Amazônia para automatizar a descoberta e o gerenciamento de vulnerabilidades para Amazon Elastic Compute Nuvem (Amazon EC2) instâncias, contêineres, AWS Lambda funções e identifique a acessibilidade de rede de suas cargas de trabalho. Proteja seus dados e modelos contra atividades suspeitas usando Dever de guarda da Amazôniamodelos de ameaças e feeds de inteligência baseados em ML e habilitando seus recursos adicionais para proteção EKS, proteção ECS, proteção S3, proteção RDS, proteção contra malware, proteção Lambda e muito mais. Você pode usar serviços como Centro de segurança da AWS para centralizar e automatizar suas verificações de segurança para detectar desvios das práticas recomendadas de segurança e acelerar a investigação e automatizar a correção de descobertas de segurança com manuais. Você também pode considerar a implementação de um zero confiança arquitetura na AWS para aumentar ainda mais os controles refinados de autenticação e autorização para o que usuários humanos ou processos máquina a máquina podem acessar por solicitação. Considere também usar Lago de segurança amazônico para centralizar automaticamente dados de segurança de ambientes AWS, provedores de SaaS, locais e fontes de nuvem em um data lake criado especificamente e armazenado em sua conta. Com o Security Lake, você pode obter uma compreensão mais completa dos dados de segurança em toda a organização.

Depois que seu ambiente de carga de trabalho de IA generativa for protegido, você poderá adicionar recursos específicos de IA/ML, como Gerenciador de dados do Amazon SageMaker para identificar possíveis vieses durante a preparação dos dados e Esclarecimento do Amazon SageMaker para detectar vieses em dados e modelos de ML. Você também pode usar Monitor de modelo do Amazon SageMaker para avaliar a qualidade dos modelos SageMaker ML em produção e notificá-lo quando houver desvio na qualidade dos dados, qualidade do modelo e atribuição de recursos. Esses serviços de IA/ML da AWS trabalhando em conjunto (incluindo o SageMaker trabalhando com o Amazon Bedrock) com os serviços de segurança da AWS podem ajudar você a identificar fontes potenciais de preconceito natural e proteger contra adulteração maliciosa de dados. Repita esse processo para cada uma das 10 principais vulnerabilidades do OWASP para LLM para garantir que você está maximizando o valor dos serviços da AWS para implementar a defesa em profundidade para proteger seus dados e cargas de trabalho.

Como Clarke Rodgers, estrategista empresarial da AWS, escreveu em sua postagem no blog “CISO Insight: todo serviço AWS é um serviço de segurança”, “Eu diria que praticamente todos os serviços da nuvem AWS permitem um resultado de segurança por si só ou podem ser usados (sozinhos ou em conjunto com um ou mais serviços) pelos clientes para atingir um objetivo de segurança, risco ou conformidade.” E “Os Diretores de Segurança da Informação (CISOs) do cliente (ou suas respectivas equipes) podem querer reservar um tempo para garantir que estejam bem familiarizados com todos os serviços da AWS porque pode haver um objetivo de segurança, risco ou conformidade que pode ser alcançado, mesmo que um serviço não se enquadre na categoria ‘Segurança, Identidade e Conformidade’.”

Camada de defesas em limites de confiança em aplicativos LLM

Ao desenvolver sistemas e aplicativos generativos baseados em IA, você deve considerar as mesmas preocupações de qualquer outro aplicativo de ML, conforme mencionado no Matriz de ameaças de aprendizado de máquina MITRE ATLAS, como estar atento às origens do software e dos componentes de dados (como realizar uma auditoria de software de código aberto, revisar a lista de materiais de software (SBOMs) e analisar fluxos de trabalho de dados e integrações de API) e implementar as proteções necessárias contra ameaças à cadeia de suprimentos LLM. Inclua insights de estruturas do setor e esteja ciente das maneiras de usar diversas fontes de inteligência sobre ameaças e informações de risco para ajustar e ampliar suas defesas de segurança para levar em conta os riscos de segurança de IA, ML e IA generativa que são emergentes e não incluídos nas estruturas tradicionais. Procure informações complementares sobre riscos específicos de IA de fontes industriais, de defesa, governamentais, internacionais e acadêmicas, porque novas ameaças surgem e evoluem regularmente neste espaço e as estruturas e guias complementares são atualizados com frequência. Por exemplo, ao usar um modelo de geração aumentada de recuperação (RAG), se o modelo não incluir os dados necessários, ele poderá solicitá-los de uma fonte de dados externa para uso durante a inferência e o ajuste fino. A fonte consultada pode estar fora do seu controle e ser uma fonte potencial de comprometimento na sua cadeia de suprimentos. Uma abordagem de defesa aprofundada deve ser estendida a fontes externas para estabelecer confiança, autenticação, autorização, acesso, segurança, privacidade e precisão dos dados aos quais está a aceder. Para mergulhar mais fundo, leia “Crie um aplicativo empresarial seguro com IA generativa e RAG usando o Amazon SageMaker JumpStart"

Analise e mitigue riscos em suas aplicações LLM

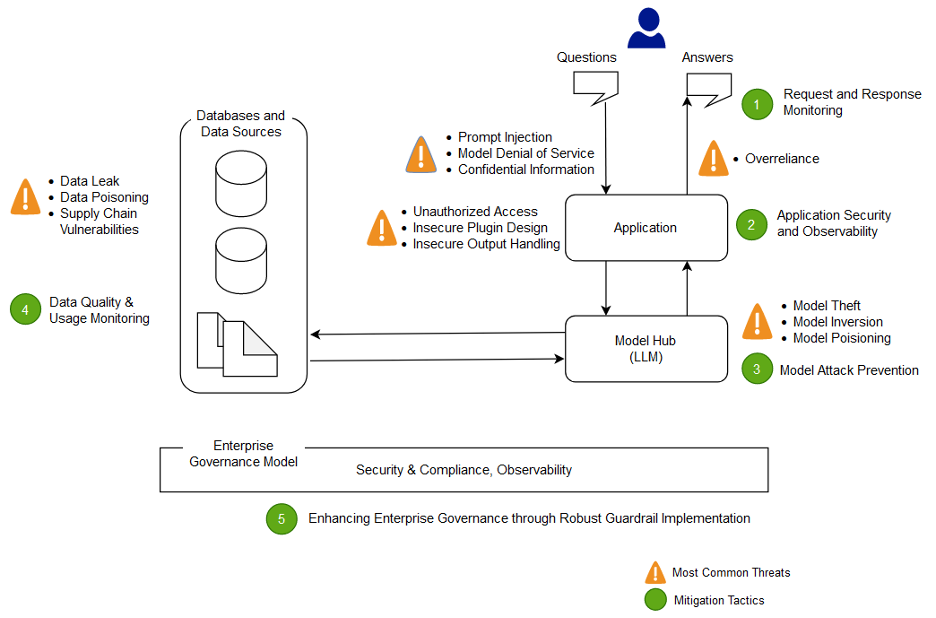

Nesta seção, analisamos e discutimos algumas técnicas de mitigação de risco com base em limites e interações de confiança, ou áreas distintas da carga de trabalho com escopo de controles e perfil de risco apropriados semelhantes. Neste exemplo de arquitetura de um aplicativo de chatbot, há cinco limites de confiança onde os controles são demonstrados, com base em como os clientes da AWS normalmente criam seus aplicativos LLM. Seu aplicativo LLM pode ter mais ou menos limites de confiança definíveis. No exemplo de arquitetura a seguir, esses limites de confiança são definidos como:

- Interações da interface do usuário (solicitação e resposta)

- Interações de aplicativos

- Interações de modelo

- Interações de dados

- Interações organizacionais e uso

Interações da interface do usuário: Desenvolva monitoramento de solicitações e respostas

Detecte e responda a incidentes cibernéticos relacionados à IA generativa em tempo hábil, avaliando uma estratégia para lidar com o risco das entradas e saídas da aplicação de IA generativa. Por exemplo, o monitoramento adicional de comportamentos e fluxo de dados pode precisar ser instrumentado para detectar a divulgação de informações confidenciais fora do seu domínio ou organização, caso seja usado no aplicativo LLM.

Os aplicativos de IA generativa ainda devem manter as práticas recomendadas de segurança padrão quando se trata de proteção de dados. Estabeleça um perímetro de dados seguro e armazenamentos de dados confidenciais seguros. Criptografe dados e informações usados para aplicativos LLM em repouso e em trânsito. Proteja os dados usados para treinar seu modelo contra envenenamento de dados de treinamento, entendendo e controlando quais usuários, processos e funções têm permissão para contribuir com os armazenamentos de dados, bem como como os dados fluem no aplicativo, monitoram desvios de polarização e usam controle de versão e armazenamento imutável em serviços de armazenamento como Amazon S3. Estabeleça controles rígidos de entrada e saída de dados usando serviços como AWS Network Firewall e AWS VPCs para proteger contra entradas suspeitas e o potencial de exfiltração de dados.

Durante o processo de treinamento, reciclagem ou ajuste fino, você deve estar ciente de quaisquer dados confidenciais utilizados. Depois que os dados forem usados durante um desses processos, você deve planejar um cenário em que qualquer usuário do seu modelo subitamente se torne capaz de extrair os dados ou informações de volta utilizando técnicas de injeção imediata. Entenda os riscos e benefícios do uso de dados confidenciais em seus modelos e inferências. Implemente mecanismos robustos de autenticação e autorização para estabelecer e gerenciar permissões de acesso refinadas, que não dependam da lógica do aplicativo LLM para evitar divulgação. Foi demonstrado que a entrada controlada pelo usuário para uma aplicação de IA generativa é, sob algumas condições, capaz de fornecer um vetor para extrair informações do modelo ou de quaisquer partes da entrada não controladas pelo usuário. Isso pode ocorrer por meio de injeção imediata, em que o usuário fornece informações que fazem com que a saída do modelo se desvie das proteções esperadas do aplicativo LLM, incluindo o fornecimento de pistas para os conjuntos de dados nos quais o modelo foi originalmente treinado.

Implemente cotas de acesso em nível de usuário para usuários que fornecem entrada e recebem saída de um modelo. Você deve considerar abordagens que não permitam acesso anônimo em condições em que os dados e informações de treinamento do modelo sejam confidenciais ou onde haja risco de um adversário treinar um fac-símile do seu modelo com base na entrada dele e na saída do modelo alinhado. Em geral, se parte da entrada para um modelo consistir em texto arbitrário fornecido pelo usuário, considere a saída como suscetível à injeção imediata e, consequentemente, garanta que o uso das saídas inclua contramedidas técnicas e organizacionais implementadas para mitigar o tratamento inseguro da saída, agência excessiva e excesso de confiança. No exemplo anterior relacionado à filtragem de entradas mal-intencionadas usando o AWS WAF, considere criar um filtro na frente do seu aplicativo para esse possível uso indevido de prompts e desenvolver uma política sobre como lidar e evoluí-los à medida que seu modelo e seus dados crescem. Considere também uma revisão filtrada da saída antes de ela ser devolvida ao usuário para garantir que atenda aos padrões de qualidade, precisão ou moderação de conteúdo. Talvez você queira personalizar ainda mais isso de acordo com as necessidades da sua organização com uma camada adicional de controle sobre entradas e saídas na frente dos seus modelos para mitigar padrões de tráfego suspeitos.

Interações de aplicativos: segurança e observabilidade de aplicativos

Revise seu aplicativo LLM com atenção em como um usuário poderia utilizar seu modelo para ignorar a autorização padrão para uma ferramenta downstream ou cadeia de ferramentas que ele não tem autorização para acessar ou usar. Outra preocupação nesta camada envolve o acesso a armazenamentos de dados externos usando um modelo como mecanismo de ataque usando riscos LLM técnicos ou organizacionais não mitigados. Por exemplo, se o seu modelo for treinado para aceder a determinadas lojas de dados que possam conter dados sensíveis, deverá garantir que tem verificações de autorização adequadas entre o seu modelo e as lojas de dados. Use atributos imutáveis sobre usuários que não vêm do modelo ao realizar verificações de autorização. O tratamento de saída inseguro e absoluto, o design de plug-in inseguro e a agência excessiva podem criar condições em que um agente de ameaça pode usar um modelo para enganar o sistema de autorização para aumentar privilégios efetivos, levando um componente downstream a acreditar que o usuário está autorizado a recuperar dados ou obter um determinado Ação.

Ao implementar qualquer plugin ou ferramenta de IA generativa, é imperativo examinar e compreender o nível de acesso concedido, bem como examinar minuciosamente os controles de acesso que foram configurados. O uso de plug-ins de IA generativos totalmente inseguros pode tornar seu sistema suscetível a vulnerabilidades e ameaças da cadeia de suprimentos, levando potencialmente a ações maliciosas, incluindo a execução remota de código.

Interações de modelo: prevenção de ataques de modelo

Você deve estar ciente da origem de quaisquer modelos, plug-ins, ferramentas ou dados que utiliza, a fim de avaliar e mitigar as vulnerabilidades da cadeia de suprimentos. Por exemplo, alguns formatos de modelos comuns permitem a incorporação de código executável arbitrário nos próprios modelos. Use espelhos de pacotes, varreduras e inspeções adicionais conforme relevante para as metas de segurança de sua organização.

Os conjuntos de dados nos quais você treina e ajusta seus modelos também devem ser revisados. Se você ajustar automaticamente um modelo com base no feedback do usuário (ou outras informações controláveis pelo usuário final), deverá considerar se um agente de ameaça mal-intencionado poderia alterar o modelo arbitrariamente com base na manipulação de suas respostas e obter envenenamento de dados de treinamento.

Interações de dados: monitore a qualidade e o uso dos dados

Modelos generativos de IA, como LLMs, geralmente funcionam bem porque foram treinados em uma grande quantidade de dados. Embora esses dados ajudem os LLMs a concluir tarefas complexas, eles também podem expor seu sistema ao risco de envenenamento de dados de treinamento, que ocorre quando dados inadequados são incluídos ou omitidos dentro de um conjunto de dados de treinamento que pode alterar o comportamento de um modelo. Para mitigar esse risco, você deve examinar sua cadeia de suprimentos e compreender o processo de revisão de dados do seu sistema antes de usá-lo dentro do seu modelo. Embora o pipeline de treinamento seja uma fonte principal de envenenamento de dados, você também deve observar como seu modelo obtém dados, como em um modelo RAG ou data lake, e se a fonte desses dados é confiável e protegida. Use os serviços de segurança da AWS, como AWS Security Hub, Amazon GuardDuty e Amazon Inspector, para ajudar a monitorar continuamente atividades suspeitas no Amazon EC2, Amazon EKS, Amazon S3, Serviço de banco de dados relacional da Amazon (Amazon RDS) e acesso à rede que podem ser indicadores de ameaças emergentes e use o Detective para visualizar investigações de segurança. Considere também usar serviços como Lago de segurança amazônico para acelerar as investigações de segurança criando um data lake específico para centralizar automaticamente os dados de segurança de ambientes AWS, provedores de SaaS, locais e fontes de nuvem que contribuem para suas cargas de trabalho de IA/ML.

Interações organizacionais: Implementar proteções de governança corporativa para IA generativa

Identifique os riscos associados ao uso de IA generativa para seus negócios. Você deve construir a taxonomia de risco da sua organização e realizar avaliações de risco para tomar decisões informadas ao implantar soluções generativas de IA. Desenvolver um plano de continuidade de negócios (BCP) que inclui cargas de trabalho de IA, ML e IA generativa e que pode ser implementado rapidamente para substituir a funcionalidade perdida de um aplicativo LLM impactado ou off-line para atender aos seus SLAs.

Identifique lacunas, ineficiências e inconsistências de processos e recursos e melhore a conscientização e a propriedade em toda a sua empresa. Modelo de ameaça todas as cargas de trabalho generativas de IA para identificar e mitigar possíveis ameaças à segurança que podem levar a resultados com impacto nos negócios, incluindo acesso não autorizado a dados, negação de serviço e uso indevido de recursos. Aproveite o novo Ferramenta de modelagem AWS Threat Composer para ajudar a reduzir o tempo de obtenção de valor ao executar a modelagem de ameaças. Mais tarde em seus ciclos de desenvolvimento, considere incluir a introdução engenharia de caos de segurança experimentos de injeção de falhas para criar condições do mundo real para entender como seu sistema reagirá a incógnitas e criar confiança na resiliência e segurança do sistema.

Incluir diversas perspectivas no desenvolvimento de estratégias de segurança e mecanismos de gestão de risco para garantir adesão e cobertura para IA/ML e segurança generativa em todos os cargos e funções. Traga uma mentalidade de segurança para a mesa desde o início e a pesquisa de qualquer aplicativo generativo de IA para alinhar os requisitos. Se você precisar de assistência extra da AWS, peça ao seu gerente de contas da AWS para garantir que haja suporte igual, solicitando aos arquitetos de soluções da AWS da AWS Security e AI/ML para ajudar em conjunto.

Certifique-se de que sua organização de segurança tome ações rotineiramente para promover a comunicação em torno da conscientização e do gerenciamento de riscos entre as partes interessadas em IA generativa, como gerentes de produtos, desenvolvedores de software, cientistas de dados e liderança executiva, permitindo que a inteligência de ameaças e a orientação de controles cheguem às equipes que podem ser impactado. As organizações de segurança podem apoiar uma cultura de divulgação responsável e melhoria iterativa, participando em discussões e trazendo novas ideias e informações às partes interessadas generativas da IA que se relacionam com os seus objetivos de negócio. Aprender mais sobre nosso compromisso com a IA Responsável e adicional recursos de IA responsáveis para ajudar nossos clientes.

Obtenha vantagem ao permitir uma melhor postura organizacional para IA generativa, desbloqueando o tempo de retorno nos processos de segurança existentes em sua organização. Avalie proativamente onde sua organização pode exigir processos excessivamente onerosos, dado o contexto de segurança de IA generativa, e refine-os para fornecer aos desenvolvedores e cientistas um caminho claro para o lançamento com os controles corretos em vigor.

Avalie onde pode haver oportunidades para alinhar incentivos, eliminar riscos e fornecer uma linha de visão clara sobre os resultados desejados. A atualização controla orientações e defesas para atender às crescentes necessidades de IA/ML e desenvolvimento de aplicativos de IA generativos para reduzir a confusão e a incerteza que podem custar tempo de desenvolvimento, aumentar o risco e aumentar o impacto.

Certifique-se de que as partes interessadas que não são especialistas em segurança sejam capazes de compreender como a governação organizacional, as políticas e as etapas de gestão de riscos se aplicam às suas cargas de trabalho, bem como aplicar mecanismos de gestão de riscos. Prepare sua organização para responder a eventos e cenários realistas que podem ocorrer com aplicativos de IA generativa e garanta que as funções de construtor de IA generativa e as equipes de resposta estejam cientes dos caminhos e ações de escalonamento em caso de preocupação com qualquer atividade suspeita.

Conclusão

Para comercializar com sucesso a inovação com qualquer tecnologia nova e emergente, é necessário começar com uma mentalidade de segurança em primeiro lugar, construir sobre uma base de infraestrutura segura e pensar em como integrar ainda mais a segurança em cada nível da pilha de tecnologia desde o início, com uma defesa em profundidade. abordagem. Isto inclui interações em múltiplas camadas da sua pilha de tecnologia e pontos de integração na sua cadeia de fornecimento digital, para garantir a resiliência organizacional. Embora a IA generativa introduza alguns novos desafios de segurança e privacidade, se você seguir as práticas recomendadas de segurança fundamentais, como o uso de defesa profunda com serviços de segurança em camadas, poderá ajudar a proteger sua organização contra muitos problemas comuns e ameaças em evolução. Você deve implementar serviços de segurança da AWS em camadas em suas cargas de trabalho generativas de IA e em organizações maiores, e se concentrar em pontos de integração em suas cadeias de fornecimento digitais para proteger seus ambientes de nuvem. Em seguida, você pode usar os recursos aprimorados de segurança e privacidade nos serviços de IA/ML da AWS, como Amazon SageMaker e Amazon Bedrock, para adicionar mais camadas de segurança aprimorada e controles de privacidade aos seus aplicativos de IA generativos. Incorporar a segurança desde o início tornará mais rápido, fácil e econômico inovar com IA generativa, ao mesmo tempo que simplificará a conformidade. Isso ajudará você a aumentar os controles, a confiança e a observabilidade de seus aplicativos generativos de IA para seus funcionários, clientes, parceiros, reguladores e outras partes interessadas.

Referências adicionais

- Estruturas padrão do setor para gerenciamento de riscos e segurança específicos de IA/ML:

Sobre os autores

Christopher Rae é especialista mundial em segurança GTM com foco no desenvolvimento e execução de iniciativas estratégicas que aceleram e dimensionam a adoção de serviços de segurança da AWS. Ele é apaixonado pela interseção entre segurança cibernética e tecnologias emergentes, com mais de 20 anos de experiência em funções de liderança estratégica global, fornecendo soluções de segurança para clientes de mídia, entretenimento e telecomunicações. Ele se recarrega lendo, viajando, comendo e bebendo vinho, descobrindo novas músicas e aconselhando startups em estágio inicial.

Christopher Rae é especialista mundial em segurança GTM com foco no desenvolvimento e execução de iniciativas estratégicas que aceleram e dimensionam a adoção de serviços de segurança da AWS. Ele é apaixonado pela interseção entre segurança cibernética e tecnologias emergentes, com mais de 20 anos de experiência em funções de liderança estratégica global, fornecendo soluções de segurança para clientes de mídia, entretenimento e telecomunicações. Ele se recarrega lendo, viajando, comendo e bebendo vinho, descobrindo novas músicas e aconselhando startups em estágio inicial.

Elias Inverno é engenheiro de segurança sênior na Amazon Security, possui bacharelado em engenharia de segurança cibernética e é apaixonado por Harry Potter. Elijah é excelente na identificação e solução de vulnerabilidades em sistemas de IA, combinando conhecimento técnico com um toque de magia. Elijah projeta protocolos de segurança personalizados para ecossistemas de IA, trazendo um toque mágico às defesas digitais. Movido pela integridade, Elijah tem experiência em segurança em organizações do setor público e comercial focadas na proteção da confiança.

Elias Inverno é engenheiro de segurança sênior na Amazon Security, possui bacharelado em engenharia de segurança cibernética e é apaixonado por Harry Potter. Elijah é excelente na identificação e solução de vulnerabilidades em sistemas de IA, combinando conhecimento técnico com um toque de magia. Elijah projeta protocolos de segurança personalizados para ecossistemas de IA, trazendo um toque mágico às defesas digitais. Movido pela integridade, Elijah tem experiência em segurança em organizações do setor público e comercial focadas na proteção da confiança.

Carneiro Vital é arquiteto principal de soluções de ML na AWS. Ele tem mais de 3 décadas de experiência arquitetando e construindo aplicativos distribuídos, híbridos e em nuvem. Ele é apaixonado por criar soluções seguras e escaláveis de IA/ML e big data para ajudar clientes corporativos em sua jornada de adoção e otimização da nuvem para melhorar seus resultados de negócios. Nas horas vagas, ele anda de moto e caminha com seu Sheepadoodle de 3 anos!

Carneiro Vital é arquiteto principal de soluções de ML na AWS. Ele tem mais de 3 décadas de experiência arquitetando e construindo aplicativos distribuídos, híbridos e em nuvem. Ele é apaixonado por criar soluções seguras e escaláveis de IA/ML e big data para ajudar clientes corporativos em sua jornada de adoção e otimização da nuvem para melhorar seus resultados de negócios. Nas horas vagas, ele anda de moto e caminha com seu Sheepadoodle de 3 anos!

Navneet Tuteja é especialista em dados da Amazon Web Services. Antes de ingressar na AWS, Navneet trabalhou como facilitador para organizações que buscam modernizar suas arquiteturas de dados e implementar soluções abrangentes de IA/ML. Ela é formada em engenharia pela Thapar University e tem mestrado em estatística pela Texas A&M University.

Navneet Tuteja é especialista em dados da Amazon Web Services. Antes de ingressar na AWS, Navneet trabalhou como facilitador para organizações que buscam modernizar suas arquiteturas de dados e implementar soluções abrangentes de IA/ML. Ela é formada em engenharia pela Thapar University e tem mestrado em estatística pela Texas A&M University.

Emily Soward é um cientista de dados com AWS Professional Services. Possui Mestrado em Ciências com Distinção em Inteligência Artificial pela Universidade de Edimburgo na Escócia, Reino Unido, com ênfase em Processamento de Linguagem Natural (PNL). Emily atuou em funções científicas e de engenharia aplicadas com foco em pesquisa e desenvolvimento de produtos habilitados para IA, excelência operacional e governança para cargas de trabalho de IA executadas em organizações do setor público e privado. Ela contribui para a orientação do cliente como palestrante sênior da AWS e, recentemente, como autora do AWS Well-Architected in the Machine Learning Lens.

Emily Soward é um cientista de dados com AWS Professional Services. Possui Mestrado em Ciências com Distinção em Inteligência Artificial pela Universidade de Edimburgo na Escócia, Reino Unido, com ênfase em Processamento de Linguagem Natural (PNL). Emily atuou em funções científicas e de engenharia aplicadas com foco em pesquisa e desenvolvimento de produtos habilitados para IA, excelência operacional e governança para cargas de trabalho de IA executadas em organizações do setor público e privado. Ela contribui para a orientação do cliente como palestrante sênior da AWS e, recentemente, como autora do AWS Well-Architected in the Machine Learning Lens.

- Conteúdo com tecnologia de SEO e distribuição de relações públicas. Seja amplificado hoje.

- PlatoData.Network Gerativa Vertical Ai. Capacite-se. Acesse aqui.

- PlatoAiStream. Inteligência Web3. Conhecimento Amplificado. Acesse aqui.

- PlatãoESG. Carbono Tecnologia Limpa, Energia, Ambiente, Solar, Gestão de resíduos. Acesse aqui.

- PlatoHealth. Inteligência em Biotecnologia e Ensaios Clínicos. Acesse aqui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/architect-defense-in-depth-security-for-generative-ai-applications-using-the-owasp-top-10-for-llms/

- :tem

- :é

- :não

- :onde

- $UP

- 1

- 10

- 100

- 125

- 150

- 30

- 300

- a

- habilidade

- Capaz

- Sobre

- acadêmico

- acelerar

- aceitável

- Acesso

- Acesso a dados

- acessando

- conformemente

- Conta

- Contas

- precisão

- Alcançar

- alcançar

- em

- Açao Social

- ações

- atividades

- atividade

- adaptação

- adicionar

- adicionado

- Adição

- Adicional

- endereço

- endereçando

- aderência

- ajustar

- adotar

- Adotando

- Adoção

- avançado

- avanços

- Vantagem

- aconselhando

- Depois de

- contra

- agência

- Agente

- AI

- Modelos de IA

- Sistemas de IA

- AI / ML

- alinhar

- alinhado

- Alinha

- Todos os Produtos

- permitir

- permitidas

- Permitindo

- sozinho

- tb

- Apesar

- Amazon

- Amazon EC2

- Amazon RDS

- Amazon Sage Maker

- Amazon Web Services

- entre

- quantidade

- an

- analisar

- análise

- e

- e infra-estrutura

- Anônimo

- Outro

- responder

- qualquer

- api

- apetite

- relevante

- Aplicação

- Desenvolvimento de Aplicações

- segurança da aplicação

- aplicações

- aplicado

- aplica

- Aplicar

- Aplicando

- abordagem

- se aproxima

- apropriado

- arquitetos

- arquitetônico

- arquitetura

- SOMOS

- áreas

- argumentar

- surgir

- por aí

- artificial

- inteligência artificial

- Inteligência artificial (AI)

- AS

- perguntar

- Avaliando

- avaliações

- Ativos

- Assistência

- assistentes

- associado

- garantia

- At

- atlas

- ataque

- Ataques

- tentando

- por WhatsApp.

- atributos

- auditor

- aumentado

- Autenticação

- autor

- autorização

- autorizado

- automatizar

- automaticamente

- disponível

- consciente

- consciência

- AWS

- Cliente AWS

- Serviços Profissionais AWS

- em caminho duplo

- Apoiado

- fundo

- baseado

- basic

- base

- BE

- Porque

- torna-se

- sido

- antes

- começar

- comportamento

- ser

- crente

- beneficiar

- Benefícios

- MELHOR

- melhores práticas

- Melhor

- entre

- viés

- Grande

- Big Data

- Projeto de lei

- blending

- Blog

- ambos

- limites

- trazer

- Trazendo

- construir

- construtor

- construtores

- Prédio

- Constrói

- construído

- construídas em

- negócio

- negócios

- by

- ignorar

- Cadência

- CAN

- Pode obter

- capacidades

- Capacidade

- casas

- Categoria

- Causar

- causas

- centralizar

- certo

- certificado

- FDA

- cadeia

- correntes

- desafios

- alterar

- Chaos

- chatbot

- Cheques

- chefe

- remover filtragem

- Na nuvem

- adoção de nuvem

- Aplicativos em nuvem

- computação em nuvem

- infraestrutura de nuvem

- Cloud Security

- código

- combinação

- como

- vem

- comercial

- comercializar

- compromisso

- comprometido

- comum

- geralmente

- Comunicação

- companheiro

- companheiros

- Empresa

- completar

- integrações

- compliance

- componente

- Compor

- compreender

- compreensivo

- compromisso

- Comprometido

- comprometendo

- Computar

- computação

- Interesse

- preocupado

- Preocupações

- condições

- Conduzir

- confiança

- configurado

- confusão

- conjunção

- Contato

- Consequências

- Considerar

- considerado

- considerando

- consistente

- consiste

- não contenho

- Containers

- conteúdo

- moderação de conteúdo

- contexto

- continuidade

- continuamente

- contribuir

- contribui

- ao controle

- controle

- controles

- Por outro lado

- núcleo

- pedra angular

- correta

- Correspondente

- Custo

- relação custo-benefício

- poderia

- cobertura

- crio

- Criar

- crítico

- Cultura

- cura

- cliente

- Clientes

- personalizar

- personalizado

- cibernético

- cíber segurança

- Cíber segurança

- ciclos

- dados,

- lago data

- Preparação de dados

- qualidade de dados

- cientista de dados

- adulteração de dados

- banco de dados

- conjuntos de dados

- dia

- décadas

- Tomada de Decisão

- decisores

- decisões

- profundo

- mais profunda

- Defesa

- defensiva

- definir

- definido

- definição

- Grau

- entregando

- mergulhar

- demonstraram

- Denial of Service

- Dependendo

- implantar

- implantado

- Implantação

- desenvolvimento

- profundidade

- descreve

- Design

- projetos

- desejado

- descobrir

- desenvolver

- desenvolvido

- desenvolvedores

- em desenvolvimento

- Desenvolvimento

- desviar

- desvio

- diferente

- digital

- disciplinas

- divulgação

- descobrindo

- descoberta

- discutir

- discutir

- discussões

- interrupções

- distinto

- distinção

- distribuído

- mergulho

- diferente

- perspectivas diversas

- Não faz

- domínio

- não

- desenha

- dirigido

- durante

- cada

- Mais cedo

- Cedo

- estágio inicial

- mais fácil

- facilmente

- Econômico

- valor Econômico

- ecossistemas

- Edimburgo

- Eficaz

- eficiente

- ou

- embutindo

- emergem

- emergente

- tecnologias emergentes

- Tecnologia emergente

- ênfase

- colaboradores

- autorizar

- permitir

- permite

- permitindo

- encorajar

- criptografada

- final

- aplicar

- impor

- engenheiro

- Engenharia

- Engenheiros

- aprimorada

- garantir

- Empreendimento

- clientes corporativos

- Entretenimento

- Todo

- Meio Ambiente

- ambientes

- igual

- erro

- escalada

- essencial

- estabelecer

- estabelecendo

- Éter (ETH)

- avaliar

- avaliação

- avaliação

- Mesmo

- Evento

- eventos

- Cada

- evolui

- evolução

- examinar

- exemplo

- exemplos

- Excelência

- excessivo

- executando

- executivo

- Exercício

- exfiltração

- existir

- existente

- expansão

- esperado

- vasta experiência

- experimentos

- experiência

- especialistas

- Exposição

- estender

- opção

- estendendo

- se estende

- externo

- extra

- extrato

- extrair os dados

- extremamente

- rostos

- facilita

- Facilitador

- falha

- Cair

- Familiaridade

- RÁPIDO

- mais rápido

- Característica

- Funcionalidades

- retornos

- menos

- filtro

- filtragem

- financeiro

- serviços financeiros

- Encontre

- descoberta

- descobertas

- firewall

- Primeiro nome

- cinco

- flair

- flexível

- fluxo

- Fluxos

- Foco

- focado

- seguir

- seguinte

- comida

- Escolha

- Forense

- Promover

- promove

- Foundation

- Fundacional

- Quadro

- enquadramentos

- freqüentemente

- da

- frente

- funcionalidade

- funções

- fundamental

- mais distante

- Ganho

- lacunas

- Geral

- geralmente

- geração

- generativo

- IA generativa

- ter

- obtendo

- dado

- Global

- meta

- Objetivos

- vai

- governo

- governo

- Governo

- governamental

- concedido

- Cresce

- orientações

- guia

- dirigido

- Guias

- tinha

- manipular

- Manipulação

- Ter

- he

- saúde

- ajudar

- ajuda

- ajuda

- alta performance

- altamente

- sua

- segurando

- detém

- Como funciona o dobrador de carta de canal

- Como Negociar

- HTML

- http

- HTTPS

- Hub

- humano

- HÍBRIDO

- i

- idéia

- idéias

- identificado

- identificar

- identificar

- Identidade

- if

- imutabilidade

- imutável

- Impacto

- impactada

- Impacto

- imperativo

- executar

- implementação

- implementado

- implementação

- melhorar

- melhoria

- in

- incentivos

- começo

- incidentes

- incluir

- incluído

- inclui

- Incluindo

- inconsistências

- Crescimento

- aumentou

- aumentando

- indicadores

- indústria

- ineficiências

- INFORMAÇÕES

- segurança da informação

- informado

- Infraestrutura

- infundido

- inerente

- iniciativas

- inovar

- inovando

- Inovação

- entrada

- inputs

- inseguro

- dentro

- introspecção

- insights

- instâncias

- integrar

- integrado

- Integra-se

- integração

- integrações

- integridade

- Inteligência

- interações

- interesse

- Interface

- Internacionais

- interseção

- para dentro

- introduzir

- Introduz

- introduzindo

- investigação

- investigações

- envolve

- questões

- IT

- ESTÁ

- se

- Trabalho

- juntando

- viagem

- jpg

- apenas por

- Guarda

- Chave

- Áreas-chave

- Reino

- Conhecimento

- Kubernetes

- lago

- língua

- grande

- Maior

- por último

- mais tarde

- lançamento

- camada

- em camadas

- camadas

- conduzir

- líderes

- Liderança

- principal

- APRENDER

- aprendizagem

- mínimo

- Lente

- lentes

- Nível

- wifecycwe

- como

- probabilidade

- Line

- linhas

- logging

- lógica

- olhar

- procurando

- perdido

- gosta,

- máquina

- aprendizado de máquina

- fazer

- malicioso

- malwares

- gerencia

- gerenciados

- de grupos

- Gerente

- Gerentes

- gestão

- manipulando

- Manipulação

- maneira

- muitos

- mapa,

- dominar

- mestre

- materiais

- Matéria

- maturidade

- maximizando

- Posso..

- significa

- a medida

- mecanismo

- mecanismos

- Mídia

- Conheça

- atende

- mental

- mencionado

- conheceu

- Métrica

- poder

- migrado

- milhões

- mente

- Mindset

- mau uso

- Mitigar

- mitigação

- ML

- modelo

- modelagem

- modelos

- moderação

- modernizar

- Monitore

- monitoração

- mais

- a maioria

- motocicleta

- mover

- muito

- múltiplo

- Música

- devo

- my

- natural

- Linguagem Natural

- Processamento de linguagem natural

- Natureza

- necessário

- você merece...

- necessário

- Cria

- rede

- Acesso à rede

- Novo

- Próximo

- nist

- PNL

- objeto

- objetivo

- objetivos

- ocorrer

- of

- WOW!

- oferecendo treinamento para distância

- Oferece

- oficiais

- modo offline

- on

- ONE

- aberto

- open source

- operado

- operacional

- Operações

- oportunidades

- otimização

- otimizado

- or

- ordem

- organização

- organizacional

- organizações

- Origin

- originalmente

- origens

- Outros

- A Nossa

- Fora

- Resultado

- resultados

- saída

- outputs

- lado de fora

- Acima de

- global

- excessivamente

- propriedade

- pacote

- parte

- participando

- partes

- Parceiros

- peças

- apaixonado

- caminho

- caminhos

- padrões

- atuação

- realizada

- realização

- permissões

- perspectivas

- fases

- pilares

- oleoduto

- Lugar

- plano

- planejamento

- platão

- Inteligência de Dados Platão

- PlatãoData

- plug-in

- plugins

- pontos

- veneno

- políticas

- Privacidade

- posicionamento

- Publique

- potencial

- potencialmente

- prática

- práticas

- preparação

- Preparar

- evitar

- anterior

- Prime

- Diretor

- princípios

- Prévio

- priorização

- prioridade

- política de privacidade

- privado

- setor privado

- privilégio

- privilégios

- processo

- processos

- em processamento

- Produto

- Produção

- produtividade

- profissional

- Perfil

- Agenda

- Programas

- projeto

- solicita

- adequado

- devidamente

- proteger

- protegido

- proteger

- proteção

- protocolos

- fornecer

- fornecedores

- fornece

- fornecendo

- público

- colocar

- qualidade

- consultas

- questão

- Links

- rapidamente

- trapo

- alcançar

- Reagir

- Leia

- Prontidão

- Leitura

- mundo real

- realista

- realização

- perceber

- receber

- recentemente

- recomendar

- recomendações

- Recuperar

- recuperação

- reduzir

- referência

- refinar

- região

- regular

- regularmente

- regulamentadas

- Reguladores

- relacionado

- relevante

- confiável

- depender

- remediação

- remoto

- repetir

- substituir

- solicitar

- solicitando

- requerer

- requerimento

- Requisitos

- exige

- pesquisa

- pesquisa e desenvolvimento

- resiliência

- recurso

- Recursos

- respeitado

- aqueles

- Responder

- resposta

- respostas

- responsabilidade

- responsável

- DESCANSO

- restringir

- reciclagem

- recuperação

- rever

- Comentários

- revendo

- Opinões

- passeios

- certo

- Risco

- apetite de risco

- gestão de risco

- Mitigação de riscos

- riscos

- uma conta de despesas robusta

- Rodgers

- papéis

- raiz

- rotineiramente

- regras

- corrida

- s

- SaaS

- sábio

- mesmo

- escalável

- Escala

- exploração

- cenário

- cenários

- Ciência

- científico

- Cientista

- cientistas

- escopo

- Escopo

- Escócia

- Pesquisar

- Seção

- setor

- seguro

- Secured

- assegurando

- segurança

- benefícios de segurança

- eventos de segurança

- riscos de segurança

- As ameaças de segurança

- ferramentas de segurança

- Buscar

- busca

- Procura

- selecionar

- selecionado

- senior

- sensível

- servido

- serviço

- Serviços

- conjunto

- contexto

- compartilhado

- ela

- rede de apoio social

- mostrar

- Vista

- semelhante

- simples

- simplificar

- simplificando

- So

- socializar

- Software

- conta de software

- Desenvolvedores de software

- desenvolvimento de software

- solução

- Soluções

- alguns

- fonte

- Fontes

- soberania

- Espaço

- Palestrantes

- especialista

- específico

- especificamente

- velocidade

- pilha

- Estágio

- partes interessadas

- padrão

- padrões

- começo

- começado

- Comece

- Startups

- estatística

- Passos

- Ainda

- armazenamento

- armazenadas

- lojas

- Estratégico

- estratégias

- Estrategista

- Estratégia

- rigoroso

- discordaram

- substancialmente

- sucesso

- entraram com sucesso

- tal

- supply

- cadeia de suprimentos

- Redes de fornecimento

- ajuda

- Apoiar

- certo

- suscetível

- suspeito

- sintético

- .

- sistemas

- mesa

- adaptados

- Tire

- toma

- Tandem

- tarefas

- taxonomia

- Profissionais

- equipes

- Dados Técnicos:

- técnicas

- Tecnologias

- tecnólogos

- Tecnologia

- telecom

- teste

- ensaio

- testes

- texas

- texto

- que

- A

- A fonte

- roubo

- deles

- Eles

- temas

- si mesmos

- então

- Lá.

- Este

- deles

- Pensando

- Terceiro

- terceiro

- isto

- aqueles

- ameaça

- inteligência de ameaças

- ameaças

- três

- Através da

- todo

- tempo

- oportuno

- TLS

- para

- juntos

- ferramenta

- ferramentas

- topo

- 10 topo

- tocar

- para

- Trading

- tradicional

- tráfego

- Trem

- treinado

- Training

- transação

- trânsito

- Transparência

- transporte

- Viagens

- Confiança

- confiável

- tipicamente

- não autorizado

- Incerteza

- para

- minar

- compreender

- compreensão

- desconhecido

- Unido

- Reino Unido

- universidade

- absoluto

- Atualizar

- Atualizada

- Defender

- uptime

- usar

- caso de uso

- usava

- Utilizador

- usuários

- usos

- utilização

- utilizar

- utilizado

- Utilizando

- VALIDAR

- validando

- validação

- valor

- versado

- via

- Virtual

- praticamente

- visualizar

- vs

- vulnerabilidades

- vulnerabilidade

- anda

- queremos

- Garantias

- foi

- maneiras

- we

- web

- Aplicativo da Web

- Aplicativos da web

- serviços web

- BEM

- O Quê

- quando

- se

- qual

- enquanto

- QUEM

- inteiro

- precisarão

- VINHO

- Vitórias

- de

- dentro

- sem

- Atividades:

- trabalhou

- de gestão de documentos

- fluxos de trabalho

- trabalhar

- no mundo todo

- seria

- escreveu

- XSS

- anos

- Você

- investimentos

- zefirnet