W epoce dużych zbiorów danych organizacje na całym świecie nieustannie poszukują innowacyjnych sposobów wydobywania wartości i spostrzeżeń ze swoich ogromnych zbiorów danych. Apache Spark oferuje skalowalność i szybkość niezbędną do wydajnego przetwarzania dużych ilości danych.

Amazon EMR to wiodące w branży rozwiązanie Big Data w chmurze do przetwarzania danych w skali petabajtowej, interaktywnej analizy i uczenia maszynowego (ML) przy użyciu platform open source, takich jak Apache Spark, Ula Apache, presto. Amazon EMR to najlepsze miejsce do uruchomienia Apache Spark. Możesz szybko i bez wysiłku tworzyć zarządzane klastry Spark z poziomu Konsola zarządzania AWS, Interfejs wiersza poleceń AWS (AWS CLI) lub API Amazon EMR. Możesz także skorzystać z dodatkowych funkcji Amazon EMR, w tym szybkich Usługa Amazon Simple Storage (Amazon S3) łączność za pomocą systemu plików Amazon EMR (EMRFS), integracja z Punkt Amazon EC2 rynek i Klej AWS Data Catalog i skalowanie zarządzane EMR umożliwiające dodawanie lub usuwanie instancji z klastra. Studio Amazon EMR to zintegrowane środowisko programistyczne (IDE), które ułatwia analitykom i inżynierom danych tworzenie, wizualizację i debugowanie aplikacji do inżynierii danych i nauki o danych napisanych w językach R, Python, Scala i PySpark. EMR Studio zapewnia w pełni zarządzane notatniki Jupyter oraz narzędzia, takie jak interfejs Spark UI i usługa osi czasu YARN, aby uprościć debugowanie.

Aby uwolnić potencjał drzemiący w zbiorach danych, konieczne jest wyjście poza tradycyjną analitykę. Poznaj generatywną sztuczną inteligencję, najnowocześniejszą technologię, która łączy uczenie maszynowe z kreatywnością, aby generować tekst, grafikę, a nawet kod przypominający człowieka. Amazońska skała macierzysta to najprostszy sposób tworzenia i skalowania generatywnych aplikacji AI za pomocą modeli podstawowych (FM). Amazon Bedrock to w pełni zarządzana usługa, która udostępnia FM firmy Amazon i wiodących firm zajmujących się sztuczną inteligencją za pośrednictwem interfejsu API, dzięki czemu możesz szybko eksperymentować z różnymi FM na placu zabaw i korzystać z jednego API do wnioskowania niezależnie od wybranych modeli, dając zapewnia elastyczność korzystania z FM od różnych dostawców i bycie na bieżąco z najnowszymi wersjami modeli przy minimalnych zmianach kodu.

W tym poście odkrywamy, w jaki sposób możesz usprawnić analizę danych za pomocą generatywnej sztucznej inteligencji, korzystając z Amazon EMR, Amazon Bedrock i pyspark-ai biblioteka. Biblioteka pyspark-ai to angielski zestaw SDK dla Apache Spark. Pobiera instrukcje w języku angielskim i kompiluje je do obiektów PySpark, takich jak DataFrames. Ułatwia to pracę ze Sparkiem i pozwala skupić się na wydobywaniu wartości z danych.

Omówienie rozwiązania

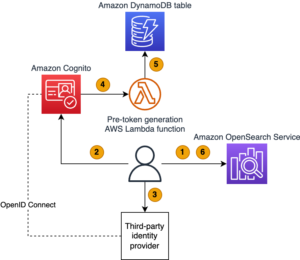

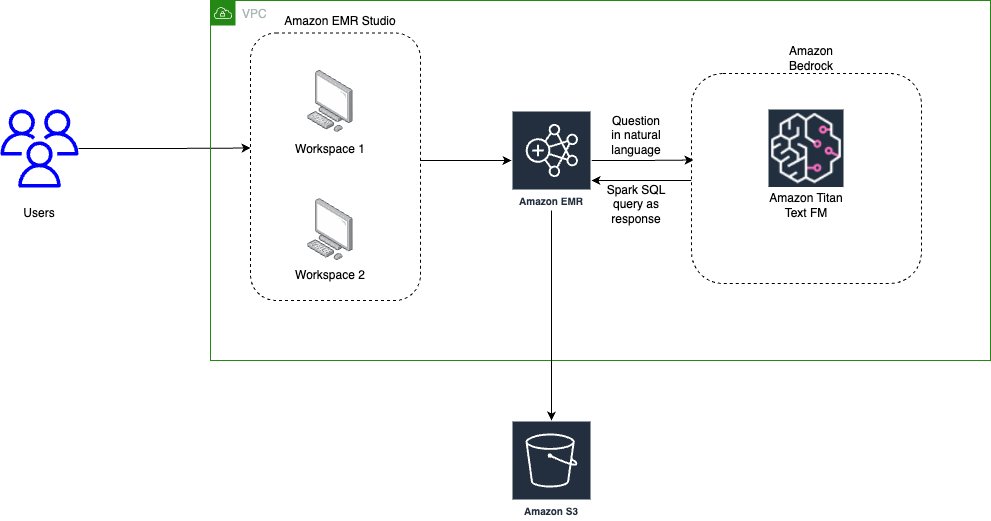

Poniższy diagram ilustruje architekturę wykorzystania generatywnej sztucznej inteligencji w Amazon EMR i Amazon Bedrock.

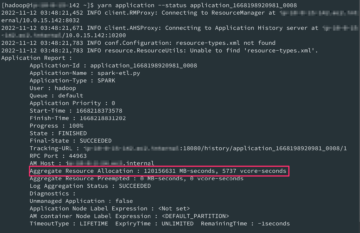

EMR Studio to internetowe środowisko IDE dla w pełni zarządzanych notatników Jupyter działających w klastrach EMR. Wchodzimy w interakcję z obszarami roboczymi EMR Studio podłączonymi do działającego klastra EMR i uruchamiamy notatnik dostarczony w ramach tego postu. Używamy Taksówka z Nowego Jorku dane w celu uzyskania wglądu w różne przejazdy taksówkami użytkowników. Zadajemy pytania w języku naturalnym na podstawie danych załadowanych do Spark DataFrame. Następnie biblioteka pyspark-ai wykorzystuje Amazon Titan Text FM z Amazon Bedrock do utworzenia zapytania SQL w oparciu o pytanie w języku naturalnym. Biblioteka pyspark-ai pobiera zapytanie SQL, uruchamia je przy użyciu Spark SQL i dostarcza wyniki użytkownikowi.

W tym rozwiązaniu możesz utworzyć i skonfigurować wymagane zasoby na swoim koncie AWS za pomocą pliku Tworzenie chmury AWS szablon. Szablon tworzy plik Klej AWS baza danych i tabele, wiadro S3, VPC i inne AWS Zarządzanie tożsamością i dostępem (IAM) zasobów używanych w rozwiązaniu.

Szablon ma na celu zademonstrowanie sposobu używania EMR Studio z pakietem pyspark-ai i Amazon Bedrock i nie jest przeznaczony do użytku produkcyjnego bez modyfikacji. Dodatkowo szablon wykorzystuje us-east-1 Regionu i może nie działać w innych Regionach bez modyfikacji. Szablon tworzy zasoby, które ponoszą koszty w trakcie ich używania. Wykonaj kroki czyszczenia opisane na końcu tego posta, aby usunąć zasoby i uniknąć niepotrzebnych opłat.

Wymagania wstępne

Przed uruchomieniem stosu CloudFormation upewnij się, że masz następujące elementy:

- Konto AWS zapewniające dostęp do usług AWS

- Użytkownik IAM z kluczem dostępu i tajnym kluczem do konfiguracji interfejsu CLI AWS oraz uprawnieniami do tworzenia roli IAM, zasad IAM i stosów w AWS CloudFormation

- Model Titan Text G1 – Express jest obecnie w wersji zapoznawczej, więc musisz mieć dostęp do podglądu, aby móc go używać w ramach tego posta

Twórz zasoby za pomocą AWS CloudFormation

CloudFormation tworzy następujące zasoby AWS:

- Stos VPC z podsieciami prywatnymi i publicznymi do użytku z EMR Studio, tabelami tras i bramą NAT.

- Klaster EMR z zainstalowanym językiem Python 3.9. Używamy akcji bootstrap, aby zainstalować Python 3.9 i inne odpowiednie pakiety, takie jak zależności pyspark-ai i Amazon Bedrock. (Więcej informacji można znaleźć w skrypt startowy.)

- Wiadro S3 do przestrzeni roboczej EMR Studio i miejsca na notebooka.

- Role i zasady IAM dotyczące konfiguracji EMR Studio, dostępu do Amazon Bedrock i uruchamiania notatników

Aby rozpocząć, wykonaj następujące czynności:

Ukończenie stosu CloudFormation zajmuje około 20–30 minut. Możesz monitorować jego postęp na konsoli AWS CloudFormation. Kiedy jego status brzmi CREATE_COMPLETE, Twoje konto AWS będzie miało zasoby niezbędne do wdrożenia tego rozwiązania.

Utwórz Studio EMR

Teraz możesz utworzyć Studio i obszar roboczy EMR do pracy z kodem notatnika. Wykonaj następujące kroki:

- W konsoli EMR Studio wybierz Utwórz Studio.

- Wpisz Nazwa studia as

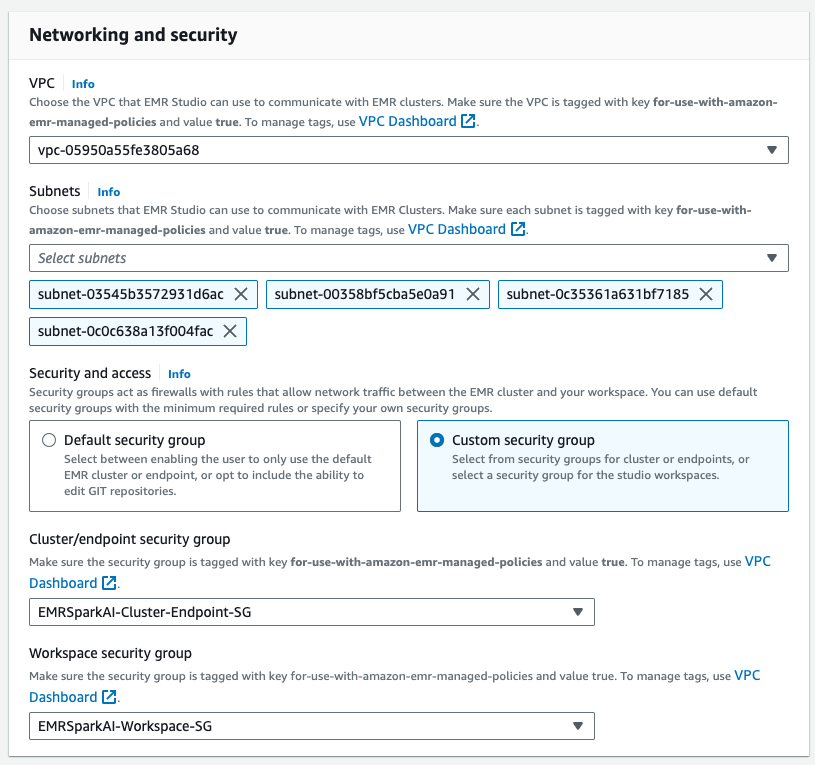

GenAI-EMR-Studioi podaj opis. - W Sieci i bezpieczeństwo sekcji, podaj następujące informacje:

- W razie zamówieenia projektu VPC, wybierz VPC utworzoną jako część wdrożonego stosu CloudFormation. Uzyskaj identyfikator VPC, korzystając z danych wyjściowych CloudFormation dla klucza VPCID.

- W razie zamówieenia projektu Podsieci, wybierz wszystkie cztery podsieci.

- W razie zamówieenia projektu Bezpieczeństwo i dostęp, Wybierz Niestandardowa grupa zabezpieczeń.

- W razie zamówieenia projektu Grupa zabezpieczeń klastra/punktu końcowegowybierz

EMRSparkAI-Cluster-Endpoint-SG. - W razie zamówieenia projektu Grupa zabezpieczeń obszaru roboczegowybierz

EMRSparkAI-Workspace-SG.

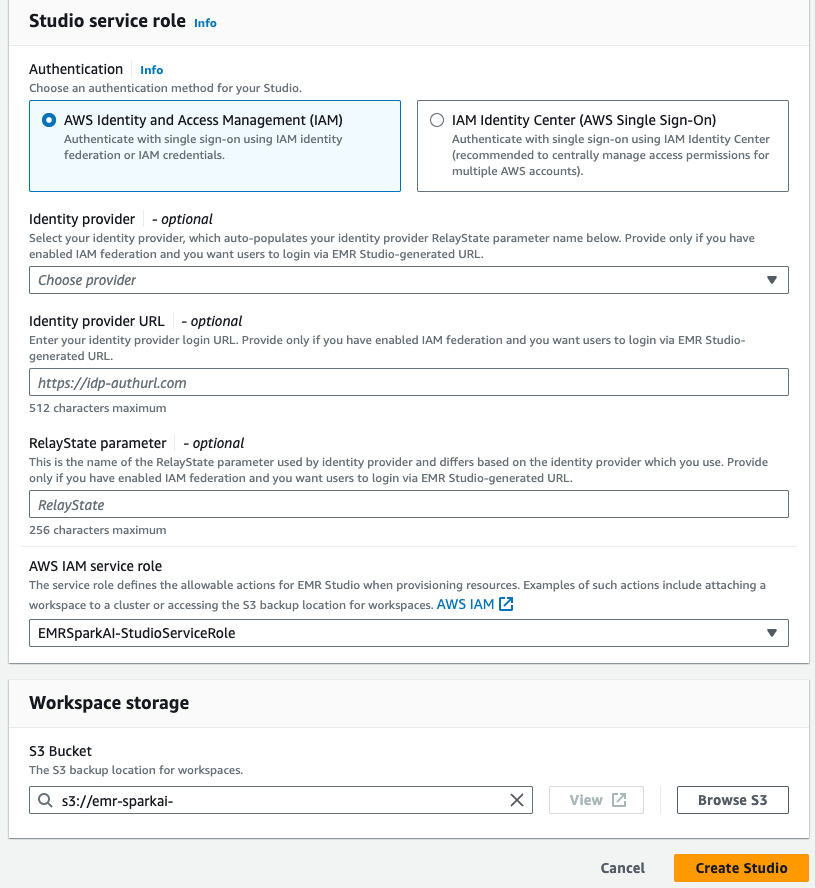

- W Rola obsługi studia sekcji, podaj następujące informacje:

- W razie zamówieenia projektu Uwierzytelnianie, Wybierz Zarządzanie tożsamością i dostępem AWS (IAM).

- W razie zamówieenia projektu Rola usługi AWS IAMwybierz

EMRSparkAI-StudioServiceRole.

- W Przechowywanie przestrzeni roboczej sekcję, przeglądaj i wybierz wiadro S3 do przechowywania, zaczynając od

emr-sparkai-<account-id>. - Dodaj Utwórz studio.

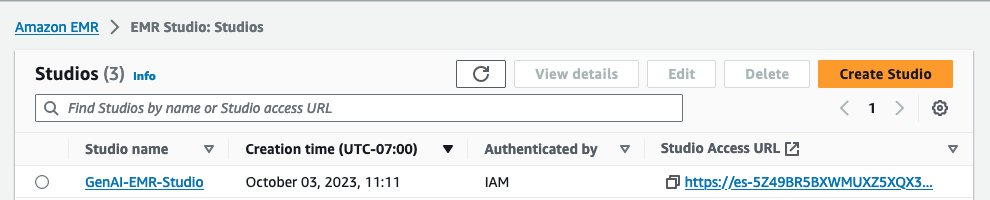

- Po utworzeniu Studia EMR wybierz link poniżej Adres URL dostępu do Studio aby uzyskać dostęp do Studia.

- Kiedy będziesz w Studio, wybierz Utwórz obszar roboczy.

- Dodaj

emr-genaijako nazwę obszaru roboczego i wybierz Utwórz obszar roboczy. - Po utworzeniu obszaru roboczego wybierz jego nazwę, aby uruchomić obszar roboczy (upewnij się, że wyłączyłeś wszelkie blokady wyskakujących okienek).

Analityka Big Data przy użyciu Apache Spark z Amazon EMR i generatywną sztuczną inteligencją

Teraz, gdy zakończyliśmy wymaganą konfigurację, możemy rozpocząć analizę dużych zbiorów danych przy użyciu Apache Spark z Amazon EMR i generatywną sztuczną inteligencją.

W pierwszym kroku ładujemy notatnik, który zawiera wymagany kod i przykłady do pracy z przypadkiem użycia. Korzystamy ze zbioru danych NY Taxi, który zawiera szczegółowe informacje na temat przejazdów taksówkami.

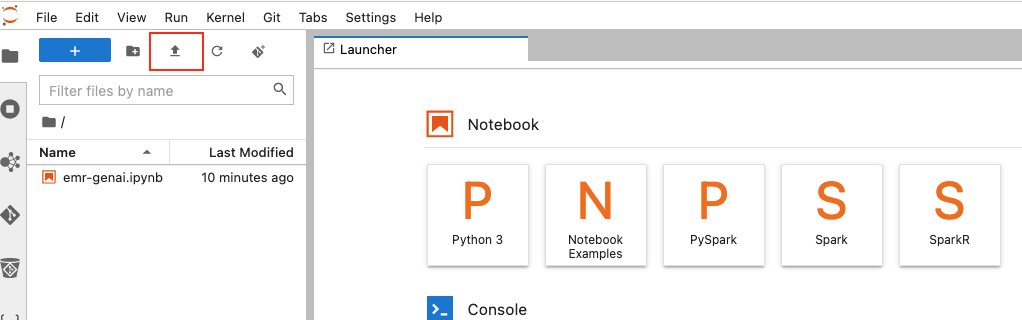

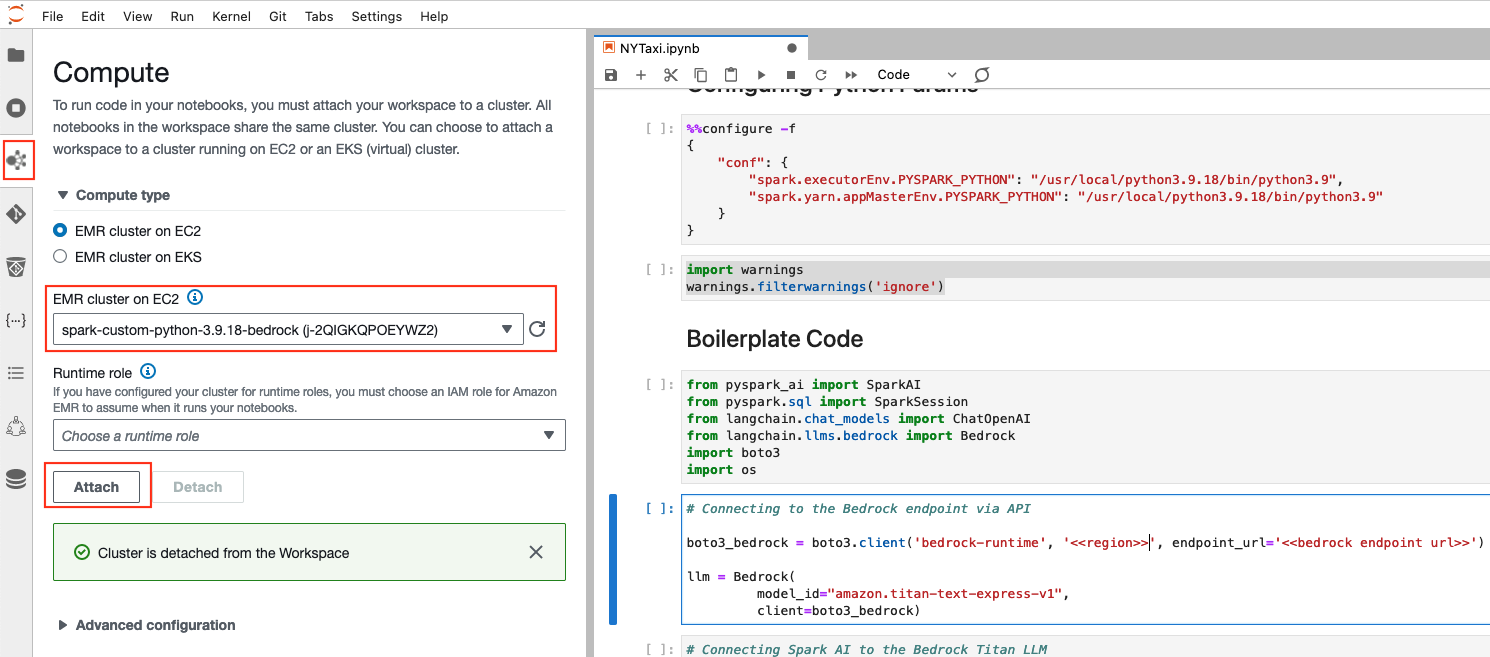

- Pobierz plik notatnika NYTaxi.ipynb i prześlij go do swojego obszaru roboczego, wybierając ikonę przesyłania.

- Po zaimportowaniu notatnika otwórz notatnik i wybierz

PySparkjako jądro.

Sztuczna inteligencja PySpark domyślnie używa ChatGPT4.0 OpenAI jako modelu LLM, ale możesz także podłączyć modele z Amazon Bedrock, Amazon SageMaker JumpStarti inne modele innych firm. W tym poście pokazujemy, jak zintegrować model Amazon Bedrock Titan do generowania zapytań SQL i uruchomić go za pomocą Apache Spark w Amazon EMR.

- Aby rozpocząć pracę z notatnikiem, musisz powiązać obszar roboczy z warstwą obliczeniową. W tym celu wybierz obliczać w panelu nawigacji i wybierz klaster EMR utworzony przez stos CloudFormation.

- Skonfiguruj parametry Pythona, aby używać zaktualizowanego pakietu Python 3.9 z Amazon EMR:

- Zaimportuj niezbędne biblioteki:

- Po zaimportowaniu bibliotek możesz zdefiniować model LLM z Amazon Bedrock. W tym przypadku używamy amazon.titan-text-express-v1. Musisz wprowadzić adres URL regionu i punktu końcowego Amazon Bedrock w oparciu o dostęp do podglądu modelu Titan Text G1 – Express.

- Połącz Spark AI z modelem Amazon Bedrock LLM w celu generowania zapytań SQL na podstawie pytań w języku naturalnym:

Tutaj zainicjowaliśmy Spark AI za pomocą verbose=False; możesz także ustawić verbose=True, aby zobaczyć więcej szczegółów.

Teraz możesz czytać dane NYC Taxi w ramce danych Spark i korzystać z mocy generatywnej sztucznej inteligencji w Spark.

- Możesz na przykład zapytać o liczbę rekordów w zbiorze danych:

Otrzymujemy następującą odpowiedź:

Spark AI wykorzystuje wewnętrznie LangChain i łańcuch SQL, które ukrywają złożoność przed użytkownikami końcowymi pracującymi z zapytaniami w Spark.

W notatniku znajduje się jeszcze kilka przykładowych scenariuszy pozwalających zbadać możliwości generatywnej sztucznej inteligencji za pomocą Apache Spark i Amazon EMR.

Sprzątać

Opróżnij zawartość wiadra S3 emr-sparkai-<account-id>, usuń obszar roboczy EMR Studio utworzony w ramach tego posta, a następnie usuń wdrożony stos CloudFormation.

Wnioski

W tym poście pokazano, jak możesz usprawnić analizę dużych zbiorów danych za pomocą Apache Spark z Amazon EMR i Amazon Bedrock. Pakiet PySpark AI umożliwia wyciąganie znaczących wniosków z danych. Pomaga skrócić czas programowania i analizy, skracając czas ręcznego pisania zapytań i umożliwiając skupienie się na biznesowym przypadku użycia.

O autorach

Saurabha Bhutyaniego jest głównym specjalistą ds. analityki i architektem rozwiązań w AWS. Pasjonuje się nowymi technologiami. Dołączył do AWS w 2019 roku i współpracuje z klientami, aby zapewnić wskazówki architektoniczne dotyczące uruchamiania generatywnych przypadków użycia sztucznej inteligencji, skalowalnych rozwiązań analitycznych i architektur siatki danych przy użyciu usług AWS, takich jak Amazon Bedrock, Amazon SageMaker, Amazon EMR, Amazon Athena, AWS Glue, AWS Lake Formation, i Amazon DataZone.

Saurabha Bhutyaniego jest głównym specjalistą ds. analityki i architektem rozwiązań w AWS. Pasjonuje się nowymi technologiami. Dołączył do AWS w 2019 roku i współpracuje z klientami, aby zapewnić wskazówki architektoniczne dotyczące uruchamiania generatywnych przypadków użycia sztucznej inteligencji, skalowalnych rozwiązań analitycznych i architektur siatki danych przy użyciu usług AWS, takich jak Amazon Bedrock, Amazon SageMaker, Amazon EMR, Amazon Athena, AWS Glue, AWS Lake Formation, i Amazon DataZone.

Harsh Vardhan jest starszym architektem rozwiązań AWS, specjalizującym się w analityce. Posiada ponad 8-letnie doświadczenie w pracy w obszarze big data i data science. Jego pasją jest pomaganie klientom w przyjmowaniu najlepszych praktyk i odkrywaniu wniosków z ich danych.

Harsh Vardhan jest starszym architektem rozwiązań AWS, specjalizującym się w analityce. Posiada ponad 8-letnie doświadczenie w pracy w obszarze big data i data science. Jego pasją jest pomaganie klientom w przyjmowaniu najlepszych praktyk i odkrywaniu wniosków z ich danych.

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- PlatoData.Network Pionowe generatywne AI. Wzmocnij się. Dostęp tutaj.

- PlatoAiStream. Inteligencja Web3. Wiedza wzmocniona. Dostęp tutaj.

- PlatonESG. Węgiel Czysta technologia, Energia, Środowisko, Słoneczny, Gospodarowanie odpadami. Dostęp tutaj.

- Platon Zdrowie. Inteligencja w zakresie biotechnologii i badań klinicznych. Dostęp tutaj.

- Źródło: https://aws.amazon.com/blogs/big-data/use-generative-ai-with-amazon-emr-amazon-bedrock-and-english-sdk-for-apache-spark-to-unlock-insights/

- :ma

- :Jest

- :nie

- $W GÓRĘ

- 1

- 10

- 100

- 107

- 11

- 20

- 200

- 2019

- 320

- 500

- 521

- 7

- 8

- 9

- 990

- a

- O nas

- dostęp

- zarządzanie dostępem

- Konto

- uznać

- Działania

- Dodaj

- Dodatkowy

- do tego

- przyjąć

- AI

- przypadki użycia ai

- Wszystkie kategorie

- Pozwalać

- pozwala

- również

- Amazonka

- Amazonka Atena

- Amazon EMR

- Amazon Sage Maker

- Amazon Web Services

- kwoty

- an

- analiza

- analityka

- i

- odpowiedź

- każdy

- Apache

- Apache Spark

- api

- aplikacje

- w przybliżeniu

- architektoniczny

- architektura

- SĄ

- Sztuka

- AS

- zapytać

- Współpracownik

- At

- dostępny

- uniknąć

- AWS

- Tworzenie chmury AWS

- Klej AWS

- Formacja AWS Lake

- z powrotem

- na podstawie

- BEST

- Najlepsze praktyki

- Poza

- Duży

- Big Data

- Bootstrap

- budować

- biznes

- ale

- przycisk

- by

- CAN

- walizka

- Etui

- katalog

- łańcuch

- Zmiany

- Opłaty

- Dodaj

- Wybierając

- Miasto

- Chmura

- duże zbiory danych w chmurze

- Grupa

- kod

- kombajny

- Firmy

- kompletny

- Zakończony

- kompleksowość

- obliczać

- połączony

- Łączność

- Konsola

- stale

- zawiera

- treść

- Koszty:

- Stwórz

- stworzony

- tworzy

- kreatywność

- Obecnie

- Klientów

- pionierski nowatorski

- dane

- Analityka danych

- analiza danych

- nauka danych

- Baza danych

- zbiory danych

- Data

- Domyślnie

- określić

- wykazać

- Zależności

- wdrażane

- czerpać

- opis

- zaprojektowany

- detale

- rozwijać

- oprogramowania

- różne

- niepełnosprawny

- odkryj

- do

- skutecznie

- bez wysiłku

- zakończenia

- Punkt końcowy

- Inżynieria

- Inżynierowie

- Angielski

- zapewnić

- Wchodzę

- wprowadzenie

- Środowisko

- Era

- niezbędny

- Eter (ETH)

- Parzyste

- przykład

- przykłady

- doświadczenie

- eksperyment

- odkryj

- ekspresowy

- wyciąg

- FAST

- Korzyści

- kilka

- pole

- filet

- finał

- i terminów, a

- Elastyczność

- Skupiać

- obserwuj

- następujący

- W razie zamówieenia projektu

- formacja

- Fundacja

- cztery

- Ramy

- od

- w pełni

- g1

- zbierać

- Bramka

- Generować

- generacja

- generatywny

- generatywna sztuczna inteligencja

- otrzymać

- Dający

- Go

- poradnictwo

- Have

- he

- pomoc

- pomoc

- pomaga

- Ukryty

- Ukryj

- W jaki sposób

- How To

- http

- HTTPS

- i

- IAM

- ICON

- ID

- tożsamość

- zarządzanie tożsamością i dostępem

- ilustruje

- wdrożenia

- importować

- in

- W innych

- Włącznie z

- wiodący w branży

- Informacja

- Innowacyjny

- wkład

- spostrzeżenia

- zainstalować

- instancje

- instrukcje

- integrować

- zintegrowany

- integracja

- zamierzony

- interakcji

- interaktywne

- wewnętrznie

- najnowszych

- IT

- JEGO

- Dołączył

- jpg

- Trzymać

- Klawisz

- Wiedzieć

- jezioro

- język

- duży

- firmy

- uruchomić

- warstwa

- prowadzący

- nauka

- biblioteki

- Biblioteka

- lubić

- Linia

- LINK

- załadować

- maszyna

- uczenie maszynowe

- robić

- WYKONUJE

- zarządzane

- i konserwacjami

- podręcznik

- rynek

- Może..

- wymowny

- siatka

- minimalny

- minuty

- ML

- model

- modele

- monitor

- jeszcze

- większość

- Nazwa

- Naturalny

- Język naturalny

- Nawigacja

- niezbędny

- Potrzebować

- potrzebne

- sieci

- Nowości

- Nowe technologie

- notatnik

- laptopy

- już dziś

- numer

- NY

- NYC

- obiekty

- obserwacja

- of

- Oferty

- on

- koncepcja

- open source

- or

- organizacji

- Inne

- Wyjścia

- koniec

- przegląd

- pakiet

- Pakiety

- chleb

- parametry

- część

- namiętny

- wykonywania

- uprawnienia

- Miejsce

- plato

- Analiza danych Platona

- PlatoDane

- plac zabaw dla dzieci

- wtyczka

- polityka

- pop-up

- Post

- potencjał

- power

- praktyki

- Podgląd

- Główny

- prywatny

- wygląda tak

- przetwarzanie

- Produkcja

- Postęp

- zapewniać

- pod warunkiem,

- dostawców

- zapewnia

- publiczny

- Python

- zapytania

- pytanie

- pytania

- szybko

- R

- Czytaj

- dokumentacja

- zmniejszyć

- redukcja

- odnosić się

- Bez względu

- region

- regiony

- usunąć

- wymagany

- Zasoby

- odpowiedź

- Efekt

- przejażdżki

- Rola

- role

- Trasa

- run

- bieganie

- działa

- sagemaker

- Scala

- Skalowalność

- skalowalny

- Skala

- skalowaniem

- scenariusze

- nauka

- Naukowcy

- Sdk

- poszukiwania

- Tajemnica

- bezpieczeństwo

- widzieć

- wybierać

- senior

- usługa

- Usługi

- zestaw

- ustawienie

- pokazać

- pokazał

- Prosty

- upraszczać

- pojedynczy

- So

- rozwiązanie

- Rozwiązania

- Źródło

- Iskra

- specjalista

- specjalizujący się

- prędkość

- SQL

- stos

- Półki na książki

- początek

- rozpoczęty

- Startowy

- Rynek

- Ewolucja krok po kroku

- Cel

- przechowywanie

- bezpośredni

- studio

- podsieci

- taki

- doładowania

- pewnie

- system

- stół

- Zadania

- trwa

- Technologies

- Technologia

- szablon

- XNUMX

- że

- Połączenia

- ich

- Im

- następnie

- one

- innych firm

- to

- myśl

- Przez

- czas

- Oś czasu

- tytan

- do

- narzędzia

- Top

- tradycyjny

- ui

- dla

- odblokować

- zaktualizowane

- URL

- posługiwać się

- przypadek użycia

- używany

- Użytkownik

- Użytkownicy

- zastosowania

- za pomocą

- wartość

- różnorodność

- różnorodny

- Naprawiono

- wyobrażać sobie

- Droga..

- sposoby

- we

- sieć

- usługi internetowe

- Web-based

- jeśli chodzi o komunikację i motywację

- który

- Podczas

- będzie

- w

- w ciągu

- bez

- Praca

- pracujący

- działa

- na calym swiecie

- napisać

- napisany

- lat

- york

- ty

- Twój

- zefirnet