Naukowcy z Intel Corporation opublikowali artykuł techniczny zatytułowany „Efficient LLM inference Solution on Intel GPU”.

Abstrakcyjny:

„Modele wielkojęzyczne oparte na transformatorach (LLM) są szeroko stosowane w wielu dziedzinach, a wydajność wnioskowania LLM staje się gorącym tematem w rzeczywistych zastosowaniach. Jednak LLM są zwykle zaprojektowane w skomplikowanej strukturze modelu z masowymi operacjami i wykonują wnioskowanie w trybie autoregresji, co sprawia, że zaprojektowanie systemu o wysokiej wydajności jest trudnym zadaniem.

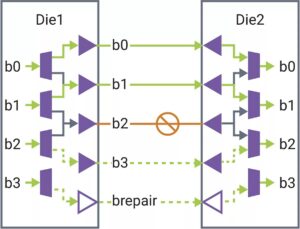

W tym artykule proponujemy wydajne rozwiązanie wnioskowania LLM o niskim opóźnieniu i dużej przepustowości. Po pierwsze, upraszczamy warstwę dekodera LLM, łącząc ruch danych i operacje na elementach, aby zmniejszyć częstotliwość dostępu do pamięci i mniejsze opóźnienia systemu. Proponujemy również politykę pamięci podręcznej segmentu KV, aby przechowywać klucz/wartość tokenów żądań i odpowiedzi w oddzielnej pamięci fizycznej w celu efektywnego zarządzania pamięcią urządzenia, pomagając zwiększyć rozmiar wsadu środowiska wykonawczego i poprawić przepustowość systemu. Dostosowane jądro Scaled-Dot-Product-Attention zostało zaprojektowane tak, aby pasowało do naszej polityki fuzji opartej na rozwiązaniu pamięci podręcznej segmentu KV. Wdrażamy nasze rozwiązanie wnioskowania LLM na procesorze graficznym Intel i publikujemy je publicznie. W porównaniu ze standardową implementacją HuggingFace proponowane rozwiązanie osiąga do 7 razy mniejsze opóźnienia tokena i 27 razy większą przepustowość w przypadku niektórych popularnych LLM na procesorach graficznych Intel.

Znajdź papier techniczny tutaj. Opublikowano w grudniu 2023 r. (przeddruk).

Wu, Hui, Yi Gan, Feng Yuan, Jing Ma, Wei Zhu, Yutao Xu, Hong Zhu, Yuhua Zhu, Xiaoli Liu i Jinghui Gu. „Wydajne rozwiązanie do wnioskowania LLM na procesorze graficznym Intel”. Przedruk arXiv arXiv:2401.05391 (2023).

Powiązane artykuły

Wnioskowanie LLM na procesorach (Intel)

Naukowcy z firmy Intel opublikowali artykuł techniczny zatytułowany „Efficient LLM Inference on CPUs”.

AI ściga się do krawędzi

W miarę rozprzestrzeniania się sztucznej inteligencji na nowe zastosowania, wnioskowanie i niektóre szkolenia są przenoszone na mniejsze urządzenia.

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- PlatoData.Network Pionowe generatywne AI. Wzmocnij się. Dostęp tutaj.

- PlatoAiStream. Inteligencja Web3. Wiedza wzmocniona. Dostęp tutaj.

- PlatonESG. Węgiel Czysta technologia, Energia, Środowisko, Słoneczny, Gospodarowanie odpadami. Dostęp tutaj.

- Platon Zdrowie. Inteligencja w zakresie biotechnologii i badań klinicznych. Dostęp tutaj.

- Źródło: https://semiengineering.com/llm-inference-on-gpus-intel/

- :Jest

- $W GÓRĘ

- 2023

- a

- dostęp

- Osiąga

- AI

- również

- an

- i

- aplikacje

- SĄ

- AS

- At

- na podstawie

- staje się

- być

- jest

- by

- Pamięć podręczna

- wyzwanie

- w porównaniu

- KORPORACJA

- dostosowane

- dane

- grudzień

- Wnętrze

- zaprojektowany

- urządzenie

- urządzenia

- Efektywne

- efektywność

- wydajny

- powiększać

- Łąka

- W razie zamówieenia projektu

- Częstotliwość

- łączenie

- fuzja

- GPU

- GPU

- Have

- pomoc

- tutaj

- Wysoki

- wyższy

- Hong

- HOT

- Jednak

- HTTPS

- Przytulanie twarzy

- wdrożenia

- realizacja

- podnieść

- in

- Intel

- IT

- jpg

- Trzymać

- język

- duży

- Utajenie

- warstwa

- llm

- niski

- niższy

- Dokonywanie

- i konserwacjami

- wiele

- masywny

- Mecz

- Pamięć

- Moda

- model

- modele

- ruch

- Nowości

- of

- on

- koncepcja

- operacje

- ludzkiej,

- Papier

- wykonać

- fizyczny

- plato

- Analiza danych Platona

- PlatoDane

- polityka

- Popularny

- zaproponować

- zaproponowane

- publicznie

- publikować

- opublikowany

- popychany

- wyścigi

- real

- zmniejszyć

- zażądać

- Badacze

- odpowiedź

- segment

- oddzielny

- upraszczać

- Rozmiar

- mniejszy

- rozwiązanie

- kilka

- Spready

- standard

- Struktura

- system

- Zadanie

- Techniczny

- Połączenia

- to

- wydajność

- pod tytulem

- do

- żeton

- Żetony

- aktualny

- Trening

- używany

- zazwyczaj

- była

- we

- szeroko

- w

- Yuan

- zefirnet