Inside the Tech is een blogreeks die bij onze blogserie hoort Tech Talks-podcast. In aflevering 20 van de podcast, The Evolution of Roblox Avatars, sprak Roblox CEO David Baszucki met Senior Director of Engineering Kiran Bhat, Senior Director of Product Mahesh Ramasubramanian en Principal Product Manager Effie Goenawan, over de toekomst van meeslepende communicatie via avatars en de technische uitdagingen die we oplossen om dit mogelijk te maken. In deze editie van Inside the Tech spraken we met Senior Engineering Manager Andrew Portner om meer te leren over een van die technische uitdagingen, veiligheid in meeslepende spraakcommunicatie, en hoe het werk van het team helpt een veilige en civiele digitale omgeving voor iedereen te bevorderen. ons platform.

Wat zijn de grootste technische uitdagingen waarmee uw team wordt geconfronteerd?

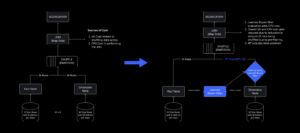

Wij geven prioriteit aan het behouden van een veilige en positieve ervaring voor onze gebruikers. Veiligheid en beleefdheid zijn voor ons altijd top of mind, maar het in realtime verwerken ervan kan een grote technische uitdaging zijn. Wanneer er zich een probleem voordoet, willen we dit kunnen beoordelen en in realtime actie kunnen ondernemen, maar gezien onze omvang is dit een uitdaging. Om effectief met deze schaal om te kunnen gaan, moeten we gebruik maken van geautomatiseerde veiligheidssystemen.

Een andere technische uitdaging waar we ons op richten is de nauwkeurigheid van onze veiligheidsmaatregelen voor moderatie. Er zijn twee moderatiebenaderingen om beleidsschendingen aan te pakken en in realtime nauwkeurige feedback te geven: reactieve en proactieve moderatie. Voor reactieve moderatie ontwikkelen we machine learning-modellen (ML) om verschillende soorten beleidsschendingen nauwkeurig te identificeren. Deze werken door te reageren op rapporten van mensen op het platform. Proactief werken we aan realtime detectie van potentieel inhoud die ons beleid schendt, gebruikers informeren over hun gedrag. Het gesproken woord begrijpen en de audiokwaliteit verbeteren is een complex proces. We zien al vooruitgang, maar ons uiteindelijke doel is om een zeer nauwkeurig model te hebben dat beleidsschendend gedrag in realtime kan detecteren.

Wat zijn enkele van de innovatieve benaderingen en oplossingen die we gebruiken om deze technische uitdagingen aan te pakken?

We hebben een end-to-end ML-model ontwikkeld dat audiogegevens kan analyseren en een betrouwbaarheidsniveau biedt op basis van het type beleidsschendingen (bijvoorbeeld hoe waarschijnlijk is dit pesten, godslastering, enz.). Dit model heeft ons vermogen om bepaalde rapporten automatisch te sluiten aanzienlijk verbeterd. We ondernemen actie wanneer ons model vertrouwen heeft en er zeker van kan zijn dat het beter presteert dan mensen. Binnen slechts een paar maanden na de lancering konden we met dit model vrijwel alle Engelstalige meldingen van stemmisbruik modereren. We hebben deze modellen intern ontwikkeld en het is een bewijs van de samenwerking tussen veel open source-technologieën en ons eigen werk om de technologie erachter te creëren.

Bepalen wat in realtime gepast is, lijkt behoorlijk complex. Hoe werkt dat?

Er is veel aandacht besteed aan het contextueel bewust maken van het systeem. We kijken ook naar patronen in de loop van de tijd voordat we actie ondernemen, zodat we er zeker van kunnen zijn dat onze acties gerechtvaardigd zijn. Ons beleid is genuanceerd afhankelijk van de leeftijd van een persoon, of deze zich nu in een openbare ruimte of een privéchat bevindt, en vele andere factoren. We onderzoeken nieuwe manieren om beleefdheid in realtime te bevorderen en ML vormt daarbij de kern. We hebben onlangs geautomatiseerde pushmeldingen (of ‘nudges’) gelanceerd om gebruikers aan ons beleid te herinneren. We onderzoeken ook andere factoren, zoals de toon van de stem, om iemands bedoelingen beter te begrijpen en zaken als sarcasme of grappen te onderscheiden. Ten slotte bouwen we ook aan een meertalig model, omdat sommige mensen meerdere talen spreken of zelfs halverwege een zin van taal wisselen. Om dit allemaal mogelijk te maken, moeten we over een nauwkeurig model beschikken.

Momenteel concentreren we ons op het aanpakken van de meest prominente vormen van misbruik, zoals intimidatie, discriminatie en godslastering. Deze vormen het merendeel van de misbruikmeldingen. Ons doel is om op deze gebieden een aanzienlijke impact te hebben en de industrienormen te bepalen voor hoe het bevorderen en onderhouden van een burgerlijk online gesprek eruit ziet. We zijn enthousiast over het potentieel van het gebruik van ML in realtime, omdat het ons in staat stelt om op effectieve wijze een veilige en civiele ervaring voor iedereen te bevorderen.

Hoe zijn de uitdagingen die we bij Roblox oplossen uniek? Wat kunnen we als eerste oplossen?

Onze Chat met ruimtelijke stem technologie creëert een meer meeslepende ervaring, die communicatie uit de echte wereld nabootst. Als ik bijvoorbeeld links van iemand sta, hoort hij mij in zijn linkeroor. We creëren een analogie met hoe communicatie in de echte wereld werkt en dit is een uitdaging die we als eerste moeten oplossen.

Als gamer ben ik getuige geweest van veel intimidatie en pesterijen bij online gamen. Het is een probleem dat vaak niet onder controle blijft vanwege de anonimiteit van de gebruiker en het gebrek aan gevolgen. De technische uitdagingen die we hiermee aanpakken, zijn echter uniek voor waar andere platforms op een aantal gebieden mee te maken hebben. Op sommige spelplatforms zijn interacties beperkt tot teamgenoten. Roblox biedt verschillende manieren om rond te hangen in een sociale omgeving die het echte leven beter nabootst. Dankzij de vooruitgang op het gebied van ML en realtime signaalverwerking zijn we in staat misbruikgedrag effectief te detecteren en aan te pakken, wat betekent dat we niet alleen een realistischere omgeving hebben, maar ook een omgeving waarin iedereen zich veilig voelt om te communiceren en contact te maken met anderen. De combinatie van onze technologie, ons meeslepende platform en onze toewijding om gebruikers voor te lichten over ons beleid stelt ons in staat deze uitdagingen het hoofd te bieden.

Wat zijn enkele van de belangrijkste dingen die je hebt geleerd tijdens dit technische werk?

Ik heb het gevoel dat ik veel heb geleerd. Ik ben geen ML-ingenieur. Ik heb vooral aan de front-end in gaming gewerkt, dus het was enorm fijn om dieper te kunnen ingaan op de werking van deze modellen dan ik ooit heb gedaan. Ik hoop dat de acties die we ondernemen om beleefdheid te bevorderen zich vertalen in een niveau van empathie in de online gemeenschap dat tot nu toe ontbrak.

Een laatste les is dat alles afhangt van de trainingsgegevens die u invoert. En om de gegevens accuraat te laten zijn, moeten mensen het eens zijn over de labels die worden gebruikt om bepaald beleidschendend gedrag te categoriseren. Het is erg belangrijk om te trainen op kwaliteitsgegevens waar iedereen het over eens kan zijn. Het is een heel moeilijk probleem om op te lossen. Je begint gebieden te zien waar ML ver vooruit is op al het andere, en dan andere gebieden waar het zich nog in de beginfase bevindt. Er zijn nog steeds veel gebieden waar ML nog steeds groeit, dus het is van cruciaal belang dat u zich bewust bent van de huidige beperkingen ervan.

Met welke Roblox-waarde sluit uw team het meest aan?

Het respecteren van de gemeenschap is onze leidende waarde tijdens dit proces. Ten eerste moeten we ons concentreren op het verbeteren van de beleefdheid en het terugdringen van beleidsschendingen op ons platform. Dit heeft een aanzienlijke impact op de algehele gebruikerservaring. Ten tweede moeten we zorgvuldig overwegen hoe we deze nieuwe functies uitrollen. We moeten rekening houden met valse positieven (bijvoorbeeld het ten onrechte markeren van iets als misbruik) in het model en voorkomen dat gebruikers ten onrechte worden gestraft. Het monitoren van de prestaties van onze modellen en hun impact op de gebruikersbetrokkenheid is van cruciaal belang.

Wat boeit je het meest aan waar Roblox en je team naartoe gaan?

We hebben aanzienlijke vooruitgang geboekt bij het verbeteren van de publieke spraakcommunicatie, maar er moet nog veel meer worden gedaan. Privécommunicatie is een spannend gebied om te verkennen. Ik denk dat er een enorme kans bestaat om de privécommunicatie te verbeteren, om gebruikers in staat te stellen zich te uiten tegenover goede vrienden, om een telefoongesprek te voeren over ervaringen of tijdens een ervaring terwijl ze met hun vrienden communiceren. Ik denk dat er ook een mogelijkheid is om deze gemeenschappen te stimuleren met betere tools, zodat gebruikers zichzelf kunnen organiseren, lid kunnen worden van gemeenschappen, inhoud kunnen delen en ideeën kunnen delen.

Hoe kunnen we, terwijl we blijven groeien, onze chattechnologie schalen om deze groeiende gemeenschappen te ondersteunen? We staan nog maar aan het begin van veel van wat we kunnen doen, en ik denk dat er een kans is om de beleefdheid van online communicatie en samenwerking in de hele sector te verbeteren op een manier die nog niet eerder is gedaan. Met de juiste technologie en ML-mogelijkheden bevinden we ons in een unieke positie om de toekomst van civiele online communicatie vorm te geven.

- Door SEO aangedreven content en PR-distributie. Word vandaag nog versterkt.

- PlatoData.Network Verticale generatieve AI. Versterk jezelf. Toegang hier.

- PlatoAiStream. Web3-intelligentie. Kennis versterkt. Toegang hier.

- PlatoESG. carbon, CleanTech, Energie, Milieu, Zonne, Afvalbeheer. Toegang hier.

- Plato Gezondheid. Intelligentie op het gebied van biotech en klinische proeven. Toegang hier.

- Bron: https://blog.roblox.com/2024/01/inside-the-tech-solving-for-safety-in-immersive-voice-communication/

- : heeft

- :is

- :niet

- :waar

- $UP

- 20

- a

- vermogen

- in staat

- Over

- misbruik

- nauwkeurigheid

- accuraat

- nauwkeurig

- over

- Actie

- acties

- adres

- aanpakken

- vooruitgang

- Na

- leeftijd

- vooruit

- streven

- richten

- Alles

- toelaten

- bijna

- al

- ook

- altijd

- an

- analyseren

- en

- Andrew

- anonimiteit

- elke

- benaderingen

- passend

- ZIJN

- GEBIED

- gebieden

- rond

- AS

- At

- audio

- geautomatiseerde

- webmaster.

- Avatars

- vermijd

- bewust

- gebaseerde

- BE

- geweest

- vaardigheden

- beginnen

- gedrag

- achter

- wezen

- Betere

- tussen

- Groot

- Grootste

- Blog

- Gebouw

- pesten

- maar

- by

- Bellen

- CAN

- mogelijkheden

- voorzichtig

- ceo

- zeker

- uitdagen

- uitdagingen

- uitdagend

- kans

- de chat

- burgerlijk

- Sluiten

- van nabij

- cognizant

- samenwerking

- combinatie van

- verplichting

- Communicatie

- Gemeenschappen

- gemeenschap

- complex

- vertrouwen

- zeker

- Verbinden

- Gevolgen

- Overwegen

- aanzienlijk

- content

- voortzetten

- Gesprek

- Koppel

- en je merk te creëren

- creëert

- Wij creëren

- cruciaal

- Actueel

- gegevens

- David

- transactie

- diepere

- Afhankelijk

- afhankelijk

- opsporen

- Opsporing

- ontwikkelde

- het ontwikkelen van

- anders

- digitaal

- Director

- Discriminatie

- onderscheiden

- do

- doet

- doen

- gedaan

- twee

- gedurende

- e

- Vroeg

- editie

- opleiden

- effectief

- anders

- Empathie

- in staat stellen

- maakt

- einde

- eind tot eind

- engagement

- ingenieur

- Engineering

- Engels

- Milieu

- aflevering

- etc

- Zelfs

- iedereen

- alles

- Evolutie

- opgewonden

- opgewonden

- opwindend

- uit te breiden

- ervaring

- Ervaringen

- Verken

- Verkennen

- uitdrukkelijk

- naar

- factoren

- vals

- Voordelen

- feedback

- voelen

- voelt zich

- Voornaam*

- Focus

- gericht

- Voor

- formulieren

- Bevorderen

- vrienden

- oppompen van

- voor

- Voorkant

- toekomst

- gaming

- gegeven

- Go

- doel

- Goes

- gaan

- Groeien

- Groeiend

- leidend

- handvol

- handvat

- Behandeling

- lastig vallen

- Hard

- Hebben

- hoofd

- opschrift

- horen

- Hart

- het helpen van

- zeer

- hoop

- Hoe

- Echter

- HTTPS

- reusachtig

- Mensen

- i

- ideeën

- identificeren

- if

- meeslepende

- Impact

- belangrijk

- verbeteren

- verbeterd

- het verbeteren van

- in

- onjuist

- -industrie

- innovatieve

- binnen

- instantie

- intenties

- interactie

- interacties

- in

- kwestie

- IT

- HAAR

- mee

- voor slechts

- gerechtvaardigde

- sleutel

- labels

- Gebrek

- ontbreekt

- Talen

- Achternaam*

- tot slot

- gelanceerd

- lancering

- LEARN

- geleerd

- leren

- links

- Niveau

- Hefboomwerking

- Life

- als

- Waarschijnlijk

- Beperkt

- grenzen

- Kijk

- op zoek

- LOOKS

- lot

- machine

- machine learning

- gemaakt

- behoud van

- Meerderheid

- maken

- maken

- manager

- veel

- het merken

- me

- middel

- maatregelen

- denken

- ML

- model

- modellen

- matig

- gematigdheid

- Grensverkeer

- maanden

- meer

- meest

- meestal

- veel

- meervoudig

- Dan moet je

- my

- mezelf

- Noodzaak

- New

- Nieuwe mogelijkheden

- normen

- meldingen

- of

- Aanbod

- vaak

- on

- EEN

- online.

- online gaming

- Slechts

- open

- open source

- kansen

- or

- bestellen

- Overige

- Overig

- onze

- uit

- presteert beter

- over

- totaal

- het te bezitten.

- patronen

- Mensen

- prestatie

- platform

- platforms

- Plato

- Plato gegevensintelligentie

- PlatoData

- Podcast

- beleidsmaatregelen door te lezen.

- beleidsmaatregelen

- positie

- positief

- mogelijk

- potentieel

- energie

- nauwkeurig

- mooi

- Principal

- prioriteren

- privaat

- Proactieve

- probleem

- verwerking

- Product

- product manager

- VULGAIR TAALGEBRUIK

- Voortgang

- vooraanstaand

- promoten

- Het bevorderen van

- zorgen voor

- biedt

- publiek

- Duwen

- zetten

- puts

- kwaliteit

- kwaliteit van de gegevens

- vast

- echte leven

- echte wereld

- real-time

- realistisch

- werkelijk

- onlangs

- vermindering

- Rapporten

- reageert

- beoordelen

- rechts

- roblox

- Rollen

- veilig

- Veiligheid

- Sarcasme

- Scale

- Tweede

- zien

- te zien

- lijkt

- senior

- -Series

- reeks

- Vorm

- Delen

- Signaal

- aanzienlijke

- aanzienlijk

- sinds

- So

- Social

- Oplossingen

- OPLOSSEN

- Het oplossen van

- sommige

- Iemand

- iets

- bron

- Tussenruimte

- ruimtelijke

- spreken

- gesproken

- stadia

- staand

- Still

- dergelijk

- ondersteuning

- zeker

- Oppervlak

- Stap over voor slechts

- system

- Systems

- aanpakken

- aanpakken

- Nemen

- het nemen

- Talks

- team

- tech

- Technisch

- Technologies

- Technologie

- testament

- neem contact

- dat

- De

- De toekomst

- hun

- zich

- harte

- Er.

- Deze

- ze

- spullen

- denken

- dit

- die

- gedachte

- Door

- overal

- niet de tijd of

- naar

- TONE

- Tone of Voice

- tools

- top

- Trainen

- Trainingen

- vertalen

- twee

- type dan:

- types

- ultieme

- begrijpen

- begrip

- unieke

- us

- gebruikt

- Gebruiker

- Gebruikerservaring

- gebruikers

- gebruik

- waarde

- variëteit

- Overtredingen

- Stem

- willen

- Manier..

- manieren

- we

- waren

- Wat

- Wat is

- wanneer

- of

- welke

- en

- Met

- binnen

- getuige

- Woord

- Mijn werk

- werkte

- werkzaam

- Bedrijven

- wereld

- u

- Your

- zephyrnet