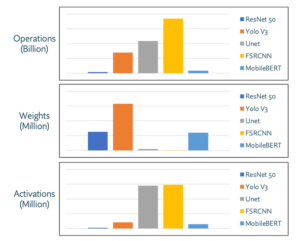

実のところ、私たちは人工知能 (AI) 革命の始まりにすぎません。 AI の機能は、まさに今、将来の兆しを見せ始めたところです。 たとえば、自動車は大規模で複雑なニューラル ネットワーク モデルを使用して、環境を理解するだけでなく、自動車自体を操縦および制御しています。 どのようなアプリケーションでも、有用なネットワークを作成するにはトレーニング データが必要です。 有用な実世界のデータがモデルに組み込まれるにつれて、トレーニング操作と推論操作の両方のサイズが急速に増大しています。 近年のモデルの成長を見て、それがトレーニングと推論のための処理能力のニーズをどのように促進しているかを理解しましょう。

Ansys 2021 Ideas Digital Forum のプレゼンテーションで、Cerebras のエンジニアリング担当副社長 Dhiraj Mallik は、ニューラル ネットワーク モデルの成長についての洞察を提供しました。 過去 1000 年間で、モデルのサイズは BERT Base (110 MB) から GPT-3 (175 GB) まで 1 倍に増加しました。 そして近日中には、サイズが 1 TB の MSFT-3T モデルも登場します。 GPT-1024 モデルは、それ自体興味深いトピックですが、4 個の GPU を使用する従来のハードウェアで 3 か月間トレーニングされました。 これは、インターネットやその他のソース上のほとんどのテキスト データを使用する自然言語処理 (NLP) モデルです。 これは Open AI によって開発され、現在は OpenAI Codex の基礎となっています。OpenAI Codex は、ユーザーからの平易な言語の指示から複数の言語で有用なプログラミング コードを作成できるアプリケーションです。 GPT-XNUMX を使用すると、大多数の読者には AI プログラムによって書かれたとは分からないような短い記事を書くことができます。

上からわかるように、1024 個の GPU を 4 か月間実行することは現実的ではありません。 「前例のない AP 加速の実現: ムーアの法則を超えて」と題した講演の中で、Dhiraj 氏は、このレベルの半導体成長をサポートするために必要な進歩は、私たちが見慣れているムーアの法則をはるかに超えていると主張しています。 この認識された市場ニーズに応えて、Cerebras は 1 年に、これまでに製造されたどのチップよりも 2019 倍大きい、ウェーハ スケール AI エンジン WSE-56 をリリースしました。 2 年半後、同社は WSE-XNUMX を発表しました。これもまた、以下を搭載した最大のチップです。

- 6兆個のトランジスタ

- 850,000 個の最適化された AI コア

- 40 GBのRAM

- 20ペタバイト/秒のメモリ帯域幅

- 220 ペタバイトのファブリック帯域幅

- TSMCのN7プロセスで構築

- ウェハには 84 個のダイ (それぞれ 550 mm) が含まれています2.

WSE-2 をカプセル化する CS-2 システムは、120 兆のパラメータを持つ AI モデルに適合できます。 さらに驚くべきことは、CS-2 システムを 192 ユニットのクラスタに組み込んで、ほぼ線形のパフォーマンス向上を実現できることです。 Cerebras は、メモリと計算を分離して、非常に大規模なモデルのスケーリングとスループットの向上を実現するメモリ サブシステムを開発しました。 Cerebras は、時間と電力を節約するトレーニング セットのスパース性の最適化も開発しました。

Dhiraj のプレゼンテーションでは、その機能、特にスループットと容量を維持するために大規模なモデルで効率的にスケーリングする領域について詳しく説明します。 半導体の観点から見ると、これまで半導体業界が試みたものよりも 2 桁大きい設計において、Cerebras が IR ドロップ、エレクトロマイグレーション、ESD サインオフをどのように分析したかを見るのも興味深いです。 Dhiraj 氏は、Cerebras が静的および動的 IR ドロップ サインオフのために、設計の各レベル (タイル、ブロック、フル ウェーハ) で複数の CPU にわたって Ansys RedHawk-SC をどのように使用したかについて語ります。 RedHawk-SC は、電力エレクトロマイグレーションと信号エレクトロマイグレーションのチェックにも使用されました。 同様に、ESD 耐性と電流密度のチェックに Ansys Pathfinder を使用しました。

7nm というこれほど大きなシリコンでは、ツールの決定は文字通り「成功するか失敗するか」です。 これほど破壊的なシリコンを構築するには、開発プロセスにおいて非常によく検討された多くの選択が必要であり、もちろん比類のない能力が主な関心事です。 しかし、Dhiraj のプレゼンテーションが明確に示しているように、AI/ML モデルで見られる成長率を管理するには、CS-2 の処理能力の向上が必要です。 今日、AIの分野で私たちの想像を超える革新が起こることは間違いありません。 Web やクラウドがテクノロジー、さらには社会を変えたのと同じように、新しい AI テクノロジーの開発によって世界が劇的に変わることが予想されます。 Cerebras シリコンについてさらに詳しく知りたい場合は、Ansys IDEAS Digital Forum での Dhiraj のプレゼンテーションをご覧ください。 www.ansys.com/ideas.

- 000

- 110

- 2019

- 2021

- 84

- AI

- 発表の

- 申し込み

- AREA

- 物品

- 建物

- 容量

- 自動車

- 変化する

- 小切手

- チップ

- クラウド

- コード

- 電流プローブ

- データ

- 設計

- 詳細

- 開発

- デジタル

- Drop

- エンジニアリング

- 環境

- ファブリック

- フィット

- フル

- 未来

- GPU

- 成長

- 成長性

- Hardware

- 認定条件

- HTTPS

- 産業を変えます

- インターネット

- IT

- 言語

- ESL, ビジネスESL <br> 中国語/フランス語、その他

- 大

- 法律

- 学習

- レベル

- 大多数

- 市場

- ヶ月

- 自然言語

- 自然言語処理

- 近く

- ネットワーク

- ネットワーク

- ニューラル

- ニューラルネットワーク

- NLP

- 開いた

- OpenAI

- 業務執行統括

- 受注

- その他

- パフォーマンス

- 視点

- 電力

- 生産された

- 演奏曲目

- プログラミング

- 読者

- 応答

- ランニング

- 規模

- スケールai

- スケーリング

- 半導体

- ショート

- サイズ

- 社会

- サポート

- システム

- トーク

- テクノロジー

- 未来

- 時間

- トレーニング

- users

- ウェブ

- 何ですか

- 世界

- 年

- 年