Autore: Vitalik Buterin tramite il Blog di Vitalik Buterin

Un ringraziamento speciale ai team di Worldcoin e Modulus Labs, Xinyuan Sun, Martin Koeppelmann e Illia Polosukhin per feedback e discussioni.

Molte persone nel corso degli anni mi hanno posto una domanda simile: cosa sono i intersezioni tra criptovaluta e intelligenza artificiale che considero la più fruttuosa? È una domanda ragionevole: le criptovalute e l'intelligenza artificiale sono le due principali tendenze tecnologiche (software) profonde dell'ultimo decennio, e sembra proprio che lì devono obbligatoriamente: essere una sorta di connessione tra i due. È facile trovare sinergie a livello superficiale: la decentralizzazione delle criptovalute può farlo bilanciare la centralizzazione dell’IA, L'intelligenza artificiale è opaca e la crittografia porta trasparenza, l'intelligenza artificiale ha bisogno di dati e le blockchain sono utili per archiviare e tracciare i dati. Ma nel corso degli anni, quando le persone mi chiedevano di approfondire e parlare di applicazioni specifiche, la mia risposta è stata deludente: “sì, ci sono alcune cose ma non così tante”.

Negli ultimi tre anni, con l'ascesa di un'intelligenza artificiale molto più potente sotto forma di moderna LLMe l'ascesa di criptovalute molto più potenti sotto forma non solo di soluzioni di ridimensionamento blockchain ma anche ZKP, FHE, (bipartitico e N-partitico) MPC, sto iniziando a vedere questo cambiamento. Esistono infatti alcune applicazioni promettenti dell’intelligenza artificiale all’interno degli ecosistemi blockchain, o L’intelligenza artificiale insieme alla crittografia, anche se è importante fare attenzione a come viene applicata l'intelligenza artificiale. Una sfida particolare è: nella crittografia, l’open source è l’unico modo per rendere qualcosa veramente sicuro, ma nell’intelligenza artificiale, un modello (o anche i suoi dati di addestramento) essendo aperto aumenta notevolmente la sua vulnerabilità a apprendimento automatico del contraddittorio attacchi. Questo post esaminerà una classificazione dei diversi modi in cui criptovaluta e intelligenza artificiale potrebbero intersecarsi, nonché le prospettive e le sfide di ciascuna categoria.

Un riepilogo di alto livello delle intersezioni cripto+AI da a post sul blog uETH. Ma cosa serve per realizzare effettivamente una qualsiasi di queste sinergie in un’applicazione concreta?

Le quattro categorie principali

L’intelligenza artificiale è un concetto molto ampio: si può pensare all’“AI” come all’insieme di algoritmi che si creano non specificandoli esplicitamente, ma piuttosto mescolando un grande brodo computazionale e inserendo una sorta di pressione di ottimizzazione che spinge il brodo verso producendo algoritmi con le proprietà desiderate. Questa descrizione non dovrebbe assolutamente essere presa in modo sprezzante: it inclusi , il processi che creato noi umani in primis! Ma ciò significa che gli algoritmi di intelligenza artificiale hanno alcune proprietà comuni: la loro capacità di fare cose estremamente potenti, insieme ai limiti nella nostra capacità di conoscere o comprendere cosa succede sotto il cofano.

Esistono molti modi per classificare l'intelligenza artificiale; ai fini di questo post, che parla delle interazioni tra AI e blockchain (che sono state descritte come una piattaforma per creare “giochi”), lo classificherò come segue:

- AI come giocatore in un gioco [massima vitalità]: Le IA partecipano a meccanismi in cui la fonte ultima degli incentivi proviene da un protocollo con input umani.

- L'intelligenza artificiale come interfaccia del gioco [alto potenziale, ma con rischi]: L'intelligenza artificiale aiuta gli utenti a comprendere il mondo crittografico che li circonda e a garantire che il loro comportamento (ad esempio messaggi e transazioni firmati) corrisponda alle loro intenzioni e non vengano ingannati o truffati.

- L'intelligenza artificiale come regole del gioco [procedere con molta attenzione]: blockchain, DAO e meccanismi simili che richiamano direttamente le IA. Pensa ad es. “Giudici dell’IA”

- L'intelligenza artificiale come obiettivo del gioco [a lungo termine ma intrigante]: progettare blockchain, DAO e meccanismi simili con l'obiettivo di costruire e mantenere un'intelligenza artificiale che potrebbe essere utilizzata per altri scopi, utilizzando i bit crittografici per incentivare meglio la formazione o per impedire che l'intelligenza artificiale trapeli dati privati o venga utilizzata in modo improprio.

Esaminiamoli uno per uno.

AI come giocatore in un gioco

Questa è in realtà una categoria che esiste da quasi un decennio, almeno da allora Scambi decentralizzati on-chain (DEX) ha iniziato a vedere un uso significativo. Ogni volta che avviene uno scambio, c’è l’opportunità di guadagnare denaro attraverso l’arbitraggio, e i robot possono fare arbitraggio molto meglio degli umani. Questo caso d’uso esiste da molto tempo, anche con IA molto più semplici di quelle che abbiamo oggi, ma alla fine è una vera e propria intersezione AI + criptovaluta. Più recentemente, abbiamo visto i bot di arbitraggio MEV spesso sfruttandosi a vicenda. Ogni volta che hai un'applicazione blockchain che prevede aste o scambi, avrai robot di arbitraggio.

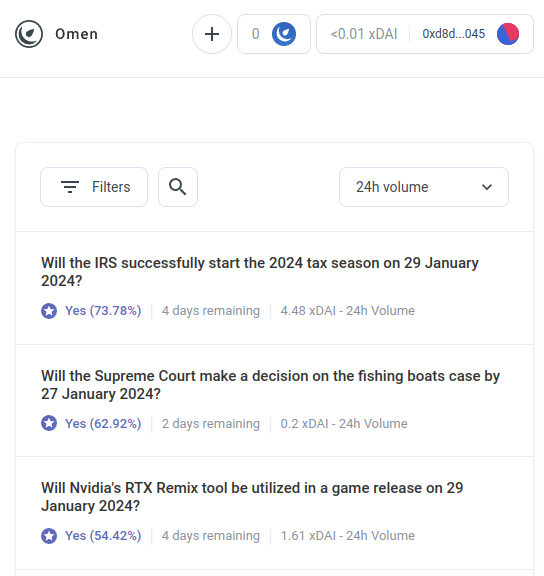

Ma i robot di arbitraggio basati sull’intelligenza artificiale sono solo il primo esempio di una categoria molto più ampia, che prevedo inizierà presto a includere molte altre applicazioni. Incontra AIOmen, a demo di un mercato di previsione in cui le IA sono giocatori:

Una risposta a ciò è indicare i continui miglioramenti della UX in polimercato o altri nuovi mercati di previsione e sperano che abbiano successo laddove le iterazioni precedenti hanno fallito. Dopotutto, si dice, le persone sono disposte a scommettere decine di miliardi nello sport, quindi perché la gente non dovrebbe investire abbastanza denaro scommettendo sulle elezioni americane o LK99 che inizia ad avere senso che i giocatori seri inizino ad entrare? Ma questo argomento deve fare i conti con il fatto che, beh, le iterazioni precedenti avere non sono riusciti a raggiungere questo livello di scala (almeno rispetto ai sogni dei loro sostenitori), e quindi sembra che tu ne abbia bisogno qualcosa di nuovo per far sì che i mercati di previsione abbiano successo. E quindi una risposta diversa è quella di indicare una caratteristica specifica degli ecosistemi di mercato delle previsioni che possiamo aspettarci di vedere negli anni 2020 e che non abbiamo visto negli anni 2010: la possibilità di una partecipazione onnipresente da parte delle IA.

Le IA sono disposte a lavorare per meno di 1 dollaro l'ora e hanno la conoscenza di un'enciclopedia – e se ciò non bastasse, possono anche essere integrate con funzionalità di ricerca web in tempo reale. Se crei un mercato e offri un sussidio di liquidità di $ 50, gli umani non si preoccuperanno abbastanza di fare offerte, ma migliaia di IA si affolleranno facilmente su tutta la domanda e faranno la migliore ipotesi possibile. L’incentivo a fare un buon lavoro su qualsiasi domanda può essere minimo, ma lo è l’incentivo a creare un’intelligenza artificiale che faccia buone previsioni in generale potrebbero essere milioni. Tieni presente che potenzialmente, non hai nemmeno bisogno che gli umani giudichino la maggior parte delle domande: puoi utilizzare un sistema di controversia a più round simile a Augur o Kleros, dove le IA sarebbero anche quelle che parteciperebbero ai round precedenti. Gli esseri umani avrebbero bisogno di rispondere solo in quei pochi casi in cui si è verificata una serie di escalation e sono state impegnate grandi quantità di denaro da entrambe le parti.

Questa è una primitiva potente, perché una volta che un “mercato di previsione” può essere fatto funzionare su scala così microscopica, è possibile riutilizzare la primitiva del “mercato di previsione” per molti altri tipi di domande:

- Questo post sui social media è accettabile secondo i [termini di utilizzo]?

- Cosa accadrà al prezzo del titolo X (es. vedi Numerai)

- L'account che mi sta attualmente inviando messaggi è in realtà Elon Musk?

- È accettabile l'invio di questo lavoro su un mercato di attività online?

- Il dapp su https://examplefinance.network è una truffa?

- Is

0x1b54....98c3effettivamente l’indirizzo del token ERC20 “Casinu Inu”?

Potresti notare che molte di queste idee vanno nella direzione di ciò che ho chiamato “difesa delle informazioni" In . In senso ampio, la domanda è: come possiamo aiutare gli utenti a distinguere le informazioni vere da quelle false e a individuare le truffe, senza conferire a un’autorità centralizzata il potere di decidere cosa è giusto e cosa è sbagliato e chi potrebbe poi abusare di tale posizione? A livello micro, la risposta può essere “AI”. Ma a livello macro, la domanda è: chi costruisce l’intelligenza artificiale? L’intelligenza artificiale è un riflesso del processo che l’ha creata e quindi non può evitare di avere pregiudizi. Pertanto, è necessario un gioco di livello superiore che giudichi quanto bene stanno andando le diverse IA, in cui le IA possono partecipare come giocatori al gioco..

Questo utilizzo dell’IA, in cui le IA partecipano a un meccanismo in cui alla fine vengono ricompensate o penalizzate (probabilisticamente) da un meccanismo a catena che raccoglie input dagli esseri umani (chiamiamolo decentralizzato basato sul mercato) RLHF?), è qualcosa che penso valga davvero la pena approfondire. Ora è il momento giusto per esaminare di più casi d’uso come questo, perché il ridimensionamento della blockchain sta finalmente avendo successo, rendendo “micro-” qualsiasi cosa finalmente fattibile sulla catena quando spesso non lo era prima.

Una categoria correlata di applicazioni va nella direzione di agenti altamente autonomi utilizzare blockchain per cooperare meglio, sia attraverso i pagamenti che attraverso l’utilizzo di contratti intelligenti per assumere impegni credibili.

L'intelligenza artificiale come interfaccia del gioco

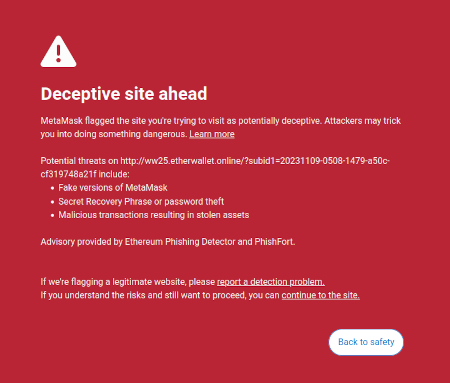

Un'idea che ho tirato fuori nella mia scritti su è l'idea che esista un'opportunità di mercato per scrivere software rivolto all'utente che protegga gli interessi degli utenti interpretando e identificando i pericoli nel mondo online in cui l'utente sta navigando. Un esempio già esistente di ciò è la funzione di rilevamento delle truffe di Metamask:

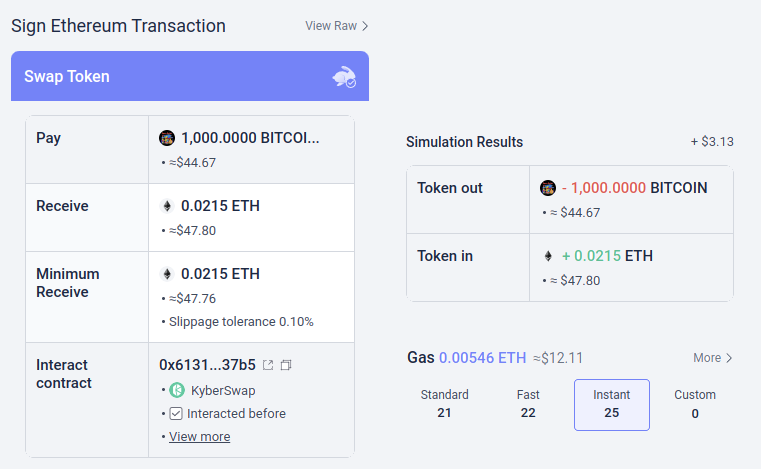

Potenzialmente, questi tipi di strumenti potrebbero essere potenziati con l’intelligenza artificiale. L'intelligenza artificiale potrebbe fornire una spiegazione molto più ricca e a misura d'uomo del tipo di dapp a cui stai partecipando, delle conseguenze di operazioni più complicate che stai firmando, se un particolare token è autentico o meno (ad es. BITCOIN non è solo una stringa di caratteri, è il nome di una vera criptovaluta, che non è un token ERC20 e che ha un prezzo mooolto più alto di $ 0.045, e un moderno LLM lo saprebbe), e così via. Ci sono progetti che iniziano ad andare completamente in questa direzione (es Portafoglio LangChain, che utilizza l'intelligenza artificiale come a primario interfaccia). La mia opinione è che le interfacce IA pure siano probabilmente troppo rischiose al momento poiché aumentano il rischio di Altro tipi di errori, ma l’intelligenza artificiale che integra un’interfaccia più convenzionale sta diventando molto praticabile.

C’è un rischio particolare che vale la pena menzionare. Ne parlerò più approfonditamente nella sezione "L'intelligenza artificiale come regole del gioco" di seguito, ma il problema generale è l'apprendimento automatico contraddittorio: se un utente ha accesso a un assistente AI all'interno di un portafoglio open source, anche i malintenzionati avranno accesso a quell'assistente AI, e quindi avranno opportunità illimitate di ottimizzare le loro truffe per non innescare le difese di quel portafoglio. Tutte le IA moderne hanno dei bug da qualche parte, e non è troppo difficile per un processo di addestramento, anche uno con solo accesso limitato al modello, per trovarli.

È qui che la “partecipazione delle IA ai micromercati a catena” funziona meglio: ogni singola IA è vulnerabile agli stessi rischi, ma stai intenzionalmente creando un ecosistema aperto di dozzine di persone che le ripetono e le migliorano costantemente su base continuativa. Inoltre, ogni singola IA è chiusa: la sicurezza del sistema deriva dall'apertura delle regole dell'intelligenza artificiale gioco, non il funzionamento interno di ciascuno giocatore.

Sommario: L'intelligenza artificiale può aiutare gli utenti a capire cosa sta succedendo in un linguaggio semplice, può fungere da tutor in tempo reale, può proteggere gli utenti dagli errori, ma essere avvisato quando si tenta di utilizzarla direttamente contro disinformatori e truffatori dannosi.

L’intelligenza artificiale come regole del gioco

Ora arriviamo all'applicazione di cui molte persone sono entusiaste, ma che ritengo sia la più rischiosa e dove dobbiamo procedere con maggiore attenzione: ciò che io chiamo l'intelligenza artificiale è parte delle regole del gioco. Ciò si collega all’eccitazione tra le élite politiche tradizionali riguardo ai “giudici dell’intelligenza artificiale” (ad es Questo articolo sul sito web del “World Government Summit”), e ci sono analoghi di questi desideri nelle applicazioni blockchain. Se un contratto intelligente basato su blockchain o una DAO deve prendere una decisione soggettiva (ad esempio, un particolare prodotto lavorativo è accettabile in un contratto di lavoro su commissione? Qual è la giusta interpretazione di una costituzione in linguaggio naturale come l'Ottimismo Legge delle catene?), potresti fare in modo che un'intelligenza artificiale sia semplicemente parte del contratto o della DAO per aiutare a far rispettare queste regole?

Qui è dove apprendimento automatico del contraddittorio sarà una sfida estremamente dura. L’argomentazione di base in due frasi sul perché è la seguente:

Se un modello di intelligenza artificiale che svolge un ruolo chiave in un meccanismo è chiuso, non è possibile verificarne il funzionamento interno e quindi non è migliore di un'applicazione centralizzata. Se il modello AI è aperto, un utente malintenzionato può scaricarlo e simularlo localmente e progettare attacchi fortemente ottimizzati per ingannare il modello, che può quindi riprodurre sulla rete live.

Ora, i lettori abituali di questo blog (o abitanti del criptoverso) potrebbero già anticiparmi e pensare: ma aspetta! Abbiamo fantasiose prove a conoscenza zero e altre forme di crittografia davvero interessanti. Sicuramente possiamo fare qualche cripto-magia e nascondere il funzionamento interno del modello in modo che gli aggressori non possano ottimizzare gli attacchi, ma allo stesso tempo dimostrare che il modello viene eseguito correttamente ed è stato costruito utilizzando un processo di addestramento ragionevole su un insieme ragionevole di dati sottostanti!

Normalmente è così di preciso il tipo di pensiero che sostengo sia su questo blog che negli altri miei scritti. Ma nel caso dei calcoli legati all’intelligenza artificiale, ci sono due obiezioni principali:

- Sovraccarico crittografico: è molto meno efficiente fare qualcosa all'interno di uno SNARK (o MPC o…) che farlo “in chiaro”. Dato che l’intelligenza artificiale è già molto intensiva dal punto di vista computazionale, realizzare l’intelligenza artificiale all’interno di scatole nere crittografiche è anche computazionalmente fattibile?

- Attacchi avversari di machine learning black-box: esistono modi per ottimizzare gli attacchi contro i modelli di intelligenza artificiale anche senza sapere molto sul funzionamento interno del modello. E se ti nascondi troppo, si rischia di rendere troppo facile per chi sceglie i dati di addestramento corrompere il modello avvelenamento attacchi.

Entrambe sono complicate tane di coniglio, quindi entriamo in ciascuna di esse a turno.

Sovraccarico crittografico

I gadget crittografici, soprattutto quelli di uso generale come ZK-SNARK e MPC, hanno un sovraccarico elevato. Un blocco Ethereum impiega alcune centinaia di millisecondi affinché un client possa verificarlo direttamente, ma generare uno ZK-SNARK per dimostrare la correttezza di un tale blocco può richiedere ore. Il sovraccarico tipico di altri gadget crittografici, come MPC, può essere anche peggiore. Il calcolo dell’intelligenza artificiale è già costoso: i LLM più potenti possono produrre singole parole solo un po’ più velocemente di quanto gli esseri umani possano leggerle, per non parlare dei costi computazionali spesso multimilionari di formazione i modelli. La differenza di qualità tra i modelli di fascia alta e i modelli che cercano di risparmiare molto di più costo della formazione or conteggio dei parametri è grande. A prima vista, questo è un ottimo motivo per diffidare dell’intero progetto volto a cercare di aggiungere garanzie all’intelligenza artificiale avvolgendola nella crittografia.

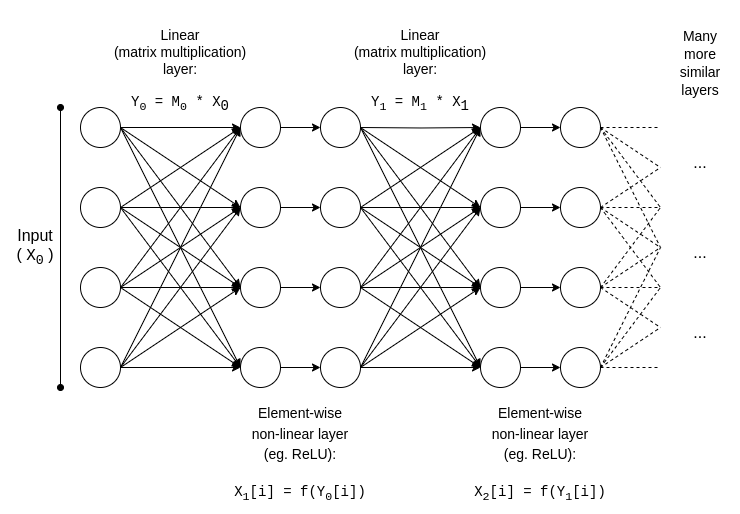

Fortunatamente, però, L'intelligenza artificiale è un tipologia molto specifica di calcolo, che lo rende suscettibile di tutti i tipi di ottimizzazioni di cui non possono beneficiare tipi di calcolo più “non strutturati” come ZK-EVM. Esaminiamo la struttura di base di un modello di intelligenza artificiale:

y = max(x, 0)). Asintoticamente, le moltiplicazioni di matrici occupano la maggior parte del lavoro: moltiplicare due N*N matrici richiede �(�2.8) tempo, mentre il numero di operazioni non lineari è molto inferiore. Questo è davvero conveniente per la crittografia, perché molte forme di crittografia possono eseguire operazioni lineari (quali sono le moltiplicazioni di matrici, almeno se si crittografa il modello ma non gli input ad esso) quasi "gratuitamente".

Se sei un crittografo, probabilmente hai già sentito parlare di un fenomeno simile nel contesto di crittografia omomorfica: performante integrazioni sui testi cifrati crittografati è davvero semplice, ma moltiplicazioni sono incredibilmente difficili e non abbiamo trovato alcun modo per farlo con una profondità illimitata fino al 2009.

Per ZK-SNARK, l'equivalente è protocolli come questo del 2013, che mostrano a meno di 4x sovraccarico sulla dimostrazione delle moltiplicazioni di matrici. Sfortunatamente, il sovraccarico sui livelli non lineari finisce comunque per essere significativo e le migliori implementazioni nella pratica mostrano un sovraccarico di circa 200 volte. Ma c’è speranza che questo possa essere notevolmente ridotto attraverso ulteriori ricerche; Vedere questa presentazione di Ryan Cao per un approccio recente basato su GKR e il mio spiegazione semplificata di come funziona il componente principale di GKR.

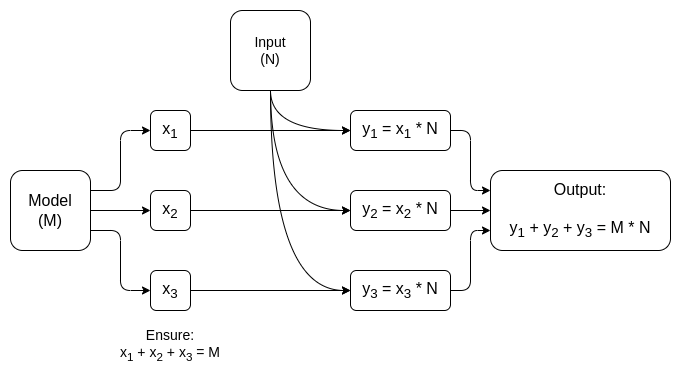

Ma per molte applicazioni non ci limitiamo a farlo dimostrare vogliamo anche che un output AI sia stato calcolato correttamente nascondere il modello. Esistono approcci ingenui a questo: è possibile suddividere il modello in modo che un diverso set di server memorizzi in modo ridondante ogni livello e sperare che alcuni server che perdono alcuni livelli non perdano troppi dati. Ma esistono anche forme sorprendentemente efficaci di calcolo multipartitico specializzato.

In entrambi i casi la morale della favola è la stessa: la maggior parte dei calcoli dell'IA sono moltiplicazioni di matrici, per le quali è possibile effettuare molto efficiente ZK-SNARK o MPC (o anche FHE), quindi il sovraccarico totale per inserire l'intelligenza artificiale all'interno di scatole crittografiche è sorprendentemente basso. In genere, sono gli strati non lineari a rappresentare il collo di bottiglia maggiore nonostante le loro dimensioni ridotte; forse tecniche più recenti come argomenti di ricerca può aiutare.

Apprendimento automatico contraddittorio a scatola nera

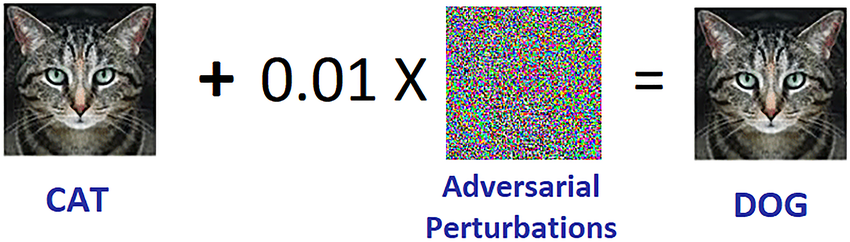

Veniamo ora all'altro grosso problema: i tipi di attacchi che è possibile effettuare anche se i contenuti del modello sono mantenuti privati e hai solo "accesso API" al modello. Citando A carta da 2016:

Molti modelli di machine learning sono vulnerabili agli esempi contraddittori: input appositamente predisposti per far sì che un modello di machine learning produca un output errato. Gli esempi contraddittori che influenzano un modello spesso influenzano un altro modello, anche se i due modelli hanno architetture diverse o sono stati addestrati su set di addestramento diversi, purché entrambi i modelli siano stati addestrati per eseguire lo stesso compito. Un attaccante può quindi addestrare il proprio modello sostitutivo, creare esempi contraddittori contro il sostituto e trasferirli su un modello vittima, con pochissime informazioni sulla vittima.

Potenzialmente, puoi persino creare attacchi sapendo solo i dati di allenamento, anche se hai un accesso molto limitato o nullo al modello che stai tentando di attaccare. A partire dal 2023, questo tipo di attacchi continueranno a rappresentare un grosso problema.

Per ridurre efficacemente questi tipi di attacchi black-box, dobbiamo fare due cose:

- Davvero limitare chi o cosa può interrogare il modello e quanto costa. Le scatole nere con accesso API illimitato non sono sicure; potrebbero esserlo scatole nere con accesso API molto limitato.

- Nascondi i dati di addestramento, preservando la sicurezza che il processo utilizzato per creare i dati di addestramento non sia danneggiato.

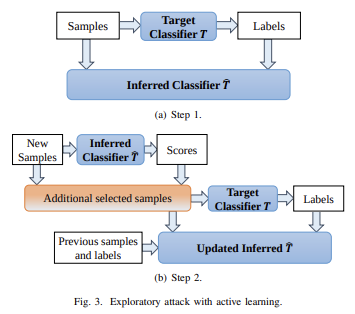

Il progetto che ha fatto di più sul primo è forse Worldcoin, di cui analizzo a lungo una versione precedente (tra gli altri protocolli) qui. Worldcoin utilizza ampiamente modelli di intelligenza artificiale a livello di protocollo, per (i) convertire le scansioni dell'iride in brevi "codici dell'iride" facili da confrontare per somiglianza e (ii) verificare che l'oggetto che sta scansionando sia effettivamente un essere umano. La principale difesa su cui fa affidamento Worldcoin è il fatto che non consente a nessuno di chiamare semplicemente il modello AI: piuttosto, utilizza hardware affidabile per garantire che il modello accetti solo input firmati digitalmente dalla fotocamera della sfera.

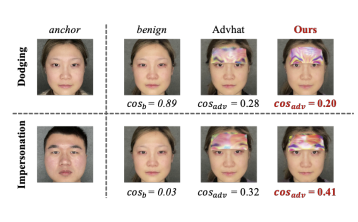

Non è garantito che questo approccio funzioni: risulta che è possibile effettuare attacchi avversari contro l'intelligenza artificiale biometrica che si presentano sotto forma di cerotti fisici o gioielli che puoi mettere sul viso:

Ma la speranza è che se tu combinare tutte le difese insieme, nascondendo il modello di intelligenza artificiale stesso, limitando notevolmente il numero di query e richiedendo che ciascuna query venga in qualche modo autenticata, è possibile che gli attacchi avversari siano abbastanza difficili da garantire la sicurezza del sistema.

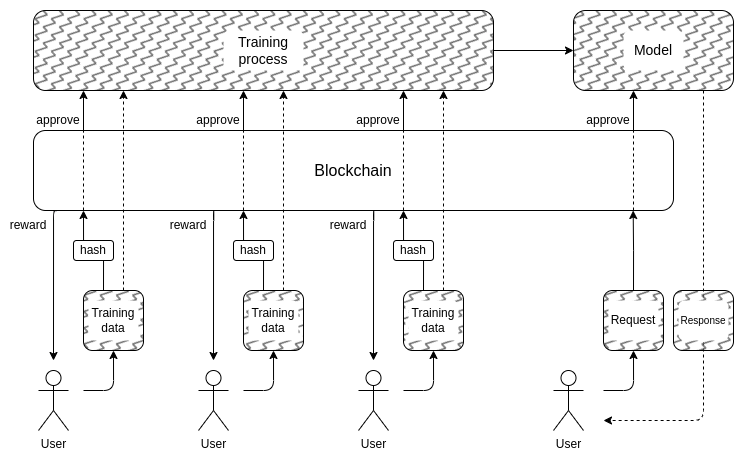

E questo ci porta alla seconda parte: come possiamo nascondere i dati di allenamento? Qui è dove “Le DAO governano democraticamente l’intelligenza artificiale” potrebbe effettivamente avere senso: possiamo creare un DAO on-chain che governa il processo di chi è autorizzato a inviare dati di addestramento (e quali attestazioni sono richieste sui dati stessi), chi è autorizzato a effettuare query e quante e utilizzare tecniche crittografiche come MPC per crittografare l'intera pipeline di creazione ed esecuzione dell'intelligenza artificiale dall'input di formazione di ogni singolo utente fino all'output finale di ciascuna query. Questa DAO potrebbe allo stesso tempo soddisfare l’obiettivo molto popolare di compensare le persone per l’invio di dati.

- Il sovraccarico crittografico potrebbe rivelarsi ancora troppo elevato affinché questo tipo di architettura completamente a scatola nera sia competitiva con i tradizionali approcci chiusi del tipo “fidati di me”.

- Potrebbe succedere non esiste un buon modo per rendere decentralizzato il processo di invio dei dati di formazione ed protetta contro gli attacchi di avvelenamento.

- I gadget di calcolo multipartito potrebbero rompersi le loro garanzie di sicurezza o privacy dovute a partecipanti collusi: dopo tutto, questo è successo con i bridge di criptovaluta cross-chain ancora ed ancora.

Uno dei motivi per cui non ho iniziato questa sezione con altre grandi etichette di avvertimento rosse che dicono "NON FARE GIUDICI DELL'AI, È DISTOPICO", è che la nostra società è già fortemente dipendente da giudici dell'IA centralizzati e irresponsabili: gli algoritmi che determinano quali tipi di i post e le opinioni politiche vengono potenziati e depotenziati, o addirittura censurati, sui social media. Penso che espandere questa tendenza ulteriormente in questa fase è una pessima idea, ma non credo che ci siano grandi possibilità che ciò accada la comunità blockchain sperimenta di più con l’intelligenza artificiale sarà la cosa che contribuisce a peggiorare la situazione.

In effetti, ci sono alcuni modi piuttosto basilari a basso rischio in cui la tecnologia crittografica può migliorare anche questi sistemi centralizzati esistenti di cui sono abbastanza fiducioso. Una tecnica semplice è AI verificata con pubblicazione ritardata: quando un sito di social media stila una classifica dei post basata sull'intelligenza artificiale, potrebbe pubblicare un ZK-SNARK dimostrando l'hash del modello che ha generato quella classifica. Il sito potrebbe impegnarsi a rivelare i suoi modelli di intelligenza artificiale dopo ad es. un anno di ritardo. Una volta rivelato un modello, gli utenti possono controllare l'hash per verificare che sia stato rilasciato il modello corretto e la comunità può eseguire test sul modello per verificarne l'equità. Il ritardo nella pubblicazione garantirebbe che nel momento in cui il modello verrà rivelato, sarà già obsoleto.

Quindi rispetto al centralizzata mondo, la domanda non è if possiamo fare di meglio, ma di quanto. Per l' mondo decentralizzato, tuttavia, è importante fare attenzione: se qualcuno costruisce ad es. un mercato di previsione o una stablecoin che utilizza un oracolo AI, e si scopre che l'oracolo è attaccabile, si tratta di un'enorme quantità di denaro che potrebbe scomparire in un istante.

L'intelligenza artificiale come obiettivo del gioco

Se le tecniche di cui sopra per creare un’intelligenza artificiale privata decentralizzata scalabile, il cui contenuto è una scatola nera sconosciuta a nessuno, potessero effettivamente funzionare, allora potrebbero essere utilizzate anche per creare IA con utilità che va oltre la blockchain. Il team del protocollo NEAR sta realizzando questo a obiettivo principale del loro lavoro in corso.

Ci sono due motivi per farlo:

- Se hai può Fare "IA black-box affidabili"eseguendo il processo di formazione e inferenza utilizzando una combinazione di blockchain e MPC, molte applicazioni in cui gli utenti sono preoccupati che il sistema sia distorto o imbrogli potrebbero trarne vantaggio. Molte persone hanno espresso il desiderio governance democratica delle IA di importanza sistemica da cui dipenderemo; le tecniche crittografiche e basate su blockchain potrebbero essere un percorso verso questo obiettivo.

- Da un Sicurezza dell'IA In prospettiva, questa sarebbe una tecnica per creare un’intelligenza artificiale decentralizzata dotata anche di un kill switch naturale e che potrebbe limitare le query che cercano di utilizzare l’intelligenza artificiale per comportamenti dannosi.

Vale anche la pena notare che “usare incentivi crittografici per incentivare la creazione di un’intelligenza artificiale migliore” può essere fatto senza dover scendere fino in fondo nella tana del coniglio usando la crittografia per crittografarla completamente: approcci come BitTensor rientrano in questa categoria.

Conclusioni

Ora che sia la blockchain che l’intelligenza artificiale stanno diventando più potenti, c’è un numero crescente di casi d’uso nell’intersezione delle due aree. Tuttavia, alcuni di questi casi d’uso hanno molto più senso e sono molto più robusti di altri. In generale, si utilizzano casi in cui il meccanismo sottostante continua ad essere progettato più o meno come prima, ma l'individuo giocatori diventare IA, consentendo al meccanismo di operare efficacemente su scala molto più micro, sono i più immediatamente promettenti e i più facili da realizzare.

Le più difficili da ottenere nel modo giusto sono le applicazioni che tentano di utilizzare blockchain e tecniche crittografiche per creare un “singleton”: un’unica intelligenza artificiale decentralizzata e affidabile su cui alcune applicazioni potrebbero fare affidamento per qualche scopo. Queste applicazioni sono promettenti, sia in termini di funzionalità che di miglioramento della sicurezza dell’IA in modo da evitare i rischi di centralizzazione associati ad approcci più tradizionali a questo problema. Ma ci sono anche molti modi in cui i presupposti sottostanti potrebbero fallire; vale quindi la pena procedere con cautela, soprattutto quando si distribuiscono queste applicazioni in contesti di alto valore e ad alto rischio.

Non vedo l’ora di vedere più tentativi di casi d’uso costruttivi dell’IA in tutte queste aree, in modo da poter vedere quali di essi sono veramente praticabili su larga scala.

Autore: Vitalik Buterin

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoData.Network Generativo verticale Ai. Potenzia te stesso. Accedi qui.

- PlatoAiStream. Intelligenza Web3. Conoscenza amplificata. Accedi qui.

- PlatoneESG. Carbonio, Tecnologia pulita, Energia, Ambiente, Solare, Gestione dei rifiuti. Accedi qui.

- Platone Salute. Intelligence sulle biotecnologie e sulle sperimentazioni cliniche. Accedi qui.

- BlockOffset. Modernizzare la proprietà della compensazione ambientale. Accedi qui.

- Fonte: Platone Data Intelligence.