Questo post è stato scritto in collaborazione con Greg Benson, capo scienziato; Aaron Kesler, responsabile prodotto senior; e Rich Dill, Enterprise Solutions Architect di SnapLogic.

Molti clienti stanno creando app di intelligenza artificiale generativa Roccia Amazzonica ed Amazon Code Whisperer per creare artefatti di codice basati sul linguaggio naturale. Questo caso d'uso evidenzia come i modelli linguistici di grandi dimensioni (LLM) siano in grado di diventare un traduttore tra i linguaggi umani (inglese, spagnolo, arabo e altri) e linguaggi interpretabili dalla macchina (Python, Java, Scala, SQL e così via) insieme a sofisticati ragionamento interno. Questa capacità emergente negli LLM ha costretto gli sviluppatori di software a utilizzare gli LLM come strumento di automazione e miglioramento dell'esperienza utente che trasforma il linguaggio naturale in un linguaggio specifico del dominio (DSL): istruzioni di sistema, richieste API, artefatti di codice e altro ancora. In questo post ti mostriamo come Snap Logic, un cliente AWS, ha utilizzato Amazon Bedrock per alimentare il proprio SnapGPT prodotto attraverso la creazione automatizzata di questi complessi artefatti DSL dal linguaggio umano.

Quando i clienti creano oggetti DSL da LLM, il DSL risultante è una replica esatta o un derivato di dati e schemi di interfaccia esistenti che costituiscono il contratto tra l'interfaccia utente e la logica aziendale nel servizio di supporto. Questo modello è particolarmente di tendenza tra i fornitori di software indipendenti (ISV) e gli ISV di software as a service (SaaS) a causa del loro modo unico di rappresentare le configurazioni tramite codice e del desiderio di semplificare l'esperienza utente per i propri clienti. I casi d'uso di esempio includono:

Il modo più semplice per creare e scalare applicazioni text-to-pipeline con LLM su AWS è utilizzare Amazon Bedrock. Amazon Bedrock è il modo più semplice per creare e scalare applicazioni di intelligenza artificiale generativa con modelli di base (FM). Si tratta di un servizio completamente gestito che offre accesso a una scelta di FM di base ad alte prestazioni provenienti dai principali sistemi di intelligenza artificiale tramite un'unica API, insieme a un'ampia gamma di funzionalità necessarie per creare applicazioni di intelligenza artificiale generativa con privacy e sicurezza. Anthropic, un laboratorio di ricerca e sicurezza sull'intelligenza artificiale che costruisce sistemi di intelligenza artificiale affidabili, interpretabili e gestibili, è una delle principali società di intelligenza artificiale che offre accesso al loro LLM all'avanguardia, Claude, su Amazon Bedrock. Claude è un LLM che eccelle in una vasta gamma di compiti, dal dialogo ponderato, alla creazione di contenuti, al ragionamento complesso, alla creatività e alla codifica. Anthropic offre sia i modelli Claude che Claude Instant, tutti disponibili tramite Amazon Bedrock. Claude ha rapidamente guadagnato popolarità in queste applicazioni text-to-pipeline grazie alla sua migliorata capacità di ragionamento, che gli consente di eccellere nella risoluzione di problemi tecnici ambigui. Claude 2 su Amazon Bedrock supporta una finestra di contesto da 100,000 token, che equivale a circa 200 pagine di testo inglese. Questa è una funzionalità particolarmente importante su cui puoi fare affidamento quando crei applicazioni text-to-pipeline che richiedono ragionamenti complessi, istruzioni dettagliate ed esempi completi.

Sfondo SnapLogic

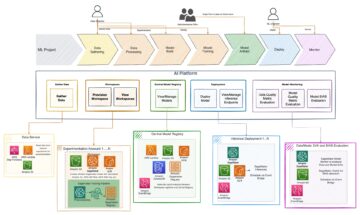

SnapLogic è un cliente AWS con la missione di portare l'automazione aziendale nel mondo. La SnapLogic Intelligent Integration Platform (IIP) consente alle organizzazioni di realizzare un'automazione a livello aziendale collegando l'intero ecosistema di applicazioni, database, big data, macchine e dispositivi, API e altro ancora con connettori intelligenti precostruiti chiamati Snaps. SnapLogic ha recentemente rilasciato una funzionalità chiamata SnapGPT, che fornisce un'interfaccia di testo in cui è possibile digitare la pipeline di integrazione desiderata che si desidera creare in un linguaggio umano semplice. SnapGPT utilizza il modello Claude di Anthropic tramite Amazon Bedrock per automatizzare la creazione di queste pipeline di integrazione come codice, che vengono poi utilizzate tramite la soluzione di integrazione di punta di SnapLogic. Tuttavia, il viaggio di SnapLogic verso SnapGPT è stato il culmine di molti anni di attività nello spazio dell'intelligenza artificiale.

Il viaggio dell'intelligenza artificiale di SnapLogic

Nel campo delle piattaforme di integrazione, SnapLogic è sempre stata in prima linea, sfruttando il potere di trasformazione dell’intelligenza artificiale. Nel corso degli anni, l'impegno dell'azienda nell'innovazione con l'intelligenza artificiale è diventato evidente, soprattutto quando ne tracciamo il percorso Iris a Collegamento automatico.

Gli umili inizi con Iris

Nel 2017, SnapLogic ha presentato Iris, il primo assistente di integrazione basato sull'intelligenza artificiale. Iris è stato progettato per utilizzare algoritmi di machine learning (ML) per prevedere i passaggi successivi nella creazione di una pipeline di dati. Analizzando milioni di elementi di metadati e flussi di dati, Iris potrebbe fornire suggerimenti intelligenti agli utenti, democratizzando l'integrazione dei dati e consentendo anche a chi non ha un background tecnico approfondito di creare flussi di lavoro complessi.

Collegamento automatico: creare slancio

Basandosi sul successo e sugli insegnamenti di Iris, SnapLogic ha introdotto AutoLink, una funzionalità volta a semplificare ulteriormente il processo di mappatura dei dati. Il noioso compito di mappare manualmente i campi tra i sistemi di origine e di destinazione è diventato un gioco da ragazzi con AutoLink. Utilizzando l'intelligenza artificiale, AutoLink ha identificato e suggerito automaticamente potenziali corrispondenze. Integrazioni che una volta richiedevano ore potrebbero essere eseguite in pochi minuti.

Il salto generativo con SnapGPT

L'ultima incursione di SnapLogic nel campo dell'intelligenza artificiale ci porta SnapGPT, che mira a rivoluzionare ulteriormente l'integrazione. Con SnapGPT, SnapLogic introduce la prima soluzione di integrazione generativa al mondo. Non si tratta solo di semplificare i processi esistenti, ma di reinventare completamente il modo in cui vengono progettate le integrazioni. La potenza dell’intelligenza artificiale generativa può creare da zero intere pipeline di integrazione, ottimizzando il flusso di lavoro in base al risultato desiderato e alle caratteristiche dei dati.

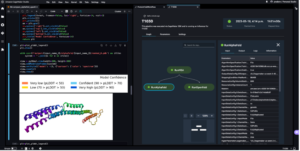

SnapGPT ha un impatto enorme per i clienti di SnapLogic perché sono in grado di ridurre drasticamente la quantità di tempo necessaria per generare la loro prima pipeline SnapLogic. Tradizionalmente, i clienti SnapLogic dovrebbero dedicare giorni o settimane alla configurazione da zero delle pipeline di integrazione. Ora, questi clienti possono semplicemente chiedere a SnapGPT, ad esempio, di "creare una pipeline che sposterà tutti i miei clienti SFDC attivi su WorkDay". Una prima bozza funzionante di una pipeline viene creata automaticamente per questo cliente, riducendo drasticamente i tempi di sviluppo necessari per la creazione della base della pipeline di integrazione. Ciò consente al cliente finale di dedicare più tempo a concentrarsi su ciò che ha un reale impatto aziendale per lui invece di lavorare sulle configurazioni di una pipeline di integrazione. L'esempio seguente mostra come un cliente SnapLogic può inserire una descrizione nella funzionalità SnapGPT per generare rapidamente una pipeline, utilizzando il linguaggio naturale.

AWS e SnapLogic hanno collaborato strettamente durante la creazione di questo prodotto e hanno imparato molto lungo il percorso. Il resto di questo post si concentrerà sugli apprendimenti tecnici che AWS e SnapLogic hanno avuto sull'utilizzo degli LLM per le applicazioni text-to-pipeline.

Panoramica della soluzione

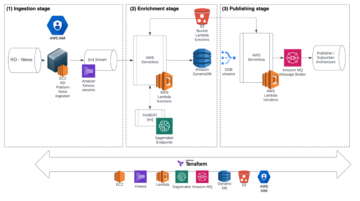

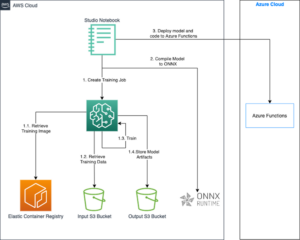

Per risolvere questo problema di text-to-pipeline, AWS e SnapLogic hanno progettato una soluzione completa mostrata nell'architettura seguente.

Una richiesta a SnapGPT passa attraverso il seguente flusso di lavoro:

- Un utente invia una descrizione all'applicazione.

- SnapLogic utilizza un approccio RAG (Retrieval Augmented Generation) per recuperare esempi rilevanti di pipeline SnapLogic simili alla richiesta dell'utente.

- Questi esempi rilevanti estratti vengono combinati con l'input dell'utente e sottoposti ad una preelaborazione del testo prima di essere inviati a Claude su Amazon Bedrock.

- Claude produce un artefatto JSON che rappresenta una pipeline SnapLogic.

- L'artefatto JSON è direttamente integrato nella piattaforma di integrazione principale SnapLogic.

- La pipeline SnapLogic viene resa all'utente in modo intuitivo.

Attraverso varie sperimentazioni tra AWS e SnapLogic, abbiamo riscontrato che la fase di progettazione tempestiva del diagramma della soluzione è estremamente importante per generare output di alta qualità per questi output text-to-pipeline. La sezione successiva approfondisce alcune tecniche specifiche utilizzate con Claude in questo spazio.

Sperimentazione immediata

Durante la fase di sviluppo di SnapGPT, AWS e SnapLogic hanno scoperto che l'iterazione rapida dei prompt inviati a Claude era un'attività di sviluppo fondamentale per migliorare la precisione e la pertinenza degli output text-to-pipeline negli output di SnapLogic. Usando Amazon Sage Maker Studio notebook interattivi, il team AWS e SnapLogic sono stati in grado di lavorare rapidamente attraverso diverse versioni di prompt utilizzando il Connessione dell'SDK Boto3 ad Amazon Bedrock. Lo sviluppo basato su notebook ha consentito ai team di creare rapidamente connessioni lato client ad Amazon Bedrock, includere descrizioni basate su testo insieme al codice Python per l'invio di prompt ad Amazon Bedrock e tenere sessioni congiunte di ingegneria dei prompt in cui venivano effettuate rapidamente iterazioni tra più personaggi.

L'antropologico Claude richiede metodi ingegneristici

In questa sezione descriviamo alcune delle tecniche iterative che abbiamo utilizzato per creare un prompt ad alte prestazioni basato su una richiesta utente illustrativa: "Crea una pipeline che utilizzi il database EsempioCompany che recupera tutti i clienti attivi". Tieni presente che questo esempio non è lo schema di cui è alimentato SnapGPT e viene utilizzato solo per illustrare un'applicazione text-to-pipeline.

Per basare la nostra progettazione del prompt, utilizziamo il seguente prompt originale:

Crea una pipeline che utilizzi il database EsempioCompany che recupera tutti i clienti attivi

L'output previsto è il seguente:

{ "database": "ExampleCompany", "query": "SELECT * FROM ec_prod.customers WHERE status = 'active'" }

Miglioramento n. 1: utilizzo delle annotazioni Human e Assistant

La procedura di formazione di Claude insegna al FM a comprendere il dialogo tra un essere umano e un assistente nella sua struttura immediata. Gli utenti di Claude possono trarre vantaggio da questa struttura terminando il loro prompt in Assistant:, che farà sì che Claude inizi a generare la risposta a una query in base a ciò che ha detto l'umano. Tieni presente che poiché Claude continuerà a generare testo finché non gli viene detto di interrompersi, assicurati di utilizzare una sequenza di arresto di nnHuman: nella richiesta API ad Amazon Bedrock quando usi Claude. Ciò ti garantirà di ricevere solo la risposta dall'assistente e non la risposta successiva prevista dall'essere umano nella catena di dialogo. Questi indicatori nnUmano e nnAssistente non solo aiutano a limitare la risposta di Claude alle informazioni rilevanti, ma aiutano anche a fornire una chiara demarcazione tra gli input umani primari e le risposte dell'assistente da altre interazioni. Ciò è particolarmente utile in un'impostazione di prompt a pochi scatti in cui è possibile avere più query e risposte con query contrassegnate con nnHuman e risposte precedenti contrassegnate con nnAssistant. Diamo un'occhiata al prompt migliorato e alla chiamata API illustrativa associata ad Amazon Bedrock tramite l'SDK Boto3.

Usiamo il seguente prompt:

Umano: crea una pipeline che utilizzi il database EsempioCompany che recupera tutti i clienti attivi

Assistente:

L'output è il seguente:

Ecco una pipeline MongoDB per recuperare tutti i clienti attivi dal database EsempioCompany:

pipeline = [ { '$match': { 'database': 'ExampleCompany', 'status': 'active' } } ] db.customers.aggregate(pipeline)I passaggi chiave sono:

– `$match` per filtrare i documenti solo a quelli presenti nel database di EsempioCompany e con stato uguale a "attivo".

– `db.customers.aggregate()` esegue la pipeline sulla raccolta dei clienti e restituisce i risultati filtrati.

Quindi questo restituirà tutti i documenti del cliente dal database EsempioCompany in cui il campo stato è impostato su "attivo".

Nota come nell'output Claude fornisce una risposta alla nostra domanda senza alcun contesto. La risposta è potenzialmente utile, ma non è specifica per il problema che stiamo cercando di risolvere perché non viene fornito un contesto sufficiente. È anche importante notare che Anthropic richiede questo formato umano e assistente quando si utilizzano i modelli Claude; se non includi questo passaggio, Amazon Bedrock restituirà un errore.

Miglioramento n. 2: includere un contesto iperspecifico per Claude prima che gli venga detto cosa fare

Claude dà il meglio di sé quando gli viene fornito un buon contesto su ciò che deve realizzare e su come dovrebbe svolgere tale compito. Ecco alcuni esempi di cose da includere come contesto per Claude prima di dirgli l'attività:

- Descrivi la funzione lavorativa che desideri che Claude ricopra. In questo modo, stai facendo pensare a Claude nel ruolo di qualcuno che lavora in quel lavoro, o più come qualcuno che viene semplicemente assunto in quello specifico ruolo lavorativo. Ciò aiuterà Claude a formulare la risposta dalla prospettiva di quello specifico ruolo lavorativo, riducendo le allucinazioni e la casualità nella risposta.

- Includere dettagli tecnici riguardanti il formato di output. I modelli di base sono generalmente bravi a seguire le azioni, quindi chiedere a Claude di generare l'output in un formato o schema specifico con uno o pochi esempi aiuterà Claude a fornire la risposta nel formato giusto, riducendo la necessità di filtraggio e postelaborazione dell'output. L'esempio nel prompt seguente mostra uno schema fittizio che corrisponde all'output previsto.

Combiniamo questi suggerimenti per migliorare il nostro suggerimento originale:

Umano: il tuo compito è agire come esperto di pipeline ETL. Nello specifico, il tuo compito è creare una rappresentazione JSON di una pipeline ETL che risolverà la richiesta dell'utente che ti è stata fornita.

L'output JSON dovrebbe seguire il seguente formato:

Ecco il tuo compito: crea una pipeline che utilizzi il database EsempioCompany che recupera tutti i clienti attivi

Assistente:

L'output è il seguente:

Ecco una rappresentazione JSON di una pipeline ETL per recuperare tutti i clienti attivi dal database EsempioCompany:

Questa pipeline utilizza il database EsempioCompany e una query SQL per selezionare tutti i record dalla tabella clienti in cui lo stato è "attivo".

Con l'aggiunta del contesto, il modello è ora in grado di arrivare quasi alla nostra risposta. Ora sa come strutturare l'output e capisce che è necessario scrivere un'istruzione SQL per risolvere il compito. Tuttavia, noterai che il modello non utilizza correttamente la nomenclatura ec_prod.customers prevista. Margini di miglioramento! Tieni inoltre presente che, in pratica, dovrai includere molto più contesto rispetto a quello fornito in questo esempio per ottenere risultati di alta qualità nei casi d'uso text-to-pipeline.

Miglioramento n. 3: racchiudere esempi nei tag XML

L'apprendimento a colpi brevi è un modo popolare per aumentare la precisione con i FM in cui si hanno esempi rilevanti per guidare i FM nel loro compito. Ciò è particolarmente importante quando si lavora in applicazioni text-to-pipeline perché questi output della pipeline iperspecifici in genere non sono inclusi in nessun set di dati pubblico perché sono specifici per la rappresentazione dei dati di un singolo cliente. Quando usi Claude, puoi sfruttare la sua innata conoscenza dei tag XML arbitrari per fornire questi esempi in un formato a poche riprese. Nel seguente prompt migliorato, notare l'aggiunta degli esempi racchiusi in Tag XML. Inoltre, puoi utilizzare le abbreviazioni di umano e assistente con H e A per fornire contesto a Claude senza fargli pensare che si tratti di parti specifiche del dialogo già avvenute.

Usiamo il seguente prompt:

Umano: il tuo compito è agire come esperto di pipeline ETL. Nello specifico, il tuo compito è creare una rappresentazione JSON di una pipeline ETL che risolverà la richiesta dell'utente che ti è stata fornita.

L'output JSON dovrebbe seguire il seguente formato:

Di seguito sono riportati alcuni esempi di richieste utente e artefatti JSON di output associati che risolvono correttamente l'attività fornita. Assicurati di utilizzare la stessa nomenclatura fornita negli esempi se stai utilizzando gli stessi database.

H: interroga il database di EsempioCompany per eventuali ordini attivi per il cliente n. 1234

A:

Il motivo di questa query è che il cliente n. 1234 è filtrato e stiamo cercando nella tabella "ordini" eventuali record esistenti dopo il filtro "attivo".

H: rimuovi tutti i clienti nel database di EsempioCompany che non sono stati attivi nell'ultimo mese

A:

Il motivo di questa query è che la tabella "ec_prod.customers" è l'unica tabella nel database EsempioCompany che contiene i record dei clienti.

Ecco il tuo compito: crea una pipeline che utilizzi il database EsempioCompany che recupera tutti i clienti attivi.

Assistente:

L'output è il seguente:

Ecco la rappresentazione JSON per una pipeline ETL per recuperare tutti i clienti attivi dal database EsempioCompany:

Il ragionamento è:

Il database EsempioCompany è specificato come database da utilizzare

La tabella ec_prod.customers contiene i dati del cliente

Il campo stato indica se un cliente è attivo, quindi la query filtra solo i clienti attivi

Questo dovrebbe recuperare tutti i record dei clienti attivi dal database EsempioCompany. Fammi sapere se hai bisogno di chiarimenti o hai requisiti aggiuntivi per la pipeline ETL!

L'output JSON ora ha la nomenclatura del database corretta, che Claude ha potuto utilizzare grazie agli esempi forniti. L'abbinamento degli indicatori umani e di quelli dell'assistente con i tag XML rende più semplice per Claude comprendere qual è il compito e quale è stata la risposta in esempi simili con una separazione molto chiara tra più esempi di poche riprese. Più facile sarà per Claude comprendere, migliore e più pertinente sarà la risposta, riducendo ulteriormente la possibilità che il modello abbia allucinazioni e fornisca risposte casuali e irrilevanti.

Miglioramento n. 4: attivare Claude per iniziare la generazione JSON con tag XML

Una piccola sfida con le applicazioni text-to-pipeline che utilizzano FM è la necessità di analizzare esattamente un output dal testo risultante in modo che possa essere interpretato come codice in un'applicazione downstream. Un modo per risolvere questo problema con Claude è sfruttare la comprensione dei tag XML e combinarla con una sequenza di arresto personalizzata. Nella richiesta seguente, abbiamo chiesto a Claude di racchiudere l'output in Tag XML. Quindi, abbiamo aggiunto il tag alla fine del prompt. Ciò garantisce che il primo testo che esce da Claude sarà l'inizio dell'output JSON. Se non lo fai, Claude spesso risponde con del testo colloquiale, quindi la vera risposta in codice. Ordinando a Claude di iniziare immediatamente a generare l'output, puoi facilmente interrompere la generazione quando vedi la chiusura etichetta. Ciò è mostrato nella chiamata API Boto3 aggiornata. I vantaggi di questa tecnica sono duplici. Innanzitutto, puoi analizzare esattamente la risposta in codice di Claude. In secondo luogo, puoi ridurre i costi perché Claude genera solo output di codice e nessun testo aggiuntivo. Ciò riduce i costi su Amazon Bedrock perché ti viene addebitato un costo per ogni token prodotto come output da tutti i FM.

Usiamo il seguente prompt:

Umano: il tuo compito è agire come esperto di pipeline ETL. Nello specifico, il tuo compito è creare una rappresentazione JSON di una pipeline ETL che risolverà la richiesta dell'utente che ti è stata fornita.

L'output JSON dovrebbe seguire il seguente formato:

Di seguito sono riportati alcuni esempi di richieste utente e artefatti JSON di output associati che risolvono correttamente l'attività fornita. Assicurati di utilizzare la stessa nomenclatura fornita negli esempi se stai utilizzando gli stessi database.

H: interroga il database di EsempioCompany per eventuali ordini attivi per il cliente n. 1234

A:

Il motivo di questa query è che il cliente n. 1234 è filtrato e stiamo cercando nella tabella "ordini" eventuali record esistenti dopo il filtro "attivo".

H: rimuovi tutti i clienti nel database di EsempioCompany che non sono stati attivi nell'ultimo mese

A:

Il motivo di questa query è che la tabella "ec_prod.customers" è l'unica tabella nel database EsempioCompany che contiene i record dei clienti.

Ricorda sempre di racchiudere i tuoi output JSON in tag.

Ecco il tuo compito: crea una pipeline che utilizzi il database EsempioCompany che recupera tutti i clienti attivi.

Assistente:

Usiamo il seguente codice:

body = json.dumps({"prompt": prompt, "stop_sequences": ['nnHuman:', '</json>']})

response = bedrock.invoke_model(

body=body,

modelId='anthropic.claude-v2'

)L'output è il seguente:

{ "database": "ExampleCompany", "query": "SELECT * FROM ec_prod.customers WHERE status = 'active'" }

Ora siamo arrivati all'output previsto con il solo oggetto JSON restituito! Utilizzando questo metodo, siamo in grado di generare un artefatto tecnico immediatamente utilizzabile e di ridurre il costo di generazione riducendo i token di output.

Conclusione

Per iniziare oggi con SnapGPT, richiedi a prova gratuita di SnapLogic or richiedi una demo del prodotto. Se desideri utilizzare questi concetti per creare applicazioni oggi, ti consigliamo sperimentando sul campo con la sezione di prompt engineering di questo post, utilizzando lo stesso flusso su un diverso caso d'uso di generazione DSL adatto alla tua attività e approfondendo l'argomento Funzionalità RAG disponibili tramite Amazon Bedrock.

SnapLogic e AWS sono stati in grado di collaborare in modo efficace per creare un traduttore avanzato tra il linguaggio umano e il complesso schema delle pipeline di integrazione SnapLogic basate su Amazon Bedrock. Durante questo viaggio, abbiamo visto come l'output generato con Claude possa essere migliorato nelle applicazioni text-to-pipeline utilizzando specifiche tecniche di prompt engineering. AWS e SnapLogic sono entusiasti di continuare questa partnership nell'intelligenza artificiale generativa e attendono con impazienza la futura collaborazione e innovazione in questo spazio in rapida evoluzione.

Informazioni sugli autori

Greg Bensson è professore di informatica presso l'Università di San Francisco e capo scienziato presso SnapLogic. È entrato a far parte del Dipartimento di Informatica dell'USF nel 1998 e ha tenuto corsi universitari e di specializzazione tra cui sistemi operativi, architettura dei computer, linguaggi di programmazione, sistemi distribuiti e programmazione introduttiva. Greg ha pubblicato ricerche nei settori dei sistemi operativi, del calcolo parallelo e dei sistemi distribuiti. Da quando è entrato in SnapLogic nel 2010, Greg ha contribuito a progettare e implementare diverse funzionalità chiave della piattaforma, tra cui l'elaborazione dei cluster, l'elaborazione dei big data, l'architettura cloud e l'apprendimento automatico. Attualmente sta lavorando sull'intelligenza artificiale generativa per l'integrazione dei dati.

Greg Bensson è professore di informatica presso l'Università di San Francisco e capo scienziato presso SnapLogic. È entrato a far parte del Dipartimento di Informatica dell'USF nel 1998 e ha tenuto corsi universitari e di specializzazione tra cui sistemi operativi, architettura dei computer, linguaggi di programmazione, sistemi distribuiti e programmazione introduttiva. Greg ha pubblicato ricerche nei settori dei sistemi operativi, del calcolo parallelo e dei sistemi distribuiti. Da quando è entrato in SnapLogic nel 2010, Greg ha contribuito a progettare e implementare diverse funzionalità chiave della piattaforma, tra cui l'elaborazione dei cluster, l'elaborazione dei big data, l'architettura cloud e l'apprendimento automatico. Attualmente sta lavorando sull'intelligenza artificiale generativa per l'integrazione dei dati.

Aaron Kesler è Senior Product Manager per prodotti e servizi AI presso SnapLogic, Aaron applica oltre dieci anni di esperienza nella gestione dei prodotti per essere pioniere nello sviluppo di prodotti AI/ML e promuovere i servizi in tutta l'organizzazione. È l'autore del libro di prossima uscita "Qual è il tuo problema?" mirato a guidare i nuovi product manager attraverso la carriera di product management. Il suo viaggio imprenditoriale è iniziato con la sua startup universitaria, STAK, che è stata successivamente acquisita da Carvertise con Aaron che ha contribuito in modo significativo al loro riconoscimento come Startup tecnologica dell'anno 2015 in Delaware. Al di là delle sue attività professionali, Aaron trova gioia nel giocare a golf con suo padre, nell'esplorare nuove culture e cibi durante i suoi viaggi e nel praticare l'ukulele.

Aaron Kesler è Senior Product Manager per prodotti e servizi AI presso SnapLogic, Aaron applica oltre dieci anni di esperienza nella gestione dei prodotti per essere pioniere nello sviluppo di prodotti AI/ML e promuovere i servizi in tutta l'organizzazione. È l'autore del libro di prossima uscita "Qual è il tuo problema?" mirato a guidare i nuovi product manager attraverso la carriera di product management. Il suo viaggio imprenditoriale è iniziato con la sua startup universitaria, STAK, che è stata successivamente acquisita da Carvertise con Aaron che ha contribuito in modo significativo al loro riconoscimento come Startup tecnologica dell'anno 2015 in Delaware. Al di là delle sue attività professionali, Aaron trova gioia nel giocare a golf con suo padre, nell'esplorare nuove culture e cibi durante i suoi viaggi e nel praticare l'ukulele.

Aneto ricco è un Principal Solutions Architect con esperienza in molteplici aree di specializzazione. Un track record di successo che abbraccia software aziendale multipiattaforma e SaaS. Ben noto per trasformare la tutela del cliente (che funge da voce del cliente) in nuove funzionalità e prodotti generatori di entrate. Comprovata capacità di portare sul mercato prodotti all'avanguardia e di portare a termine progetti nei tempi previsti e nel rispetto del budget in ambienti onshore e offshore frenetici. Un modo semplice per descrivermi: la mente di uno scienziato, il cuore di un esploratore e l'anima di un artista.

Aneto ricco è un Principal Solutions Architect con esperienza in molteplici aree di specializzazione. Un track record di successo che abbraccia software aziendale multipiattaforma e SaaS. Ben noto per trasformare la tutela del cliente (che funge da voce del cliente) in nuove funzionalità e prodotti generatori di entrate. Comprovata capacità di portare sul mercato prodotti all'avanguardia e di portare a termine progetti nei tempi previsti e nel rispetto del budget in ambienti onshore e offshore frenetici. Un modo semplice per descrivermi: la mente di uno scienziato, il cuore di un esploratore e l'anima di un artista.

Clay Elmore è un AI/ML Specialist Solutions Architect presso AWS. Dopo aver trascorso molte ore in un laboratorio di ricerca sui materiali, il suo background in ingegneria chimica è stato rapidamente abbandonato per perseguire il suo interesse per l'apprendimento automatico. Ha lavorato su applicazioni ML in molti settori diversi, dal commercio di energia al marketing nel settore dell'ospitalità. L'attuale lavoro di Clay presso AWS è incentrato sull'aiutare i clienti a introdurre pratiche di sviluppo software nei carichi di lavoro di ML e IA generativa, consentendo ai clienti di creare soluzioni ripetibili e scalabili in questi ambienti complessi. Nel tempo libero, Clay ama sciare, risolvere i cubi di Rubik, leggere e cucinare.

Clay Elmore è un AI/ML Specialist Solutions Architect presso AWS. Dopo aver trascorso molte ore in un laboratorio di ricerca sui materiali, il suo background in ingegneria chimica è stato rapidamente abbandonato per perseguire il suo interesse per l'apprendimento automatico. Ha lavorato su applicazioni ML in molti settori diversi, dal commercio di energia al marketing nel settore dell'ospitalità. L'attuale lavoro di Clay presso AWS è incentrato sull'aiutare i clienti a introdurre pratiche di sviluppo software nei carichi di lavoro di ML e IA generativa, consentendo ai clienti di creare soluzioni ripetibili e scalabili in questi ambienti complessi. Nel tempo libero, Clay ama sciare, risolvere i cubi di Rubik, leggere e cucinare.

Sina Sojoodi è un dirigente tecnologico, ingegnere di sistema, leader di prodotto, ex fondatore e consulente di startup. È entrato in AWS nel marzo 2021 come Principal Solutions Architect. Sina è attualmente il Solutions Architect responsabile dell'area ISV degli Stati Uniti occidentali. Collabora con aziende di software SaaS e B2B per costruire e far crescere le loro attività su AWS. Prima del suo ruolo in Amazon, Sina è stato dirigente tecnologico presso VMware e Pivotal Software (IPO nel 2018, VMware M&A nel 2020) e ha ricoperto diversi ruoli di leadership, tra cui ingegnere fondatore presso Xtreme Labs (acquisizione Pivotal nel 2013). Sina ha dedicato gli ultimi 15 anni della sua esperienza lavorativa alla creazione di piattaforme e pratiche software per imprese, società di software e il settore pubblico. È un leader del settore con una passione per l’innovazione. Sina ha conseguito una laurea presso l'Università di Waterloo, dove ha studiato ingegneria elettrica e psicologia.

Sina Sojoodi è un dirigente tecnologico, ingegnere di sistema, leader di prodotto, ex fondatore e consulente di startup. È entrato in AWS nel marzo 2021 come Principal Solutions Architect. Sina è attualmente il Solutions Architect responsabile dell'area ISV degli Stati Uniti occidentali. Collabora con aziende di software SaaS e B2B per costruire e far crescere le loro attività su AWS. Prima del suo ruolo in Amazon, Sina è stato dirigente tecnologico presso VMware e Pivotal Software (IPO nel 2018, VMware M&A nel 2020) e ha ricoperto diversi ruoli di leadership, tra cui ingegnere fondatore presso Xtreme Labs (acquisizione Pivotal nel 2013). Sina ha dedicato gli ultimi 15 anni della sua esperienza lavorativa alla creazione di piattaforme e pratiche software per imprese, società di software e il settore pubblico. È un leader del settore con una passione per l’innovazione. Sina ha conseguito una laurea presso l'Università di Waterloo, dove ha studiato ingegneria elettrica e psicologia.

Sandeep Rohilla è Senior Solutions Architect presso AWS e supporta i clienti ISV nella regione degli Stati Uniti occidentali. Il suo obiettivo è aiutare i clienti a progettare soluzioni sfruttando i contenitori e l'intelligenza artificiale generativa sul cloud AWS. Sandeep è appassionato nel comprendere i problemi aziendali dei clienti e nell'aiutarli a raggiungere i loro obiettivi attraverso la tecnologia. È entrato in AWS dopo aver lavorato per più di un decennio come architetto di soluzioni, mettendo a frutto i suoi 17 anni di esperienza. Sandeep ha conseguito un Master. in Ingegneria del Software presso l'Università dell'Inghilterra Occidentale a Bristol, Regno Unito.

Sandeep Rohilla è Senior Solutions Architect presso AWS e supporta i clienti ISV nella regione degli Stati Uniti occidentali. Il suo obiettivo è aiutare i clienti a progettare soluzioni sfruttando i contenitori e l'intelligenza artificiale generativa sul cloud AWS. Sandeep è appassionato nel comprendere i problemi aziendali dei clienti e nell'aiutarli a raggiungere i loro obiettivi attraverso la tecnologia. È entrato in AWS dopo aver lavorato per più di un decennio come architetto di soluzioni, mettendo a frutto i suoi 17 anni di esperienza. Sandeep ha conseguito un Master. in Ingegneria del Software presso l'Università dell'Inghilterra Occidentale a Bristol, Regno Unito.

Dottor Farooq Sabir è Senior Artificial Intelligence and Machine Learning Specialist Solutions Architect presso AWS. Ha conseguito un dottorato di ricerca e un master in ingegneria elettrica presso l'Università del Texas ad Austin e un master in informatica presso il Georgia Institute of Technology. Ha oltre 15 anni di esperienza lavorativa e gli piace anche insegnare e fare da mentore agli studenti universitari. In AWS, aiuta i clienti a formulare e risolvere i loro problemi aziendali in data science, machine learning, visione artificiale, intelligenza artificiale, ottimizzazione numerica e domini correlati. Con sede a Dallas, in Texas, lui e la sua famiglia amano viaggiare e fare lunghi viaggi.

Dottor Farooq Sabir è Senior Artificial Intelligence and Machine Learning Specialist Solutions Architect presso AWS. Ha conseguito un dottorato di ricerca e un master in ingegneria elettrica presso l'Università del Texas ad Austin e un master in informatica presso il Georgia Institute of Technology. Ha oltre 15 anni di esperienza lavorativa e gli piace anche insegnare e fare da mentore agli studenti universitari. In AWS, aiuta i clienti a formulare e risolvere i loro problemi aziendali in data science, machine learning, visione artificiale, intelligenza artificiale, ottimizzazione numerica e domini correlati. Con sede a Dallas, in Texas, lui e la sua famiglia amano viaggiare e fare lunghi viaggi.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoData.Network Generativo verticale Ai. Potenzia te stesso. Accedi qui.

- PlatoAiStream. Intelligenza Web3. Conoscenza amplificata. Accedi qui.

- PlatoneESG. Carbonio, Tecnologia pulita, Energia, Ambiente, Solare, Gestione dei rifiuti. Accedi qui.

- Platone Salute. Intelligence sulle biotecnologie e sulle sperimentazioni cliniche. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/how-snaplogic-built-a-text-to-pipeline-application-with-amazon-bedrock-to-translate-business-intent-into-action/

- :ha

- :È

- :non

- :Dove

- $ SU

- 10

- 100

- 121

- 14

- 15 anni

- 15%

- 150

- 17

- 1998

- 200

- 2010

- 2013

- 2015

- 2017

- 2018

- 2020

- 2021

- 31

- 33

- 7

- 8

- 9

- a

- Aaron

- capacità

- capace

- Chi siamo

- accesso

- realizzare

- precisione

- Raggiungere

- acquisito

- acquisizione

- operanti in

- Legge

- Action

- azioni

- attivo

- aggiunto

- aggiunta

- aggiuntivo

- Avanzate

- Vantaggio

- consulente

- patrocinio

- Dopo shavasana, sedersi in silenzio; saluti;

- AI

- Sistemi di intelligenza artificiale

- AI-alimentato

- AI / ML

- Mirato

- mira

- Algoritmi

- Tutti

- permesso

- Consentire

- consente

- lungo

- a fianco di

- già

- anche

- Amazon

- Amazon Web Services

- quantità

- an

- l'analisi

- ed

- rispondere

- risposte

- Antropico

- in qualsiasi

- api

- API

- Applicazioni

- applicazioni

- si applica

- approccio

- applicazioni

- Arabo

- architettura

- SONO

- RISERVATA

- aree

- in giro

- arrivato

- Arte

- artificiale

- intelligenza artificiale

- Intelligenza artificiale e apprendimento automatico

- artista

- AS

- chiedere

- chiedendo

- Assistant

- associato

- At

- aumentata

- austin

- autore

- automatizzare

- Automatizzata

- automaticamente

- Automazione

- disponibile

- AWS

- Cliente AWS

- B2B

- sfondo

- sostegno

- base

- basato

- Linea di base

- BE

- Orso

- è diventato

- perché

- diventare

- stato

- prima

- ha iniziato

- iniziare

- dietro

- essendo

- vantaggi

- MIGLIORE

- Meglio

- fra

- Al di là di

- Big

- Big Data

- libro

- entrambi

- portare

- Portare

- Porta

- Bristol

- ampio

- in linea di massima

- budget limitato.

- costruire

- Costruzione

- costruisce

- costruito

- affari

- impatto sul business

- aziende

- ma

- by

- chiamata

- detto

- Materiale

- funzionalità

- Career

- Custodie

- casi

- centri

- catena

- Challenge

- possibilità

- caratteristiche

- carico

- chimico

- capo

- scegliere

- pulire campo

- strettamente

- chiusura

- Cloud

- Cluster

- codice

- codifica

- collaborato

- collaborazione

- collezione

- College

- combinare

- combinato

- viene

- impegno

- Aziende

- Società

- costretto

- completamento

- complesso

- globale

- computer

- Informatica

- Visione computerizzata

- informatica

- concetti

- configurazione

- Collegamento

- veloce

- Connessioni

- costantemente

- Tecnologie Container

- contiene

- contenuto

- creazione di contenuti

- contesto

- continua

- contratto

- contribuendo

- discorsivo

- cucina

- Nucleo

- correggere

- correttamente

- Costo

- potuto

- Corsi

- creare

- creato

- creazione

- la creatività

- critico

- Corrente

- Attualmente

- costume

- cliente

- Clienti

- taglio

- bordo tagliente

- Dallas

- dati

- integrazione dei dati

- elaborazione dati

- scienza dei dati

- Banca Dati

- banche dati

- Giorni

- decennio

- diminuire

- dedicato

- deep

- più profondo

- Delaware

- Dimo

- democratizzare

- Shirts Department

- derivato

- descrivere

- descrizione

- Design

- progettato

- desiderio

- desiderato

- dettagliati

- dettagli

- sviluppatori

- Mercato

- dispositivi

- Dialogo

- diverso

- direttamente

- distribuito

- sistemi distribuiti

- immersione

- do

- documenti

- non

- fare

- domini

- Dont

- giù

- bozza

- drasticamente

- guidare

- dovuto

- ogni

- più facile

- più semplice

- facilmente

- ecosistema

- in maniera efficace

- o

- Ingegneria Elettrica

- elementi

- Abilita

- fine

- finale

- energia

- ingegnere

- Ingegneria

- Inghilterra

- Inglese

- aumento

- abbastanza

- garantire

- assicura

- entrare

- Impresa

- software aziendale

- Enterprise Solutions

- aziende

- Intero

- interamente

- imprenditoriale

- ambienti

- pari

- Equivalente

- errore

- particolarmente

- Etere (ETH)

- Anche

- evidente

- di preciso

- esempio

- Esempi

- Excel

- eccitato

- esecutivo

- esistente

- previsto

- aspetta

- esperienza

- esperto

- competenza

- esploratore

- Esplorare

- extra

- estremamente

- famiglia

- che si muove velocemente

- fast-paced

- caratteristica

- Caratteristiche

- pochi

- campo

- campi

- filtro

- filtraggio

- filtri

- trova

- Nome

- nave ammiraglia

- flusso

- flussi

- Focus

- si concentra

- messa a fuoco

- seguire

- i seguenti

- segue

- alimenti

- Nel

- Incursione

- prima linea

- formato

- forme

- Avanti

- essere trovato

- Fondazione

- fondazione

- Francisco

- amichevole

- da

- Adempiere

- completamente

- function

- ulteriormente

- futuro

- guadagnato

- generalmente

- generare

- generato

- genera

- la generazione di

- ELETTRICA

- generativo

- AI generativa

- Georgia

- Georgia Institute of Technology

- ottenere

- gif

- dato

- Go

- Obiettivi

- va

- buono

- laurea

- Crescere

- guida

- ha avuto

- cura

- Sfruttamento

- Avere

- he

- Cuore

- Aiuto

- aiutato

- utile

- aiutare

- aiuta

- qui

- ad alte prestazioni

- alta qualità

- evidenzia

- il suo

- tenere

- detiene

- ospitalità

- ORE

- Come

- Tutorial

- Tuttavia

- HTML

- HTTPS

- umano

- umile

- identificato

- if

- illustrare

- subito

- Impact

- di forte impatto

- realizzare

- importante

- competenze

- migliorata

- miglioramento

- in

- includere

- incluso

- Compreso

- Aumento

- studente indipendente

- indica

- individuale

- industrie

- industria

- Leader del settore

- informazioni

- innato

- innovare

- Innovazione

- ingresso

- Ingressi

- immediato

- invece

- Istituto

- istruzioni

- integrato

- integrazione

- integrazioni

- Intelligence

- Intelligente

- intento

- interazioni

- interattivo

- interesse

- Interfaccia

- interno

- ai miglioramenti

- introdotto

- Introduce

- introduttivo

- IPO

- isv

- IT

- iterazione

- iterazioni

- SUO

- Java

- Lavoro

- congiunto

- accoppiamento

- giunto

- viaggio

- gioia

- jpg

- json

- ad appena

- Le

- Sapere

- conoscenze

- conosciuto

- conosce

- laboratorio

- Labs

- Lingua

- Le Lingue

- grandi

- Cognome

- dopo

- con i più recenti

- portare

- leader

- Leadership

- principale

- Salto

- imparato

- apprendimento

- a sinistra

- lasciare

- leveraging

- piace

- piace

- logica

- Lunghi

- Guarda

- lotto

- amore

- M & A

- macchina

- machine learning

- macchine

- fatto

- make

- FA

- Fare

- gestito

- gestione

- direttore

- I gestori

- modo

- manualmente

- molti

- mappatura

- Marzo

- Rappresentanza

- Marketing

- fiammiferi

- Materiale

- me

- mentore

- semplice

- Metadati

- metodo

- milioni

- mente

- verbale

- Missione

- ML

- modello

- modelli

- MongoDB

- Scopri di più

- maggior parte

- cambiano

- MS

- Multi-Platform

- multiplo

- my

- Nome

- Naturale

- Linguaggio naturale

- Bisogno

- esigenze

- New

- Nuove funzionalità

- nuovo prodotto

- GENERAZIONE

- no

- Nota

- computer portatili

- Avviso..

- adesso

- oggetto

- oggetti

- si è verificato

- of

- Offerte

- di frequente

- on

- una volta

- ONE

- esclusivamente

- operativo

- sistemi operativi

- ottimizzazione

- ottimizzazione

- or

- minimo

- ordini

- organizzazione

- organizzazioni

- i

- Altro

- nostro

- su

- Risultato

- produzione

- uscite

- ancora

- pagine

- Parallel

- particolarmente

- partner

- Partnership

- passione

- appassionato

- passato

- Cartamodello

- esegue

- prospettiva

- fase

- phd

- pezzi

- pioniere

- conduttura

- centrale

- posto

- piattaforma

- Piattaforme

- Platone

- Platone Data Intelligence

- PlatoneDati

- Popolare

- popolarità

- Post

- potenziale

- potenzialmente

- energia

- alimentato

- pratica

- pratiche

- predire

- previsto

- precedente

- primario

- Direttore

- Privacy

- Privacy e sicurezza

- Problema

- problemi

- procedura

- processi

- i processi

- lavorazione

- Prodotto

- produce

- Prodotto

- sviluppo del prodotto

- gestione del prodotto

- product manager

- Prodotti

- Prodotti e Servizi

- professionale

- Insegnante

- Programmazione

- linguaggi di programmazione

- progetti

- istruzioni

- comprovata

- fornire

- purché

- fornisce

- fornitura

- Psicologia

- la percezione

- pubblicato

- Ricerche pubblicate

- perseguire

- Python

- query

- domanda

- rapidamente

- casuale

- casualità

- gamma

- che vanno

- veloce

- Lettura

- rendersi conto

- regno

- ricevere

- recentemente

- riconoscimento

- raccomandare

- record

- record

- ridurre

- riduce

- riducendo

- per quanto riguarda

- regione

- rivisitazione

- relazionato

- rilasciato

- pertinente

- affidabile

- fare affidamento

- ricorda

- rimuovere

- reso

- ripetibile

- replica

- rappresentazione

- che rappresenta

- rappresenta

- richiesta

- richieste

- richiedere

- necessario

- Requisiti

- richiede

- riparazioni

- risposta

- risposte

- REST

- risultante

- Risultati

- ritorno

- problemi

- rivoluzionare

- Ricco

- destra

- strada

- Ruolo

- ruoli

- Prenotazione sale

- Correre

- corre

- SaaS

- Sicurezza

- sagemaker

- Suddetto

- stesso

- San

- San Francisco

- Scala

- scalabile

- Scala

- programma

- Scienze

- Scienziato

- graffiare

- sdk

- ricerca

- Secondo

- Sezione

- settore

- problemi di

- vedere

- visto

- select

- invio

- anziano

- inviato

- Sequenza

- servito

- servizio

- Servizi

- servizio

- sessioni

- set

- regolazione

- alcuni

- dovrebbero

- mostrare attraverso le sue creazioni

- mostrato

- Spettacoli

- significativamente

- simile

- Un'espansione

- semplificare

- semplificando

- semplicemente

- da

- singolo

- piccole

- So

- Software

- software come un servizio

- Sviluppatori di software

- lo sviluppo del software

- Ingegneria del software

- soluzione

- Soluzioni

- RISOLVERE

- Soluzione

- alcuni

- Qualcuno

- sofisticato

- Anima

- Fonte

- lo spazio

- Spagnolo

- tensione

- specialista

- specifico

- in particolare

- specificato

- spendere

- Spendere

- SQL

- inizia a

- iniziato

- startup

- dichiarazione

- Stato dei servizi

- step

- Passi

- Fermare

- lineare

- La struttura

- Gli studenti

- studiato

- il successo

- Supporto

- supporti

- suppone

- sicuro

- sistema

- SISTEMI DI TRATTAMENTO

- tavolo

- TAG

- Fai

- Target

- Task

- task

- insegnato

- team

- le squadre

- Tech

- avvio tech

- Consulenza

- per l'esame

- tecniche

- Tecnologia

- dire

- carnagione

- Texas

- testo

- di

- che

- Il

- L'Occidente

- il mondo

- loro

- Li

- poi

- Strumenti Bowman per analizzare le seguenti finiture:

- di

- cose

- think

- questo

- quelli

- Attraverso

- per tutto

- tempo

- a

- oggi

- token

- Tokens

- detto

- ha preso

- tracciare

- pista

- Trading

- tradizionalmente

- Training

- trasformativa

- trasforma

- tradurre

- viaggiare

- viaggia

- trend

- prova

- innescare

- innescando

- vero

- Vero codice

- cerca

- Svolta

- Digitare

- ui

- Uk

- per

- capire

- e una comprensione reciproca

- capisce

- unico

- Università

- fino a quando

- svelato

- imminenti

- aggiornato

- su

- us

- utilizzabile

- uso

- caso d'uso

- utilizzato

- Utente

- Esperienza da Utente

- utenti

- usa

- utilizzando

- generalmente

- ux

- vario

- fornitori

- molto

- via

- visione

- visivo

- vmware

- Voce

- volere

- Prima

- Modo..

- we

- sito web

- servizi web

- Settimane

- WELL

- sono stati

- ovest

- Che

- Che cosa è l'

- quando

- quale

- largo

- Vasta gamma

- volere

- finestra

- con

- senza

- Lavora

- lavorato

- flusso di lavoro

- flussi di lavoro

- lavoro

- lavori

- mondo

- Il mondo di

- sarebbe

- scrivere

- XML

- anno

- anni

- Tu

- Trasferimento da aeroporto a Sharm

- youtube

- zefiro