Selamat datang di era data. Volume data yang diambil setiap hari terus bertambah, membutuhkan platform dan solusi untuk berkembang. Layanan seperti Layanan Penyimpanan Sederhana Amazon (Amazon S3) menawarkan solusi terukur yang beradaptasi namun tetap hemat biaya untuk mengembangkan kumpulan data. Itu Inisiatif Data Keberlanjutan Amazon (ASDI) menggunakan kemampuan Amazon S3 untuk memberikan solusi tanpa biaya bagi Anda untuk menyimpan dan berbagi beban kerja ilmu iklim di seluruh dunia. Program Sponsor Data Terbuka Amazon memungkinkan organisasi untuk menghosting secara gratis di AWS.

Selama dekade terakhir, kami telah melihat lonjakan kerangka kerja ilmu data yang membuahkan hasil, bersama dengan adopsi massal oleh komunitas ilmu data. Salah satu kerangka tersebut adalah Senja, yang sangat andal karena kemampuannya menyediakan orkestrasi node komputasi pekerja, sehingga mempercepat analisis kompleks pada kumpulan data besar.

Dalam posting ini, kami menunjukkan kepada Anda cara menerapkan custom Kit Pengembangan AWS Cloud (AWS CDK) solusi yang memperluas fungsionalitas Dask untuk bekerja antar-Wilayah di seluruh jaringan global Amazon. Solusi AWS CDK menerapkan jaringan pekerja Dask di dua Wilayah AWS, terhubung ke Wilayah klien. Untuk informasi lebih lanjut, lihat Panduan untuk Komputasi Terdistribusi dengan Cross Regional Dask di AWS dan GitHub repo untuk kode sumber terbuka.

Setelah penerapan, pengguna akan memiliki akses ke notebook Jupyter, tempat mereka dapat berinteraksi dengan dua kumpulan data dari ASDI di AWS: Proyek Interkomparasi Model Berpasangan 6 (CMIP6) dan Analisis Ulang ECMWF ERA5. CMIP6 berfokus pada fase keenam ansambel model sirkulasi umum atmosfer laut gabungan global; ERA5 adalah generasi kelima dari analisis ulang atmosfer ECMWF tentang iklim global, dan analisis ulang pertama yang diproduksi sebagai layanan operasional.

Solusi ini terinspirasi oleh pekerjaan dengan pelanggan utama AWS, the Kantor UK Met. Met Office didirikan pada tahun 1854 dan merupakan layanan meteorologi nasional untuk Inggris. Mereka memberikan prediksi cuaca dan iklim untuk membantu Anda membuat keputusan yang lebih baik agar tetap aman dan berkembang. Kolaborasi antara Met Office dan EUMETSAT, dirinci dalam Komputasi Proksimat Data pada Cluster Dask yang Didistribusikan Antara Pusat Data, menyoroti meningkatnya kebutuhan untuk mengembangkan solusi ilmu data yang berkelanjutan, efisien, dan dapat diskalakan. Solusi ini mencapainya dengan mendekatkan komputasi ke data, daripada memaksa data mendekat ke sumber daya komputasi, yang menambah biaya, latensi, dan energi.

Ikhtisar solusi

Setiap hari, UK Met Office menghasilkan hingga 300 TB data cuaca dan iklim, sebagian dipublikasikan ke ASDI. Kumpulan data ini didistribusikan ke seluruh dunia dan dihosting untuk penggunaan umum. Met Office ingin memungkinkan konsumen memanfaatkan lebih banyak data mereka untuk membantu menginformasikan keputusan penting dalam mengatasi masalah seperti persiapan yang lebih baik untuk kebakaran hutan dan banjir akibat perubahan iklim, dan mengurangi kerawanan pangan melalui analisis hasil panen yang lebih baik.

Solusi tradisional yang digunakan saat ini, terutama dengan data iklim, memakan waktu dan tidak berkelanjutan, mereplikasi kumpulan data lintas Wilayah. Transfer data yang tidak perlu pada skala petabyte mahal, lambat, dan menghabiskan energi.

Kami memperkirakan bahwa jika praktik ini diterapkan oleh pengguna Met Office, konsumsi daya harian yang setara dengan 40 rumah dapat dihemat setiap hari, dan mereka juga dapat mengurangi transfer data antar wilayah.

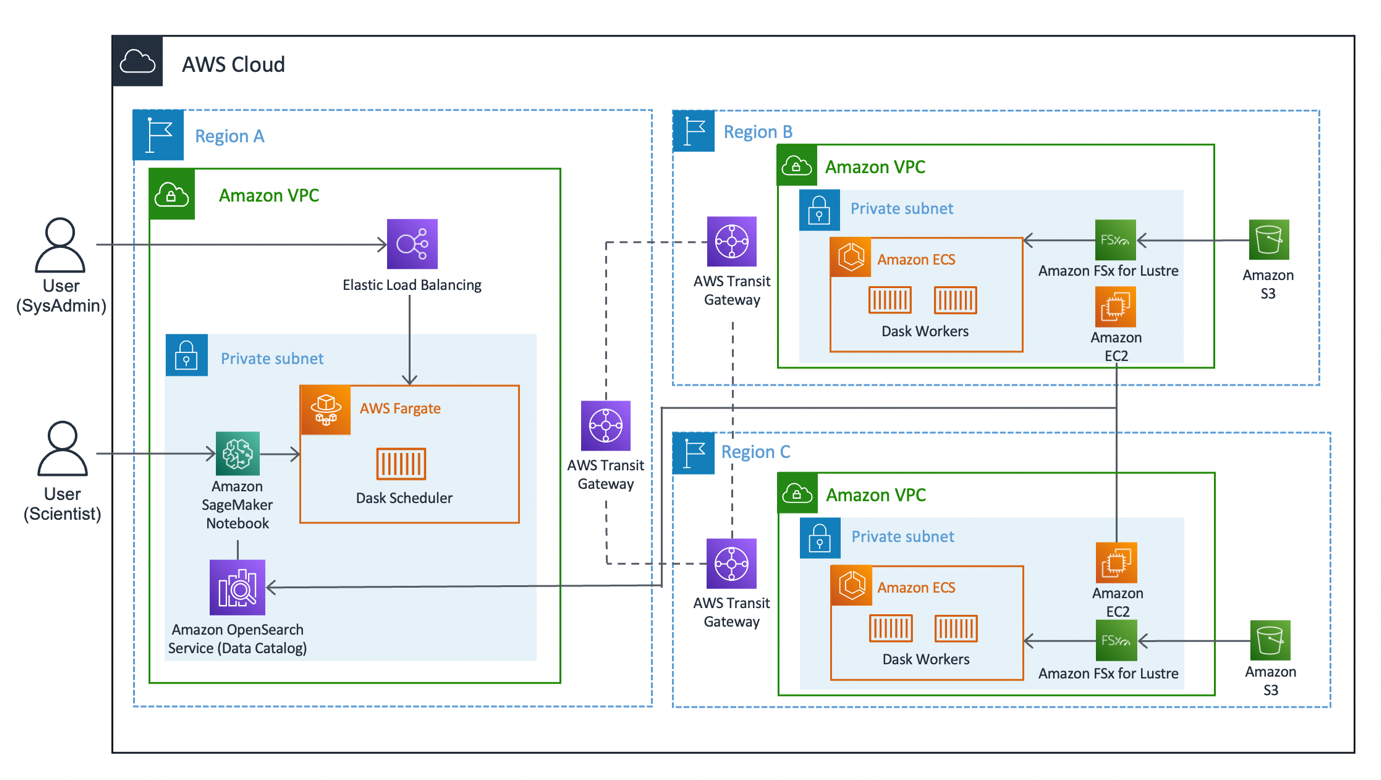

Diagram berikut menggambarkan arsitektur solusi.

Solusinya dapat dibagi menjadi tiga segmen utama: klien, pekerja, dan jaringan. Mari selami masing-masing dan lihat bagaimana mereka bersatu.

Pelanggan

Klien mewakili Wilayah sumber tempat ilmuwan data terhubung. Wilayah ini (Wilayah A pada diagram) berisi sebuah Notebook Amazon SageMaker, Sebuah Layanan Pencarian Terbuka Amazon domain, dan a Penjadwal gelap sebagai komponen kunci. Administrator sistem memiliki akses ke dasbor Dask bawaan yang diekspos melalui Penyeimbang Beban Elastis.

Ilmuwan data memiliki akses ke notebook Jupyter yang dihosting di SageMaker. Notebook dapat terhubung dan menjalankan beban kerja pada penjadwal Dask. Domain Layanan OpenSearch menyimpan metadata pada kumpulan data yang terhubung di Wilayah. Pengguna notebook dapat mengkueri layanan ini untuk mengambil detail seperti pekerja Region of Dask yang benar tanpa perlu mengetahui lokasi Regional data sebelumnya.

Pekerja

Setiap Wilayah pekerja (Wilayah B dan C dalam diagram) terdiri dari sebuah Layanan Kontainer Amazon Elastic (Amazon ECS) klaster Pekerja gelap, Sebuah Amazon FSx untuk Lustre sistem file, dan mandiri Cloud komputasi elastis Amazon (Amazon EC2) misalnya. FSx for Luster memungkinkan pekerja Dask untuk mengakses dan memproses data Amazon S3 dari sistem file berkinerja tinggi dengan menautkan sistem file Anda ke bucket S3. Ini memberikan latensi sub-milidetik, throughput hingga ratusan GB/dtk, dan jutaan IOPS. Fitur utama Luster adalah hanya metadata sistem file yang disinkronkan. Luster mengelola keseimbangan file yang akan dimuat dan tetap hangat, berdasarkan permintaan.

Skala cluster pekerja berdasarkan penggunaan CPU, menyediakan pekerja tambahan dalam jangka waktu permintaan yang lama, dan menurunkan skala saat sumber daya menganggur.

Setiap malam pada pukul 0:00 UTC, tugas sinkronisasi data meminta sistem file Lustre untuk melakukan sinkronisasi ulang dengan bucket S3 terlampir, dan menarik katalog metadata terbaru dari bucket tersebut. Selanjutnya, instans EC2 mandiri mendorong pembaruan ini ke Layanan OpenSearch sesuai dengan indeks Wilayah tersebut. Layanan OpenSearch memberikan informasi yang diperlukan kepada klien tentang kumpulan pekerja mana yang harus dipanggil untuk kumpulan data tertentu.

jaringan

Jaringan membentuk inti dari solusi ini, memanfaatkan jaringan backbone internal Amazon. Dengan menggunakan Gerbang Transit AWS, kami dapat menghubungkan setiap Wilayah satu sama lain tanpa perlu melintasi internet publik. Setiap pekerja dapat terhubung secara dinamis ke penjadwal Dask, memungkinkan ilmuwan data untuk menjalankan kueri antar wilayah melalui Dask.

Prasyarat

Paket AWS CDK menggunakan bahasa pemrograman TypeScript. Ikuti langkah-langkah di Memulai untuk AWS CDK untuk mengatur lingkungan lokal Anda dan mem-bootstrap akun pengembangan Anda (Anda harus mem-bootstrap semua Wilayah yang ditentukan dalam GitHub repo).

Untuk penerapan yang berhasil, Anda memerlukan Docker diinstal dan berjalan di mesin lokal Anda.

Terapkan paket AWS CDK

Menerapkan paket AWS CDK sangatlah mudah. Setelah Anda menginstal prasyarat dan mem-bootstrap akun Anda, Anda dapat melanjutkan dengan mengunduh basis kode.

- Download Repositori GitHub:

- Instal modul node:

- Menerapkan AWS CDK:

Tumpukan dapat memakan waktu lebih dari satu setengah jam untuk diterapkan.

Panduan kode

Pada bagian ini, kami memeriksa beberapa fitur utama basis kode. Jika Anda ingin memeriksa basis kode lengkap, lihat Repositori GitHub.

Konfigurasikan dan sesuaikan tumpukan Anda

Di dalam file bin/variabel.ts, Anda akan menemukan dua deklarasi variabel: satu untuk klien dan satu untuk pekerja. Deklarasi klien adalah kamus dengan referensi ke Wilayah dan rentang CIDR. Menyesuaikan variabel ini akan mengubah rentang Wilayah dan CIDR tempat sumber daya klien akan diterapkan.

Variabel pekerja menyalin fungsi yang sama ini; namun, ini adalah daftar kamus untuk mengakomodasi penambahan atau pengurangan kumpulan data yang ingin disertakan pengguna. Selain itu, setiap kamus berisi bidang tambahan dari dataset dan lustreFileSystemPath. Dataset digunakan untuk menentukan S3 URI penghubung untuk Lustre untuk terhubung. Itu lustreFileSystemPath variabel digunakan sebagai pemetaan untuk bagaimana pengguna ingin dataset tersebut dipetakan secara lokal pada sistem file pekerja. Lihat kode berikut:

Publikasikan IP penjadwal secara dinamis

Tantangan yang melekat pada sifat lintas wilayah dari proyek ini adalah menjaga hubungan dinamis antara pekerja Dask dan penjadwal. Bagaimana kami dapat memublikasikan alamat IP, yang dapat diubah, di seluruh Wilayah AWS? Kami dapat mencapai ini melalui penggunaan Peta AWS Cloud dan asosiasikan-vpc-dengan-hosted-zone. Layanan abstrak memungkinkan AWS untuk mengelola ruang nama DNS ini secara pribadi. Lihat kode berikut:

Antarmuka notebook Jupyter

Notebook Jupyter yang dihosting di SageMaker menyediakan lingkungan siap pakai bagi para ilmuwan untuk penerapan agar dapat dengan mudah terhubung dan bereksperimen pada kumpulan data yang dimuat. Kami menggunakan a skrip konfigurasi siklus hidup untuk menyediakan notebook dengan lingkungan pengembang yang telah dikonfigurasi sebelumnya dan basis kode contoh. Lihat kode berikut:

Node pekerja gelap

Dalam hal pekerja Dask, kemampuan penyesuaian yang lebih besar disediakan, lebih khusus pada jenis instans, utas per wadah, dan alarm penskalaan. Secara default, pekerja menyediakan jenis instans m5d.4xlarge, memasang ke sistem file Lustre saat diluncurkan, dan membagi pekerja dan utasnya secara dinamis ke port. Semua ini dapat disesuaikan secara opsional. Lihat kode berikut:

Performance

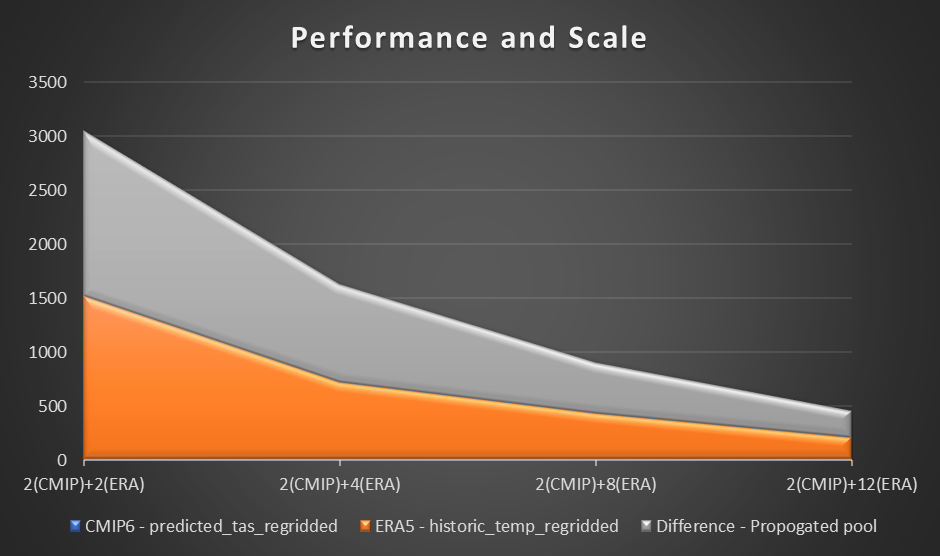

Untuk menilai kinerja, kami menggunakan perhitungan sampel dan memplot suhu udara pada jarak 2 meter berdasarkan perbedaan antara prediksi CMIP6 selama sebulan dan rata-rata suhu udara ERA5 selama 10 tahun. Kami menetapkan tolok ukur dua pekerja di setiap Wilayah dan menilai perbedaan pengurangan waktu saat pekerja tambahan ditambahkan. Secara teori, saat skala solusi, seharusnya ada perbedaan material yang produktif dalam mengurangi waktu keseluruhan.

Tabel berikut meringkas detail dataset kami.

| Dataset | Variabel | Ukuran Disk | Ukuran Dataset Xarray | Daerah |

| ERA5 | 2011–2020 (120 file netcdf) | 53.5GB | 364.1 GB | kami-timur-1 |

| CMIP6 | 1.13GB | 0.11 GB | kami-barat-2 |

Tabel berikut menunjukkan hasil yang dikumpulkan, menampilkan waktu (dalam detik) untuk setiap komputasi dan prediksi dalam tiga tahap dalam menghitung prediksi CMIP6, ERA5, dan perbedaan.

| . | . | Jumlah Pekerja | |||

| menghitung | Daerah | 2(CMIP) + 2(ERA) | 2(CMIP) + 4(ERA) | 2(CMIP) + 8(ERA) |

2 (CMIP) + 12(ERA) |

CMIP6 (predicted_tas_regridded) |

kami-barat-2 | 11.8 | 11.5 | 11.2 | 11.6 |

ERA5 (historic_temp_regridded) |

kami-timur-1 | 1512 | 711 | 427 | 202 |

Perbedaan (propogated pool) |

us-barat-2 dan us-timur-1 | 1527 | 906 | 469 | 251 |

Grafik berikut memvisualisasikan kinerja dan skala.

Dari percobaan kami, kami mengamati peningkatan linier pada komputasi untuk kumpulan data ERA5 karena jumlah pekerja meningkat. Ketika jumlah pekerja meningkat, waktu komputasi terkadang berkurang setengahnya.

Notebook Jupyter

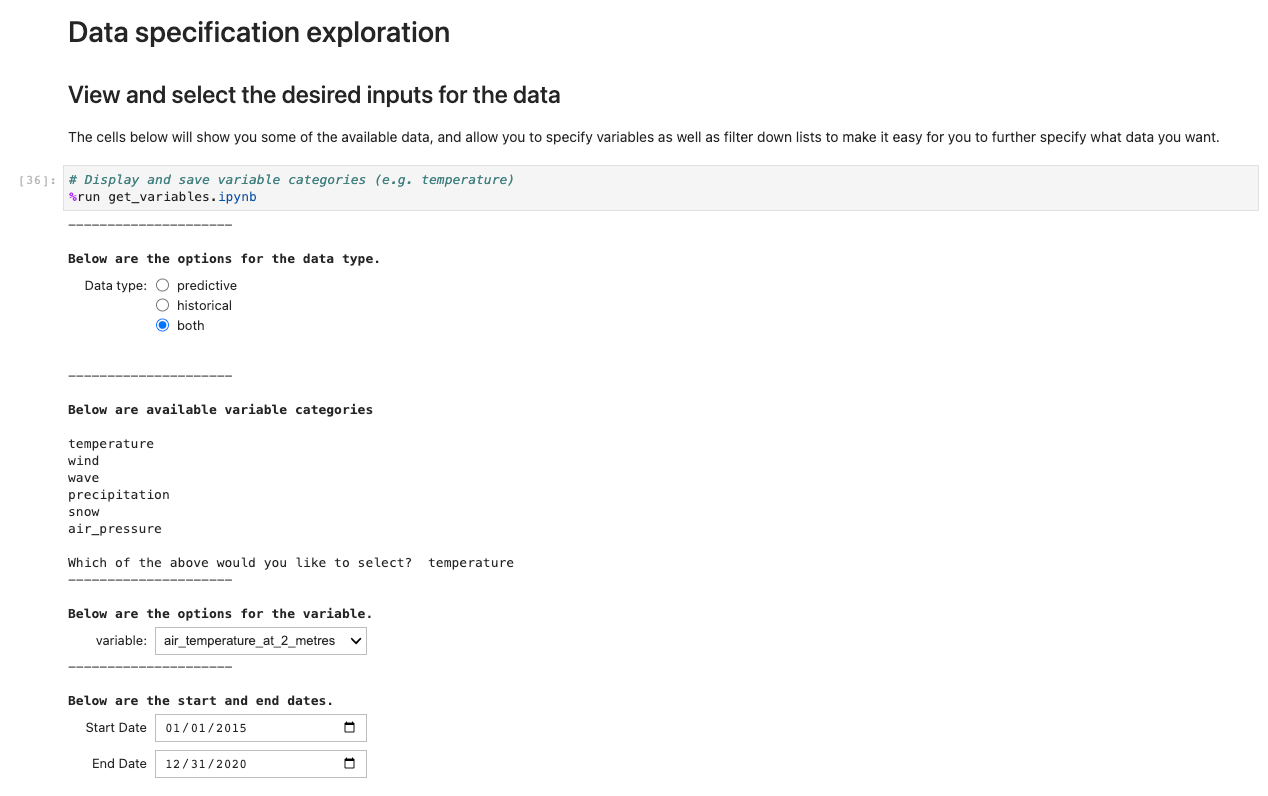

Sebagai bagian dari peluncuran solusi, kami menerapkan notebook Jupyter yang telah dikonfigurasi sebelumnya untuk membantu menguji solusi Dask lintas Wilayah. Notebook menunjukkan kekhawatiran yang dihilangkan karena perlu mengetahui lokasi Regional dari kumpulan data, alih-alih menanyakan katalog melalui serangkaian notebook Jupyter yang berjalan di latar belakang.

Untuk memulai, ikuti petunjuk di bagian ini.

Kode untuk notebook dapat ditemukan di lib/SagemakerCode dengan notebook utama sedang ux_notebook.ipynb. Buku catatan ini memanggil buku catatan lain, memicu skrip pembantu. ux_notebook dirancang untuk menjadi titik masuk bagi para ilmuwan, tanpa perlu pergi ke tempat lain.

Untuk memulai, buka notebook ini di SageMaker setelah Anda menerapkan AWS CDK. AWS CDK membuat instans notebook dengan semua file dalam repositori dimuat dan dicadangkan ke Komitmen Kode AWS gudang.

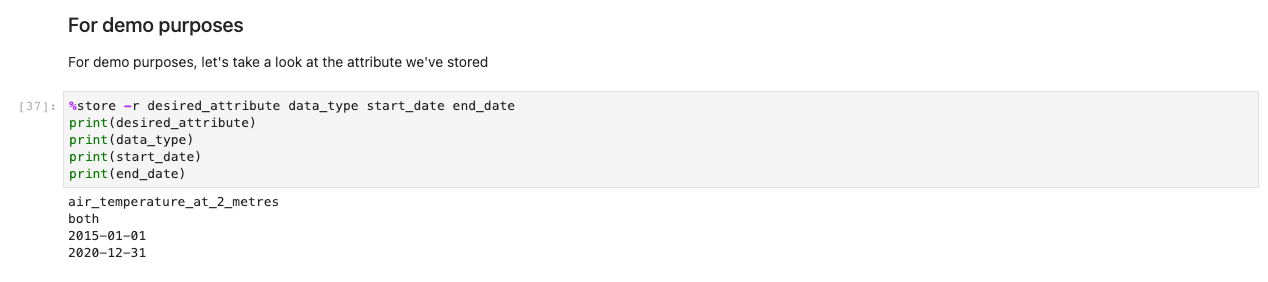

Untuk menjalankan aplikasi, buka dan jalankan sel pertama ux_notebook. Sel ini menjalankan get_variables buku catatan di latar belakang, yang meminta Anda memasukkan data yang ingin Anda pilih. Kami menyertakan contoh; namun, perhatikan bahwa pertanyaan hanya akan muncul setelah opsi sebelumnya dipilih. Ini disengaja untuk membatasi pilihan drop-down dan secara opsional dapat dikonfigurasi dengan mengedit file get_variables buku catatan.

Kode sebelumnya menyimpan variabel secara global sehingga buku catatan lain dapat mengambil dan memuat pilihan pilihan Anda. Untuk demonstrasi, sel berikutnya harus menampilkan variabel penyimpanan dari sebelumnya.

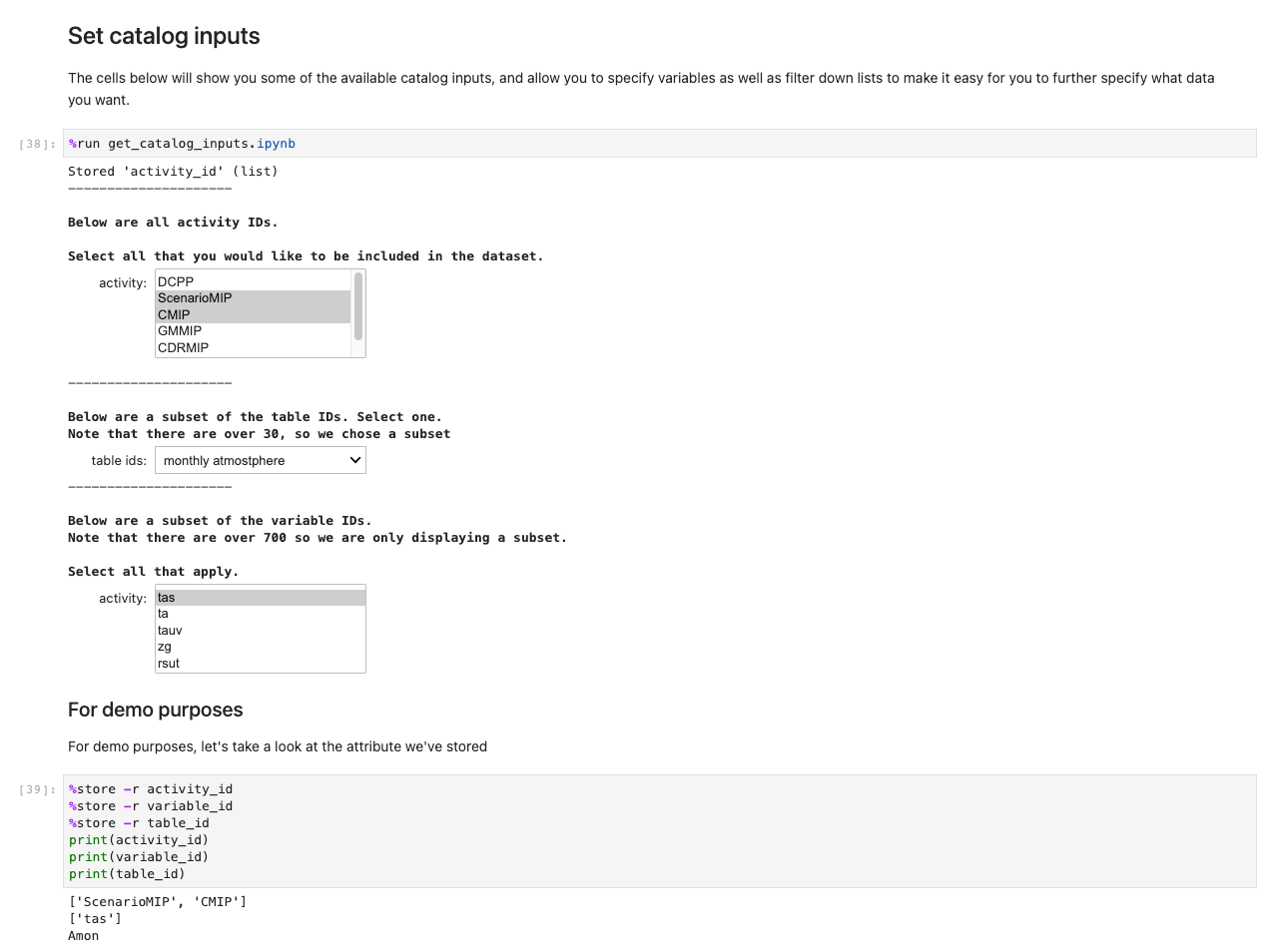

Selanjutnya, prompt untuk spesifikasi data lebih lanjut muncul. Sel ini menyempurnakan data yang Anda cari dengan menampilkan ID tabel dalam format yang dapat dibaca manusia. Pengguna memilih seolah-olah itu adalah formulir, tetapi judul dipetakan ke tabel di latar belakang yang membantu sistem mengambil kumpulan data yang sesuai.

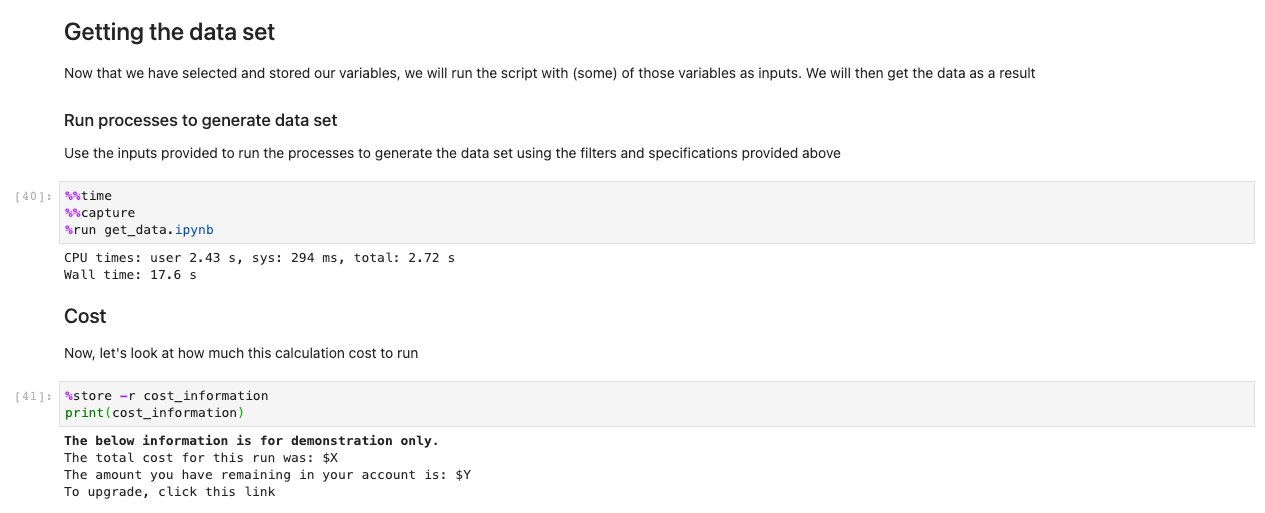

Setelah Anda menyimpan semua pilihan dan sel pilihan Anda, muat data ke dalam Wilayah dengan menjalankan sel di Mendapatkan data set bagian. Perintah %%capture akan menekan output yang tidak perlu dari get_data buku catatan. Catatan Anda dapat menghapus ini untuk memeriksa keluaran dari notebook lain. Data kemudian diambil di backend.

Saat notebook lain dijalankan di latar belakang, satu-satunya titik sentuh bagi pengguna adalah ux_notebook. Ini untuk mengabstraksi proses impor data yang membosankan ke dalam format yang dapat diikuti oleh pengguna mana pun dengan mudah.

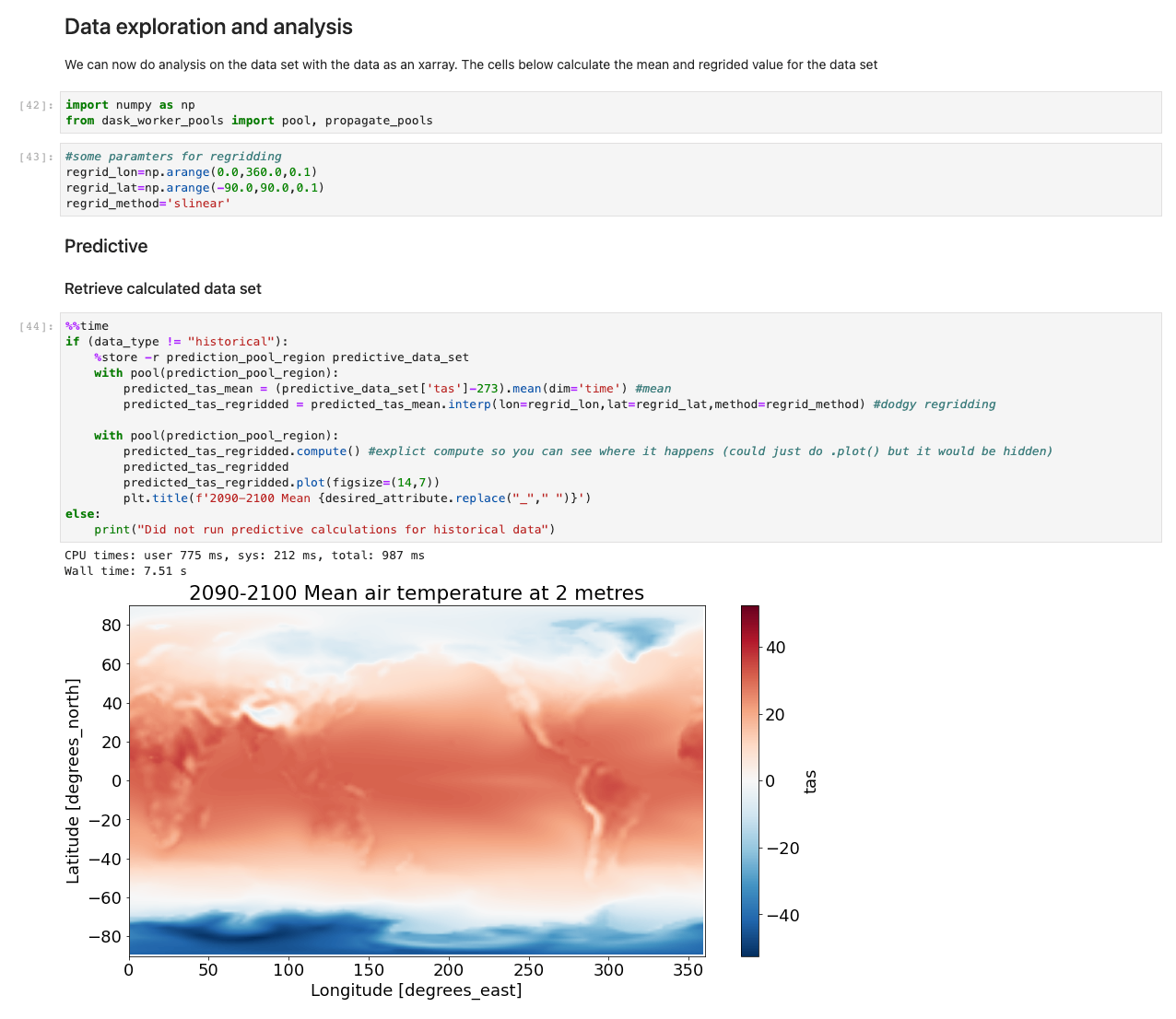

Dengan data yang sekarang dimuat, kita dapat mulai berinteraksi dengannya. Sel berikut adalah contoh perhitungan yang dapat Anda jalankan pada data cuaca. Menggunakan xarray, kami mengimpor, menghitung, lalu memplot kumpulan data tersebut.

Sampel kami mengilustrasikan plot data prediktif yang mengambil data, menjalankan komputasi, dan memplot hasilnya dalam waktu kurang dari 7.5 detik—urutan besarnya lebih cepat daripada pendekatan biasa.

Dibawah tenda

Buku catatan get_catalog_input dan get_variables menggunakan perpustakaan widget ipy untuk menampilkan widget seperti drop-down dan pilihan multi-kotak. Opsi ini disimpan secara global menggunakan perintah %%store sehingga dapat diakses dari ux_notebook. Salah satu opsi menanyakan apakah Anda menginginkan data historis, data prediktif, atau keduanya. Variabel ini diteruskan ke get_data notebook untuk menentukan notebook berikutnya yang akan dijalankan.

Grafik get_data notebook terlebih dahulu mengambil domain Layanan OpenSearch bersama yang disimpan ke Penyimpanan Parameter Manajer Sistem AWS. Domain ini memungkinkan notebook kami menjalankan kueri untuk mengumpulkan informasi yang akan menunjukkan di mana kumpulan data yang dipilih disimpan secara Regional. Dengan kumpulan data tersebut yang terletak secara Regional, notebook akan melakukan upaya koneksi ke penjadwal Dask, menyampaikan informasi yang dikumpulkan dari Layanan OpenSearch. Penjadwal Dask pada gilirannya akan dapat memanggil pekerja di Wilayah yang benar.

Cara menyesuaikan dan melanjutkan pengembangan

Notebook ini dimaksudkan untuk menjadi contoh bagaimana Anda dapat membuat cara bagi pengguna untuk berinteraksi dan berinteraksi dengan data. Buku catatan dalam postingan ini berfungsi sebagai ilustrasi tentang apa yang mungkin terjadi, dan kami mengundang Anda untuk terus mengembangkan solusi guna lebih meningkatkan keterlibatan pengguna. Bagian inti dari solusi ini adalah teknologi backend, tetapi tanpa beberapa mekanisme untuk berinteraksi dengan backend tersebut, pengguna tidak akan menyadari potensi penuh dari solusi tersebut.

Untuk menghindari timbulnya biaya di masa mendatang, hapus sumber daya. Mari hancurkan solusi yang diterapkan dengan perintah berikut:

Kesimpulan

Posting ini menampilkan ekstensi Dask antar-Wilayah di AWS, dan kemungkinan integrasi dengan kumpulan data publik di AWS. Solusinya dibangun sebagai pola generik, dan kumpulan data lebih lanjut dapat dimuat untuk mempercepat analisis I/O yang tinggi pada data yang kompleks.

Data mengubah setiap bidang dan setiap bisnis. Namun, dengan pertumbuhan data yang lebih cepat daripada yang dapat dilacak sebagian besar perusahaan, mengumpulkan data dan mendapatkan nilai dari data tersebut merupakan tantangan. Strategi data modern dapat membantu Anda menciptakan hasil bisnis yang lebih baik dengan data. AWS menyediakan rangkaian layanan terlengkap untuk perjalanan data ujung ke ujung untuk membantu Anda membuka nilai dari data Anda dan mengubahnya menjadi wawasan.

Untuk mempelajari lebih lanjut tentang berbagai cara menggunakan data Anda di cloud, kunjungi Blog Data Besar AWS. Kami selanjutnya mengundang Anda untuk berkomentar dengan pemikiran Anda pada posting ini, dan apakah ini solusi yang Anda rencanakan untuk dicoba.

Tentang Penulis

Patrick O'Connor adalah Insinyur Prototyping WWSO yang berbasis di London. Dia adalah pemecah masalah yang kreatif, dapat beradaptasi di berbagai teknologi, seperti IoT, teknologi tanpa server, teknologi spasial 3D, dan ML/AI, serta rasa ingin tahu yang tiada henti tentang bagaimana teknologi dapat terus mengembangkan pendekatan sehari-hari.

Patrick O'Connor adalah Insinyur Prototyping WWSO yang berbasis di London. Dia adalah pemecah masalah yang kreatif, dapat beradaptasi di berbagai teknologi, seperti IoT, teknologi tanpa server, teknologi spasial 3D, dan ML/AI, serta rasa ingin tahu yang tiada henti tentang bagaimana teknologi dapat terus mengembangkan pendekatan sehari-hari.

Cakra Nagarajan adalah SA Prototipe Pembelajaran Mesin Utama dengan pengalaman 21 tahun dalam pembelajaran mesin, data besar, dan komputasi kinerja tinggi. Dalam perannya saat ini, dia membantu pelanggan memecahkan masalah bisnis yang kompleks di dunia nyata dengan membuat prototipe dengan solusi AI/ML end-to-end di perangkat cloud dan edge. Spesialisasi ML-nya mencakup visi komputer, pemrosesan bahasa alami, perkiraan deret waktu, dan personalisasi.

Cakra Nagarajan adalah SA Prototipe Pembelajaran Mesin Utama dengan pengalaman 21 tahun dalam pembelajaran mesin, data besar, dan komputasi kinerja tinggi. Dalam perannya saat ini, dia membantu pelanggan memecahkan masalah bisnis yang kompleks di dunia nyata dengan membuat prototipe dengan solusi AI/ML end-to-end di perangkat cloud dan edge. Spesialisasi ML-nya mencakup visi komputer, pemrosesan bahasa alami, perkiraan deret waktu, dan personalisasi.

Val Cohen adalah Insinyur Prototyping WWSO senior yang berbasis di London. Sebagai seorang pemecah masalah, Val senang menulis kode untuk mengotomatiskan proses, membuat alat yang terobsesi dengan pelanggan, dan membuat infrastruktur untuk berbagai aplikasi untuk basis pelanggan globalnya. Val memiliki pengalaman di berbagai macam teknologi, seperti pengembangan web front-end, pekerjaan backend, dan AI/ML.

Val Cohen adalah Insinyur Prototyping WWSO senior yang berbasis di London. Sebagai seorang pemecah masalah, Val senang menulis kode untuk mengotomatiskan proses, membuat alat yang terobsesi dengan pelanggan, dan membuat infrastruktur untuk berbagai aplikasi untuk basis pelanggan globalnya. Val memiliki pengalaman di berbagai macam teknologi, seperti pengembangan web front-end, pekerjaan backend, dan AI/ML.

Niall Robinson adalah Head of product futures di UK Met Office. Dia dan timnya mencari cara baru agar Met Office dapat memberikan nilai melalui inovasi produk dan kemitraan strategis. Dia memiliki karir yang bervariasi, memimpin tim R&D informatika multidisiplin, penelitian akademik dalam ilmu data, dan ilmuwan lapangan bersama dengan keahlian pemodel iklim.

Niall Robinson adalah Head of product futures di UK Met Office. Dia dan timnya mencari cara baru agar Met Office dapat memberikan nilai melalui inovasi produk dan kemitraan strategis. Dia memiliki karir yang bervariasi, memimpin tim R&D informatika multidisiplin, penelitian akademik dalam ilmu data, dan ilmuwan lapangan bersama dengan keahlian pemodel iklim.

- Konten Bertenaga SEO & Distribusi PR. Dapatkan Amplifikasi Hari Ini.

- PlatoAiStream. Kecerdasan Data Web3. Pengetahuan Diperkuat. Akses Di Sini.

- Mencetak Masa Depan bersama Adryenn Ashley. Akses Di Sini.

- Beli dan Jual Saham di Perusahaan PRE-IPO dengan PREIPO®. Akses Di Sini.

- Sumber: https://aws.amazon.com/blogs/big-data/build-efficient-cross-regional-i-o-intensive-workloads-with-dask-on-aws/

- :memiliki

- :adalah

- :Di mana

- $NAIK

- 1

- 10

- 100

- 11

- 12

- 20

- 24

- 3d

- 40

- 50

- 7

- 9

- a

- kemampuan

- Sanggup

- Tentang Kami

- atas

- ABSTRAK

- abstrak

- akademik

- penelitian akademik

- mempercepat

- mempercepat

- mengakses

- diakses

- menampung

- menyelesaikan

- Akun

- Mencapai

- di seluruh

- beradaptasi

- menambahkan

- menambahkan

- Tambahan

- Selain itu

- alamat

- menangani

- Menambahkan

- administrator

- diadopsi

- Adopsi

- Setelah

- AI / ML

- UDARA

- Semua

- Membiarkan

- memungkinkan

- sepanjang

- juga

- Amazon

- Amazon EC2

- an

- analisis

- dan

- Apa pun

- muncul

- Aplikasi

- aplikasi

- pendekatan

- pendekatan

- sesuai

- arsitektur

- ADALAH

- AS

- At

- Suasana

- atmosfer

- mengotomatisasikan

- menghindari

- AWS

- Pelanggan AWS

- Tulang punggung

- bersandaran

- Backend

- latar belakang

- Saldo

- mendasarkan

- berdasarkan

- BE

- menjadi

- menjadi

- sebelum

- makhluk

- di bawah

- patokan

- Lebih baik

- antara

- Besar

- Big data

- Bootstrap

- kedua

- Membawa

- Rusak

- membangun

- Bangunan

- dibangun di

- built-in

- bisnis

- tapi

- by

- menghitung

- panggilan

- bernama

- panggilan

- Panggilan

- CAN

- kemampuan

- mampu

- Lowongan Kerja

- katalog

- CD

- Sel

- menantang

- menantang

- perubahan

- mengubah

- biaya

- beban

- pilihan

- Sirkulasi

- klien

- Iklim

- lebih dekat

- awan

- Kelompok

- CO

- kode

- basis kode

- kolaborasi

- Mengumpulkan

- bagaimana

- datang

- kedatangan

- komentar

- masyarakat

- Perusahaan

- lengkap

- kompleks

- komponen

- Terdiri dari

- komputasi

- menghitung

- komputer

- Visi Komputer

- komputasi

- konfigurasi

- Terhubung

- terhubung

- Menghubungkan

- koneksi

- Konsumen

- konsumsi

- Wadah

- mengandung

- terus

- terus

- salinan

- Core

- benar

- Biaya

- hemat biaya

- bisa

- ditambah

- CPU

- membuat

- menciptakan

- Kreatif

- kritis

- tanaman

- Cross

- rasa ingin tahu

- terbaru

- adat

- pelanggan

- pelanggan

- disesuaikan

- menyesuaikan

- harian

- dasbor

- data

- ilmu data

- strategi data

- kumpulan data

- hari

- dasawarsa

- keputusan

- Default

- Permintaan

- menunjukkan

- menyebarkan

- dikerahkan

- penyebaran

- menyebarkan

- dirancang

- menghancurkan

- terperinci

- rincian

- Menentukan

- mengembangkan

- Pengembang

- Pengembangan

- Devices

- perbedaan

- cacat

- penemuan

- Display

- didistribusikan

- komputasi terdistribusi

- dns

- Buruh pelabuhan

- domain

- turun

- dinamis

- dinamis

- setiap

- memudahkan

- mudah

- Tepi

- mengedit

- efisien

- di tempat lain

- aktif

- ujung ke ujung

- energi

- interaksi

- insinyur

- masuk

- Lingkungan Hidup

- Setara

- Era

- diperkirakan

- Eter (ETH)

- Setiap

- setiap hari

- sehari-hari

- berkembang

- contoh

- contoh

- pengalaman

- eksperimen

- keahlian

- menyelidiki

- ekspor

- terkena

- perpanjangan

- lebih cepat

- Fitur

- Fitur

- bidang

- Fields

- File

- File

- Menemukan

- Pertama

- berfokus

- mengikuti

- berikut

- makanan

- Untuk

- bentuk

- format

- bentuk

- ditemukan

- Didirikan di

- Kerangka

- kerangka

- Gratis

- dari

- membuahkan hasil

- penuh

- fungsi

- lebih lanjut

- masa depan

- Futures

- Umum

- generasi

- mendapatkan

- mendapatkan

- pergi

- Aksi

- jaringan global

- Secara global

- bumi

- akan

- grafik

- lebih besar

- kisi

- Tumbuh

- Pertumbuhan

- memiliki

- Setengah

- dibelah dua

- Memiliki

- he

- kepala

- membantu

- membantu

- dia

- High

- kinerja tinggi

- highlight

- -nya

- historis

- tuan rumah

- host

- jam

- Seterpercayaapakah Olymp Trade? Kesimpulan

- How To

- Namun

- HTML

- HTTPS

- bisa dibaca manusia

- Ratusan

- Siaga

- id

- if

- menggambarkan

- mengimpor

- pengimporan

- memperbaiki

- perbaikan

- in

- memasukkan

- termasuk

- Pada meningkat

- indeks

- menunjukkan

- memberitahu

- informasi

- Infrastruktur

- inheren

- Innovation

- memasukkan

- ketidakamanan

- wawasan

- terinspirasi

- install

- contoh

- sebagai gantinya

- instruksi

- integrasi

- Disengaja

- berinteraksi

- berinteraksi

- Antarmuka

- intern

- Internet

- ke

- mengundang

- idiot

- IP

- Alamat IP

- masalah

- IT

- NYA

- Pekerjaan

- perjalanan

- jpg

- Notebook Jupyter

- Menjaga

- kunci

- Tahu

- bahasa

- besar

- Terakhir

- Latensi

- jalankan

- terkemuka

- BELAJAR

- pengetahuan

- Perpustakaan

- siklus hidup

- 'like'

- menghubungkan

- Daftar

- memuat

- lokal

- lokal

- terletak

- tempat

- London

- mesin

- Mesin belajar

- utama

- membuat

- mengelola

- manajer

- mengelola

- peta

- pemetaan

- Massa

- Adopsi Massal

- bahan

- Mungkin..

- berarti

- mekanisme

- Metadata

- jutaan

- ML

- model

- modern

- Modul

- Bulan

- bulanan

- data bulanan

- lebih

- paling

- MOUNT

- multidisiplin

- nama

- nasional

- Alam

- Bahasa Alami

- Pengolahan Bahasa alami

- Alam

- perlu

- Perlu

- membutuhkan

- jaringan

- New

- berikutnya

- malam

- simpul

- node

- buku catatan

- laptop

- sekarang

- jumlah

- nomor

- of

- menawarkan

- Office

- on

- ONE

- hanya

- Buka

- Data terbuka

- open source

- kode sumber terbuka

- operasional

- pilihan

- Opsi

- or

- teknik mengatur musik

- organisasi

- Lainnya

- kami

- di luar

- hasil

- keluaran

- lebih

- secara keseluruhan

- paket

- parameter

- bagian

- tertentu

- khususnya

- kemitraan

- Lulus

- Lewat

- pola

- prestasi

- periode

- Personalisasi

- petabyte.dll

- tahap

- rencana

- Platform

- plato

- Kecerdasan Data Plato

- Data Plato

- Titik

- kolam

- port

- mungkin

- Pos

- potensi

- kekuasaan

- kuat

- praktek

- ramalan

- Prediksi

- prasyarat

- sebelumnya

- primer

- Utama

- swasta

- Masalah

- masalah

- proses

- proses

- pengolahan

- Diproduksi

- Produk

- Inovasi Produk

- produktif

- program

- Pemrograman

- proyek

- prototipe

- prototyping

- memberikan

- disediakan

- menyediakan

- ketentuan

- publik

- menerbitkan

- diterbitkan

- Menarik

- query

- Pertanyaan

- R & D

- jarak

- agak

- sudah jadi

- dunia nyata

- menyadari

- menurunkan

- mengurangi

- pengurangan

- wilayah

- daerah

- daerah

- tanpa henti

- sisa

- menghapus

- Dihapus

- gudang

- merupakan

- penelitian

- Sumber

- itu

- Hasil

- Peran

- Run

- berjalan

- SA

- aman

- pembuat bijak

- sama

- Save

- terukur

- Skala

- sisik

- skala

- Ilmu

- ilmuwan

- ilmuwan

- script

- detik

- Bagian

- melihat

- terlihat

- segmen

- terpilih

- seleksi

- senior

- Seri

- Tanpa Server

- melayani

- layanan

- Layanan

- set

- Share

- berbagi

- harus

- Menunjukkan

- menampilkan

- Pertunjukkan

- Sederhana

- hanya

- keenam

- lambat

- So

- larutan

- Solusi

- MEMECAHKAN

- beberapa

- sumber

- spasial

- Secara khusus

- spesifikasi

- ditentukan

- sokongan

- tumpukan

- magang

- standalone

- awal

- mulai

- tinggal

- Tangga

- penyimpanan

- menyimpan

- tersimpan

- toko

- mudah

- Strategis

- Kemitraan strategis

- Penyelarasan

- selanjutnya

- Kemudian

- sukses

- seperti itu

- Permukaan

- gelora

- Keberlanjutan

- berkelanjutan

- sistem

- sistem

- tabel

- Mengambil

- tim

- tech

- Teknologi

- Teknologi

- uji

- dari

- bahwa

- Grafik

- informasi

- Sumber

- Inggris

- Dunia

- mereka

- kemudian

- Sana.

- dengan demikian

- Ini

- mereka

- ini

- itu

- tiga

- Berkembang

- Melalui

- keluaran

- waktu

- Seri waktu

- kali

- judul

- untuk

- hari ini

- bersama

- alat

- jalur

- Pelacakan

- transfer

- mengubah

- transit

- memicu

- MENGHIDUPKAN

- dua

- mengetik

- Naskah

- khas

- Uk

- bawah

- membuka kunci

- tidak berkelanjutan

- mutakhir

- Pembaruan

- atas

- URI

- penggunaan

- menggunakan

- bekas

- Pengguna

- Pengguna

- menggunakan

- UTC

- Memanfaatkan

- VAL

- nilai

- variasi

- berbagai

- melalui

- penglihatan

- Mengunjungi

- volume

- ingin

- ingin

- hangat

- adalah

- Cara..

- cara

- we

- Cuaca

- jaringan

- pengembangan web

- adalah

- apakah

- yang

- lebar

- Rentang luas

- akan

- keinginan

- dengan

- tanpa

- Kerja

- pekerja

- pekerja

- dunia

- kuatir

- akan

- penulisan

- tahun

- namun

- Menghasilkan

- kamu

- Anda

- zephyrnet.dll