Kita hidup di era data dan wawasan real-time, yang didorong oleh aplikasi streaming data berlatensi rendah. Saat ini, semua orang mengharapkan pengalaman yang dipersonalisasi dalam aplikasi apa pun, dan organisasi terus berinovasi untuk meningkatkan kecepatan operasional bisnis dan pengambilan keputusan. Volume data sensitif terhadap waktu yang dihasilkan meningkat pesat, dengan berbagai format data yang diperkenalkan di bisnis baru dan kasus penggunaan pelanggan. Oleh karena itu, sangat penting bagi organisasi untuk menggunakan infrastruktur streaming data dengan latensi rendah, skalabel, dan andal untuk menghadirkan aplikasi bisnis real-time dan pengalaman pelanggan yang lebih baik.

Ini adalah postingan pertama dalam seri blog yang menawarkan pola arsitektur umum dalam membangun infrastruktur streaming data real-time menggunakan Kinesis Data Streams untuk berbagai kasus penggunaan. Hal ini bertujuan untuk menyediakan kerangka kerja untuk membuat aplikasi streaming latensi rendah di AWS Cloud menggunakan Aliran Data Amazon Kinesis dan Layanan analisis data AWS yang dibuat khusus.

Dalam postingan ini, kami akan meninjau pola arsitektur umum dari dua kasus penggunaan: Analisis Data Rangkaian Waktu dan Layanan Mikro Berbasis Peristiwa. Pada posting berikutnya dalam seri kami, kami akan mengeksplorasi pola arsitektur dalam membangun saluran streaming untuk dasbor BI real-time, agen pusat kontak, data buku besar, rekomendasi real-time yang dipersonalisasi, analisis log, data IoT, Pengambilan Data Perubahan, dan data nyata. -data pemasaran waktu. Semua pola arsitektur ini terintegrasi dengan Amazon Kinesis Data Streams.

Streaming waktu nyata dengan Kinesis Data Streams

Amazon Kinesis Data Streams adalah layanan data streaming tanpa server cloud-native yang memudahkan pengambilan, pemrosesan, dan penyimpanan data real-time pada skala apa pun. Dengan Kinesis Data Streams, Anda dapat mengumpulkan dan memproses ratusan gigabyte data per detik dari ratusan ribu sumber, sehingga Anda dapat dengan mudah menulis aplikasi yang memproses informasi secara real-time. Data yang dikumpulkan tersedia dalam hitungan milidetik untuk memungkinkan kasus penggunaan analitik waktu nyata, seperti dasbor waktu nyata, deteksi anomali waktu nyata, dan penetapan harga dinamis. Secara default, data dalam Kinesis Data Stream disimpan selama 24 jam dengan opsi untuk meningkatkan retensi data hingga 365 hari. Jika pelanggan ingin memproses data yang sama secara real-time dengan beberapa aplikasi, maka dapat menggunakan fitur Enhanced Fan-Out (EFO). Sebelum fitur ini, setiap aplikasi yang menggunakan data dari aliran berbagi keluaran 2MB/detik/shard. Dengan mengonfigurasi konsumen aliran untuk menggunakan fan-out yang ditingkatkan, setiap konsumen data menerima pipa throughput baca khusus sebesar 2MB/detik per shard untuk lebih mengurangi latensi dalam pengambilan data.

Untuk ketersediaan dan daya tahan tinggi, Kinesis Data Streams mencapai daya tahan tinggi dengan mereplikasi data yang dialirkan secara sinkron di tiga Availability Zone di Wilayah AWS dan memberi Anda opsi untuk menyimpan data hingga 365 hari. Demi keamanan, Kinesis Data Streams menyediakan enkripsi sisi server sehingga Anda dapat memenuhi persyaratan manajemen data yang ketat dengan mengenkripsi data saat istirahat dan titik akhir antarmuka Amazon Virtual Private Cloud (VPC) untuk menjaga lalu lintas antara Amazon VPC dan Kinesis Data Streams tetap pribadi.

Kinesis Data Streams memiliki integrasi asli dengan layanan AWS lainnya seperti Lem AWS dan Jembatan Acara Amazon untuk membangun aplikasi streaming waktu nyata di AWS. Lihat integrasi Amazon Kinesis Data Streams untuk detail tambahan.

Arsitektur streaming data modern dengan Kinesis Data Streams

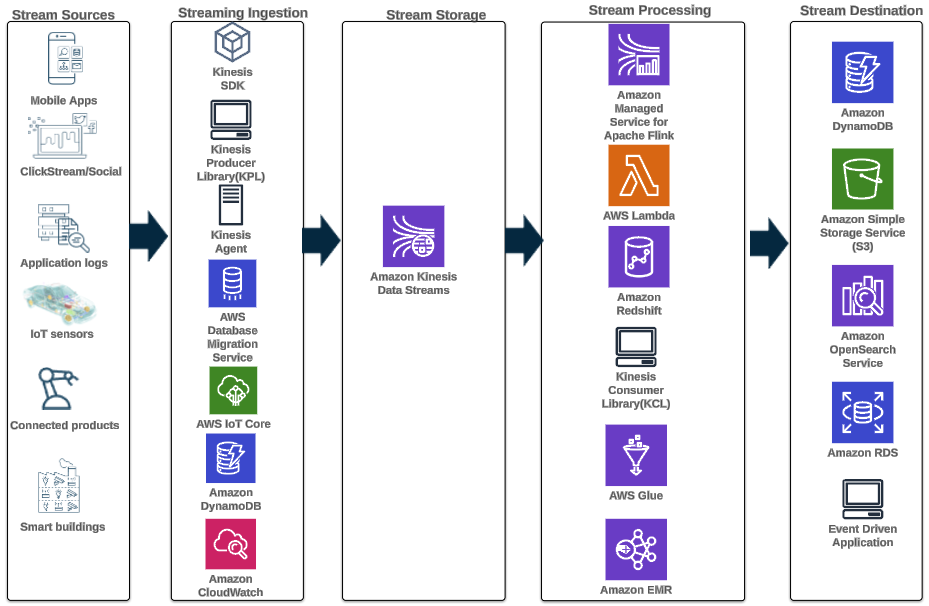

Arsitektur data streaming modern dengan Kinesis Data Streams dapat dirancang sebagai tumpukan lima lapisan logis; setiap lapisan terdiri dari beberapa komponen yang dibuat khusus untuk memenuhi kebutuhan spesifik, seperti yang diilustrasikan dalam diagram berikut:

Arsitekturnya terdiri dari komponen-komponen utama berikut:

- Sumber streaming – Sumber data streaming Anda mencakup sumber data seperti data clickstream, sensor, media sosial, perangkat Internet of Things (IoT), file log yang dihasilkan dengan menggunakan aplikasi web dan seluler Anda, dan perangkat seluler yang menghasilkan data semi-terstruktur dan tidak terstruktur sebagai aliran berkelanjutan dengan kecepatan tinggi.

- Aliran penyerapan – Lapisan penyerapan aliran bertanggung jawab untuk memasukkan data ke dalam lapisan penyimpanan aliran. Ini memberikan kemampuan untuk mengumpulkan data dari puluhan ribu sumber data dan menyerapnya secara real time. Anda dapat menggunakan SDK Kinesis untuk menyerap data streaming melalui API, itu Perpustakaan Produser Kinesis untuk membangun produser streaming yang berkinerja tinggi dan bertahan lama, atau a Agen Kinesis untuk mengumpulkan sekumpulan file dan memasukkannya ke dalam Kinesis Data Streams. Selain itu, Anda dapat menggunakan banyak integrasi pra-bangun seperti Layanan Migrasi Basis Data AWS (AWS DMS), Amazon DynamoDB, dan Inti AWS IoT untuk menyerap data tanpa kode. Anda juga dapat menyerap data dari platform pihak ketiga seperti Apache Spark dan Apache Kafka Connect

- Penyimpanan streaming – Kinesis Data Streams menawarkan dua mode untuk mendukung throughput data: Sesuai Permintaan dan Disediakan. Mode Sesuai Permintaan, yang kini menjadi pilihan default, dapat diskalakan secara elastis untuk menyerap throughput yang bervariasi, sehingga pelanggan tidak perlu khawatir tentang manajemen kapasitas dan membayar berdasarkan throughput data. Mode Sesuai Permintaan secara otomatis meningkatkan 2x kapasitas streaming melebihi penyerapan data maksimum historisnya untuk menyediakan kapasitas yang cukup untuk lonjakan penyerapan data yang tidak terduga. Sebagai alternatif, pelanggan yang menginginkan kontrol terperinci atas sumber daya aliran dapat menggunakan mode Disediakan dan secara proaktif meningkatkan dan menurunkan jumlah Shard untuk memenuhi persyaratan throughput mereka. Selain itu, Kinesis Data Streams dapat menyimpan data streaming hingga 24 jam secara default, namun dapat diperpanjang hingga 7 hari atau 365 hari bergantung pada kasus penggunaan. Beberapa aplikasi dapat menggunakan aliran yang sama.

- Pemrosesan aliran – Lapisan pemrosesan aliran bertanggung jawab untuk mengubah data menjadi status habis pakai melalui validasi data, pembersihan, normalisasi, transformasi, dan pengayaan. Catatan streaming dibaca sesuai urutan produksinya, memungkinkan analisis waktu nyata, membangun aplikasi berbasis peristiwa, atau streaming ETL (ekstrak, transformasi, dan muat). Anda dapat gunakan Layanan Terkelola Amazon untuk Apache Flink untuk pemrosesan data aliran yang kompleks, AWS Lambda untuk pemrosesan data aliran tanpa kewarganegaraan, dan Lem AWS & Amazon ESDM untuk komputasi hampir real-time. Anda juga dapat membangun aplikasi konsumen yang disesuaikan dengan Perpustakaan Konsumen Kinesis, yang akan menangani banyak tugas kompleks yang terkait dengan komputasi terdistribusi.

- Tujuan - Lapisan tujuan seperti tujuan yang dibuat khusus, bergantung pada kasus penggunaan Anda. Anda dapat melakukan streaming data langsung ke Pergeseran Merah Amazon untuk gudang data dan Amazon EventBridge untuk membangun aplikasi berbasis peristiwa. Anda juga bisa menggunakan Firehose Data Amazon Kinesis untuk integrasi streaming di mana Anda dapat melakukan pemrosesan streaming ringan dengan AWS Lambda, lalu mengirimkan streaming yang diproses ke tujuan seperti Amazon S3 data lake, Layanan OpenSearch untuk analisis operasional, gudang data Redshift, database No-SQL seperti Amazon DynamoDB, dan database relasional seperti Amazon RDS untuk menggunakan aliran real-time ke dalam aplikasi bisnis. Tujuannya dapat berupa aplikasi berbasis peristiwa untuk dasbor waktu nyata, keputusan otomatis berdasarkan data streaming yang diproses, perubahan waktu nyata, dan banyak lagi.

Arsitektur analitik waktu nyata untuk deret waktu

Data deret waktu adalah urutan titik data yang direkam selama interval waktu untuk mengukur peristiwa yang berubah seiring waktu. Contohnya adalah harga saham dari waktu ke waktu, aliran klik laman web, dan log perangkat dari waktu ke waktu. Pelanggan dapat menggunakan data deret waktu untuk memantau perubahan dari waktu ke waktu, sehingga mereka dapat mendeteksi anomali, mengidentifikasi pola, dan menganalisis bagaimana variabel tertentu dipengaruhi dari waktu ke waktu. Data deret waktu biasanya dihasilkan dari berbagai sumber dalam jumlah besar, dan perlu dikumpulkan secara hemat biaya dalam waktu hampir real-time.

Biasanya, ada tiga tujuan utama yang ingin dicapai pelanggan dalam memproses data deret waktu:

- Dapatkan wawasan secara real-time tentang kinerja sistem dan deteksi anomali

- Pahami perilaku pengguna akhir untuk melacak tren dan membuat kueri/membuat visualisasi dari wawasan ini

- Miliki solusi penyimpanan yang tahan lama untuk menyerap dan menyimpan data arsip dan data yang sering diakses.

Dengan Kinesis Data Streams, pelanggan dapat terus menangkap data deret waktu berukuran terabyte dari ribuan sumber untuk pembersihan, pengayaan, penyimpanan, analisis, dan visualisasi.

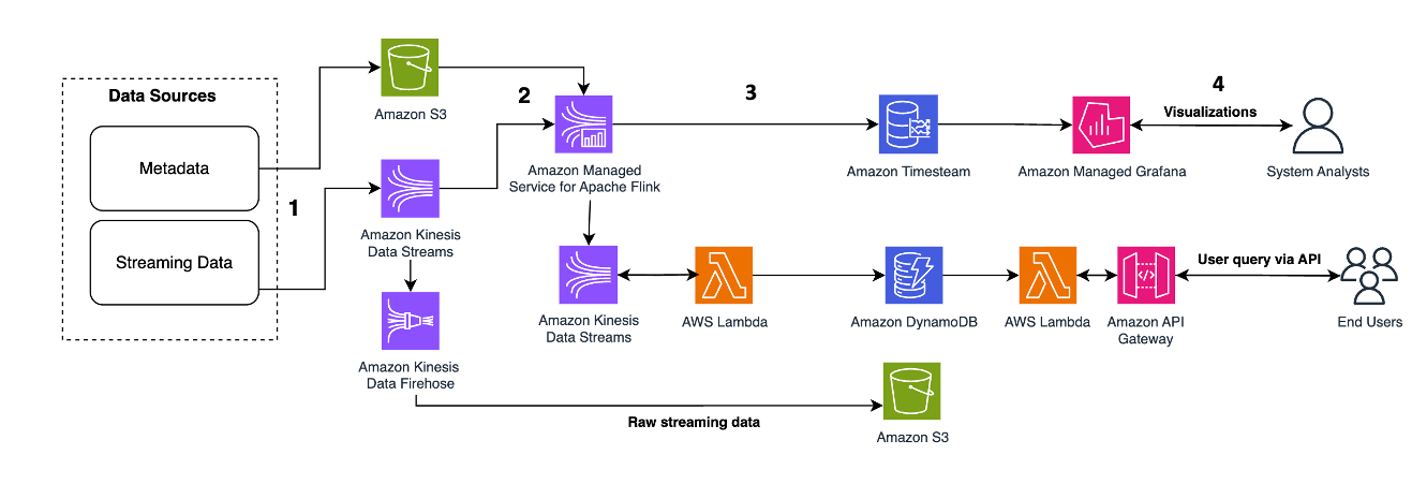

Pola arsitektur berikut mengilustrasikan bagaimana analitik waktu nyata dapat dicapai untuk data Time Series dengan Kinesis Data Streams:

Langkah-langkah alur kerjanya adalah sebagai berikut:

- Penyerapan & Penyimpanan Data – Kinesis Data Streams dapat terus menangkap dan menyimpan data berukuran terabyte dari ribuan sumber.

- Pemrosesan Aliran – Aplikasi yang dibuat dengan Layanan Terkelola Amazon untuk Apache Flink dapat membaca catatan dari aliran data untuk mendeteksi dan membersihkan kesalahan apa pun dalam data deret waktu dan memperkaya data dengan metadata spesifik untuk mengoptimalkan analisis operasional. Menggunakan aliran data di tengah memberikan keuntungan menggunakan data deret waktu dalam proses dan solusi lain pada waktu yang bersamaan. Fungsi Lambda kemudian dipanggil dengan kejadian ini, dan dapat melakukan penghitungan deret waktu di memori.

- Tujuan – Setelah pembersihan dan pengayaan, data deret waktu yang diproses dapat dialirkan Aliran Waktu Amazon database untuk dasbor dan analisis waktu nyata, atau disimpan dalam database seperti DynamoDB untuk kueri pengguna akhir. Data mentah dapat dialirkan ke Amazon S3 untuk pengarsipan.

- Visualisasi & Dapatkan wawasan – Pelanggan dapat menanyakan, memvisualisasikan, dan membuat peringatan menggunakan Layanan Terkelola Amazon untuk Grafana. Grafana mendukung sumber data yang merupakan backend penyimpanan untuk data deret waktu. Untuk mengakses data Anda dari Timestream, Anda perlu menginstal plugin Timestream untuk Grafana. Pengguna akhir dapat menanyakan data dari tabel DynamoDB dengan Gerbang API Amazon bertindak sebagai proksi.

Lihat Pemrosesan Hampir Real-Time dengan Amazon Kinesis, Amazon Timestream, dan Grafana menampilkan pipeline streaming tanpa server untuk memproses dan menyimpan data IoT telemetri perangkat ke dalam penyimpanan data yang dioptimalkan deret waktu seperti Amazon Timestream.

Memperkaya & memutar ulang data secara real-time untuk layanan mikro sumber peristiwa

Layanan mikro adalah pendekatan arsitektur dan organisasi untuk pengembangan perangkat lunak di mana perangkat lunak terdiri dari layanan independen kecil yang berkomunikasi melalui API yang terdefinisi dengan baik. Saat membangun layanan mikro berbasis peristiwa, pelanggan ingin mencapai 1. skalabilitas tinggi untuk menangani volume peristiwa yang masuk dan 2. keandalan pemrosesan peristiwa dan mempertahankan fungsionalitas sistem dalam menghadapi kegagalan.

Pelanggan memanfaatkan pola arsitektur layanan mikro untuk mempercepat inovasi dan waktu pemasaran fitur-fitur baru, karena hal ini membuat aplikasi lebih mudah untuk diukur dan dikembangkan lebih cepat. Namun, memperkaya dan memutar ulang data dalam panggilan jaringan ke layanan mikro lain merupakan tantangan karena dapat memengaruhi keandalan aplikasi dan mempersulit proses debug dan pelacakan kesalahan. Untuk mengatasi masalah ini, sumber peristiwa adalah pola desain efektif yang memusatkan catatan sejarah semua perubahan status untuk pengayaan dan pemutaran ulang, serta memisahkan beban kerja baca dan tulis. Pelanggan dapat menggunakan Kinesis Data Streams sebagai penyimpanan peristiwa terpusat untuk layanan mikro sumber peristiwa, karena KDS dapat menangani 1/ gigabyte throughput data per detik per aliran dan mengalirkan data dalam hitungan milidetik, untuk memenuhi persyaratan skalabilitas tinggi dan hampir real-time latensi, 2/ berintegrasi dengan Flink dan S3 untuk pengayaan dan pencapaian data sambil sepenuhnya dipisahkan dari layanan mikro, dan 3/ memungkinkan percobaan ulang dan pembacaan asinkron di lain waktu, karena KDS menyimpan catatan data untuk default 24 jam, dan secara opsional hingga 365 hari.

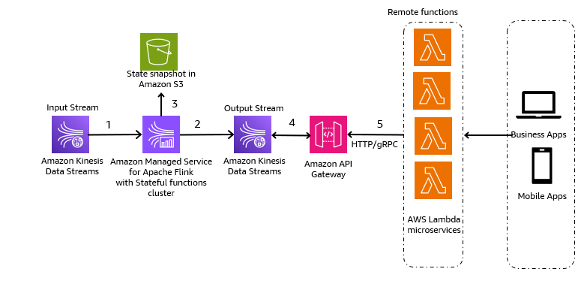

Pola arsitektur berikut adalah ilustrasi umum tentang bagaimana Kinesis Data Streams dapat digunakan untuk Layanan Mikro Sumber Peristiwa:

Langkah-langkah dalam alur kerja adalah sebagai berikut:

- Penyerapan dan Penyimpanan Data – Anda dapat menggabungkan input dari layanan mikro ke Kinesis Data Streams untuk penyimpanan.

- Pemrosesan arus - Fungsi Stateful Apache Flink menyederhanakan pembuatan aplikasi berbasis peristiwa stateful yang terdistribusi. Ia dapat menerima peristiwa dari aliran data masukan Kinesis dan merutekan aliran yang dihasilkan ke aliran data keluaran. Anda dapat membuat kluster fungsi stateful dengan Apache Flink berdasarkan logika bisnis aplikasi Anda.

- Nyatakan snapshot di Amazon S3 – Anda dapat menyimpan snapshot status di Amazon S3 untuk pelacakan.

- Aliran keluaran – Aliran keluaran dapat digunakan melalui fungsi jarak jauh Lambda melalui protokol HTTP/gRPC melalui API Gateway.

- Fungsi jarak jauh Lambda – Fungsi Lambda dapat bertindak sebagai layanan mikro untuk berbagai aplikasi dan logika bisnis untuk melayani aplikasi bisnis dan aplikasi seluler.

Untuk mempelajari cara pelanggan lain membangun layanan mikro berbasis peristiwa dengan Kinesis Data Streams, lihat hal berikut:

Pertimbangan utama dan praktik terbaik

Berikut ini adalah pertimbangan dan praktik terbaik yang perlu diingat:

- Penemuan data harus menjadi langkah pertama Anda dalam membangun aplikasi streaming data modern. Anda harus menentukan nilai bisnis dan kemudian mengidentifikasi sumber data streaming dan persona pengguna untuk mencapai hasil bisnis yang diinginkan.

- Pilih alat penyerapan data streaming Anda berdasarkan sumber data steaming Anda. Misalnya, Anda dapat menggunakan SDK Kinesis untuk menyerap data streaming melalui API, itu Perpustakaan Produser Kinesis untuk membangun produser streaming berkinerja tinggi dan bertahan lama, a Agen Kinesis untuk mengumpulkan sekumpulan file dan memasukkannya ke dalam Kinesis Data Streams, DMS AWS untuk kasus penggunaan streaming CDC, dan Inti AWS IoT untuk memasukkan data perangkat IoT ke Kinesis Data Streams. Anda dapat menyerap data streaming langsung ke Amazon Redshift untuk membangun aplikasi streaming berlatensi rendah. Anda juga dapat menggunakan perpustakaan pihak ketiga seperti Apache Spark dan Apache Kafka untuk menyerap data streaming ke Kinesis Data Streams.

- Anda harus memilih layanan pemrosesan data streaming berdasarkan kasus penggunaan spesifik dan kebutuhan bisnis Anda. Misalnya, Anda dapat menggunakan Amazon Kinesis Managed Service for Apache Flink untuk kasus penggunaan streaming tingkat lanjut dengan beberapa tujuan streaming dan pemrosesan aliran stateful yang kompleks atau jika Anda ingin memantau metrik bisnis secara real-time (seperti setiap jam). Lambda cocok untuk pemrosesan berbasis peristiwa dan tanpa kewarganegaraan. Anda dapat gunakan Amazon ESDM untuk streaming pemrosesan data menggunakan kerangka data besar sumber terbuka favorit Anda. AWS Glue cocok untuk pemrosesan data streaming hampir real-time untuk kasus penggunaan seperti streaming ETL.

- Mode on-demand Kinesis Data Streams dikenakan biaya berdasarkan penggunaan dan secara otomatis meningkatkan kapasitas sumber daya, sehingga cocok untuk beban kerja streaming yang sulit dan pemeliharaan hands-free. Mode yang disediakan dikenakan biaya berdasarkan kapasitas dan memerlukan manajemen kapasitas proaktif, sehingga cocok untuk beban kerja streaming yang dapat diprediksi.

- Anda dapat menggunakan Kalkulator Bersama Kinesis untuk menghitung jumlah pecahan yang diperlukan untuk mode yang disediakan. Anda tidak perlu khawatir tentang pecahan dengan mode sesuai permintaan.

- Saat memberikan izin, Anda memutuskan siapa yang mendapatkan izin apa pada sumber daya Kinesis Data Streams mana. Anda mengaktifkan tindakan spesifik yang ingin Anda izinkan pada sumber daya tersebut. Oleh karena itu, Anda sebaiknya hanya memberikan izin yang diperlukan untuk melakukan suatu tugas. Anda juga dapat mengenkripsi data saat istirahat dengan menggunakan kunci yang dikelola pelanggan (CMK) KMS.

- Anda dapat memperbarui periode retensi melalui konsol Kinesis Data Streams atau dengan menggunakan Tingkatkan Periode Retensi Aliran dan Penurunan Periode Retensi Aliran operasi berdasarkan kasus penggunaan spesifik Anda.

- Kinesis Data Streams mendukung pembuatan ulang. API yang direkomendasikan untuk fungsi ini adalah PerbaruiShardCount, yang memungkinkan Anda mengubah jumlah pecahan di aliran Anda untuk beradaptasi dengan perubahan laju aliran data melalui aliran. API resharding (Pisahkan dan Gabungkan) biasanya digunakan untuk menangani pecahan panas.

Kesimpulan

Postingan ini menunjukkan berbagai pola arsitektur untuk membangun aplikasi streaming latensi rendah dengan Kinesis Data Streams. Anda dapat membangun aplikasi steaming latensi rendah Anda sendiri dengan Kinesis Data Streams menggunakan informasi dalam postingan ini.

Untuk pola arsitektur terperinci, lihat sumber daya berikut:

Jika Anda ingin membangun visi dan strategi data, lihat Semuanya Berbasis Data AWS (D2E).

Tentang Penulis

Raghavarao Sodabathina adalah Arsitek Solusi Utama di AWS, dengan fokus pada Analisis Data, AI/ML, dan keamanan cloud. Dia terlibat dengan pelanggan untuk menciptakan solusi inovatif yang mengatasi masalah bisnis pelanggan dan mempercepat penerapan layanan AWS. Di waktu luangnya, Raghavarao senang menghabiskan waktu bersama keluarganya, membaca buku, dan menonton film.

Raghavarao Sodabathina adalah Arsitek Solusi Utama di AWS, dengan fokus pada Analisis Data, AI/ML, dan keamanan cloud. Dia terlibat dengan pelanggan untuk menciptakan solusi inovatif yang mengatasi masalah bisnis pelanggan dan mempercepat penerapan layanan AWS. Di waktu luangnya, Raghavarao senang menghabiskan waktu bersama keluarganya, membaca buku, dan menonton film.

Tunggu Zuo adalah Manajer Produk Senior di tim Amazon Kinesis Data Streams di Amazon Web Services. Dia bersemangat mengembangkan pengalaman produk intuitif yang memecahkan masalah pelanggan yang kompleks dan memungkinkan pelanggan mencapai tujuan bisnis mereka.

Tunggu Zuo adalah Manajer Produk Senior di tim Amazon Kinesis Data Streams di Amazon Web Services. Dia bersemangat mengembangkan pengalaman produk intuitif yang memecahkan masalah pelanggan yang kompleks dan memungkinkan pelanggan mencapai tujuan bisnis mereka.

Shwetha Radhakrishnan adalah Arsitek Solusi untuk AWS dengan fokus pada Analisis Data. Dia telah membangun solusi yang mendorong adopsi cloud dan membantu organisasi mengambil keputusan berdasarkan data di sektor publik. Di luar pekerjaan, dia suka menari, menghabiskan waktu bersama teman dan keluarga, dan jalan-jalan.

Shwetha Radhakrishnan adalah Arsitek Solusi untuk AWS dengan fokus pada Analisis Data. Dia telah membangun solusi yang mendorong adopsi cloud dan membantu organisasi mengambil keputusan berdasarkan data di sektor publik. Di luar pekerjaan, dia suka menari, menghabiskan waktu bersama teman dan keluarga, dan jalan-jalan.

Brittany Ly adalah Arsitek Solusi di AWS. Dia fokus membantu pelanggan perusahaan dalam perjalanan adopsi dan modernisasi cloud, serta memiliki minat pada bidang keamanan dan analitik. Di luar pekerjaan, dia suka menghabiskan waktu bersama anjingnya dan bermain acar.

Brittany Ly adalah Arsitek Solusi di AWS. Dia fokus membantu pelanggan perusahaan dalam perjalanan adopsi dan modernisasi cloud, serta memiliki minat pada bidang keamanan dan analitik. Di luar pekerjaan, dia suka menghabiskan waktu bersama anjingnya dan bermain acar.

- Konten Bertenaga SEO & Distribusi PR. Dapatkan Amplifikasi Hari Ini.

- PlatoData.Jaringan Vertikal Generatif Ai. Berdayakan Diri Anda. Akses Di Sini.

- PlatoAiStream. Intelijen Web3. Pengetahuan Diperkuat. Akses Di Sini.

- PlatoESG. Karbon, teknologi bersih, energi, Lingkungan Hidup, Tenaga surya, Penanganan limbah. Akses Di Sini.

- PlatoHealth. Kecerdasan Uji Coba Biotek dan Klinis. Akses Di Sini.

- Sumber: https://aws.amazon.com/blogs/big-data/architectural-patterns-for-real-time-analytics-using-amazon-kinesis-data-streams-part-1/

- :memiliki

- :adalah

- :bukan

- :Di mana

- $NAIK

- 1

- 100

- 24

- 7

- a

- kemampuan

- Tentang Kami

- mempercepat

- mengakses

- diakses

- Mencapai

- dicapai

- Mencapai

- mencapai

- di seluruh

- Bertindak

- akting

- tindakan

- menyesuaikan

- tambahan

- Tambahan

- Selain itu

- alamat

- Adopsi

- maju

- Keuntungan

- Setelah

- usia

- Agen

- agregat

- AI / ML

- bertujuan

- alert

- Semua

- mengizinkan

- Membiarkan

- memungkinkan

- juga

- Amazon

- Amazon Kinesis

- Aliran Waktu Amazon

- Amazon Web Services

- an

- analisis

- analisis

- menganalisa

- dan

- deteksi anomali

- Lain

- Apa pun

- Apache

- Apache Kafka

- Apache Spark

- api

- Lebah

- Aplikasi

- aplikasi

- pendekatan

- aplikasi

- arsitektur

- arsitektur

- ADALAH

- AS

- terkait

- At

- secara otomatis

- secara otomatis

- tersedianya

- tersedia

- AWS

- Lem AWS

- AWS Lambda

- berdasarkan

- BE

- karena

- menjadi

- laku

- makhluk

- TERBAIK

- Praktik Terbaik

- Lebih baik

- antara

- Besar

- Big data

- Blog

- Buku-buku

- kedua

- membangun

- Bangunan

- dibangun di

- bisnis

- Aplikasi Bisnis

- bisnis

- tapi

- by

- menghitung

- panggilan

- CAN

- Kapasitas

- menangkap

- yang

- kasus

- kasus

- CDC

- pusat

- terpusat

- tertentu

- menantang

- perubahan

- Perubahan

- beban

- memeriksa

- pilihan

- Pilih

- membersihkan

- Pembersihan

- awan

- adopsi cloud

- Cloud Security

- Kelompok

- mengumpulkan

- Mengumpulkan

- Umum

- menyampaikan

- sama sekali

- kompleks

- komponen

- tersusun

- menghitung

- komputasi

- prihatin

- mengkonfigurasi

- pertimbangan

- terdiri

- konsul

- terus-menerus

- memakan

- dikonsumsi

- konsumen

- Konsumen

- kontak

- contact center

- kontinu

- terus menerus

- kontrol

- membuat

- dibuat

- kritis

- pelanggan

- pelanggan

- disesuaikan

- Tarian

- dasbor

- data

- analisis data

- Data Analytics

- pengayaan data

- Danau Data

- manajemen data

- titik data

- pengolahan data

- data warehouse

- Data-driven

- Basis Data

- database

- Hari

- memutuskan

- keputusan

- Pengambilan Keputusan

- keputusan

- dipisahkan

- dedicated

- Default

- menetapkan

- menyampaikan

- menunjukkan

- Tergantung

- Mendesain

- dirancang

- diinginkan

- tujuan

- tujuan

- terperinci

- rincian

- menemukan

- Deteksi

- mengembangkan

- berkembang

- Pengembangan

- alat

- Devices

- berbeda

- sulit

- langsung

- penemuan

- didistribusikan

- komputasi terdistribusi

- do

- Anjing

- Dont

- turun

- mendorong

- didorong

- daya tahan

- dinamis

- setiap

- mudah

- mudah

- Mudah

- Efektif

- merangkul

- aktif

- enkripsi

- endpoint

- terlibat

- ditingkatkan

- memperkaya

- Enterprise

- pelanggan perusahaan

- kesalahan

- Eter (ETH)

- Acara

- peristiwa

- Setiap

- semua orang

- contoh

- contoh

- mengharapkan

- pengalaman

- Pengalaman

- menyelidiki

- memperpanjang

- ekstrak

- Menghadapi

- kegagalan

- keluarga

- Fashion

- lebih cepat

- Favorit

- Fitur

- Fitur

- bidang

- File

- Pertama

- lima

- aliran

- Fokus

- terfokus

- berfokus

- berikut

- berikut

- Untuk

- Kerangka

- kerangka

- sering

- teman

- dari

- fungsi

- fungsi

- fungsi

- lebih lanjut

- Mendapatkan

- pintu gerbang

- menghasilkan

- dihasilkan

- mendapatkan

- GitHub

- memberikan

- Anda

- baik

- memberikan

- pemberian

- menangani

- Menggantung

- he

- membantu

- membantu

- dia

- High

- kinerja tinggi

- -nya

- bersejarah

- PANAS

- jam

- JAM

- Seterpercayaapakah Olymp Trade? Kesimpulan

- Namun

- HTML

- http

- HTTPS

- Ratusan

- mengenali

- if

- menggambarkan

- Dampak

- in

- Di lain

- termasuk

- masuk

- Meningkatkan

- meningkatkan

- independen

- terpengaruh

- informasi

- Infrastruktur

- infrastruktur

- berinovasi

- Innovation

- inovatif

- memasukkan

- wawasan

- install

- mengintegrasikan

- terpadu

- integrasi

- integrasi

- bunga

- Antarmuka

- Internet

- internet hal-hal

- ke

- diperkenalkan

- intuitif

- dipanggil

- idiot

- Perangkat IOT

- IT

- NYA

- perjalanan

- jpg

- kafka

- Menjaga

- kunci

- Aliran Data Kinesis

- danau

- Latensi

- kemudian

- lapisan

- lapisan

- BELAJAR

- Buku besar

- perpustakaan

- Perpustakaan

- cahaya

- 'like'

- hidup

- memuat

- mencatat

- logika

- logis

- mencintai

- memelihara

- pemeliharaan

- membuat

- MEMBUAT

- Membuat

- berhasil

- pengelolaan

- manajer

- banyak

- Marketing

- maksimum

- ukur

- Media

- Pelajari

- Memori

- Bergabung

- Metadata

- Metrik

- microservices

- Tengah

- migrasi

- milidetik

- keberatan

- mobil

- Aplikasi Seluler

- telepon genggam

- ponsel-apps

- mode

- modern

- modernisasi

- mode

- memodifikasi

- Memantau

- lebih

- bioskop

- beberapa

- harus

- asli

- Dekat

- Perlu

- dibutuhkan

- kebutuhan

- jaringan

- New

- Fitur Baru

- sekarang

- jumlah

- of

- menawarkan

- Penawaran

- on

- Sesuai Permintaan

- hanya

- Buka

- open source

- operasi

- operasional

- Operasi

- Optimize

- dioptimalkan

- pilihan

- or

- urutan

- organisatoris

- organisasi

- Lainnya

- kami

- di luar

- hasil

- keluaran

- di luar

- lebih

- sendiri

- bagian

- bergairah

- pola

- pola

- Membayar

- untuk

- melakukan

- prestasi

- Izin

- Personalized

- pipa

- pipa saluran

- Platform

- plato

- Kecerdasan Data Plato

- Data Plato

- Bermain

- Plugin

- poin

- Pos

- praktek

- Bisa ditebak

- harga

- di harga

- primer

- Utama

- Sebelumnya

- swasta

- Proaktif

- Masalah

- masalah

- proses

- diproses

- proses

- pengolahan

- Diproduksi

- produsen

- Produsen

- Produk

- manajer produk

- program

- protokol

- memberikan

- menyediakan

- wakil

- publik

- jarak

- cepat

- Penilaian

- Mentah

- data mentah

- Baca

- Bacaan

- nyata

- real-time

- data waktu nyata

- menerima

- menerima

- Rekomendasi

- direkomendasikan

- catatan

- tercatat

- arsip

- menurunkan

- lihat

- wilayah

- keandalan

- dapat diandalkan

- terpencil

- wajib

- kebutuhan

- Persyaratan

- membutuhkan

- sumber

- Sumber

- tanggung jawab

- ISTIRAHAT

- dihasilkan

- menahan

- mempertahankan

- penyimpanan

- ulasan

- Rute

- sama

- Skalabilitas

- terukur

- Skala

- sisik

- Kedua

- sektor

- keamanan

- senior

- sensor

- Urutan

- Seri

- melayani

- Tanpa Server

- layanan

- Layanan

- set

- berbagi

- dia

- harus

- menampilkan

- disederhanakan

- kecil

- Potret

- So

- Sosial

- media sosial

- Perangkat lunak

- pengembangan perangkat lunak

- larutan

- Solusi

- MEMECAHKAN

- sumber

- sumber

- percikan

- tertentu

- kecepatan

- menghabiskan

- Pengeluaran

- sepatu berduri

- membagi

- tumpukan

- Negara

- Langkah

- Tangga

- saham

- penyimpanan

- menyimpan

- tersimpan

- Penyelarasan

- aliran

- streaming

- Streaming

- stream

- ketat

- selanjutnya

- seperti itu

- cukup

- mendukung

- Mendukung

- sistem

- tabel

- Mengambil

- tugas

- tugas

- tim

- memiliki

- bahwa

- Grafik

- informasi

- Negara

- mereka

- Mereka

- kemudian

- Sana.

- karena itu

- Ini

- mereka

- hal

- pihak ketiga

- ini

- itu

- ribuan

- tiga

- Melalui

- keluaran

- waktu

- Seri waktu

- peka waktu

- untuk

- hari ini

- alat

- jejak

- jalur

- Pelacakan

- lalu lintas

- Mengubah

- Transformasi

- mengubah

- Perjalanan

- Tren

- dua

- khas

- Tiba-tiba

- atas

- penggunaan

- menggunakan

- gunakan case

- bekas

- Pengguna

- menggunakan

- Penggunaan

- pengesahan

- nilai

- variabel

- berbagai

- Kecepatan

- melalui

- maya

- penglihatan

- visualisasi

- membayangkan

- volume

- volume

- ingin

- Gudang

- Pergudangan

- menonton

- we

- jaringan

- layanan web

- terdefinisi dengan baik

- Apa

- ketika

- yang

- sementara

- SIAPA

- lebar

- Rentang luas

- akan

- dengan

- dalam

- Kerja

- alur kerja

- kuatir

- menulis

- kamu

- Anda

- zephyrnet.dll

- zona