Startup cybersecurity pertama Josh Lospinoso diakuisisi pada tahun 2017 oleh Raytheon/Forcepoint. Yang kedua, Shift5, bekerja dengan militer AS, operator kereta api, dan maskapai penerbangan termasuk JetBlue. Lulusan West Point 2009 dan Rhodes Scholar, mantan kapten Angkatan Darat berusia 36 tahun itu menghabiskan lebih dari satu dekade membuat alat peretasan untuk Badan Keamanan Nasional dan Komando Siber AS.

Lospinoso baru-baru ini memberi tahu subkomite Angkatan Bersenjata Senat bagaimana kecerdasan buatan dapat membantu melindungi operasi militer. CEO/pemrogram mendiskusikan masalah ini dengan The Associated Press serta bagaimana kerentanan perangkat lunak dalam sistem persenjataan merupakan ancaman besar bagi militer AS. Wawancara telah diedit untuk kejelasan dan panjangnya.

T: Dalam kesaksian Anda, Anda menjelaskan dua ancaman utama terhadap teknologi yang mendukung AI: Salah satunya adalah pencurian. Itu cukup jelas. Yang lainnya adalah keracunan data. Bisakah Anda menjelaskannya?

J: Salah satu cara berpikir tentang keracunan data adalah sebagai disinformasi digital. Jika musuh dapat menyusun data yang dilihat oleh teknologi yang mendukung AI, mereka dapat sangat memengaruhi cara kerja teknologi tersebut.

T: Apakah terjadi keracunan data?

J: Kami tidak melihatnya secara luas. Tetapi itu telah terjadi. Salah satu kasus paling terkenal terjadi pada tahun 2016. Microsoft merilis chatbot Twitter bernama Tay yang belajar dari percakapan online. Pengguna jahat berkonspirasi untuk men-tweet bahasa yang kasar dan menyinggung. Tay mulai menghasilkan konten yang menghasut. Microsoft menjadikannya offline.

T: AI bukan sekadar chatbot. Itu sudah lama menjadi bagian integral dari keamanan siber, bukan?

J: AI digunakan dalam filter email untuk mencoba menandai dan memisahkan email sampah dan umpan phishing. Contoh lainnya adalah titik akhir, seperti program antivirus di laptop Anda – atau perangkat lunak pendeteksi malware yang berjalan di jaringan. Tentu saja, peretas ofensif juga menggunakan AI untuk mencoba mengalahkan sistem klasifikasi tersebut. Itu disebut AI permusuhan.

T: Mari kita bicara tentang sistem perangkat lunak militer. Tahun 2018 yang mengkhawatirkan Laporan Kantor Akuntabilitas Pemerintah mengatakan hampir semua sistem senjata yang baru dikembangkan memiliki kerentanan kritis misi. Dan Pentagon berpikir untuk memasukkan AI ke dalam sistem seperti itu?

J: Ada dua masalah di sini. Pertama, kita perlu mengamankan sistem senjata yang ada secara memadai. Ini adalah hutang teknis yang kami miliki yang akan memakan waktu sangat lama untuk dibayar. Lalu ada batas baru untuk mengamankan algoritme AI – hal-hal baru yang akan kami instal. Laporan GAO tidak benar-benar berbicara tentang AI. Jadi lupakan AI sejenak. Jika sistem ini tetap seperti apa adanya, mereka masih sangat rentan.

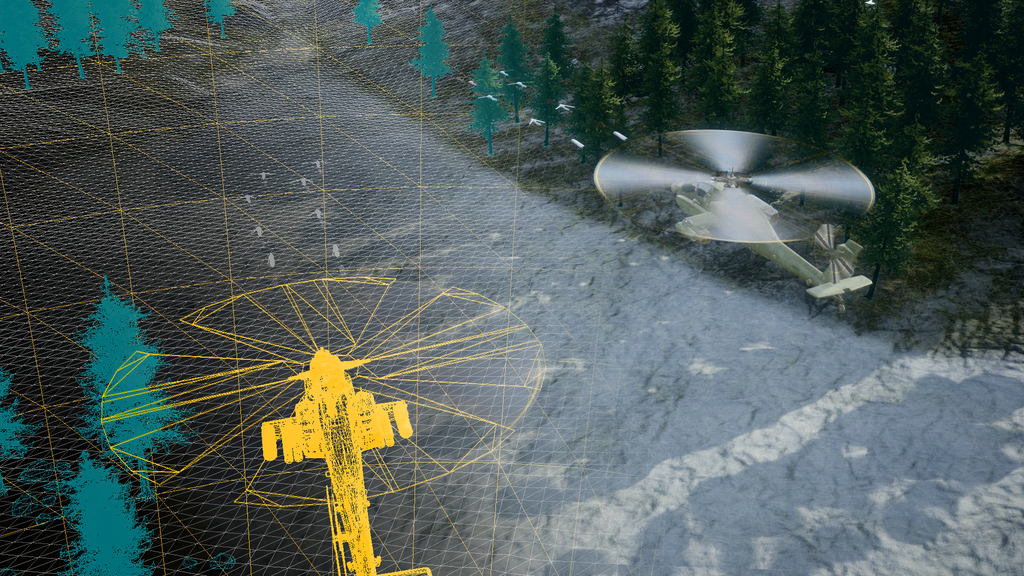

Kami sedang mendiskusikan mendorong amplop dan menambahkan kemampuan yang diaktifkan AI untuk hal-hal seperti peningkatan pemeliharaan dan kecerdasan operasional. Semuanya bagus. Tapi kami sedang membangun di atas rumah kartu. Banyak sistem yang berumur puluhan tahun, dilengkapi dengan teknologi digital. Pesawat terbang, kendaraan darat, aset luar angkasa, kapal selam. Mereka sekarang saling berhubungan. Kami bertukar data masuk dan keluar. Sistemnya keropos, sulit untuk ditingkatkan, dan dapat diserang. Setelah penyerang mendapatkan akses, permainan berakhir.

Terkadang lebih mudah membangun platform baru daripada mendesain ulang komponen digital sistem yang ada. Namun ada peran AI dalam mengamankan sistem ini. AI dapat digunakan untuk bertahan jika seseorang mencoba mengkompromikannya.

T: Anda bersaksi bahwa menghentikan penelitian AI, seperti yang disarankan beberapa orang, akan menjadi ide yang buruk karena akan menguntungkan China dan pesaing lainnya. Tetapi Anda juga memiliki kekhawatiran tentang serbuan cepat ke produk AI. Mengapa?

J: Saya tidak suka terdengar fatalistik, tetapi apa yang disebut kasus "penggunaan pembakaran" sepertinya berlaku. Produk yang dilarikan ke pasar sering kali terbakar (diretas, gagal, menyebabkan kerusakan yang tidak diinginkan). Dan kami berkata, 'Nak, kita seharusnya membangun keamanan.' Saya berharap laju pengembangan AI akan semakin cepat, dan kami mungkin tidak cukup berhenti sejenak untuk melakukan ini dengan cara yang aman dan bertanggung jawab. Setidaknya Gedung Putih dan Kongres sedang mendiskusikan masalah ini.

T: Sepertinya banyak perusahaan – termasuk di sektor pertahanan – terburu-buru mengumumkan produk AI setengah matang.

A: Setiap perusahaan teknologi dan banyak perusahaan non-teknologi telah membuat poros yang hampir menggelegar menuju AI. Dislokasi ekonomi akan datang. Model bisnis pada dasarnya akan berubah. Dislokasi sudah terjadi atau sudah di depan mata - dan para pemimpin bisnis berusaha untuk tidak terjebak.

T: Bagaimana dengan penggunaan AI dalam pengambilan keputusan militer seperti penargetan?

A: Saya tidak, secara kategoris tidak, berpikir bahwa algoritme kecerdasan buatan — data yang kami kumpulkan — siap untuk waktu utama bagi sistem senjata mematikan untuk membuat keputusan. Kami sangat jauh dari itu.

- Konten Bertenaga SEO & Distribusi PR. Dapatkan Amplifikasi Hari Ini.

- PlatoAiStream. Kecerdasan Data Web3. Pengetahuan Diperkuat. Akses Di Sini.

- Mencetak Masa Depan bersama Adryenn Ashley. Akses Di Sini.

- Beli dan Jual Saham di Perusahaan PRE-IPO dengan PREIPO®. Akses Di Sini.

- Sumber: https://www.defensenews.com/artificial-intelligence/2023/05/29/adversarial-ai-a-threat-to-military-systems-shift5s-lospinoso-says/

- :memiliki

- :adalah

- :bukan

- 2016

- 2017

- 2018

- 70

- a

- Sanggup

- Tentang Kami

- mempercepat

- mengakses

- akuntabilitas

- diperoleh

- menambahkan

- cukup

- permusuhan

- badan

- AI

- ai penelitian

- pesawat terbang

- Airlines

- algoritma

- Semua

- sudah

- juga

- an

- dan

- Mengumumkan

- Lain

- antivirus

- Mendaftar

- ADALAH

- bersenjata

- Tentara

- buatan

- kecerdasan buatan

- AS

- Aktiva

- terkait

- At

- Buruk

- BE

- karena

- menjadi

- mulai

- secara luas

- membangun

- Bangunan

- dibangun di

- ikat

- bisnis

- tapi

- by

- bernama

- CAN

- kemampuan

- Kartu-kartu

- kasus

- kasus

- tertangkap

- perubahan

- ChatBot

- chatbots

- Tiongkok

- kejelasan

- klasifikasi

- Mengumpulkan

- kedatangan

- Perusahaan

- perusahaan

- pesaing

- komponen

- kompromi

- Kekhawatiran

- Kongres

- Konten

- percakapan

- bisa

- Tentu saja

- kerajinan

- kritis

- maya

- Keamanan cyber

- data

- Hutang

- dasawarsa

- dekade

- Pengambilan Keputusan

- keputusan

- Pertahanan

- dijelaskan

- Deteksi

- dikembangkan

- Pengembangan

- digital

- dibahas

- mendiskusikan

- disinformasi

- do

- tidak

- mudah

- Ekonomis

- cukup

- Setiap

- contoh

- ada

- mengharapkan

- Menjelaskan

- gagal

- jauh

- mendukung

- filter

- Kebakaran

- Pertama

- Untuk

- Bekas

- dari

- perbatasan

- secara fundamental

- Keuntungan

- permainan

- GAO

- menghasilkan

- mendapatkan

- akan

- besar

- Tanah

- hack

- hacker

- peretasan

- memiliki

- terjadi

- Kejadian

- Sulit

- Memiliki

- tunggang langgang

- membantu

- di sini

- -nya

- horison

- Rumah

- Seterpercayaapakah Olymp Trade? Kesimpulan

- HTTPS

- i

- ide

- if

- gambar

- Dampak

- ditingkatkan

- in

- Termasuk

- install

- integral

- Intelijen

- saling berhubungan

- Wawancara

- ke

- masalah

- IT

- biru jet

- hanya

- bahasa

- laptop

- pemimpin

- belajar

- paling sedikit

- Panjang

- 'like'

- Panjang

- lama

- terbuat

- pemeliharaan

- utama

- Membuat

- malware

- deteksi malware

- banyak

- Pasar

- Microsoft

- mungkin

- Militer

- Misi

- model

- lebih

- Bernama

- nasional

- keamanan nasional

- National Security Agency

- hampir

- Perlu

- jaringan

- New

- Platform Baru

- novel

- sekarang

- terjadi

- of

- serangan

- Office

- Pengunjung

- sering

- Tua

- on

- sekali

- ONE

- secara online

- beroperasi

- operasional

- Operasi

- operator

- or

- Lainnya

- di luar

- lebih

- Perdamaian

- berhenti sebentar

- Membayar

- segi lima

- Phishing

- Poros

- Platform

- plato

- Kecerdasan Data Plato

- Data Plato

- Titik

- pers

- Perdana

- Utama

- Produk

- Produk

- program

- melindungi

- Mendorong

- Puting

- Rel

- siap

- benar-benar

- baru-baru ini

- mendesain ulang

- dirilis

- melaporkan

- penelitian

- tanggung jawab

- benar

- Peran

- buru-buru

- s

- Tersebut

- mengatakan

- mengatakan

- Kedua

- sektor

- aman

- mengamankan

- keamanan

- melihat

- melihat

- tampaknya

- Senat

- Layanan

- harus

- So

- sejauh ini

- Perangkat lunak

- beberapa

- Seseorang

- Suara

- Space

- menghabiskan

- startup

- tinggal

- Masih

- panitia kecil

- subyek

- seperti itu

- swapping

- sistem

- sistem

- Mengambil

- Berbicara

- penargetan

- tech

- Perusahaan Teknologi

- Teknis

- Teknologi

- Teknologi

- bersaksi

- kesaksian

- dari

- bahwa

- Grafik

- pencurian

- Mereka

- kemudian

- Sana.

- Ini

- mereka

- hal

- berpikir

- Pikir

- ini

- itu

- ancaman

- ancaman

- waktu

- untuk

- mengambil

- puncak

- terhadap

- mencoba

- menciak

- dua

- kami

- meningkatkan

- menggunakan

- bekas

- Pengguna

- Kendaraan

- sangat

- Kerentanan

- Rentan

- adalah

- Cara..

- we

- Senjata

- BAIK

- Barat

- Apa

- putih

- Gedung Putih

- mengapa

- dengan

- bekerja

- akan

- kamu

- Anda

- zephyrnet.dll