[लेखक द्वारा छवि]

"सुविधा महत्व" की अवधारणा का व्यापक रूप से मशीन लर्निंग में मॉडल व्याख्या के सबसे बुनियादी प्रकार के रूप में उपयोग किया जाता है। उदाहरण के लिए, इसका उपयोग रिकर्सिव फ़ीचर एलिमिनेशन (आरएफई) में किया जाता है, ताकि मॉडल की सबसे कम महत्वपूर्ण विशेषता को पुनरावृत्त रूप से हटा दिया जा सके।

हालाँकि, इसे लेकर एक ग़लतफ़हमी है।

तथ्य यह है कि एक सुविधा महत्वपूर्ण है इसका मतलब यह नहीं है कि यह मॉडल के लिए फायदेमंद है!

दरअसल, जब हम कहते हैं कि एक सुविधा महत्वपूर्ण है, तो इसका सीधा सा मतलब है कि यह सुविधा मॉडल द्वारा की गई भविष्यवाणियों में एक उच्च योगदान देती है। लेकिन हमें उस पर विचार करना चाहिए ऐसा योगदान गलत हो सकता है.

एक सरल उदाहरण लें: एक डेटा वैज्ञानिक गलती से अपने मॉडल की विशेषताओं के बीच ग्राहक आईडी भूल जाता है। मॉडल ग्राहक आईडी का उपयोग अत्यधिक पूर्वानुमानित सुविधा के रूप में करता है। परिणामस्वरूप, इस सुविधा का उच्च सुविधा महत्व होगा, भले ही यह वास्तव में मॉडल को खराब कर रहा हो, क्योंकि यह अनदेखे डेटा पर अच्छी तरह से काम नहीं कर सकता है।

चीजों को स्पष्ट करने के लिए, हमें दो अवधारणाओं के बीच अंतर करना होगा:

- भविष्यवाणी योगदान: भविष्यवाणियों का कौन सा भाग विशेषता के कारण है; यह फीचर महत्व के बराबर है।

- त्रुटि योगदान: पूर्वानुमान त्रुटियों का कौन सा भाग मॉडल में सुविधा की उपस्थिति के कारण है।

इस लेख में, हम देखेंगे कि इन मात्राओं की गणना कैसे करें और पूर्वानुमानित मॉडल के बारे में मूल्यवान जानकारी प्राप्त करने के लिए (और इसे बेहतर बनाने के लिए) उनका उपयोग कैसे करें।

नोट: यह लेख प्रतिगमन मामले पर केंद्रित है। यदि आप वर्गीकरण मामले में अधिक रुचि रखते हैं, तो आप पढ़ सकते हैं "आपके वर्गीकरण मॉडल के लिए कौन सी सुविधाएँ हानिकारक हैं?"

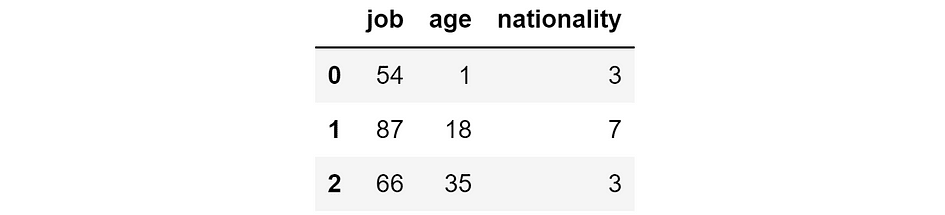

मान लीजिए कि हमने लोगों की नौकरी, उम्र और राष्ट्रीयता के आधार पर उनकी आय का अनुमान लगाने के लिए एक मॉडल बनाया है। अब हम तीन लोगों पर भविष्यवाणियां करने के लिए मॉडल का उपयोग करते हैं।

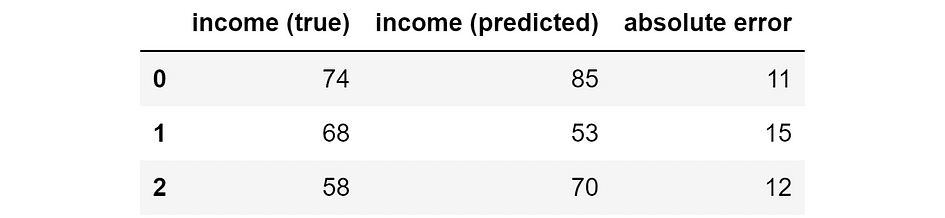

इस प्रकार, हमारे पास जमीनी सच्चाई, मॉडल भविष्यवाणी और परिणामी त्रुटि है:

जमीनी सच्चाई, मॉडल भविष्यवाणी, और पूर्ण त्रुटि (हजारों डॉलर में)। [लेखक द्वारा छवि]

जब हमारे पास एक पूर्वानुमानित मॉडल होता है, तो हम हमेशा मॉडल पूर्वानुमानों को एकल विशेषताओं द्वारा लाए गए योगदान में विघटित कर सकते हैं। यह SHAP मानों के माध्यम से किया जा सकता है (यदि आप नहीं जानते कि SHAP मान कैसे काम करते हैं, तो आप मेरा लेख पढ़ सकते हैं: SHAP मान बिल्कुल उसी तरह समझाए गए जैसे आप चाहते थे कि कोई आपको बताए).

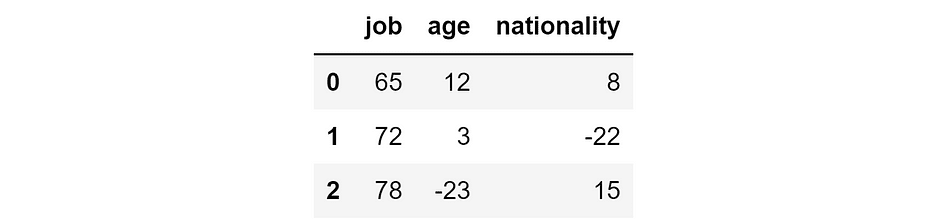

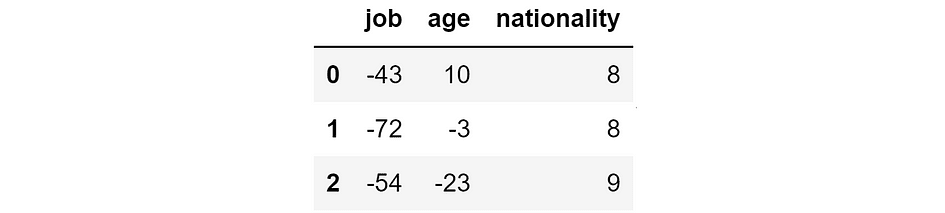

तो, मान लें कि ये तीन व्यक्तियों के लिए हमारे मॉडल के सापेक्ष SHAP मान हैं।

हमारे मॉडल की भविष्यवाणियों के लिए SHAP मान (हजारों डॉलर में)। [लेखक द्वारा छवि]

SHAP मूल्यों की मुख्य संपत्ति यह है कि वे योगात्मक हैं। इसका मतलब यह है कि - प्रत्येक पंक्ति का योग लेकर - हम उस व्यक्ति के लिए अपने मॉडल की भविष्यवाणी प्राप्त करेंगे। उदाहरण के लिए, यदि हम दूसरी पंक्ति लेते हैं: 72k $ +3k $ -22k $ = 53k $, जो बिल्कुल दूसरे व्यक्ति के लिए मॉडल की भविष्यवाणी है।

अब, SHAP मान इस बात का एक अच्छा संकेतक है कि हमारी भविष्यवाणियों के लिए कोई सुविधा कितनी महत्वपूर्ण है। वास्तव में, (पूर्ण) SHAP मान जितना अधिक होगा, उस विशिष्ट व्यक्ति के बारे में भविष्यवाणी के लिए सुविधा उतनी ही अधिक प्रभावशाली होगी। ध्यान दें कि मैं पूर्ण SHAP मानों के बारे में बात कर रहा हूं क्योंकि यहां संकेत कोई मायने नहीं रखता: एक सुविधा भी उतनी ही महत्वपूर्ण है यदि यह भविष्यवाणी को ऊपर या नीचे धकेलती है।

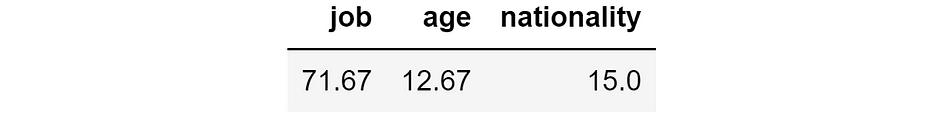

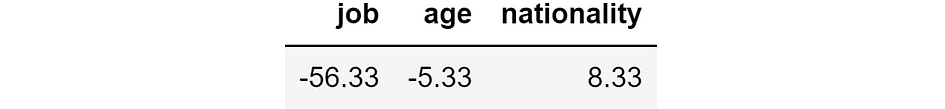

इसलिए, किसी सुविधा का पूर्वानुमान योगदान उस सुविधा के पूर्ण SHAP मानों के माध्य के बराबर है. यदि आपके पास पांडा डेटाफ़्रेम में SHAP मान संग्रहीत हैं, तो यह इतना सरल है:

prediction_contribution = shap_values.abs().mean()हमारे उदाहरण में, यह परिणाम है:

भविष्यवाणी योगदान. [लेखक द्वारा छवि]

जैसा कि आप देख सकते हैं, नौकरी स्पष्ट रूप से सबसे महत्वपूर्ण विशेषता है, क्योंकि औसतन, यह अंतिम भविष्यवाणी का 71.67k$ है। राष्ट्रीयता और उम्र क्रमशः दूसरी और तीसरी सबसे प्रासंगिक विशेषता हैं।

हालाँकि, तथ्य यह है कि दी गई सुविधा अंतिम भविष्यवाणी के प्रासंगिक हिस्से के लिए जिम्मेदार है, सुविधा के प्रदर्शन के बारे में कुछ भी नहीं बताती है। इस पहलू पर भी विचार करने के लिए, हमें "त्रुटि योगदान" की गणना करने की आवश्यकता होगी।

मान लीजिए कि हम निम्नलिखित प्रश्न का उत्तर देना चाहते हैं: "यदि मॉडल में यह सुविधा नहीं होती तो वह क्या पूर्वानुमान लगाता" काम?” SHAP मान हमें इस प्रश्न का उत्तर देने की अनुमति देते हैं। वास्तव में, चूंकि वे योगात्मक हैं, इसलिए यह सुविधा के सापेक्ष SHAP मानों को घटाने के लिए पर्याप्त है काम मॉडल द्वारा की गई भविष्यवाणियों से।

बेशक, हम प्रत्येक सुविधा के लिए इस प्रक्रिया को दोहरा सकते हैं। पंडों में:

y_pred_wo_feature = shap_values.apply(lambda feature: y_pred - feature)यह परिणाम है:

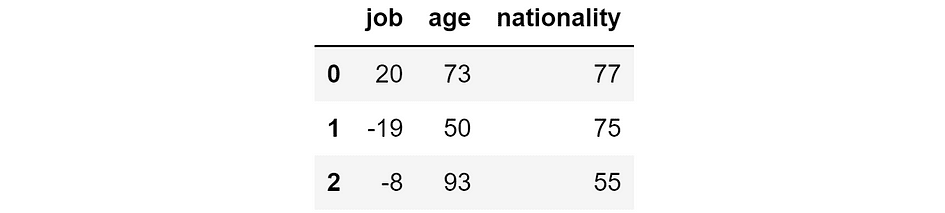

यदि हम संबंधित सुविधा को हटा दें तो हमें जो पूर्वानुमान प्राप्त होंगे। [लेखक द्वारा छवि]

इसका मतलब यह है कि, अगर हमारे पास यह सुविधा नहीं थी काम, तो मॉडल पहले व्यक्ति के लिए 20k$, दूसरे के लिए -19k$ और तीसरे के लिए -8k$ की भविष्यवाणी करेगा। इसके बजाय, यदि हमारे पास सुविधा नहीं थी उम्र, मॉडल पहले व्यक्ति के लिए 73k$, दूसरे के लिए 50k$, इत्यादि की भविष्यवाणी करेगा।

जैसा कि आप देख सकते हैं, यदि हम अलग-अलग सुविधाएँ हटा दें तो प्रत्येक व्यक्ति के लिए पूर्वानुमान बहुत भिन्न होते हैं। परिणामस्वरूप, भविष्यवाणी त्रुटियाँ भी बहुत भिन्न होंगी। हम उनकी गणना आसानी से कर सकते हैं:

abs_error_wo_feature = y_pred_wo_feature.apply(lambda feature: (y_true - feature).abs())परिणाम निम्नलिखित है:

यदि हमने संबंधित सुविधा को हटा दिया तो हमें पूर्ण त्रुटियाँ प्राप्त होंगी। [लेखक द्वारा छवि]

ये वे त्रुटियां हैं जो हमें संबंधित सुविधा को हटाने पर प्राप्त होंगी। सहज रूप से, यदि त्रुटि छोटी है, तो सुविधा को हटाना कोई समस्या नहीं है - या यह मॉडल के लिए फायदेमंद भी है। यदि त्रुटि अधिक है, तो सुविधा को हटाना अच्छा विचार नहीं है।

लेकिन हम इससे भी अधिक कर सकते हैं. वास्तव में, हम पूर्ण मॉडल की त्रुटियों और सुविधा के बिना प्राप्त होने वाली त्रुटियों के बीच अंतर की गणना कर सकते हैं:

error_diff = abs_error_wo_feature.apply(lambda feature: abs_error - feature)जो है:

मॉडल की त्रुटियों और सुविधा के बिना होने वाली त्रुटियों के बीच अंतर। [लेखक द्वारा छवि]

यदि यह संख्या है:

- नकारात्मक, तो सुविधा की उपस्थिति से भविष्यवाणी त्रुटि में कमी आती है, इसलिए सुविधा उस अवलोकन के लिए अच्छी तरह से काम करती है!

- सकारात्मक, तो सुविधा की उपस्थिति से भविष्यवाणी त्रुटि में वृद्धि होती है, इसलिए सुविधा उस अवलोकन के लिए खराब है।

हम प्रत्येक सुविधा के लिए इन मानों के माध्य के रूप में "त्रुटि योगदान" की गणना कर सकते हैं. पंडों में:

error_contribution = error_diff.mean()यह परिणाम है:

त्रुटि योगदान. [लेखक द्वारा छवि]

यदि यह मान सकारात्मक है, तो इसका मतलब है कि, औसतन, मॉडल में सुविधा की उपस्थिति उच्च त्रुटि की ओर ले जाती है। इस प्रकार, उस सुविधा के बिना, भविष्यवाणी आम तौर पर बेहतर होती। दूसरे शब्दों में, यह सुविधा फायदे से ज्यादा नुकसान पहुंचा रही है!

इसके विपरीत, यह मान जितना अधिक नकारात्मक होगा, यह सुविधा भविष्यवाणियों के लिए उतनी ही अधिक फायदेमंद होगी क्योंकि इसकी उपस्थिति से छोटी त्रुटियां होती हैं।

आइए इन अवधारणाओं को वास्तविक डेटासेट पर उपयोग करने का प्रयास करें।

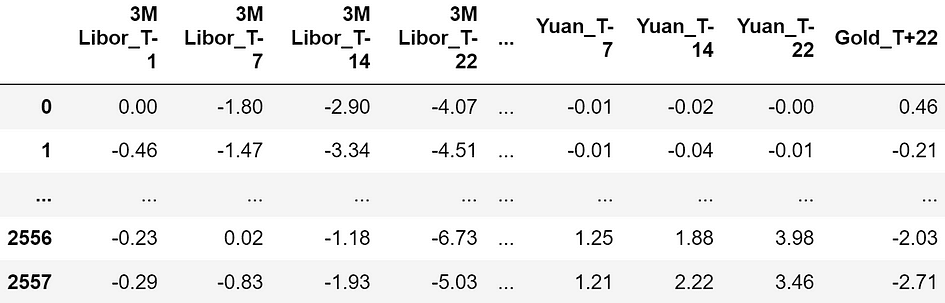

इसके बाद, मैं से लिए गए डेटासेट का उपयोग करूंगा पाइकैरेट (एक पायथन लाइब्रेरी के अंतर्गत एमआईटी लाइसेंस). डेटासेट को "गोल्ड" कहा जाता है और इसमें वित्तीय डेटा की समय श्रृंखला शामिल होती है।

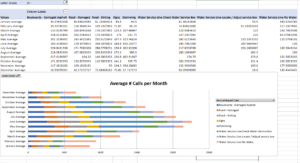

डेटासेट नमूना. सभी विशेषताएं प्रतिशत में व्यक्त की गई हैं, इसलिए -4.07 का मतलब -4.07% का रिटर्न है। [लेखक द्वारा छवि]

सुविधाओं में अवलोकन क्षण ("टी-22", "टी-14", "टी-7", "टी-1") से पहले क्रमशः 22, 14, 7 और 1 दिन पहले वित्तीय परिसंपत्तियों का रिटर्न शामिल है। पूर्वानुमानित सुविधाओं के रूप में उपयोग की जाने वाली सभी वित्तीय परिसंपत्तियों की विस्तृत सूची यहां दी गई है:

उपलब्ध परिसंपत्तियों की सूची. प्रत्येक परिसंपत्ति को समय -22, -14, -7, और -1 पर देखा जाता है। [लेखक द्वारा छवि]

कुल मिलाकर, हमारे पास 120 सुविधाएँ हैं।

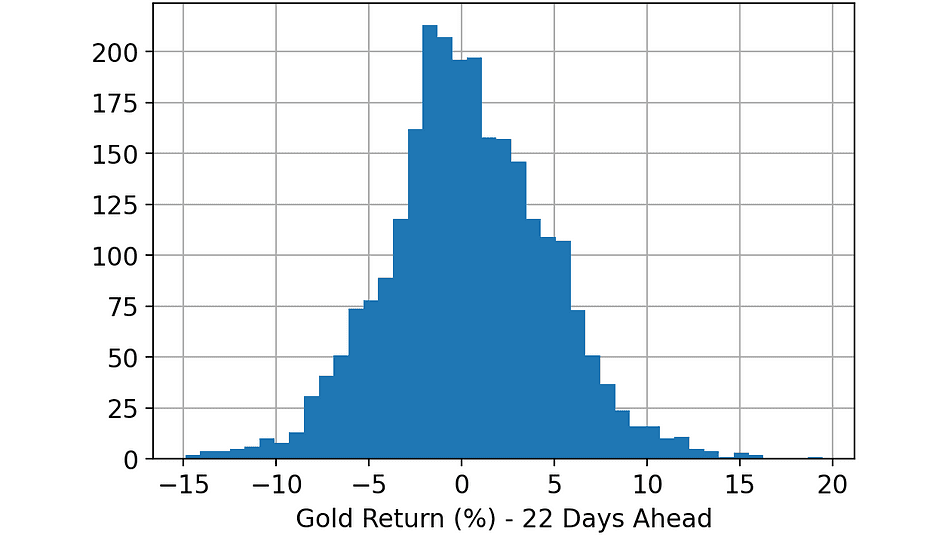

लक्ष्य समय से 22 दिन पहले सोने की कीमत (रिटर्न) की भविष्यवाणी करना है ("गोल्ड_टी+22")। आइए लक्ष्य चर पर एक नज़र डालें।

चर का हिस्टोग्राम. [लेखक द्वारा छवि]

एक बार जब मैंने डेटासेट लोड किया, तो ये वे चरण हैं जो मैंने किए:

- संपूर्ण डेटासेट को यादृच्छिक रूप से विभाजित करें: प्रशिक्षण डेटासेट में 33% पंक्तियाँ, सत्यापन डेटासेट में अन्य 33%, और परीक्षण डेटासेट में शेष 33%।

- प्रशिक्षण डेटासेट पर एक लाइटजीबीएम रेजिस्टर को प्रशिक्षित करें।

- पिछले चरण में प्रशिक्षित मॉडल का उपयोग करके प्रशिक्षण, सत्यापन और परीक्षण डेटासेट पर भविष्यवाणियां करें।

- पायथन लाइब्रेरी "शेप" का उपयोग करके प्रशिक्षण, सत्यापन और परीक्षण डेटासेट के SHAP मानों की गणना करें।

- पिछले पैराग्राफ में देखे गए कोड का उपयोग करके, प्रत्येक डेटासेट (प्रशिक्षण, सत्यापन और परीक्षण) पर प्रत्येक सुविधा के पूर्वानुमान योगदान और त्रुटि योगदान की गणना करें।

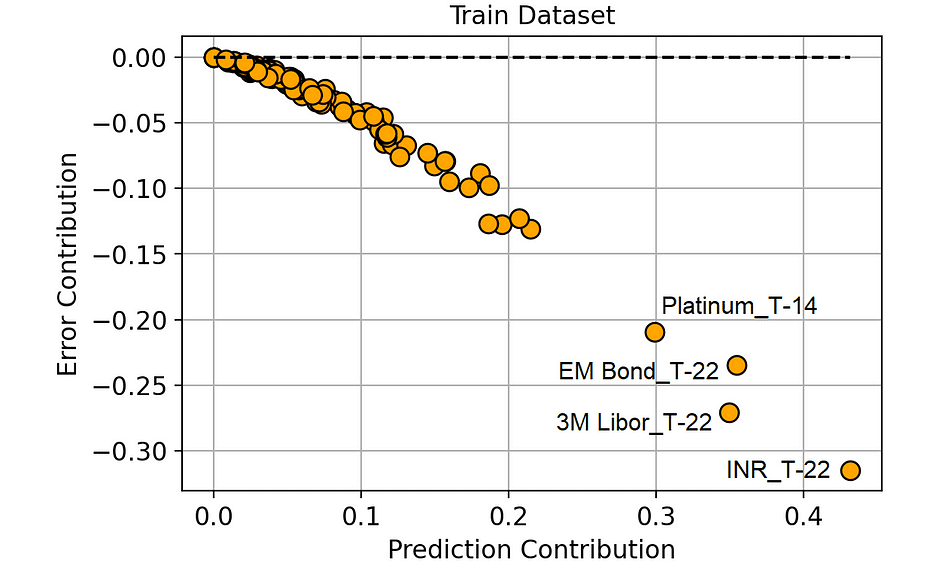

आइए प्रशिक्षण डेटासेट में त्रुटि योगदान और पूर्वानुमान योगदान की तुलना करें। हम एक स्कैटर प्लॉट का उपयोग करेंगे, ताकि बिंदु मॉडल की 120 विशेषताओं की पहचान कर सकें।

पूर्वानुमान योगदान बनाम त्रुटि योगदान (प्रशिक्षण डेटासेट पर)। [लेखक द्वारा छवि]

प्रशिक्षण सेट में पूर्वानुमान योगदान और त्रुटि योगदान के बीच अत्यधिक नकारात्मक सहसंबंध है।

और यह समझ में आता है: चूंकि मॉडल प्रशिक्षण डेटासेट पर सीखता है, इसलिए यह उन विशेषताओं को उच्च महत्व (यानी उच्च भविष्यवाणी योगदान) देता है जिससे भविष्यवाणी त्रुटि (यानी अत्यधिक नकारात्मक त्रुटि योगदान) में बड़ी कमी आती है।.

लेकिन इससे हमारे ज्ञान में कोई खास इज़ाफा नहीं होता, है न?

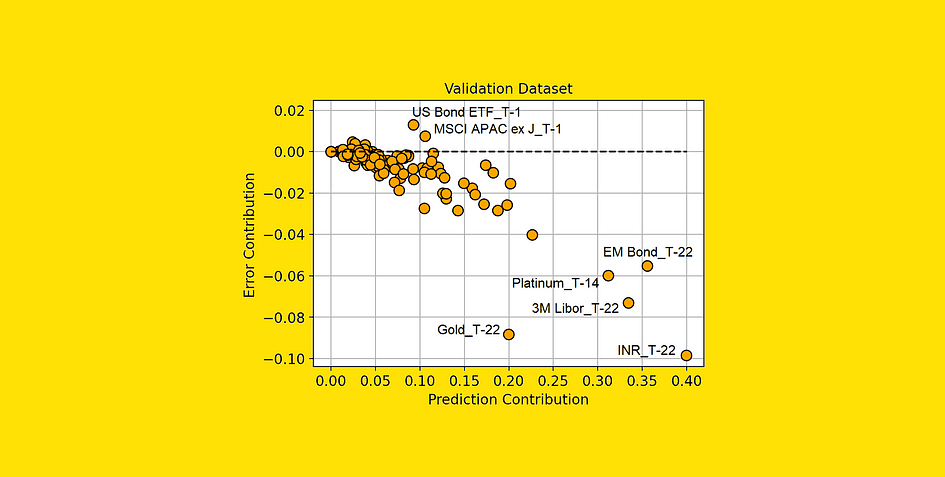

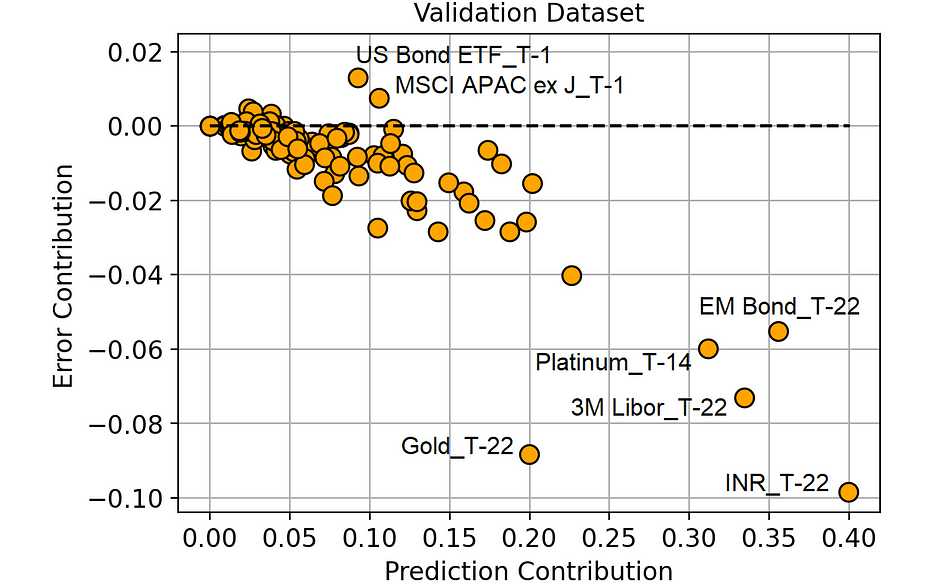

दरअसल, जो चीज हमारे लिए वास्तव में मायने रखती है वह है सत्यापन डेटासेट। सत्यापन डेटासेट वास्तव में सबसे अच्छा प्रॉक्सी है जो हमारे पास हो सकता है कि हमारी विशेषताएं नए डेटा पर कैसे व्यवहार करेंगी। तो, आइए सत्यापन सेट पर वही तुलना करें।

पूर्वानुमान योगदान बनाम त्रुटि योगदान (सत्यापन डेटासेट पर)। [लेखक द्वारा छवि]

इस कथानक से हम कुछ और भी रोचक जानकारी प्राप्त कर सकते हैं।

कथानक के निचले दाएँ भाग में वे विशेषताएँ हैं जिन्हें हमारा मॉडल सही ढंग से उच्च महत्व दे रहा है क्योंकि वे वास्तव में भविष्यवाणी त्रुटि में कमी लाते हैं।

साथ ही, ध्यान दें कि "गोल्ड_टी-22" (अवलोकन अवधि से 22 दिन पहले सोने की वापसी) मॉडल द्वारा बताए जा रहे महत्व की तुलना में वास्तव में अच्छी तरह से काम कर रहा है। इस का मतलब है कि यह सुविधा संभवतः उपयुक्त नहीं है. और यह जानकारी विशेष रूप से दिलचस्प है क्योंकि सोना वह संपत्ति है जिसकी हम भविष्यवाणी करने की कोशिश कर रहे हैं ("गोल्ड_टी+22")।

दूसरी ओर, जिन सुविधाओं में 0 से ऊपर त्रुटि योगदान है, वे हमारी भविष्यवाणियों को बदतर बना रही हैं. उदाहरण के लिए, "यूएस बॉन्ड ETF_T-1" मॉडल की भविष्यवाणी को औसतन 0.092% (भविष्यवाणी योगदान) से बदल देता है, लेकिन यह मॉडल को औसतन 0.013% (त्रुटि योगदान) की भविष्यवाणी करने की ओर ले जाता है, जो उस सुविधा के बिना होता। .

हम ऐसा मान सकते हैं उच्च त्रुटि योगदान वाली सभी सुविधाएँ (उनके पूर्वानुमान योगदान की तुलना में) संभवतः ओवरफिटिंग हैं या, सामान्य तौर पर, प्रशिक्षण सेट और सत्यापन सेट में उनका व्यवहार अलग-अलग होता है।

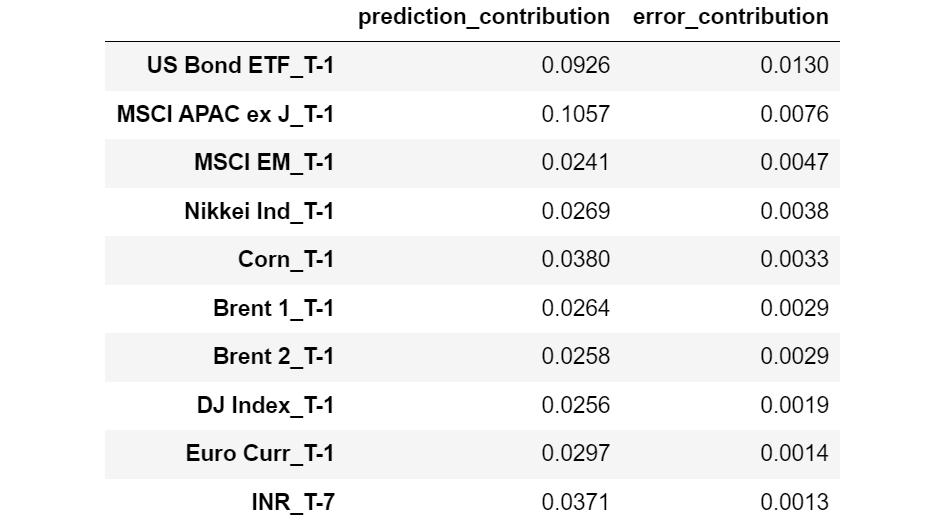

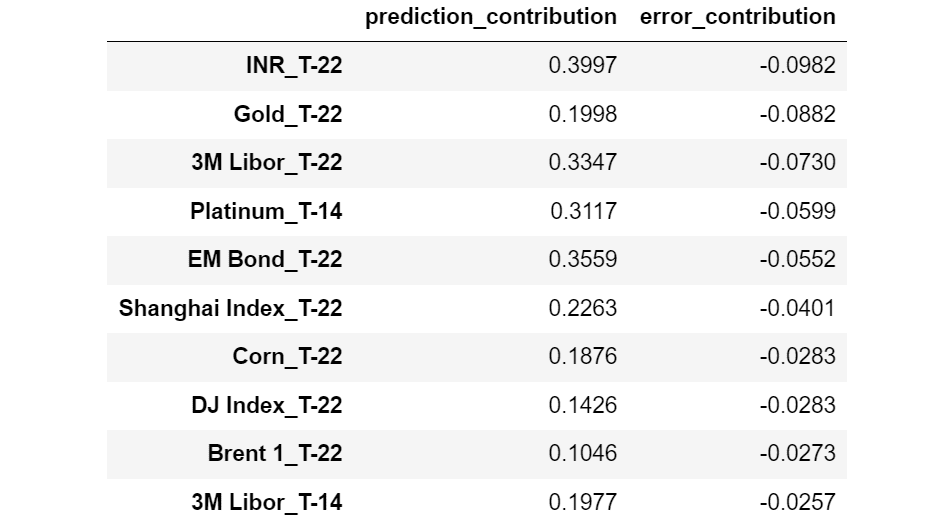

आइए देखें कि किन विशेषताओं में सबसे बड़ा त्रुटि योगदान है।

त्रुटि योगदान को घटाकर सुविधाओं को क्रमबद्ध किया गया। [लेखक द्वारा छवि]

और अब सबसे कम त्रुटि योगदान वाली सुविधाएँ:

त्रुटि योगदान को बढ़ाकर सुविधाओं को क्रमबद्ध किया गया। [लेखक द्वारा छवि]

दिलचस्प बात यह है कि हम देख सकते हैं कि उच्च त्रुटि योगदान वाली सभी सुविधाएँ T-1 (अवलोकन क्षण से 1 दिन पहले) के सापेक्ष हैं, जबकि छोटे त्रुटि योगदान वाली लगभग सभी सुविधाएँ T-22 (अवलोकन क्षण से 22 दिन पहले) के सापेक्ष हैं ).

इससे तो यही संकेत मिलता है सबसे हाल की सुविधाओं में ओवरफिटिंग का खतरा होता है, जबकि समय में अधिक दूर की सुविधाओं का सामान्यीकरण बेहतर होता है.

ध्यान दें कि, त्रुटि योगदान के बिना, हम इस अंतर्दृष्टि को कभी नहीं जान पाते।

पारंपरिक पुनरावर्ती फ़ीचर उन्मूलन (RFE) विधियाँ महत्वहीन सुविधाओं को हटाने पर आधारित हैं। यह पहले एक छोटे पूर्वानुमान योगदान के साथ सुविधाओं को हटाने के बराबर है।

हालाँकि, हमने पिछले पैराग्राफ में जो कहा था, उसके आधार पर, सबसे पहले उच्चतम त्रुटि योगदान वाली सुविधाओं को हटाना अधिक समझदारी होगी।

यह जांचने के लिए कि क्या हमारा अंतर्ज्ञान सत्यापित है, आइए दो दृष्टिकोणों की तुलना करें:

- पारंपरिक RFE: पहले बेकार सुविधाओं को हटाना (न्यूनतम पूर्वानुमान योगदान)।

- हमारा RFE: हानिकारक सुविधाओं को हटाना प्रथम (उच्चतम त्रुटि योगदान)।

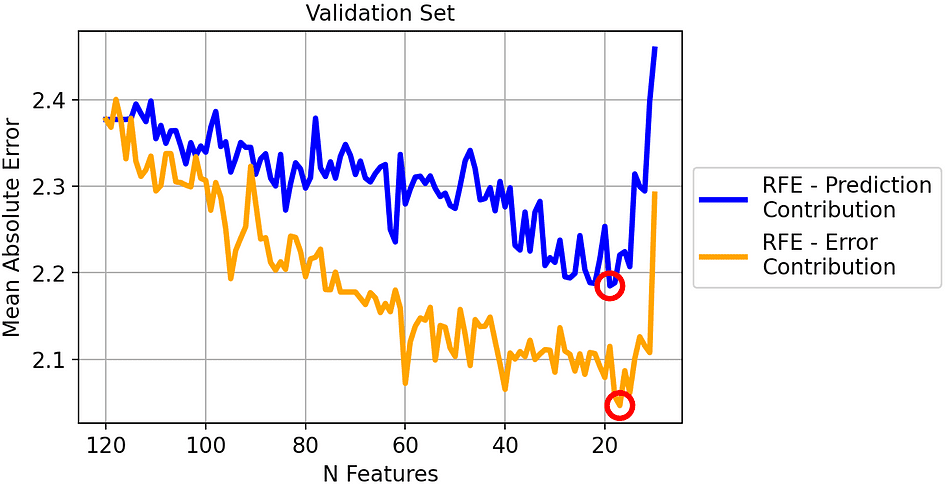

आइए सत्यापन सेट पर परिणाम देखें:

सत्यापन सेट पर दो रणनीतियों की माध्य निरपेक्ष त्रुटि। [लेखक द्वारा छवि]

प्रत्येक विधि के लिए सबसे अच्छा पुनरावृत्ति चक्रित किया गया है: यह पारंपरिक RFE (नीली रेखा) के लिए 19 सुविधाओं वाला मॉडल है और हमारे RFE (नारंगी रेखा) के लिए 17 सुविधाओं वाला मॉडल है।

सामान्य तौर पर, ऐसा लगता है कि हमारी विधि अच्छी तरह से काम करती है: उच्चतम त्रुटि योगदान वाले फीचर को हटाने से उच्चतम पूर्वानुमान योगदान वाले फीचर को हटाने की तुलना में लगातार छोटा एमएई होता है।

हालाँकि, आप सोच सकते हैं कि यह सिर्फ इसलिए अच्छा काम करता है क्योंकि हम सत्यापन सेट को ओवरफिट कर रहे हैं। आख़िरकार, हम उस परिणाम में रुचि रखते हैं जो हम परीक्षण सेट पर प्राप्त करेंगे।

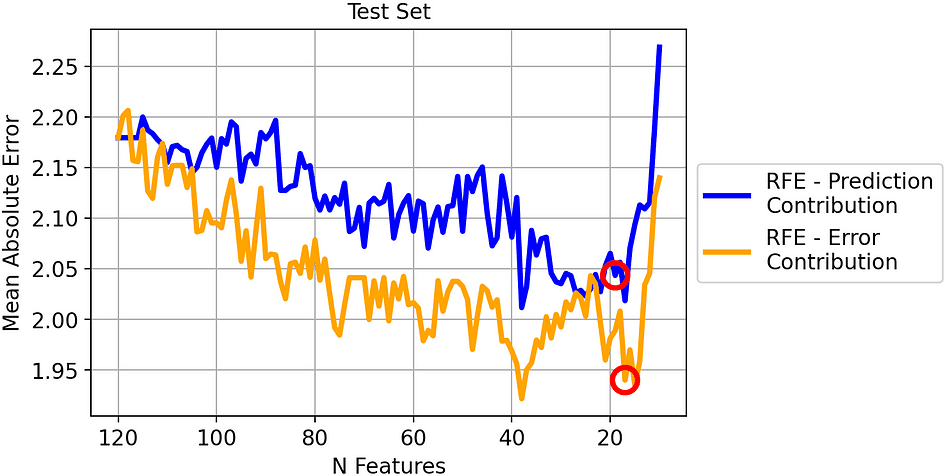

तो आइए परीक्षण सेट पर वही तुलना देखें।

परीक्षण सेट पर दो रणनीतियों की माध्य निरपेक्ष त्रुटि। [लेखक द्वारा छवि]

परिणाम पिछले वाले के समान है. भले ही दो पंक्तियों के बीच कम दूरी हो, उच्चतम त्रुटि योगदानकर्ता को हटाकर प्राप्त एमएई स्पष्ट रूप से निम्नतम पूर्वानुमान योगदानकर्ता को हटाकर प्राप्त एमएई से बेहतर है।

चूँकि हमने सत्यापन सेट पर सबसे छोटे एमएई की ओर ले जाने वाले मॉडलों का चयन किया है, आइए परीक्षण सेट पर उनके परिणाम देखें:

- आरएफई-भविष्यवाणी योगदान (19 विशेषताएं)। परीक्षण सेट पर एमएई: 2.04.

- आरएफई-त्रुटि योगदान (17 विशेषताएं)। परीक्षण सेट पर एमएई: 1.94।

इसलिए हमारी पद्धति का उपयोग करने वाला सर्वोत्तम एमएई पारंपरिक आरएफई की तुलना में 5% बेहतर है!

फीचर महत्व की अवधारणा मशीन लर्निंग में एक मौलिक भूमिका निभाती है। हालाँकि, "महत्व" की धारणा को अक्सर "अच्छाई" समझ लिया जाता है।

इन दो पहलुओं के बीच अंतर करने के लिए हमने दो अवधारणाएँ प्रस्तुत की हैं: पूर्वानुमान योगदान और त्रुटि योगदान। दोनों अवधारणाएँ सत्यापन डेटासेट के SHAP मानों पर आधारित हैं, और लेख में हमने उनकी गणना करने के लिए पायथन कोड देखा है।

हमने उन्हें एक वास्तविक वित्तीय डेटासेट (जिसमें कार्य सोने की कीमत की भविष्यवाणी करना है) पर भी आज़माया है और साबित किया है कि त्रुटि योगदान के आधार पर पुनरावर्ती फ़ीचर उन्मूलन से भविष्यवाणी योगदान के आधार पर पारंपरिक आरएफई की तुलना में 5% बेहतर औसत निरपेक्ष त्रुटि होती है।

इस आलेख के लिए उपयोग किए गए सभी कोड यहां पाए जा सकते हैं यह नोटबुक.

पढ़ने के लिए धन्यवाद!

सैमुएल माज़ांती जकाला में लीड डेटा साइंटिस्ट हैं और वर्तमान में रोम में रहते हैं। उन्होंने सांख्यिकी में स्नातक की उपाधि प्राप्त की और उनकी मुख्य अनुसंधान रुचि उद्योग के लिए मशीन लर्निंग अनुप्रयोगों से संबंधित है। वह एक स्वतंत्र सामग्री निर्माता भी हैं।

मूल। अनुमति के साथ पुनर्प्रकाशित।

- एसईओ संचालित सामग्री और पीआर वितरण। आज ही प्रवर्धित हो जाओ।

- प्लेटोडेटा.नेटवर्क वर्टिकल जेनरेटिव एआई। स्वयं को शक्तिवान बनाएं। यहां पहुंचें।

- प्लेटोआईस्ट्रीम। Web3 इंटेलिजेंस। ज्ञान प्रवर्धित। यहां पहुंचें।

- प्लेटोईएसजी. कार्बन, क्लीनटेक, ऊर्जा, पर्यावरण, सौर, कचरा प्रबंधन। यहां पहुंचें।

- प्लेटोहेल्थ। बायोटेक और क्लिनिकल परीक्षण इंटेलिजेंस। यहां पहुंचें।

- स्रोत: https://www.kdnuggets.com/your-features-are-important-it-doesnt-mean-they-are-good?utm_source=rss&utm_medium=rss&utm_campaign=your-features-are-important-it-doesnt-mean-they-are-good

- :हैस

- :है

- :नहीं

- $यूपी

- 07

- 1

- 14

- 17

- 19

- 20k

- 22

- 7

- a

- About

- इसके बारे में

- ऊपर

- पूर्ण

- अकौन्टस(लेखा)

- वास्तव में

- जोड़ना

- additive

- बाद

- उम्र

- आगे

- सब

- अनुमति देना

- लगभग

- भी

- हमेशा

- am

- an

- और

- अन्य

- जवाब

- कुछ भी

- अनुप्रयोगों

- दृष्टिकोण

- हैं

- लेख

- AS

- पहलू

- पहलुओं

- आस्ति

- संपत्ति

- At

- लेखक

- उपलब्ध

- औसत

- बुरा

- आधारित

- बुनियादी

- BE

- क्योंकि

- किया गया

- से पहले

- लाभदायक

- BEST

- बेहतर

- के बीच

- नीला

- बंधन

- के छात्रों

- लाना

- लाता है

- लाया

- बनाया गया

- लेकिन

- by

- गणना

- बुलाया

- कर सकते हैं

- नही सकता

- किया

- मामला

- परिवर्तन

- चेक

- वर्गीकरण

- साफ

- स्पष्ट रूप से

- कोड

- तुलना

- तुलना

- तुलना

- गणना करना

- संकल्पना

- अवधारणाओं

- चिंता

- विचार करना

- लगातार

- शामिल हैं

- सामग्री

- विपरीत

- योगदान

- योगदान

- अंशदाता

- सह - संबंध

- पाठ्यक्रम

- निर्माता

- वर्तमान में

- ग्राहक

- तिथि

- आँकड़े वाला वैज्ञानिक

- डेटासेट

- दिन

- दिन

- अंतर

- विभिन्न

- दूरी

- दूर

- भेद

- अंतर करना

- do

- नहीं करता है

- किया

- dont

- नीचे

- बूंद

- दो

- e

- से प्रत्येक

- आसानी

- पर्याप्त

- बराबर

- समान रूप से

- बराबर

- त्रुटि

- त्रुटियाँ

- और भी

- ठीक ठीक

- उदाहरण

- व्याख्या करने योग्य

- समझाया

- व्यक्त

- उद्धरण

- तथ्य

- Feature

- विशेषताएं

- अंतिम

- वित्तीय

- वित्तीय आँकड़ा

- प्रथम

- ध्यान केंद्रित

- निम्नलिखित

- के लिए

- पाया

- फ्रीलांस

- से

- पूर्ण

- मौलिक

- सामान्य जानकारी

- आम तौर पर

- मिल

- दी

- लक्ष्य

- सोना

- सोने की कीमत

- अच्छा

- महान

- जमीन

- हाथ

- नुकसान

- हानिकारक

- है

- he

- यहाँ उत्पन्न करें

- हाई

- उच्चतर

- उच्चतम

- अत्यधिक

- उसके

- कैसे

- How To

- तथापि

- HTTPS

- i

- ID

- विचार

- पहचान करना

- if

- की छवि

- महत्व

- महत्वपूर्ण

- में सुधार

- in

- अन्य में

- आमदनी

- बढ़ना

- बढ़ती

- संकेत मिलता है

- सूचक

- व्यक्ति

- व्यक्तियों

- उद्योग

- प्रभावशाली

- करें-

- अन्तर्दृष्टि

- अंतर्दृष्टि

- उदाहरण

- बजाय

- रुचि

- दिलचस्प

- रुचियों

- में

- शुरू की

- अंतर्ज्ञान

- IT

- यात्रा

- आईटी इस

- काम

- केवल

- केडनगेट्स

- जानना

- ज्ञान

- जानने वाला

- सबसे बड़ा

- नेतृत्व

- प्रमुख

- बिक्रीसूत्र

- सीख रहा हूँ

- कम से कम

- कम

- पुस्तकालय

- लाइन

- पंक्तियां

- लिंक्डइन

- सूची

- लाइव्स

- देखिए

- लॉट

- कम

- सबसे कम

- मशीन

- यंत्र अधिगम

- बनाया गया

- मुख्य

- बनाना

- बनाता है

- निर्माण

- बात

- मैटर्स

- मई..

- मतलब

- साधन

- तरीका

- तरीकों

- ग़लतफ़हमी

- आदर्श

- मॉडल

- पल

- अधिक

- अधिकांश

- बहुत

- my

- आवश्यकता

- नकारात्मक

- कभी नहीँ

- नया

- नोट

- धारणा

- अभी

- संख्या

- निरीक्षण

- मनाया

- प्राप्त

- प्राप्त

- of

- अक्सर

- on

- ONE

- or

- नारंगी

- आदेश

- अन्य

- हमारी

- आउट

- परिणाम

- पांडा

- भाग

- विशेष रूप से

- स्टाफ़

- प्रतिशतता

- प्रदर्शन

- अवधि

- अनुमति

- टुकड़ा

- प्लेटो

- प्लेटो डेटा इंटेलिजेंस

- प्लेटोडाटा

- निभाता

- सकारात्मक

- संभवतः

- भविष्यवाणी करना

- की भविष्यवाणी

- भविष्यवाणी

- भविष्यवाणियों

- भविष्य कहनेवाला

- उपस्थिति

- पिछला

- मूल्य

- शायद

- मुसीबत

- प्रक्रिया

- संपत्ति

- साबित

- प्रतिनिधि

- धक्का

- अजगर

- प्रश्न

- पढ़ना

- वास्तविक

- वास्तव में

- हाल

- पुनरावर्ती

- कमी

- प्रतीपगमन

- सापेक्ष

- प्रासंगिक

- शेष

- हटाने

- हटाना

- हटाया

- हटाने

- दोहराना

- अनुसंधान

- कि

- क्रमश

- परिणाम

- जिसके परिणामस्वरूप

- परिणाम

- वापसी

- रिटर्न

- सही

- भूमिका

- रोम

- आरओडब्ल्यू

- कहा

- वही

- कहना

- वैज्ञानिक

- दूसरा

- देखना

- लगता है

- देखा

- चयनित

- भावना

- कई

- सेट

- चाहिए

- हस्ताक्षर

- समान

- सरल

- केवल

- के बाद से

- एक

- छोटा

- छोटे

- So

- कुछ

- कोई

- विशिष्ट

- आँकड़े

- कदम

- कदम

- संग्रहित

- रणनीतियों

- लेना

- लिया

- ले जा

- में बात कर

- लक्ष्य

- कार्य

- कहना

- आदत

- परीक्षण

- से

- कि

- RSI

- लेकिन हाल ही

- उन

- फिर

- वहाँ।

- इन

- वे

- चीज़ें

- सोचना

- तीसरा

- इसका

- उन

- हजारों

- तीन

- यहाँ

- इस प्रकार

- पहर

- समय श्रृंखला

- सेवा मेरे

- कुल

- परंपरागत

- प्रशिक्षित

- प्रशिक्षण

- कोशिश

- सच

- कोशिश

- की कोशिश कर रहा

- दो

- टाइप

- us

- उपयोग

- प्रयुक्त

- का उपयोग करता है

- का उपयोग

- सत्यापन

- मूल्यवान

- मूल्य

- मान

- परिवर्तनशील

- सत्यापित

- बहुत

- vs

- करना चाहते हैं

- we

- कुंआ

- क्या

- कब

- जहाँ तक

- या

- कौन कौन से

- व्यापक रूप से

- मर्जी

- साथ में

- बिना

- शब्द

- काम

- काम कर रहे

- कार्य

- बदतर

- होगा

- इसलिए आप

- आपका

- जेफिरनेट