लेखक द्वारा छवि

इस पोस्ट में, हम मिक्सट्रल 8x7बी नामक नए अत्याधुनिक ओपन-सोर्स मॉडल का पता लगाएंगे। हम यह भी सीखेंगे कि LLaMA C++ लाइब्रेरी का उपयोग करके इसे कैसे एक्सेस किया जाए और कम कंप्यूटिंग और मेमोरी पर बड़े भाषा मॉडल कैसे चलाए जाएं।

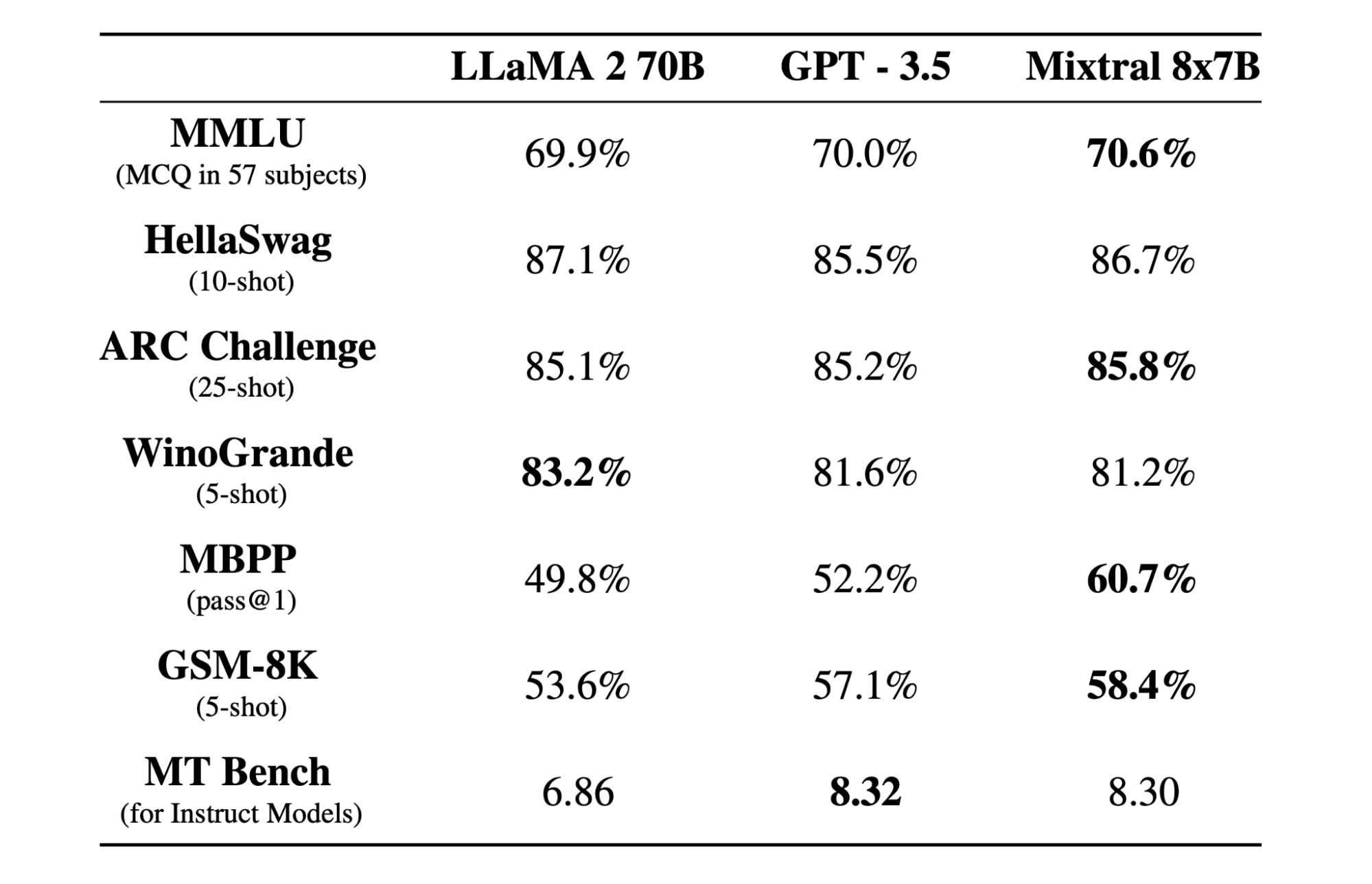

मिक्सट्रल 8x7बी खुले वजन के साथ विशेषज्ञों (एसएमओई) मॉडल का एक उच्च गुणवत्ता वाला विरल मिश्रण है, जो मिस्ट्रल एआई द्वारा बनाया गया है। इसे अपाचे 2.0 के तहत लाइसेंस प्राप्त है और यह 2 गुना तेज अनुमान के साथ अधिकांश बेंचमार्क पर लामा 70 6बी से बेहतर प्रदर्शन करता है। मिक्सट्रल अधिकांश मानक बेंचमार्क पर GPT3.5 से मेल खाता है या उसे मात देता है और लागत/प्रदर्शन के संबंध में सबसे अच्छा ओपन-वेट मॉडल है।

से छवि विशेषज्ञों का मिश्रण

मिक्सट्रल 8x7B डिकोडर-केवल विरल मिश्रण-विशेषज्ञ नेटवर्क का उपयोग करता है। इसमें मापदंडों के 8 समूहों में से एक फीडफॉरवर्ड ब्लॉक का चयन करना शामिल है, जिसमें एक राउटर नेटवर्क प्रत्येक टोकन के लिए इनमें से दो समूहों को चुनता है, उनके आउटपुट को योगात्मक रूप से जोड़ता है। यह विधि लागत और विलंबता का प्रबंधन करते हुए मॉडल के पैरामीटर गिनती को बढ़ाती है, जिससे कुल पैरामीटर 12.9B होने के बावजूद, यह 46.7B मॉडल जितना कुशल हो जाता है।

मिक्सट्रल 8x7B मॉडल 32k टोकन के विस्तृत संदर्भ को संभालने में उत्कृष्ट है और अंग्रेजी, फ्रेंच, इतालवी, जर्मन और स्पेनिश सहित कई भाषाओं का समर्थन करता है। यह कोड जनरेशन में मजबूत प्रदर्शन प्रदर्शित करता है और इसे एमटी-बेंच जैसे बेंचमार्क पर उच्च स्कोर प्राप्त करते हुए एक निर्देश-पालन मॉडल में ठीक किया जा सकता है।

एलएलएएमए.सीपीपी एक सी/सी++ लाइब्रेरी है जो फेसबुक के एलएलएम आर्किटेक्चर पर आधारित बड़े भाषा मॉडल (एलएलएम) के लिए एक उच्च-प्रदर्शन इंटरफ़ेस प्रदान करती है। यह एक हल्का और कुशल पुस्तकालय है जिसका उपयोग पाठ निर्माण, अनुवाद और प्रश्न उत्तर सहित विभिन्न कार्यों के लिए किया जा सकता है। LLaMA.cpp LLaMA, LLaMA 2, Falcon, Alpaca, Mistral 7B, Mixtral 8x7B, और GPT4ALL सहित LLM की एक विस्तृत श्रृंखला का समर्थन करता है। यह सभी ऑपरेटिंग सिस्टम के साथ संगत है और सीपीयू और जीपीयू दोनों पर कार्य कर सकता है।

इस अनुभाग में, हम Colab पर llama.cpp वेब एप्लिकेशन चलाएंगे। कोड की कुछ पंक्तियाँ लिखकर, आप अपने पीसी या Google Colab पर नए अत्याधुनिक मॉडल के प्रदर्शन का अनुभव कर पाएंगे।

Getting Started

सबसे पहले, हम नीचे दिए गए कमांड लाइन का उपयोग करके llama.cpp GitHub रिपॉजिटरी डाउनलोड करेंगे:

!git clone --depth 1 https://github.com/ggerganov/llama.cpp.gitउसके बाद, हम डायरेक्टरी को रिपॉजिटरी में बदल देंगे और `मेक` कमांड का उपयोग करके llama.cpp इंस्टॉल करेंगे। हम CUDA स्थापित के साथ NVidia GPU के लिए llama.cpp स्थापित कर रहे हैं।

%cd llama.cpp

!make LLAMA_CUBLAS=1मॉडल डाउनलोड करें

हम `.gguf` मॉडल फ़ाइल के उपयुक्त संस्करण का चयन करके मॉडल को हगिंग फेस हब से डाउनलोड कर सकते हैं। विभिन्न संस्करणों पर अधिक जानकारी यहां पाई जा सकती है TheBloke/Mixtral-8x7B-निर्देश-v0.1-GGUF.

से छवि TheBloke/Mixtral-8x7B-निर्देश-v0.1-GGUF

आप मौजूदा निर्देशिका में मॉडल डाउनलोड करने के लिए `wget` कमांड का उपयोग कर सकते हैं।

!wget https://huggingface.co/TheBloke/Mixtral-8x7B-Instruct-v0.1-GGUF/resolve/main/mixtral-8x7b-instruct-v0.1.Q2_K.ggufLLaMA सर्वर के लिए बाहरी पता

जब हम एलएलएएमए सर्वर चलाते हैं तो यह हमें एक लोकलहोस्ट आईपी देगा जो कोलाब पर हमारे लिए बेकार है। हमें कोलाब कर्नेल प्रॉक्सी पोर्ट का उपयोग करके लोकलहोस्ट प्रॉक्सी से कनेक्शन की आवश्यकता है।

नीचे दिए गए कोड को चलाने के बाद, आपको ग्लोबल हाइपरलिंक मिलेगा। हम बाद में अपने वेबएप तक पहुंचने के लिए इस लिंक का उपयोग करेंगे।

from google.colab.output import eval_js

print(eval_js("google.colab.kernel.proxyPort(6589)"))

https://8fx1nbkv1c8-496ff2e9c6d22116-6589-colab.googleusercontent.com/सर्वर चला रहा है

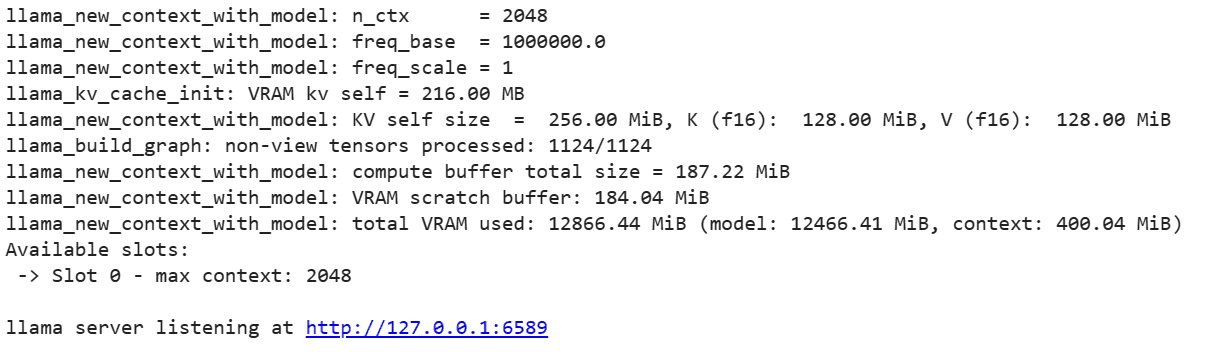

LLaMA C++ सर्वर को चलाने के लिए, आपको मॉडल फ़ाइल के स्थान और सही पोर्ट नंबर के साथ सर्वर कमांड प्रदान करना होगा। यह सुनिश्चित करना महत्वपूर्ण है कि पोर्ट नंबर उसी से मेल खाता है जिसे हमने प्रॉक्सी पोर्ट के लिए पिछले चरण में शुरू किया था।

%cd /content/llama.cpp

!./server -m mixtral-8x7b-instruct-v0.1.Q2_K.gguf -ngl 27 -c 2048 --port 6589

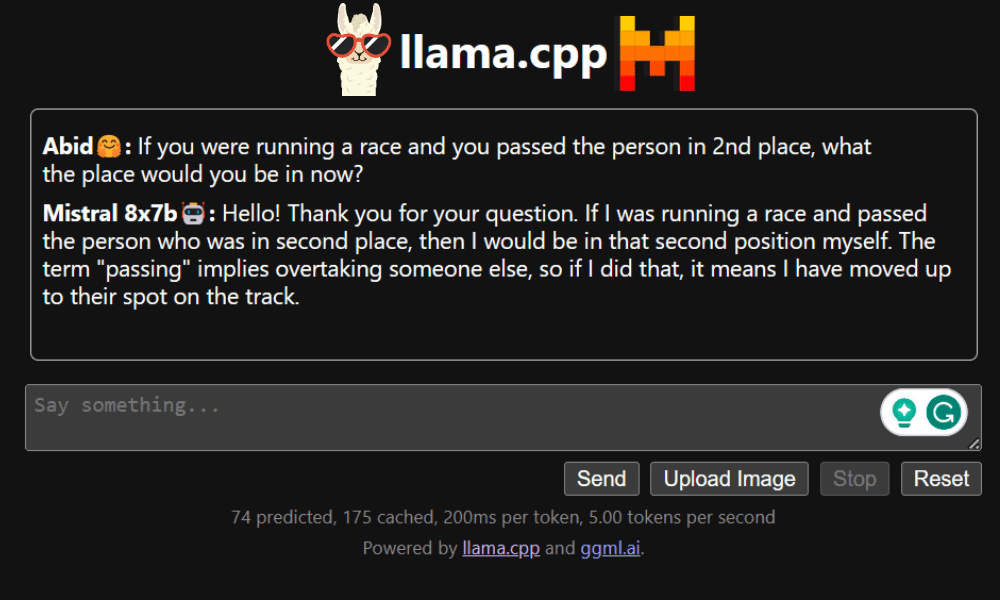

पिछले चरण में प्रॉक्सी पोर्ट हाइपरलिंक पर क्लिक करके चैट वेबएप तक पहुंचा जा सकता है क्योंकि सर्वर स्थानीय रूप से नहीं चल रहा है।

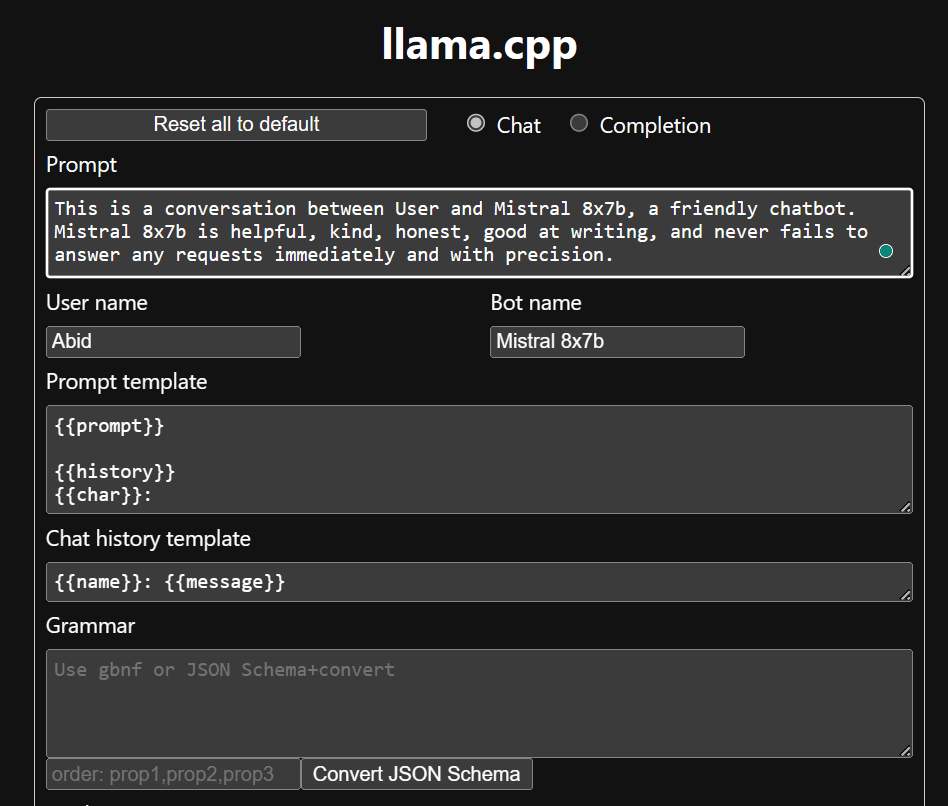

एलएलएएमए सी++ वेबएप

इससे पहले कि हम चैटबॉट का उपयोग शुरू करें, हमें इसे अनुकूलित करना होगा। प्रॉम्प्ट अनुभाग में "LLaMA" को अपने मॉडल नाम से बदलें। इसके अतिरिक्त, उत्पन्न प्रतिक्रियाओं के बीच अंतर करने के लिए उपयोगकर्ता नाम और बॉट नाम को संशोधित करें।

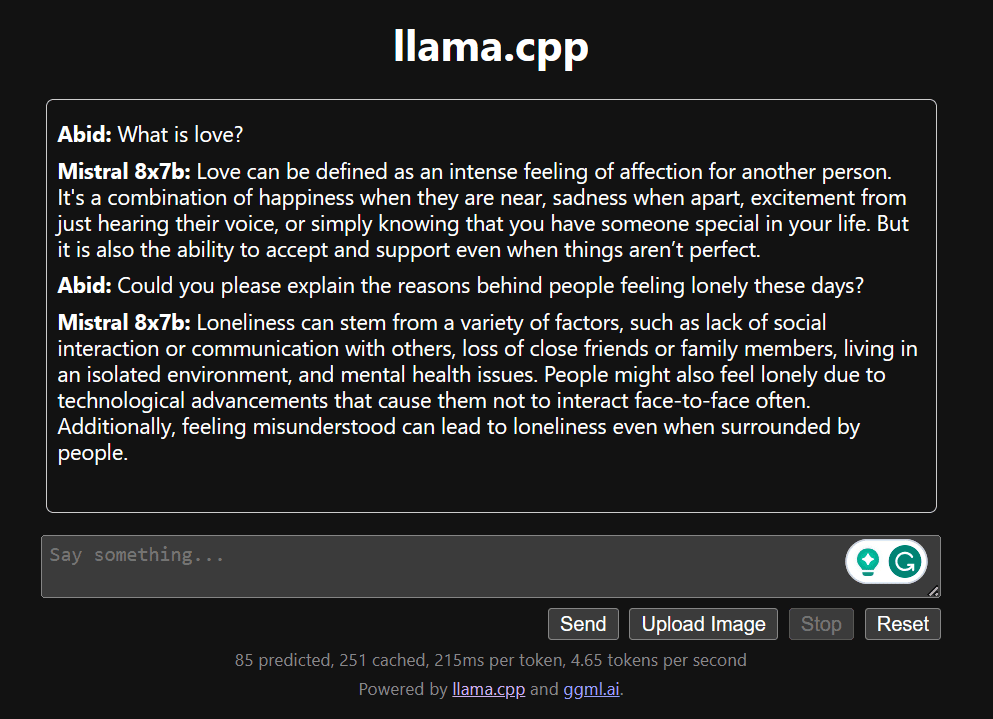

नीचे स्क्रॉल करके और चैट सेक्शन में टाइप करके चैट शुरू करें। बेझिझक ऐसे तकनीकी प्रश्न पूछें जिनका अन्य ओपन सोर्स मॉडल ठीक से उत्तर देने में विफल रहे हैं।

यदि आपको ऐप में कोई समस्या आती है, तो आप मेरे Google Colab का उपयोग करके इसे स्वयं चलाने का प्रयास कर सकते हैं: https://colab.research.google.com/drive/1gQ1lpSH-BhbKN-DdBmq5r8-8Rw8q1p9r?usp=sharing

यह ट्यूटोरियल LLaMA C++ लाइब्रेरी का उपयोग करके Google Colab पर उन्नत ओपन-सोर्स मॉडल, Mixtral 8x7b को चलाने के तरीके पर एक व्यापक मार्गदर्शिका प्रदान करता है। अन्य मॉडलों की तुलना में, मिक्सट्रल 8x7बी बेहतर प्रदर्शन और दक्षता प्रदान करता है, जो इसे उन लोगों के लिए एक उत्कृष्ट समाधान बनाता है जो बड़े भाषा मॉडल के साथ प्रयोग करना चाहते हैं लेकिन उनके पास व्यापक कम्प्यूटेशनल संसाधन नहीं हैं। आप इसे अपने लैपटॉप या फ्री क्लाउड कंप्यूट पर आसानी से चला सकते हैं। यह उपयोगकर्ता के अनुकूल है, और आप अपने चैट ऐप को दूसरों के उपयोग और प्रयोग के लिए भी तैनात कर सकते हैं।

मुझे आशा है कि आपको बड़े मॉडल को चलाने का यह सरल समाधान उपयोगी लगा होगा। मैं हमेशा सरल और बेहतर विकल्पों की तलाश में रहता हूं। यदि आपके पास इससे भी बेहतर समाधान है, तो कृपया मुझे बताएं, और मैं अगली बार इसे कवर करूंगा।

आबिद अली अवनी (@1अबिदलियावान) एक प्रमाणित डेटा वैज्ञानिक पेशेवर है जो मशीन लर्निंग मॉडल बनाना पसंद करता है। वर्तमान में, वह सामग्री निर्माण और मशीन लर्निंग और डेटा विज्ञान प्रौद्योगिकियों पर तकनीकी ब्लॉग लिखने पर ध्यान केंद्रित कर रहा है। आबिद के पास प्रौद्योगिकी प्रबंधन में मास्टर डिग्री और दूरसंचार इंजीनियरिंग में स्नातक की डिग्री है। उनका दृष्टिकोण मानसिक बीमारी से जूझ रहे छात्रों के लिए ग्राफ न्यूरल नेटवर्क का उपयोग करके एआई उत्पाद बनाना है।

- एसईओ संचालित सामग्री और पीआर वितरण। आज ही प्रवर्धित हो जाओ।

- प्लेटोडेटा.नेटवर्क वर्टिकल जेनरेटिव एआई। स्वयं को शक्तिवान बनाएं। यहां पहुंचें।

- प्लेटोआईस्ट्रीम। Web3 इंटेलिजेंस। ज्ञान प्रवर्धित। यहां पहुंचें।

- प्लेटोईएसजी. कार्बन, क्लीनटेक, ऊर्जा, पर्यावरण, सौर, कचरा प्रबंधन। यहां पहुंचें।

- प्लेटोहेल्थ। बायोटेक और क्लिनिकल परीक्षण इंटेलिजेंस। यहां पहुंचें।

- स्रोत: https://www.kdnuggets.com/running-mixtral-8x7b-on-google-colab-for-free?utm_source=rss&utm_medium=rss&utm_campaign=running-mixtral-8x7b-on-google-colab-for-free

- :है

- :नहीं

- 1

- 12

- 27

- 46

- 7

- 8

- a

- योग्य

- पहुँच

- पहुँचा

- प्राप्त करने

- इसके अतिरिक्त

- पता

- उन्नत

- AI

- सब

- भी

- हमेशा

- am

- an

- और

- जवाब

- अपाचे

- अनुप्रयोग

- आवेदन

- उपयुक्त

- स्थापत्य

- हैं

- AS

- पूछना

- आधारित

- BE

- शुरू करना

- नीचे

- मानक

- BEST

- बेहतर

- के बीच

- खंड

- ब्लॉग

- बीओटी

- के छात्रों

- निर्माण

- इमारत

- लेकिन

- by

- सी + +

- बुलाया

- कर सकते हैं

- प्रमाणित

- परिवर्तन

- बातचीत

- chatbot

- बातें

- चुनने

- बादल

- कोड

- संयोजन

- तुलना

- संगत

- व्यापक

- कम्प्यूटेशनल

- गणना करना

- कंप्यूटिंग

- संबंध

- सामग्री

- सामग्री निर्माण

- प्रसंग

- सही

- लागत

- आवरण

- बनाया

- निर्माण

- वर्तमान

- वर्तमान में

- अनुकूलित

- तिथि

- डेटा विज्ञान

- आँकड़े वाला वैज्ञानिक

- डिग्री

- बचाता है

- दर्शाता

- तैनात

- के बावजूद

- अंतर करना

- do

- नीचे

- डाउनलोड

- से प्रत्येक

- आसानी

- दक्षता

- कुशल

- सामना

- अभियांत्रिकी

- अंग्रेज़ी

- बढ़ाता है

- और भी

- उत्कृष्ट

- अनुभव

- प्रयोग

- विशेषज्ञों

- का पता लगाने

- व्यापक

- चेहरा

- फेसबुक

- विफल रहे

- बाज़

- और तेज

- लग रहा है

- कुछ

- पट्टिका

- ध्यान केंद्रित

- के लिए

- पाया

- मुक्त

- फ्रेंच

- से

- समारोह

- उत्पन्न

- पीढ़ी

- जर्मन

- मिल

- GitHub

- देना

- वैश्विक

- गूगल

- GPU

- GPUs

- ग्राफ

- ग्राफ तंत्रिका नेटवर्क

- समूह की

- गाइड

- हैंडलिंग

- है

- होने

- he

- सहायक

- हाई

- उच्च प्रदर्शन

- उच्च गुणवत्ता

- उसके

- रखती है

- आशा

- कैसे

- How To

- HTTPS

- हब

- i

- if

- बीमारी

- आयात

- महत्वपूर्ण

- in

- सहित

- करें-

- शुरू

- स्थापित

- स्थापित कर रहा है

- इंटरफेस

- में

- शामिल

- IP

- मुद्दों

- IT

- इतालवी

- केडनगेट्स

- जानना

- भाषा

- भाषाऐं

- लैपटॉप

- बड़ा

- विलंब

- बाद में

- जानें

- सीख रहा हूँ

- चलो

- पुस्तकालय

- लाइसेंस - प्राप्त

- हल्के

- पसंद

- लाइन

- पंक्तियां

- LINK

- लिंक्डइन

- लामा

- स्थानीय स्तर पर

- स्थान

- देख

- प्यार करता है

- मशीन

- यंत्र अधिगम

- बनाना

- निर्माण

- प्रबंध

- प्रबंध

- मास्टर

- मैच

- me

- याद

- मानसिक

- मानसिक बीमारी

- तरीका

- मिश्रण

- आदर्श

- मॉडल

- संशोधित

- अधिक

- अधिकांश

- विभिन्न

- my

- नाम

- आवश्यकता

- नेटवर्क

- तंत्रिका

- तंत्रिका नेटवर्क

- नया

- अगला

- संख्या

- Nvidia

- of

- on

- ONE

- खुला

- खुला स्रोत

- परिचालन

- ऑपरेटिंग सिस्टम

- ऑप्शंस

- or

- अन्य

- अन्य

- हमारी

- Outperforms

- उत्पादन

- outputs के

- अपना

- प्राचल

- पैरामीटर

- PC

- प्रदर्शन

- प्लेटो

- प्लेटो डेटा इंटेलिजेंस

- प्लेटोडाटा

- कृप्या अ

- पद

- पिछला

- एस्ट्रो मॉल

- पेशेवर

- अच्छी तरह

- प्रदान करना

- प्रदान करता है

- प्रतिनिधि

- प्रश्न

- प्रशन

- रेंज

- घटी

- के बारे में

- की जगह

- कोष

- अनुसंधान

- उपयुक्त संसाधन चुनें

- प्रतिक्रियाएं

- रूटर

- रन

- दौड़ना

- s

- विज्ञान

- वैज्ञानिक

- स्कोर

- स्क्रॉलिंग

- अनुभाग

- का चयन

- सर्वर

- सरल

- के बाद से

- समाधान

- स्रोत

- स्पेनिश

- मानक

- राज्य के-the-कला

- कदम

- मजबूत

- संघर्ष

- छात्र

- बेहतर

- समर्थन करता है

- निश्चित

- सिस्टम

- कार्य

- तकनीकी

- टेक्नोलॉजीज

- टेक्नोलॉजी

- दूरसंचार

- टेक्स्ट

- पाठ पीढ़ी

- कि

- RSI

- लेकिन हाल ही

- इन

- इसका

- उन

- पहर

- सेवा मेरे

- टोकन

- टोकन

- कुल

- अनुवाद करें

- कोशिश

- ट्यूटोरियल

- दो

- के अंतर्गत

- us

- उपयोग

- प्रयुक्त

- उपयोगकर्ता

- उपयोगकर्ता के अनुकूल

- का उपयोग करता है

- का उपयोग

- विविधता

- विभिन्न

- संस्करण

- दृष्टि

- करना चाहते हैं

- we

- वेब

- वेब एप्लीकेशन

- कौन कौन से

- जब

- कौन

- चौड़ा

- विस्तृत श्रृंखला

- मर्जी

- साथ में

- लिख रहे हैं

- इसलिए आप

- आपका

- जेफिरनेट