जेनेरिक एआई मॉडल अपने प्रशिक्षण डेटा से छवियों को याद कर सकते हैं, संभवतः उपयोगकर्ताओं को निजी कॉपीराइट डेटा निकालने की अनुमति दे सकते हैं अनुसंधान.

DALL-E, स्टेबल डिफ्यूजन और मिडजर्नी जैसे टूल को इंटरनेट से निकाली गई अरबों छवियों पर प्रशिक्षित किया जाता है, जिसमें कलाकृति और लोगो जैसे कॉपीराइट द्वारा संरक्षित डेटा भी शामिल है। वे वस्तुओं और शैलियों के दृश्य प्रतिनिधित्व को प्राकृतिक भाषा में मैप करना सीखते हैं। जब उन्हें इनपुट के रूप में एक टेक्स्ट विवरण दिया जाता है, तो वे आउटपुट के रूप में कैप्शन से मेल खाने वाली एक छवि उत्पन्न करते हैं।

नई तकनीक ने कॉपीराइट पर एक नई कानूनी बहस छेड़ दी है: क्या ये उपकरण बौद्धिक संपदा अधिकारों का उल्लंघन करते हैं क्योंकि उन्होंने बिना अनुमति के कॉपीराइट वाली छवियों का उपयोग किया है?

मुक़दमे हुए हैं दायर कॉपीराइट का उल्लंघन करने के लिए सबसे लोकप्रिय जेनरेटिव एआई टूल के निर्माताओं के खिलाफ। टेक्स्ट-टू-इमेज मॉडल बनाने वाली कंपनियों का तर्क है कि चूंकि उनका सॉफ़्टवेयर अद्वितीय छवियां उत्पन्न करता है, इसलिए कॉपीराइट डेटा का उनका उपयोग उचित उपयोग है। लेकिन जिन कलाकारों ने इन उपकरणों द्वारा अपनी शैलियों और कार्यों की नकल देखी है, उनका मानना है कि उन्हें धोखा दिया गया है।

अब Google, डीपमाइंड, कैलिफोर्निया विश्वविद्यालय, बर्कले, ETH ज्यूरिख और प्रिंसटन विश्वविद्यालय में काम करने वाले शोधकर्ताओं के नेतृत्व में किए गए शोध से पता चलता है कि इन मॉडलों को प्रशिक्षित करने के लिए उपयोग की जाने वाली छवियां निकाली जा सकती हैं। जेनरेटिव एआई मॉडल छवियों को याद रखते हैं और उनकी सटीक प्रतियां तैयार कर सकते हैं, जिससे नई कॉपीराइट और गोपनीयता संबंधी चिंताएं पैदा होती हैं।

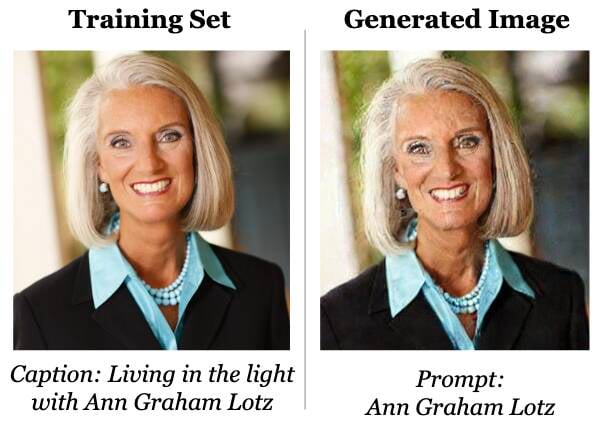

छवियों के कुछ उदाहरण शोधकर्ता स्टेबल डिफ्यूजन से निकालने में कामयाब रहे

अध्ययन के सह-लेखकों ने बताया, "वास्तविक हमले में, जहां एक प्रतिद्वंद्वी निजी जानकारी निकालना चाहता है, वे उस लेबल या कैप्शन का अनुमान लगाएंगे जो एक छवि के लिए इस्तेमाल किया गया था।" रजिस्टर.

“हमलावर के लिए सौभाग्य से, हमारा तरीका कभी-कभी काम कर सकता है, भले ही अनुमान सही न हो। उदाहरण के लिए, हम प्रशिक्षण सेट से पूर्ण कैप्शन ("एन ग्राहम लोट्ज़ के साथ प्रकाश में रहना") के बजाय, केवल उसके नाम के साथ स्टेबल डिफ्यूजन का संकेत देकर एन ग्राहम लोट्ज़ का चित्र निकाल सकते हैं।

केवल मॉडल द्वारा याद की गई छवियां ही निकाली जा सकती हैं, और कोई मॉडल कितना डेटा याद रख सकता है यह उसके प्रशिक्षण डेटा और आकार जैसे कारकों पर निर्भर करता है। एक ही छवि की प्रतियां याद रखने की अधिक संभावना होती है, और अधिक पैरामीटर वाले मॉडल भी छवियों को याद रखने में सक्षम होने की अधिक संभावना रखते हैं।

टीम स्थिर प्रसार को प्रशिक्षित करने के लिए उपयोग किए गए 94 उदाहरणों में से 350,000 छवियां निकालने में सक्षम थी, और Google के 23 उदाहरणों में से 1,000 छवियां निकालने में सक्षम थी। छवि नमूना। तुलना के लिए, स्टेबल डिफ्यूजन में 890 मिलियन पैरामीटर हैं और इसे 160 मिलियन छवियों पर प्रशिक्षित किया गया था, जबकि इमेजन में दो बिलियन पैरामीटर हैं - यह स्पष्ट नहीं है कि इसे सटीक रूप से प्रशिक्षित करने के लिए कितनी छवियों का उपयोग किया गया था।

शोधकर्ताओं ने कहा, "स्थिर प्रसार के लिए, हमने पाया कि अधिकांश याद की गई छवियों को प्रशिक्षण सेट में 100 बार या उससे अधिक बार दोहराया गया था, लेकिन कुछ को 10 बार भी कम किया गया था।" “Google के इमेजेन मॉडल के लिए, जो स्टेबल डिफ्यूज़न से बड़ा मॉडल है और छोटे डेटासेट पर प्रशिक्षित है, याद रखना अधिक बार-बार प्रतीत होता है। यहां हमें कुछ बाहरी छवियां मिलती हैं जो पूरे प्रशिक्षण सेट में केवल एक बार मौजूद होती हैं, फिर भी निकालने योग्य होती हैं।

वे निश्चित नहीं हैं कि बड़े मॉडल अधिक छवियों को याद रखने की प्रवृत्ति क्यों रखते हैं, लेकिन उनका मानना है कि इसका उनके प्रशिक्षण डेटा को इसके मापदंडों में अधिक संग्रहीत करने में सक्षम होने से कुछ लेना-देना हो सकता है।

इन मॉडलों के लिए याद रखने की दर बहुत कम है, और वास्तव में छवियां निकालना कठिन और मुश्किल होगा। याद किए गए डेटा को उत्पन्न करने में मॉडल का नेतृत्व करने के लिए हमलावरों को अनुमान लगाना होगा और कई संकेतों का प्रयास करना होगा। फिर भी, टीम डेवलपर्स को निजी संवेदनशील डेटा पर जेनरेटर एआई मॉडल का प्रशिक्षण देने से परहेज करने की चेतावनी दे रही है।

“याद रखना कितना ख़राब है यह जनरेटिव मॉडल के अनुप्रयोग पर निर्भर करता है। अत्यधिक निजी अनुप्रयोगों में, जैसे कि चिकित्सा क्षेत्र में (उदाहरण के लिए छाती के एक्स-रे या मेडिकल रिकॉर्ड पर प्रशिक्षण), याद रखना अत्यधिक अवांछनीय है, भले ही यह केवल उपयोगकर्ताओं के एक बहुत छोटे हिस्से को प्रभावित करता हो। इसके अलावा, गोपनीयता संवेदनशील अनुप्रयोगों में उपयोग किए जाने वाले प्रशिक्षण सेट आमतौर पर वर्तमान जेनरेटिव आर्ट मॉडल को प्रशिक्षित करने के लिए उपयोग किए जाने वाले सेट से छोटे होते हैं। इसलिए, हम बहुत अधिक स्मरणशक्ति देख सकते हैं, जिसमें वे छवियां भी शामिल हैं जिनकी नकल नहीं की गई है,'' उन्होंने हमें बताया।

डेटा निष्कर्षण को रोकने का एक तरीका मॉडलों में याद रखने की संभावना को कम करना है। उदाहरण के लिए, प्रशिक्षण डेटासेट में डुप्लिकेट से छुटकारा पाने से छवियों को याद रखने और निकालने की संभावना कम हो जाएगी। स्टेबिलिटी एआई, स्टेबल डिफ्यूजन के निर्माता, ने कथित तौर पर शोधकर्ताओं के निष्कर्षों से स्वतंत्र रूप से कम डुप्लिकेट वाले डेटासेट पर अपने नवीनतम मॉडल को प्रशिक्षित किया है।

अब जब यह सिद्ध हो गया है कि टेक्स्ट-टू-इमेज मॉडल उन छवियों की सटीक प्रतियां उत्पन्न कर सकते हैं जिन पर उन्हें प्रशिक्षित किया गया था, तो यह स्पष्ट नहीं है कि यह कॉपीराइट मामलों को कैसे प्रभावित कर सकता है।

“एक सामान्य तर्क जो हमने लोगों को ऑनलाइन बनाते देखा था, वह कुछ प्रकार का था 'ये मॉडल कभी भी प्रशिक्षण डेटा को याद नहीं रखते हैं।' अब हम जानते हैं कि यह स्पष्ट रूप से झूठ है। लेकिन क्या यह वास्तव में कानूनी बहस में मायने रखता है या नहीं, यह भी बहस का विषय है, ”शोधकर्ताओं ने निष्कर्ष निकाला।

“कम से कम अब, इन मुकदमों में दोनों पक्षों के पास कुछ और ठोस तथ्य हैं जिन पर वे भरोसा कर सकते हैं: हाँ, याद रखना होता है; लेकिन यह बहुत दुर्लभ है; और ऐसा मुख्य रूप से अत्यधिक डुप्लिकेट की गई छवियों के लिए होता है। ®

- एसईओ संचालित सामग्री और पीआर वितरण। आज ही प्रवर्धित हो जाओ।

- प्लेटोब्लॉकचैन। Web3 मेटावर्स इंटेलिजेंस। ज्ञान प्रवर्धित। यहां पहुंचें।

- स्रोत: https://go.theregister.com/feed/www.theregister.com/2023/02/06/uh_oh_attackers_can_extract/

- 000

- 1

- 10

- 100

- a

- योग्य

- अनुसार

- वास्तव में

- के खिलाफ

- AI

- की अनुमति दे

- और

- आवेदन

- अनुप्रयोगों

- बहस

- तर्क

- कला

- कलाकार

- कलाकृति

- आक्रमण

- बुरा

- जा रहा है

- मानना

- बर्कले

- बिलियन

- अरबों

- सीमा

- दोनों पक्षों

- इमारत

- कैलिफ़ोर्निया

- मामलों

- केंद्र

- संभावना

- स्पष्ट

- स्पष्ट रूप से

- सामान्य

- कंपनियों

- तुलना

- चिंताओं

- निष्कर्ष निकाला

- प्रतियां

- Copyright

- सका

- रचनाकारों

- वर्तमान

- दल-ए

- तिथि

- बहस

- कमी

- Deepmind

- निर्भर करता है

- विवरण

- डेवलपर्स

- प्रसार

- डोमेन

- डुप्लिकेट

- संपूर्ण

- ETH

- ETH ज्यूरिख

- ईथर (ईटीएच)

- और भी

- ठीक ठीक

- उदाहरण

- उदाहरण

- उद्धरण

- निष्कर्षण

- कारकों

- निष्पक्ष

- कुछ

- खोज

- भाग्यवश

- अंश

- बारंबार

- ताजा

- से

- पूर्ण

- और भी

- उत्पन्न

- उत्पन्न करता है

- सृजन

- उत्पादक

- जनरेटिव एआई

- मिल रहा

- दी

- गूगल

- होना

- हो जाता

- यहाँ उत्पन्न करें

- अत्यधिक

- कैसे

- HTTPS

- की छवि

- छवियों

- प्रभाव

- in

- सहित

- स्वतंत्र रूप से

- करें-

- निवेश

- बजाय

- बौद्धिक

- बौद्धिक संपदा

- इंटरनेट

- IT

- जानना

- लेबल

- भाषा

- बड़ा

- मुकदमों

- नेतृत्व

- जानें

- नेतृत्व

- कानूनी

- प्रकाश

- संभावित

- जीवित

- लॉट

- निम्न

- बनाना

- निर्माताओं

- कामयाब

- बहुत

- नक्शा

- मिलान

- मैटर्स

- मेडिकल

- तरीका

- मध्य यात्रा

- हो सकता है

- दस लाख

- आदर्श

- मॉडल

- अधिक

- अधिकांश

- सबसे लोकप्रिय

- नाम

- प्राकृतिक

- प्राकृतिक भाषा

- नया

- नवीनतम

- अनेक

- वस्तुओं

- ऑनलाइन

- पैरामीटर

- स्टाफ़

- उत्तम

- अनुमति

- प्लेटो

- प्लेटो डेटा इंटेलिजेंस

- प्लेटोडाटा

- लोकप्रिय

- चित्र

- संभव

- वर्तमान

- सुंदर

- को रोकने के

- प्रिंसटन

- एकांत

- निजी

- निजी जानकारी

- संपत्ति

- संपत्ति के अधिकार

- संरक्षित

- साबित

- को ऊपर उठाने

- दुर्लभ

- दरें

- RE

- वास्तविक

- वास्तविकता

- अभिलेख

- याद

- अनुसंधान

- शोधकर्ताओं

- छुटकारा

- अधिकार

- फट

- कहा

- वही

- लगता है

- संवेदनशील

- सेट

- सेट

- साइड्स

- के बाद से

- एक

- आकार

- छोटा

- छोटे

- सॉफ्टवेयर

- कुछ

- कुछ

- स्थिरता

- स्थिर

- फिर भी

- की दुकान

- अध्ययन

- ऐसा

- टीम

- टेक्नोलॉजी

- RSI

- लेकिन हाल ही

- इसलिये

- पहर

- बार

- सेवा मेरे

- भी

- उपकरण

- रेलगाड़ी

- प्रशिक्षित

- प्रशिक्षण

- अद्वितीय

- विश्वविद्यालय

- यूनिवर्सिटी ऑफ कैलिफोर्निया

- us

- उपयोग

- उपयोगकर्ताओं

- आमतौर पर

- प्रकार

- Ve

- चेतावनी

- या

- कौन कौन से

- जब

- कौन

- बिना

- काम

- काम कर रहे

- होगा

- जेफिरनेट

- ज्यूरिक