L'importance des entrepôts de données et des analyses effectuées sur les plates-formes d'entrepôt de données n'a cessé d'augmenter au fil des ans, de nombreuses entreprises en viennent à s'appuyer sur ces systèmes en tant que mission critique pour la prise de décision opérationnelle à court terme et la planification stratégique à long terme. Traditionnellement, les entrepôts de données sont actualisés par cycles de lots, par exemple, mensuellement, hebdomadairement ou quotidiennement, afin que les entreprises puissent en tirer diverses informations.

De nombreuses organisations se rendent compte que l'ingestion de données en temps quasi réel ainsi que l'analyse avancée ouvrent de nouvelles opportunités. Par exemple, un institut financier peut prédire si une transaction par carte de crédit est frauduleuse en exécutant un programme de détection d'anomalies en mode quasi temps réel plutôt qu'en mode batch.

Dans cet article, nous montrons comment Redshift d'Amazon peut fournir des prédictions d'ingestion de flux et d'apprentissage automatique (ML) sur une seule plate-forme.

Amazon Redshift est un entrepôt de données cloud rapide, évolutif, sécurisé et entièrement géré qui permet d'analyser simplement et à moindre coût toutes vos données à l'aide de SQL standard.

Amazon Redshift ML permet aux analystes de données et aux développeurs de bases de données de créer, former et appliquer facilement des modèles ML à l'aide de commandes SQL familières dans les entrepôts de données Amazon Redshift.

Nous sommes ravis de lancer Ingestion de flux Amazon Redshift en Flux de données Amazon Kinesis ainsi que Amazon Managed Streaming pour Apache Kafka (Amazon MSK), qui vous permet d'ingérer des données directement à partir d'un flux de données Kinesis ou d'une rubrique Kafka sans avoir à stocker les données dans Service de stockage simple Amazon (Amazon S3). L'ingestion de streaming Amazon Redshift vous permet d'obtenir une faible latence de l'ordre de quelques secondes tout en ingérant des centaines de mégaoctets de données dans votre entrepôt de données.

Cet article montre comment Amazon Redshift, l'entrepôt de données cloud, vous permet de créer des prédictions ML en temps quasi réel en utilisant l'ingestion de streaming Amazon Redshift et les fonctionnalités Redshift ML avec un langage SQL familier.

Vue d'ensemble de la solution

En suivant les étapes décrites dans cet article, vous pourrez configurer une application de streamer producteur sur un Cloud de calcul élastique Amazon (Amazon EC2) qui simule les transactions par carte de crédit et transmet les données à Kinesis Data Streams en temps réel. Vous configurez une vue matérialisée Amazon Redshift Streaming Ingestion sur Amazon Redshift, où les données de streaming sont reçues. Vous entraînez et créez un modèle Redshift ML pour générer des inférences en temps réel par rapport aux données de streaming.

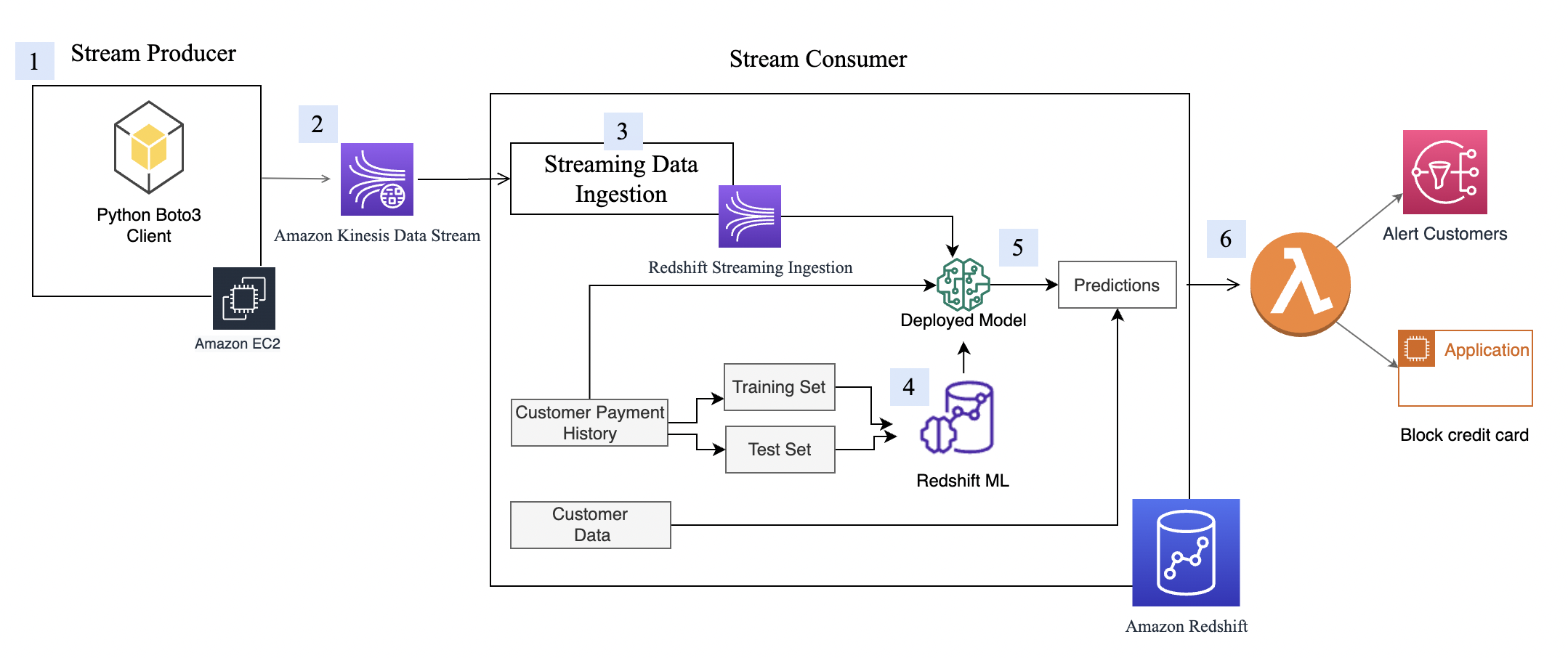

Le diagramme suivant illustre l'architecture et le flux de processus.

Le processus étape par étape est le suivant :

- L'instance EC2 simule une application de transaction par carte de crédit, qui insère des transactions par carte de crédit dans le flux de données Kinesis.

- Le flux de données stocke les données de transaction de carte de crédit entrantes.

- Une vue matérialisée Amazon Redshift Streaming Ingestion est créée au-dessus du flux de données, qui ingère automatiquement les données de streaming dans Amazon Redshift.

- Vous créez, entraînez et déployez un modèle ML à l'aide de Redshift ML. Le modèle Redshift ML est formé à l'aide de données transactionnelles historiques.

- Vous transformez les données de streaming et générez des prédictions ML.

- Vous pouvez alerter les clients ou mettre à jour l'application pour atténuer les risques.

Cette procédure pas à pas utilise les données de streaming des transactions par carte de crédit. Les données de transaction par carte de crédit sont fictives et sont basées sur un simulateur. L'ensemble de données client est également fictif et est généré avec certaines fonctions de données aléatoires.

Pré-requis

- Créer un cluster Amazon Redshift.

- Configurer le cluster pour utiliser Redshift ML.

- Création an Gestion des identités et des accès AWS (IAM) utilisateur.

- Mettez à jour le rôle IAM attaché au cluster Redshift pour inclure les autorisations d'accès au flux de données Kinesis. Pour plus d'informations sur la stratégie requise, reportez-vous à Premiers pas avec l'ingestion de flux.

- Créer une instance EC5.4 m2xlarge. Nous avons testé l'application Producer avec l'instance m5.4xlarge mais vous êtes libre d'utiliser un autre type d'instance. Lors de la création de l'instance, utilisez le amzn2-ami-kernel-5.10-hvm-2.0.20220426.0-x86_64-gp2 SUIS-JE.

- Pour vous assurer que Python3 est installé dans l'instance EC2, exécutez la commande suivante pour vérifier votre version Python (notez que le script d'extraction de données ne fonctionne que sur Python 3) :

- Installez les packages dépendants suivants pour exécuter le programme de simulation :

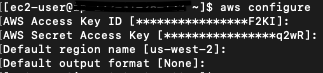

- Configurez Amazon EC2 à l'aide des variables telles que les informations d'identification AWS générées pour l'utilisateur IAM créé à l'étape 3 ci-dessus. La capture d'écran suivante montre un exemple utilisant aws configurer.

Configurer les flux de données Kinesis

Amazon Kinesis Data Streams est un service de diffusion de données en temps réel massivement évolutif et durable. Il peut capturer en continu des gigaoctets de données par seconde à partir de centaines de milliers de sources, telles que les flux de clics de sites Web, les flux d'événements de bases de données, les transactions financières, les flux de médias sociaux, les journaux informatiques et les événements de localisation. Les données collectées sont disponibles en quelques millisecondes pour permettre des cas d'utilisation d'analyse en temps réel tels que des tableaux de bord en temps réel, la détection d'anomalies en temps réel, la tarification dynamique, etc. Nous utilisons Kinesis Data Streams car il s'agit d'une solution sans serveur qui peut évoluer en fonction de l'utilisation.

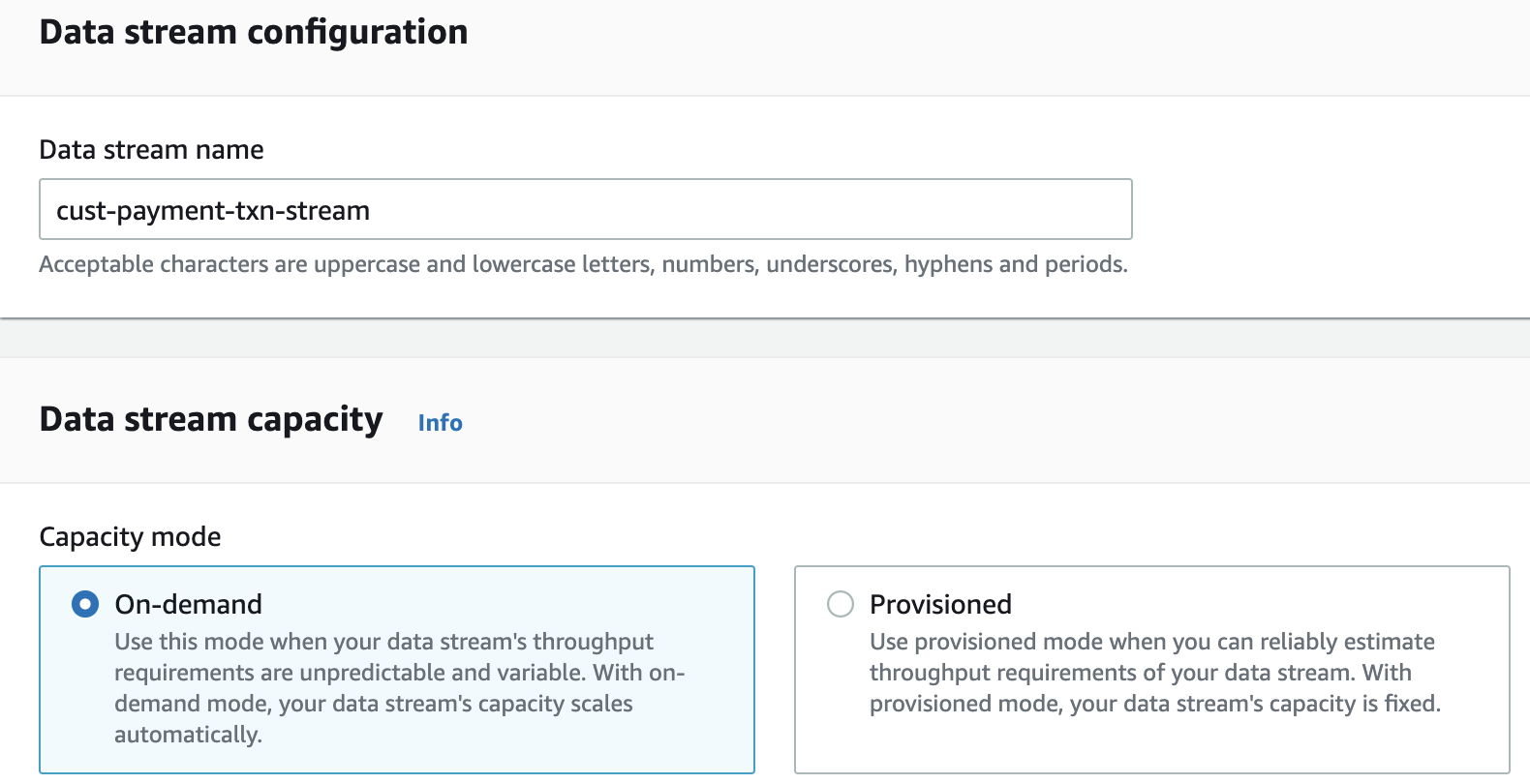

Créer un flux de données Kinesis

Tout d'abord, vous devez créer un flux de données Kinesis pour recevoir les données de streaming :

- Sur la console Amazon Kinesis, choisissez Flux de données dans le volet de navigation.

- Selectionnez Créer un flux de données.

- Pour Nom du flux de données, Entrer

cust-payment-txn-stream. - Pour Mode capacité, sélectionnez À la demande.

- Pour le reste des options, choisissez les options par défaut et suivez les invites pour terminer la configuration.

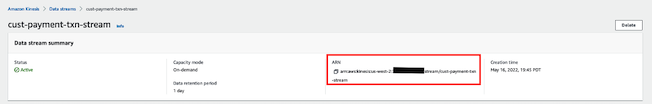

- Capturez l'ARN du flux de données créé à utiliser dans la section suivante lors de la définition de votre stratégie IAM.

Configurer les autorisations

Pour qu'une application de streaming puisse écrire dans Kinesis Data Streams, l'application doit avoir accès à Kinesis. Vous pouvez utiliser la déclaration de stratégie suivante pour accorder au processus de simulation que vous configurez dans la section suivante l'accès au flux de données. Utilisez l'ARN du flux de données que vous avez enregistré à l'étape précédente.

Configurer le producteur de flux

Avant de pouvoir consommer des données de streaming dans Amazon Redshift, nous avons besoin d'une source de données de streaming qui écrit des données dans le flux de données Kinesis. Ce poste utilise un générateur de données personnalisé et le AWS SDK pour Python (Boto3) pour publier les données dans le flux de données. Pour les instructions de configuration, reportez-vous à Simulateur de producteur. Ce processus de simulation publie des données de diffusion dans le flux de données créé à l'étape précédente (cust-payment-txn-stream).

Configurer le consommateur de flux

Cette section traite de la configuration du consommateur de flux (la vue d'ingestion de flux Amazon Redshift).

Amazon Redshift Streaming Ingestion fournit une ingestion à faible latence et à grande vitesse des données de streaming de Kinesis Data Streams dans une vue matérialisée Amazon Redshift. Vous pouvez configurer votre cluster Amazon Redshift pour activer l'ingestion de flux et créer une vue matérialisée avec actualisation automatique, à l'aide d'instructions SQL, comme décrit dans Création de vues matérialisées dans Amazon Redshift. Le processus d'actualisation automatique de la vue matérialisée ingèrera des données de streaming à des centaines de mégaoctets de données par seconde depuis Kinesis Data Streams vers Amazon Redshift. Cela se traduit par un accès rapide aux données externes qui sont rapidement actualisées.

Après avoir créé la vue matérialisée, vous pouvez accéder à vos données à partir du flux de données à l'aide de SQL et simplifier vos pipelines de données en créant des vues matérialisées directement au-dessus du flux.

Effectuez les étapes suivantes pour configurer une vue matérialisée de streaming Amazon Redshift :

- Sur la console IAM, choisissez des stratégies dans le volet de navigation.

- Selectionnez Créer une politique.

- Créez une nouvelle stratégie IAM appelée

KinesisStreamPolicy. Pour la définition de la stratégie de diffusion en continu, consultez Premiers pas avec l'ingestion de flux. - Dans le volet de navigation, choisissez Rôles.

- Choisissez Créer un rôle.

- Sélectionnez Service AWS et choisissez Redshift et Redshift personnalisables.

- Créez un nouveau rôle appelé

redshift-streaming-roleet joignez la politiqueKinesisStreamPolicy. - Créez un schéma externe à mapper sur Kinesis Data Streams :

Vous pouvez maintenant créer une vue matérialisée pour consommer les données de flux. Vous pouvez utiliser le type de données SUPER pour stocker la charge utile telle quelle, au format JSON, ou utiliser les fonctions Amazon Redshift JSON pour analyser les données JSON dans des colonnes individuelles. Pour cet article, nous utilisons la deuxième méthode car le schéma est bien défini.

- Créer la vue matérialisée d'ingestion de flux

cust_payment_tx_stream. En spécifiant AUTO REFRESH YES dans le code suivant, vous pouvez activer l'actualisation automatique de la vue d'ingestion de flux, ce qui permet de gagner du temps en évitant de créer des pipelines de données :

Notez que json_extract_path_text a une limite de longueur de 64 Ko. From_varbye filtre également les enregistrements supérieurs à 65 Ko.

- Actualisez les données.

La vue matérialisée du streaming Amazon Redshift est actualisée automatiquement par Amazon Redshift pour vous. De cette façon, vous n'avez pas à vous soucier de l'obsolescence des données. Avec l'actualisation automatique de la vue matérialisée, les données sont automatiquement chargées dans Amazon Redshift dès qu'elles sont disponibles dans le flux. Si vous choisissez d'effectuer manuellement cette opération, utilisez la commande suivante :

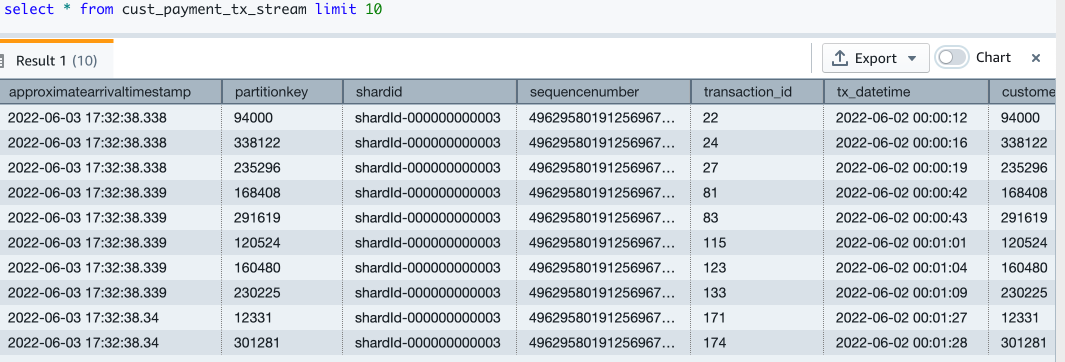

- Interrogeons maintenant la vue matérialisée par flux pour voir des exemples de données :

- Vérifions maintenant le nombre d'enregistrements dans la vue de diffusion :

Vous avez maintenant terminé la configuration de la vue d'ingestion de flux Amazon Redshift, qui est continuellement mise à jour avec les données de transaction de carte de crédit entrantes. Dans ma configuration, je vois qu'environ 67,000 XNUMX enregistrements ont été extraits dans la vue de diffusion au moment où j'ai exécuté ma requête de comptage de sélection. Ce nombre pourrait être différent pour vous.

Décalage vers le rouge ML

Avec Redshift ML, vous pouvez apporter un modèle ML pré-entraîné ou en créer un de manière native. Pour plus d'informations, reportez-vous à Utilisation de l'apprentissage automatique dans Amazon Redshift.

Dans cet article, nous formons et construisons un modèle ML à l'aide d'un ensemble de données historiques. Les données contiennent un tx_fraud champ qui signale une transaction historique comme frauduleuse ou non. Nous construisons un modèle ML supervisé à l'aide de Redshift Auto ML, qui apprend de cet ensemble de données et prédit les transactions entrantes lorsqu'elles sont exécutées via les fonctions de prédiction.

Dans les sections suivantes, nous montrons comment configurer l'ensemble de données historiques et les données client.

Charger le jeu de données historique

La table historique contient plus de champs que la source de données de diffusion en continu. Ces champs contiennent les dépenses les plus récentes du client et le score de risque du terminal, comme le nombre de transactions frauduleuses calculé en transformant les données de streaming. Il existe également des variables catégorielles comme les transactions du week-end ou les transactions de nuit.

Pour charger les données historiques, exécutez les commandes à l'aide de Éditeur de requêtes Amazon Redshift.

Créez la table d'historique des transactions avec le code suivant. Le DDL est également disponible sur GitHub.

Vérifions combien de transactions sont chargées :

Vérifiez la tendance mensuelle des transactions frauduleuses et non frauduleuses :

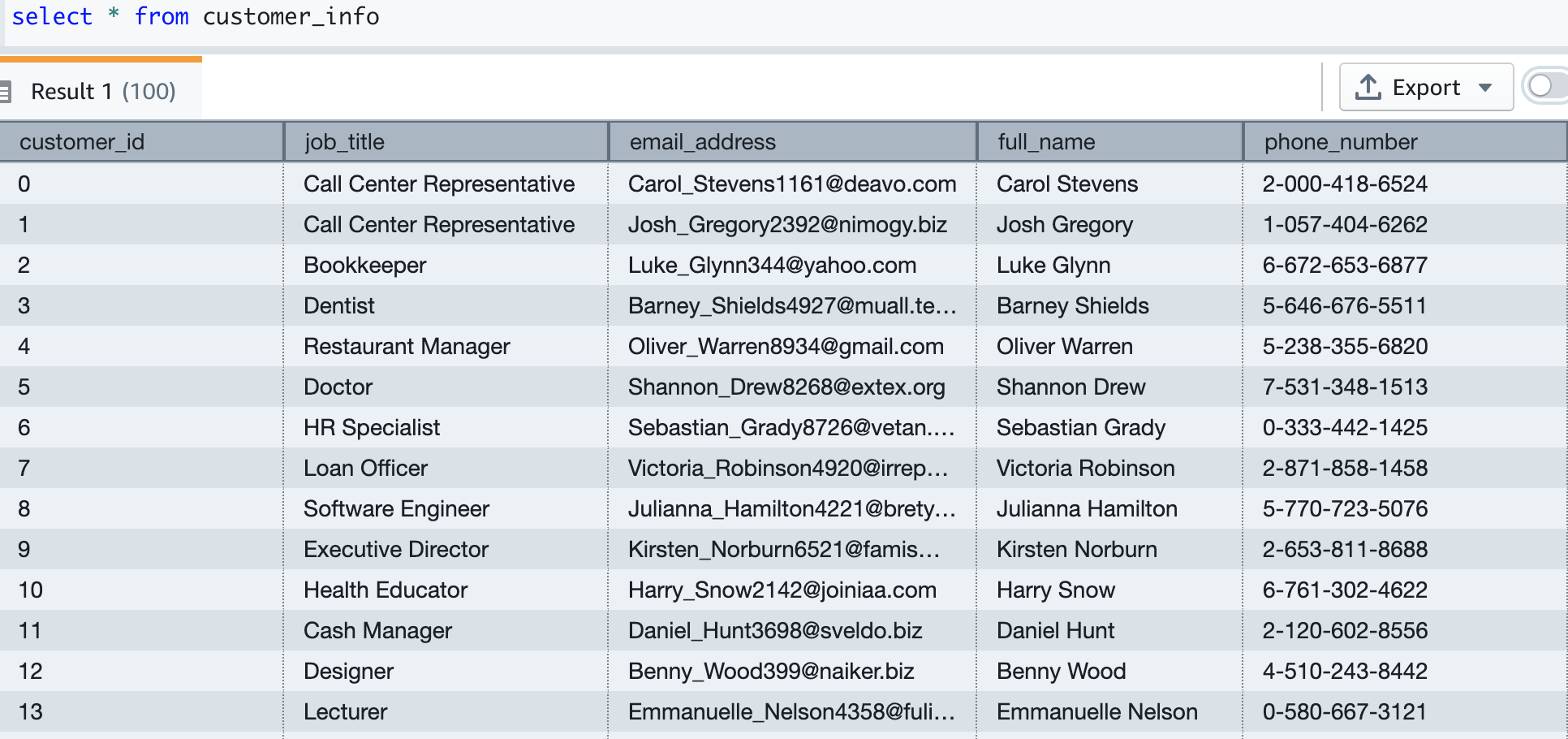

Créer et charger des données client

Maintenant, nous créons la table client et chargeons les données, qui contiennent l'e-mail et le numéro de téléphone du client. Le code suivant crée la table, charge les données et échantillonne la table. La table DDL est disponible sur GitHub.

Nos données de test comptent environ 5,000 XNUMX clients. La capture d'écran suivante montre des exemples de données client.

Construire un modèle ML

Notre tableau historique des transactions par carte contient 6 mois de données, que nous utilisons maintenant pour former et tester le modèle ML.

Le modèle prend les champs suivants en entrée :

On a tx_fraud comme sortie.

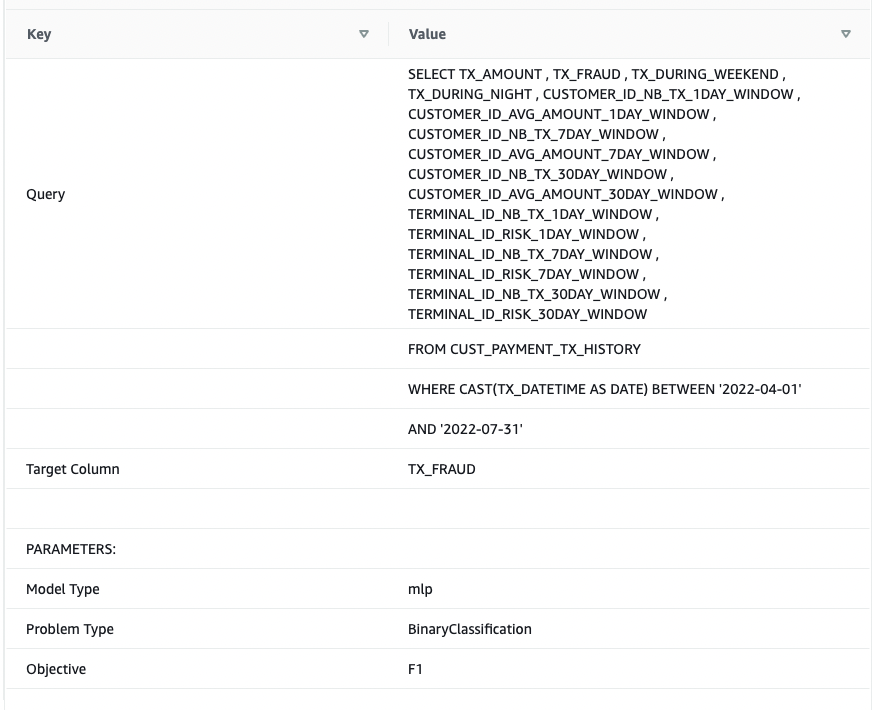

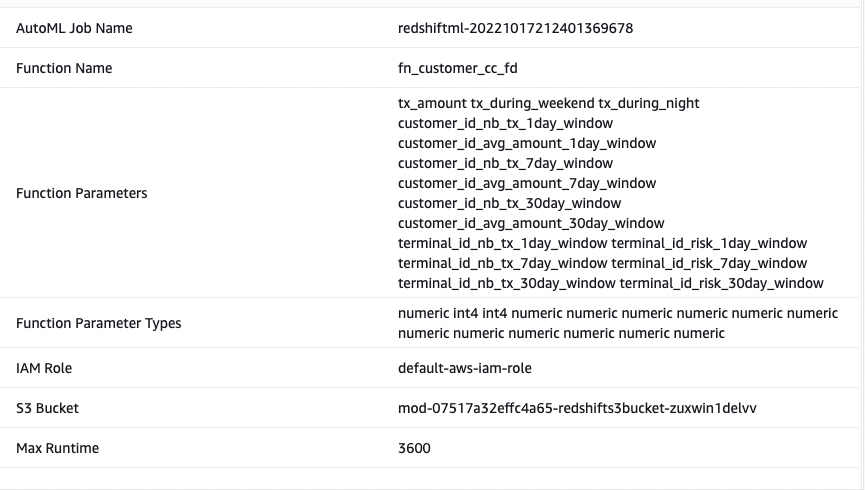

Nous divisons ces données en ensembles de données d'entraînement et de test. Les transactions du 2022-04-01 au 2022-07-31 sont pour l'ensemble de formation. Les transactions du 2022-08-01 au 2022-09-30 sont utilisées pour l'ensemble de test.

Créons le modèle ML en utilisant le SQL familier Instruction CRÉER UN MODÈLE. Nous utilisons une forme de base de la commande Redshift ML. La méthode suivante utilise Pilote automatique Amazon SageMaker, qui effectue automatiquement pour vous la préparation des données, l'ingénierie des fonctionnalités, la sélection des modèles et la formation. Indiquez le nom de votre compartiment S3 contenant le code.

J'appelle le modèle ML comme Cust_cc_txn_fd, et la fonction de prédiction comme fn_customer_cc_fd. La clause FROM affiche les colonnes d'entrée de la table historique public.cust_payment_tx_history. Le paramètre cible est défini sur tx_fraud, qui est la variable cible que nous essayons de prédire. IAM_Role est défini sur la valeur par défaut car le cluster est configuré avec ce rôle ; sinon, vous devez fournir l'ARN du rôle IAM de votre cluster Amazon Redshift. j'ai mis le max_runtime à 3,600 XNUMX secondes, qui est le temps que nous donnons à SageMaker pour terminer le processus. Redshift ML déploie le meilleur modèle identifié dans ce laps de temps.

Selon la complexité du modèle et la quantité de données, la disponibilité du modèle peut prendre un certain temps. Si vous trouvez que votre sélection de modèle n'est pas terminée, augmentez la valeur de max_runtime. Vous pouvez définir une valeur maximale de 9999.

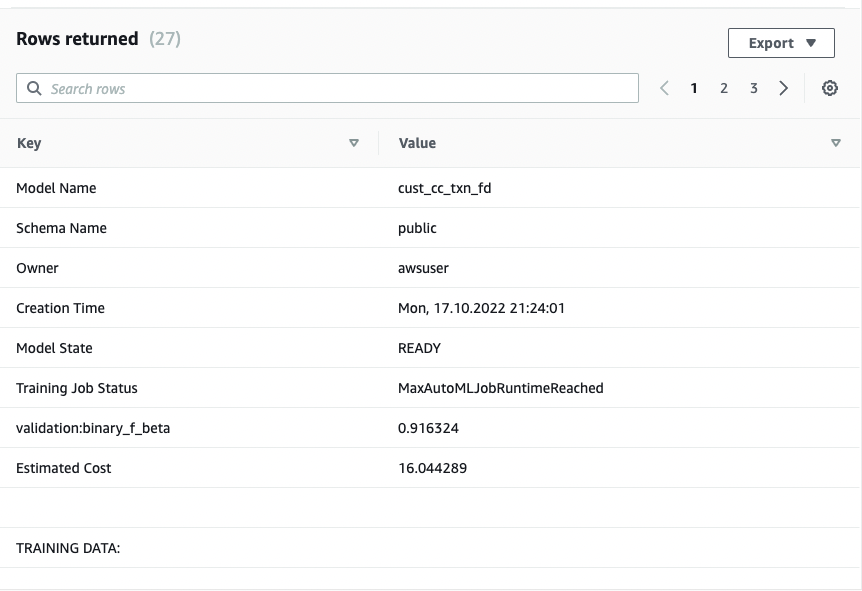

La commande CREATE MODEL est exécutée de manière asynchrone, ce qui signifie qu'elle s'exécute en arrière-plan. Vous pouvez utiliser le MONTRER LE MODÈLE commande pour voir l'état du modèle. Lorsque l'état indique Prêt, cela signifie que le modèle est formé et déployé.

Les captures d'écran suivantes montrent notre sortie.

D'après la sortie, je vois que le modèle a été correctement reconnu comme BinaryClassification, et F1 a été sélectionné comme objectif. Le Score F1 est une métrique qui considère à la fois précision et rappel. Il renvoie une valeur comprise entre 1 (précision et rappel parfaits) et 0 (score le plus bas possible). Dans mon cas, c'est 0.91. Plus la valeur est élevée, meilleures sont les performances du modèle.

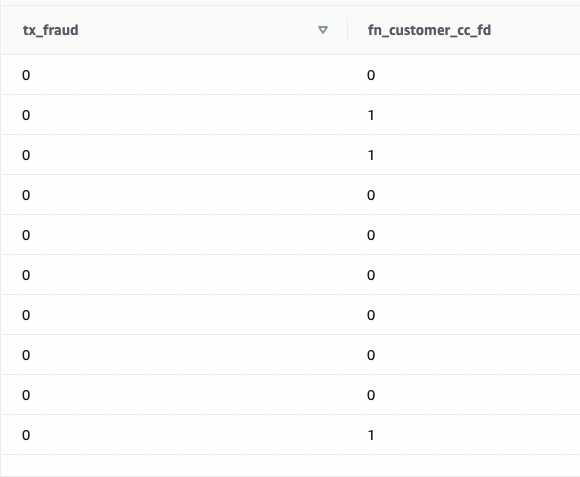

Testons ce modèle avec le jeu de données de test. Exécutez la commande suivante, qui récupère des exemples de prédictions :

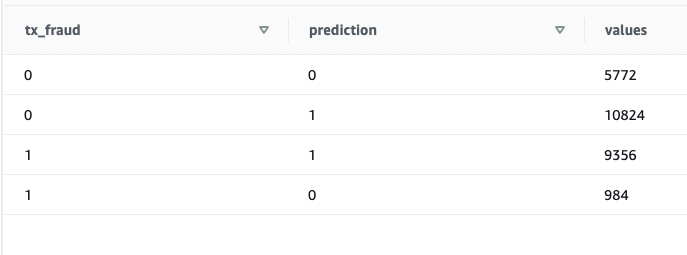

Nous voyons que certaines valeurs correspondent et d'autres non. Comparons les prédictions à la vérité terrain :

Nous avons validé que le modèle fonctionne et que le score F1 est bon. Passons à la génération de prédictions sur les données de streaming.

Anticipez les transactions frauduleuses

Étant donné que le modèle Redshift ML est prêt à l'emploi, nous pouvons l'utiliser pour exécuter les prédictions par rapport à l'ingestion de données en continu. L'ensemble de données historiques a plus de champs que ce que nous avons dans la source de données de streaming, mais ce ne sont que des mesures de récence et de fréquence autour du risque client et terminal pour une transaction frauduleuse.

Nous pouvons très facilement appliquer les transformations au-dessus des données de streaming en intégrant le SQL dans les vues. Créer le première vue, qui agrège les données de streaming au niveau du client. Créez ensuite le deuxième vue, qui agrège les données de streaming au niveau du terminal, et le troisième vue, qui combine les données transactionnelles entrantes avec les données agrégées des clients et des terminaux et appelle la fonction de prédiction en un seul endroit. Le code de la troisième vue est le suivant :

Exécutez une instruction SELECT sur la vue :

Lorsque vous exécutez l'instruction SELECT à plusieurs reprises, les dernières transactions par carte de crédit subissent des transformations et des prédictions ML en temps quasi réel.

Cela démontre la puissance d'Amazon Redshift - avec des commandes SQL faciles à utiliser, vous pouvez transformer les données de streaming en appliquant des fonctions de fenêtre complexes et appliquer un modèle ML pour prédire les transactions frauduleuses en une seule étape, sans créer de pipelines de données complexes ni créer et gérer infrastructures supplémentaires.

Développez la solution

Étant donné que les flux de données entrants et les prédictions ML sont effectuées en temps quasi réel, vous pouvez créer des processus métier pour alerter votre client à l'aide Service de notification simple d'Amazon (Amazon SNS), ou vous pouvez verrouiller le compte de carte de crédit du client dans un système opérationnel.

Cet article n'entre pas dans les détails de ces opérations, mais si vous souhaitez en savoir plus sur la création de solutions basées sur les événements à l'aide d'Amazon Redshift, reportez-vous à ce qui suit GitHub référentiel.

Nettoyer

Pour éviter d'encourir des frais futurs, supprimez les ressources qui ont été créées dans le cadre de cette publication.

Conclusion

Dans cet article, nous avons montré comment configurer un flux de données Kinesis, configurer un producteur et publier des données sur des flux, puis créer une vue Amazon Redshift Streaming Ingestion et interroger les données dans Amazon Redshift. Une fois les données dans le cluster Amazon Redshift, nous avons montré comment former un modèle ML, créer une fonction de prédiction et l'appliquer aux données de streaming pour générer des prédictions en temps quasi réel.

Si vous avez des commentaires ou des questions, veuillez les laisser dans les commentaires.

À propos des auteurs

Bhanu Pittampally est un architecte de solutions spécialisées en analyse basé à Dallas. Il est spécialisé dans la construction de solutions analytiques. Son expérience est dans les entrepôts de données - architecture, développement et administration. Il travaille dans le domaine des données et de l'analyse depuis plus de 15 ans.

Bhanu Pittampally est un architecte de solutions spécialisées en analyse basé à Dallas. Il est spécialisé dans la construction de solutions analytiques. Son expérience est dans les entrepôts de données - architecture, développement et administration. Il travaille dans le domaine des données et de l'analyse depuis plus de 15 ans.

Praveen Kadipikonda est architecte principal de solutions spécialisées dans l'analytique chez AWS, basé à Dallas. Il aide les clients à créer des solutions analytiques efficaces, performantes et évolutives. Il travaille à la création de bases de données et de solutions d'entrepôt de données depuis plus de 15 ans.

Praveen Kadipikonda est architecte principal de solutions spécialisées dans l'analytique chez AWS, basé à Dallas. Il aide les clients à créer des solutions analytiques efficaces, performantes et évolutives. Il travaille à la création de bases de données et de solutions d'entrepôt de données depuis plus de 15 ans.

Ritesh Kumar Sinha est un architecte de solutions spécialisées en analyse basé à San Francisco. Il aide les clients à créer des solutions évolutives d'entreposage de données et de mégadonnées depuis plus de 16 ans. Il aime concevoir et créer des solutions efficaces de bout en bout sur AWS. Dans ses temps libres, il aime lire, marcher et faire du yoga.

Ritesh Kumar Sinha est un architecte de solutions spécialisées en analyse basé à San Francisco. Il aide les clients à créer des solutions évolutives d'entreposage de données et de mégadonnées depuis plus de 16 ans. Il aime concevoir et créer des solutions efficaces de bout en bout sur AWS. Dans ses temps libres, il aime lire, marcher et faire du yoga.

- Contenu propulsé par le référencement et distribution de relations publiques. Soyez amplifié aujourd'hui.

- Platoblockchain. Intelligence métaverse Web3. Connaissance Amplifiée. Accéder ici.

- La source: https://aws.amazon.com/blogs/big-data/near-real-time-fraud-detection-using-amazon-redshift-streaming-ingestion-with-amazon-kinesis-data-streams-and-amazon-redshift-ml/

- 000

- Clients 000

- 1

- 10

- 100

- 11

- 15 ans

- 67

- 7

- 9

- a

- Capable

- Description

- au dessus de

- accès

- Compte

- atteindre

- Action

- Supplémentaire

- administration

- Avancée

- Après

- à opposer à

- Alerte

- Tous

- permet

- Amazon

- Amazon EC2

- Amazon Kinésis

- montant

- Analystes

- Analytique

- analytique

- il analyse

- ainsi que

- Détection d'une anomalie

- Apache

- Candidature

- Appliquer

- Application

- architecture

- autour

- joindre

- auto

- Automatique

- automatiquement

- disponibles

- en évitant

- AWS

- fond

- basé

- Essentiel

- car

- devient

- LES MEILLEURS

- Améliorée

- jusqu'à XNUMX fois

- Big

- Big Data

- apporter

- construire

- Développement

- la performance des entreprises

- processus d'affaires

- entreprises

- Appelez-nous

- appelé

- Appels

- capturer

- carte

- maisons

- cas

- caractère

- des charges

- vérifier

- Selectionnez

- Ville

- le cloud

- Grappe

- code

- Colonnes

- moissonneuses-batteuses

- Venir

- commentaires

- comparer

- complet

- compléter

- complexe

- complexité

- calcul

- considère

- Console

- consommer

- consommateur

- contient

- rentable

- pourriez

- engendrent

- créée

- crée des

- La création

- Lettres de créance

- crédit

- carte de crédit

- des clients

- données client

- Clients

- cycles

- Tous les jours

- Dallas

- données

- Préparation des données

- entrepôt de données

- entrepôts de données

- Base de données

- bases de données

- ensembles de données

- Date

- La prise de décision

- Réglage par défaut

- définir

- livrer

- démontré

- dépendant

- déployer

- déployé

- déploie

- décrit

- Conception

- détails

- Détection

- mobiles

- Développement

- différent

- directement

- Ne fait pas

- faire

- Ne pas

- fenêtre

- Dynamic

- même

- facile à utiliser

- effet

- efficace

- permettre

- permet

- end-to-end

- ENGINEERING

- Entrer

- Ether (ETH)

- événement

- événements

- exemple

- excité

- externe

- extraction

- f1

- familier

- RAPIDE

- Fonctionnalité

- Fonctionnalités:

- Réactions

- champ

- Des champs

- filtres

- la traduction de documents financiers

- Trouvez

- drapeaux

- flux

- suivre

- Abonnement

- suit

- formulaire

- le format

- trouvé

- CADRE

- Francisco

- fraude

- détection de fraude

- Test d'anglais

- La fréquence

- de

- d’étiquettes électroniques entièrement

- fonction

- fonctions

- avenir

- générer

- généré

- générateur

- générateur

- obtenez

- Donner

- Go

- Bien

- subvention

- Sol

- Réservation de groupe

- ayant

- a aidé

- aide

- augmentation

- Souligner

- historique

- Histoire

- Comment

- How To

- HTML

- HTTPS

- Des centaines

- IAM

- identifié

- Active

- importance

- in

- comprendre

- Nouveau

- Améliore

- croissant

- individuel

- d'information

- Infrastructure

- contribution

- Inserts

- idées.

- installer

- instance

- Institut

- Des instructions

- intéressé

- IT

- rejoindre

- json

- kafka

- Flux de données Kinesis

- langue

- plus importantes

- Latence

- Nouveautés

- lancer

- apprentissage

- Laisser

- Longueur

- Niveau

- LIMIT

- limitation

- charge

- charges

- long-term

- Faible

- click

- machine learning

- LES PLANTES

- faire

- FAIT DU

- gérés

- les gérer

- manuellement

- de nombreuses

- Localisation

- massivement

- assorti

- matplotlib

- max

- veux dire

- Médias

- méthode

- métrique

- Métrique

- Réduire les

- ML

- Mode

- modèle

- numériques jumeaux (digital twin models)

- mensuel

- mois

- PLUS

- (en fait, presque toutes)

- Bougez

- prénom

- Navigation

- Besoin

- Besoins

- Nouveauté

- next

- déclaration

- nombre

- numpy

- objectif

- ONE

- ouvre

- opération

- opérationnel

- Opérations

- Opportunités

- Options

- de commander

- organisations

- Autre

- décrit

- Forfaits

- pandas

- pain

- paramètre

- partie

- parfaite

- effectuer

- performant

- effectue

- autorisations

- Téléphone

- Place

- et la planification de votre patrimoine

- plateforme

- Plateformes

- Platon

- Intelligence des données Platon

- PlatonDonnées

- veuillez cliquer

- politiques

- politique

- possible

- Post

- power

- La précision

- prévoir

- prédiction

- Prédictions

- Prévoit

- précédent

- établissement des prix

- processus

- les process

- producteur

- Programme

- fournir

- fournit

- public

- publier

- Python

- fréquemment posées

- vite.

- aléatoire

- en cours

- solutions

- réal

- en temps réel

- données en temps réel à grande vitesse.

- réalisation

- recevoir

- reçu

- récent

- reconnu

- Articles

- À PLUSIEURS REPRISES

- remplacer

- conditions

- ressource

- Ressources

- REST

- Résultats

- Retours

- Analyse

- Rôle

- Courir

- pour le running

- sagemaker

- San

- San Francisco

- évolutive

- Escaliers intérieurs

- screenshots

- Sdk

- seaborn

- Deuxièmement

- secondes

- Section

- les sections

- sécurisé

- choisi

- sélection

- Sans serveur

- service

- set

- mise

- Paramétres

- installation

- assistance technique à court terme

- montrer

- Spectacles

- étapes

- simplifier

- simulateur

- So

- Réseaux sociaux

- réseaux sociaux

- sur mesure

- Solutions

- quelques

- Identifier

- Sources

- spécialiste

- spécialise

- passer

- scission

- SQL

- Étape

- Standard

- j'ai commencé

- Région

- Déclaration

- déclarations

- Statut

- étapes

- Étapes

- storage

- Boutique

- STORES

- Stratégique

- courant

- streaming

- service de diffusion

- flux

- tel

- Super

- combustion propre

- Système

- table

- Prenez

- prend

- Talks

- Target

- terminal

- tester

- La

- Troisièmement

- milliers

- Avec

- fiable

- horodatage

- à

- top

- sujet

- traditionnellement

- Train

- qualifié

- Formation

- transaction

- transactionnel

- Transactions

- Transformer

- transformations

- transformer

- Trend

- Mises à jour

- a actualisé

- Utilisation

- utilisé

- Utilisateur

- validé

- Plus-value

- Valeurs

- divers

- Vérité

- version

- Voir

- vues

- marche

- walkthrough

- Entrepots

- Entreposage

- Site Web

- weekend

- hebdomadaire

- Quoi

- qui

- tout en

- Wikipédia

- sera

- sans

- travaillé

- de travail

- vos contrats

- écrire

- années

- Yoga

- Votre

- zéphyrnet