ما شروع به دیدن مراحل اولیه یک پشته فناوری در هوش مصنوعی مولد (AI) کرده ایم. صدها استارتآپ جدید برای توسعه مدلهای بنیادی، ساخت اپلیکیشنهای مبتنی بر هوش مصنوعی و زیرساختها/ابزارها به سرعت وارد بازار میشوند.

بسیاری از روندهای داغ فناوری خیلی قبل از اینکه بازار به بازار برسد، بیش از حد تبلیغات می شود. اما رونق مولد هوش مصنوعی با دستاوردهای واقعی در بازارهای واقعی و کشش واقعی از سوی شرکت های واقعی همراه بوده است. مدلهایی مانند Stable Diffusion و ChatGPT رکوردهای تاریخی را برای رشد کاربران ثبت میکنند و چندین برنامه کمتر از یک سال پس از راهاندازی به درآمد سالانه ۱۰۰ میلیون دلاری رسیدهاند. مقایسه های کنار هم مدل های هوش مصنوعی را نشان می دهد عملکرد بهتر از انسان ها در برخی از وظایف با مرتبه های قدر متعدد.

بنابراین، داده های اولیه کافی وجود دارد که نشان دهد تحول عظیمی در حال وقوع است. چیزی که ما نمی دانیم و اکنون به سوال مهم تبدیل شده است، این است: ارزش در کجای این بازار افزایش می یابد؟

در طول سال گذشته، ما با دهها موسس و اپراتور استارتآپ در شرکتهای بزرگ که مستقیماً با هوش مصنوعی مولد سروکار دارند، ملاقات کردهایم. ما آن را مشاهده کرده ایم فروشندگان زیرساخت به احتمال زیاد بزرگترین برندگان در این بازار تاکنون هستند و اکثر دلارهایی را که در پشته جریان مییابند به دست آوردهاند. شرکت های کاربردی درآمدهای خط اصلی بسیار سریع در حال رشد هستند، اما اغلب با حفظ، تمایز محصول و حاشیه های ناخالص دست و پنجه نرم می کنند. و بیشتر ارائه دهندگان مدلاگرچه مسئول وجود این بازار است، اما هنوز به مقیاس تجاری بزرگی دست نیافته است.

به عبارت دیگر، شرکتهایی که بیشترین ارزش را ایجاد میکنند - یعنی آموزش مدلهای هوش مصنوعی مولد و استفاده از آنها در برنامههای جدید - بیشتر آن را به دست نیاوردهاند. پیش بینی اینکه چه اتفاقی می افتد بسیار سخت تر است. اما ما فکر می کنیم نکته کلیدی برای درک این است که کدام بخش از پشته واقعاً متمایز و قابل دفاع است. این تأثیر عمده ای بر ساختار بازار (یعنی توسعه افقی در مقابل عمودی شرکت) و محرک های ارزش بلندمدت (مثلاً حاشیه و حفظ) خواهد داشت. تا کنون، برای یافتن قابلیت دفاعی ساختاری با مشکل مواجه بوده ایم هر جا در پشته، خارج از خندق های سنتی برای مدیران فعلی.

ما نسبت به هوش مصنوعی مولد به طرز باورنکردنی خوشبین هستیم و معتقدیم که تأثیر زیادی در صنعت نرمافزار و فراتر از آن خواهد داشت. هدف این پست ترسیم پویایی بازار و پاسخ دادن به سوالات گسترده تر در مورد مدل های کسب و کار هوش مصنوعی مولد است.

پشته فناوری سطح بالا: زیرساخت، مدلها و برنامهها

برای درک چگونگی شکل گیری بازار مولد هوش مصنوعی، ابتدا باید تعریف کنیم که پشته امروز چگونه به نظر می رسد. در اینجا دیدگاه اولیه ما است.

پشته را می توان به سه لایه تقسیم کرد:

- اپلیکیشنها که مدلهای هوش مصنوعی مولد را در یک محصول رو به رو کاربر ادغام میکنند، یا خطوط لوله مدل خود را اجرا میکنند («برنامههای انتها به انتها») یا با تکیه بر یک API شخص ثالث

- مدل که محصولات هوش مصنوعی را تقویت می کند، که یا به عنوان API های اختصاصی یا به عنوان نقاط بازرسی منبع باز (که به نوبه خود نیاز به راه حل میزبانی دارند) در دسترس هستند.

- شالوده فروشندگان (یعنی پلتفرم های ابری و سازندگان سخت افزار) که بارهای آموزشی و استنتاجی را برای مدل های هوش مصنوعی مولد اجرا می کنند.

مهم است که توجه داشته باشید: این یک نقشه بازار نیست، بلکه چارچوبی برای تجزیه و تحلیل بازار است. در هر دسته، چند نمونه از فروشندگان معروف را فهرست کرده ایم. ما هیچ تلاشی نکردهایم که جامع باشیم یا تمام برنامههای کاربردی شگفتانگیز هوش مصنوعی مولد منتشر شده را فهرست کنیم. ما همچنین در اینجا به ابزارهای Mlops یا LLMops که هنوز کاملاً استاندارد نشده است و در یک پست آینده به آن پرداخته خواهد شد، نمی پردازیم.

موج اول برنامههای هوش مصنوعی تولیدی در حال گسترش هستند، اما با حفظ و تمایز مبارزه میکنند.

در چرخههای فناوری قبلی، عقل مرسوم این بود که برای ایجاد یک شرکت بزرگ و مستقل، باید مالک مشتری نهایی باشید - چه به معنای مصرفکنندگان فردی باشد یا خریداران B2B. وسوسه انگیز است که باور کنیم بزرگترین شرکت های هوش مصنوعی مولد نیز اپلیکیشن های کاربر نهایی خواهند بود. تا اینجای کار مشخص نیست که اینطور باشد.

مطمئناً، رشد برنامههای کاربردی هوش مصنوعی حیرتانگیز بوده است که به دلیل تازگی محض و موارد استفاده فراوان بوده است. در واقع، ما از حداقل سه دسته محصول که قبلاً از 100 میلیون دلار درآمد سالانه فراتر رفته اند، آگاهیم: تولید تصویر، کپی رایتینگ و کدنویسی.

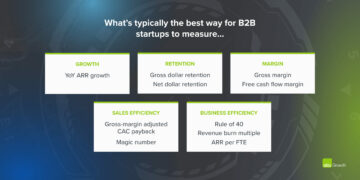

با این حال، رشد به تنهایی برای ایجاد شرکت های نرم افزاری بادوام کافی نیست. به طور بحرانی، رشد باید سودآور باشد - به این معنا که کاربران و مشتریان، پس از ثبت نام، سود ایجاد می کنند (حاشیه ناخالص بالا) و برای مدت طولانی (حفظ بالا) باقی می مانند. در غیاب تمایز فنی قوی، برنامههای B2B و B2C ارزش بلندمدت مشتری را از طریق اثرات شبکه، نگهداشتن دادهها یا ایجاد جریانهای کاری پیچیدهتر افزایش میدهند.

در هوش مصنوعی مولد، این فرضیات لزوما درست نیستند. در میان شرکتهای برنامهای که با آنها صحبت کردهایم، طیف گستردهای از حاشیههای ناخالص وجود دارد - در موارد معدودی تا 90 درصد اما اغلب به 50-60 درصد، عمدتاً ناشی از هزینه استنتاج مدل است. رشد بالای قیف شگفتانگیز بوده است، اما مشخص نیست که آیا استراتژیهای جذب مشتری فعلی مقیاسپذیر خواهند بود یا خیر - ما در حال حاضر شاهد کاهش کارآمدی جذب پولی و حفظ آن هستیم. بسیاری از برنامهها نیز نسبتاً متمایز نیستند، زیرا بر مدلهای مشابه زیربنایی هوش مصنوعی تکیه میکنند و اثرات شبکه آشکار یا دادهها/جریانهای کاری را که تکرار آن برای رقبا دشوار است، کشف نکردهاند.

بنابراین، هنوز مشخص نیست که فروش اپلیکیشنهای کاربر نهایی تنها یا حتی بهترین راه برای ایجاد یک کسبوکار مولد هوش مصنوعی پایدار است. با افزایش رقابت و کارایی در مدلهای زبان، حاشیهها باید بهبود یابد (در زیر در این مورد بیشتر توضیح میدهیم). با خروج گردشگران هوش مصنوعی از بازار، نگهداری باید افزایش یابد. و یک استدلال قوی وجود دارد که برنامه های یکپارچه عمودی مزیتی در ایجاد تمایز دارند. اما هنوز چیزهای زیادی برای اثبات وجود دارد.

با نگاهی به آینده، برخی از سوالات بزرگی که شرکتهای اپلیکیشنهای هوش مصنوعی با آن مواجه هستند عبارتند از:

- ادغام عمودی ("مدل + برنامه"). استفاده از مدلهای هوش مصنوعی بهعنوان یک سرویس به توسعهدهندگان اپلیکیشن این امکان را میدهد تا به سرعت با یک تیم کوچک تکرار کنند و با پیشرفت فناوری، ارائهدهندگان مدلها را تعویض کنند. در طرف مقابل، برخی از توسعه دهندگان استدلال می کنند که محصول is این مدل، و اینکه آموزش از ابتدا تنها راه ایجاد قابلیت دفاع است - یعنی با آموزش مجدد مداوم بر روی داده های محصول اختصاصی. اما این به قیمت نیاز سرمایه بسیار بالاتر و تیم محصول کمتر زیرک است.

- ویژگی های ساختمان در مقابل برنامه ها محصولات هوش مصنوعی مولد اشکال مختلفی دارند: برنامه های دسکتاپ، برنامه های موبایل، پلاگین های Figma/Photoshop، افزونه های کروم، حتی ربات های Discord. ادغام محصولات هوش مصنوعی در جایی که کاربران قبلاً کار می کنند آسان است، زیرا رابط کاربری معمولاً فقط یک جعبه متن است. کدام یک از این شرکتها به شرکتهای مستقل تبدیل میشوند - و کدام یک توسط شرکتهایی مانند مایکروسافت یا گوگل که قبلاً هوش مصنوعی را در خطوط تولید خود گنجاندهاند جذب میشوند؟

- مدیریت از طریق چرخه هایپ. هنوز مشخص نیست که آیا ریزش در دسته فعلی محصولات هوش مصنوعی مولد ذاتی است یا اینکه مصنوع از یک بازار اولیه است. یا اگر افزایش علاقه به هوش مصنوعی مولد با کاهش هیاهو کاهش یابد. این پرسشها پیامدهای مهمی برای شرکتهای اپلیکیشن دارد، از جمله اینکه چه زمانی باید روی پدال گاز برای جمعآوری سرمایه ضربه بزنید. چگونه تهاجمی در جذب مشتری سرمایه گذاری کنیم. کدام بخش های کاربر را اولویت بندی کنیم. و زمان اعلام تناسب محصول با بازار

ارائه دهندگان مدل هوش مصنوعی مولد را اختراع کردند، اما به مقیاس تجاری بزرگ نرسیده اند

چیزی که ما اکنون آن را هوش مصنوعی مولد مینامیم، بدون تحقیقات و کارهای مهندسی درخشانی که در مکانهایی مانند Google، OpenAI و Stability انجام شده بود، وجود نداشت. از طریق معماریهای مدل جدید و تلاشهای قهرمانانه برای مقیاسبندی خطوط لوله آموزشی، همه ما از قابلیتهای شگفتانگیز مدلهای زبان بزرگ فعلی (LLM) و مدلهای تولید تصویر بهره میبریم.

با این حال، درآمد مرتبط با این شرکت ها در مقایسه با استفاده و هجوم هنوز نسبتاً ناچیز است. در تولید تصویر، Stable Diffusion شاهد رشد انفجاری جامعه بوده است که توسط اکوسیستمی از رابط های کاربری، پیشنهادات میزبانی شده و روش های تنظیم دقیق پشتیبانی می شود. اما Stability پست های بازرسی اصلی خود را به صورت رایگان به عنوان اصل اصلی کسب و کارشان می دهد. در مدلهای زبان طبیعی، OpenAI با GPT-3/3.5 و ChatGPT غالب است. ولی نسبتا تعداد کمی از برنامه های قاتل ساخته شده بر روی OpenAI تاکنون وجود داشته است و قیمت ها نیز قبلاً وجود داشته است یک بار سقوط کرد.

این ممکن است فقط یک پدیده موقتی باشد. Stability شرکت جدیدی است که هنوز روی کسب درآمد تمرکز نکرده است. OpenAI این پتانسیل را دارد که به یک تجارت عظیم تبدیل شود و بخش قابل توجهی از درآمدهای دسته NLP را با ساخت اپلیکیشن های قاتل بیشتر به دست آورد - به خصوص اگر آنها ادغام در سبد محصولات مایکروسافت به آرامی پیش می رود با توجه به استفاده زیاد از این مدلها، درآمدهای کلان ممکن است دور از دسترس نباشد.

اما نیروهای متقابل نیز وجود دارد. مدلهایی که بهعنوان منبع باز منتشر میشوند میتوانند توسط هر کسی میزبانی شوند، از جمله شرکتهای خارجی که هزینههای مربوط به آموزش مدل در مقیاس بزرگ (تا دهها یا صدها میلیون دلار) را متقبل نمیشوند. و مشخص نیست که آیا هر مدل منبع بسته می تواند لبه خود را به طور نامحدود حفظ کند یا خیر. به عنوان مثال، ما شروع به دیدن LLM های ساخته شده توسط شرکت هایی مانند Anthropic، Cohere، و Character.ai کرده ایم که به سطوح عملکرد OpenAI نزدیک تر می شوند که بر روی مجموعه داده های مشابه (یعنی اینترنت) و با معماری های مدل مشابه آموزش دیده اند. مثال انتشار پایدار نشان می دهد که if مدلهای منبع باز به سطح کافی از عملکرد و پشتیبانی جامعه میرسند، سپس جایگزینهای اختصاصی ممکن است برای رقابت سخت باشند.

شاید واضح ترین نکته برای ارائه دهندگان مدل، تا کنون، این باشد که تجاری سازی احتمالاً به میزبانی گره خورده است. تقاضا برای APIهای اختصاصی (به عنوان مثال از OpenAI) به سرعت در حال رشد است. خدمات میزبانی برای مدل های منبع باز (مانند Hugging Face و Replicate) به عنوان هاب های مفیدی برای به اشتراک گذاری و ادغام آسان مدل ها در حال ظهور هستند - و حتی برخی اثرات غیرمستقیم شبکه بین تولید کنندگان و مصرف کنندگان مدل دارند. همچنین یک فرضیه قوی وجود دارد مبنی بر اینکه امکان کسب درآمد از طریق تنظیم دقیق و قراردادهای میزبانی با مشتریان سازمانی وجود دارد.

با این حال، فراتر از آن، تعدادی سؤال بزرگ پیش روی ارائه دهندگان مدل وجود دارد:

- کالایی شدن یک باور رایج وجود دارد که مدلهای هوش مصنوعی در طول زمان از نظر عملکرد همگرا میشوند. با صحبت با توسعه دهندگان برنامه، واضح است که هنوز این اتفاق نیفتاده است، با رهبران قوی در هر دو مدل متن و تصویر. مزایای آنها بر اساس معماری مدل منحصر به فرد نیست، بلکه بر اساس نیازهای سرمایه بالا، داده های تعامل محصول اختصاصی و استعداد کمیاب هوش مصنوعی است. آیا این به عنوان یک مزیت بادوام عمل می کند؟

- ریسک فارغ التحصیلی تکیه بر ارائه دهندگان مدل یک راه عالی برای شرکت های برنامه برای شروع و حتی رشد کسب و کارشان است. اما انگیزه ای برای آنها وجود دارد که پس از رسیدن به مقیاس، مدل های خود را بسازند و/یا میزبانی کنند. و بسیاری از ارائه دهندگان مدل دارای توزیع بسیار ناهنجار مشتری هستند، با چند برنامه که بیشتر درآمد را نشان می دهد. چه اتفاقی می افتد اگر/وقتی این مشتریان به توسعه هوش مصنوعی داخلی روی آورند؟

- آیا پول مهم است؟ وعده هوش مصنوعی مولد آنقدر بزرگ است - و همچنین به طور بالقوه بسیار مضر - که بسیاری از ارائه دهندگان مدل به عنوان شرکتهای منافع عمومی (B corps) سازماندهی کردهاند، سهام سود محدودی منتشر کردهاند، یا خیر عمومی را به صراحت در مأموریت خود گنجاندهاند. این به هیچ وجه مانع تلاش آنها برای جمع آوری کمک نشده است. اما بحث منطقی در مورد اینکه آیا اکثر ارائه دهندگان مدل واقعاً وجود دارد می خواهم برای گرفتن ارزش، و اگر آنها باید.

فروشندگان زیرساخت همه چیز را لمس می کنند و از پاداش آن بهره می برند

تقریباً همه چیز در هوش مصنوعی مولد در نقطهای از یک GPU (یا TPU) میزبان ابر عبور میکند. چه برای ارائه دهندگان مدل / آزمایشگاههای تحقیقاتی که بارهای آموزشی را اجرا میکنند، شرکتهای میزبانی که استنتاج/تنظیم دقیق را انجام میدهند، یا شرکتهای برنامهای که ترکیبی از هر دو را انجام میدهند – فلاپ رگ حیات هوش مصنوعی مولد هستند. برای اولین بار در یک زمان بسیار طولانی، پیشرفت در مخرب ترین فناوری محاسباتی به طور گسترده محدود به محاسبات است.

در نتیجه، پول زیادی در بازار مولد هوش مصنوعی در نهایت به شرکتهای زیرساخت سرازیر میشود. برای گذاشتن مقداری بسیار اعداد تقریبی پیرامون آن: ما تخمین می زنیم که به طور متوسط، شرکت های اپلیکیشن حدود 20 تا 40 درصد درآمد را صرف استنباط و تنظیم دقیق هر مشتری می کنند. این معمولاً مستقیماً به ارائه دهندگان ابری برای نمونه های محاسباتی یا به ارائه دهندگان مدل های شخص ثالث پرداخت می شود - که به نوبه خود حدود نیمی از درآمد خود را در زیرساخت های ابری خرج می کنند. بنابراین، منطقی است که حدس بزنیم که 10-20٪ از درآمد کل در هوش مصنوعی مولد امروز به ارائه دهندگان ابری می رود.

علاوه بر این، استارتآپهایی که مدلهای خود را آموزش میدهند، میلیاردها دلار سرمایهگذاری مخاطرهآمیز جمعآوری کردهاند - که اکثریت آن (تا 80 تا 90 درصد در دورهای اولیه) معمولاً با ارائهدهندگان ابری نیز خرج میشود. بسیاری از شرکتهای فناوری عمومی، سالانه صدها میلیون برای آموزش مدلها صرف میکنند، چه با ارائهدهندگان ابری خارجی یا مستقیماً با تولیدکنندگان سختافزار.

این همان چیزی است که ما در اصطلاح فنی، "پول زیاد" می نامیم - به ویژه برای یک بازار نوپا. بیشتر آن در بزرگ 3 ابرها: خدمات وب آمازون (AWS)، پلتفرم ابری گوگل (GCP) و مایکروسافت آژور. این ارائه دهندگان ابر به طور جمعی بیش از $ 100 میلیارد در سال برای اطمینان از اینکه جامع ترین، قابل اعتمادترین و مقرون به صرفه ترین پلتفرم ها را دارند. مخصوصاً در هوش مصنوعی مولد، از محدودیتهای عرضه نیز بهره میبرند زیرا دسترسی ترجیحی به سختافزار کمیاب دارند (مانند پردازندههای گرافیکی Nvidia A100 و H100).

با این حال، جالب است که ما شاهد ظهور رقابت معتبر هستیم. چالشبرانگیزانی مانند اوراکل با هزینههای کلان و مشوقهای فروش پیشروی کردهاند. و چند استارتآپ، مانند Coreweave و Lambda Labs، با راهحلهایی که بهطور خاص برای توسعهدهندگان مدلهای بزرگ هدفگذاری شدهاند، به سرعت رشد کردهاند. آنها بر سر هزینه، در دسترس بودن و پشتیبانی شخصی رقابت می کنند. آنها همچنین انتزاعات منابع دانه ای بیشتری را نشان می دهند (یعنی کانتینرها)، در حالی که ابرهای بزرگ تنها نمونه های VM را به دلیل محدودیت های مجازی سازی GPU ارائه می دهند.

پشت صحنه، اجرای اکثریت قریب به اتفاق بارهای کاری هوش مصنوعی، شاید بزرگترین برنده در هوش مصنوعی مولد تا کنون باشد: Nvidia. شرکت 3.8 دلار گزارش شده است بیلیون درآمد GPU مرکز داده در سه ماهه سوم سال مالی 2023, شامل بخش معنیداری برای موارد استفاده مولد هوش مصنوعی. و آنها از طریق چندین دهه سرمایه گذاری در معماری GPU، یک اکوسیستم نرم افزاری قوی و استفاده عمیق در جامعه دانشگاهی، خندق های قوی در اطراف این تجارت ایجاد کرده اند. یک تحلیل اخیر دریافت که پردازندههای گرافیکی انویدیا در مقالات تحقیقاتی 90 برابر بیشتر از مجموع برترین استارتآپهای تراشههای هوش مصنوعی ذکر شده است..

گزینه های سخت افزاری دیگری از جمله واحدهای پردازش تنسور Google (TPU) وجود دارد. پردازندههای گرافیکی AMD Instinct؛ تراشه های AWS Inferentia و Trainium؛ و شتاب دهنده های هوش مصنوعی از استارتاپ هایی مانند Cerebras، Sambanova و Graphcore. اینتل که در اواخر بازی وارد بازار شده است، با تراشههای پیشرفته Habana و پردازندههای گرافیکی Ponte Vecchio وارد بازار میشود. اما تاکنون تعداد کمی از این تراشه های جدید سهم قابل توجهی از بازار را به خود اختصاص داده اند. دو استثنایی که باید تماشا کرد گوگل است که TPU های آن در جامعه Stable Diffusion و در برخی معاملات بزرگ GCP مورد توجه قرار گرفته اند و TSMC که گمان می رود تولید کننده باشد. تمام از تراشههای ذکر شده در اینجا، از جمله پردازندههای گرافیکی Nvidia (اینتل از ترکیبی از محصولات خود و TSMC برای ساخت تراشههای خود استفاده میکند).

به عبارت دیگر، زیرساخت یک لایه سودآور، بادوام و به ظاهر قابل دفاع در پشته است. سوالات بزرگی که باید برای شرکت های زیرساخت پاسخ داد عبارتند از:

- نگه داشتن بار کاری بدون تابعیت پردازندههای گرافیکی انویدیا هر کجا که آنها را اجاره میکنید یکسان هستند. بیشتر بارهای کاری هوش مصنوعی بدون حالت هستند، به این معنا که استنتاج مدل نیازی به پایگاههای داده یا ذخیرهسازی پیوست شده (به غیر از وزنهای خود مدل) ندارد. این به این معنی است که بارهای کاری هوش مصنوعی ممکن است در میان ابرها قابل حمل تر از بارهای کاری برنامه های سنتی باشد. در این زمینه، چگونه ارائه دهندگان ابری می توانند چسبندگی ایجاد کنند و از پرش مشتریان به ارزان ترین گزینه جلوگیری کنند؟

- زنده ماندن از پایان کمبود تراشه. قیمت گذاری برای ارائه دهندگان ابر و برای خود انویدیا، توسط منابع کمیاب از مطلوب ترین GPU ها پشتیبانی شده است. یکی از ارائه دهندگان به ما گفت که لیست قیمت A100s در واقع وجود دارد افزایش از زمان راه اندازی، که برای سخت افزار محاسباتی بسیار غیرمعمول است. هنگامی که این محدودیت عرضه در نهایت از طریق افزایش تولید و/یا پذیرش پلتفرمهای سختافزاری جدید برداشته میشود، این چه تاثیری بر ارائهدهندگان ابری خواهد داشت؟

- آیا یک ابر رقیب می تواند نفوذ کند؟ ما به آن معتقدیم ابرهای عمودی با ارائه های تخصصی تر، سهم بازار را از Big 3 خواهد گرفت. تاکنون در هوش مصنوعی، رقبا از طریق تمایز فنی متوسط و پشتیبانی از Nvidia، کشش معنیداری را به دست آوردهاند – که برای آنها ارائهدهندگان ابر فعلی هم بزرگترین مشتریان و هم رقبای نوظهور هستند. سوال بلندمدت این است که آیا این برای غلبه بر مزایای مقیاس بزرگ 3 کافی است؟

بنابراین ... ارزش کجا تعلق می گیرد؟

البته ما هنوز نمی دانیم. اما بر اساس داده های اولیه ای که برای هوش مصنوعی مولد داریم، ترکیب شده با تجربه ما با شرکت های قبلی AI/ML، شهود ما به شرح زیر است.

امروزه به نظر نمی رسد که هیچ خندق سیستمی در هوش مصنوعی مولد وجود داشته باشد. به عنوان یک تقریب مرتبه اول، برنامه های کاربردی فاقد تمایز محصول قوی هستند زیرا از مدل های مشابه استفاده می کنند. مدلها با تمایز طولانیمدت نامشخصی روبرو هستند زیرا بر روی مجموعه دادههای مشابه با معماریهای مشابه آموزش دیدهاند. ارائه دهندگان ابری فاقد تمایز فنی عمیق هستند زیرا از همان GPU استفاده می کنند. و حتی شرکت های سخت افزاری تراشه های خود را در همان کارخانه ها تولید می کنند.

البته، خندقهای استاندارد وجود دارد: خندقهای مقیاس ("من بیشتر از شما پول دارم یا میتوانم پول جمع کنم!")، خندقهای زنجیره تامین ("من پردازندههای گرافیکی دارم، شما ندارید!")، خندقهای اکوسیستمی (" همه از نرم افزار من در حال حاضر استفاده می کنند!»)، خندق های الگوریتمی («ما از شما باهوش تر هستیم!»)، خندق های توزیع («من در حال حاضر یک تیم فروش دارم و مشتریان بیشتری از شما دارم!») و خندق های خط لوله داده («من» بیشتر از شما در اینترنت خزیدم!»). اما هیچ یک از این خندق ها در دراز مدت دوام ندارند. و هنوز خیلی زود است که بگوییم آیا تأثیرات قوی و مستقیم شبکه در هر لایه ای از پشته وجود دارد یا خیر.

بر اساس داده های موجود، مشخص نیست که آیا در هوش مصنوعی مولد پویایی بلندمدت و همه چیز برنده خواهد بود یا خیر.

این عجیب است. اما برای ما، خبر خوبی است. اندازه بالقوه این بازار به سختی قابل درک است - جایی بین تمام نرم افزارها و تمام تلاش های بشر - بنابراین ما انتظار داریم بازیکنان بسیار زیادی و رقابت سالم در تمام سطوح پشته وجود داشته باشد. ما همچنین انتظار داریم که شرکت های افقی و عمودی با بهترین رویکردی که توسط بازارهای نهایی و کاربران نهایی دیکته می شود، موفق شوند. به عنوان مثال، اگر تمایز اولیه در محصول نهایی خود هوش مصنوعی باشد، این احتمال وجود دارد که عمودیسازی (یعنی اتصال محکم برنامه رو به روی کاربر به مدل خانگی) برنده شود. در حالی که اگر هوش مصنوعی بخشی از مجموعه ویژگی های بزرگتر و دم بلندتر باشد، احتمال افقی شدن آن بیشتر است. البته، ما همچنین باید شاهد ساخت خندق های سنتی تر در طول زمان باشیم - و حتی ممکن است شاهد شکل گیری انواع جدیدی از خندق ها باشیم.

به هر حال، یک چیزی که ما در مورد آن مطمئن هستیم این است که هوش مصنوعی مولد بازی را تغییر می دهد. همه ما در حال یادگیری قوانین در زمان واقعی هستیم، مقدار زیادی ارزش وجود دارد که قفل آن باز می شود، و در نتیجه چشم انداز فناوری بسیار متفاوت به نظر می رسد. و ما برای آن اینجا هستیم!

تمام تصاویر این پست با استفاده از Midjourney ایجاد شده اند.

- محتوای مبتنی بر SEO و توزیع روابط عمومی. امروز تقویت شوید.

- پلاتوبلاک چین. Web3 Metaverse Intelligence. دانش تقویت شده دسترسی به اینجا.

- منبع: https://a16z.com/2023/01/19/who-owns-the-generative-ai-platform/

- 100 میلیون دلار

- $3

- 1

- a

- A100

- درباره ما

- دانشگاهی

- شتاب دهنده ها

- دسترسی

- دست

- اکتساب

- در میان

- واقعا

- اتخاذ

- پیشرفت

- مزیت - فایده - سود - منفعت

- مزایای

- پس از

- موافقت نامه

- پیش

- AI

- پلتفرم هوش مصنوعی

- موارد استفاده ai

- AI / ML

- الگوریتمی

- معرفی

- اجازه می دهد تا

- تنها

- قبلا

- جایگزین

- شگفت انگیز

- آمازون

- آمازون خدمات وب

- خدمات وب آمازون (AWS)

- AMD

- مقدار

- تحلیل

- و

- سالانه

- پاسخ

- هر کس

- رابط های برنامه کاربردی

- نرم افزار

- ظاهر شدن

- کاربرد

- برنامه های کاربردی

- با استفاده از

- روش

- برنامه های

- معماری

- استدلال

- استدلال

- دور و بر

- مصنوعی

- هوش مصنوعی

- هوش مصنوعی (AI)

- مرتبط است

- دسترس پذیری

- در دسترس

- میانگین

- AWS

- استنتاج AWS

- لاجوردی

- B2B

- B2C

- مستقر

- خرس

- زیرا

- شدن

- قبل از

- پشت سر

- باور

- باور

- اعتقاد بر این

- مؤمنان

- در زیر

- سود

- بهترین

- میان

- خارج از

- بزرگ

- بزرگترین

- بیلیون

- میلیاردها

- رونق

- رباتها

- بسته

- جعبه

- شکستن

- درخشان

- گسترده تر

- ساختن

- بنا

- ساخته

- سرسخت کله شق

- کسب و کار

- کسب و کار

- خریداران

- صدا

- قابلیت های

- سرمایه

- گرفتن

- ضبط

- مورد

- موارد

- دسته

- دسته بندی

- مرکز

- معین

- رقیب

- تبادل

- شخصیت

- GPT چت

- ارزان ترین

- تراشه

- چیپس

- کروم

- اشاره

- واضح

- نزدیک

- ابر

- زیرساخت های ابری

- بستر ابری

- رمز

- مجموعا

- ترکیب

- ترکیب شده

- بیا

- تجاری

- تجاری سازی

- مشترک

- انجمن

- شرکت

- شرکت

- مقایسه

- رقابت

- رقابت

- رقبای

- پیچیده

- جامع

- محاسبه

- محاسبه

- محدودیت ها

- مصرف کنندگان

- ظروف

- زمینه

- به طور مستمر

- معمولی

- همگرا

- copywriting است

- هسته

- شرکت ها

- هزینه

- هزینه

- دوره

- ایجاد

- ایجاد شده

- ایجاد

- قابل اعتماد

- بحرانی

- جاری

- مشتری

- مشتریان

- چرخه

- داده ها

- مرکز داده

- پایگاه های داده

- مجموعه داده ها

- مقدار

- معاملات

- دهه

- عمیق

- تقاضا

- دسکتاپ

- توسعه

- توسعه دهندگان

- پروژه

- سازندگان

- مختلف

- اشکال مختلف

- متفاوت است

- انتشار

- مستقیم

- مستقیما

- اختلاف

- کشف

- گفتگو

- نفاق افکن

- توزیع

- توزیع

- تقسیم شده

- عمل

- دلار

- غالب است

- آیا

- ده ها

- راندن

- رانده

- درایور

- رانندگی

- پویا

- دینامیک

- هر

- پیش از آن

- در اوایل

- سود

- به آسانی

- اکوسیستم

- لبه

- اثرات

- بهره وری

- تلاش

- هر دو

- سنگ سنباده

- مهندسی

- کافی

- اطمینان حاصل شود

- سرمایه گذاری

- مشتریان سازمانی

- به خصوص

- تخمین زدن

- حتی

- در نهایت

- همه چیز

- مثال

- مثال ها

- انتظار

- تجربه

- ضمیمهها

- خارجی

- چهره

- نما

- سقوط

- ویژگی

- امکانات

- کمی از

- پیدا کردن

- پیدا کردن

- نام خانوادگی

- بار اول

- مالی

- مناسب

- فلیپ

- در حال جریان

- جریانها

- متمرکز شده است

- پیروی

- نیروهای

- اشکال

- یافت

- پایه

- بنیانگذاران

- چارچوب

- رایگان

- از جانب

- جمع آوری کمک

- آینده

- عایدات

- بازی

- GAS

- عموما

- تولید می کنند

- نسل

- مولد

- هوش مصنوعی مولد

- دریافت کنید

- داده

- می دهد

- هدف

- می رود

- رفتن

- خوب

- گوگل

- Google Cloud

- Google Cloud Platform

- GPU

- GPU ها

- فهم

- بزرگ

- درشت

- شدن

- در حال رشد

- رشد کرد

- رشد

- نیم

- رخ دادن

- اتفاق افتاده است

- اتفاق می افتد

- سخت

- سخت افزار

- مضر

- سالم

- اینجا کلیک نمایید

- زیاد

- بالاتر

- خیلی

- تاریخی

- اصابت

- نگه داشتن

- برگزاری

- افقی

- میزبان

- میزبانی

- میزبانی وب

- HOT

- چگونه

- HTTPS

- بزرگ

- انسان

- صدها نفر

- صدها میلیون

- هیپ

- تصویر

- تولید تصویر

- تصاویر

- تأثیر

- پیامدهای

- مهم

- بهبود

- in

- در دیگر

- انگیزه

- انگیزه

- شامل

- از جمله

- ادغام شده

- گنجاندن

- افزایش

- افزایش

- افزایش

- به طور فزاینده

- بطور باور نکردنی

- مسوول

- مستقل

- فرد

- صنعت

- شالوده

- ذاتی

- ادغام

- یکپارچه

- ادغام

- اینتل

- اطلاعات

- اثر متقابل

- علاقه

- رابط

- اینترنت

- شهود

- اختراع

- سرمایه گذاری

- سرمایه گذاری

- صادر

- IT

- خود

- کلید

- دانستن

- آزمایشگاه

- عدم

- چشم انداز

- زبان

- بزرگ

- در مقیاس بزرگ

- تا حد زیادی

- بزرگتر

- نام

- پارسال

- دیر

- راه اندازی

- لایه

- لایه

- رهبران

- یادگیری

- ترک کردن

- سطح

- سطح

- احتمالا

- محدودیت

- خطوط

- فهرست

- ذکر شده

- طولانی

- مدت زمان طولانی

- دراز مدت

- نگاه کنيد

- مطالب

- خیلی

- کم

- نافع

- ساخته

- حفظ

- عمده

- اکثریت

- ساخت

- تولید کنندگان

- بسیاری

- نقشه

- حاشیه

- بازار

- نقشه بازار

- ساختار بازار

- بازارها

- عظیم

- انبوه

- حداکثر عرض

- معنی دار

- به معنی

- روش

- مایکروسافت

- مایکروسافت لاورو

- میانه سفر

- میلیون

- میلیون ها نفر

- ماموریت

- MLO ها

- موبایل

- تلفن همراه برنامه های

- مدل

- مدل

- کسب درآمد

- کسب درآمد

- پول

- بیش

- اکثر

- چندگانه

- نوظهور

- طبیعی

- زبان طبیعی

- لزوما

- نیاز

- شبکه

- جدید

- سخت افزار جدید

- اخبار

- بعد

- زیرک

- nlp

- رمان

- تازگی

- عدد

- تعداد

- کارت گرافیک Nvidia

- واضح

- ارائه

- پیشنهادات

- ONE

- باز کن

- منبع باز

- OpenAI

- اپراتور

- گزینه

- گزینه

- وحی

- سفارشات

- سازمان یافته

- دیگر

- در غیر این صورت

- خارج از

- غلبه بر

- خود

- مالک است

- پرداخت

- اوراق

- بخش

- ویژه

- بخش

- عبور می کند

- مسیر

- کارایی

- شاید

- شخصی

- پدیده

- خط لوله

- محل

- اماکن

- سکو

- سیستم عامل

- افلاطون

- هوش داده افلاطون

- PlatoData

- بازیکنان

- کثیف

- پلاگین ها

- نقطه

- ممکن

- پست

- پتانسیل

- بالقوه

- قدرت

- پیش بینی

- جلوگیری از

- قیمت

- قیمت

- اصلی

- قبلا

- اولویت بندی

- در حال پردازش

- تولید

- محصول

- تولید

- محصولات

- سود

- مفید

- منافع

- پیشرفت

- وعده

- اختصاصی

- ثابت كردن

- ارائه دهنده

- ارائه دهندگان

- عمومی

- قرار دادن

- یک چهارم

- سوال

- سوالات

- به سرعت

- بالا بردن

- مطرح شده

- محدوده

- سریعا

- رسیدن به

- رسیده

- واقعی

- زمان واقعی

- معقول

- اخیر

- سوابق

- نسبتا

- منتشر شد

- قابل اعتماد

- حذف شده

- اجاره

- نمایندگی

- نیاز

- مورد نیاز

- تحقیق

- منابع

- مسئوليت

- نتیجه

- نگهداری

- درامد

- درآمد

- خطر

- تنومند

- دور

- قوانین

- دویدن

- در حال اجرا

- حراجی

- مشوق های فروش

- همان

- مقیاس پذیر

- مقیاس

- کمیاب

- کمبود

- صحنه های

- مشاهده

- بخش ها

- فروش

- حس

- خدمت

- سرویس

- خدمات

- تنظیم

- محیط

- چند

- شکل

- اشتراک گذاری

- سهام

- باید

- نشان

- امضاء

- قابل توجه

- مشابه

- پس از

- اندازه

- کوچک

- به نرمی

- So

- تا حالا

- نرم افزار

- راه حل

- مزایا

- برخی از

- یک جایی

- منبع

- تخصصی

- به طور خاص

- خرج کردن

- صرف

- ثبات

- پایدار

- پشته

- مراحل

- ایستادن

- مستقل

- استاندارد

- شروع

- آغاز شده

- راه افتادن

- شروع

- نوپا

- چوب

- هنوز

- ذخیره سازی

- استراتژی ها

- قوی

- ساختاری

- ساختار

- مبارزه

- موفق شدن

- کافی

- حاکی از

- عرضه

- پشتیبانی

- پشتیبانی

- افزایش

- قابل تحمل

- گزینه

- سیستمیک

- گرفتن

- مصرف

- استعداد

- سخنگو

- هدف قرار

- وظایف

- تیم

- فن آوری

- شرکت های فن آوری

- فنی

- پیشرفته

- موقت

- قوانین و مقررات

- La

- شان

- خودشان

- چیز

- سوم

- شخص ثالث

- سه

- از طریق

- گره خورده است

- محکم

- زمان

- بار

- به

- امروز

- هم

- بالا

- لمس

- کشش

- سنتی

- آموزش دیده

- آموزش

- دگرگونی

- عظیم

- روند

- درست

- tsmc

- دور زدن

- انواع

- به طور معمول

- ui

- در نهایت

- اساسی

- فهمیدن

- منحصر به فرد

- واحد

- غیر معمول

- us

- استفاده

- استفاده کنید

- کاربر

- کاربران

- ارزش

- وسیع

- فروشندگان

- ریسک

- سرمایه گذاری

- از طريق

- چشم انداز

- تماشا کردن

- موج

- وب

- خدمات وب

- معروف

- چی

- چه

- که

- در حین

- WHO

- وسیع

- دامنه گسترده

- ویکیپدیا

- اراده

- پیروزی

- برندگان

- خرد

- بدون

- کلمات

- مهاجرت کاری

- گردش کار

- نوشته

- سال

- زفیرنت