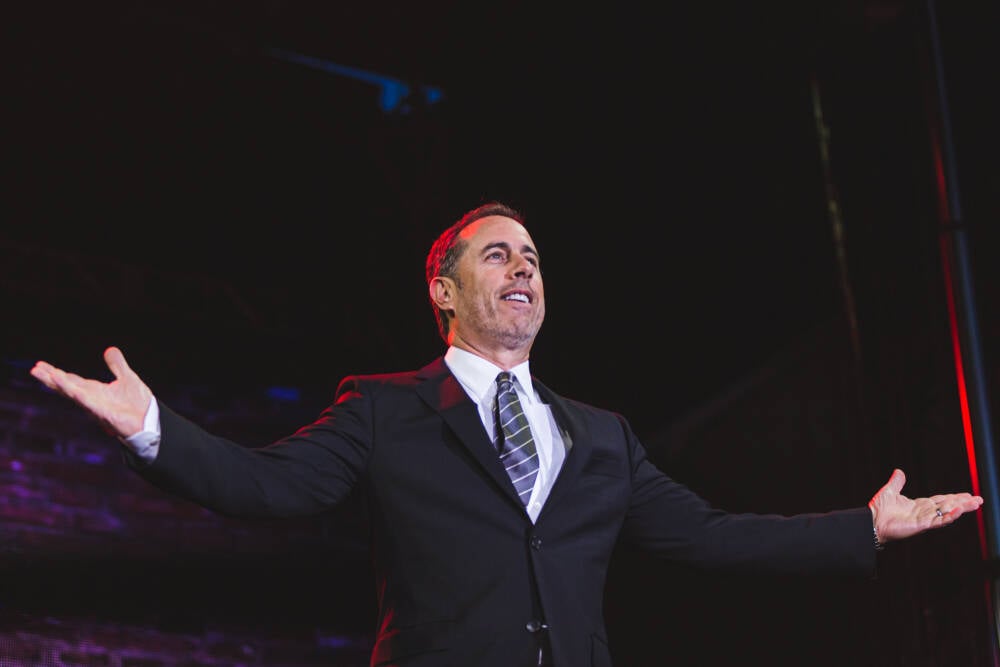

تصویری The Seinfeld spoof Nothing, Forever – یک کمدی کمدی که با استفاده از هوش مصنوعی تولید شده است – به دلیل اینکه یکی از شخصیت ها به طور تصادفی ناسزاهای ترنس هراسی را منتشر کرد، به طور موقت در توییچ ممنوع شد.

نمایش عجیب و غریب تیتر ساخته شده هفته گذشته به دلیل استفاده از هوش مصنوعی برای بداهه سازی تصاویر و فیلمنامه یک قسمت بی پایان از Seinfeld. در هنر تقلید کمدی، کمدی کمدی 30 راک پیش بینی چیزی شبیه به این بیش از 15 سال پیش.

شخصیتها که از شخصیتهای سریال کمدی نمادین جری، جورج، الین و کرامر الگوبرداری شدهاند، دیالوگی کاملا ساختهشده با استفاده از مدلهای زبان GPT-3 OpenAI را بیان میکنند. متن با استفاده از الگوریتمهای تبدیل متن به گفتار به صدا ترجمه میشود و پسزمینهها و صحنهها نیز با هوش مصنوعی تولید میشوند. Nothing، Forever در توییچ 24/7 پخش شد و از زمانی که پخش آن در دسامبر سال گذشته شروع شد، طرفداران زیادی را جذب کرده است.

اما کانال میزبانی برنامه در روز دوشنبه به دلیل حذف شد نقض کردن خطمشیهای محتوای توییچ اسکایلر هارتل، یکی از بنیانگذاران Mismatch Media و یکی از سازندگان Nothing, Forever، به ثبت نام این ممنوعیت به این دلیل صادر شد که شخصیت اصلی، لری فاینبرگ، اظهارات توهین آمیزی کرد و گفت که تراجنسیتی ها در حال خراب کردن ساختار جامعه هستند، ترنسجندر بودن یک بیماری روانی است، و اینکه «همه لیبرال ها مخفیانه همجنس گرا هستند».

در ادامه می توانید صحنه بد استندآپ را تماشا کنید.

هارتل گفت که فیلمنامه نمایش زمانی از مسیر منحرف شد که سازندگان آن از استفاده از مدل Davinci مدل GPT-3 OpenAI به نسخه کمتر قدرتمندتر و ارزانتر به نام Curie روی آوردند و از ویژگیهای نرمافزاری برای تعدیل محتوای آن استفاده نکردند.

ما شب گذشته مشکلی را در ارتباط با داوینچی تجربه کردیم و مجبور شدیم به مدل کوری تغییر دهیم در حالی که این مشکل خود به خود حل شد. این زمانی بود که متن نامناسب تولید شد و ما بلافاصله آن را خاموش کردیم. ما این موضوع را بیشتر بررسی کردیم و متوجه شدیم که از ابزارهای تعدیل محتوای OpenAI به درستی استفاده نمیکنیم.» او به ما گفت.

هارتل تایید کرد که این ممنوعیت موقتی است و باید 14 روز طول بکشد. Mismatch Media اکنون در حال کار بر روی استفاده از ابزارهای تعدیل محتوای OpenAI است و همچنین در حال بررسی یک سیستم ثانویه برای ردیابی خروجی های مدل است.

«متنی که ما ایجاد کردیم یک اشتباه بود، ما بسیار خجالت میکشیم، و محتوای مولد ایجاد شده به هیچ وجه ارزشها یا نظرات کارکنان ما را منعکس نمیکند. ما بسیار متأسفیم که این اتفاق افتاد و امیدواریم که به زودی به روی آنتن برگردیم، با تمام اقدامات حفاظتی مناسب.»

مدلهای زبان بزرگ مانند GPT-3 از متنی که از اینترنت خراشیده شده است آموزش داده میشود و میتواند زبان نامناسب و توهینآمیز ایجاد کند. فیلترهای محتوا میتوانند بدترین متن را به حداقل برسانند، اما گزیدهها حتی با وجود محافظها همچنان به صورت مخفیانه وارد میشوند.

سخنگوی توییچ فرستاد ثبت نام دستورالعمل های جامعه شرکت در برخورد با رفتار نفرت انگیز، و گفت:

«ما به دلایل حفظ حریم خصوصی در مورد نقضهای خاص اظهار نظر نمیکنیم، اما زمانی که شواهدی در دست داشته باشیم که کانالی دستورالعملهای انجمن یا شرایط خدمات ما را نقض کرده است، اقدامات لازم را انجام میدهیم.» ®

- محتوای مبتنی بر SEO و توزیع روابط عمومی. امروز تقویت شوید.

- پلاتوبلاک چین. Web3 Metaverse Intelligence. دانش تقویت شده دسترسی به اینجا.

- منبع: https://go.theregister.com/feed/www.theregister.com/2023/02/07/twitch_ai_seinfeld/

- سال 15

- a

- عمل

- پس از

- AI

- AIR

- الگوریتم

- معرفی

- و

- مناسب

- هنر

- مجذوب

- سمعی

- به عقب

- پس زمینه

- بد

- بان کی مون

- توقیف شده

- ممنوعیت

- پشت سر

- بودن

- در زیر

- کانال

- شخصیت

- کاراکتر

- ارزان تر

- بنیانگذاران

- کمدی

- توضیح

- نظرات

- انجمن

- شرکت

- به طور کامل

- رفتار

- تایید شده

- ارتباط

- با توجه به

- محتوا

- تعدیل محتوا

- ایجاد شده

- سازندگان

- روز

- معامله

- دسامبر

- گسترش

- توسعه

- گفتگو

- DID

- کشف

- پایین

- اتر (ETH)

- حتی

- مدرک

- با تجربه

- پارچه

- امکانات

- Feinberg

- فیلترها برای تصفیه آب

- برای همیشه

- از جانب

- بیشتر

- تولید می کنند

- تولید

- مولد

- هوش مصنوعی مولد

- جورج

- دستورالعمل ها

- اتفاق افتاده است

- امید

- میزبانی وب

- HTTPS

- یاد

- بیماری

- بلافاصله

- انجام

- in

- اینترنت

- موضوع

- صادر

- IT

- خود

- برچسب

- زبان

- نام

- پارسال

- بهره برداری

- ساخته

- اصلی

- ساخت

- بسیاری

- رسانه ها

- روانی

- بیماری روانی

- اشتباه

- مدل

- مدل

- اعتدال

- دوشنبه

- تحت عنوان

- شب

- توهین آمیز

- ONE

- OpenAI

- دیدگاه ها

- مردم

- محل

- افلاطون

- هوش داده افلاطون

- PlatoData

- سیاست

- قوی

- خلوت

- دلایل

- بازتاب می دهد

- پشیمانی

- مصمم

- سنگ

- سعید

- صحنه

- صحنه های

- ثانوی

- سلسله

- سرویس

- باید

- نشان

- پس از

- دزدکی حرکت کردن

- جامعه

- نرم افزار

- چیزی

- بزودی

- خاص

- سخنگوی

- کارکنان

- آغاز شده

- هنوز

- جریان

- فوق العاده

- گزینه

- روشن

- سیستم

- گرفتن

- موقت

- قوانین و مقررات

- شرایط استفاده از خدمات

- تبدیل متن به گفتار

- La

- از طریق

- به

- هم

- ابزار

- مسیر

- آموزش دیده

- جنسیت

- انقباض

- us

- ارزشها

- نسخه

- نقض

- نقض

- تماشا کردن

- هفته

- در حین

- ویکیپدیا

- اراده

- کارگر

- بدترین

- سال

- سال

- زفیرنت