1گروه مکانیک مهندسی، دانشگاه Tsinghua، 100084 پکن، چین

2گروه آمار و علوم داده، دانشگاه پنسیلوانیا

3مرکز مرزهای مطالعات محاسباتی، دانشگاه پکن، 100871 پکن، چین

4دانشکده علوم کامپیوتر، دانشگاه پکن، 100871 پکن، چین

این مقاله را جالب می دانید یا می خواهید بحث کنید؟ SciRate را ذکر کنید یا در SciRate نظر بدهید.

چکیده

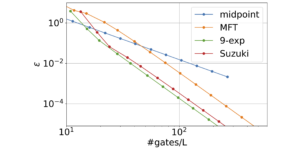

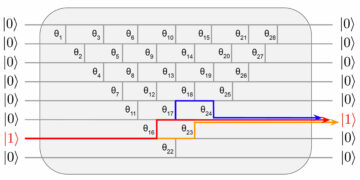

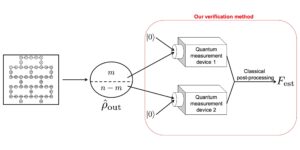

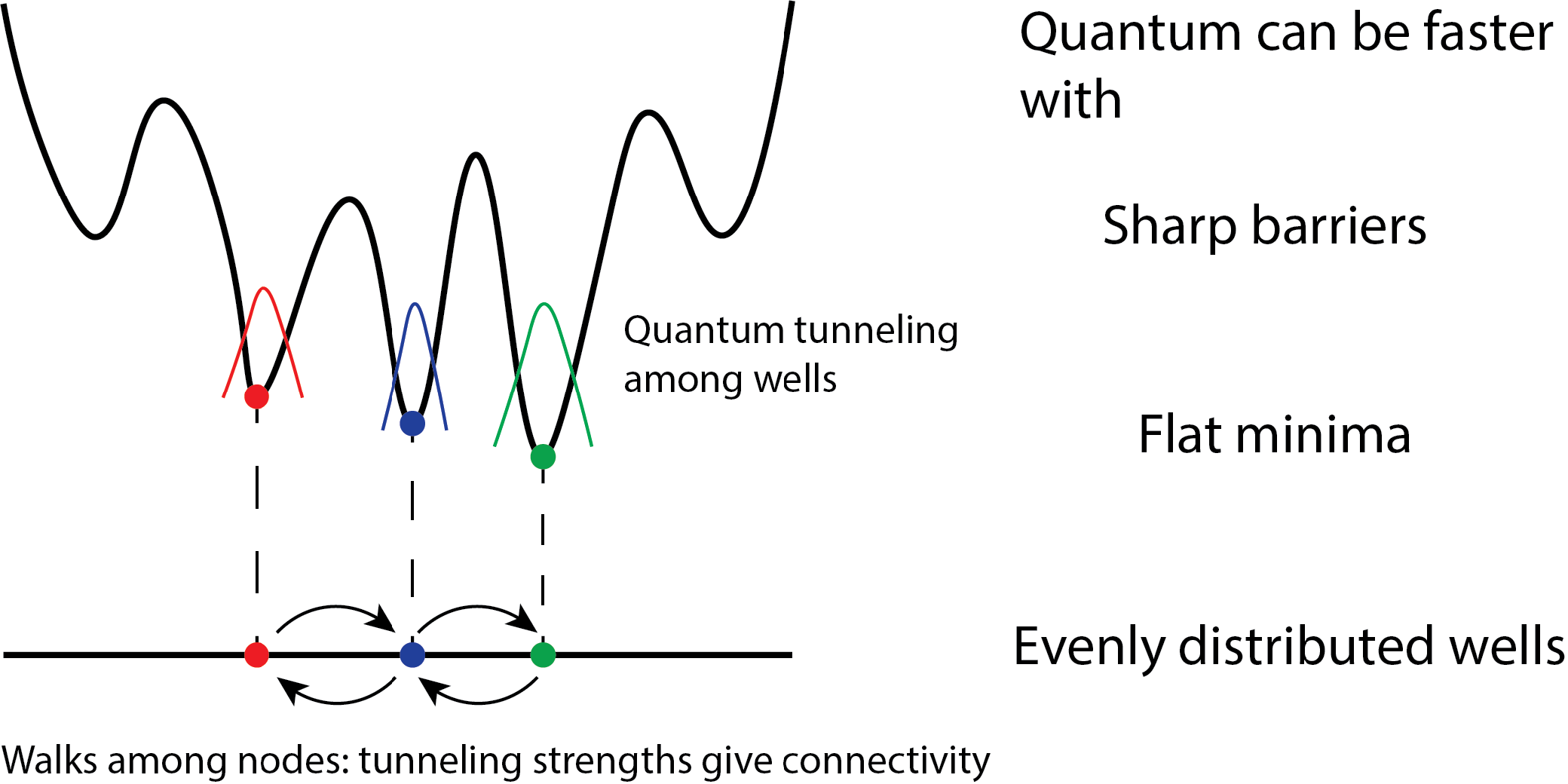

الگوریتمهای کلاسیک اغلب برای حل مسائل بهینهسازی غیرمحدب که در آن حداقلهای محلی با موانع زیاد جدا شدهاند، مؤثر نیستند. در این مقاله، ما سرعتهای کوانتومی ممکن را برای بهینهسازی غیرمحدب با استفاده از اثر $global$ تونلزنی کوانتومی بررسی میکنیم. به طور خاص، ما یک الگوریتم کوانتومی به نام پیادهروی تونلزنی کوانتومی (QTW) معرفی میکنیم و آن را برای مسائل غیر محدب که در آن حداقلهای محلی تقریباً حداقلهای جهانی هستند، اعمال میکنیم. ما نشان میدهیم که QTW به سرعت کوانتومی بیش از نزولهای گرادیان تصادفی کلاسیک (SGD) دست مییابد که موانع بین حداقلهای محلی مختلف زیاد اما نازک هستند و حداقلها مسطح هستند. بر اساس این مشاهدات، ما یک چشمانداز دو چاهی خاص میسازیم، که در آن الگوریتمهای کلاسیک نمیتوانند به خوبی به یک هدف ضربه بزنند، اما QTW زمانی که حالتهای اولیه مناسب در نزدیکی چاه شناخته شده داده میشود، میتواند. در نهایت، ما یافته های خود را با آزمایش های عددی تأیید می کنیم.

[محتوای جاسازی شده]

خلاصه محبوب

► داده های BibTeX

◄ مراجع

[1] زیوان آلن ژو و یوانژی لی. Neon2: یافتن حداقل های محلی از طریق اوراکل های مرتبه اول. در Advances in Neural Information Processing Systems، صفحات 3716–3726، 2018. URL http://papers.neurips.cc/paper/7629-neon2-finding-local-minima-via-first-order-oracles. pdf. arXiv:1711.06673.

arXiv: 1711.06673

http://papers.neurips.cc/paper/7629-neon2-finding-local-minima-via-first-order-oracles.pdf

[2] Animashree Anandkumar، Rong Ge، Daniel Hsu، Sham M Kakade و Matus Telgarsky. تجزیه تانسور برای یادگیری مدل های متغیر پنهان مجله تحقیقات یادگیری ماشین، 15: 2773-2832، 2014. URL https://jmlr.org/papers/volume15/anandkumar14b/. arXiv:1210.7559v4.

ARXIV: 1210.7559v4

https://jmlr.org/papers/volume15/anandkumar14b/

[3] بن اندروز و جولی کلاترباک. اثبات حدس شکاف اساسی. مجله انجمن ریاضی آمریکا، 24 (3): 899–916، 2011. ISSN 08940347, 10886834. URL http://www.jstor.org/stable/23072145. arXiv:1006.1686.

arXiv: 1006.1686

http://www.jstor.org/stable/23072145

[4] جوران ون آپلدورن و آندراس گیلین. بهبود در حل کوانتومی SDP با برنامه ها. در مجموعه مقالات چهل و ششمین کنفرانس بین المللی اتومات، زبان ها و برنامه نویسی، جلد 46 مجموعه مقالات بین المللی لایب نیتس در انفورماتیک (LIPIcs)، صفحات 132:99-1:99. Schloss Dagstuhl–Leibniz-Zentrum fuer Informatik, 15. 2019/LIPIcs.ICALP.10.4230. arXiv:2019.99.

https://doi.org/10.4230/LIPIcs.ICALP.2019.99

arXiv: 1804.05058

[5] جوران ون آپلدورن، آندراس گیلین، ساندر گریبلینگ و رونالد دی ولف. حل کننده های کوانتومی SDP: کران های بالا و پایین بهتر. در مجموعه مقالات پنجاه و هشتمین سمپوزیوم سالانه مبانی علوم کامپیوتر. IEEE، 58. 2017/FOCS.10.1109. arXiv:2017.44.

https://doi.org/10.1109/FOCS.2017.44

arXiv: 1705.01843

[6] جوران ون آپلدورن، آندراس گیلین، ساندر گریبلینگ و رونالد دی ولف. بهینه سازی محدب با استفاده از اوراکل های کوانتومی Quantum, 4: 220, 2020. 10.22331/q-2020-01-13-220. arXiv:1809.00643.

https://doi.org/10.22331/q-2020-01-13-220

arXiv: 1809.00643

[7] فرانک آروت، کونال آریا، رایان بابوش، دیو بیکن، جوزف سی باردین، رامی بارندز، سرجیو بویکسو، مایکل بروتون، باب بی. باکلی، دیوید آ. بوئل، برایان بورکت، نیکلاس بوشنل، یو چن، زیجون چن، بنجامین کیارو روبرتو کالینز، ویلیام کورتنی، شان دمورا، اندرو دانسورث، ادوارد فرهی، آستین فاولر، بروکس فاکسن، کریگ گیدنی، ماریسا جوستینا، راب گراف، استیو هابگر، متیو پی هریگان، آلن هو، سابرینا هونگ، ترنت هوانگ، ویلیام جی هاگینز، لو آیوف، سرگئی وی. ایزاکوف، ایوان جفری، ژانگ جیانگ، کودی جونز، دویر کافری، کوستیانتین کچجی، جولیان کلی، سون کیم، پل وی. لیندمارک، اریک لوسرو، اوریون مارتین، جان ام. مارتینیس، جارود آر. مککلین، مت مک ایون، آنتونی مگرنت، شیائو می، مسعود محسنی، وویسیک مرچکیویچ، جاش موتوس، اوفر نامان، متیو نیلی، چارلز نیل، هارتموت نیون، نیو، توماس ای. اوبراین، اریک اوستبی، آندره پتوخوف، هارالد پوترمن، کریس کوینتانا، پدرام روشن، نیکلاس سی روبین، دانیل سانک، کوین جی ساتزینگر، وادیم اسملیانسکی، داگ استرین، کوین جی سانگ، مارکو زالای ، تایلر وای تاکشیتا، آمیت واینسنچر، تئودور وایت، ناتان ویبه، زی جیمی یائو، پینگ یه و آدام زالکمن. Hartree-Fock روی یک کامپیوتر کوانتومی کیوبیت ابررسانا. Science, 369 (6507): 1084-1089, 2020. 10.1126/science.abb9811. نشانی اینترنتی https://science.sciencemag.org/content/369/6507/1084.abstract. arXiv:2004.04174.

https://doi.org/10.1126/science.abb9811

arXiv: 2004.04174

https://science.sciencemag.org/content/369/6507/1084.abstract

[8] یوسی آتیا و شانتاناو چاکرابورتی. مرزهای بالایی بهبود یافته برای زمان برخورد پیاده روی کوانتومی. بررسی فیزیکی A, 104: 032215, Sep 2021. ISSN 2469-9934. 10.1103/physreva.104.032215. نشانی اینترنتی http://dx.doi.org/10.1103/PhysRevA.104.032215. arXiv:2005.04062v5.

https://doi.org/10.1103/physreva.104.032215

ARXIV: 2005.04062v5

[9] کارلو بالداسی و ریکاردو زکینا کارایی بازپخت کوانتومی در مقابل آنیل کلاسیک در مسائل یادگیری غیر محدب. Proceedings of the National Academy of Sciences, 115 (7): 1457–1462, Jan 2018. ISSN 1091-6490. 10.1073/pnas.1711456115. نشانی اینترنتی http://dx.doi.org/10.1073/pnas.1711456115. arXiv:1706.08470.

https://doi.org/10.1073/pnas.1711456115

arXiv: 1706.08470

[10] چارلز اچ. بنت، اتان برنشتاین، ژیل براسارد، و اومش وزیرانی. نقاط قوت و ضعف محاسبات کوانتومی SIAM Journal on Computing, 26 (5): 1510-1523, 1997. 10.1137/S0097539796300933. نشانی اینترنتی https://doi.org/10.1137/S0097539796300933. arXiv:quant-ph/9701001.

https://doi.org/10.1137/S0097539796300933

arXiv:quant-ph/9701001

[11] مایکل بتانکور، مایکل آی. جردن و آشیا سی ویلسون. در بهینه سازی ساده، 2018. arXiv:1802.03653.

arXiv: 1802.03653

[12] Sergio Boixo و Rolando D. Somma. شرط لازم برای تقریب آدیاباتیک کوانتومی. بررسی فیزیکی A, 81 (3): 032308, 2010. 10.1103/PhysRevA.81.032308. نشانی اینترنتی https://journals.aps.org/pra/abstract/10.1103/PhysRevA.81.032308. arXiv:0911.1362.

https://doi.org/10.1103/PhysRevA.81.032308

arXiv: 0911.1362

[13] فرناندو جی اس ال براندائو و کریستا سوور. افزایش سرعت کوانتومی برای برنامه نویسی نیمه معین. در مجموعه مقالات پنجاه و هشتمین سمپوزیوم سالانه مبانی علوم کامپیوتر، صفحات 58–415، 426. 2017/FOCS.10.1109. arXiv:2017.45.

https://doi.org/10.1109/FOCS.2017.45

arXiv: 1609.05537

[14] فرناندو جی اس ال براندائو، امیر کالف، تونگ یانگ لی، سدریک ین-یو لین، کریستا ام. سوور، و شیائودی وو. حلکنندههای کوانتومی SDP: افزایش سرعت، بهینهسازی و کاربردهای زیادی برای یادگیری کوانتومی. در مجموعه مقالات چهل و ششمین کنفرانس بین المللی اتومات، زبان ها و برنامه نویسی، جلد 46 مجموعه مقالات بین المللی لایبنیتس در انفورماتیک (LIPIcs)، صفحات 132:27-1:27. Schloss Dagstuhl–Leibniz-Zentrum fuer Informatik, 14. 2019/LIPIcs.ICALP.10.4230. arXiv:2019.27.

https://doi.org/10.4230/LIPIcs.ICALP.2019.27

arXiv: 1710.02581

[15] Shouvanik Chakrabarti، Andrew M. Childs، Tongyang Li، و Xiaodi Wu. الگوریتم های کوانتومی و مرزهای پایین برای بهینه سازی محدب. Quantum, 4: 221, 2020. 10.22331/q-2020-01-13-221. arXiv:1809.01731.

https://doi.org/10.22331/q-2020-01-13-221

arXiv: 1809.01731

[16] شانتاناو چاکرابورتی، کایل لو و ژرمی رولاند. پیاده روی های کوانتومی با چه سرعتی مخلوط می شوند؟ Physical Review Letters, 124: 050501, Feb 2020. 10.1103/PhysRevLett.124.050501. نشانی اینترنتی https://link.aps.org/doi/10.1103/PhysRevLett.124.050501. arXiv:2001.06305v1.

https://doi.org/10.1103/PhysRevLett.124.050501

ARXIV: 2001.06305v1

[17] پراتیک چاوداری و استفانو سواتو. نزول گرادیان تصادفی استنتاج متغیر را انجام می دهد، برای محدود کردن چرخه برای شبکه های عمیق همگرا می شود. در کارگاه آموزشی نظریه و کاربردهای اطلاعات (ITA)، صفحات 2018-1، 10. 2018/ITA.10.1109. arXiv:2018.8503224v1710.11029.

https://doi.org/10.1109/ITA.2018.8503224

ARXIV: 1710.11029v2

[18] اندرو ام. چایلدز، ریچارد کلیو، انریکو دئوتو، ادوارد فرهی، سام گاتمن و دانیل آ. اسپیلمن. افزایش سرعت الگوریتمی نمایی با راه رفتن کوانتومی. در مجموعه مقالات سی و پنجمین سمپوزیوم سالانه ACM در تئوری محاسبات، STOC '03، صفحه 59-68، نیویورک، نیویورک، ایالات متحده آمریکا، 2003. انجمن ماشین های محاسباتی. ISBN 1581136749. 10.1145/780542.780552. نشانی اینترنتی https://doi.org/10.1145/780542.780552. arXiv:quant-ph/0209131v2.

https://doi.org/10.1145/780542.780552

arXiv:quant-ph/0209131v2

[19] اندرو ام. چایلدز، جین پنگ لیو، و آرون اوستراندر. الگوریتم های کوانتومی با دقت بالا برای معادلات دیفرانسیل جزئی Quantum, 5: 574, Nov 2021. ISSN 2521-327X. 10.22331/q-2021-11-10-574. نشانی اینترنتی http://dx.doi.org/10.22331/q-2021-11-10-574. arXiv:2002.07868.

https://doi.org/10.22331/q-2021-11-10-574

arXiv: 2002.07868

[20] پیر کومون، خاویر لوسیانی و آندره ال اف دی آلمیدا. تجزیه های تانسور، حداقل مربعات متناوب و داستان های دیگر. مجله کمومتریکس، 23: 393-405، اوت 2009. 10.1002/cem.1236. نشانی اینترنتی https://hal.archives-ouvertes.fr/hal-00410057.

https://doi.org/10.1002/cem.1236

https://hal.archives-ouvertes.fr/hal-00410057

[21] پدرو سی اس کاستا، استفن جردن و آرون اوستراندر. الگوریتم کوانتومی برای شبیه سازی معادله موج. بررسی فیزیکی A، 99: 012323، ژانویه 2019. 10.1103/PhysRevA.99.012323. نشانی اینترنتی https://link.aps.org/doi/10.1103/PhysRevA.99.012323. arXiv:1711.05394.

https://doi.org/10.1103/PhysRevA.99.012323

arXiv: 1711.05394

[22] کریستوفر کریسیتلو و نیکلاس بومال. انحنای منفی مانع از شتاب برای بهینه سازی محدب زمین شناسی می شود، حتی با اوراکل های مرتبه اول دقیق، 2021. arXiv:2111.13263.

arXiv: 2111.13263

[23] الیزابت کراسون و آرام دبلیو هارو. بازپخت کوانتومی شبیه سازی شده می تواند به طور نمایی سریعتر از بازپخت شبیه سازی شده کلاسیک باشد. در سال 2016 IEEE پنجاه و هفتمین سمپوزیوم سالانه مبانی علوم کامپیوتر (FOCS)، صفحات 57-714. IEEE، اکتبر 723. 2016/focs.10.1109. نشانی اینترنتی http://dx.doi.org/2016.81/FOCS.10.1109. arXiv:2016.81.

https://doi.org/10.1109/focs.2016.81

arXiv: 1601.03030

[24] Mouez Dimassi و Johannes Sjöstrand. مجانبی طیفی در حد نیمه کلاسیک. مجموعه یادداشت های سخنرانی انجمن ریاضی لندن. انتشارات دانشگاه کمبریج، 1999. 10.1017/CBO9780511662195.

https://doi.org/10.1017/CBO9780511662195

[25] فلیکس دراکسلر، کامبیس وشگینی، مانفرد سالمهوفر و فرد همپرشت. اساساً هیچ مانعی در چشم انداز انرژی شبکه عصبی وجود ندارد. در کنفرانس بین المللی یادگیری ماشین، صفحات 1309-1318. PMLR، 2018. نشانی اینترنتی http://proceedings.mlr.press/v80/draxler18a.html. arXiv:1803.00885.

arXiv: 1803.00885

http://proceedings.mlr.press/v80/draxler18a.html

[26] رونیائو دوان. بررسی مجدد قضیه کوانتومی آدیاباتیک، 2020. arXiv:2003.03063v1.

ARXIV: 2003.03063v1

[27] جان دوچی، الاد هازان و یورام سینگر. روشهای زیرگروه تطبیقی برای یادگیری آنلاین و بهینهسازی تصادفی مجله تحقیقات یادگیری ماشین، 12 (61): 2121-2159، 2011. URL https://www.jmlr.org/papers/volume12/duchi11a/duci11a.pdf.

https://www.jmlr.org/papers/volume12/duci11a/duci11a.pdf

[28] سپهر عبادی، توت تی وانگ، هری لوین، الکساندر کیسلینگ، جولیا سمگینی، احمد عمران، دولف بلوشتاین، راین ساماجدار، هانس پیچلر، ون وی هو، سون وون چوی، سوبیر ساچدف، مارکوس گرینر، ولادان وولتیچ و میخائیل. . فازهای کوانتومی ماده در یک شبیه ساز کوانتومی قابل برنامه ریزی ۲۵۶ اتمی. Nature, 256 (595): 7866–227, 232. 2021/s10.1038-41586-021-03582. نشانی اینترنتی https://www.nature.com/articles/s4-41586-021-03582.

https://doi.org/10.1038/s41586-021-03582-4

https://www.nature.com/articles/s41586-021-03582-4

[29] کونگ فانگ، کریس جونچی لی، ژوچن لین و تانگ ژانگ. عنکبوت: بهینه سازی غیر محدب تقریباً بهینه از طریق برآوردگر دیفرانسیل یکپارچه مسیر تصادفی. در پیشرفتها در سیستمهای پردازش اطلاعات عصبی، صفحات 689–699، 2018. URL https://dl.acm.org/doi/abs/10.5555/3326943.3327007. arXiv:1807.01695.

arXiv: 1807.01695

https://dl.acm.org/doi/abs/10.5555/3326943.3327007

[30] کنگ فانگ، ژوچن لین و تانگ ژانگ. تجزیه و تحلیل تیز برای SGD غیر محدب فرار از نقاط زین. در کنفرانس تئوری یادگیری، صفحات 1192-1234، 2019. URL http://ceedings.mlr.press/v99/fang19a.html. arXiv:1902.00247.

arXiv: 1902.00247

http://proceedings.mlr.press/v99/fang19a.html

[31] ادوارد فرهی، جفری گلدستون، سام گاتمن، جاشوا لاپان، اندرو لاندگرن و دانیل پردا. یک الگوریتم تکامل آدیاباتیک کوانتومی که برای نمونههای تصادفی یک مسئله NP-کامل اعمال میشود. Science, 292 (5516): 472–475, Apr 2001. ISSN 1095-9203. 10.1126/science.1057726. نشانی اینترنتی http://dx.doi.org/10.1126/science.1057726. arXiv:quant-ph/0104129.

https://doi.org/10.1126/science.1057726

arXiv:quant-ph/0104129

[32] AB Finnila، MA Gomez، C. Sebenik، C. Stenson، و JD Doll. آنیل کوانتومی: روشی جدید برای به حداقل رساندن توابع چند بعدی. Chemical Physics Letters, 219 (5-6): 343-348, Mar 1994. ISSN 0009-2614. 10.1016/0009-2614(94)00117-0. نشانی اینترنتی http://dx.doi.org/10.1016/0009-2614(94)00117-0. arXiv:chem-ph/9404003.

https://doi.org/10.1016/0009-2614(94)00117-0

arXiv:chem-ph/9404003

[33] Mauger François. طرح قورباغه جهشی نمادین، 2020. URL https://www.mathworks.com/matlabcentral/fileexchange/38652-symplectic-leap-frog-scheme. https: //www.mathworks.com /matlabcentral /fileexchange /38652-symplectic-leap-frog-scheme.

https://www.mathworks.com/matlabcentral/fileexchange/38652-symplectic-leap-frog-scheme

[34] آلن فریز، مارک جروم و راوی کانان. یادگیری تبدیل های خطی در مجموعه مقالات سی و هفتمین کنفرانس مبانی علوم کامپیوتر، صفحات 37-359، 368. 1996/SFCS.10.1109.

https://doi.org/10.1109/SFCS.1996.548495

[35] تیمور گاریپوف، پاول ایزمایلوف، دیمیتری پودوپریخین، دیمیتری وتروف و اندرو گوردون ویلسون. سطوح از دست دادن، اتصال حالت، و ترکیب سریع DNN ها. در پیشرفتها در سیستمهای پردازش اطلاعات عصبی، صفحات 8803–8812، 2018. URL https://dl.acm.org/doi/abs/10.5555/3327546.3327556. arXiv:1802.10026.

arXiv: 1802.10026

https://dl.acm.org/doi/abs/10.5555/3327546.3327556

[36] Rong Ge و Tengyu Ma. در مورد چشم انداز بهینه سازی تجزیه تانسور. برنامه نویسی ریاضی، صفحات 1-47، 2020. ISSN 1436-4646. 10.1007/s10107-020-01579-x. نشانی اینترنتی https://doi.org/10.1007/s10107-020-01579-x. arXiv:1706.05598v1.

https://doi.org/10.1007/s10107-020-01579-x

ARXIV: 1706.05598v1

[37] رونگ جی، فورونگ هوانگ، چی جین و یانگ یوان. فرار از نقاط زین - گرادیان تصادفی آنلاین برای تجزیه تانسور. در مجموعه مقالات بیست و هشتمین کنفرانس تئوری یادگیری، جلد 28 از مجموعه مقالات تحقیقات یادگیری ماشین، صفحات 40–797، 842. نشانی اینترنتی http://proceedings.mlr.press/v2015/Ge40. arXiv:15.

arXiv: 1503.02101

http://proceedings.mlr.press/v40/Ge15

[38] Rong Ge، Jason D. Lee و Tengyu Ma. تکمیل ماتریس حداقل محلی جعلی ندارد. در پیشرفتها در سیستمهای پردازش اطلاعات عصبی، صفحات 2981–2989، 2016. URL https://dl.acm.org/doi/abs/10.5555/3157382.3157431. arXiv:1605.07272.

arXiv: 1605.07272

https://dl.acm.org/doi/abs/10.5555/3157382.3157431

[39] مینگ گونگ، شییو وانگ، چن ژا، مینگ-چنگ چن، هه-لیانگ هوانگ، یولین وو، چینگلینگ ژو، یووی ژائو، شائووی لی، شائوجون گوئو، هائوران کیان، یانگسن یه، فوشنگ چن، چونگ یینگ، جیاله یو، دائوجین فن، داچائو وو، هونگ سو، هوی دنگ، هائو رونگ، کیلی ژانگ، سیروی کائو، جین لین، یو خو، لیهوا سان، چنگ گو، نا لی، فوتیان لیانگ، وی ام باستیداس، کای نموتو، وی جی مونرو، یونگ هنگ هوئو، چائو یانگ لو، چنگ-ژی پنگ، شیائوبو ژو و جیان وی پان. کوانتومی روی یک پردازنده ابررسانا 62 کیوبیتی دو بعدی قابل برنامه ریزی راه می رود. Science, 372 (6545): 948-952, 2021. 10.1126/science.abg7812. نشانی اینترنتی https://science.sciencemag.org/content/372/6545/948.abstract. arXiv:2102.02573.

https://doi.org/10.1126/science.abg7812

arXiv: 2102.02573

https://science.sciencemag.org/content/372/6545/948.abstract

[40] استفن کی گری و دیوید ای. مانولوپولوس. انتگرالگرهای ساده متناسب با معادله شرودینگر وابسته به زمان. مجله فیزیک شیمی، 104 (18): 7099-7112، 1996. 10.1063/1.471428. نشانی اینترنتی https://doi.org/10.1063/1.471428.

https://doi.org/10.1063/1.471428

[41] برنارد هلفر تجزیه و تحلیل نیمه کلاسیک برای اپراتور شرودینگر و برنامه های کاربردی. نکات سخنرانی در ریاضیات. Springer, 1988. 10.1007/BFb0078115.

https://doi.org/10.1007/BFb0078115

[42] برنارد هلفر و یوهانس شوستراند. چاه های چندگانه در حد نیمه کلاسیک I. ارتباطات در معادلات دیفرانسیل جزئی، 9 (4): 337-408، 1984. 10.1080/03605308408820335.

https://doi.org/10.1080/03605308408820335

[43] برنارد هلفر و یوهانس شوستراند. چاه های متعدد در حد نیمه کلاسیک III - برهمکنش از طریق چاه های غیر تشدید. Mathematische Nachrichten, 124 (1): 263–313, 1985. https://doi.org/10.1002/mana.19851240117. نشانی اینترنتی https://onlinelibrary.wiley.com/doi/abs/10.1002/mana.19851240117.

https://doi.org/10.1002/mana.19851240117

[44] سپ هوکرایتر مشکل گرادیان ناپدید شدن در حین یادگیری شبکه های عصبی مکرر و راه حل های مسئله مجله بین المللی عدم قطعیت، فازی و سیستم های مبتنی بر دانش، 6 (02): 107-116، 1998. 10.1142/S0218488598000094. نشانی اینترنتی https://dl.acm.org/doi/abs/10.1142/S0218488598000094.

https://doi.org/10.1142/S0218488598000094

[45] Aapo Hyvarinen. ICA سریع برای داده های پر سر و صدا با استفاده از لحظات گاوسی. در سال 1999 IEEE International Symposium on Circuits and Systems (ISCAS)، جلد 5، صفحات 57-61، 1999. 10.1109/ISCAS.1999.777510.

https://doi.org/10.1109/ISCAS.1999.777510

[46] فردریک هراو، مایکل هیتریک و یوهانس شوستراند. اثر تونل و تقارن برای عملگرهای نوع کرامرز-فوکر-پلانک مجله موسسه ریاضیات جوسیو، 10 (3): 567–634، 2011. 10.1017/S1474748011000028.

https://doi.org/10.1017/S1474748011000028

[47] چی جین، رونگ جی، پرانیث نتراپالی، شم ام. کاکاده، و مایکل آی. جردن. چگونه به طور موثر از نقاط زین فرار کنیم. در مجموعه مقالات سی و چهارمین کنفرانس بین المللی یادگیری ماشین، جلد 34، صفحات 70–1724، 1732. نشانی اینترنتی http://proceedings.mlr.press/v2017/jin70a. arXiv:17.

arXiv: 1703.00887

http://proceedings.mlr.press/v70/jin17a

[48] چی جین، لیدیا تی لیو، رونگ جی، و مایکل آی. جردن. بر روی حداقل های محلی ریسک تجربی. در پیشرفتها در سیستمهای پردازش اطلاعات عصبی، جلد 31، صفحه 4901-4910. Curran Associates, Inc., 2018. URL https://proceedings.neurips.cc/paper/2018/file/da4902cb0bc38210839714ebdcf0efc3-Paper.pdf. arXiv:1803.09357.

arXiv: 1803.09357

https://proceedings.neurips.cc/paper/2018/file/da4902cb0bc38210839714ebdcf0efc3-Paper.pdf

[49] چی جین، پرانیت نتراپالی، رونگ جی، شم ام کاکاده، و مایکل آی. جردن. در مورد بهینه سازی غیر محدب برای یادگیری ماشین: گرادیان ها، تصادفی، و نقاط زین. مجله ACM (JACM)، 68 (2): 1–29، 2021. 10.1145/3418526. آدرس https://dl.acm.org/doi/abs/10.1145/3418526. arXiv:1902.04811.

https://doi.org/10.1145/3418526

arXiv: 1902.04811

[50] مایکل اول جردن. دیدگاه های پویا، ساده و تصادفی در بهینه سازی مبتنی بر گرادیان در مجموعه مقالات کنگره بین المللی ریاضیدانان: ریودوژانیرو 2018، صفحات 523-549. World Scientific, 2018. URL https://doi.org/10.1142/9789813272880_0022.

https://doi.org/10.1142/9789813272880_0022

[51] کنجی کاواگوچی، جیائوانگ هوانگ و لزلی پک کائبلینگ. هر حداقل مقدار محلی، حداقل مقدار جهانی مدل القایی در یادگیری ماشین غیر محدب است. محاسبات عصبی، 31 (12): 2293-2323، 12 2019. ISSN 0899-7667. 10.1162/neco_a_01234. نشانی اینترنتی https://doi.org/10.1162/neco_a_01234. arXiv:1904.03673v3.

https://doi.org/10.1162/neco_a_01234

ARXIV: 1904.03673v3

[52] دیدریک پی کینگما و جیمی با. آدام: روشی برای بهینه سازی تصادفی. در سومین کنفرانس بین المللی بازنمایی های یادگیری، 3. URL https:///openreview.net/forum?id=2015gmWwjFyLj. arXiv:8.

arXiv: 1412.6980

https://openreview.net/forum?id=8gmWwjFyLj

[53] الکسی کیتایف و ویلیام ا. وب. آماده سازی تابع موج و نمونه برداری مجدد با استفاده از یک کامپیوتر کوانتومی، 2008. arXiv:0801.0342.

arXiv: 0801.0342

[54] بابی کلینبرگ، یوانژی لی و یانگ یوان. یک دیدگاه جایگزین: چه زمانی SGD از حداقل های محلی فرار می کند؟ در کنفرانس بین المللی یادگیری ماشین، صفحات 2698-2707. PMLR، 2018. نشانی اینترنتی http://proceedings.mlr.press/v80/kleinberg18a.html. arXiv:1802.06175.

arXiv: 1802.06175

http://proceedings.mlr.press/v80/kleinberg18a.html

[55] گای کورنوفسکی و اوحد شامیر. پیچیدگی اوراکل در بهینهسازی غیرمحدب غیرهموار. In Advances in Neural Information Processing Systems, 2021. URL https://openreview.net/forum?id=aMZJBOiOOPg. arXiv:2104.06763v2.

ARXIV: 2104.06763v2

https://openreview.net/forum?id=aMZJBOiOOPg

[56] روهیت کودیتیپودی، شیانگ وانگ، هولدن لی، یی ژانگ، ژیوان لی، وی هو، رونگ جی و سانجیو آرورا. توضیح اتصال چشم انداز راه حل های کم هزینه برای شبکه های چند لایه پیشرفتها در سیستمهای پردازش اطلاعات عصبی، 32: 14601–14610، 2019. URL http://papers.nips.cc/paper/9602-explaining-landscape-connectivity-of-low-cost-solutions-for- شبکه های چند لایه arXiv:1906.06247.

arXiv: 1906.06247

http://papers.nips.cc/paper/9602-explaining-landscape-connectivity-of-low-cost-solutions-for-multilayer-nets

[57] هارولد جی کوشنر و جی جورج یین. تقریب تصادفی و الگوریتم ها و کاربردهای بازگشتی، جلد 35. Springer Science & Business Media, 2003. 10.1007/978-1-4471-4285-0_3.

https://doi.org/10.1007/978-1-4471-4285-0_3

[58] کرن لی، شیجی وی، پان گائو، فیهائو ژانگ، زنگرونگ ژو، تائو شین، شیائوتینگ وانگ، پاتریک ربنتروست و گیلو لانگ. بهینه سازی یک تابع چند جمله ای در یک پردازنده کوانتومی اطلاعات کوانتومی npj، 7 (1): 1-7، 2021a. 10.1038/s41534-020-00351-5. arXiv:1804.05231.

https://doi.org/10.1038/s41534-020-00351-5

arXiv: 1804.05231

[59] ژیوان لی، سادیکا ملادی، و سانجیو آرورا. در مورد اعتبار مدل سازی SGD با معادلات دیفرانسیل تصادفی (SDEs). در پیشرفتها در سیستمهای پردازش اطلاعات عصبی، 2021b. نشانی اینترنتی https://openreview.net/forum?id=goEdyJ_nVQI. arXiv:2102.12470.

arXiv: 2102.12470

https://openreview.net/forum?id=goEdyJ_nVQI

[60] گوانگ هائو لو و ناتان ویبه شبیه سازی همیلتونی در تصویر تعامل، 2019. URL https://arxiv.org/abs/1805.00675v2. arXiv:1805.00675v2.

ARXIV: 1805.00675v2

[61] کونگ ما، کایژنگ وانگ، یوجی چی، و یوشین چن. تنظیم ضمنی در تخمین آماری غیر محدب: نزول گرادیان به صورت خطی برای بازیابی فاز و تکمیل ماتریس همگرا می شود. در کنفرانس بین المللی یادگیری ماشین، صفحات 3345-3354. PMLR، 2018. نشانی اینترنتی http://proceedings.mlr.press/v80/ma18c.html. arXiv:1711.10467.

arXiv: 1711.10467

http://proceedings.mlr.press/v80/ma18c.html

[62] تنگیو ما. چرا روش های محلی مسائل غیر محدب را حل می کنند؟، صفحه 465-485. انتشارات دانشگاه کمبریج، 2021. 10.1017/9781108637435.027. arXiv:2103.13462.

https://doi.org/10.1017/9781108637435.027

arXiv: 2103.13462

[63] یی-آن ما، یوانسی چن، چی جین، نیکلاس فلاماریون و مایکل اول جردن. نمونه برداری می تواند سریعتر از بهینه سازی باشد. مجموعه مقالات آکادمی ملی علوم، 116 (42): 20881–20885، 2019. URL https://www.pnas.org/content/116/42/20881.short. arXiv:.

https://doi.org/10.1073/pnas.1820003116

https://www.pnas.org/content/116/42/20881.short

[64] پیتر آ. مارکوویچ و سدریک ویلانی. در روند تعادل برای معادله فوکر-پلانک: تعامل بین فیزیک و تحلیل عملکردی. In Physics and Functional Analysis, Matematica Contemporanea (SBM) 19. Citeseer, 1999. URL http:///citeseerx.ist.psu.edu/viewdoc/summary?doi=10.1.1.35.2278.

http://citeseerx.ist.psu.edu/viewdoc/summary?doi=10.1.1.35.2278

[65] لوران میشل. درباره مقادیر ویژه کوچک Witten Laplacian. تجزیه و تحلیل خالص و کاربردی، 1 (2): 149 - 206، 2019. 10.2140/paa.2019.1.149. نشانی اینترنتی https://doi.org/10.2140/paa.2019.1.149. arXiv:1702.01837.

https://doi.org/10.2140/paa.2019.1.149

arXiv: 1702.01837

[66] سیذارت موتوکریشنان، تمیم آلباش، و دانیل آ. لیدار. تونل زنی و افزایش سرعت در بهینه سازی کوانتومی برای مسائل جایگشت - متقارن Physical Review X, 6: 031010, Jul 2016. ISSN 2160-3308. 10.1103/physrevx.6.031010. نشانی اینترنتی http://dx.doi.org/10.1103/PhysRevX.6.031010. arXiv:1511.03910.

https://doi.org/10.1103/physrevx.6.031010

arXiv: 1511.03910

[67] کوین نگوین. در مجموعههای زیرسطحی متصل در یادگیری عمیق. در کنفرانس بین المللی یادگیری ماشین، صفحات 4790-4799. PMLR، 2019. نشانی اینترنتی http://proceedings.mlr.press/v97/nguyen19a.html. arXiv:1901.07417.

arXiv: 1901.07417

http://proceedings.mlr.press/v97/nguyen19a.html

[68] مایکل ای. نیلسن و آیزاک ال. چوانگ. محاسبات کوانتومی و اطلاعات کوانتومی: نسخه 10th Anniversary. انتشارات دانشگاه کمبریج، 2010. 10.1017/CBO9780511976667.

https://doi.org/10.1017/CBO9780511976667

[69] گریگوریوس آ. پاولیوتیس. فرآیندها و کاربردهای تصادفی: فرآیندهای انتشار، معادلات فوکر-پلانک و لانگوین، جلد 60. اسپرینگر، 2014. 10.1007/978-1-4939-1323-7.

https://doi.org/10.1007/978-1-4939-1323-7

[70] چینگ کو، یوکسیانگ ژای، شیائو لی، یوکیان ژانگ و ژیهوی ژو. تجزیه و تحلیل مناظر بهینه سازی برای یادگیری بازنمایی بیش از حد، 2019. arXiv:1912.02427.

arXiv: 1912.02427

[71] جیانلوکا راستلی فرمول نیمه کلاسیک برای تونل زنی کوانتومی در پتانسیل های دو چاه نامتقارن. بررسی فیزیکی A, 86: 012106, Jul 2012. 10.1103/PhysRevA.86.012106. نشانی اینترنتی https://link.aps.org/doi/10.1103/PhysRevA.86.012106. arXiv:1205.0366.

https://doi.org/10.1103/PhysRevA.86.012106

arXiv: 1205.0366

[72] آرتور جی. راتیو، یو سان، پیر مینسن، و مارکو پیستویا. تهیه کارآمد توزیع های نرمال در ثبات های کوانتومی. Quantum, 5: 609, 2021. 10.22331/q-2021-12-23-609. نشانی اینترنتی https://quantum-journal.org/papers/q-2021-12-23-609/. arXiv:2009.06601.

https://doi.org/10.22331/q-2021-12-23-609

arXiv: 2009.06601

https://quantum-journal.org/papers/q-2021-12-23-609/

[73] پاتریک ربنتروست، ماریا شولد، لئونارد ووسنیگ، فرانچسکو پتروشیونه و ست لوید. نزول گرادیان کوانتومی و روش نیوتن برای بهینهسازی چند جملهای محدود. مجله جدید فیزیک، 21 (7): 073023، 2019. 10.1088/1367-2630/ab2a9e. arXiv:1612.01789.

https://doi.org/10.1088/1367-2630/ab2a9e

arXiv: 1612.01789

[74] Burak Shahinoğlu و Rolando D. Somma. شبیهسازی همیلتونی در زیرفضای کم انرژی اطلاعات کوانتومی npj، 7 (1): 1–5، 2021. 10.1038/s41534-021-00451-w. نشانی اینترنتی https://www.nature.com/articles/s41534-021-00451-w. arXiv:2006.02660.

https://doi.org/10.1038/s41534-021-00451-w

arXiv: 2006.02660

https://www.nature.com/articles/s41534-021-00451-w

[75] جی ام اشمیت، ان کلیلند و جان کلارک. تونل زنی تشدید در اتصالات جوزفسون کوچک با جریان جریان. Physical Review B, 43: 229-238, Jan 1991. 10.1103/PhysRevB.43.229. نشانی اینترنتی https://link.aps.org/doi/10.1103/PhysRevB.43.229.

https://doi.org/10.1103/PhysRevB.43.229

[76] الکساندر شوچنکو و مارکو موندلی. اتصال چشم انداز و پایداری حذف راه حل های SGD برای شبکه های عصبی بیش از حد پارامتر در کنفرانس بین المللی یادگیری ماشین، صفحات 8773-8784. PMLR، 2020. نشانی اینترنتی http://proceedings.mlr.press/v119/shevchenko20a.html. arXiv:1912.10095.

arXiv: 1912.10095

http://proceedings.mlr.press/v119/shevchenko20a.html

[77] بن شی، ویجی جی سو، و مایکل اول جردن. در مورد نرخ یادگیری و عملگرهای شرودینگر، 2020. arXiv:2004.06977.

arXiv: 2004.06977

[78] بن شی، سایمون اس دو، مایکل آی. جردن، و ویجی جی. سو. درک پدیده شتاب از طریق معادلات دیفرانسیل با وضوح بالا برنامه نویسی ریاضی، صفحات 1-70، 2021. 10.1007/s10107-021-01681-8. نشانی اینترنتی https://doi.org/10.1007/s10107-021-01681-8. arXiv:1810.08907.

https://doi.org/10.1007/s10107-021-01681-8

arXiv: 1810.08907

[79] ویجی سو، استفن بوید، و امانوئل جی. کندز. معادله دیفرانسیل برای مدلسازی روش گرادیان شتابدار نستروف: نظریه و بینش مجله تحقیقات یادگیری ماشین، 17 (1): 5312-5354، 2016. 10.5555/2946645.3053435. نشانی اینترنتی https://dl.acm.org/doi/abs/10.5555/2946645.3053435. arXiv:1503.01243.

https://doi.org/10.5555/2946645.3053435

arXiv: 1503.01243

[80] رویو سان. بهینه سازی برای یادگیری عمیق: نظریه و الگوریتم ها، 2019. arXiv:1912.08957.

arXiv: 1912.08957

[81] کونال تالوار جداسازی محاسباتی بین نمونه گیری و بهینه سازی پیشرفتها در سیستمهای پردازش اطلاعات عصبی، 32: 15023–15033، 2019. نشانی اینترنتی http://papers.nips.cc/paper/9639-computational-separations-between-sampling-and-optimization. arXiv:1911.02074.

arXiv: 1911.02074

http://papers.nips.cc/paper/9639-computational-separations-been-sampling-and-optimization

[82] هائو تانگ، شیائو-فنگ لین، ژن فنگ، جینگ یوان چن، جون گائو، که سون، چائو-یو وانگ، پنگ-چنگ لای، شیائو-یون شو، یائو وانگ، لو-فنگ کیائو، آی-لین یانگ، و شیان مین جین. راه رفتن کوانتومی دو بعدی تجربی روی یک تراشه فوتونیک. پیشرفت های علم، 4 (5): eaat3174، 2018. 10.1126/sciadv.aat3174. نشانی اینترنتی https://www.science.org/doi/10.1126/sciadv.aat3174. arXiv:1704.08242.

https://doi.org/10.1126/sciadv.aat3174

arXiv: 1704.08242

[83] سدریک ویلانی. Hypocoercivity، جلد 202 از خاطرات انجمن ریاضی آمریکا. انجمن ریاضی آمریکا، 2009. 10.1090/S0065-9266-09-00567-5. arXiv:math/0609050.

https://doi.org/10.1090/S0065-9266-09-00567-5

arXiv:math/0609050

[84] آندره ویبیسونو، آشیا سی ویلسون و مایکل آی. جردن. دیدگاهی متغیر در مورد روش های تسریع شده در بهینه سازی مجموعه مقالات آکادمی ملی علوم، 113 (47): E7351–E7358، 2016. 10.1073/pnas.1614734113. نشانی اینترنتی https://doi.org/10.1073/pnas.1614734113. arXiv:1603.04245.

https://doi.org/10.1073/pnas.1614734113

arXiv: 1603.04245

[85] چنی ژانگ و تونگ یانگ لی. با یک الگوریتم ساده مبتنی بر گرادیان نزولی از نقاط زین فرار کنید. In Advances in Neural Information Processing Systems، جلد 34، 2021. URL https://openreview.net/forum?id=lEf52hTHq0Q. arXiv:2111.14069.

arXiv: 2111.14069

https://openreview.net/forum?id=lEf52hTHq0Q

[86] چنی ژانگ، جیاکی لنگ، و تونگ یانگ لی. الگوریتم های کوانتومی برای فرار از نقاط زین. Quantum, 5: 529, 2021a. 10.22331/q-2021-08-20-529. arXiv:2007.10253.

https://doi.org/10.22331/q-2021-08-20-529

arXiv: 2007.10253

[87] کاینینگ ژانگ، مین هسیو هسیه، لیو لیو و داچنگ تائو. الگوریتم کوانتومی برای یافتن جهت انحنای منفی در بهینه سازی غیر محدب، 2019. arXiv:1909.07622.

arXiv: 1909.07622

[88] یوکیان ژانگ، چینگ کو و جان رایت. از تقارن تا هندسه: مسائل غیر محدب قابل ترمیم، 2021b. arXiv:2007.06753.

arXiv: 2007.06753

ذکر شده توسط

[1] Weiyuan Gong، Chenyi Zhang و Tongyang Li، "استحکام الگوریتم های کوانتومی برای بهینه سازی غیر محدب"، arXiv: 2212.02548, (2022).

نقل قول های بالا از SAO/NASA Ads (آخرین به روز رسانی با موفقیت 2023-06-02 12:31:17). فهرست ممکن است ناقص باشد زیرا همه ناشران داده های استنادی مناسب و کاملی را ارائه نمی دهند.

واکشی نشد داده های استناد شده متقاطع در آخرین تلاش 2023-06-02 12:31:15: داده های استناد شده برای 10.22331/q-2023-06-02-1030 از Crossref دریافت نشد. اگر DOI اخیراً ثبت شده باشد، طبیعی است.

این مقاله در Quantum تحت عنوان منتشر شده است Creative Commons Attribution 4.0 International (CC BY 4.0) مجوز. حق چاپ نزد دارندگان حق چاپ اصلی مانند نویسندگان یا مؤسسات آنها باقی می ماند.

- محتوای مبتنی بر SEO و توزیع روابط عمومی. امروز تقویت شوید.

- PlatoAiStream. Web3 Data Intelligence دانش تقویت شده دسترسی به اینجا.

- ضرب کردن آینده با آدرین اشلی. دسترسی به اینجا.

- خرید و فروش سهام در شرکت های PRE-IPO با PREIPO®. دسترسی به اینجا.

- منبع: https://quantum-journal.org/papers/q-2023-06-02-1030/

- : دارد

- :است

- :نه

- :جایی که

- ][پ

- 1

- 10

- 1040

- 10th

- 11

- 116

- 12

- 13

- 14

- ٪۱۰۰

- 17

- 1985

- 1994

- 1996

- 1998

- 1999

- 20

- 2001

- 2005

- 2006

- 2008

- 2011

- 2012

- 2014

- 2015

- 2016

- 2017

- 2018

- 2019

- 202

- 2020

- 2021

- 2022

- 22

- 220

- 23

- 24

- 26

- 27

- 28

- 28th

- 30

- 31

- 39

- 3rd

- 40

- 49

- 50

- 60

- 66

- 67

- 7

- 70

- 72

- 77

- 8

- 80

- 84

- 87

- 9

- a

- آرون

- درباره ما

- بالاتر

- چکیده

- دانشگاه

- تسریع شد

- شتاب

- دسترسی

- دستیابی به

- ACM

- آدم

- پیشرفت

- وابستگی ها

- آلن

- الکساندر

- الگوریتم

- الگوریتمی

- الگوریتم

- معرفی

- جایگزین

- امریکایی

- an

- تحلیل

- و

- اندرو

- سالگرد

- سالیانه

- آنتونی

- برنامه های کاربردی

- اعمال می شود

- درخواست

- تقریبا

- آوریل

- هستند

- آرتور

- AS

- انجمن

- اوت

- آستین

- نویسنده

- نویسندگان

- موانع

- مستقر

- BE

- پکن

- در توی

- بنیامین

- بهتر

- میان

- BIN

- فریب

- پلیس

- شکستن

- برایان

- کسب و کار

- اما

- by

- کمبریج

- CAN

- نمی توان

- چائو یانگ لو

- چارلز

- شیمیایی

- چن

- چنگ

- تراشه

- چونگ

- کریس

- کریستوفر

- کالینز

- COM

- توضیح

- مردم عادی

- ارتباطات

- کامل

- اتمام

- پیچیدگی

- محاسبه

- کامپیوتر

- علم کامپیوتر

- محاسبه

- شرط

- کنفرانس

- کنگره

- حدس

- متصل

- اتصال

- ساختن

- محتوا

- محدب

- حق چاپ

- تایید می کند

- میتوانست

- کریگ

- چرخه

- دانیل

- داده ها

- علم اطلاعات

- دیو

- داود

- عمیق

- یادگیری عمیق

- آن

- مختلف

- انتشار

- جهت

- بحث و تبادل نظر

- توزیع

- do

- میکند

- در طی

- e

- چاپ

- ادوارد

- اثر

- موثر

- بهره وری

- موثر

- موثر

- جاسازی شده

- انرژی

- مهندسی

- معادلات

- تعادل

- فرار

- اساسا

- اتر (ETH)

- حتی

- هر

- تکامل

- آزمایش

- توضیح دادن

- اکتشاف

- نمایی

- نمایی

- پنکه

- FAST

- سریعتر

- فوریه

- سرانجام

- پیدا کردن

- یافته ها

- صاف

- برای

- فرمول

- مبانی

- از جانب

- مرز

- تابع

- تابعی

- توابع

- اساسی

- GAO

- شکاف

- ge

- هندسه

- جورج

- ژیل

- داده

- جهانی

- گومز

- شیب ها

- خاکستری

- مرد

- هارولد

- دانشگاه هاروارد

- زیاد

- کیفیت بالا

- اصابت

- ضربه زدن

- دارندگان

- هنگ

- چگونه

- چگونه

- HTML

- HTTP

- HTTPS

- huang

- i

- IEEE

- if

- بهبود یافته

- ارتقاء

- in

- شرکت

- اطلاعات

- اول

- بینش

- موسسه

- موسسات

- اثر متقابل

- جالب

- بین المللی

- معرفی

- IT

- جیمی

- ژان

- جاوا اسکریپت

- جیان وی پان

- جان

- اردن

- روزنامه

- کیم

- دانا

- شناخته شده

- چشم انداز

- زبان ها

- بزرگ

- نام

- پرش

- یادگیری

- کمترین

- ترک کردن

- قرائت

- انسوی کشتی که از باد در پناه است

- بهره برداری

- li

- مجوز

- برخورد

- محدود

- ابشار

- فهرست

- محلی

- لندن

- طولانی

- خاموش

- کم

- کم هزینه

- دستگاه

- فراگیری ماشین

- دستگاه

- مارکو

- علامت

- مارتین

- ریاضی

- ریاضیات

- ماتریس

- ماده

- متی

- حداکثر عرض

- ممکن است..

- مک کلین

- مکانیک

- رسانه ها

- روش

- روش

- مایکل

- مخفف کلمه میکروفون

- به حداقل رساندن

- حد اقل

- حالت

- مدل

- مدل سازی

- مدل

- لحظه

- ماه

- چندگانه

- ملی

- طبیعت

- نزدیک

- لازم

- منفی

- توری

- شبکه

- شبکه

- عصبی

- شبکه های عصبی

- شبکه های عصبی

- NeurIPS

- جدید

- نیویورک

- نیوتن

- نگوین

- نیکولا

- نه

- طبیعی

- یادداشت

- NY

- اکتبر

- of

- غالبا

- on

- ONE

- آنلاین

- یادگیری آنلاین

- باز کن

- اپراتور

- اپراتور

- بهینه سازی

- بهینه سازی

- or

- وحی

- وحی

- اصلی

- دیگر

- ما

- روی

- بسته

- با ما

- PAN

- مقاله

- پاتریک

- پل

- پکن

- انجام می دهد

- چشم انداز

- دیدگاه

- از پا افتادن

- فاز

- مراحل ماده

- پدیده

- فیزیکی

- فیزیک

- تصویر

- پیر

- پینگ

- افلاطون

- هوش داده افلاطون

- PlatoData

- نقطه

- ممکن

- تهیه

- فشار

- مشکل

- مشکلات

- اقدامات

- فرآیندهای

- در حال پردازش

- پردازنده

- برنامه نويسي

- اثبات

- مناسب

- ارائه

- منتشر شده

- ناشر

- ناشران

- کوانتومی

- الگوریتم های کوانتومی

- آنیل کوانتومی

- کامپیوتر کوانتومی

- محاسبات کوانتومی

- اطلاعات کوانتومی

- Qubit

- رامی

- تصادفی

- نرخ

- تازه

- بازگشتی

- منابع

- ثبت نام

- ثبت

- بقایای

- نمایندگی

- تحقیق

- این فایل نقد می نویسید:

- ریچارد

- ریو دو ژانیرو

- خطر

- دستبرد زدن

- نیرومندی

- رولاند

- رایان

- s

- سام

- طرح

- علم

- علوم

- SDP

- شان

- SEON

- سلسله

- مجموعه

- SGD

- تیز

- کوتاه

- نشان

- سیام

- شمعون

- ساده

- شبیه سازی

- شبیه ساز

- خواننده

- کوچک

- جامعه

- مزایا

- حل

- حل کردن

- خاص

- به طور خاص

- طیفی

- مربع

- ثبات

- ایالات

- آماری

- ارقام

- استفان

- استیو

- نقاط قوت

- مطالعات

- موفقیت

- چنین

- مناسب

- خورشید

- بزم پس از شام

- سیستم های

- طراحی شده

- هدف

- نسبت به

- که

- La

- شان

- نظریه

- این

- از طریق

- بار

- عنوان

- به

- تحولات

- روند

- Tsinghua دانشگاه

- نوع

- تردید

- زیر

- درک

- دانشگاه

- به روز شده

- URL

- ایالات متحده

- با استفاده از

- ارزش

- از طريق

- چشم انداز

- حجم

- vs

- W

- می خواهم

- بود

- موج

- we

- خوب

- ولز

- چه زمانی

- سفید

- چرا

- ویلسون

- با

- گرگ

- کارگاه

- جهان

- استاد

- wu

- X

- سال

- YING

- نیویورک

- یوتیوب

- یوان

- زفیرنت

- ژائو