در زمینه به سرعت در حال تکامل هوش مصنوعی، پردازش زبان طبیعی به یک نقطه کانونی برای محققان و توسعه دهندگان تبدیل شده است. بنا بر پایه های معماری ترانسفورماتور و ارتقاء دو جهته BERTچندین مدل زبانی پیشگامانه در سالهای اخیر پدیدار شدهاند که مرزهای آنچه را که ماشینها میتوانند بفهمند و تولید کنند، افزایش دادهاند.

در این مقاله، آخرین پیشرفتها در دنیای مدلهای زبانی در مقیاس بزرگ را بررسی میکنیم، پیشرفتهای معرفیشده توسط هر مدل، قابلیتهای آنها و کاربردهای بالقوه را بررسی میکنیم. ما همچنین مدلهای زبان بصری (VLM) را بررسی خواهیم کرد که برای پردازش نه تنها دادههای متنی بلکه بصری آموزش دیدهاند.

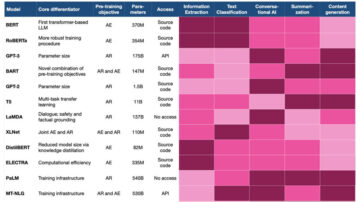

اگر میخواهید از اینجا رد شوید، مدلهای زبانی که ما ارائه کردهایم در اینجا آمده است:

- GPT-3 توسط OpenAI

- LaMDA توسط گوگل

- پالم توسط گوگل

- فلامینگو توسط DeepMind

- BLIP-2 توسط Salesforce

- LLaMA توسط Meta AI

- GPT-4 توسط OpenAI

اگر این محتوای آموزشی عمیق برای شما مفید است، می توانید در لیست پستی تحقیقات هوش مصنوعی ما مشترک شوید زمانی که مطالب جدید را منتشر می کنیم هشدار داده شود.

مهمترین مدلهای زبان بزرگ (LLM) و مدلهای زبان تصویری (VLM) در سال 2023

1. GPT-3 توسط OpenAI

خلاصه

تیم OpenAI GPT-3 را به عنوان جایگزینی برای داشتن یک مجموعه داده برچسبدار برای هر کار زبانی جدید معرفی کرد. آنها پیشنهاد کردند که بزرگکردن مدلهای زبانی میتواند عملکرد چند شات را بهبود بخشد. برای آزمایش این پیشنهاد، آنها یک مدل زبان خودرگرسیون با پارامتر 175B به نام آموزش دادند GPT-3و عملکرد آن را در بیش از دوجین کار NLP ارزیابی کرد. ارزیابی تحت آموزش چند شات، یادگیری تک شات، و یادگیری صفر شات نشان داد که GPT-3 به نتایج امیدوارکنندهای دست یافت و حتی گاهی اوقات از نتایج پیشرفتهای که توسط مدلهای تنظیمشده به دست میآمد بهتر عمل کرد.

هدف چیست؟

- برای پیشنهاد یک راه حل جایگزین برای مشکل موجود، زمانی که یک مجموعه داده برچسبدار برای هر کار زبانی جدید مورد نیاز است.

چگونه به مشکل برخورد می شود؟

- محققان پیشنهاد کردند که مدلهای زبانی را برای بهبود عملکرد چند ضربهای که بهعنوان تکلیف آگنوستیک انجام میدهند، افزایش دهند.

- La GPT-3 مدل از همان مدل و معماری GPT-2 استفاده می کند که شامل مقداردهی اولیه اصلاح شده، پیش عادی سازی و توکنیزاسیون برگشت پذیر می شود.

- با این حال، بر خلاف GPT-2، از الگوهای توجه پراکنده متراکم و با نوارهای محلی متناوب در لایه های ترانسفورماتور استفاده می کند. ترانسفورماتور اسپارس.

نتایج چیست؟

- مدل GPT-3 بدون تنظیم دقیق نتایج امیدوارکنندهای را در تعدادی از وظایف NLP به دست میآورد، و حتی گاهی اوقات از مدلهای پیشرفتهای که برای آن کار خاص تنظیم شده بودند، پیشی میگیرد:

- بر CoQA معیار، 81.5 F1 در تنظیمات صفر شلیک، 84.0 F1 در تنظیمات یک شلیک، و 85.0 F1 در تنظیمات چند شلیک، در مقایسه با امتیاز F90.7 1 که توسط SOTA تنظیم شده به دست آمده است.

- بر TriviaQA معیار، 64.3 درصد دقت در تنظیمات صفر شلیک، 68.0 درصد در تنظیمات یک شلیک، و 71.2 درصد در تنظیمات چند شات، پیشی گرفتن از وضعیت هنر (68٪) با 3.2٪.

- بر لامبادا مجموعه داده، 76.2 درصد دقت در تنظیمات صفر، 72.5 درصد در تنظیم یک شات، و 86.4 درصد در تنظیمات چند شات، بالاتر از وضعیت هنر (68 درصد) با 18 درصد.

- براساس ارزیابی های انسانی (با دقتی که به سختی بالاتر از سطح شانس در ~175٪) است، مقالات خبری تولید شده توسط مدل GPT-3 با پارامتر 52B به سختی از موارد واقعی تشخیص داده می شوند.

- علیرغم عملکرد قابل توجه GPT-3، بررسی های متفاوتی از جامعه هوش مصنوعی دریافت کرد:

- تبلیغات GPT-3 خیلی زیاد است. قابل توجه است (ممنون از تعارفات خوب!) اما همچنان دارای نقاط ضعف جدی است و گاهی اوقات اشتباهات بسیار احمقانه ای مرتکب می شود. هوش مصنوعی جهان را تغییر خواهد داد، اما GPT-3 فقط یک نگاه اولیه است. ما هنوز چیزهای زیادی برای کشف کردن داریم.» – سام آلتمن، مدیرعامل و یکی از بنیانگذاران OpenAI.

- من شوکه شده ام که چقدر سخت است که از GPT-3 متنی در مورد مسلمانان ایجاد کنیم که ربطی به خشونت یا کشته شدن نداشته باشد... ابوبکر عابد، مدیرعامل و بنیانگذار Gradio.

- «نه. GPT-3 اساساً دنیایی را که در مورد آن صحبت می کند درک نمی کند. افزایش بیشتر پیکره به آن اجازه میدهد تا پاسیچ معتبرتری تولید کند، اما عدم درک اساسی خود از جهان را برطرف نخواهد کرد. نمایشهای GPT-4 همچنان به چیدن گیلاس انسانی نیاز دارند.» – گری مارکوس، مدیرعامل و موسس Robust.ai.

- «بررسی عملکرد شگفتانگیز GPT3 به آینده نشان میدهد که پاسخ به زندگی، جهان و همه چیز فقط 4.398 تریلیون پارامتر است.» – جفری هینتون، برنده جایزه تورینگ.

از کجا درباره این تحقیق بیشتر بدانیم؟

کد پیاده سازی را از کجا می توان دریافت کرد؟

- کد به خودی خود در دسترس نیست، اما برخی از آمارهای مجموعه داده به همراه نمونههای 2048 توکن بدون قید و شرط و فیلتر نشده از GPT-3 منتشر شده است. GitHub.

2. LaMDA توسط گوگل

خلاصه

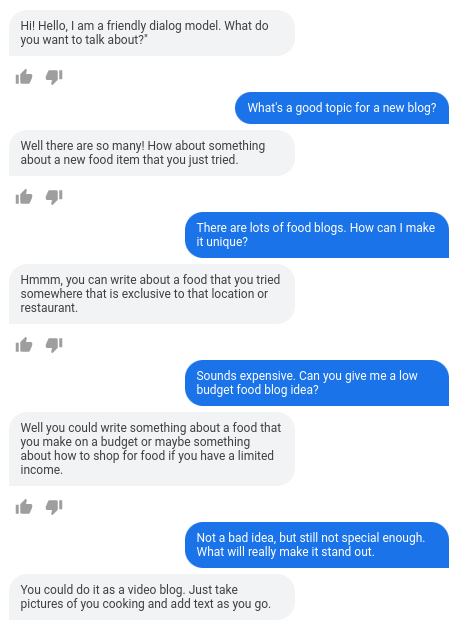

Laزبان Mمدل برای Dایالوگ Aبرنامه های کاربردی (لامدا) از طریق فرآیند تنظیم دقیق گروهی از مدلهای زبان عصبی مبتنی بر ترانسفورماتور که به طور خاص برای دیالوگها طراحی شدهاند، ایجاد شدند. این مدل ها حداکثر 137B پارامتر دارند و برای استفاده از منابع خارجی دانش آموزش دیده اند. توسعه دهندگان LaMDA سه هدف کلیدی را در ذهن داشتند: کیفیت، ایمنی و پایه. نتایج نشان داد که تنظیم دقیق اجازه می دهد تا شکاف کیفیت را به سطوح انسانی کاهش دهد، اما عملکرد مدل با توجه به ایمنی و زمینی بودن پایین تر از سطوح انسانی باقی ماند.

بارد گوگل، منتشر شد اخیراً به عنوان جایگزینی برای ChatGPT، توسط LaMDA طراحی شده است. علیرغم اینکه بارد اغلب به عنوان برچسب زدن خسته کننده، می توان آن را به عنوان شواهدی از تعهد گوگل به اولویت دادن به ایمنی، حتی در میان رقابت شدید بین گوگل و مایکروسافت برای ایجاد تسلط در زمینه هوش مصنوعی مولد تلقی کرد.

هدف چیست؟

- برای ایجاد مدلی برای برنامههای گفتگوی دامنه باز، که در آن یک عامل گفتگو میتواند در مورد هر موضوعی با پاسخهایی که معقول، مختص به زمینه، مبتنی بر منابع معتبر و اخلاقی هستند، صحبت کند.

چگونه به مشکل برخورد می شود؟

- LaMDA بر روی ساخته شده است تبدیل کننده، یک معماری شبکه عصبی است که Google Research آن را در سال 2017 اختراع و منبع باز شد.

- مانند سایر مدلهای زبان بزرگ، از جمله BERT و GPT-3، LaMDA بر روی ترابایت دادههای متنی آموزش داده میشود تا چگونگی ارتباط کلمات را با یکدیگر و سپس پیشبینی کلمات بعدی را پیشبینی کند.

- با این حال، بر خلاف بسیاری از مدلهای زبان، LaMDA بر روی گفتگو آموزش دیده بود تا نکات ظریفی را که مکالمه پایان باز را از سایر اشکال زبان متمایز میکند، درک کند.

- این مدل همچنین برای بهبود معقول بودن، ایمنی و ویژگی پاسخهای آن بهخوبی تنظیم شده است. در حالی که عباراتی مانند «خوب است» و «نمیدانم» میتوانند در بسیاری از سناریوهای گفتگو معنیدار باشند، احتمالاً منجر به مکالمات جالب و جذاب نمیشوند.

- ژنراتور LaMDA ابتدا چندین پاسخ کاندید تولید می کند که همه آنها بر اساس میزان ایمن، معقول، خاص و جالب امتیازدهی می شوند. پاسخهایی با امتیاز ایمنی پایین فیلتر میشوند و سپس نتیجه رتبهبندی برتر به عنوان پاسخ انتخاب میشود.

نتایج چیست؟

- آزمایشهای متعدد نشان میدهد که LaMDA میتواند در گفتگوهای باز در موضوعات مختلف مشارکت کند.

- مجموعهای از ارزیابیهای کیفی تأیید کردند که پاسخهای مدل معقول، خاص، جالب و مبتنی بر منابع خارجی قابل اعتماد هستند، اما هنوز جای بهبود وجود دارد.

- علیرغم همه پیشرفتهایی که تاکنون انجام شده است، نویسندگان تشخیص میدهند که این مدل هنوز محدودیتهای زیادی دارد که ممکن است منجر به ایجاد پاسخهای نامناسب یا حتی مضر شود.

از کجا درباره این تحقیق بیشتر بدانیم؟

کد پیاده سازی را از کجا می توان دریافت کرد؟

- یک پیادهسازی PyTorch منبع باز برای معماری قبل از آموزش LaMDA در دسترس است GitHub.

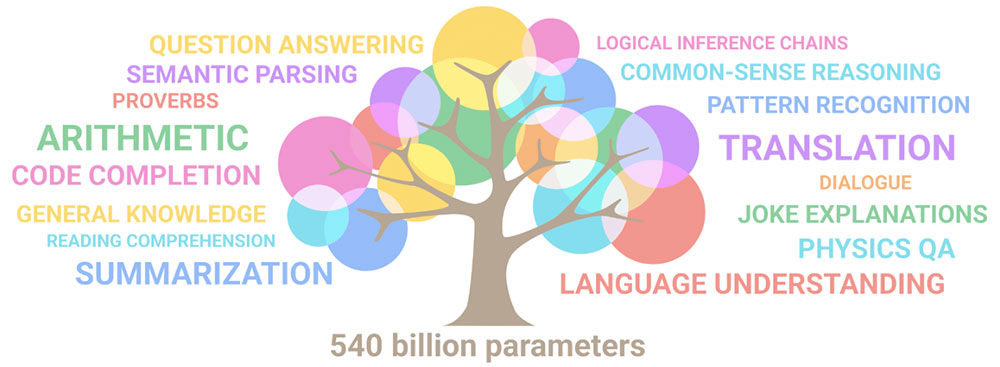

3. پالم توسط گوگل

خلاصه

Paبه این ترتیب Lاضطراب Mاودل (نخل) یک مدل زبان مبتنی بر ترانسفورماتور با 540 میلیارد پارامتر است. PaLM بر روی تراشههای 6144 TPU v4 با استفاده از Pathways، یک سیستم ML جدید برای آموزش کارآمد در چندین TPU Pod آموزش داده شد. این مدل مزایای مقیاسگذاری را در یادگیری چند شات نشان میدهد و به نتایج پیشرفتهای در صدها معیار درک زبان و تولید دست مییابد. PALM در کارهای استدلال چند مرحله ای از مدل های پیشرفته برتر عمل می کند و از میانگین عملکرد انسانی در معیار BIG-bench بالاتر است.

هدف چیست؟

- برای بهبود درک چگونگی تأثیر مقیاسگذاری مدلهای زبان بزرگ بر یادگیری چند شات.

چگونه به مشکل برخورد می شود؟

- ایده اصلی این است که آموزش یک مدل زبان پارامتری 540 میلیاردی را با سیستم Pathways مقیاس کنید:

- این تیم از موازی سازی داده ها در سطح Pod در دو Cloud TPU v4 Pod استفاده می کرد در حالی که از داده های استاندارد و موازی سازی مدل در هر Pod استفاده می کرد.

- آنها توانستند آموزش را به 6144 تراشه TPU v4، بزرگترین پیکربندی سیستم مبتنی بر TPU که تا به امروز برای آموزش استفاده شده است، مقیاس کنند.

- این مدل بازده آموزشی 57.8% استفاده از FLOPهای سختافزاری را به دست آورد، که همانطور که نویسندگان ادعا میکنند، بالاترین بازده آموزشی است که برای مدلهای زبان بزرگ در این مقیاس به دست آمده است.

- داده های آموزشی برای مدل PalM شامل ترکیبی از مجموعه داده های انگلیسی و چند زبانه شامل اسناد وب با کیفیت بالا، کتاب ها، ویکی پدیا، مکالمات و کد GitHub بود.

نتایج چیست؟

- آزمایشهای متعدد نشان میدهد که عملکرد مدل به شدت افزایش یافته است، زیرا تیم به بزرگترین مدل خود مقیاس میدهد.

- PALM 540B در چندین کار بسیار دشوار به عملکرد موفقیت آمیز دست یافت:

- درک زبان و نسل. مدل معرفی شده در 28 کار از 29 کار که شامل وظایف پاسخگویی به سوال، کارهای بسته و تکمیل جمله، وظایف درک مطلب درون متنی، وظایف استدلال عقل سلیم، وظایف SuperGLUE، و بیشتر. عملکرد PalM در وظایف BIG-bench نشان داد که می تواند علت و معلول را تشخیص دهد و همچنین ترکیبات مفهومی را در زمینه های مناسب درک کند.

- استدلال. با درخواست 8 شات، PALM 58 درصد از مسائل را در GSM8K حل میکند، معیاری از هزاران سؤال چالشبرانگیز ریاضی در سطح دبیرستان، که از امتیاز برتر قبلی 55 درصدی که با تنظیم دقیق مدل GPT-3 175B به دست آمده بود، بهتر عمل میکند. PALM همچنین توانایی ایجاد توضیحات صریح را در موقعیت هایی که نیاز به ترکیب پیچیده ای از استنتاج منطقی چند مرحله ای، دانش جهانی و درک عمیق زبان دارد را نشان می دهد.

- تولید کد. PALM با Codex 12B که به خوبی تنظیم شده عمل می کند در حالی که از کد پایتون 50 برابر کمتر برای آموزش استفاده می کند، تأیید می کند که مدل های زبان بزرگ، یادگیری را از هر دو زبان برنامه نویسی دیگر و داده های زبان طبیعی به طور مؤثرتری انتقال می دهند.

از کجا درباره این تحقیق بیشتر بدانیم؟

کد پیاده سازی را از کجا می توان دریافت کرد؟

- یک پیادهسازی غیررسمی PyTorch از معماری خاص Transformer از مقاله تحقیقاتی PalM در دسترس است GitHub. مقیاس نخواهد بود و فقط برای اهداف آموزشی منتشر شده است.

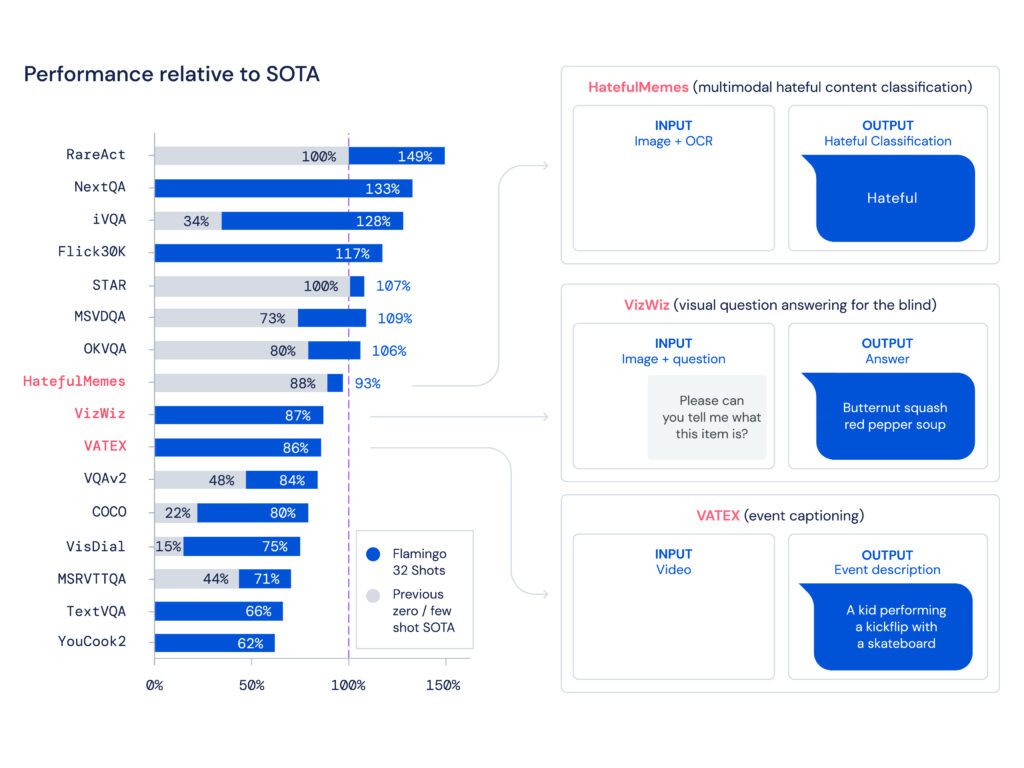

4. فلامینگو توسط DeepMind

خلاصه

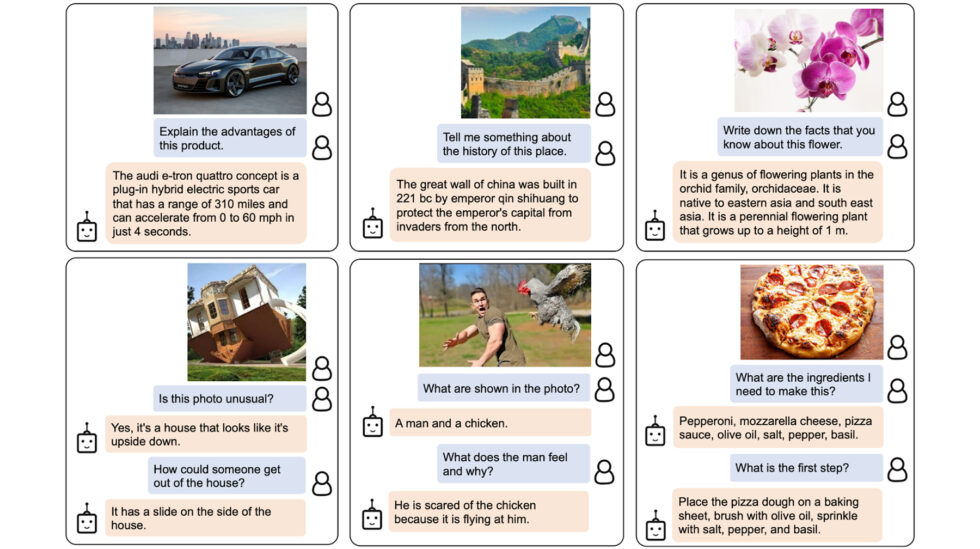

فلامینگو یک خانواده پیشرفته از مدلهای زبان بصری (VLM) است که بر روی پیکرههای وب چندوجهی در مقیاس بزرگ با متن و تصاویر ترکیبی آموزش دیدهاند. با استفاده از این آموزش، مدلها میتوانند با استفاده از حداقل مثالهای حاشیهنویسی که بهعنوان یک اعلان ارائه میشوند، با وظایف جدید سازگار شوند. فلامینگو دارای پیشرفتهای کلیدی معماری است که برای ادغام نقاط قوت مدلهای فقط بینایی و زبانی از پیش آموزش دیده، پردازش توالی دادههای بصری و متنی به هم پیوسته متغیر، و گنجاندن تصاویر یا ویدیوها به عنوان ورودی یکپارچه طراحی شدهاند. این مدلها سازگاری چشمگیری با طیف وسیعی از وظایف تصویری و ویدئویی مانند پاسخگویی به سؤالات تصویری، وظایف شرحنویسی، و پاسخگویی به سؤالات بصری چند گزینهای، تنظیم استانداردهای عملکرد جدید با استفاده از اعلانهای ویژه کار در یادگیری چند شات نشان میدهند.

هدف چیست؟

- برای پیشرفت در جهت توانمندسازی مدلهای چندوجهی برای یادگیری سریع و انجام وظایف جدید بر اساس دستورالعملهای کوتاه:

- الگوی پرکاربرد پیشآموزش یک مدل بر روی حجم زیادی از دادههای تحت نظارت، سپس تنظیم دقیق آن برای کار خاص، نیازمند منابع فشرده است و به هزاران نقطه داده مشروح همراه با تنظیم فراپارامتر دقیق برای هر کار نیاز دارد.

- مدلهای فعلی که از یک هدف کنتراست استفاده میکنند، امکان انطباق صفر شات را با وظایف جدید فراهم میکنند، اما در کارهای بازتر مانند زیرنویس یا پاسخگویی بصری به سؤالات کوتاهی میکنند، زیرا فاقد قابلیتهای تولید زبان هستند.

- هدف این تحقیق معرفی مدل جدیدی است که به طور موثر به این مسائل می پردازد و عملکرد برتر را در رژیم های کم داده نشان می دهد.

چگونه به مشکل برخورد می شود؟

- DeepMind فلامینگو را معرفی کرد، VLMهایی که برای یادگیری چند شات در کارهای مختلف بینایی و زبانی طراحی شده بودند، تنها با استفاده از چند نمونه ورودی/خروجی.

- مدلهای فلامینگو، مدلهای تولید متن خودبازگشت با شرایط بصری هستند که میتوانند نشانههای متنی مخلوط شده با تصاویر و/یا ویدیوها را پردازش کنند و متن را به عنوان خروجی تولید کنند.

- معماری فلامینگو شامل دو مدل از پیش آموزش دیده و منجمد شده است:

- یک مدل بینایی که قادر به "درک" صحنه های بصری است.

- یک مدل زبان بزرگ که وظیفه دارد استدلال اساسی را انجام دهد.

- اجزای معماری جدید این مدلها را به گونهای ادغام میکنند که دانش بهدستآمده در طول پیشآموزش فشرده محاسباتی آنها را حفظ کند.

- علاوه بر این، مدلهای فلامینگو دارای معماری مبتنی بر Perceiver هستند که به آنها اجازه میدهد تصاویر یا ویدیوهای با وضوح بالا را دریافت کنند. این معماری میتواند تعداد ثابتی از نشانههای بصری در هر تصویر/ویدئو را از یک آرایه وسیع و متغیر از ویژگیهای ورودی بصری تولید کند.

نتایج چیست؟

- این تحقیق نشان میدهد که مانند LLMها، که یادگیرندههای خوبی هستند، VLMها میتوانند از چند نمونه ورودی/خروجی برای کارهای درک تصویر و ویدئو مانند طبقهبندی، زیرنویس یا پاسخگویی به پرسش بیاموزند.

- فلامینگو معیار جدیدی را در یادگیری چند شات ایجاد میکند و عملکرد برتر را در طیف گستردهای از ۱۶ تکلیف چندوجهی زبان و درک تصویر/فیلم نشان میدهد.

- برای 6 کار از این 16 کار، فلامینگو از عملکرد پیشرفته هنر پیشی میگیرد، حتی اگر تنها از 32 نمونه کار خاص استفاده میکند - تقریباً 1000 برابر کمتر از دادههای آموزشی ویژه کار نسبت به مدلهای با عملکرد برتر فعلی.

از کجا درباره این تحقیق بیشتر بدانیم؟

کد پیاده سازی را از کجا می توان دریافت کرد؟

- DeepMind اجرای رسمی فلامینگو را منتشر نکرد.

- ممکن است پیاده سازی منبع باز رویکرد معرفی شده را در OpenFlamingo Github Repo.

- پیاده سازی جایگزین PyTorch در دسترس است اینجا کلیک نمایید.

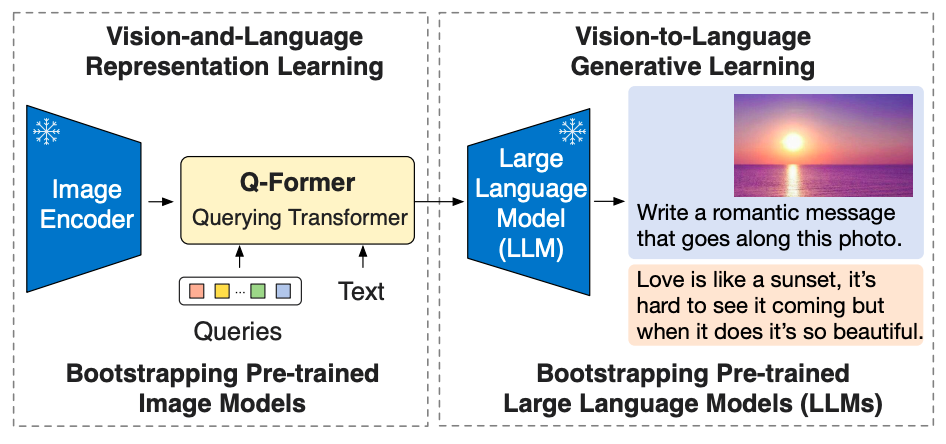

5. BLIP-2 توسط Salesforce

خلاصه

BLIP-2 یک چارچوب پیشآموزشی کارآمد و عمومی برای مدلهای بینایی و زبان است که برای دور زدن هزینههای گزاف پیشآموزش مدلهای در مقیاس بزرگ طراحی شده است. BLIP-2 از رمزگذارهای تصویر از قبل آموزشدیده منجمد شده و مدلهای زبان بزرگ منجمد برای راهاندازی پیشآموزش زبان بینایی استفاده میکند، و یک ترانسفورماتور Querying سبک وزن که در دو مرحله از قبل آموزش داده شده است را در خود جای داده است. مرحله اول یادگیری بازنمایی زبان بینایی را از یک رمزگذار تصویر ثابت آغاز می کند و مرحله دوم یادگیری مولد بینایی به زبان را از یک مدل زبان منجمد به پیش می برد. علیرغم داشتن پارامترهای قابل آموزش بسیار کمتر، BLIP-2 از روشهای پیشرفته بهتر عمل میکند و 80 درصد از DeepMind's Flamingo8.7B در VQAv2 صفر شات با 54 برابر پارامترهای قابل آموزش کمتر پیشی میگیرد. این مدل همچنین قابلیتهای نویدبخش تولید تصویر به متن بدون شات را به دنبال دستورالعملهای زبان طبیعی نشان میدهد.

هدف چیست؟

- برای به دست آوردن عملکرد پیشرفته در وظایف زبان بینایی، در عین حال کاهش هزینه های محاسباتی.

چگونه به مشکل برخورد می شود؟

- تیم Salesforce یک چارچوب پیشآموزشی جدید با زبان بینایی با نام BLIP-2 معرفی کرد. Bootstrapping Lزبان -IMage را Pآموزش مجدد با مدل های تک وجهی منجمد:

- مدلهای یکوجهی از پیش آموزشدیدهشده در طول پیشآموزش منجمد میمانند تا هزینههای محاسباتی کاهش یابد و از فراموشی فاجعهبار جلوگیری شود.

- برای تسهیل هم ترازی متقابل و پر کردن شکاف مدالیتی بین مدلهای بینایی از قبل آموزش دیده و مدلهای زبانی از قبل آموزشدیده، تیم یک ترانسفورماتور Querying سبک وزن (Q-Former) را پیشنهاد میکند که به عنوان یک گلوگاه اطلاعاتی بین رمزگذار تصویر ثابت و منجمد عمل میکند. LLM.

- Q-former با یک استراتژی دو مرحله ای جدید از قبل آموزش دیده است:

- اولین مرحله پیشآموزشی، یادگیری بازنمایی زبان بینایی را انجام میدهد. این امر Q-Former را مجبور میکند تا بازنمایی بصری مرتبطتر با متن را بیاموزد.

- مرحله دوم پیش آموزش، یادگیری مولد بینایی به زبان را با اتصال خروجی Q-Former به یک LLM منجمد انجام می دهد. Q-Former طوری آموزش داده شده است که نمایش بصری خروجی آن توسط LLM قابل تفسیر باشد.

نتایج چیست؟

- BLIP-2 نتایج استثنایی و پیشرفته ای را در انواع وظایف زبان بینایی ارائه می دهد که شامل پاسخگویی بصری به سؤالات، شرح تصاویر، و بازیابی تصویر-متن است.

- به عنوان مثال، در VQAv8.7 صفر شات 2 درصد بهتر از فلامینگو است.

- علاوه بر این، این عملکرد برجسته با راندمان رایانه به طور قابل توجهی بالاتر به دست می آید:

- BLIP-2 عملکرد بهتری از Flamingo-80B دارد در حالی که از پارامترهای آموزش پذیر 54× کمتر استفاده می کند.

- BLIP-2 ظرفیت تولید تصویر به متن صفر شات را در پاسخ به دستورالعملهای زبان طبیعی دارد، در نتیجه راه را برای توسعه مهارتهایی مانند استدلال دانش بصری و مکالمه بصری در میان دیگران هموار میکند.

- در نهایت، ذکر این نکته مهم است که BLIP-2 یک رویکرد همه کاره است که می تواند از مدل های پیچیده تری برای بهبود عملکرد پیش آموزش زبان بینایی استفاده کند.

از کجا درباره این تحقیق بیشتر بدانیم؟

کد پیاده سازی را از کجا می توان دریافت کرد؟

پیاده سازی رسمی BLIP-2 در دسترس است GitHub.

6. LLaMA توسط Meta AI

خلاصه

تیم هوش مصنوعی متا ادعا میکند که مدلهای کوچکتر که با توکنهای بیشتر آموزش داده میشوند، برای برنامههای کاربردی محصول خاص، آسانتر قابل آموزش و تنظیم دقیق هستند. لذا معرفی می کنند تماس می گیرد (Lظهور Laزبان Model Meta AI)، مجموعه ای از مدل های زبان پایه با پارامترهای 7B تا 65B. LLaMA 33B و 65B با 1.4 تریلیون توکن آموزش دیدند، در حالی که کوچکترین مدل، LLaMA 7B، با یک تریلیون توکن آموزش دیدند. آنها به طور انحصاری از مجموعه داده های در دسترس عموم، بدون وابستگی به داده های اختصاصی یا محدود استفاده می کردند. این تیم همچنین پیشرفتهای کلیدی معماری و تکنیکهای بهینهسازی سرعت آموزش را پیادهسازی کردند. در نتیجه، LLaMA-13B بهتر از GPT-3، بیش از 10 برابر کوچکتر بود، و LLaMA-65B عملکرد رقابتی با PaLM-540B از خود نشان داد.

هدف چیست؟

- برای نشان دادن امکانسنجی آموزش مدلهای با عملکرد برتر تنها بر روی مجموعه دادههای در دسترس عموم، بدون تکیه بر منابع داده اختصاصی یا محدود.

- ارائه مدلهای کوچکتر و کارآمدتر به جامعه پژوهشی و در نتیجه، امکان مطالعه مدلهای زبانی بزرگ برای کسانی که به زیرساختهای زیادی دسترسی ندارند.

چگونه به مشکل برخورد می شود؟

- برای آموزش مدل LLaMA، محققان تنها از دادههایی استفاده کردند که در دسترس عموم است و با منبع باز سازگار است.

- آنها همچنین چند پیشرفت در معماری استاندارد Transformer ارائه کرده اند:

- با اتخاذ روش GPT-3، پایداری آموزش با عادی سازی ورودی برای هر زیر لایه ترانسفورماتور، به جای عادی سازی خروجی، افزایش یافت.

- محققان با الهام از مدلهای PalM، غیرخطی بودن ReLU را با تابع فعالسازی SwiGLU جایگزین کردند تا عملکرد را بهبود بخشند.

- با الهام از سو و همکاران (2021)آنها تعبیههای موقعیتی مطلق را حذف کردند و به جای آن، تعبیههای موقعیتی چرخشی (RoPE) را در هر لایه از شبکه گنجاندند.

- در نهایت، تیم هوش مصنوعی متا سرعت آموزش مدل خود را با موارد زیر بهبود بخشید:

- استفاده از اجرای کارآمد توجه چند سر علّی با ذخیره نکردن وزن توجه یا محاسبه امتیازات کلید/پرس و جو پنهان شده.

- استفاده از چک پوینت برای به حداقل رساندن فعالسازیهای محاسبهشده مجدد در طول پاس به عقب.

- همپوشانی محاسبات فعالسازیها و ارتباط بین پردازندههای گرافیکی از طریق شبکه (به دلیل عملیات all_reduce).

نتایج چیست؟

- LLaMA-13B علیرغم اینکه بیش از 3 برابر کوچکتر است از GPT-10 پیشی می گیرد، در حالی که LLaMA-65B خود را در برابر PalM-540B حفظ می کند.

از کجا درباره این تحقیق بیشتر بدانیم؟

کد پیاده سازی را از کجا می توان دریافت کرد؟

- هوش مصنوعی متا دسترسی به LLaMA را برای محققان دانشگاهی، افراد مرتبط با دولت، جامعه مدنی، موسسات دانشگاهی و آزمایشگاههای تحقیقاتی صنعت جهانی بر اساس ارزیابی موردی فردی فراهم میکند. برای درخواست به آیدی زیر مراجعه کنید مخزن GitHub.

7. GPT-4 توسط OpenAI

خلاصه

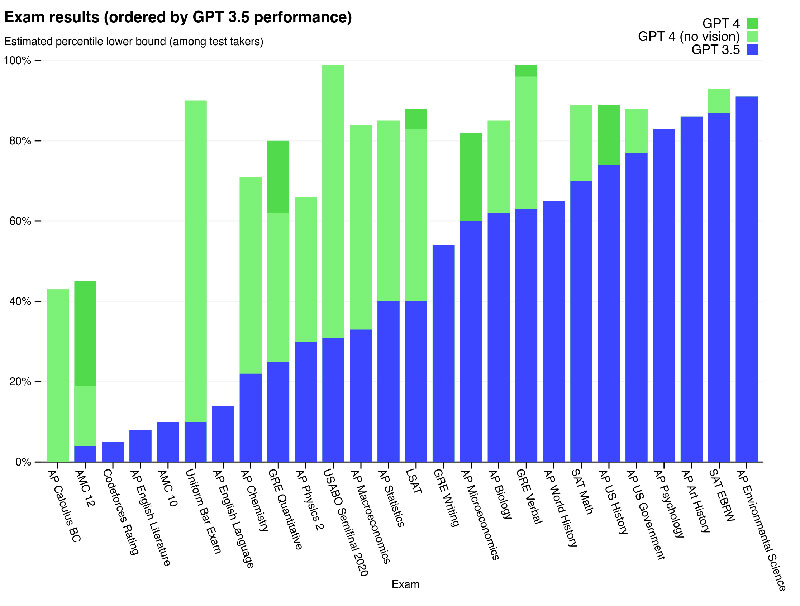

GPT-4 یک مدل چندوجهی در مقیاس بزرگ است که ورودی های تصویر و متن را می پذیرد و خروجی های متن را تولید می کند. به دلیل نگرانی های رقابتی و ایمنی، جزئیات خاصی در مورد معماری و آموزش مدل خودداری می شود. از نظر عملکرد، GPT-4 از مدلهای زبان قبلی در معیارهای سنتی پیشی میگیرد و پیشرفتهای قابلتوجهی در درک قصد کاربر و ویژگیهای ایمنی نشان میدهد. این مدل همچنین عملکردی در سطح انسانی در امتحانات مختلف به دست میآورد، از جمله امتیاز 10 درصدی در آزمون یکنواخت نواری شبیهسازی شده.

هدف چیست؟

- برای توسعه یک مدل چندوجهی در مقیاس بزرگ که می تواند ورودی های تصویر و متن را بپذیرد و خروجی های متن تولید کند.

- برای توسعه زیرساختها و روشهای بهینهسازی که در طیف وسیعی از مقیاسها رفتار قابل پیشبینی دارند.

چگونه به مشکل برخورد می شود؟

- با توجه به منظر رقابتی و مفاهیم ایمنی، OpenAI تصمیم گرفت جزئیات معماری، اندازه مدل، سختافزار، محاسبات آموزشی، ساخت مجموعه داده و روشهای آموزشی را مخفی کند.

- آنها افشا می کنند که:

- GPT-4 یک مدل مبتنی بر ترانسفورماتور است که از قبل برای پیشبینی نشانه بعدی در یک سند آموزش دیده است.

- از داده های در دسترس عموم و داده های مجوز شخص ثالث استفاده می کند.

- این مدل با استفاده از یادگیری تقویتی از بازخورد انسانی (RLHF) تنظیم شد.

- اطلاعات تایید نشده نشان می دهد که GPT-4 یک مدل متراکم منحصر به فرد مانند مدل های قبلی خود نیست، بلکه یک ائتلاف نیروگاه از هشت مدل جداگانه است که هر کدام دارای 220 میلیارد پارامتر است.

نتایج چیست؟

- GPT-4 در اکثر آزمونهای حرفهای و آکادمیک به عملکردی در سطح انسانی دست مییابد، بهویژه در آزمون یکنواخت نواری شبیهسازیشده، در ۱۰ درصد برتر امتیاز کسب میکند.

- مدل پایه از پیش آموزش دیده GPT-4 از مدل های زبان موجود و سیستم های پیشرفته قبلی در معیارهای NLP سنتی، بدون ساخت و سازهای خاص معیار یا پروتکل های آموزشی اضافی، بهتر عمل می کند.

- GPT-4 بهبود قابل توجهی را در نیت کاربر دنبال می کند، با پاسخ های آن به پاسخ های GPT-3.5 در 70.2٪ از 5,214 درخواست ChatGPT و OpenAI API ترجیح داده می شود.

- ویژگیهای ایمنی GPT-4 در مقایسه با GPT-3.5 با کاهش 82 درصدی در پاسخ به درخواستهای محتوای غیرمجاز و افزایش 29 درصدی در انطباق با خطمشیهای مربوط به درخواستهای حساس (مثلاً توصیههای پزشکی و آسیب رساندن به خود) به طور قابلتوجهی بهبود یافته است.

از کجا درباره این تحقیق بیشتر بدانیم؟

کد پیاده سازی را از کجا می توان دریافت کرد؟

- اجرای کد GPT-4 در دسترس نیست.

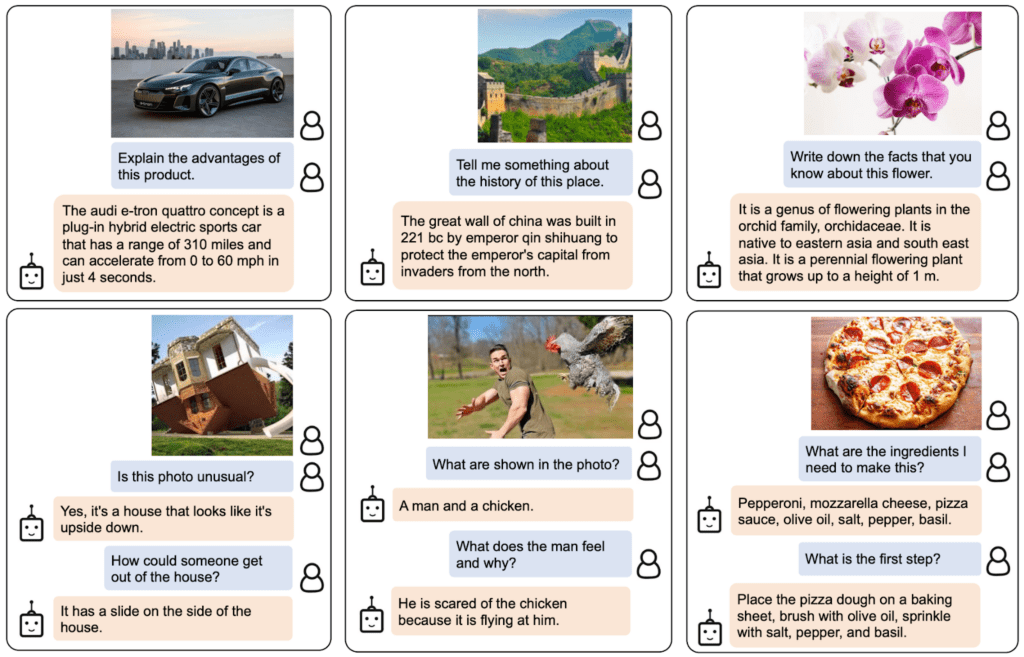

کاربردهای واقعی مدل های زبان بزرگ (ویژن).

مهمترین پیشرفتهای تحقیقاتی هوش مصنوعی در سالهای اخیر از مدلهای هوش مصنوعی بزرگی است که بر روی مجموعه دادههای عظیم آموزش دیدهاند. این مدلها عملکرد قابلتوجهی را نشان میدهند، و این شگفتانگیز است که فکر کنیم چگونه هوش مصنوعی میتواند کل صنایع مانند خدمات مشتری، بازاریابی، تجارت الکترونیک، مراقبتهای بهداشتی، توسعه نرمافزار، روزنامهنگاری و بسیاری دیگر را متحول کند.

مدل های زبان بزرگ کاربردهای متعددی در دنیای واقعی دارند. GPT-4 موارد زیر را فهرست می کند:

- درک زبان طبیعی و تولید برای چت بات ها و دستیاران مجازی.

- ترجمه ماشینی بین زبانها

- خلاصه مقالات، گزارش ها یا سایر اسناد متنی.

- تجزیه و تحلیل احساسات برای تحقیقات بازار یا نظارت بر رسانه های اجتماعی.

- تولید محتوا برای بازاریابی، رسانه های اجتماعی یا نوشتن خلاقانه.

- سیستم های پرسش و پاسخ برای پشتیبانی مشتری یا پایگاه های دانش.

- طبقه بندی متن برای فیلتر هرزنامه، دسته بندی موضوع یا سازماندهی اسناد.

- ابزارهای شخصی سازی شده برای یادگیری و آموزش زبان.

- تولید کد و کمک به توسعه نرم افزار.

- تجزیه و تحلیل و کمک اسناد پزشکی، حقوقی و فنی.

- ابزارهای دسترسی برای افراد دارای معلولیت، مانند تبدیل متن به گفتار و تبدیل گفتار به متن.

- خدمات تشخیص گفتار و رونویسی.

اگر یک بخش بصری اضافه کنیم، حوزه های برنامه های ممکن بیشتر گسترش می یابد:

بسیار هیجان انگیز است که پیشرفت های اخیر هوش مصنوعی را دنبال کنید و در مورد کاربردهای بالقوه آنها در دنیای واقعی فکر کنید. با این حال، قبل از استقرار این مدلها در زندگی واقعی، باید خطرات و محدودیتهای مربوطه را بررسی کنیم، که متاسفانه بسیار قابل توجه هستند.

خطرات و محدودیت ها

اگر از GPT-4 در مورد خطرات و محدودیتهای آن بپرسید، احتمالاً فهرست بلندبالایی از نگرانیهای مرتبط را در اختیار شما قرار میدهد. پس از فیلتر کردن این فهرست و اضافه کردن برخی ملاحظات اضافی، به مجموعه خطرات و محدودیتهای کلیدی زیر دست یافتم که مدلهای زبان بزرگ مدرن دارند:

- تعصب و تبعیض: این مدلها از حجم وسیعی از دادههای متنی که اغلب حاوی سوگیریها و محتوای تبعیضآمیز هستند، یاد میگیرند. در نتیجه، خروجی های تولید شده می توانند به طور ناخواسته کلیشه ها، زبان توهین آمیز و تبعیض بر اساس عواملی مانند جنسیت، نژاد یا مذهب را تداوم بخشند.

- اطلاعات غلط: مدلهای زبان بزرگ ممکن است محتوایی تولید کنند که از نظر واقعیات نادرست، گمراهکننده یا قدیمی باشد. در حالی که مدل ها بر روی طیف متنوعی از منابع آموزش دیده اند، ممکن است همیشه دقیق ترین یا به روزترین اطلاعات را ارائه ندهند. اغلب این اتفاق می افتد زیرا مدل تولید خروجی هایی را که از نظر گرامری صحیح هستند یا منسجم به نظر می رسند، اولویت می دهد، حتی اگر گمراه کننده باشند.

- عدم درک: اگرچه به نظر می رسد این مدل ها زبان انسان را درک می کنند، اما عمدتاً با شناسایی الگوها و ارتباط های آماری در داده های آموزشی عمل می کنند. آنها درک عمیقی از محتوایی که تولید می کنند ندارند، که گاهی اوقات می تواند منجر به خروجی های بی معنی یا نامربوط شود.

- محتوای نامناسب: مدلهای زبانی گاهی اوقات میتوانند محتوای توهینآمیز، مضر یا نامناسب تولید کنند. در حالی که تلاشهایی برای به حداقل رساندن چنین محتوایی انجام میشود، اما همچنان میتواند به دلیل ماهیت دادههای آموزشی و ناتوانی مدلها در تشخیص زمینه یا هدف کاربر رخ دهد.

نتیجه

مدلهای زبانی بزرگ بدون شک زمینه پردازش زبان طبیعی را متحول کرده و پتانسیل بسیار زیادی در افزایش بهرهوری در نقشها و صنایع مختلف نشان دادهاند. توانایی آنها در تولید متنی شبیه انسان، خودکارسازی کارهای روزمره و ارائه کمک در فرآیندهای خلاقانه و تحلیلی، آنها را به ابزاری ضروری در دنیای پرشتاب و تکنولوژی محور امروزی تبدیل کرده است.

با این حال، شناخت و درک محدودیت ها و خطرات مرتبط با این مدل های قدرتمند بسیار مهم است. مسائلی مانند سوگیری، اطلاعات غلط و احتمال استفاده مخرب را نمی توان نادیده گرفت. همانطور که ما به ادغام این فناوریهای مبتنی بر هوش مصنوعی در زندگی روزمره خود ادامه میدهیم، ایجاد تعادل بین استفاده از قابلیتهای آنها و اطمینان از نظارت انسانی، به ویژه در موقعیتهای حساس و پرخطر ضروری است.

اگر در پذیرش مسئولانه فناوریهای هوش مصنوعی موفق باشیم، راه را برای آیندهای هموار خواهیم کرد که در آن هوش مصنوعی و تخصص انسانی با هم همکاری کنند تا نوآوری را هدایت کنند و دنیایی بهتر برای همه ایجاد کنند.

از این مقاله لذت می برید؟ برای به روز رسانی های بیشتر تحقیقات هوش مصنوعی ثبت نام کنید.

زمانی که مقالات خلاصه بیشتری مانند این مقاله منتشر کنیم، به شما اطلاع خواهیم داد.

مربوط

- محتوای مبتنی بر SEO و توزیع روابط عمومی. امروز تقویت شوید.

- PlatoData.Network Vertical Generative Ai. به خودت قدرت بده دسترسی به اینجا.

- PlatoAiStream. هوش وب 3 دانش تقویت شده دسترسی به اینجا.

- PlatoESG. خودرو / خودروهای الکتریکی، کربن ، CleanTech، انرژی، محیط، خورشیدی، مدیریت پسماند دسترسی به اینجا.

- BlockOffsets. نوسازی مالکیت افست زیست محیطی. دسترسی به اینجا.

- منبع: https://www.topbots.com/top-language-models-transforming-ai-in-2023/

- : دارد

- :است

- :نه

- :جایی که

- $UP

- 1

- 10

- 12b

- 16

- 2%

- 2017

- 2021

- 2023

- 214

- 220

- 28

- 32

- 50

- 7

- 70

- 710

- 72

- 8

- 84

- 90

- a

- توانایی

- قادر

- درباره ما

- بالاتر

- مطلق

- دانشگاهی

- پذیرفتن

- قبول می کند

- دسترسی

- در دسترس

- تطبیق

- مطابق

- دقت

- دقیق

- دست

- دستیابی به

- دستیابی به

- اذعان

- در میان

- فعال سازی

- فعال سازی ها

- اعمال

- وفق دادن

- انطباق

- اضافه کردن

- اضافه کردن

- اضافه

- اضافی

- نشانی

- آدرس

- تصویب

- پیشرفت

- نصیحت

- پس از

- در برابر

- عامل

- AI

- تحقیق ai

- اهداف

- AL

- به طور یکسان

- معرفی

- اجازه دادن

- اجازه دادن

- اجازه می دهد تا

- در امتداد

- همچنین

- جایگزین

- هر چند

- همیشه

- در میان

- در میان

- مقدار

- مقدار

- an

- تحلیل

- تحلیلی

- و

- دیگر

- پاسخ

- هر

- API

- ظاهر شدن

- برنامه های کاربردی

- درخواست

- روش

- مناسب

- تقریبا

- معماری

- معماری

- هستند

- مناطق

- دور و بر

- صف

- هنر

- مقاله

- مقالات

- مصنوعی

- هوش مصنوعی

- AS

- کمک

- دستیاران

- مرتبط است

- انجمن

- At

- توجه

- نویسندگان

- خودکار بودن

- در دسترس

- میانگین

- اجتناب از

- جایزه

- برج میزان

- بار

- پایه

- مستقر

- اساسی

- اساس

- BE

- زیرا

- شدن

- قبل از

- بودن

- در زیر

- محک

- معیار

- مزایای

- بهتر

- میان

- تعصب

- تعصبات

- بیلیون

- کتاب

- خود راه انداز

- هر دو

- مرز

- دستیابی به موفقیت

- پیشرفت ها

- بریج

- پهن

- ساختن

- بنا

- ساخته

- اما

- by

- نام

- CAN

- نامزد

- نمی توان

- قابلیت های

- توانا

- ظرفیت

- دقیق

- مورد

- مصیبت بار

- علت

- مدیر عامل شرکت

- مدیر عامل و موسس

- به چالش کشیدن

- شانس

- تغییر دادن

- chatbots

- GPT چت

- چیپس

- ادعا

- طبقه بندی

- ابر

- بنیانگذاران

- رمز

- منسجم

- مجموعه

- ترکیب

- ترکیب

- بیا

- تعهد

- ارتباط

- انجمن

- مقایسه

- سازگار

- رقابتی

- مکمل

- پیچیده

- انطباق

- اجزاء

- محاسبه

- محاسبه

- کامپیوتر

- محاسبه

- مفهومی

- نگرانی ها

- پیکر بندی

- تایید شده

- اتصال

- در نتیجه

- ملاحظات

- ساخت و ساز

- محتوا

- زمینه

- زمینه ها

- ادامه دادن

- کنتراست

- گفتگو

- گفتگو

- تبدیل

- اصلاح

- متناظر

- هزینه

- هزینه

- میتوانست

- ایجاد

- ایجاد شده

- خالق

- قابل اعتماد

- بسیار سخت

- جاری

- مشتری

- خدمات مشتری

- پشتیبانی مشتریان

- لبه برش

- روزانه

- داده ها

- نقاط داده

- مجموعه داده ها

- تاریخ

- مصمم

- کاهش

- عمیق

- Deepmind

- ارائه

- نشان دادن

- نشان

- نشان می دهد

- نشان دادن

- توده مردم

- بستگی دارد

- استقرار

- طراحی

- با وجود

- جزئیات

- توسعه

- توسعه دهندگان

- در حال توسعه

- پروژه

- گفتگو

- گفتگو

- مشکل

- معلولیت

- افشای

- تبعیض

- تمیز دادن

- مختلف

- do

- سند

- اسناد و مدارک

- میکند

- تسلط

- آیا

- دوجین

- راندن

- دوبله شده

- دو

- در طی

- e

- تجارت الکترونیک

- E&T

- هر

- در اوایل

- آسان تر

- آموزش

- اثر

- به طور موثر

- بهره وری

- موثر

- تلاش

- حذف شد

- ظهور

- قادر ساختن

- را قادر می سازد

- شامل

- جذاب

- انگلیسی

- بالا بردن

- افزایش

- پیشرفت ها

- افزایش

- حصول اطمینان از

- ضروری است

- ایجاد

- ایجاد می کند

- اخلاقی

- ارزیابی

- ارزیابی

- ارزیابی

- حتی

- هر

- همه چیز

- مدرک

- در حال تحول

- معاینه

- مثال

- مثال ها

- بیش از

- استثنایی

- مهیج

- منحصرا

- نمایشگاه ها

- موجود

- گسترش

- آزمایش

- تخصص

- بررسی

- خارجی

- f1

- تسهیل کردن

- عوامل

- سقوط

- خانواده

- بسیار

- شگفت انگیز

- سریع گام

- ویژگی

- ویژه

- امکانات

- باز خورد

- کمی از

- کمتر

- رشته

- شکل

- فیلتر

- پیدا کردن

- نام خانوادگی

- رفع

- ثابت

- به دنبال

- پیروی

- برای

- اشکال

- مبانی

- موسس

- چارچوب

- از جانب

- منجمد

- تابع

- اساسی

- اساساً

- بیشتر

- آینده

- به دست آورد

- شکاف

- جنس

- تولید می کنند

- تولید

- تولید می کند

- مولد

- نسل

- مولد

- هوش مصنوعی مولد

- ژنراتور

- دریافت کنید

- GitHub

- نظر اجمالی

- جهانی

- Go

- هدف

- رفتن

- خوب

- گوگل

- گوگل

- دولت

- GPU ها

- درجه

- پیشگامانه

- گروه

- بود

- اتفاق می افتد

- سخت

- سخت افزار

- مضر

- آیا

- داشتن

- بهداشت و درمان

- اینجا کلیک نمایید

- با کیفیت بالا

- کیفیت بالا

- ریسک بالا

- بالاتر

- بالاترین

- دارای

- چگونه

- اما

- HTML

- HTTPS

- بزرگ

- انسان

- صدها نفر

- هیپ

- تنظیم فراپارامتر

- اندیشه

- شناسایی

- if

- تصویر

- تصاویر

- عظیم

- پیاده سازی

- اجرا

- پیامدهای

- مهم

- موثر

- بهبود

- بهبود یافته

- بهبود

- ارتقاء

- in

- در عمق

- عجز

- شامل

- مشمول

- از جمله

- ادغام شده

- شامل

- گنجاندن

- افزایش

- افزایش

- افزایش

- به طور فزاینده

- فرد

- افراد

- لوازم

- صنعت

- اطلاعات

- شالوده

- شروع می کند

- ابداع

- ورودی

- ورودی

- در عوض

- موسسات

- دستورالعمل

- ادغام

- اطلاعات

- قصد

- جالب

- به

- معرفی

- معرفی

- اختراع

- موضوع

- مسائل

- IT

- ITS

- خود

- روزنامه نگاری

- JPG

- تنها

- کلید

- اهداف کلیدی

- دانستن

- دانش

- آزمایشگاه

- عدم

- چشم انداز

- زبان

- زبان ها

- بزرگ

- در مقیاس بزرگ

- بزرگترین

- آخرین

- لایه

- لایه

- رهبری

- یاد گرفتن

- یادگیری

- قانونی

- کمتر

- سطح

- سطح

- قدرت نفوذ

- اهرم ها

- بهره برداری

- مجاز

- زندگی

- سبک وزن

- پسندیدن

- احتمالا

- محدودیت

- فهرست

- لیست

- زندگی

- پشم لاما

- به صورت محلی

- منطقی

- طولانی

- نگاه کنيد

- خیلی

- کم

- ماشین آلات

- ساخته

- ساخت

- باعث می شود

- بسیاری

- مارکوس

- بازار

- تحقیقات بازار

- بازار یابی (Marketing)

- ماده

- ریاضی

- حداکثر عرض

- بیشترین

- ممکن است..

- معنی دار

- رسانه ها

- پزشکی

- ادغام کردن

- متا

- روش شناسی

- روش

- مایکروسافت

- ذهن

- حداقل

- اطلاعات غلط

- گمراه کننده

- اشتباهات

- مخلوط

- ML

- مدل

- مدل

- مدرن

- اصلاح شده

- نظارت بر

- بیش

- اکثر

- بسیار

- چندگانه

- مسلمانان

- طبیعی

- زبان طبیعی

- پردازش زبان طبیعی

- طبیعت

- نیاز

- ضروری

- شبکه

- عصبی

- زبان عصبی

- شبکه های عصبی

- جدید

- اخبار

- بعد

- خوب

- nlp

- به ویژه

- هیچ چی

- عدد

- متعدد

- هدف

- اهداف

- رخ می دهد

- of

- توهین آمیز

- رسمی

- غالبا

- on

- ONE

- آنهایی که

- فقط

- باز کن

- منبع باز

- OpenAI

- کار

- عملیات

- بهینه سازی

- or

- کدام سازمان ها

- دیگر

- دیگران

- ما

- خارج

- بهتر از

- عملکرد بهتر

- تولید

- برجسته

- روی

- خود

- نخل

- مقاله

- نمونه

- پارامتر

- پارامترهای

- بخش

- شرکت کردن

- ویژه

- عبور

- الگوهای

- سنگفرش

- سنگفرش

- برای

- انجام دادن

- کارایی

- انجام

- انجام می دهد

- عبارات

- انتخاب کنید

- افلاطون

- هوش داده افلاطون

- PlatoData

- غلاف

- نقطه

- نقطه

- سیاست

- ممکن

- پتانسیل

- صفحه اصلی

- قوی

- پیش بینی

- مرجح

- قبلی

- در درجه اول

- قبلا

- اولویت بندی

- مشکل

- مشکلات

- روند

- فرآیندهای

- در حال پردازش

- تولید کردن

- محصول

- بهره وری

- حرفه ای

- برنامه نويسي

- زبانهای برنامه نویسی

- پیشرفت

- امید بخش

- املاک

- پیشنهاد می کند

- اختصاصی

- پروتکل

- ارائه

- ارائه

- فراهم می کند

- عمومی

- منتشر شده

- اهداف

- هل دادن

- پــایتــون

- مارماهی

- کیفی

- کیفیت

- سوال

- سوالات

- به سرعت

- نژاد

- محدوده

- سریعا

- نسبتا

- مطالعه

- واقعی

- زندگی واقعی

- دنیای واقعی

- اخیر

- تازه

- به رسمیت شناختن

- شناختن

- كاهش دادن

- کاهش

- رژیمها

- تقویت یادگیری

- آزاد

- منتشر شد

- مربوط

- قابل اعتماد

- منابع معتبر

- دین

- تکیه بر

- ماندن

- باقی مانده است

- قابل توجه

- جایگزین

- گزارش ها

- نمایندگی

- درخواست

- نیاز

- نیاز

- تحقیق

- جامعه پژوهشی

- محققان

- منابع فشرده

- احترام

- پاسخ دادن

- پاسخ

- پاسخ

- منحصر

- نتیجه

- نتایج

- حفظ می کند

- بررسی

- انقلابی کردن

- انقلابی

- خطرات

- رقابت

- تنومند

- نقش

- اتاق

- امن

- ایمنی

- salesforce

- همان

- مقیاس

- مقیاس ها

- مقیاس گذاری

- سناریوها

- صحنه های

- مدرسه

- نمره

- نمرات

- به ثمر رساندن

- یکپارچه

- دوم

- به نظر می رسد

- مشاهده گردید

- انتخاب شد

- حساس

- جداگانه

- سلسله

- جدی

- سرویس

- خدمات

- تنظیم

- محیط

- چند

- شوکه

- کوتاه

- نشان

- نشان داد

- نشان می دهد

- امضاء

- قابل توجه

- به طور قابل توجهی

- به طور مشابه

- مفرد

- شرایط

- اندازه

- مهارت ها

- کوچکتر

- So

- تا حالا

- آگاهی

- رسانه های اجتماعی

- جامعه

- نرم افزار

- توسعه نرم افزار

- فقط

- راه حل

- حل می کند

- برخی از

- مصنوعی

- منبع

- منابع

- سپارش

- اسپم

- خاص

- به طور خاص

- اختصاصی

- دیدنی و جذاب

- گفتار به متن

- سرعت

- ثبات

- صحنه

- مراحل

- استاندارد

- استانداردهای

- دولت

- وضعیت هنر

- آماری

- ارقام

- هنوز

- استراتژی

- نقاط قوت

- ضربه

- مهاجرت تحصیلی

- قابل توجه

- موفق شدن

- چنین

- نشان می دهد

- حاکی از

- خلاصه

- برتر

- نظارت

- پشتیبانی

- پیشی گرفت

- سیستم

- سیستم های

- مذاکرات

- کار

- وظایف

- تیم

- فنی

- تکنیک

- فن آوری

- قوانین و مقررات

- آزمون

- تولید متن

- تبدیل متن به گفتار

- نسبت به

- با تشکر

- که

- La

- آینده

- دولت

- جهان

- شان

- آنها

- سپس

- آنجا.

- در نتیجه

- از این رو

- اینها

- آنها

- فکر می کنم

- شخص ثالث

- این

- کسانی که

- اگر چه؟

- هزاران نفر

- سه

- از طریق

- بار

- به

- امروز

- با هم

- رمز

- از Tokenization

- نشانه

- هم

- ابزار

- بالا

- TOPBOTS

- موضوع

- تاپیک

- طرف

- سنتی

- قطار

- آموزش دیده

- آموزش

- انتقال

- ترانسفورماتور

- تبدیل شدن

- ترجمه

- تریلیون

- تورینگ

- تدریس خصوصی

- دو

- بدون قید و شرط

- زیر

- فهمیدن

- درک

- بعهده گرفتن

- بی شک

- متاسفانه

- جهان

- بر خلاف

- در جریان روز

- به روز رسانی

- استفاده کنید

- استفاده

- کاربر

- استفاده

- با استفاده از

- استفاده می کند

- تنوع

- مختلف

- وسیع

- همه کاره

- بسیار

- تصویری

- فیلم های

- مجازی

- دید

- VOX

- بود

- مسیر..

- we

- وب

- خوب

- بود

- چی

- چه زمانی

- که

- در حین

- WHO

- تمام

- وسیع

- دامنه گسترده

- ویکیپدیا

- اراده

- با

- در داخل

- بدون

- کلمات

- مهاجرت کاری

- همکاری

- جهان

- نوشته

- سال

- هنوز

- شما

- زفیرنت

- آموزش صفر شات