اهمیت انبارهای داده و تجزیه و تحلیل های انجام شده بر روی پلتفرم های انبار داده در طول سال ها به طور پیوسته در حال افزایش بوده است، و بسیاری از کسب و کارها به این سیستم ها تکیه می کنند که هم برای تصمیم گیری عملیاتی کوتاه مدت و هم برای برنامه ریزی استراتژیک بلندمدت مهم هستند. به طور سنتی، انبارهای داده در چرخه های دسته ای، به عنوان مثال، ماهانه، هفتگی یا روزانه به روز می شوند تا کسب و کارها بتوانند بینش های مختلفی را از آنها به دست آورند.

بسیاری از سازمانها متوجه شدهاند که دریافت دادهها در زمان واقعی همراه با تجزیه و تحلیل پیشرفته فرصتهای جدیدی را ایجاد میکند. به عنوان مثال، یک مؤسسه مالی می تواند با اجرای یک برنامه تشخیص ناهنجاری در حالت تقریباً واقعی و نه در حالت دسته ای، تقلبی بودن تراکنش کارت اعتباری را پیش بینی کند.

در این پست نحوه انجام آن را نشان می دهیم آمازون Redshift می تواند پیش بینی های جذب جریان و یادگیری ماشین (ML) را همه در یک پلتفرم ارائه دهد.

Amazon Redshift یک انبار داده ابری سریع، مقیاس پذیر، ایمن و کاملاً مدیریت شده است که تجزیه و تحلیل تمام داده های شما را با استفاده از SQL استاندارد ساده و مقرون به صرفه می کند.

Amazon Redshift ML ایجاد، آموزش و اعمال مدل های ML با استفاده از دستورات آشنای SQL در انبارهای داده Amazon Redshift را برای تحلیلگران داده و توسعه دهندگان پایگاه داده آسان می کند.

ما برای راه اندازی هیجان زده هستیم آمازون Redshift مصرف جریانی برای آمازون کینزیس جریان داده و آمازون پخش جریانی را برای آپاچی کافکا مدیریت کرد (Amazon MSK)، که به شما امکان می دهد داده ها را مستقیماً از جریان داده های Kinesis یا موضوع کافکا بدون نیاز به مرحله بندی داده ها دریافت کنید. سرویس ذخیره سازی ساده آمازون (Amazon S3). جذب جریانی Amazon Redshift به شما این امکان را میدهد که به تأخیر کم در مرتبه چند ثانیه دست یابید در حالی که صدها مگابایت داده را در انبار داده خود وارد میکنید.

این پست نشان میدهد که چگونه Amazon Redshift، انبار دادههای ابری، به شما امکان میدهد تا پیشبینیهای ML را در زمان واقعی با استفاده از انتقال جریان Amazon Redshift و ویژگیهای Redshift ML با زبان آشنای SQL ایجاد کنید.

بررسی اجمالی راه حل

با دنبال کردن مراحل ذکر شده در این پست، می توانید یک برنامه پخش کننده تولید کننده را در یک برنامه راه اندازی کنید. ابر محاسبه الاستیک آمازون نمونه (Amazon EC2) که تراکنشهای کارت اعتباری را شبیهسازی میکند و دادهها را در زمان واقعی به Kinesis Data Streams منتقل میکند. شما در آمازون Redshift، که در آن دادههای پخش جریانی دریافت میشود، یک نمای عملی شده در Amazon Redshift Streaming Ingestion تنظیم کردهاید. شما یک مدل Redshift ML را آموزش میدهید و میسازید تا استنتاجهای بلادرنگ را در برابر دادههای جریان ایجاد کنید.

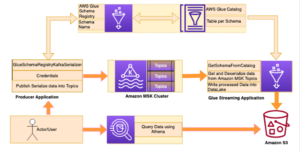

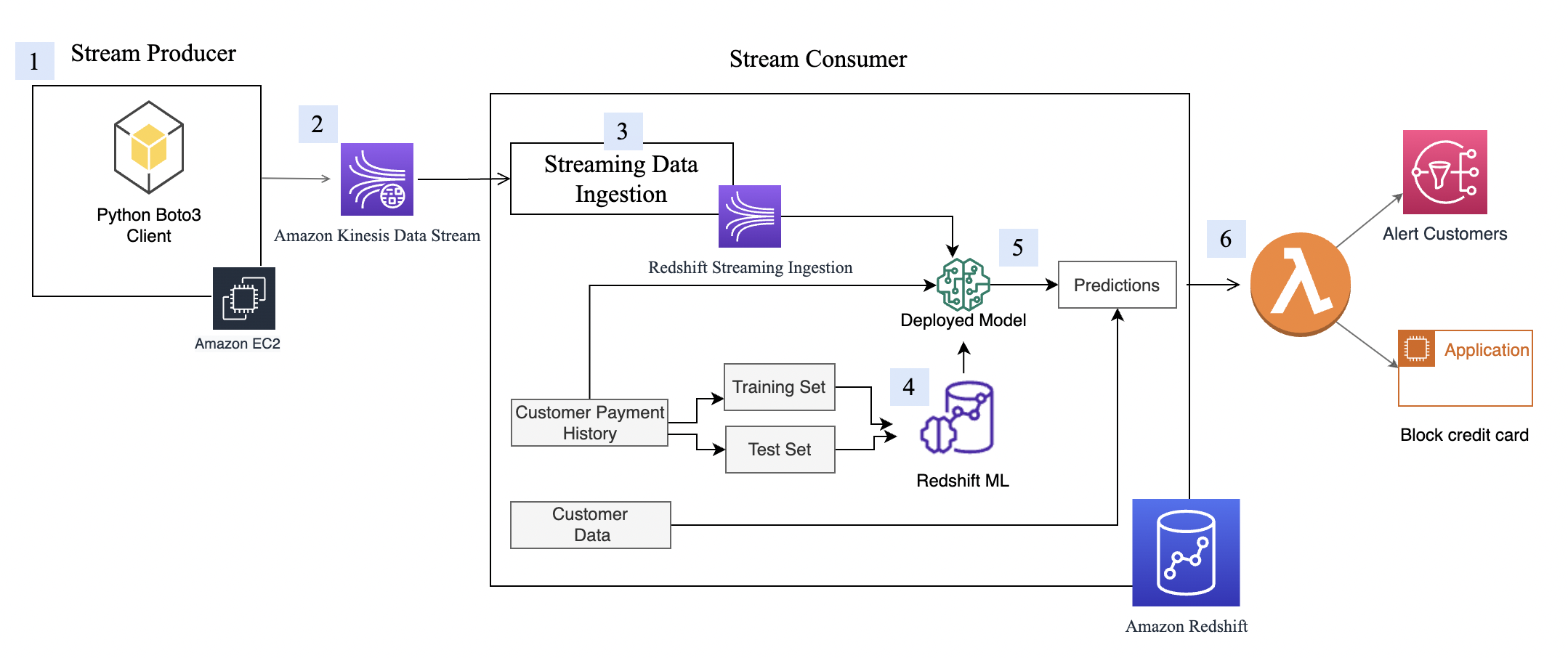

نمودار زیر معماری و جریان فرآیند را نشان می دهد.

روند گام به گام به شرح زیر است:

- نمونه EC2 یک برنامه تراکنش کارت اعتباری را شبیه سازی می کند که تراکنش های کارت اعتباری را در جریان داده های Kinesis قرار می دهد.

- جریان داده، داده های تراکنش کارت اعتباری ورودی را ذخیره می کند.

- یک نمای عملی شده از Amazon Redshift Streaming Ingestion در بالای جریان داده ایجاد می شود که به طور خودکار داده های جریانی را به Amazon Redshift وارد می کند.

- شما یک مدل ML را با استفاده از Redshift ML می سازید، آموزش می دهید و به کار می برید. مدل Redshift ML با استفاده از داده های تراکنشی تاریخی آموزش داده شده است.

- شما داده های جریان را تغییر می دهید و پیش بینی های ML را ایجاد می کنید.

- برای کاهش خطر می توانید به مشتریان هشدار دهید یا برنامه را به روز کنید.

این راهنما از دادههای جریان تراکنش کارت اعتباری استفاده میکند. داده های تراکنش کارت اعتباری ساختگی است و بر اساس الف است شبیه ساز. مجموعه داده مشتری نیز ساختگی است و با برخی از توابع داده تصادفی تولید می شود.

پیش نیازها

- یک خوشه آمازون Redshift ایجاد کنید.

- خوشه را برای استفاده از Redshift ML پیکربندی کنید.

- ساختن an هویت AWS و مدیریت دسترسی کاربر (IAM).

- نقش IAM متصل به خوشه Redshift را بهروزرسانی کنید تا مجوزهای دسترسی به جریان داده Kinesis را شامل شود. برای اطلاعات بیشتر در مورد خط مشی مورد نیاز، مراجعه کنید شروع به جذب جریانی.

- یک نمونه m5.4xlarge EC2 ایجاد کنید. ما برنامه Producer را با نمونه m5.4xlarge آزمایش کردیم، اما شما آزاد هستید که از نوع نمونه دیگری استفاده کنید. هنگام ایجاد نمونه، از amzn2-ami-kernel-5.10-hvm-2.0.20220426.0-x86_64-gp2 AMI.

- برای اطمینان از اینکه Python3 در نمونه EC2 نصب شده است، دستور زیر را برای تأیید نسخه پایتون خود اجرا کنید (توجه داشته باشید که اسکریپت استخراج داده فقط روی پایتون 3 کار می کند):

- برای اجرای برنامه شبیه ساز بسته های وابسته زیر را نصب کنید:

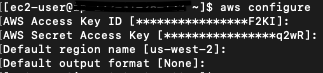

- آمازون EC2 را با استفاده از متغیرهایی مانند اعتبارنامه AWS که برای کاربر IAM ایجاد شده در مرحله 3 بالا ایجاد شده است، پیکربندی کنید. تصویر زیر نمونه ای از استفاده را نشان می دهد پیکربندی aws.

Kinesis Data Streams را تنظیم کنید

Amazon Kinesis Data Streams یک سرویس جریان داده در زمان واقعی مقیاس پذیر و بادوام است. این می تواند به طور مداوم گیگابایت داده در ثانیه از صدها هزار منبع، مانند جریان های کلیک وب سایت، جریان رویدادهای پایگاه داده، تراکنش های مالی، فید رسانه های اجتماعی، گزارش های فناوری اطلاعات، و رویدادهای ردیابی مکان را ضبط کند. دادههای جمعآوریشده در میلیثانیه برای فعال کردن موارد استفاده از تجزیه و تحلیل بلادرنگ مانند داشبوردهای بیدرنگ، تشخیص ناهنجاری در زمان واقعی، قیمتگذاری پویا و موارد دیگر در دسترس هستند. ما از Kinesis Data Streams استفاده میکنیم زیرا این یک راهحل بدون سرور است که میتواند بر اساس میزان استفاده مقیاسبندی شود.

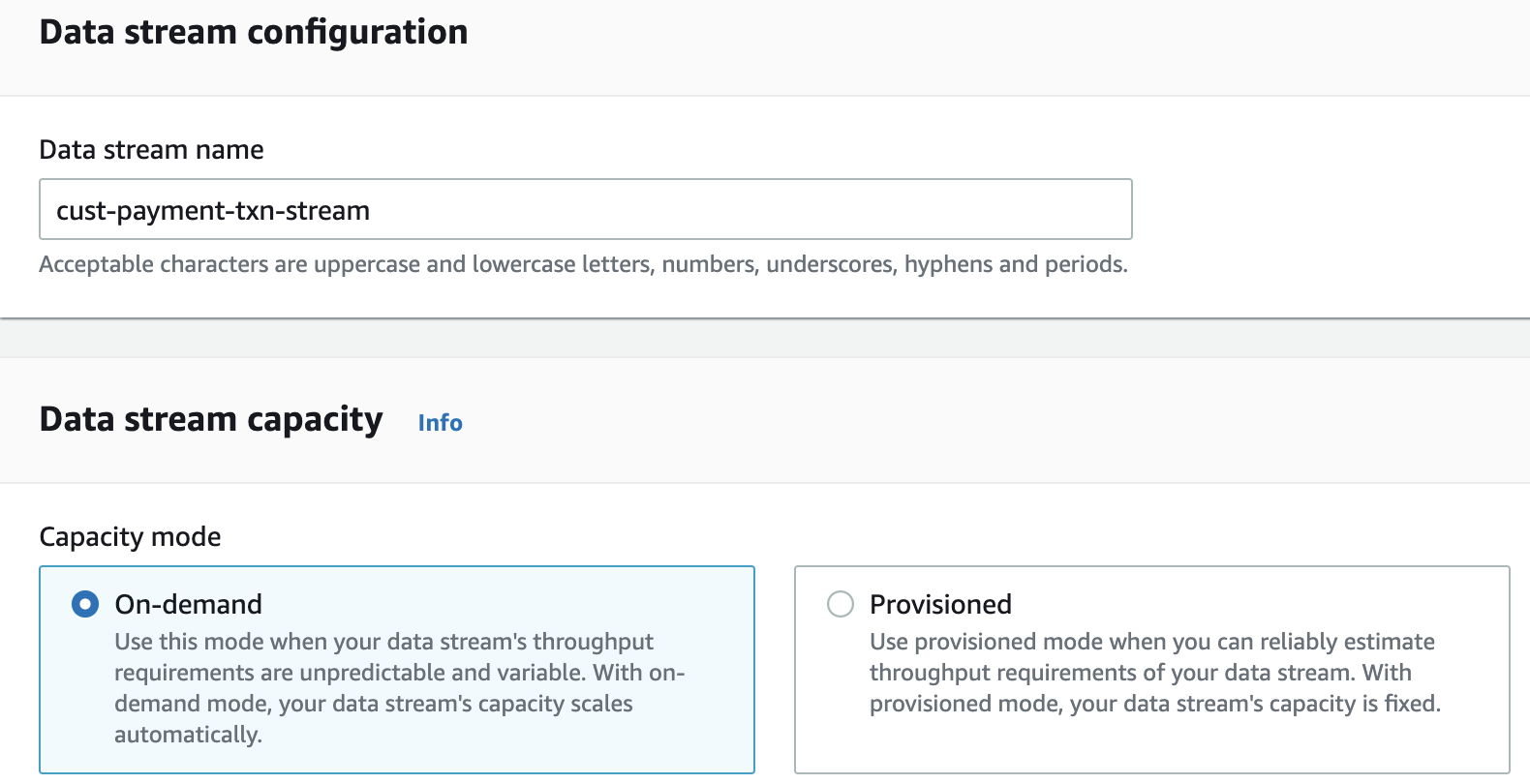

یک جریان داده Kinesis ایجاد کنید

ابتدا باید یک جریان داده Kinesis برای دریافت داده های جریان ایجاد کنید:

- در کنسول آمازون Kinesis، انتخاب کنید جریان های داده در صفحه ناوبری

- را انتخاب کنید ایجاد جریان داده.

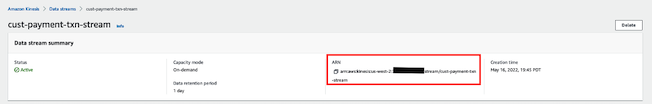

- برای نام جریان داده، وارد

cust-payment-txn-stream. - برای حالت ظرفیت، انتخاب کنید بر اساس تقاضا.

- برای بقیه گزینه ها، گزینه های پیش فرض را انتخاب کنید و دستورات را دنبال کنید تا تنظیمات کامل شود.

- ARN را برای جریان داده ایجاد شده ضبط کنید تا در بخش بعدی هنگام تعریف خط مشی IAM از آن استفاده کنید.

مجوزها را تنظیم کنید

برای اینکه یک برنامه پخش جریانی بتواند به Kinesis Data Streams بنویسد، برنامه باید به Kinesis دسترسی داشته باشد. میتوانید از بیانیه خطمشی زیر استفاده کنید تا به فرآیند شبیهسازی که در بخش بعدی راهاندازی کردهاید، به جریان داده دسترسی داشته باشید. از ARN جریان داده ای که در مرحله قبل ذخیره کرده اید استفاده کنید.

سازنده جریان را پیکربندی کنید

قبل از اینکه بتوانیم داده های جریانی را در Amazon Redshift مصرف کنیم، به یک منبع داده جریانی نیاز داریم که داده ها را در جریان داده Kinesis بنویسد. این پست از یک تولید کننده داده سفارشی ساخته شده استفاده می کند AWS SDK برای پایتون (Boto3) برای انتشار داده ها در جریان داده. برای دستورالعمل های راه اندازی، مراجعه کنید شبیه ساز تولید کننده. این فرآیند شبیه ساز، داده های جریانی را در جریان داده ایجاد شده در مرحله قبل منتشر می کند (cust-payment-txn-stream).

مصرف کننده جریان را پیکربندی کنید

این بخش در مورد پیکربندی مصرف کننده جریان (نمایش جذب جریانی آمازون Redshift) صحبت می کند.

Amazon Redshift Streaming Ingestion انتقال دادههای جریانی از Kinesis Data Streams را با تأخیر کم و سرعت بالا در نمای تحقق یافته Amazon Redshift فراهم میکند. میتوانید خوشه Redshift آمازون خود را برای فعال کردن انتقال جریان و ایجاد نمای واقعی با بهروزرسانی خودکار، با استفاده از عبارات SQL پیکربندی کنید، همانطور که در ایجاد نماهای مادی در آمازون Redshift. فرآیند بهروزرسانی نمای واقعی، دادههای جریانی را با صدها مگابایت داده در ثانیه از Kinesis Data Streams به Amazon Redshift وارد میکند. این منجر به دسترسی سریع به داده های خارجی می شود که به سرعت به روز می شوند.

پس از ایجاد نمای تحقق یافته، می توانید با استفاده از SQL به داده های خود از جریان داده دسترسی داشته باشید و خطوط لوله داده خود را با ایجاد نماهای تحقق یافته مستقیماً در بالای جریان ساده کنید.

مراحل زیر را برای پیکربندی نمای واقعی پخش جریانی Amazon Redshift انجام دهید:

- در کنسول IAM، خط مشی ها را در صفحه پیمایش انتخاب کنید.

- را انتخاب کنید ایجاد خط مشی.

- یک خط مشی جدید IAM به نام ایجاد کنید

KinesisStreamPolicy. برای تعریف خط مشی جریان، نگاه کنید شروع به جذب جریانی. - در صفحه پیمایش، را انتخاب کنید نقش.

- ایجاد نقش را انتخاب کنید.

- انتخاب کنید سرویس AWS و انتخاب کنید Redshift و Redshift قابل تنظیم است.

- یک نقش جدید به نام ایجاد کنید

redshift-streaming-roleو خط مشی را پیوست کنیدKinesisStreamPolicy. - یک طرح واره خارجی برای نگاشت به جریان داده های Kinesis ایجاد کنید:

اکنون می توانید یک نمای مادی شده برای مصرف داده های جریان ایجاد کنید. میتوانید از نوع داده SUPER برای ذخیره بار به شکلی که هست، در قالب JSON استفاده کنید یا از توابع Amazon Redshift JSON برای تجزیه دادههای JSON به ستونهای جداگانه استفاده کنید. برای این پست از روش دوم استفاده می کنیم زیرا طرحواره به خوبی تعریف شده است.

- نمای تحقق یافته جذب جریانی را ایجاد کنید

cust_payment_tx_stream. با مشخص کردن AUTO REFRESH YES در کد زیر، میتوانید بهروزرسانی خودکار نمای انتقال جریان را فعال کنید، که با اجتناب از ایجاد خطوط لوله داده در زمان صرفهجویی میکند:

توجه داشته باشید که json_extract_path_text دارای محدودیت طول 64 کیلوبایت است. همچنین from_varbye رکوردهای بزرگتر از 65 کیلوبایت را فیلتر می کند.

- داده ها را تازه کنید.

نمای واقعی پخش جریانی Amazon Redshift به طور خودکار توسط Amazon Redshift برای شما به روز می شود. به این ترتیب، شما نیازی به نگرانی در مورد کهنگی داده ها ندارید. با بهروزرسانی خودکار نمای واقعی، دادهها بهطور خودکار در آمازون Redshift بارگذاری میشوند که در جریان در دسترس قرار میگیرند. اگر این عملیات را به صورت دستی انجام دهید، از دستور زیر استفاده کنید:

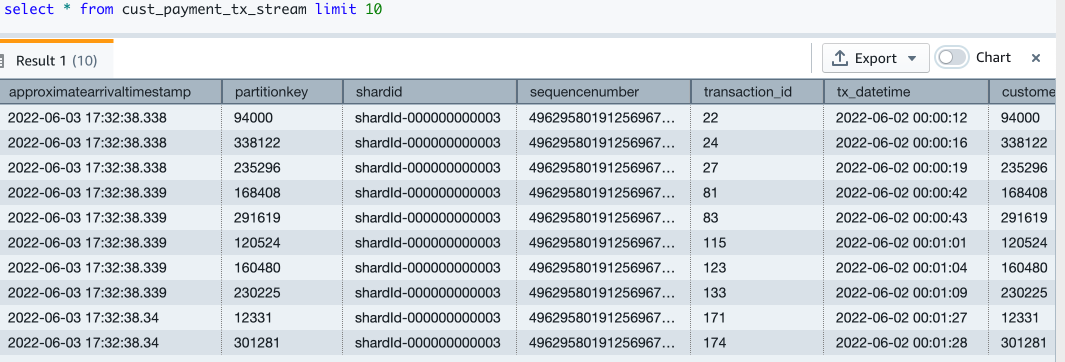

- اکنون بیایید نمای اجرا شده جریان را پرس و جو کنیم تا داده های نمونه را ببینیم:

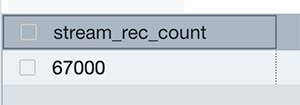

- بیایید بررسی کنیم که اکنون چند رکورد در نمای پخش جریانی وجود دارد:

اکنون راه اندازی نمای جذب جریانی Amazon Redshift را به پایان رسانده اید که به طور مداوم با داده های تراکنش کارت اعتباری ورودی به روز می شود. در راهاندازیام، میبینم که در زمانی که جستجوی تعداد انتخابی خود را اجرا کردم، حدود 67,000 رکورد به نمای استریم کشیده شدهاند. این عدد می تواند برای شما متفاوت باشد.

Redshift ML

با Redshift ML، می توانید یک مدل ML از پیش آموزش دیده را بیاورید یا به صورت بومی بسازید. برای اطلاعات بیشتر مراجعه کنید استفاده از یادگیری ماشین در آمازون Redshift.

در این پست یک مدل ML را با استفاده از مجموعه داده های تاریخی آموزش داده و می سازیم. داده ها حاوی الف هستند tx_fraud فیلدی که یک تراکنش تاریخی را بهعنوان جعلی یا غیر تقلبی علامتگذاری میکند. ما یک مدل ML نظارت شده با استفاده از Redshift Auto ML می سازیم، که از این مجموعه داده یاد می گیرد و تراکنش های دریافتی را زمانی که از طریق توابع پیش بینی اجرا می شوند، پیش بینی می کند.

در بخشهای بعدی، نحوه تنظیم مجموعه دادههای تاریخی و دادههای مشتری را نشان میدهیم.

مجموعه داده تاریخی را بارگیری کنید

جدول تاریخی دارای فیلدهای بیشتری نسبت به منبع داده جریانی است. این فیلدها حاوی جدیدترین هزینه مشتری و امتیاز ریسک پایانی است، مانند تعداد تراکنشهای جعلی محاسبهشده با تبدیل دادههای جریانی. همچنین متغیرهای طبقه بندی شده ای مانند تراکنش های آخر هفته یا تراکنش های شبانه وجود دارد.

برای بارگیری داده های تاریخی، دستورات را با استفاده از ویرایشگر درخواست آمازون Redshift.

جدول تاریخچه تراکنش ها را با کد زیر ایجاد کنید. DDL را نیز می توان در یافت کرد GitHub.

بیایید بررسی کنیم که چند تراکنش بارگیری شده است:

روند معاملات ماهانه کلاهبرداری و غیر کلاهبرداری را بررسی کنید:

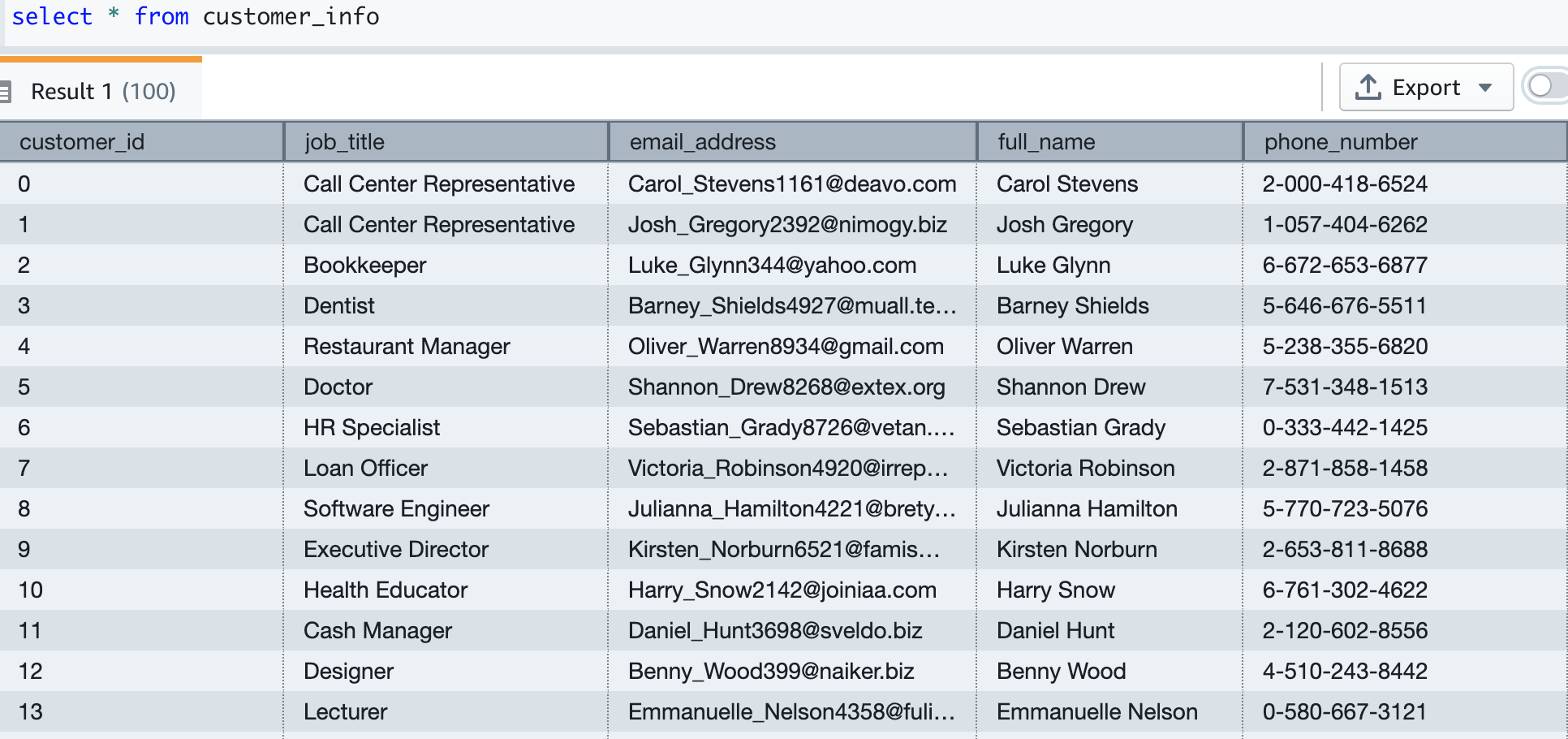

ایجاد و بارگذاری اطلاعات مشتری

اکنون جدول مشتری را ایجاد می کنیم و داده های بارگیری می کنیم که حاوی ایمیل و شماره تلفن مشتری است. کد زیر جدول را ایجاد می کند، داده ها را بارگذاری می کند و از جدول نمونه برداری می کند. جدول DDL در دسترس است GitHub.

داده های آزمایشی ما حدود 5,000 مشتری دارد. تصویر زیر نمونه داده های مشتری را نشان می دهد.

یک مدل ML بسازید

جدول تراکنش کارت تاریخی ما دارای 6 ماه داده است که اکنون از آن برای آموزش و آزمایش مدل ML استفاده می کنیم.

مدل فیلدهای زیر را به عنوان ورودی می گیرد:

ما گرفتیم tx_fraud به عنوان خروجی

ما این داده ها را به مجموعه داده های آموزشی و آزمایشی تقسیم کردیم. معاملات از 2022-04-01 تا 2022-07-31 برای مجموعه آموزشی است. معاملات از 2022-08-01 تا 2022-09-30 برای مجموعه آزمایشی استفاده می شود.

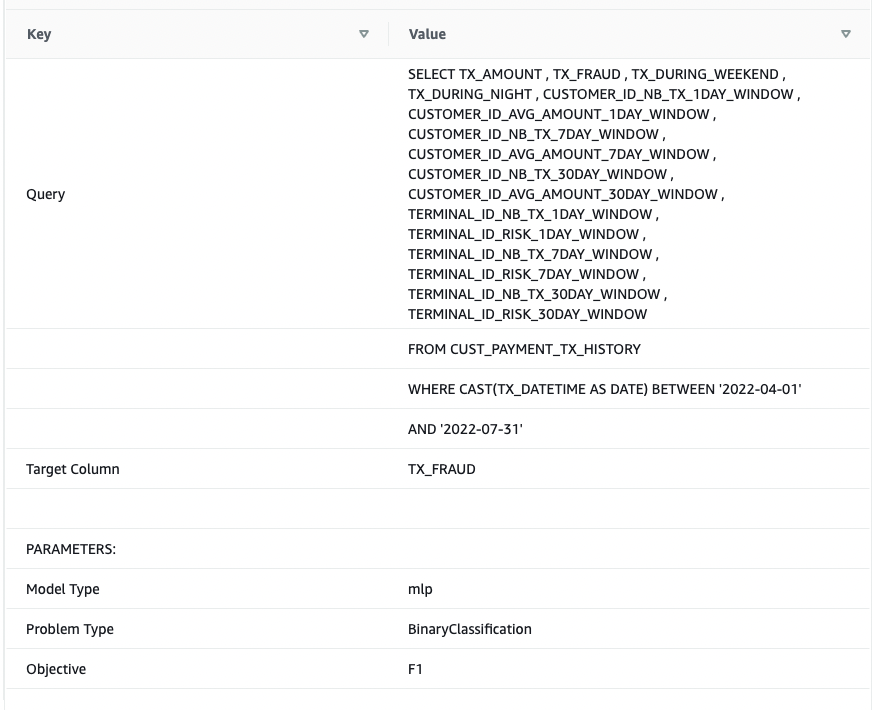

بیایید مدل ML را با استفاده از SQL آشنا ایجاد کنیم عبارت CREATE MODEL. ما از فرم اصلی دستور Redshift ML استفاده می کنیم. روش زیر استفاده می کند Amazon SageMaker Autopilotکه آماده سازی داده ها، مهندسی ویژگی ها، انتخاب مدل و آموزش را به صورت خودکار برای شما انجام می دهد. نام سطل S3 خود را حاوی کد ارائه کنید.

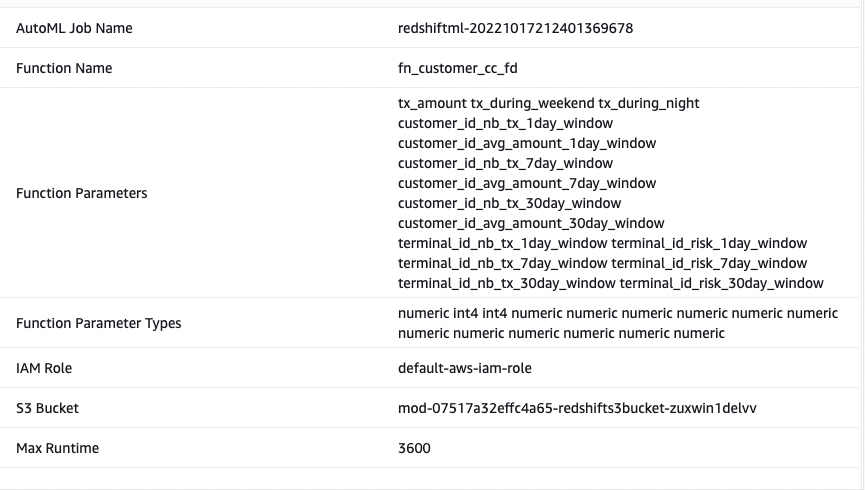

من مدل ML را به عنوان می نامم Cust_cc_txn_fd، و تابع پیش بینی به عنوان fn_customer_cc_fd. عبارت FROM ستون های ورودی جدول تاریخی را نشان می دهد public.cust_payment_tx_history. پارامتر هدف تنظیم شده است tx_fraud، که متغیر هدفی است که می خواهیم پیش بینی کنیم. IAM_Role روی پیش فرض تنظیم شده است زیرا خوشه با این نقش پیکربندی شده است. اگر نه، باید نقش ARN را در Cluster Redshift آمازون IAM ارائه دهید. من تنظیم کردم max_runtime به 3,600 ثانیه، که زمانی است که ما به SageMaker برای تکمیل فرآیند می دهیم. Redshift ML بهترین مدلی را که در این بازه زمانی شناسایی شده است به کار می گیرد.

بسته به پیچیدگی مدل و مقدار داده، ممکن است مدتی طول بکشد تا مدل در دسترس باشد. اگر متوجه شدید که انتخاب مدل شما تکمیل نشده است، مقدار برای را افزایش دهید max_runtime. می توانید حداکثر مقدار 9999 را تنظیم کنید.

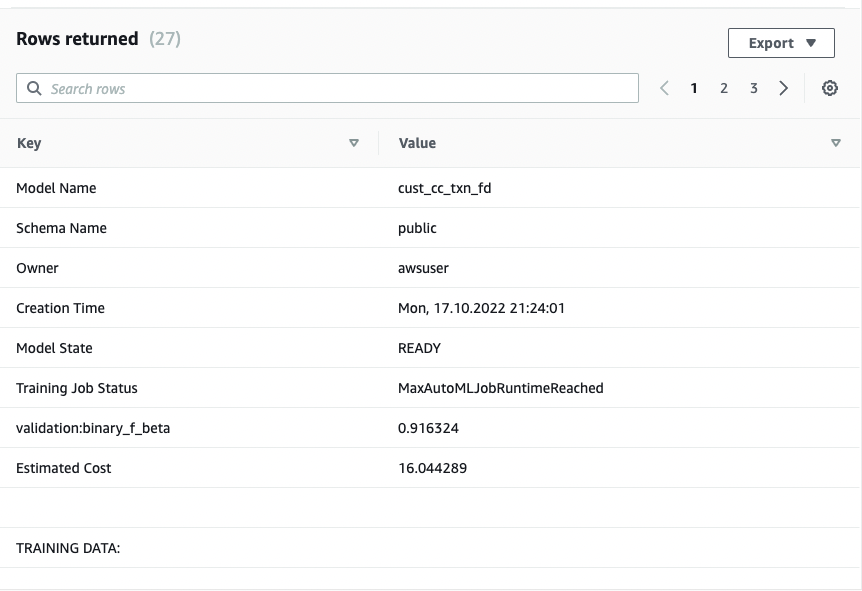

دستور CREATE MODEL به صورت ناهمزمان اجرا می شود، یعنی در پس زمینه اجرا می شود. می توانید استفاده کنید نشان دادن مدل دستور مشاهده وضعیت مدل. هنگامی که وضعیت به عنوان آماده نشان داده می شود، به این معنی است که مدل آموزش دیده و مستقر شده است.

اسکرین شات های زیر خروجی ما را نشان می دهند.

از خروجی می بینم که مدل به درستی شناسایی شده است BinaryClassificationو F1 به عنوان هدف انتخاب شده است. را امتیاز F1 معیاری است که هر دو را در نظر می گیرد دقت و یادآوری. مقداری بین 1 (دقت و یادآوری کامل) و 0 (کمترین امتیاز ممکن) برمی گرداند. در مورد من 0.91 است. هر چه مقدار بالاتر باشد، عملکرد مدل بهتر است.

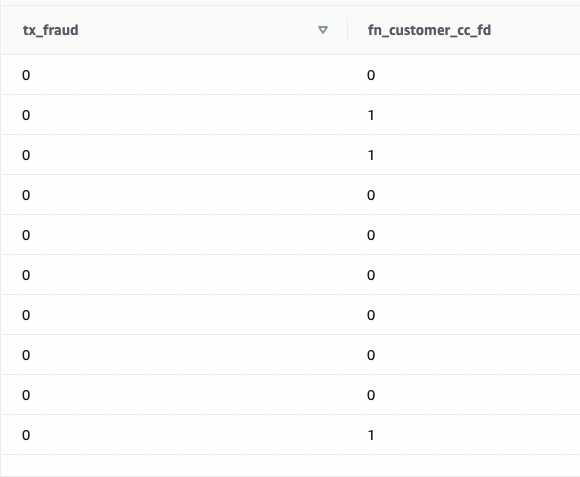

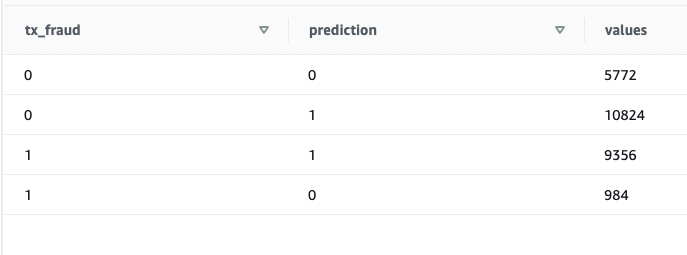

بیایید این مدل را با مجموعه داده آزمایشی آزمایش کنیم. دستور زیر را اجرا کنید که نمونه های پیش بینی را بازیابی می کند:

می بینیم که برخی از ارزش ها مطابقت دارند و برخی دیگر مطابقت ندارند. بیایید پیش بینی ها را با حقیقت زمین مقایسه کنیم:

ما تأیید کردیم که مدل کار می کند و امتیاز F1 خوب است. بیایید به تولید پیشبینیها در جریان دادهها ادامه دهیم.

پیش بینی معاملات تقلبی

از آنجایی که مدل Redshift ML آماده استفاده است، میتوانیم از آن برای اجرای پیشبینیها در برابر انتقال دادههای جریانی استفاده کنیم. مجموعه داده تاریخی دارای فیلدهای بیشتری نسبت به آنچه ما در منبع داده جریان داریم است، اما آنها فقط معیارهای اخیر و فرکانس در اطراف مشتری و ریسک پایانه برای یک تراکنش متقلبانه هستند.

ما میتوانیم با تعبیه SQL در نماها، تبدیلها را به راحتی در بالای دادههای جریان اعمال کنیم. ایجاد کنید نمای اول، که داده های جریانی را در سطح مشتری جمع می کند. سپس ایجاد کنید نمای دوم، که داده های جریانی را در سطح ترمینال جمع می کند و نمای سوم، که داده های تراکنش ورودی را با داده های جمع آوری شده مشتری و پایانه ترکیب می کند و تابع پیش بینی را در یک مکان فراخوانی می کند. کد نمای سوم به شرح زیر است:

یک عبارت SELECT را روی View اجرا کنید:

همانطور که بیانیه SELECT را به طور مکرر اجرا می کنید، آخرین تراکنش های کارت اعتباری از طریق تحولات و پیش بینی های ML در زمان تقریباً واقعی انجام می شود.

این قدرت آمازون Redshift را نشان میدهد – با دستورات SQL با استفاده آسان، میتوانید دادههای جریان را با اعمال توابع پنجره پیچیده تغییر دهید و یک مدل ML را برای پیشبینی تراکنشهای جعلی در یک مرحله، بدون ایجاد خطوط لوله داده پیچیده یا ساخت و مدیریت اعمال کنید. زیرساخت های اضافی

راه حل را گسترش دهید

از آنجایی که جریان های داده در و پیش بینی های ML تقریباً در زمان واقعی انجام می شود، می توانید فرآیندهای تجاری را برای هشدار دادن به مشتری خود با استفاده از آن ایجاد کنید. سرویس اطلاع رسانی ساده آمازون (Amazon SNS)، یا می توانید حساب کارت اعتباری مشتری را در یک سیستم عملیاتی قفل کنید.

این پست به جزئیات این عملیات نمیپردازد، اما اگر میخواهید درباره ساخت راهحلهای رویداد محور با استفاده از Amazon Redshift اطلاعات بیشتری کسب کنید، به موارد زیر مراجعه کنید. مخزن GitHub.

پاک کردن

برای جلوگیری از تحمیل هزینه های بعدی، منابعی را که به عنوان بخشی از این پست ایجاد شده اند حذف کنید.

نتیجه

در این پست، نحوه راهاندازی یک جریان داده Kinesis، پیکربندی یک سازنده و انتشار دادهها در جریانها، و سپس ایجاد نمای Amazon Redshift Streaming Ingestion و پرسوجو از دادهها در Amazon Redshift را نشان دادیم. پس از اینکه داده ها در خوشه آمازون Redshift قرار گرفتند، نشان دادیم که چگونه یک مدل ML را آموزش دهیم و یک تابع پیش بینی بسازیم و آن را در برابر داده های جریانی اعمال کنیم تا پیش بینی هایی در زمان واقعی ایجاد کنیم.

اگر بازخورد یا سوالی دارید، لطفاً آنها را در نظرات مطرح کنید.

درباره نویسنده

بانو پیتامپلی یک معمار راه حل متخصص تجزیه و تحلیل است که در دالاس مستقر است. او در ساخت راه حل های تحلیلی تخصص دارد. سابقه او در انبارهای داده - معماری، توسعه و مدیریت است. او بیش از 15 سال در زمینه داده و تجزیه و تحلیل فعالیت داشته است.

بانو پیتامپلی یک معمار راه حل متخصص تجزیه و تحلیل است که در دالاس مستقر است. او در ساخت راه حل های تحلیلی تخصص دارد. سابقه او در انبارهای داده - معماری، توسعه و مدیریت است. او بیش از 15 سال در زمینه داده و تجزیه و تحلیل فعالیت داشته است.

پراوین کادیپیکوندا یک معمار ارشد راه حل متخصص تجزیه و تحلیل در AWS مستقر در دالاس است. او به مشتریان کمک می کند تا راه حل های تحلیلی کارآمد، کارآمد و مقیاس پذیر بسازند. او بیش از 15 سال با ساخت پایگاه های داده و راه حل های انبار داده کار کرده است.

پراوین کادیپیکوندا یک معمار ارشد راه حل متخصص تجزیه و تحلیل در AWS مستقر در دالاس است. او به مشتریان کمک می کند تا راه حل های تحلیلی کارآمد، کارآمد و مقیاس پذیر بسازند. او بیش از 15 سال با ساخت پایگاه های داده و راه حل های انبار داده کار کرده است.

ریتش کومار سینها یک معمار راه حل متخصص تجزیه و تحلیل است که در سانفرانسیسکو مستقر است. او بیش از 16 سال است که به مشتریان کمک کرده است تا راه حل های ذخیره سازی داده مقیاس پذیر و کلان داده بسازند. او عاشق طراحی و ساخت راهحلهای کارآمد end-to-end در AWS است. او در اوقات فراغت خود عاشق خواندن، پیاده روی و یوگا است.

ریتش کومار سینها یک معمار راه حل متخصص تجزیه و تحلیل است که در سانفرانسیسکو مستقر است. او بیش از 16 سال است که به مشتریان کمک کرده است تا راه حل های ذخیره سازی داده مقیاس پذیر و کلان داده بسازند. او عاشق طراحی و ساخت راهحلهای کارآمد end-to-end در AWS است. او در اوقات فراغت خود عاشق خواندن، پیاده روی و یوگا است.

- محتوای مبتنی بر SEO و توزیع روابط عمومی. امروز تقویت شوید.

- پلاتوبلاک چین. Web3 Metaverse Intelligence. دانش تقویت شده دسترسی به اینجا.

- منبع: https://aws.amazon.com/blogs/big-data/near-real-time-fraud-detection-using-amazon-redshift-streaming-ingestion-with-amazon-kinesis-data-streams-and-amazon-redshift-ml/

- 000

- 000 مشتری

- 1

- 10

- 100

- 11

- سال 15

- 67

- 7

- 9

- a

- قادر

- درباره ما

- بالاتر

- دسترسی

- حساب

- رسیدن

- عمل

- اضافی

- حکومت

- پیشرفته

- پس از

- در برابر

- هوشیار

- معرفی

- اجازه می دهد تا

- آمازون

- آمازون EC2

- آمازون کینسیس

- مقدار

- تحلیلگران

- تحلیلی

- علم تجزیه و تحلیل

- تحلیل

- و

- تشخیص ناهنجاری

- آپاچی

- کاربرد

- درخواست

- با استفاده از

- معماری

- دور و بر

- ضمیمه کردن

- خودکار

- اتوماتیک

- بطور خودکار

- در دسترس

- اجتناب از

- AWS

- زمینه

- مستقر

- اساسی

- زیرا

- شود

- بهترین

- بهتر

- میان

- بزرگ

- بزرگ داده

- به ارمغان بیاورد

- ساختن

- بنا

- کسب و کار

- فرآیندهای کسب و کار

- کسب و کار

- صدا

- نام

- تماس ها

- گرفتن

- کارت

- مورد

- موارد

- شخصیت

- بار

- بررسی

- را انتخاب کنید

- شهر:

- ابر

- خوشه

- رمز

- ستون ها

- ترکیب

- آینده

- نظرات

- مقايسه كردن

- کامل

- تکمیل

- پیچیده

- پیچیدگی

- محاسبه

- در نظر می گیرد

- کنسول

- مصرف

- مصرف کننده

- شامل

- مقرون به صرفه

- میتوانست

- ایجاد

- ایجاد شده

- ایجاد

- ایجاد

- مجوزها و اعتبارات

- اعتبار

- کارت اعتباری

- مشتری

- اطلاعات مشتری

- مشتریان

- چرخه

- روزانه

- دالاس

- داده ها

- آماده سازی داده ها

- انبار داده

- انبارهای داده

- پایگاه داده

- پایگاه های داده

- مجموعه داده ها

- تاریخ

- تصمیم گیری

- به طور پیش فرض

- تعریف کردن

- ارائه

- نشان

- وابسته

- گسترش

- مستقر

- مستقر می کند

- شرح داده شده

- طرح

- جزئیات

- کشف

- توسعه دهندگان

- پروژه

- مختلف

- مستقیما

- نمی کند

- عمل

- آیا

- دیو

- پویا

- به آسانی

- آسان برای استفاده

- اثر

- موثر

- پست الکترونیک

- قادر ساختن

- را قادر می سازد

- پشت سر هم

- مهندسی

- وارد

- اتر (ETH)

- واقعه

- حوادث

- مثال

- برانگیخته

- خارجی

- استخراج

- f1

- آشنا

- FAST

- ویژگی

- امکانات

- باز خورد

- رشته

- زمینه

- فیلترها برای تصفیه آب

- مالی

- پیدا کردن

- پرچم ها

- جریان

- به دنبال

- پیروی

- به دنبال آن است

- فرم

- قالب

- یافت

- FRAME

- فرانسیسکو

- تقلب

- کشف تقلب

- رایگان

- فرکانس

- از جانب

- کاملا

- تابع

- توابع

- آینده

- تولید می کنند

- تولید

- مولد

- ژنراتور

- دریافت کنید

- دادن

- Go

- خوب

- اعطا کردن

- زمین

- گروه

- داشتن

- کمک کرد

- کمک می کند

- بالاتر

- نماد

- تاریخی

- تاریخ

- چگونه

- چگونه

- HTML

- HTTPS

- صدها نفر

- IAM

- شناسایی

- هویت

- اهمیت

- in

- شامل

- وارد شونده

- افزایش

- افزایش

- فرد

- اطلاعات

- شالوده

- ورودی

- درج می کند

- بینش

- نصب

- نمونه

- موسسه

- دستورالعمل

- علاقه مند

- IT

- پیوستن

- json

- کافکا

- جریان داده های Kinesis

- زبان

- بزرگتر

- تاخیر

- آخرین

- راه اندازی

- یادگیری

- ترک کردن

- طول

- سطح

- محدود

- محدودیت

- بار

- بارهای

- دراز مدت

- کم

- دستگاه

- فراگیری ماشین

- ساخته

- ساخت

- باعث می شود

- اداره می شود

- مدیریت

- دستی

- بسیاری

- نقشه

- انبوه

- مطابق

- ماتپلوتلب

- حداکثر

- به معنی

- رسانه ها

- روش

- متری

- متریک

- کاهش

- ML

- حالت

- مدل

- مدل

- ماهیانه

- ماه

- بیش

- اکثر

- حرکت

- نام

- جهت یابی

- نیاز

- نیازهای

- جدید

- بعد

- اخطار

- عدد

- بی حس

- هدف

- ONE

- باز می شود

- عمل

- قابل استفاده

- عملیات

- فرصت ها

- گزینه

- سفارش

- سازمان های

- دیگر

- مشخص شده

- بسته

- پانداها

- قطعه

- پارامتر

- بخش

- کامل

- انجام دادن

- کارایی

- انجام می دهد

- مجوز

- تلفن

- محل

- برنامه ریزی

- سکو

- سیستم عامل

- افلاطون

- هوش داده افلاطون

- PlatoData

- لطفا

- سیاست

- سیاست

- ممکن

- پست

- قدرت

- دقت

- پیش بینی

- پیش گویی

- پیش بینی

- پیش بینی می کند

- قبلی

- قیمت گذاری

- روند

- فرآیندهای

- تهيه كننده

- برنامه

- ارائه

- فراهم می کند

- عمومی

- منتشر کردن

- پــایتــون

- سوالات

- به سرعت

- تصادفی

- مطالعه

- اماده

- واقعی

- زمان واقعی

- داده های زمان واقعی

- تحقق

- گرفتن

- اخذ شده

- اخیر

- به رسمیت شناخته شده

- سوابق

- به طور مکرر

- جایگزین کردن

- ضروری

- منابع

- منابع

- REST

- نتایج

- بازده

- خطر

- نقش

- دویدن

- در حال اجرا

- حکیم ساز

- سان

- سان فرانسیسکو

- مقیاس پذیر

- مقیاس

- تصاویر

- sdk

- متولد دریا

- دوم

- ثانیه

- بخش

- بخش

- امن

- انتخاب شد

- انتخاب

- بدون سرور

- سرویس

- تنظیم

- محیط

- تنظیمات

- برپایی

- کوتاه مدت

- نشان

- نشان می دهد

- ساده

- ساده کردن

- شبیه ساز

- So

- آگاهی

- رسانه های اجتماعی

- راه حل

- مزایا

- برخی از

- منبع

- منابع

- متخصص

- تخصص دارد

- خرج کردن

- انشعاب

- SQL

- صحنه

- استاندارد

- آغاز شده

- دولت

- بیانیه

- اظهارات

- وضعیت

- گام

- مراحل

- ذخیره سازی

- opbevare

- پرده

- استراتژیک

- جریان

- جریان

- سرویس جریان

- جریان

- چنین

- فوق العاده

- سیستم

- سیستم های

- جدول

- گرفتن

- طول می کشد

- مذاکرات

- هدف

- پایانه

- آزمون

- La

- سوم

- هزاران نفر

- از طریق

- زمان

- برچسب زمان

- به

- بالا

- موضوع

- به طور سنتی

- قطار

- آموزش دیده

- آموزش

- معامله

- معامله ای

- معاملات

- دگرگون کردن

- تحولات

- تبدیل شدن

- روند

- بروزرسانی

- به روز شده

- استفاده

- استفاده کنید

- کاربر

- تایید شده

- ارزش

- ارزشها

- مختلف

- حقیقت

- نسخه

- چشم انداز

- نمایش ها

- راه رفتن

- خرید

- انبار کالا

- انبارداری

- سایت اینترنتی

- اخر هفته

- هفتگی

- چی

- که

- در حین

- ویکیپدیا

- اراده

- بدون

- مشغول به کار

- کارگر

- با این نسخهها کار

- نوشتن

- سال

- ریاضت

- شما

- زفیرنت