Kliendid kasutavad Amazoni punane nihe juhtida oma ärikriitilist analüüsi petabaitide struktureeritud ja poolstruktureeritud andmete põhjal. Apache Spark on populaarne raamistik, mida saate kasutada rakenduste loomiseks selliste kasutusjuhtumite jaoks nagu ETL (väljavõte, teisendamine ja laadimine), interaktiivne analüüs ja masinõpe (ML). Apache Spark võimaldab teil luua rakendusi erinevates keeltes, nagu Java, Scala ja Python, pääsedes juurde oma Amazon Redshifti andmelaos olevatele andmetele.

Apache Sparki Amazon Redshift integratsioon aitab arendajatel Amazon Redshifti andmetel Apache Sparki rakendusi sujuvalt luua ja käivitada. Arendajad saavad kasutada AWS-i analüütikat ja ML-teenuseid, näiteks Amazon EMR, AWS liimja Amazon SageMaker et luua vaevata Apache Sparki rakendusi, mis loevad nende Amazon Redshifti andmelaost ja kirjutavad sinna. Saate seda teha ilma, et see kahjustaks oma rakenduste toimivust või andmete tehingute järjepidevust.

Selles postituses arutame, miks on Apache Sparki Amazon Redshifti integreerimine analüütika ja ML-i jaoks kriitiline ja tõhus. Lisaks arutame kasutusjuhtumeid, mis kasutavad ettevõttele mõju avaldamiseks Amazon Redshifti integratsiooni Apache Sparkiga. Lõpuks tutvustame teile samm-sammult näiteid selle ametliku AWS-pistiku kasutamise kohta Apache Sparki rakenduses.

Amazon Redshift integratsioon Apache Sparkile

Amazon Redshift integratsioon Apache Sparkile minimeerib tülika ja sageli käsitsi säde-punanihke pistiku seadistamise protsessi (kogukonna versioon) ning lühendab analüüsi- ja ML-ülesanneteks valmistumiseks kuluvat aega. Peate vaid määrama ühenduse oma andmelaoga ja saate mõne minuti jooksul alustada tööd Amazon Redshifti andmetega oma Apache Sparki-põhistest rakendustest.

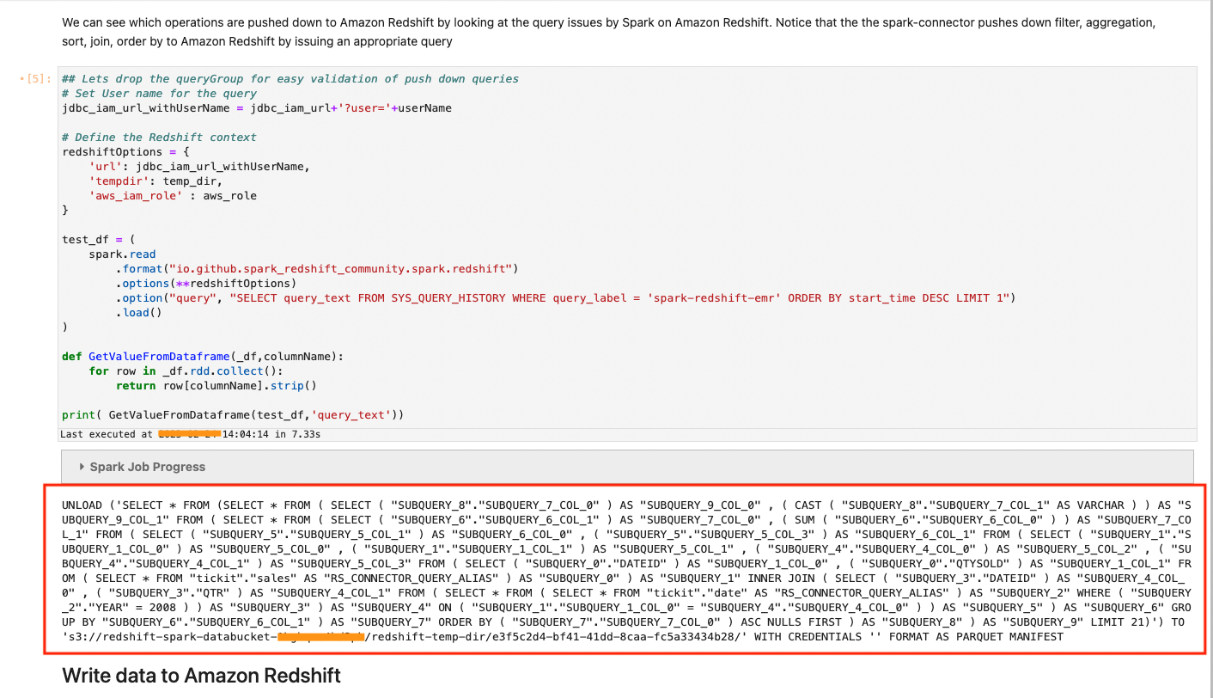

Saate kasutada mitmeid tõukefunktsioone selliste toimingute jaoks nagu sortimine, koondamine, piiramine, ühendamine ja skalaarfunktsioonid, nii et teie Amazon Redshifti andmelaost kuluvasse Apache Sparki rakendusse teisaldatakse ainult asjakohased andmed. See võimaldab teil oma rakenduste jõudlust parandada. Amazon Redshifti administraatorid saavad Sparki-põhistest rakendustest loodud SQL-i hõlpsalt tuvastada. Selles postituses näitame, kuidas saate teada Apache Sparki töö genereeritud SQL-i.

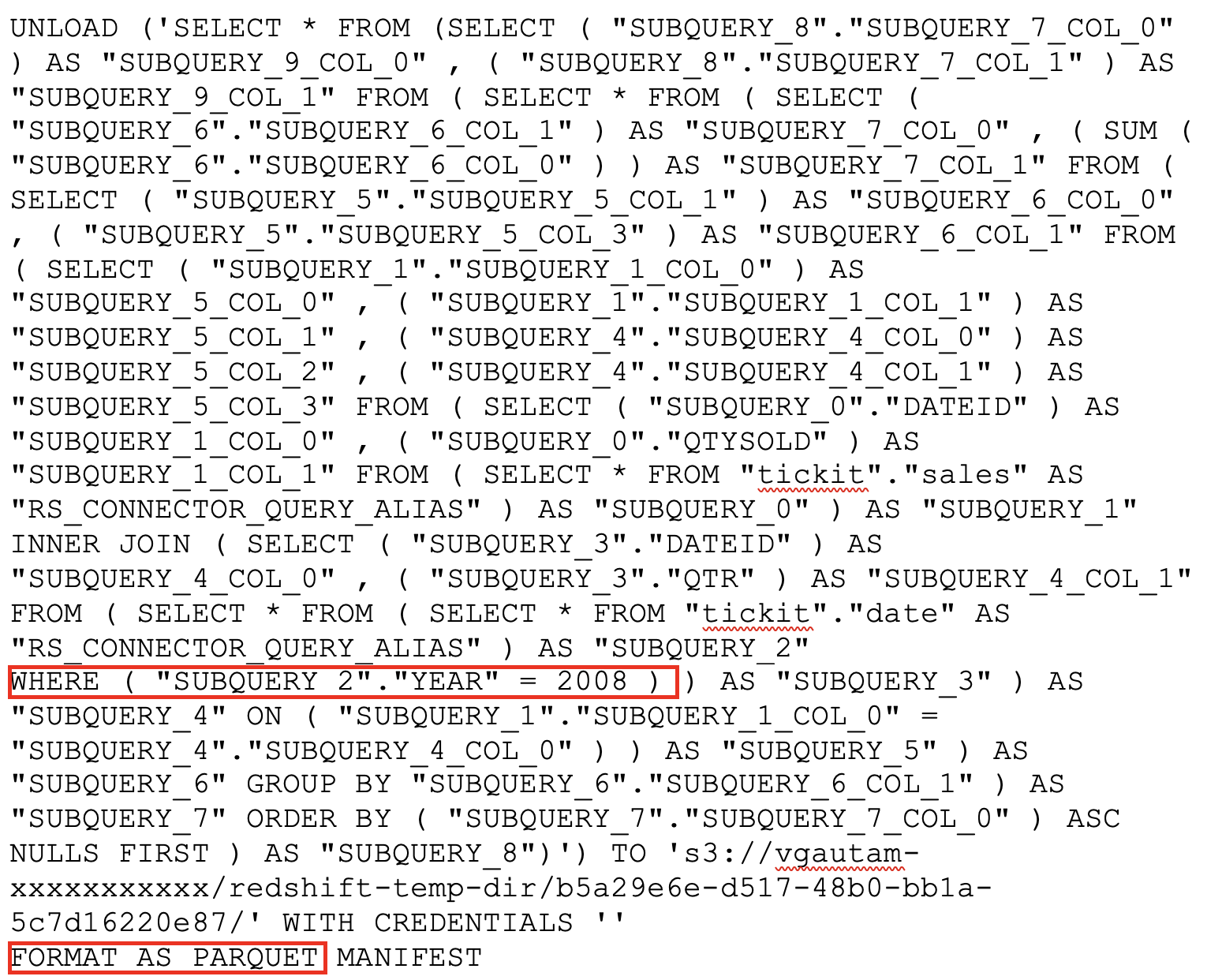

Lisaks kasutab Apache Sparki Amazon Redshift integratsioon andmete ajutisse kataloogi paigutamisel Parquet-failivormingut. Amazon Redshift kasutab nende ajutiste andmete salvestamiseks käsku UNLOAD SQL Amazoni lihtne salvestusteenus (Amazon S3). Rakendus Apache Spark hangib tulemused ajutisest kataloogist (salvestatud Parquet failivormingus), mis parandab jõudlust.

Samuti saate oma rakendusi turvalisemaks muuta, kasutades AWS-i identiteedi- ja juurdepääsuhaldus (IAM) mandaadid Amazon Redshiftiga ühenduse loomiseks.

Amazon Redshift integratsioon Apache Sparkile on ehitatud säde-punanihke pistiku peale (kogukonna versioon) ning täiustab seda jõudluse ja turvalisuse tagamiseks, aidates teil rakenduste jõudlust kuni 10 korda kiiremini saavutada.

Kasutusjuhtumid Amazon Redshifti integreerimiseks Apache Sparkiga

Meie kasutusjuhtumi puhul soovib tootepõhise ettevõtte juhtkond teada iga toote müüki mitmel turul. Kuna ettevõtte müük kõigub dünaamiliselt, on juhtkonna jaoks muutunud väljakutseks jälgida müüki mitmel turul. Üldine müük aga väheneb ja ettevõtte juhtkond soovib välja selgitada, millised turud ei toimi, et nad saaksid neid turge reklaamikampaaniate jaoks sihtida.

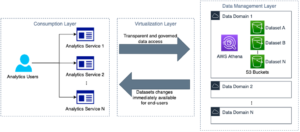

Mitme turu müügi puhul on toodete müügiandmed, nagu tellimused, tehingud ja saadetised, saadaval Amazon S3-s andmejärves. Andmetehnika meeskond saab nende andmete analüüsimiseks Amazon S3-s kasutada Apache Sparki koos Amazon EMR-i või AWS Glue'iga.

Varude andmed on saadaval Amazon Redshiftis. Samamoodi saab andmetehnika meeskond neid andmeid analüüsida Apache Sparkiga, kasutades Amazon EMR-i või AWS-liimitööd, kasutades koondamiste ja teisenduste tegemiseks Apache Sparki jaoks Amazon Redshift integratsiooni. Koondatud ja teisendatud andmestiku saab Amazon Redshifti tagasi salvestada, kasutades Apache Sparki Amazon Redshifti integratsiooni.

Jaotatud raamistiku (nt Apache Spark) kasutamine koos Apache Sparki Amazon Redshift integratsiooniga võib pakkuda müügiülevaadete loomiseks nähtavust kogu andmejärves ja andmelaos. Need ülevaated saab teha kättesaadavaks ärihuvilistele ja ärikasutajatele Amazon Redshiftis, et teha teadlikke otsuseid madala tuluga turusegmentide sihipäraste reklaamide korraldamiseks.

Lisaks saame Amazon Redshifti integratsiooni Apache Sparkiga kasutada järgmistel kasutusjuhtudel:

- Amazon EMR või AWS Glue klient, kes kasutab Apache Sparki töid, soovib andmeid teisendada ja kirjutada need Amazon Redshiftisse osana oma ETL-i torustikust.

- ML-i klient kasutab Apache Sparki koos SageMakeriga funktsioonide projekteerimiseks Amazon Redshiftis andmetele juurdepääsuks ja nende muutmiseks

- Amazon EMR-i, AWS Glue'i või SageMakeri klient kasutab Apache Sparki interaktiivseks andmete analüüsimiseks sülearvutite Amazon Redshifti andmetega

Näited Apache Sparki Amazon Redshifti integreerimise kohta Apache Sparki rakenduses

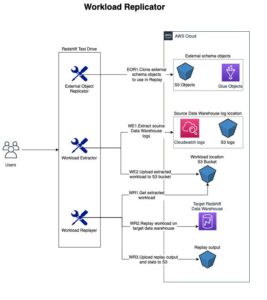

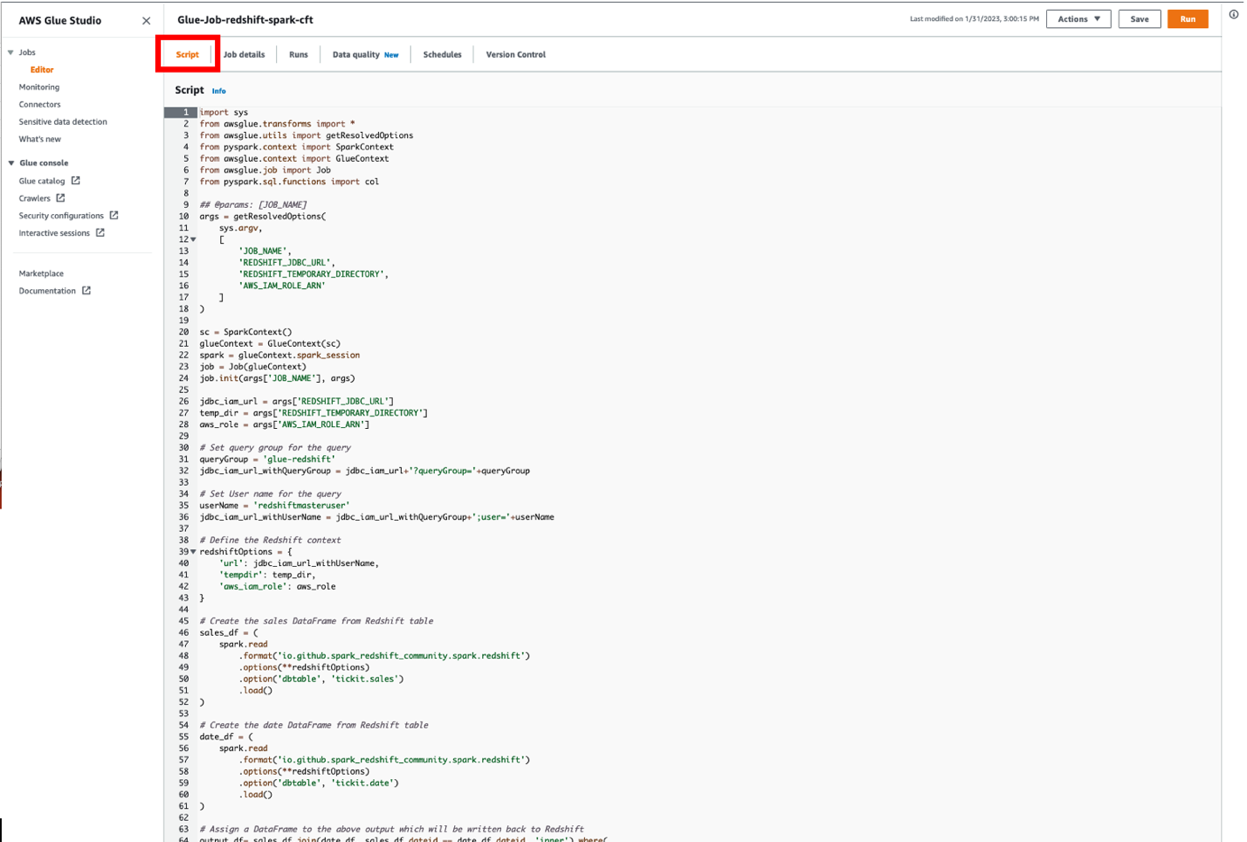

Selles postituses näitame samme Amazon Redshifti ühendamiseks Amazon EMR-iga Amazon Elastic Compute Cloud (Amazon EC2), Amazon EMR serveritaja AWS-liimi, kasutades tavalist skripti. Järgmises näidiskoodis koostame aruande, mis näitab 2008. aasta kvartali müüki. Selleks ühendame Apache Spark DataFrame'i abil kaks Amazon Redshift tabelit, käivitame predikaadi tõuke, koondame ja sorteerime andmed ning kirjutame teisendatud andmed. andmed tagasi Amazon Redshiftile. Skript kasutab PySparki

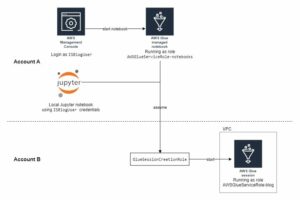

Skript kasutab Amazon Redshifti IAM-põhine autentimine. Amazon EMR-i ja AWS Glue'i kasutatavatel IAM-rollidel peaksid olema asjakohased õigused Amazon Redshifti autentimiseks ja juurdepääs S3 ämbrile ajutiseks andmete salvestamiseks.

Järgmine näitepoliitika lubab IAM-i rollil helistada GetClusterCredentials toimingud:

Järgmine näidispoliitika võimaldab juurdepääsu S3 ämbrile ajutise andmesalvestuse jaoks.

Täielik skript on järgmine:

Kui kavatsete oma keskkonnas kasutada eelmist skripti, asendage kindlasti järgmiste muutujate väärtused oma keskkonna jaoks sobivate väärtustega. jdbc_iam_url, temp_dirja aws_role.

Järgmises jaotises käsitleme selle skripti käitamise samme, et koondada Amazon Redshiftis kättesaadavaks tehtud näidisandmestik.

Eeldused

Enne alustamist veenduge, et järgmised eeltingimused on täidetud:

Juurutage ressursse AWS CloudFormationi abil

CloudFormationi virna juurutamiseks tehke järgmised toimingud.

- Logige sisse AWS-i juhtimiskonsool, seejärel käivitage CloudFormationi virn:

Te saate ka laadige alla CloudFormationi mall luua selles postituses mainitud ressursse läbi infrastruktuuri koodina (IaC). Kasutage seda malli uue CloudFormationi virna käivitamisel.

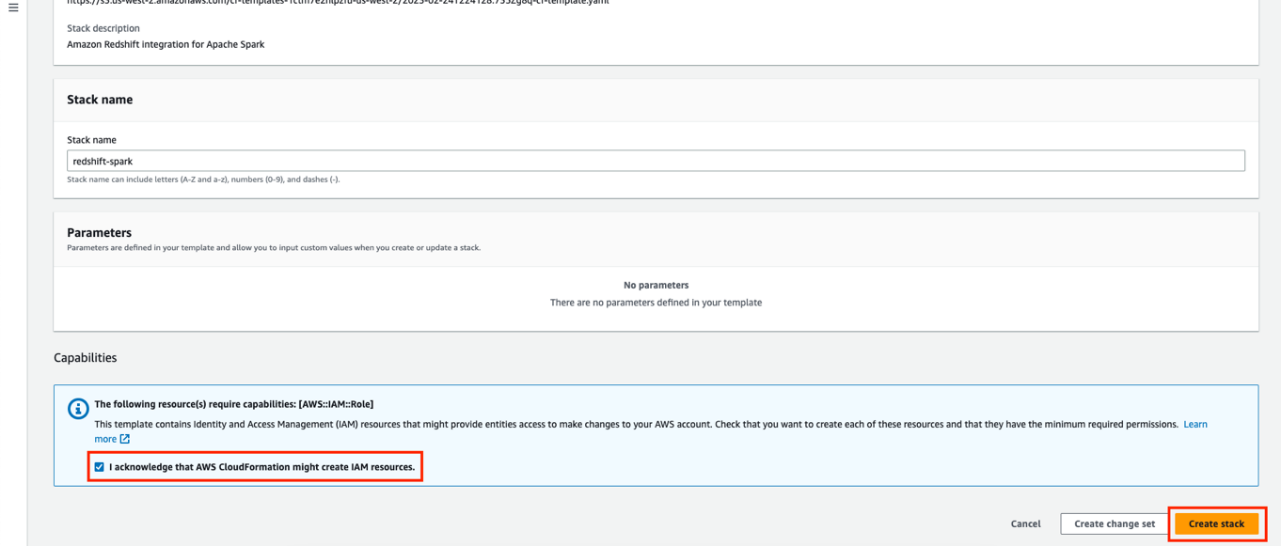

- Valimiseks kerige lehe allossa Tunnistan, et AWS CloudFormation võib luua IAM-i ressursse all Võimed, siis vali Loo virn.

Virna loomise protsess võtab aega 15–20 minutit. CloudFormationi mall loob järgmised ressursid.

-

- Amazoni VPC koos vajalike alamvõrkude, marsruuditabelite ja NAT-lüüsiga

- Nimega S3 kopp

redshift-spark-databucket-xxxxxxx(pange tähele, et xxxxxxx on juhuslik string, mis muudab ämbri nime ainulaadseks) - Amazon Redshifti klaster koos andmebaasi laaditud näidisandmetega

devja peamine kasutajaredshiftmasteruser. Selle blogipostituse jaoksredshiftmasteruserkasutatakse administraatorilubadega. Siiski on tootmiskeskkonnas soovitatav kasutada täpset juurdepääsukontrolliga kasutajat. - IAM-i roll, mida kasutatakse Amazon Redshifti jaoks koos võimalusega taotleda Amazon Redshifti klastri arendajate andmebaasist ajutisi mandaate

- Amazon EMR stuudio koos vajalike IAM-rollidega

- Amazon EMR-i versioon 6.9.0 EC2 klastris koos vajalike IAM-rollidega

- Amazon EMR-i serverita rakenduse väljalase versioon 6.9.0

- AWS-liimiühendus ja AWS-liimitöö versioon 4.0

- A Jupyteri märkmik käitada Amazon EMR Studio abil, kasutades Amazon EMR-i EC2 klastris

- PySparki skript, mis töötab Amazon EMR Studio ja Amazon EMR Serverlessi abil

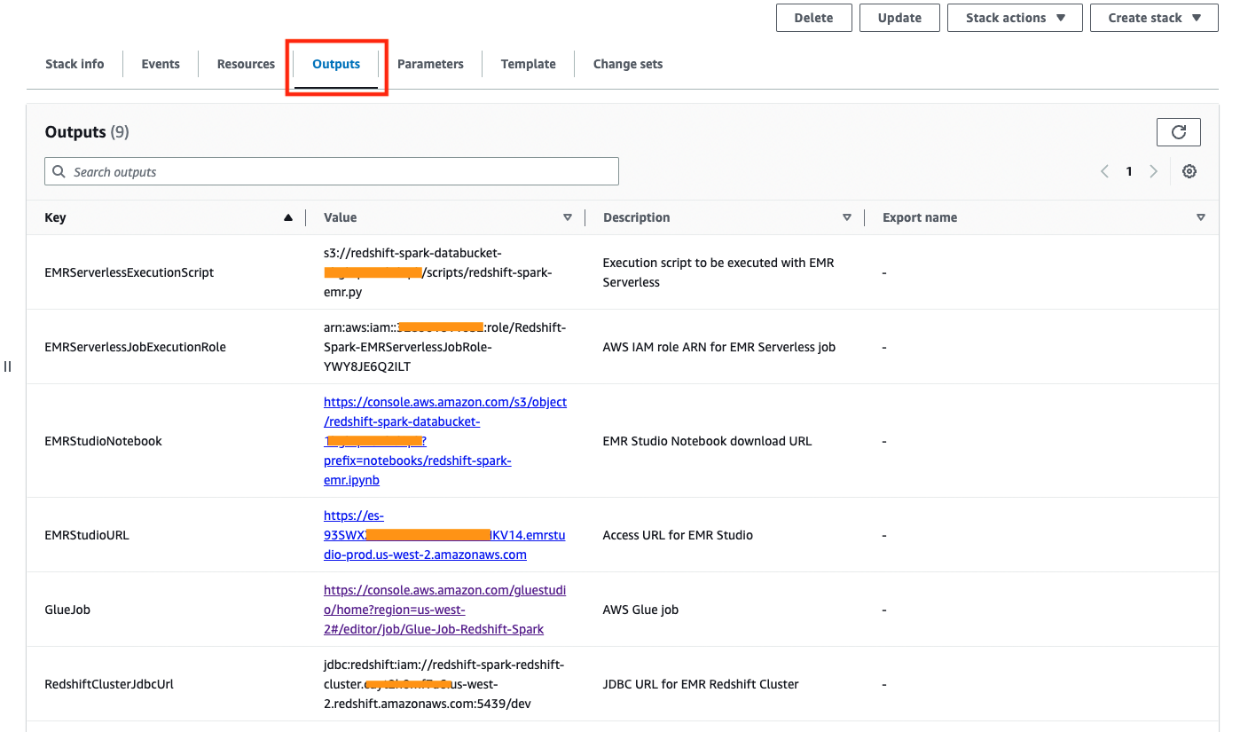

- Kui virna loomine on lõpetatud, valige virna nimi

redshift-sparkja navigeerige Väljundid

Kasutame neid väljundväärtusi selles postituses hiljem.

Järgmistes jaotistes näitame samme Amazon Redshifti integreerimiseks Apache Sparkile Amazon EMR-ist Amazon EC2-s, Amazon EMR Serverlessis ja AWS Glue'is.

Kasutage Amazon Redshifti integratsiooni Apache Sparkiga Amazon EMR-is EC2-s

Alates Amazon EMR-i versioonist 6.9.0 ja uuemast versioonist on Amazon Redshifti integratsiooni Apache Sparki ja Amazon Redshift JDBC draiveri jaoks kasutav pistik Amazon EMR-is kohapeal saadaval. Need failid asuvad all /usr/share/aws/redshift/ kataloog. Kuid Amazon EMR-i eelmistes versioonides oli kogukond versioon spark-redshift pesa on olemas.

Järgmine näide näitab, kuidas ühendada Amazon Redshift PySparki tuuma abil an Amazon EMR stuudio märkmik. CloudFormationi virn lõi Amazon EMR Studio, Amazon EMR EC2 klastris ja Jupyteri sülearvuti. Selle näite läbimiseks toimige järgmiselt.

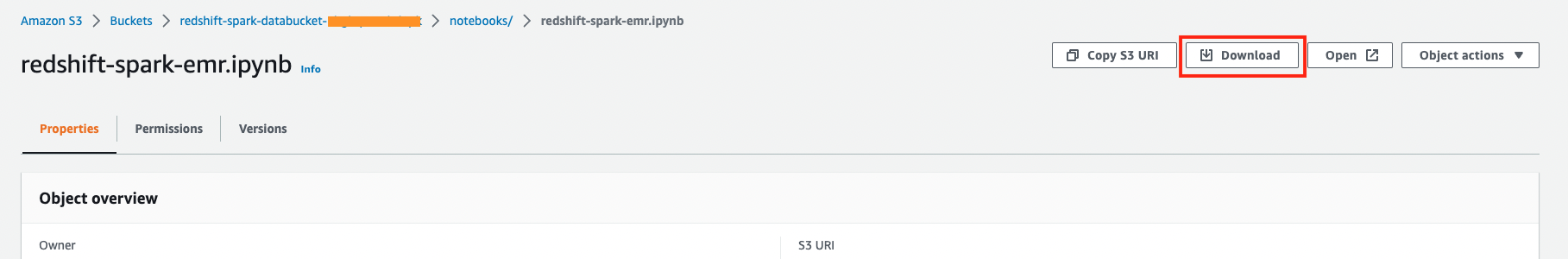

- Laadige alla Jupyteri sülearvuti, mis on teie jaoks saadaval S3 ämbris:

- Otsige CloudFormationi virna väljunditest väärtust

EMRStudioNotebook, mis peaks osutama selleleredshift-spark-emr.ipynbsülearvuti saadaval S3 ämbris. - Valige link või avage link uuel vahelehel, kopeerides märkmiku URL-i.

- Pärast lingi avamist laadige märkmik alla, valides Lae, mis salvestab faili kohapeal teie arvutisse.

- Otsige CloudFormationi virna väljunditest väärtust

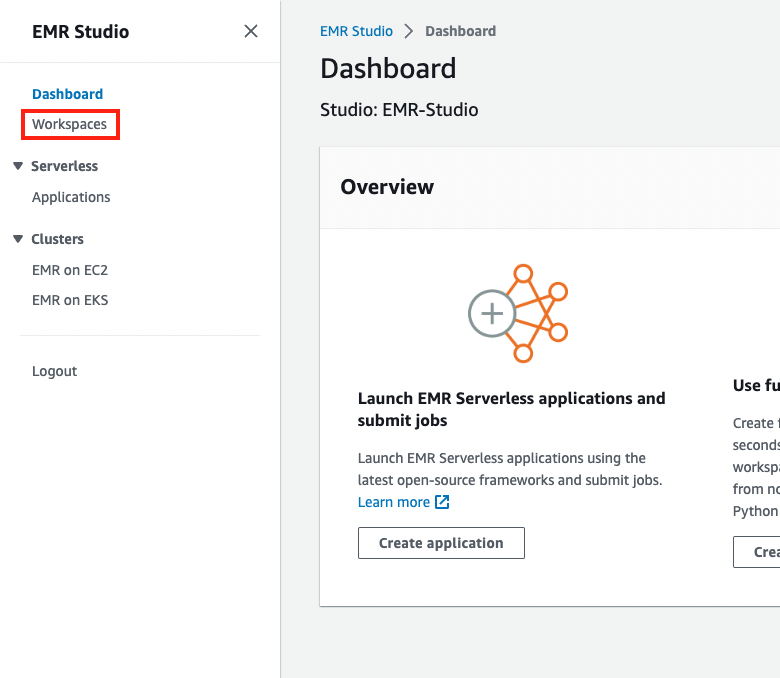

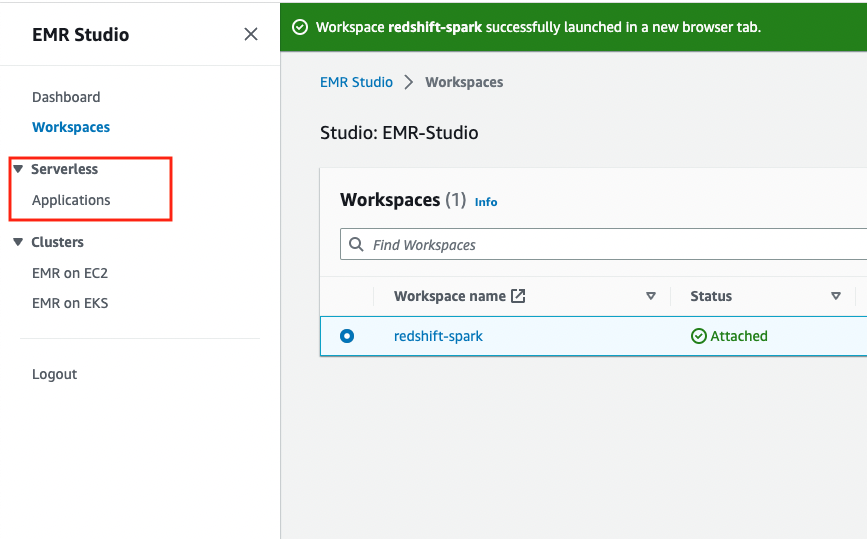

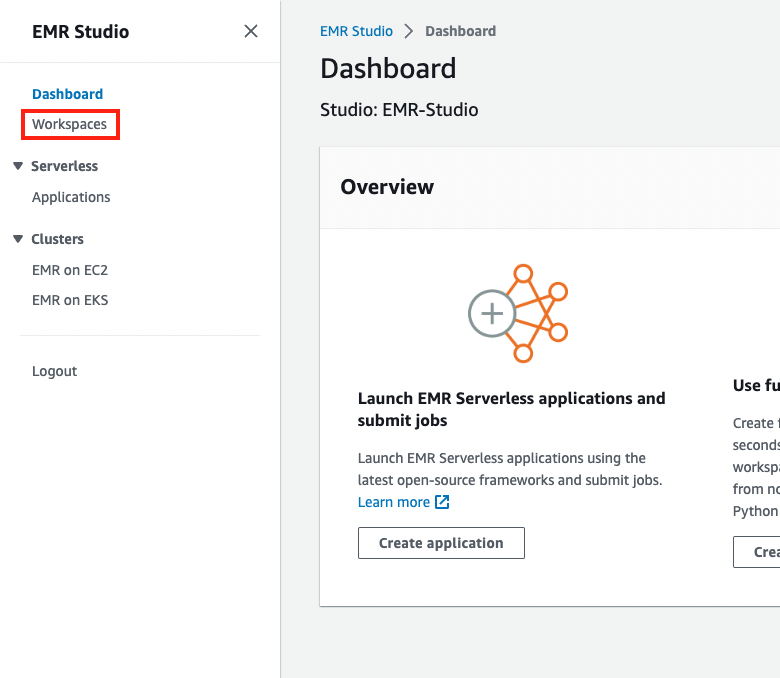

- Juurdepääs Amazon EMR Studio'ile, valides või kopeerides võtme jaoks CloudFormationi virna väljundites oleva lingi

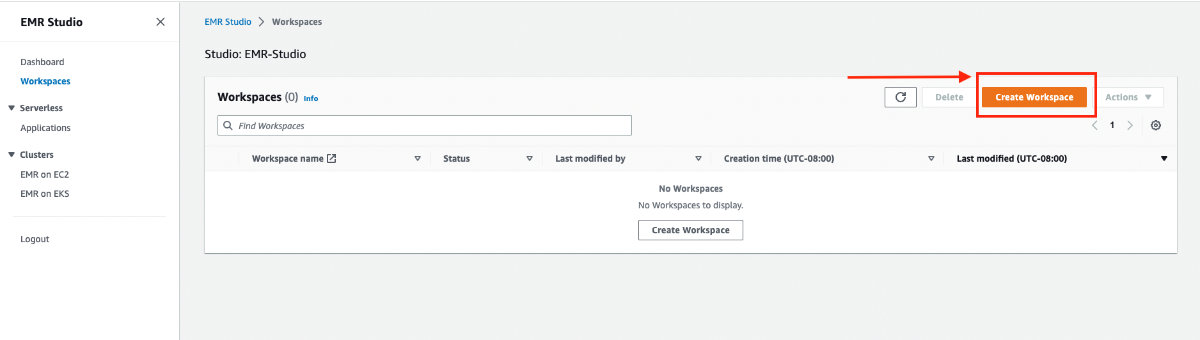

EMRStudioURL. - Valige navigeerimispaanil tööruumid.

- Vali Looge tööruum.

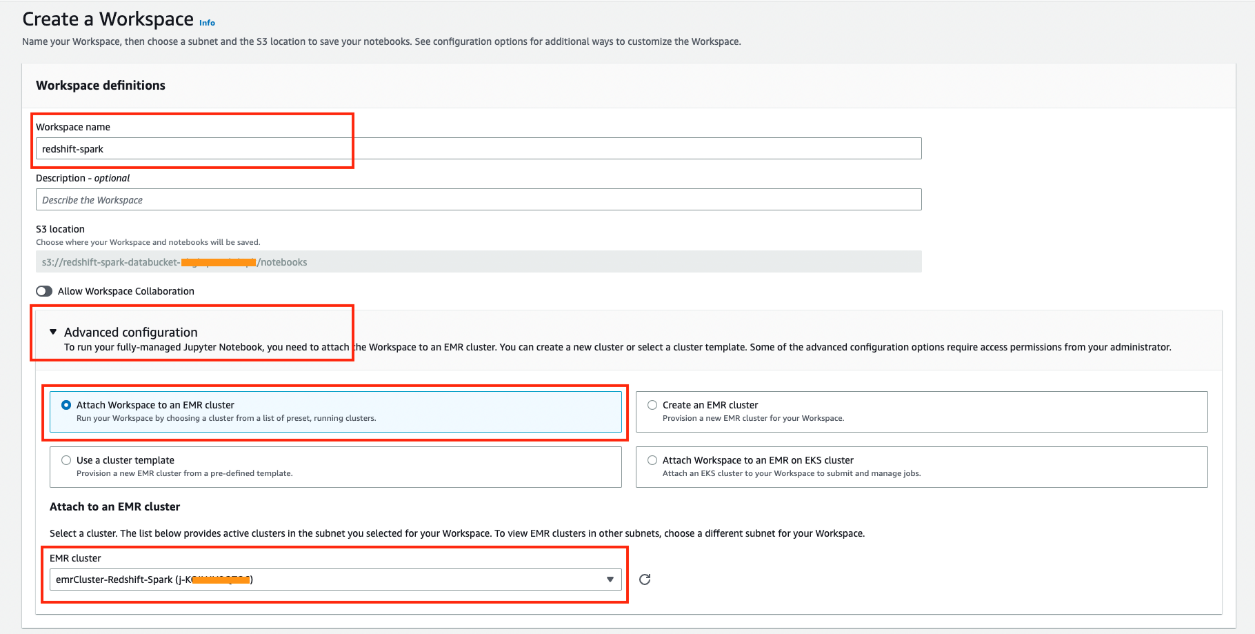

- Sisestage näiteks tööruumi nimi

redshift-spark. - Laienda Täpsem konfiguratsioon jaotis ja valige Ühendage tööruum EMR-klastriga.

- alla Kinnitage EMR-klastri külge, valige nimega EMR-klaster

emrCluster-Redshift-Spark. - Vali Looge tööruum.

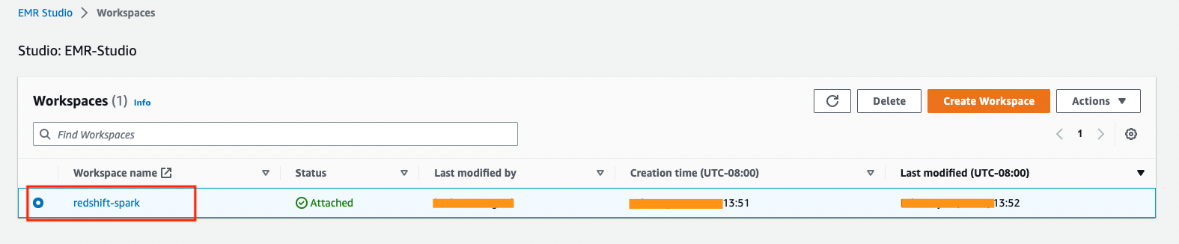

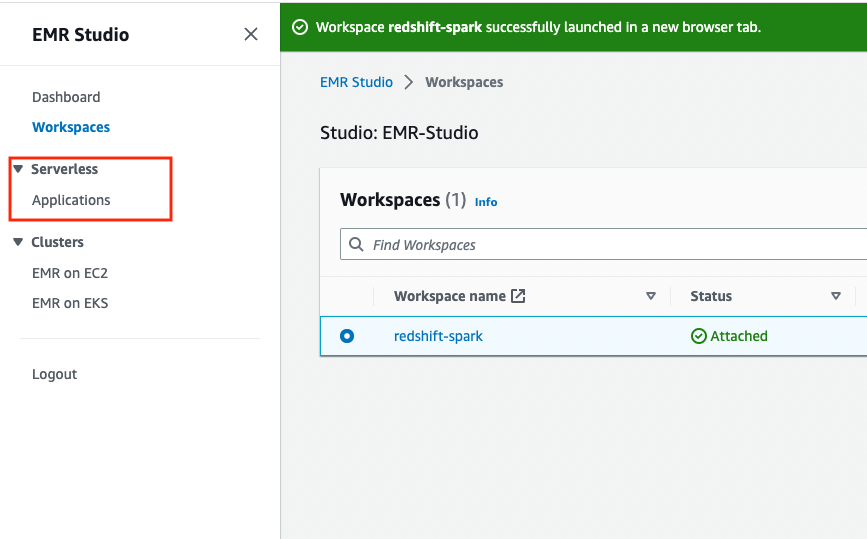

- Pärast Amazon EMR Studio tööruumi loomist ja olekus Manustatud saate tööruumile juurde pääseda, valides tööruumi nime.

See peaks avama tööruumi uuel vahekaardil. Pange tähele, et kui teil on hüpikakende blokeerija, peate võib-olla lubama tööruumil hüpikakende blokeerija avada või keelata.

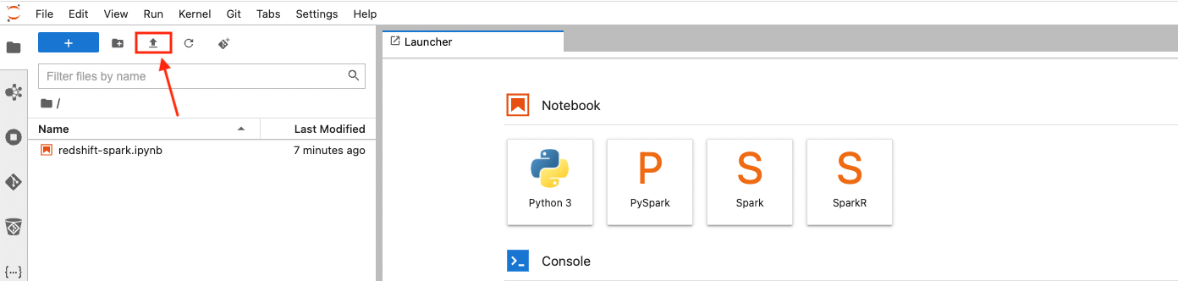

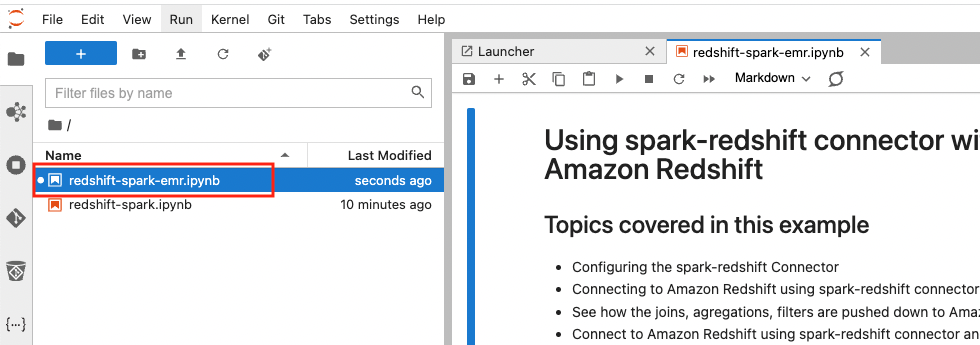

Amazon EMR Studio tööruumis laadime nüüd üles varem alla laaditud Jupyteri sülearvuti.

- Vali Täiendava kohaliku failisüsteemi sirvimiseks ja Jupyteri märkmiku üleslaadimiseks (

redshift-spark-emr.ipynb).

- Valige (topeltklõpsake)

redshift-spark-emr.ipynbmärkmiku avamiseks tööalal.

Märkmik sisaldab üksikasju erinevate ülesannete kohta, mida see täidab. Pange tähele, et jaotises Määratlege muutujad Amazon Redshift klastriga ühenduse loomiseks, ei pea te väärtusi värskendama jdbc_iam_url, temp_dirja aws_role sest neid värskendab teie jaoks AWS CloudFormation. AWS CloudFormation on teostanud ka jaotises mainitud toiminguid Eeldused märkmiku osa.

Nüüd saate märkmikku käivitada.

- Käivitage üksikud lahtrid, valides need ja seejärel valides mängima.

Võite kasutada ka klahvikombinatsiooni Tõstuklahv + sisestusklahv or Tõstuklahv+Tagasi. Teise võimalusena saate käivitada kõik lahtrid valides Käivitage kõik rakud kohta jooks menüü.

- Leidke Amazon Redshifti klastris Apache Sparki jaoks Amazon Redshifti integratsiooni abil tehtud predikaadi allavajutusoperatsioon.

Näeme ka Amazon S3-le salvestatud ajutisi andmeid optimeeritud Parketi formaadis. Väljundit saab näha jaotises oleva lahtri käivitamisel Hankige Amazon Redshiftis viimane päring.

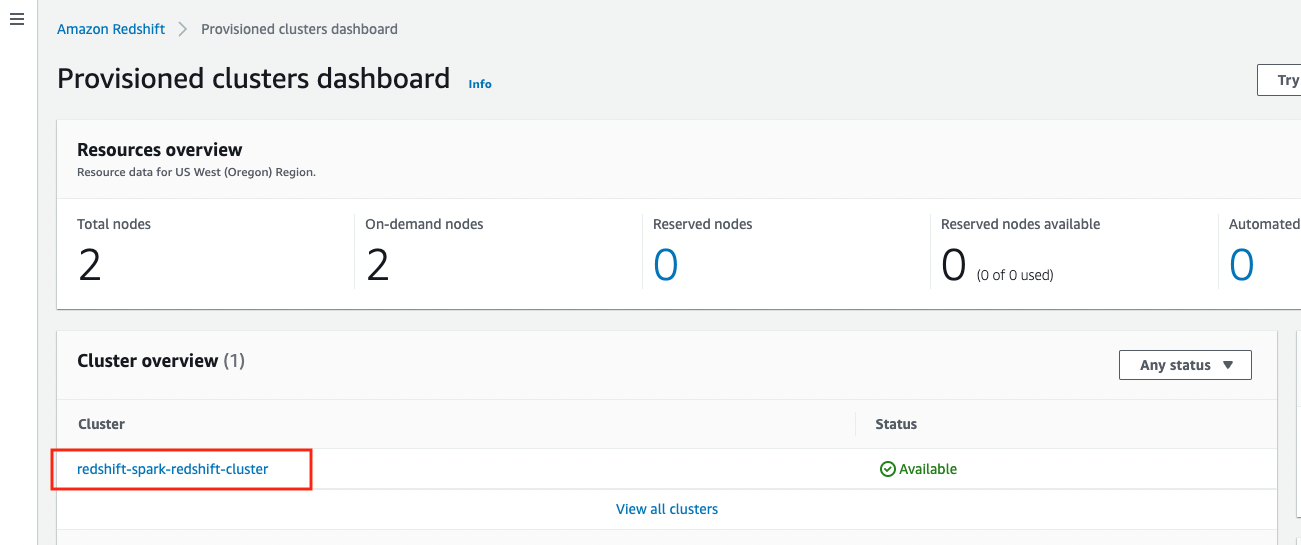

- Amazon EMR-i tööga loodud tabeli kinnitamiseks Amazon EC2-s navigeerige Amazon Redshift konsooli ja valige klaster

redshift-spark-redshift-clusterkohta Ettenähtud klastrite armatuurlaud lehel.

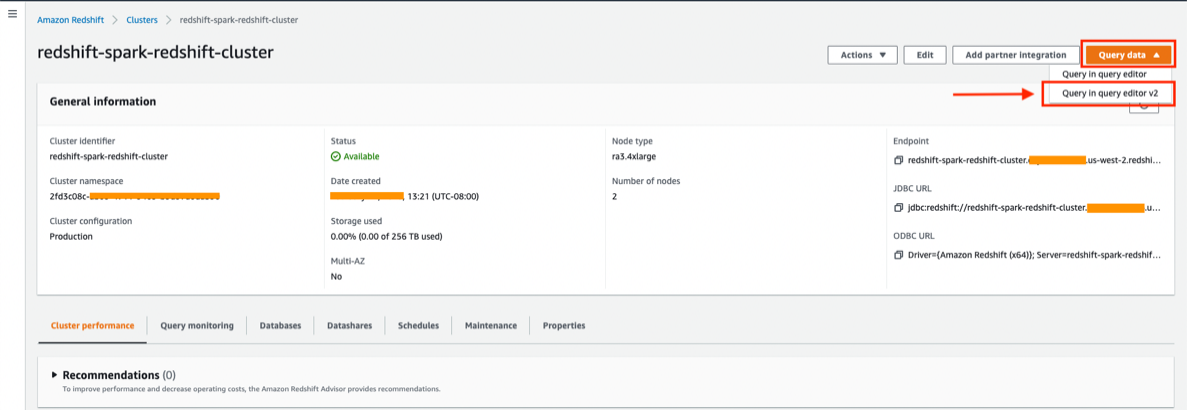

- Klastri üksikasjades kohta Andmete päring menüüst valige Päring päringuredaktoris v2.

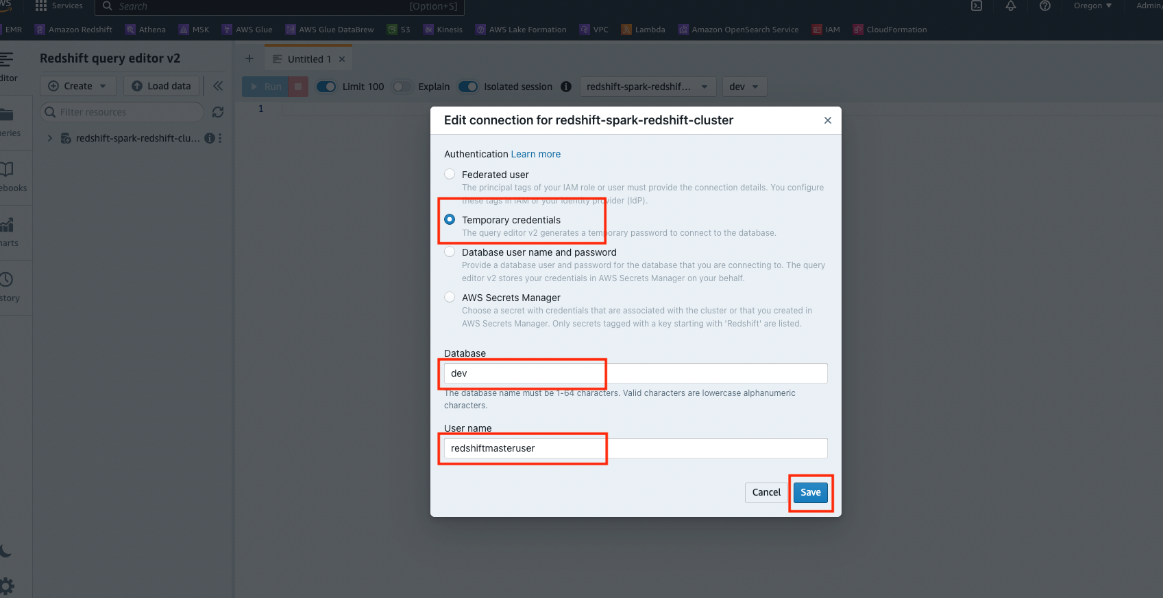

- Valige navigeerimispaanil klaster ja looge ühendus Amazon Redshift klastriga, kui see taotleb autentimist.

- valima Ajutised volikirjad.

- eest andmebaas, sisenema

dev. - eest kasutajanimi, sisenema

redshiftmasteruser. - Vali Säästa.

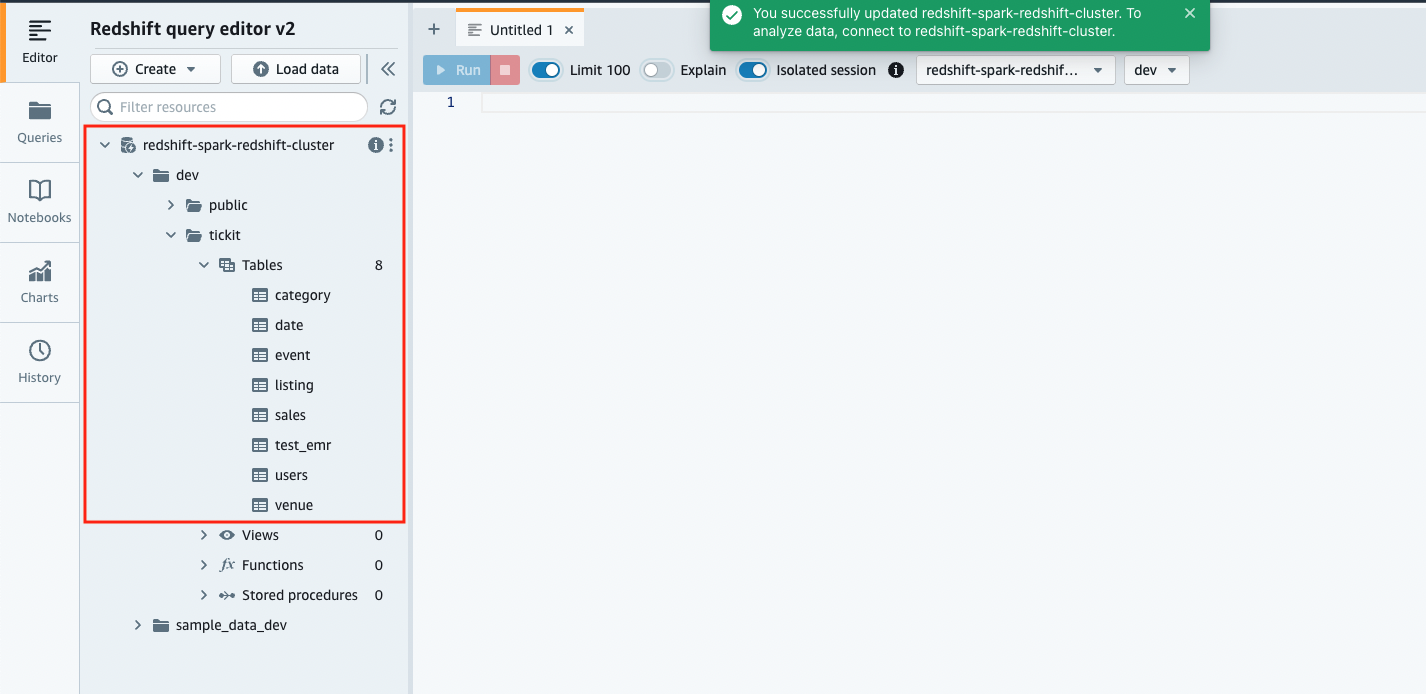

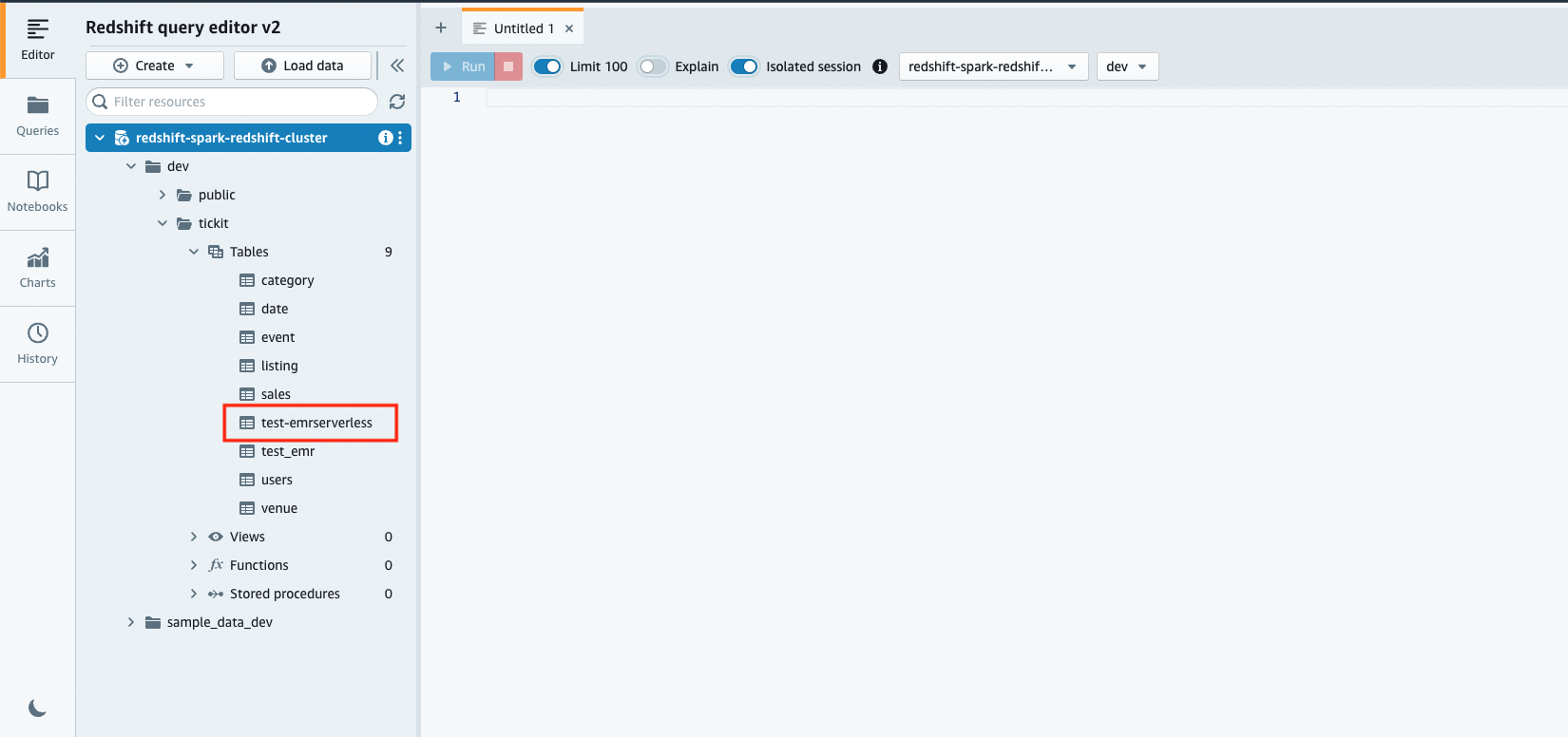

- Laiendage navigeerimispaanil klastrit

redshift-spark-redshift-cluster, laiendage arendaja andmebaasi, laiendagetickitja laiendage Tabelid et loetleda kõik skeemi sees olevad tabelidtickit.

Peaksite tabeli üles leidma test_emr.

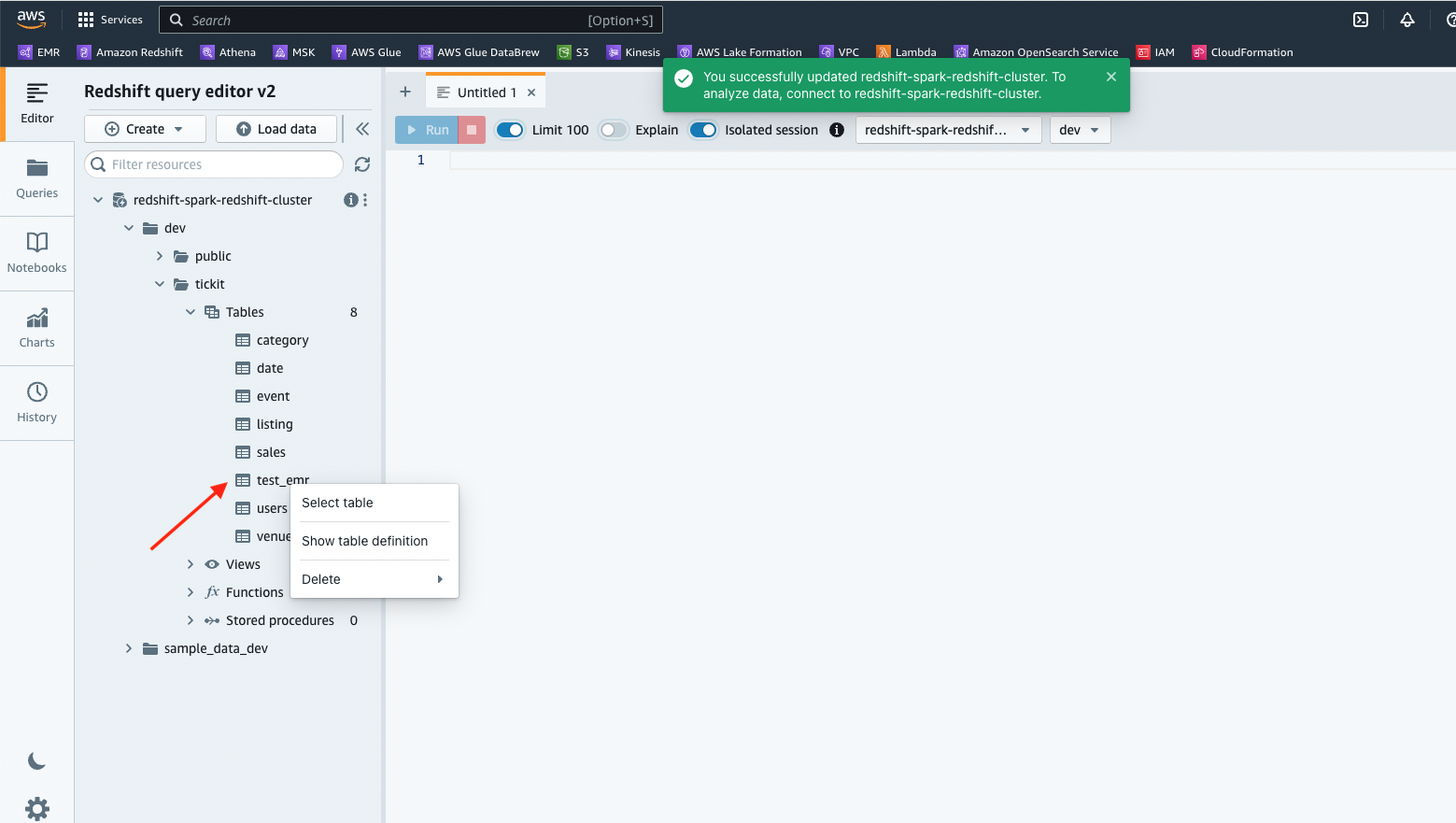

- Valige (paremklõpsake) tabel

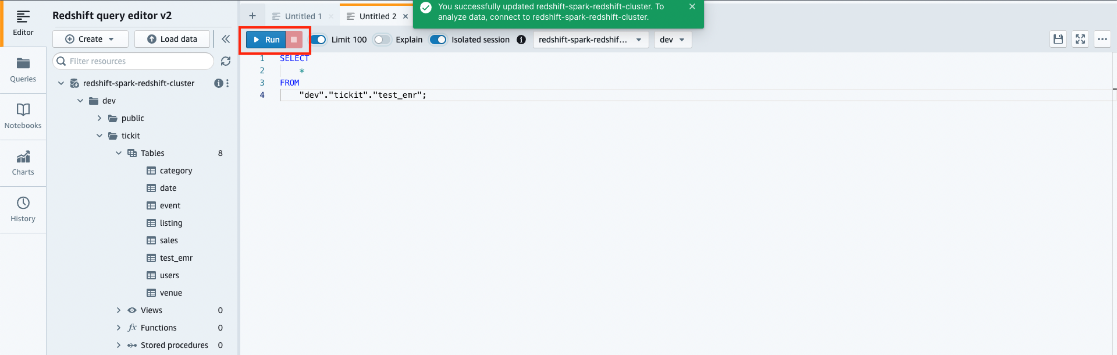

test_emr, siis vali Valige tabel tabeli küsimiseks.

- Vali jooks SQL-lause käivitamiseks.

Kasutage Amazon EMR Serverlessis Amazon Redshifti integratsiooni Apache Sparkiga

Amazon EMR-i väljalaskeversioon 6.9.0 ja uuemad pakuvad Amazon Redshifti integratsiooni Apache Spark JAR-idele (haldab Amazon Redshift) ja Amazon Redshift JDBC JAR-idele ka kohapeal Amazon EMR Serverlessis. Need failid asuvad all /usr/share/aws/redshift/ kataloog. Järgmises näites kasutame Pythoni skripti, mille meie varem loodud CloudFormationi virn S3 ämbris kättesaadavaks tegi.

- Märkige CloudFormationi virna väljunditesse väärtus

EMRServerlessExecutionScript, mis on Pythoni skripti asukoht S3 ämbris. - Pange tähele ka väärtust

EMRServerlessJobExecutionRole, mis on IAM-i roll, mida kasutatakse Amazon EMR-i serverita töö käitamiseks. - Juurdepääs Amazon EMR Studio'ile, valides või kopeerides võtme jaoks CloudFormationi virna väljundites oleva lingi

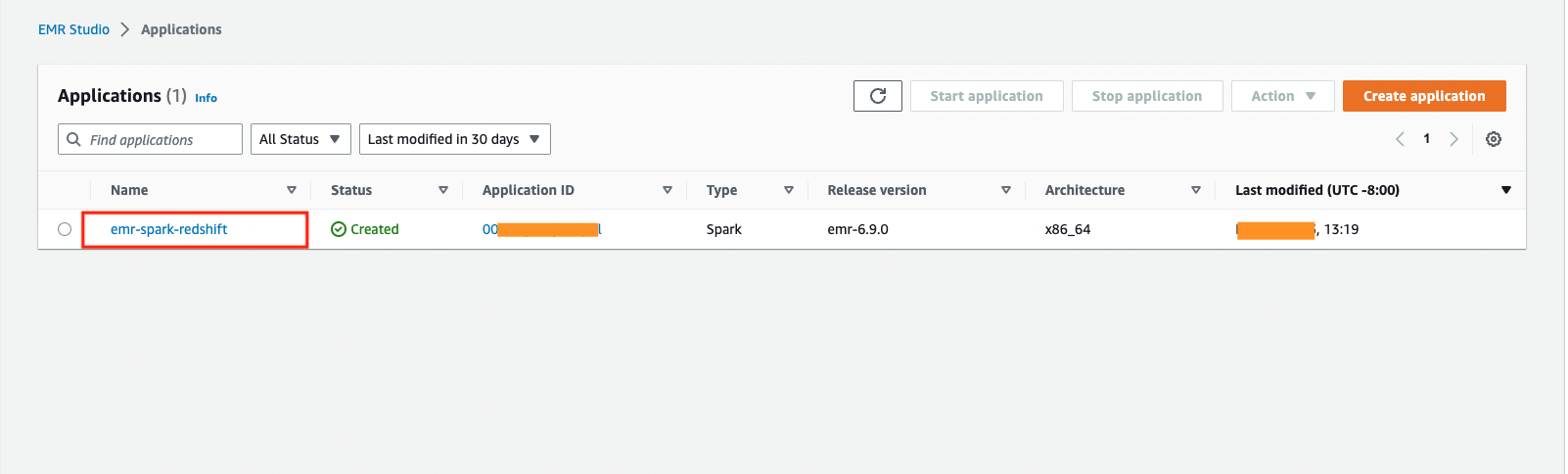

EMRStudioURL. - Vali Rakendused all Serverita navigeerimispaanil.

Leiad nimega CloudFormationi virna loodud EMR-rakenduse emr-spark-redshift.

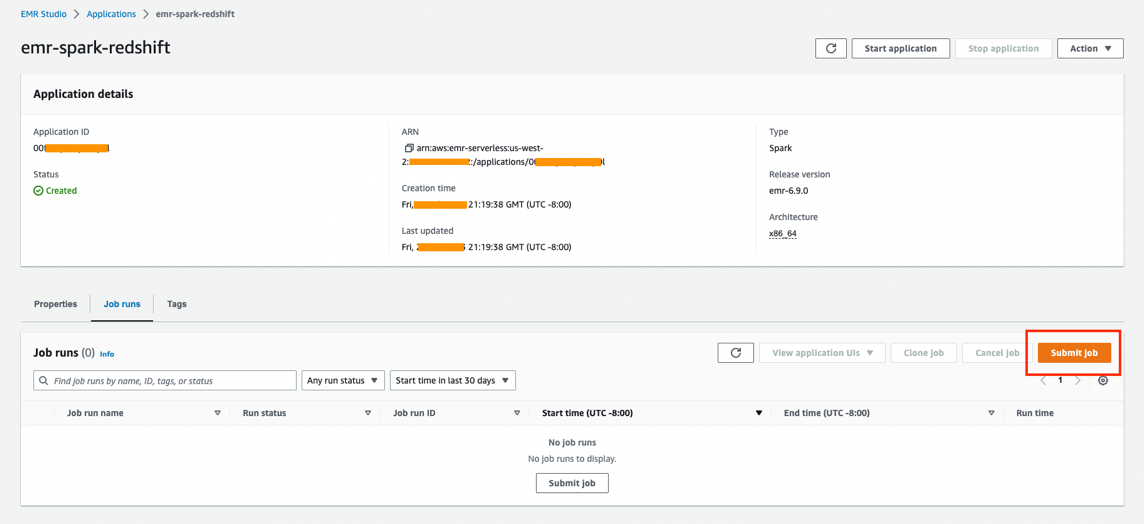

- Valige töö esitamiseks rakenduse nimi.

- Vali Esitage töö.

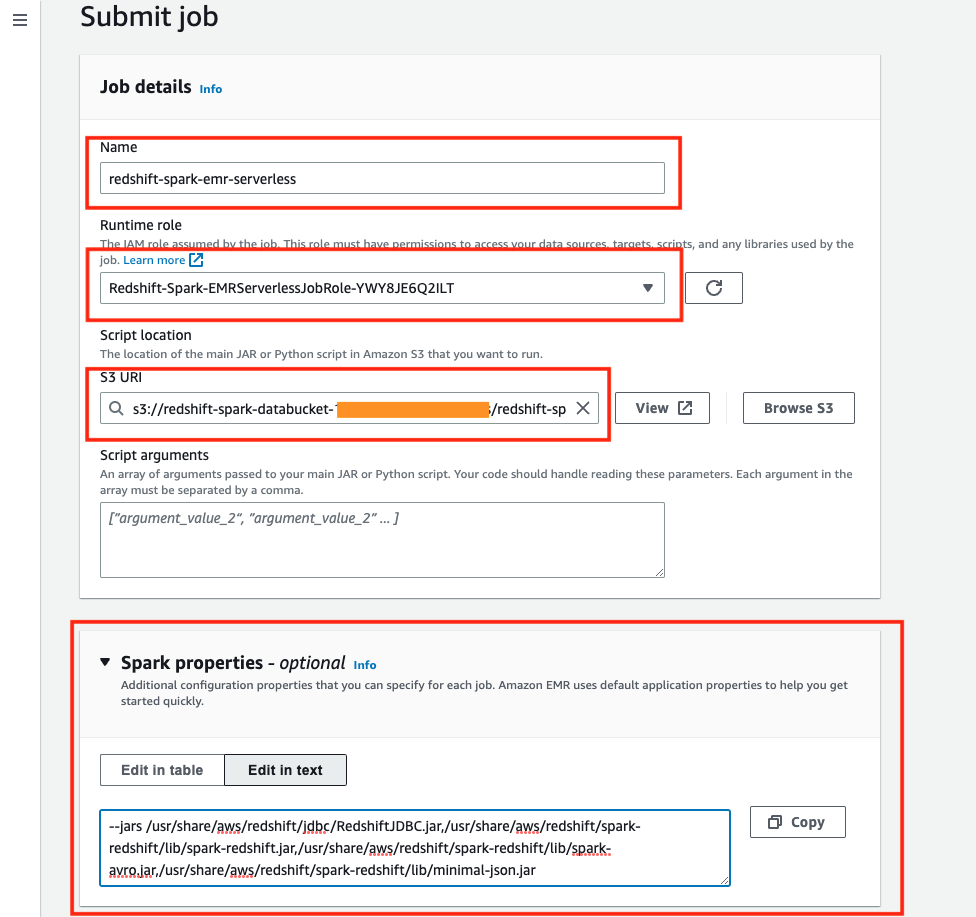

- alla Töö üksikasjadJaoks Nimi, sisestage tööle identifitseeritav nimi.

- eest Kestuslik roll, valige varem CloudFormationi virna väljundist märgitud IAM-i roll.

- eest Skripti asukoht, sisestage tee Pythoni skriptile, mille CloudFormationi virna väljundist varem märkisite.

- Laiendage jaotist Säde omadused ja vali Muuda tekstis

- Sisestage tekstikasti järgmine väärtus, mis annab tee

redshift-connector, Amazon Redshift JDBC draiver,spark-avroJAR jaminimal-jsonJAR-failid:

- Vali Esitage töö.

- Oodake, kuni töö on lõpule viidud ja käitamise olek kuvatakse kui Edu.

- Navigeerige Amazon Redshift päringuredaktorisse, et näha, kas tabel loodi edukalt.

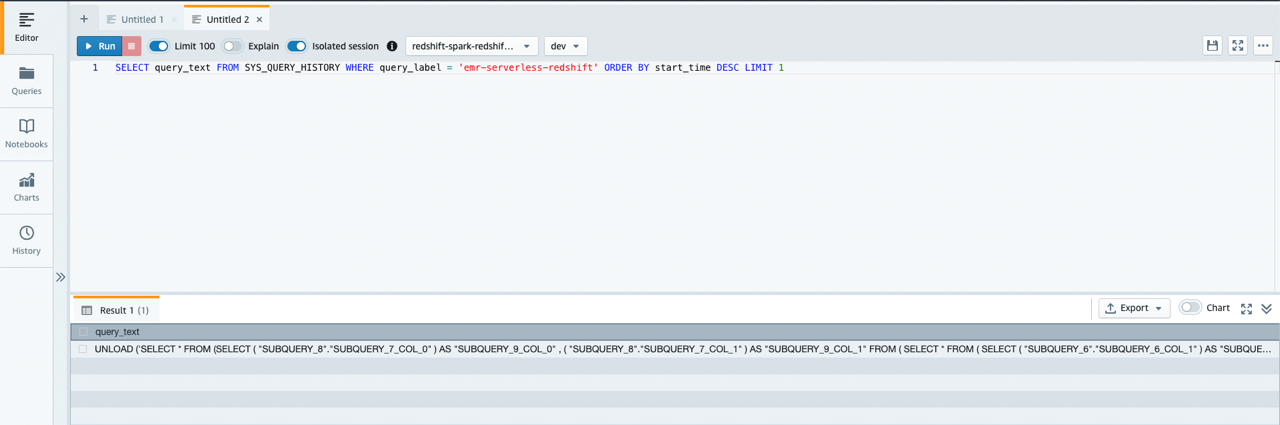

- Kontrollige Amazon Redshift päringurühma jaoks käivitatavaid allakäigupäringuid

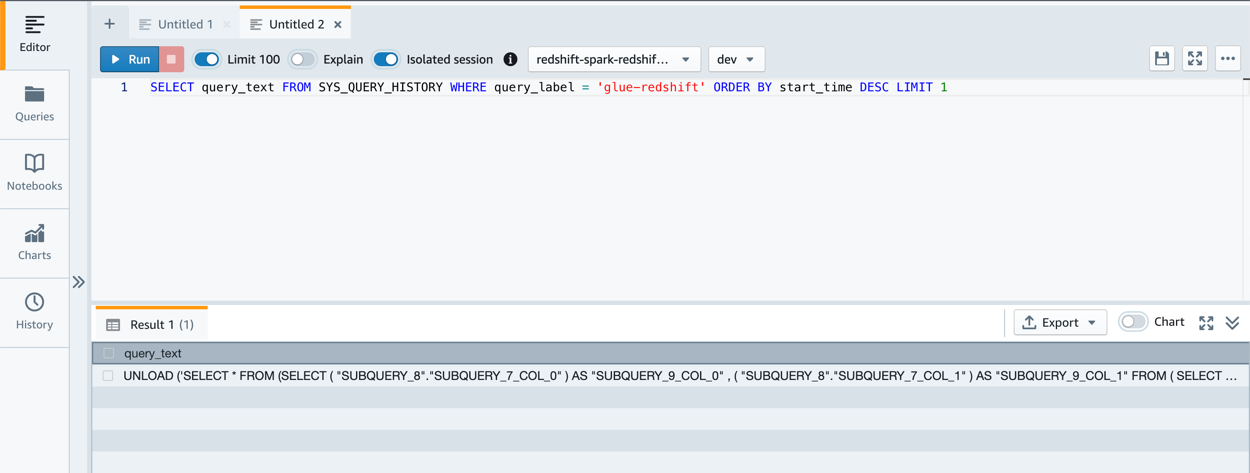

emr-serverless-redshift. Andmebaasi vastu saate käivitada järgmise SQL-lausedev:

Näete, et allapoole suunatud päring ja tagastustulemused salvestatakse Amazon S3-s Parketi failivormingus.

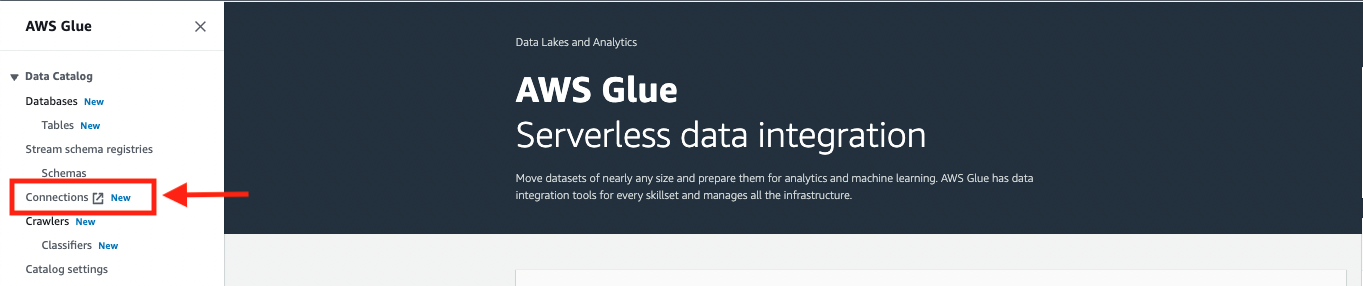

Kasutage Amazon Redshifti integreerimist Apache Sparkiga AWS Glue'is

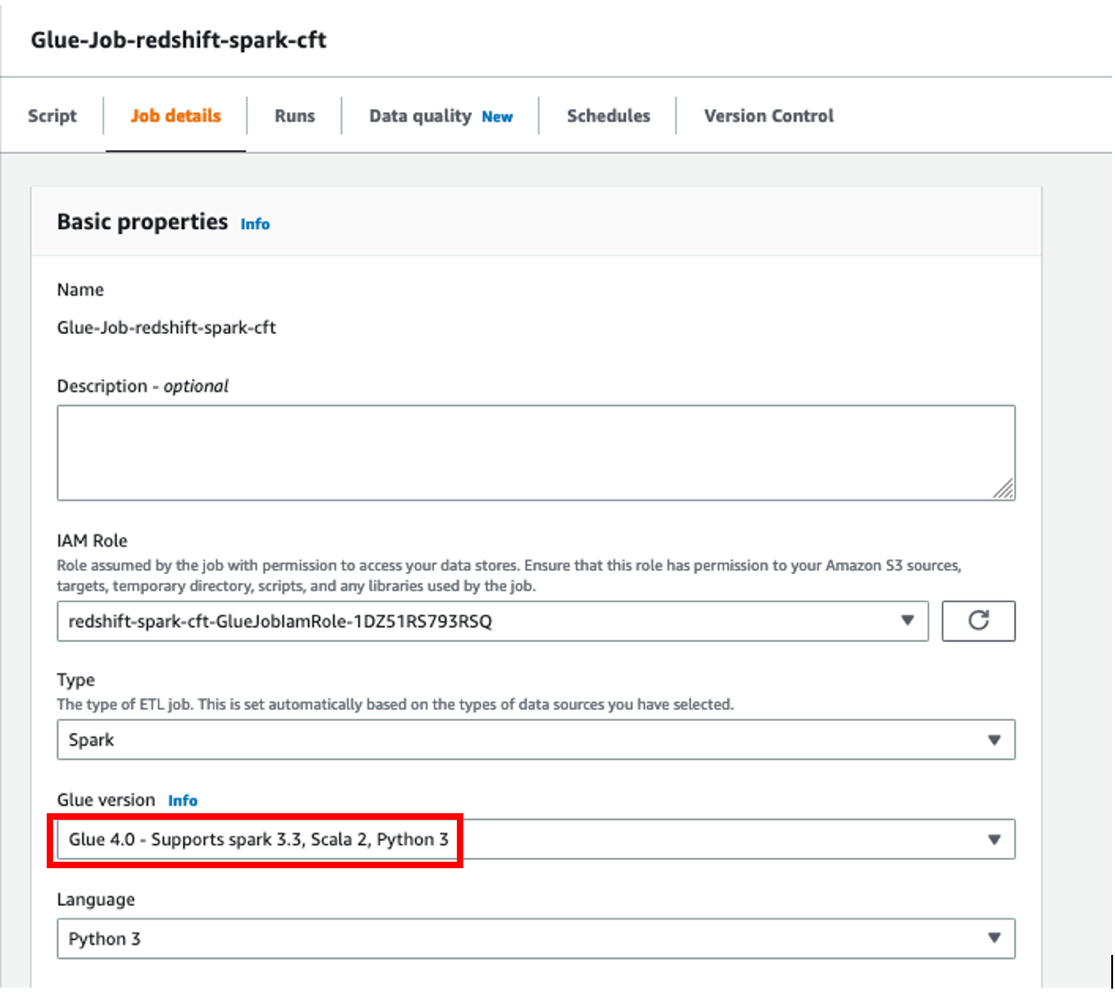

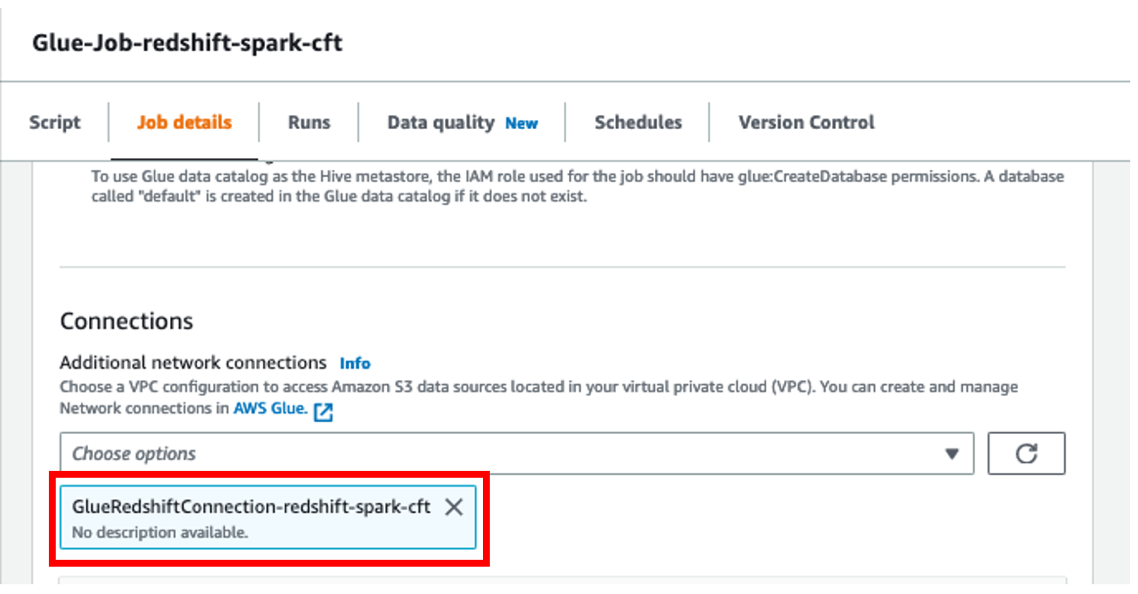

Alates AWS Glue versioonist 4.0 ja uuemast versioonist saavad Amazon Redshiftiga ühenduse loovad Apache Sparki tööd kasutada Amazon Redshifti integratsiooni Apache Sparki ja Amazon Redshift JDBC draiveri jaoks. Olemasolevad AWS-liimitööd, mis juba kasutavad allika või sihtmärgina Amazon Redshiftit, saab selle uue konnektori eeliste kasutamiseks uuendada versioonile AWS Glue 4.0. Selle postitusega kaasas olev CloudFormationi mall loob järgmised AWS-liimi ressursid:

- AWS-liimiühendus Amazon Redshifti jaoks - Ühendus ühenduse loomiseks AWS Glue'ist Amazon Redshiftiga, kasutades Apache Sparki Amazon Redshifti integratsiooni

- AWS-i liimitööga seotud IAM-i roll – IAM-i roll AWS-i liimitöö käitamise lubade haldamiseks

- AWS-i liimitöö – AWS-liimitöö skript, mis teostab teisendusi ja liitmisi, kasutades Apache Sparki Amazon Redshift integratsiooni

Järgmine näide kasutab PySparkiga AWS-liimitööga ühendatud AWS-liimi ühendust ja sisaldab järgmisi samme.

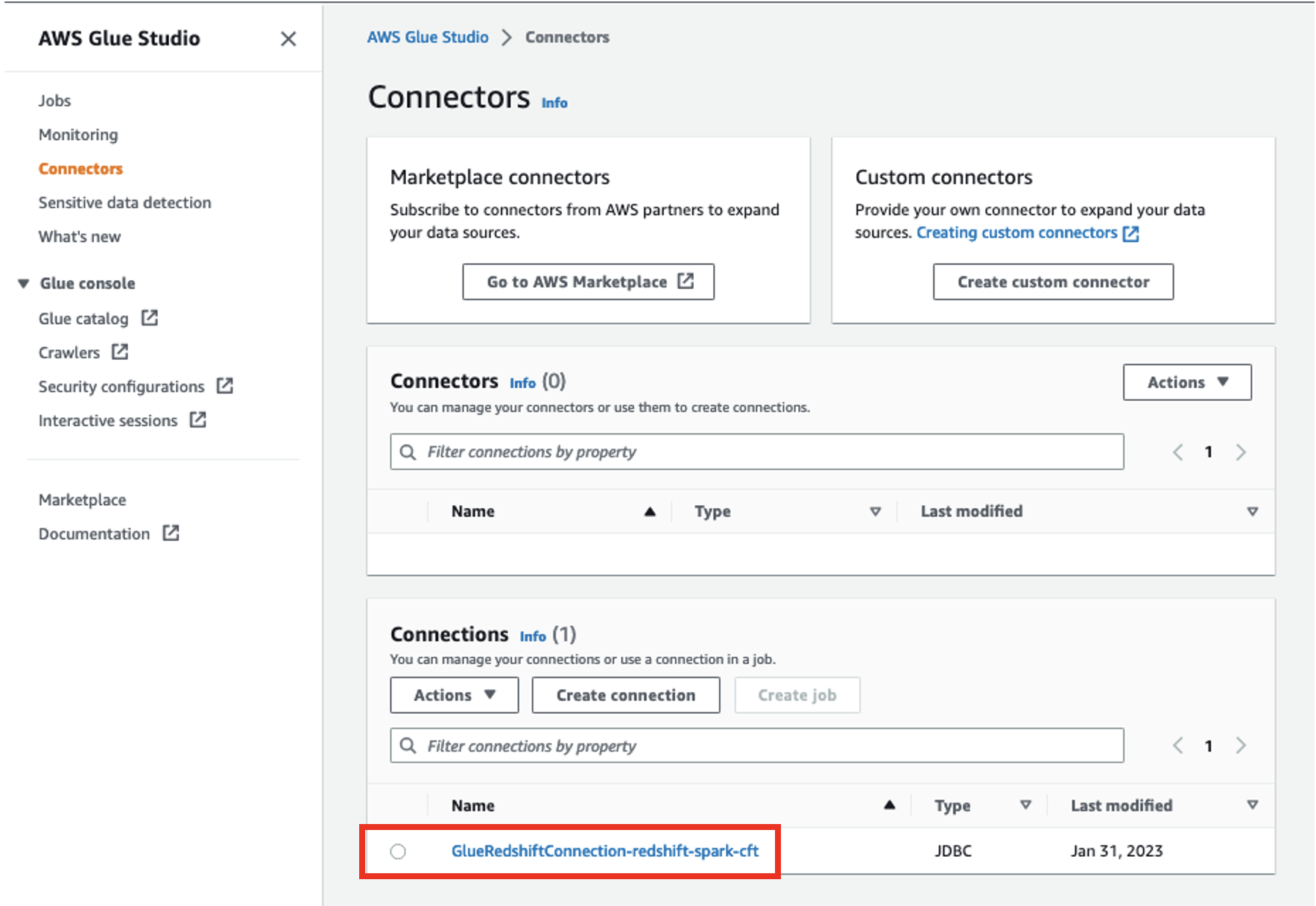

- Valige AWS Glue konsoolil Side navigeerimispaanil.

- alla Side, valige CloudFormationi malliga loodud Amazon Redshifti AWS-liimi ühendus.

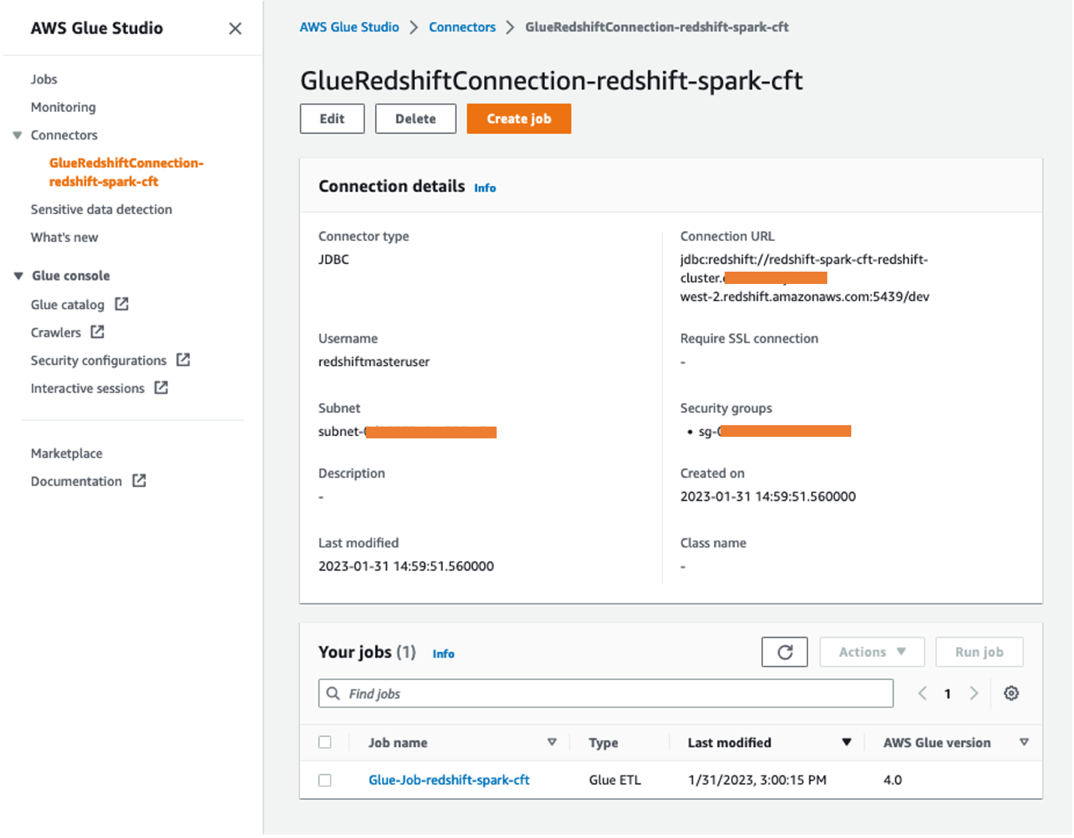

- Kontrollige ühenduse üksikasju.

Nüüd saate seda ühendust töös või mitmes töös uuesti kasutada.

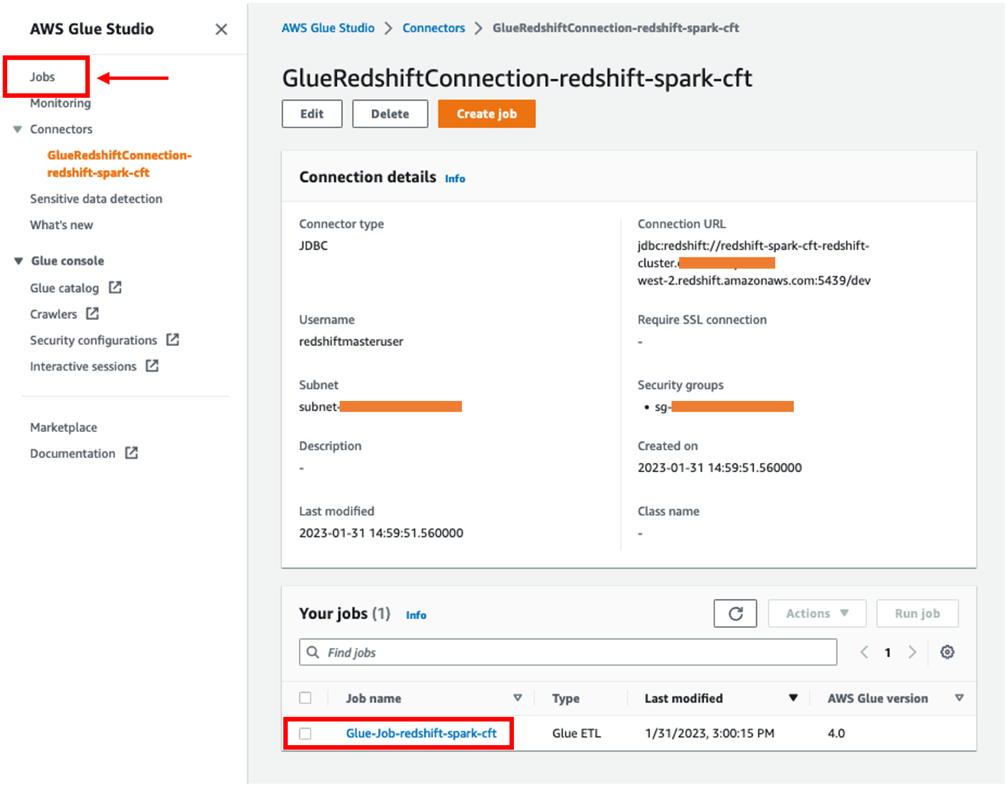

- Kohta Pistikud lehel, valige alt CloudFormationi virna loodud AWS-liimi töö Teie töökohadvõi pääsete juurde AWS-liimitööle, kasutades võtme jaoks ette nähtud URL-i

GlueJobCloudFormationi virna väljundis.

- Juurdepääs AWS-liimitöö skriptile ja selle kinnitamine.

- Kohta Töö üksikasjad vahekaarti, veenduge selles Liimi versioon on seatud väärtusele 4.0. liim.

See tagab, et töö kasutab uusimat redshift-spark pesa.

- Laiendama Täiustatud omadused ja Side jaotises kontrollige, kas CloudFormationi virna loodud ühendus on ühendatud.

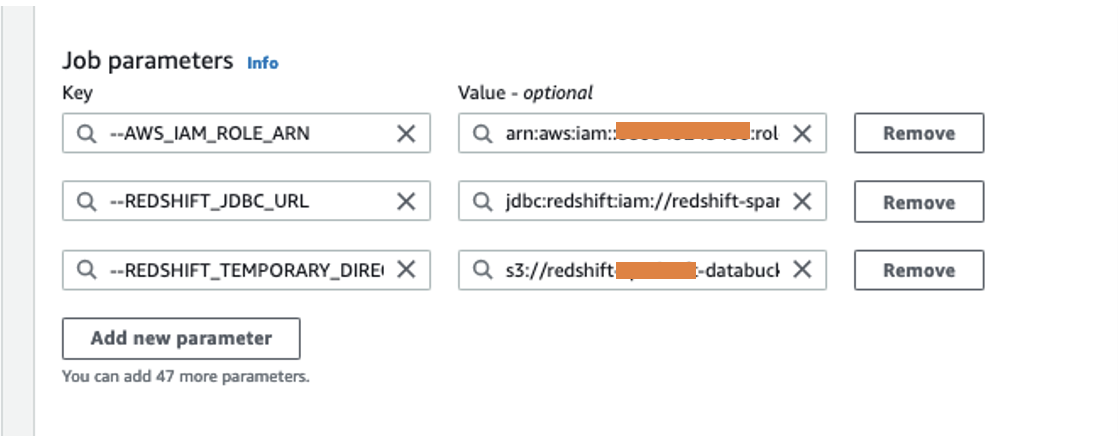

- Kontrollige AWS-liimitöö jaoks lisatud töö parameetreid. Need väärtused on saadaval ka CloudFormationi virna väljundis.

- Vali Säästa ja siis jooks.

Töö olekut saate vaadata saidil jooks Tab.

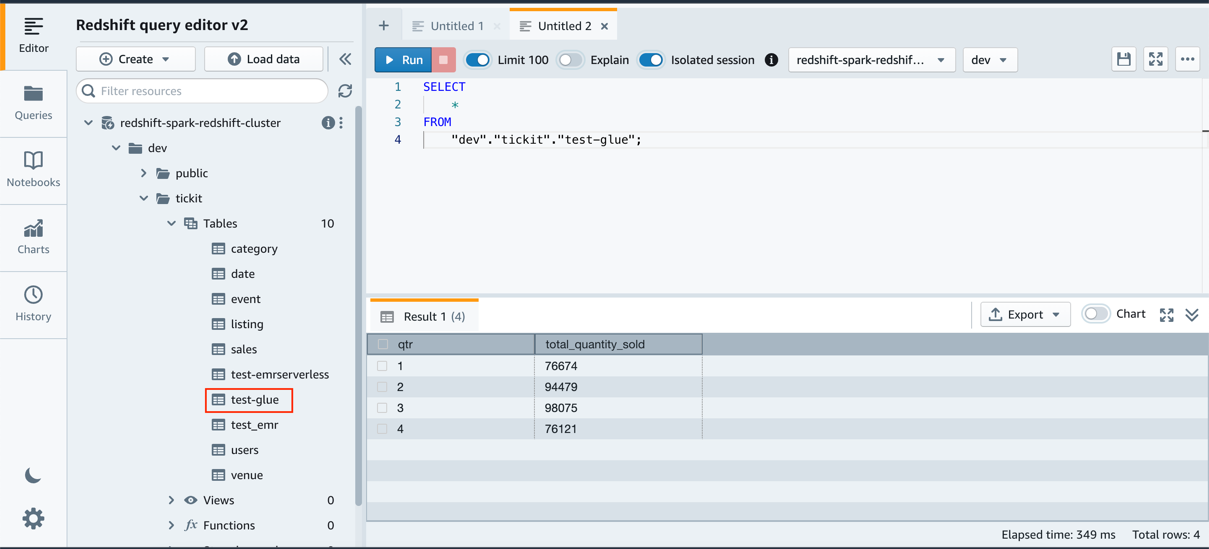

- Kui töö on edukalt lõppenud, saate kontrollida AWS-liimitööga loodud tabeli testliimi väljundit.

- Kontrollime Amazon Redshift päringurühma jaoks käivitatud allakäigupäringuid

glue-redshift. Andmebaasi vastu saate käivitada järgmise SQL-lausedev:

parimad tavad

Pidage meeles järgmisi parimaid tavasid.

- Kaaluge Amazon EMR-i Apache Sparki jaoks Amazon Redshift integratsiooni kasutamist, selle asemel, et kasutada

redshift-sparkpistik (kogukonnaversioon) teie uute Apache Sparki töökohtade jaoks. - Kui teil on olemasolevaid Apache Sparki töid kasutades

redshift-sparkpistik (kogukonna versioon), kaaluge nende täiendamist, et kasutada Amazon Redshifti integratsiooni Apache Sparki jaoks - Amazon Redshift integratsioon Apache Sparki jaoks rakendab jõudluse optimeerimiseks automaatselt predikaatide ja päringu allalaadimist. Soovitame kasutada toetatud funktsioone (

autopushdown) teie päringus. Apache Sparki Amazon Redshifti integratsioon muudab funktsiooni SQL-päringuks ja käivitab päringu rakenduses Amazon Redshift. Selle optimeerimise tulemusel hangitakse vajalikud andmed, nii et Apache Spark saab töödelda vähem andmeid ja omada paremat jõudlust.- Kaaluge koondtõukefunktsioonide kasutamist, näiteks

avg,count,max,minjasumfiltreeritud andmete toomiseks andmetöötluseks. - Kaaluge Boole'i tõukeoperaatorite kasutamist, näiteks

in,isnull,isnotnull,contains,endswithjastartswithfiltreeritud andmete toomiseks andmetöötluseks. - Kaaluge loogiliste tõukeoperaatorite kasutamist, näiteks

and,orjanot(Või!) filtreeritud andmete toomiseks andmetöötluseks.

- Kaaluge koondtõukefunktsioonide kasutamist, näiteks

- Soovitatav on IAM-i roll parameetri abil edasi anda

aws_iam_roleAmazon Redshift autentimiseks teie Apache Sparki rakendusest Amazon EMR-is või AWS Glue'is. IAM-i rollil peaksid olema vajalikud õigused ajutiste IAM-mandaatide hankimiseks, et autentida Amazon Redshiftis, nagu on näidatud selle ajaveebi jaotises „Apache Sparki Amazon Redshifti integreerimise näited Apache Sparki rakenduses”. - Selle funktsiooniga ei pea te säilitama oma Amazon Redshifti kasutajanime ja parooli saladuste halduris ja Amazon Redshifti andmebaasis.

- Amazon Redshift kasutab nende ajutiste andmete salvestamiseks Amazon S3-sse UNLOAD SQL-lauset. Rakendus Apache Spark hangib tulemused ajutisest kataloogist (salvestatud Parquet failivormingus). Seda Amazon S3 ajutist kataloogi ei puhastata automaatselt ja see võib seetõttu lisada lisakulusid. Soovitame kasutada Amazon S3 elutsükli poliitika S3 ämbri säilitusreeglite määratlemiseks.

- Soovitatav on sisse lülitada Amazon Redshift auditi logimine ühenduste ja kasutajate tegevuste teabe logimiseks oma andmebaasi.

- Soovitatav on sisse lülitada Amazon Redshift puhkeolekus krüptimine et krüpteerida teie andmed nii, nagu Amazon Redshift need oma andmekeskustesse kirjutab, ja dekrüpteerida need teie eest, kui neile juurde pääsete.

- Soovitatav on minna üle versioonile AWS Glue v4.0 ja uuemale versioonile, et kasutada Amazon Redshift integratsiooni Apache Sparki jaoks, mis on karbist väljas saadaval. AWS Glue'i sellele versioonile üleminekul kasutatakse seda funktsiooni automaatselt.

- Apache Sparki Amazon Redshift integratsiooni kasutamiseks on soovitatav minna üle versioonile Amazon EMR v6.9.0 ja uuemale. Te ei pea otseselt haldama ühtegi draiverit ega JAR-faili.

- Kaaluge Amazon EMR Studio sülearvutite kasutamist oma Amazon Redshifti andmetega suhtlemiseks rakenduses Apache Spark.

- Kaaluge AWS Glue Studio kasutamist Apache Sparki tööde loomiseks visuaalse liidese abil. Samuti saate AWS Glue Studios lülituda Apache Sparki koodi kirjutamisele kas Scalas või PySparkis.

Koristage

CloudFormationi malli osana loodud ressursside puhastamiseks tehke järgmised toimingud, et teil ei võetaks ressursside eest arvet, kui te neid enam ei kasuta.

- Peatage Amazon EMR Serverless rakendus:

- Juurdepääs Amazon EMR Studio'ile, valides või kopeerides võtme jaoks CloudFormationi virna väljundites oleva lingi

EMRStudioURL. - Vali Rakendused all Serverita navigeerimispaanil.

- Juurdepääs Amazon EMR Studio'ile, valides või kopeerides võtme jaoks CloudFormationi virna väljundites oleva lingi

Leiad nimega CloudFormationi virna loodud EMR-rakenduse emr-spark-redshift.

-

- Kui rakenduse olek on Peatatud, saate liikuda järgmiste sammude juurde. Kui aga rakenduse olek on Alustatud, valige rakenduse nimi ja seejärel valige Peatage rakendus ja Peatage rakendus uuesti kinnitada.

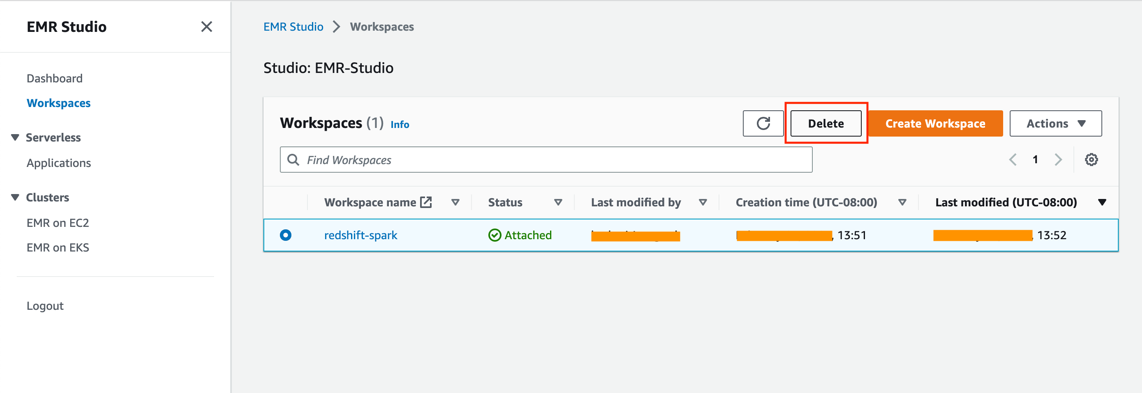

- Kustutage Amazon EMR Studio tööruum:

- Juurdepääs Amazon EMR Studio'ile, valides või kopeerides võtme jaoks CloudFormationi virna väljundites oleva lingi

EMRStudioURL. - Vali tööruumid navigeerimispaanil.

- Valige loodud tööruum ja tehke valik kustutama, siis vali kustutama uuesti kinnitada.

- Juurdepääs Amazon EMR Studio'ile, valides või kopeerides võtme jaoks CloudFormationi virna väljundites oleva lingi

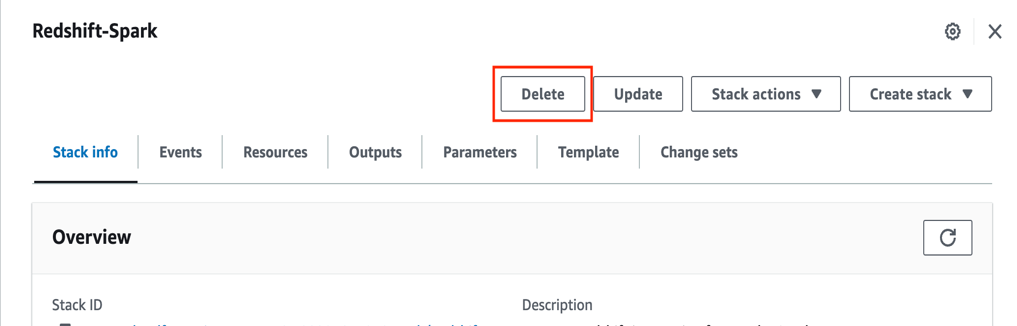

- Kustutage CloudFormationi virn:

-

- Liikuge AWS CloudFormationi konsoolis varem loodud virna juurde.

- Valige virna nimi ja seejärel valige kustutama virna eemaldamiseks ja selle postituse osana loodud ressursside kustutamiseks.

- Valige kinnituskuval Kustuta virn.

Järeldus

Selles postituses selgitasime, kuidas saate kasutada Apache Sparki jaoks Amazon Redshift integratsiooni, et luua ja juurutada rakendusi Amazon EMR-iga Amazon EC2-s, Amazon EMR Serverlessis ja AWS Glue'is, et automaatselt rakendada predikaatide ja päringu tõukejõudu, et optimeerida andmete päringu jõudlust. Amazon Redshiftis. Äärmiselt soovitatav on kasutada Apache Sparki jaoks Amazon Redshift integratsiooni, et teie Amazon EMR-i või AWS-liimiga Amazon Redshiftiga sujuv ja turvaline ühendus luua.

Mõned meie kliendid peavad Apache Sparki Amazon Redshifti integratsiooni kohta ütlema järgmist:

„Anname oma inseneridele võimaluse luua oma andmekonveierid ja rakendused Apache Sparkiga Pythoni ja Scala abil. Tahtsime kohandatud lahendust, mis lihtsustaks toiminguid ning pakuks meie klientidele kiiremini ja tõhusamalt, ning see on see, mida me saame Apache Sparki uue Amazon Redshift integratsiooniga.

— Huron Consulting

„GE Aerospace kasutab AWS-i analüütikat ja Amazon Redshifti, et võimaldada kriitilise tähtsusega äriteavet, mis juhib olulisi äriotsuseid. Amazon S3-st automaatse kopeerimise toega saame luua lihtsamaid andmekonveierid andmete teisaldamiseks Amazon S3-st Amazon Redshifti. See kiirendab meie andmetoodete tiimide võimet andmetele juurde pääseda ja lõppkasutajatele teadmisi edastada. Kulutame rohkem aega andmete kaudu väärtuse lisamisele ja vähem aega integreerimisele.

-GE Aerospace

„Meie fookuses on iseteenindusliku juurdepääsu pakkumine andmetele kõigile meie Goldman Sachsi kasutajatele. Meie avatud lähtekoodiga andmehaldus- ja haldusplatvorm Legend võimaldab kasutajatel arendada andmekeskseid rakendusi ja saada andmepõhiseid teadmisi, kui teeme koostööd finantsteenuste valdkonnas. Apache Sparki Amazon Redshifti integratsiooniga saab meie andmeplatvormi meeskond juurdepääsu Amazon Redshifti andmetele minimaalsete käsitsi sammudega, võimaldades nullkoodiga ETL-i, mis suurendab meie võimet hõlbustada inseneride keskendumist oma töövoo täiustamisele. nad koguvad täielikku ja õigeaegset teavet. Loodame näha rakenduste jõudluse paranemist ja paremat turvalisust, kuna meie kasutajad pääsevad nüüd hõlpsalt juurde Amazon Redshifti uusimatele andmetele.

- Goldman Sachs

Autoritest

Gagan Brahmi on vanemspetsialist lahenduste arhitekt, kes keskendub suurandmete analüütikale ja AI/ML platvormile Amazon Web Servicesis. Gaganil on üle 18-aastane kogemus infotehnoloogia vallas. Ta aitab klientidel AWS-is väga skaleeritavaid, tõhusaid ja turvalisi pilvepõhiseid lahendusi välja töötada ja luua. Vabal ajal veedab ta aega perega ja uurib uusi kohti.

Gagan Brahmi on vanemspetsialist lahenduste arhitekt, kes keskendub suurandmete analüütikale ja AI/ML platvormile Amazon Web Servicesis. Gaganil on üle 18-aastane kogemus infotehnoloogia vallas. Ta aitab klientidel AWS-is väga skaleeritavaid, tõhusaid ja turvalisi pilvepõhiseid lahendusi välja töötada ja luua. Vabal ajal veedab ta aega perega ja uurib uusi kohti.

Vivek Gautam on andmearhitekt, kes on spetsialiseerunud andmejärvedele ettevõttes AWS Professional Services. Ta teeb koostööd ettevõtete klientidega, kes loovad AWS-is andmetooteid, analüüsiplatvorme ja lahendusi. Kui just andmejärvi ei ehita ja projekteeri, on Vivek toiduhuviline, kellele meeldib uudistada ka uusi reisisihtkohti ja matkata.

Vivek Gautam on andmearhitekt, kes on spetsialiseerunud andmejärvedele ettevõttes AWS Professional Services. Ta teeb koostööd ettevõtete klientidega, kes loovad AWS-is andmetooteid, analüüsiplatvorme ja lahendusi. Kui just andmejärvi ei ehita ja projekteeri, on Vivek toiduhuviline, kellele meeldib uudistada ka uusi reisisihtkohti ja matkata.

Naresh Gautam on 20-aastase kogemusega AWS-i andmeanalüüsi ja AI/ML juht, kellele meeldib aidata klientidel luua väga kättesaadavaid, suure jõudlusega ja kulutõhusaid andmeanalüütika ja AI/ML lahendusi, et anda klientidele andmepõhiseid otsuseid. . Vabal ajal naudib ta mediteerimist ja kokkamist.

Naresh Gautam on 20-aastase kogemusega AWS-i andmeanalüüsi ja AI/ML juht, kellele meeldib aidata klientidel luua väga kättesaadavaid, suure jõudlusega ja kulutõhusaid andmeanalüütika ja AI/ML lahendusi, et anda klientidele andmepõhiseid otsuseid. . Vabal ajal naudib ta mediteerimist ja kokkamist.

Beaux Sharifi on tarkvaraarenduse insener Amazon Redshifti juhtide meeskonnas, kus ta juhib Amazon Redshifti integratsiooni arendamist Apache Sparki pistikuga. Tal on üle 20-aastane kogemus andmepõhiste platvormide loomisel mitmes tööstusharus. Vabal ajal veedab ta meelsasti perega aega ja surfab.

Beaux Sharifi on tarkvaraarenduse insener Amazon Redshifti juhtide meeskonnas, kus ta juhib Amazon Redshifti integratsiooni arendamist Apache Sparki pistikuga. Tal on üle 20-aastane kogemus andmepõhiste platvormide loomisel mitmes tööstusharus. Vabal ajal veedab ta meelsasti perega aega ja surfab.

- SEO-põhise sisu ja PR-levi. Võimenduge juba täna.

- Platoblockchain. Web3 metaversiooni intelligentsus. Täiustatud teadmised. Juurdepääs siia.

- Tuleviku rahapaja Adryenn Ashley. Juurdepääs siia.

- Allikas: https://aws.amazon.com/blogs/big-data/simplify-and-speed-up-apache-spark-applications-on-amazon-redshift-data-with-amazon-redshift-integration-for-apache-spark/

- :on

- :on

- :mitte

- $ UP

- 1

- 10

- 100

- 107

- 11

- 20

- 20 aastat

- 7

- 8

- 9

- a

- võime

- Võimalik

- MEIST

- üle

- kiirendab

- juurdepääs

- Juurdepääs andmetele

- Ligipääs

- kinnitada

- üle

- tegevus

- tegevus

- lisatud

- lisamine

- Täiendavad lisad

- haldus-

- ADEelis

- Aerospace

- vastu

- AI / ML

- Materjal: BPA ja flataatide vaba plastik

- Lubades

- võimaldab

- juba

- Ka

- Amazon

- Amazon EC2

- Amazon EMR

- Amazon Web Services

- an

- analüüs

- analytics

- analüüsima

- ja

- mistahes

- Apache

- Apache Spark

- taotlus

- rakendused

- kehtima

- asjakohane

- OLEME

- AS

- At

- audit

- autentida

- Autentimine

- automaatselt

- saadaval

- AWS

- AWS CloudFormation

- AWS liim

- AWS-i professionaalsed teenused

- tagasi

- BE

- sest

- muutuma

- alustama

- on

- BEST

- parimaid tavasid

- Parem

- Suur

- Big andmed

- Blogi

- põhi

- Kast

- ehitama

- ehitaja

- Ehitus

- ehitatud

- äri

- ärimõju

- by

- helistama

- Kampaaniad

- CAN

- võimeid

- juhul

- juhtudel

- Rakke

- Centers

- väljakutse

- kontrollima

- Vali

- valimine

- klass

- kliendid

- Cluster

- kood

- Teevad koostööd

- koguma

- COM

- kombinatsioon

- ühine

- kogukond

- ettevõte

- täitma

- Lõpetab

- kompromiteeriv

- Arvutama

- arvuti

- Kinnitama

- kinnitus

- Võta meiega ühendust

- ühendamine

- ühendus

- Side

- Arvestama

- konsool

- kontekst

- kontrollida

- cooking

- kopeerimine

- Maksma

- kuluefektiivne

- võiks

- looma

- loodud

- loob

- loomine

- volikiri

- kriitiline

- klient

- Kliendid

- armatuurlaud

- andmed

- andmete analüüs

- Andmete analüüs

- andmekeskuste

- andmejärv

- andmehaldus

- Andmeplatvorm

- andmetöötlus

- andmete salvestamine

- andmekogus

- andmepõhistele

- andmebaas

- kuupäev

- Otsuse tegemine

- otsused

- Langevad

- Avaldage lahti

- tarnima

- esitatud

- juurutada

- projekteerimine

- sihtkohtadesse

- detailid

- dev

- arendama

- Arendajad

- & Tarkvaraarendus

- erinev

- arutama

- Ekraan

- jagatud

- Ära

- alla

- lae alla

- ajam

- juht

- draiverid

- Drop

- dünaamiliselt

- iga

- Ajalugu

- lihtsam

- kergesti

- toimetaja

- mõju

- tõhus

- tõhusalt

- kumbki

- volitama

- võimaldama

- võimaldab

- insener

- Inseneriteadus

- Inseneride

- Parandab

- tagama

- tagab

- sisene

- ettevõte

- ettevõtte kliendid

- entusiast

- keskkond

- looma

- Eeter (ETH)

- näide

- näited

- olemasolevate

- Laiendama

- ootama

- kogemus

- selgitas

- uurima

- väljavõte

- pere

- kiiremini

- tunnusjoon

- fail

- Faile

- Lõpuks

- finants-

- finantsteenused

- leidma

- lõpp

- kõikuma

- Keskenduma

- keskendunud

- Järel

- järgneb

- toit

- eest

- formaat

- FRAME

- Raamistik

- tasuta

- Alates

- funktsioon

- funktsioonid

- kasu

- tekitama

- loodud

- saama

- GitHub

- Go

- kuldmees

- Goldman Sachs

- valitsemistava

- Grupp

- Olema

- he

- aitama

- aidates

- aitab

- suur jõudlus

- kõrgelt

- Matkad

- Kuidas

- Kuidas

- aga

- HTML

- http

- HTTPS

- IAC

- IAM

- identifitseerima

- Identity

- mõju

- import

- oluline

- parandama

- paranenud

- paranemine

- parandab

- in

- hõlmab

- Suurendama

- eraldi

- tööstusharudes

- tööstus

- info

- infotehnoloogia

- teavitatakse

- Infrastruktuur

- algatama

- teadmisi

- Näiteks

- selle asemel

- integratsioon

- integratsioon

- suhelda

- interaktiivne

- Interface

- sisse

- inventar

- varude andmed

- IT

- ITS

- Java

- töö

- Tööturg

- liituma

- Jupyteri sülearvuti

- Võti

- Teadma

- järv

- Keeled

- viimane

- hiljemalt

- algatama

- käivitamine

- juht

- Juhtimine

- Leads

- õppimine

- Lets

- eluring

- nagu

- LIMIT

- joon

- LINK

- nimekiri

- koormus

- kohalik

- kohapeal

- asub

- liising

- loogiline

- enam

- Vaata

- Madal

- masin

- masinõpe

- tehtud

- säilitada

- tegema

- juhtima

- juhitud

- juhtimine

- juht

- käsiraamat

- Turg

- turud

- mai..

- Meditatsioon

- mainitud

- menüü

- võib

- meeles

- minimaalne

- protokoll

- ML

- rohkem

- liikuma

- mitmekordne

- nimi

- Navigate

- NAVIGATSIOON

- vajalik

- Vajadus

- vaja

- Uus

- järgmine

- märkmik

- märkmikud

- märkida

- nüüd

- of

- ametlik

- on

- ainult

- avatud

- avatud lähtekoodiga

- töö

- Operations

- ettevõtjad

- optimeerimine

- optimeerima

- optimeeritud

- Valikud

- or

- et

- tellimuste

- meie

- väljund

- üle

- üldine

- lehekülg

- pane

- parameeter

- parameetrid

- osa

- sooritama

- Parool

- tee

- täiustamine

- täitma

- jõudlus

- esitades

- täidab

- Õigused

- Kohad

- kava

- inimesele

- Platvormid

- Platon

- Platoni andmete intelligentsus

- PlatoData

- Punkt

- poliitika

- pop-up

- populaarne

- post

- tavad

- Valmistama

- eeldused

- eelmine

- esmane

- protsess

- töötlemine

- Toode

- Produktsioon

- Toodet

- professionaalne

- edendamine

- Tutvustusi

- anda

- tingimusel

- annab

- pakkudes

- eesmärk

- Lükkama

- Python

- päringud

- juhuslik

- Lugenud

- soovitama

- soovitatav

- vabastama

- asjakohane

- kõrvaldama

- asendama

- aru

- taotleda

- Taotlusi

- nõutav

- ressurss

- Vahendid

- Tulemused

- säilitamine

- tagasipöördumine

- taaskasutada

- tulu

- Paremklõpsake

- Roll

- rollid

- Marsruut

- eeskirjade

- jooks

- jooksmine

- Sachs

- salveitegija

- müük

- Näidisandmekogum

- Säästa

- Scala

- skaalautuvia

- Ekraan

- sujuv

- sujuvalt

- Osa

- lõigud

- kindlustama

- turvalisus

- segmendid

- valides

- Iseteenindus

- vanem

- Serverita

- Teenused

- istung

- komplekt

- kehtestamine

- mitu

- peaks

- näitama

- näidatud

- Näitused

- Samamoodi

- lihtne

- lihtsustatud

- lihtsustama

- So

- tarkvara

- tarkvaraarenduse

- lahendus

- Lahendused

- mõned

- allikas

- Säde

- spetsialist

- kiirus

- kulutama

- Kulutused

- SQL

- Kestab

- matkimine

- huvirühmad

- algus

- alustatud

- väljavõte

- olek

- Sammud

- peatatud

- ladustamine

- salvestada

- ladustatud

- nöör

- struktureeritud

- stuudio

- esitama

- alamvõrgud

- Edukalt

- selline

- toetama

- Toetatud

- Lüliti

- süsteem

- tabel

- kohandatud

- Võtma

- võtab

- sihtmärk

- suunatud

- ülesanded

- meeskond

- Tehnoloogia

- šabloon

- ajutine

- test

- et

- .

- teave

- oma

- Neile

- seetõttu

- Need

- see

- Läbi

- aeg

- korda

- et

- ülemine

- jälgida

- tehinguline

- Tehingud

- Muutma

- muundumised

- ümber

- transformeerivate

- reisima

- Pöörake

- all

- ainulaadne

- Värskendused

- ajakohastatud

- upgrade

- täiendatud

- URL

- kasutama

- kasutage juhtumit

- Kasutatud

- Kasutaja

- Kasutajad

- ära kasutama

- kasutades

- KINNITAGE

- kinnitamine

- väärtus

- Väärtused

- sort

- kontrollima

- versioon

- kaudu

- vaade

- nähtavus

- tagaotsitav

- Ladu

- oli

- we

- web

- veebiteenused

- Hästi

- M

- mis

- WHO

- will

- koos

- jooksul

- ilma

- töövoog

- töö

- töötab

- kirjutama

- kirjutamine

- kirjalik

- yaml

- aasta

- aastat

- sa

- Sinu

- sephyrnet