En esta era de big data, las organizaciones de todo el mundo buscan constantemente formas innovadoras de extraer valor e información de sus vastos conjuntos de datos. Apache Spark Ofrece la escalabilidad y velocidad necesarias para procesar grandes cantidades de datos de manera eficiente.

EMR de Amazon es la solución de big data en la nube líder en la industria para procesamiento de datos a escala de petabytes, análisis interactivos y aprendizaje automático (ML) utilizando marcos de código abierto como Apache Spark. Colmena Apachey presto. Amazon EMR es el mejor lugar para ejecutar Apache Spark. Puede crear de forma rápida y sencilla clústeres de Spark administrados desde Consola de administración de AWS, Interfaz de línea de comandos de AWS (AWS CLI) o API de Amazon EMR. También puede utilizar funciones adicionales de Amazon EMR, incluida la rápida Servicio de almacenamiento simple de Amazon (Amazon S3) mediante el sistema de archivos de Amazon EMR (EMRFS), integración con el Punto de Amazon EC2 mercado y el Pegamento AWS Catálogo de datos y escalado administrado de EMR para agregar o eliminar instancias de su clúster. Estudio de Amazon EMR es un entorno de desarrollo integrado (IDE) que facilita a los científicos e ingenieros de datos desarrollar, visualizar y depurar aplicaciones de ingeniería y ciencia de datos escritas en R, Python, Scala y PySpark. EMR Studio proporciona cuadernos Jupyter totalmente administrados y herramientas como Spark UI y YARN Timeline Service para simplificar la depuración.

Para desbloquear el potencial oculto en los tesoros de datos, es esencial ir más allá del análisis tradicional. Ingrese a la IA generativa, una tecnología de vanguardia que combina el aprendizaje automático con la creatividad para generar texto, arte e incluso código similar al humano. lecho rocoso del amazonas es la forma más sencilla de crear y escalar aplicaciones de IA generativa con modelos básicos (FM). Amazon Bedrock es un servicio totalmente administrado que hace que los FM de Amazon y de las principales empresas de IA estén disponibles a través de una API, de modo que pueda experimentar rápidamente con una variedad de FM en el patio de recreo y utilizar una única API para realizar inferencias independientemente de los modelos que elija, lo que le brinda Le brinda la flexibilidad de utilizar FM de diferentes proveedores y mantenerse actualizado con las últimas versiones de los modelos con cambios mínimos de código.

En esta publicación, exploramos cómo puede potenciar sus análisis de datos con IA generativa utilizando Amazon EMR, Amazon Bedrock y pyspark-ai biblioteca. La biblioteca pyspark-ai es un SDK en inglés para Apache Spark. Toma instrucciones en idioma inglés y las compila en objetos PySpark como DataFrames. Esto hace que trabajar con Spark sea sencillo, lo que le permite concentrarse en extraer valor de sus datos.

Resumen de la solución

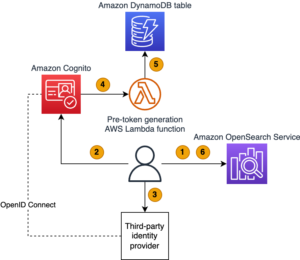

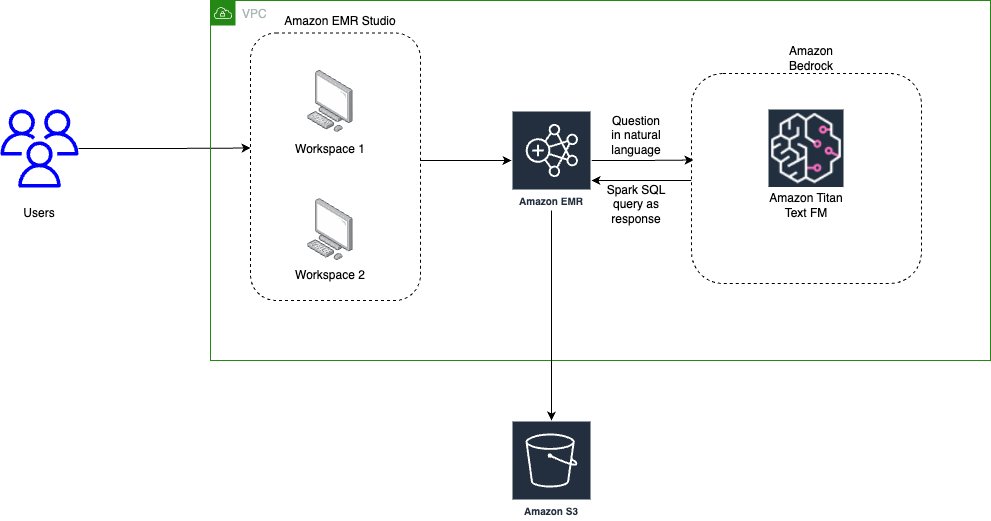

El siguiente diagrama ilustra la arquitectura para utilizar IA generativa con Amazon EMR y Amazon Bedrock.

EMR Studio es un IDE basado en web para portátiles Jupyter totalmente administrados que se ejecutan en clústeres de EMR. Interactuamos con los espacios de trabajo de EMR Studio conectados a un clúster de EMR en ejecución y ejecutamos el cuaderno proporcionado como parte de esta publicación. Usamos el Taxi de la ciudad de Nueva York datos para obtener información sobre varios viajes en taxi realizados por los usuarios. Hacemos las preguntas en lenguaje natural además de los datos cargados en Spark DataFrame. Luego, la biblioteca pyspark-ai utiliza Amazon Titan Text FM de Amazon Bedrock para crear una consulta SQL basada en la pregunta en lenguaje natural. La biblioteca pyspark-ai toma la consulta SQL, la ejecuta utilizando Spark SQL y proporciona los resultados al usuario.

En esta solución, puede crear y configurar los recursos necesarios en su cuenta de AWS con un Formación en la nube de AWS plantilla. La plantilla crea el Pegamento AWS bases de datos y tablas, depósito S3, VPC y otros Gestión de identidades y accesos de AWS (IAM) recursos que se utilizan en la solución.

La plantilla está diseñada para demostrar cómo utilizar EMR Studio con el paquete pyspark-ai y Amazon Bedrock, y no está diseñada para uso en producción sin modificaciones. Además, la plantilla utiliza el us-east-1 Región y es posible que no funcione en otras regiones sin modificaciones. La plantilla crea recursos que generan costos mientras están en uso. Siga los pasos de limpieza al final de esta publicación para eliminar los recursos y evitar cargos innecesarios.

Requisitos previos

Antes de iniciar la pila de CloudFormation, asegúrese de tener lo siguiente:

- Una cuenta de AWS que proporciona acceso a los servicios de AWS

- Un usuario de IAM con una clave de acceso y una clave secreta para configurar la CLI de AWS y permisos para crear un rol de IAM, políticas de IAM y pilas en AWS CloudFormation.

- El modelo Titan Text G1 – Express se encuentra actualmente en versión preliminar, por lo que necesitas tener acceso a la vista previa para usarlo como parte de esta publicación.

Cree recursos con AWS CloudFormation

CloudFormation crea los siguientes recursos de AWS:

- Una pila de VPC con subredes públicas y privadas para usar con EMR Studio, tablas de enrutamiento y puerta de enlace NAT.

- Un clúster EMR con Python 3.9 instalado. Estamos utilizando una acción de arranque para instalar Python 3.9 y otros paquetes relevantes como las dependencias de pyspark-ai y Amazon Bedrock. (Para obtener más información, consulte la secuencia de comandos de arranque.)

- Un depósito S3 para EMR Studio Workspace y almacenamiento de portátiles.

- Roles y políticas de IAM para la configuración de EMR Studio, el acceso a Amazon Bedrock y la ejecución de cuadernos

Para comenzar, complete los siguientes pasos:

La pila de CloudFormation tarda aproximadamente entre 20 y 30 minutos en completarse. Puede monitorear su progreso en la consola de AWS CloudFormation. Cuando su estado dice CREATE_COMPLETE, su cuenta de AWS tendrá los recursos necesarios para implementar esta solución.

Crear estudio EMR

Ahora puede crear un EMR Studio y un espacio de trabajo para trabajar con el código del cuaderno. Complete los siguientes pasos:

- En la consola de EMR Studio, elija Crear estudio.

- Escriba la Nombre del estudio as

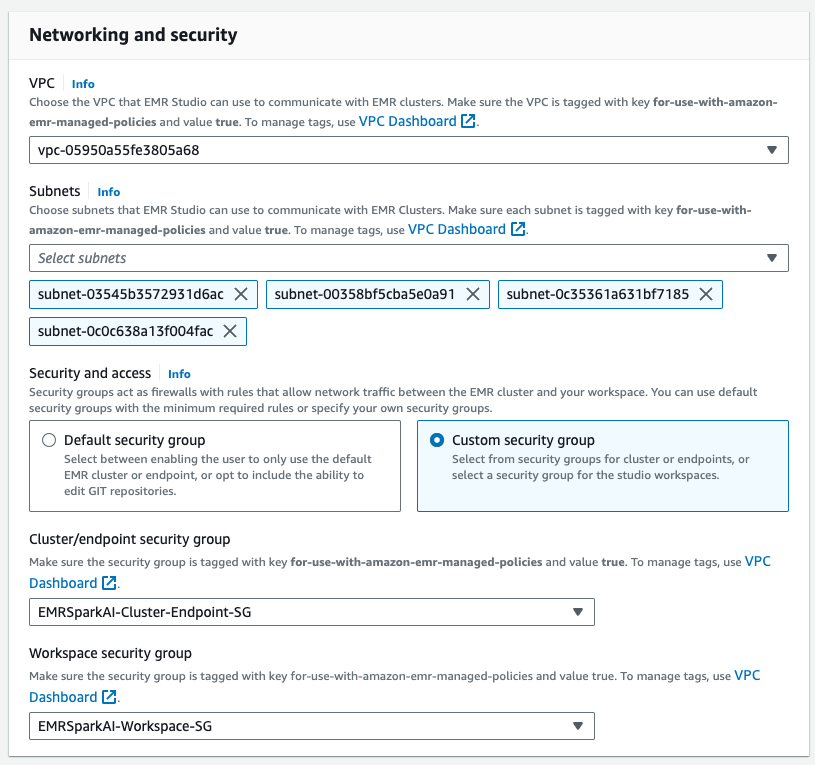

GenAI-EMR-Studioy proporcione una descripción. - En Redes y seguridad sección, especifique lo siguiente:

- VPC, elija la VPC que creó como parte de la pila de CloudFormation que implementó. Obtenga el ID de VPC utilizando las salidas de CloudFormation para la clave VPCID.

- Subredes, elija las cuatro subredes.

- Seguridad y acceso., seleccione Grupo de seguridad personalizado.

- Grupo de seguridad de clúster/punto final, escoger

EMRSparkAI-Cluster-Endpoint-SG. - Grupo de seguridad del espacio de trabajo, escoger

EMRSparkAI-Workspace-SG.

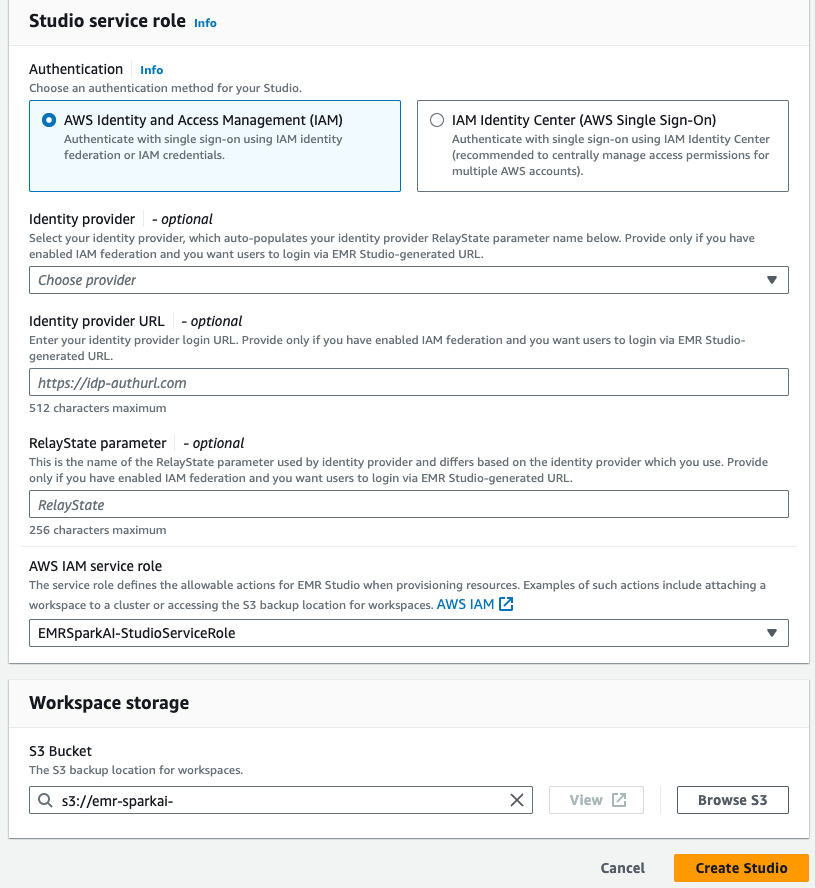

- En Rol de servicio de estudio sección, especifique lo siguiente:

- Autenticación, seleccione Administración de acceso e identidad de AWS (IAM).

- Rol del servicio AWS IAM, escoger

EMRSparkAI-StudioServiceRole.

- En Almacenamiento del espacio de trabajo sección, busque y elija el depósito S3 para el almacenamiento que comienza con

emr-sparkai-<account-id>. - Elige Crear estudio.

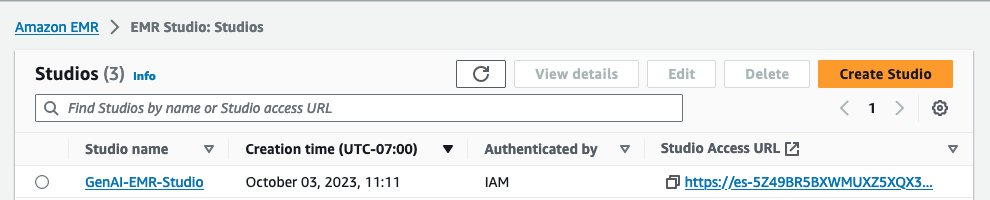

- Cuando se crea EMR Studio, elija el enlace debajo URL de acceso al estudio para acceder al Estudio.

- Cuando estés en Studio, elige Crear espacio de trabajo.

- Añada

emr-genaicomo nombre del espacio de trabajo y elija Crear espacio de trabajo. - Cuando se crea el espacio de trabajo, elija su nombre para iniciarlo (asegúrese de haber desactivado los bloqueadores de ventanas emergentes).

Análisis de big data utilizando Apache Spark con Amazon EMR e IA generativa

Ahora que hemos completado la configuración requerida, podemos comenzar a realizar análisis de big data utilizando Apache Spark con Amazon EMR e IA generativa.

Como primer paso, cargamos un cuaderno que tiene el código y los ejemplos necesarios para trabajar con el caso de uso. Utilizamos el conjunto de datos de NY Taxi, que contiene detalles sobre viajes en taxi.

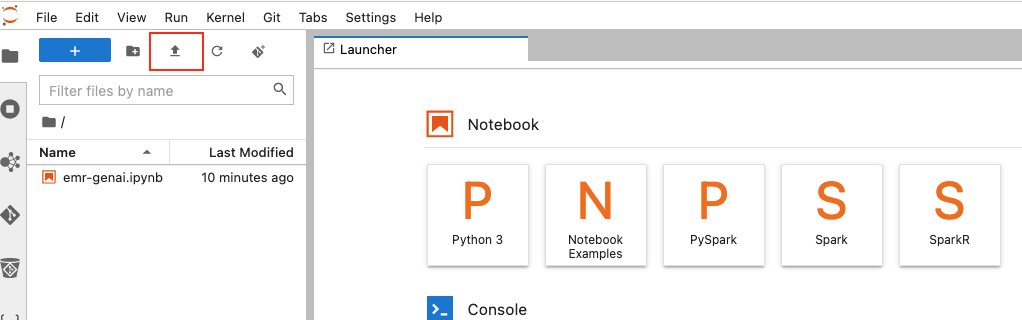

- Descargar el archivo del cuaderno NYTaxi.ipynb y cárguelo en su espacio de trabajo eligiendo el icono de carga.

- Después de importar el cuaderno, ábralo y elija

PySparkcomo el kernel.

PySpark AI de forma predeterminada utiliza ChatGPT4.0 de OpenAI como modelo LLM, pero también puede conectar modelos de Amazon Bedrock, JumpStart de Amazon SageMakery otros modelos de terceros. Para esta publicación, mostramos cómo integrar el modelo Amazon Bedrock Titan para la generación de consultas SQL y ejecutarlo con Apache Spark en Amazon EMR.

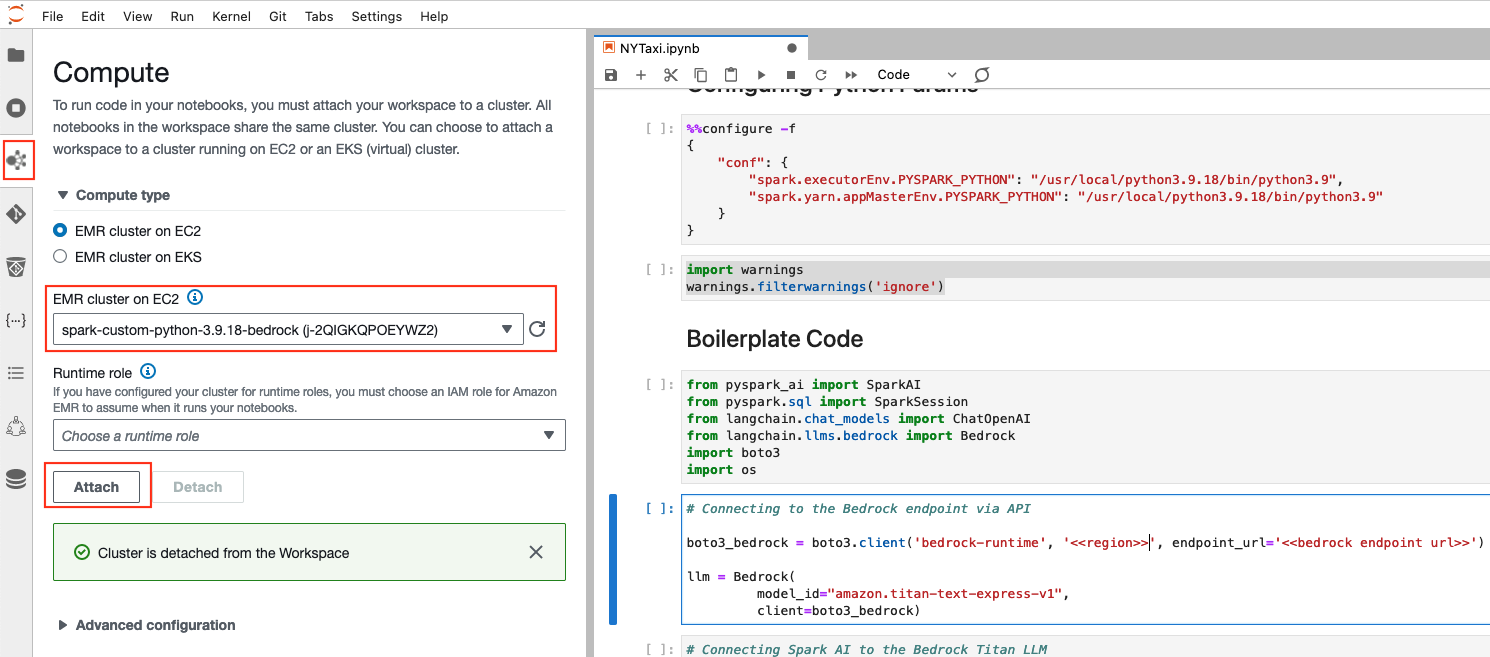

- Para comenzar con el cuaderno, debe asociar el espacio de trabajo a una capa informática. Para ello, elija el Calcular en el panel de navegación y elija el clúster EMR creado por la pila de CloudFormation.

- Configure los parámetros de Python para utilizar el paquete Python 3.9 actualizado con Amazon EMR:

- Importe las bibliotecas necesarias:

- Una vez importadas las bibliotecas, puede definir el modelo LLM desde Amazon Bedrock. En este caso, utilizamos amazon.titan-text-express-v1. Debe ingresar la región y la URL del punto final de Amazon Bedrock según su acceso a la vista previa para el modelo Titan Text G1 – Express.

- Conecte Spark AI al modelo de Amazon Bedrock LLM para la generación de consultas SQL basadas en preguntas en lenguaje natural:

Aquí, hemos inicializado Spark AI con detallado=False; También puedes establecer verbose=True para ver más detalles.

Ahora puede leer los datos de NYC Taxi en un Spark DataFrame y utilizar el poder de la IA generativa en Spark.

- Por ejemplo, puede preguntar el recuento de la cantidad de registros en el conjunto de datos:

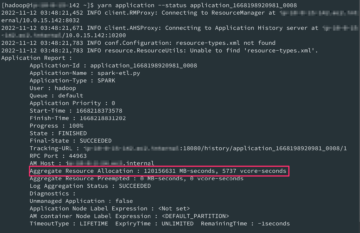

Obtenemos la siguiente respuesta:

Spark AI utiliza internamente LangChain y cadena SQL, que oculta la complejidad a los usuarios finales que trabajan con consultas en Spark.

El cuaderno tiene algunos escenarios de ejemplo más para explorar el poder de la IA generativa con Apache Spark y Amazon EMR.

Limpiar

Vaciar el contenido del depósito S3 emr-sparkai-<account-id>, elimine el espacio de trabajo de EMR Studio creado como parte de esta publicación y luego elimine la pila de CloudFormation que implementó.

Conclusión

Esta publicación mostró cómo puede potenciar sus análisis de big data con la ayuda de Apache Spark con Amazon EMR y Amazon Bedrock. El paquete PySpark AI le permite obtener información significativa de sus datos. Ayuda a reducir el tiempo de desarrollo y análisis, reduciendo el tiempo para escribir consultas manuales y permitiéndole centrarse en su caso de uso empresarial.

Acerca de los autores

Saurabh Butyani es arquitecto principal de soluciones especialista en análisis en AWS. Es un apasionado de las nuevas tecnologías. Se unió a AWS en 2019 y trabaja con clientes para brindar orientación arquitectónica para ejecutar casos de uso de IA generativa, soluciones de análisis escalables y arquitecturas de malla de datos utilizando servicios de AWS como Amazon Bedrock, Amazon SageMaker, Amazon EMR, Amazon Athena, AWS Glue, AWS Lake Formation, y Amazon DataZone.

Saurabh Butyani es arquitecto principal de soluciones especialista en análisis en AWS. Es un apasionado de las nuevas tecnologías. Se unió a AWS en 2019 y trabaja con clientes para brindar orientación arquitectónica para ejecutar casos de uso de IA generativa, soluciones de análisis escalables y arquitecturas de malla de datos utilizando servicios de AWS como Amazon Bedrock, Amazon SageMaker, Amazon EMR, Amazon Athena, AWS Glue, AWS Lake Formation, y Amazon DataZone.

Harsh Vardhan es un arquitecto senior de soluciones de AWS, especializado en análisis. Tiene más de 8 años de experiencia trabajando en el campo de big data y ciencia de datos. Le apasiona ayudar a los clientes a adoptar las mejores prácticas y descubrir conocimientos a partir de sus datos.

Harsh Vardhan es un arquitecto senior de soluciones de AWS, especializado en análisis. Tiene más de 8 años de experiencia trabajando en el campo de big data y ciencia de datos. Le apasiona ayudar a los clientes a adoptar las mejores prácticas y descubrir conocimientos a partir de sus datos.

- Distribución de relaciones públicas y contenido potenciado por SEO. Consiga amplificado hoy.

- PlatoData.Network Vertical Generativo Ai. Empodérate. Accede Aquí.

- PlatoAiStream. Inteligencia Web3. Conocimiento amplificado. Accede Aquí.

- PlatoESG. Carbón, tecnología limpia, Energía, Ambiente, Solar, Gestión de residuos. Accede Aquí.

- PlatoSalud. Inteligencia en Biotecnología y Ensayos Clínicos. Accede Aquí.

- Fuente: https://aws.amazon.com/blogs/big-data/use-generative-ai-with-amazon-emr-amazon-bedrock-and-english-sdk-for-apache-spark-to-unlock-insights/

- :posee

- :es

- :no

- $ UP

- 1

- 10

- 100

- 107

- 11

- 20

- 200

- 2019

- 320

- 500

- 521

- 7

- 8

- 9

- 990

- a

- Nuestra Empresa

- de la máquina

- Gestión de Acceso

- Mi Cuenta

- reconocer

- la columna Acción

- add

- Adicionales

- Adicionalmente

- adoptar

- AI

- casos de uso de ia

- Todos

- Permitir

- permite

- también

- Amazon

- Atenea amazónica

- EMR de Amazon

- Amazon SageMaker

- Amazon Web Services

- cantidades

- an

- análisis

- Analytics

- y

- https://www.youtube.com/watch?v=xB-eutXNUMXJtA&feature=youtu.be

- cualquier

- APACHE

- Apache Spark

- abejas

- aplicaciones

- aproximadamente

- arquitectónico

- arquitectura

- somos

- Arte

- AS

- contacta

- Consejos

- At

- Hoy Disponibles

- evitar

- AWS

- Formación en la nube de AWS

- Pegamento AWS

- Formación del lago AWS

- Atrás

- basado

- MEJOR

- y las mejores prácticas

- Más allá de

- Big

- Big Data

- Bootstrap

- build

- pero

- .

- by

- PUEDEN

- case

- cases

- catalogar

- cadena

- Cambios

- cargos

- Elige

- la elección de

- Ciudad

- Soluciones

- grandes datos en la nube

- Médico

- código

- combina

- Empresas

- completar

- Completado

- complejidad

- Calcular

- conectado

- Conectividad

- Consola

- constantemente

- contiene

- contenido

- Precio

- Para crear

- creado

- crea

- creatividad

- En la actualidad

- Clientes

- innovador

- datos

- Data Analytics

- proceso de datos

- Ciencia de los datos

- Base de datos

- conjuntos de datos

- Fecha

- Predeterminado

- definir

- demostrar

- dependencias

- desplegado

- derivar

- descripción

- diseñado

- detalles

- desarrollar

- Desarrollo

- una experiencia diferente

- discapacitados

- descrubrir

- do

- eficiente.

- sin esfuerzo

- final

- Punto final

- Ingeniería

- certificados

- Inglés

- garantizar

- Participar

- que entran a los

- Entorno

- Era

- esencial

- Éter (ETH)

- Incluso

- ejemplo

- ejemplos

- experience

- experimento

- explorar

- expreso

- extraerlos

- RÁPIDO

- Caracteristicas

- pocos

- campo

- Archive

- final

- Nombre

- Flexibilidad

- Focus

- seguir

- siguiendo

- formación

- Fundación

- Digital XNUMXk

- marcos

- Desde

- completamente

- g1

- granero

- puerta

- generar

- generación de AHSS

- generativo

- IA generativa

- obtener

- Diezmos y Ofrendas

- Go

- guía

- Tienen

- he

- ayuda

- ayudando

- ayuda

- Oculto

- Esconder

- Cómo

- Como Hacer

- http

- HTTPS

- i

- AMI

- ICON

- ID

- Identidad

- Gestión de identidad y acceso.

- ilustra

- implementar

- importar

- in

- En otra

- Incluye

- líderes en la industria

- información

- originales

- Las opciones de entrada

- Insights

- instalar

- instancias

- Instrucciones

- integrar

- COMPLETAMENTE

- integración

- Destinado a

- interactuar

- interactivo

- internamente

- dentro

- IT

- SUS

- se unió a

- jpg

- Guardar

- Clave

- Saber

- lago

- idioma

- large

- más reciente

- lanzamiento

- .

- líder

- aprendizaje

- bibliotecas

- Biblioteca

- como

- línea

- LINK

- carga

- máquina

- máquina de aprendizaje

- para lograr

- HACE

- gestionado

- Management

- manual

- Mercado

- Puede..

- significativo

- malla

- mínimo

- minutos

- ML

- modelo

- modelos

- Monitorear

- más,

- MEJOR DE TU

- nombre

- Natural

- Lenguaje natural

- Navegación

- necesario

- ¿ Necesita ayuda

- red

- Nuevo

- Nuevas tecnologías

- cuaderno

- ordenadores portátiles

- ahora

- número

- NY

- Nueva York

- objetos

- observación

- of

- Ofertas

- on

- habiertos

- de código abierto

- or

- para las fiestas.

- Otro

- salidas

- Más de

- visión de conjunto

- paquete

- paquetes

- cristal

- parámetros

- parte

- apasionado

- realizar

- permisos

- Colocar

- Platón

- Inteligencia de datos de Platón

- PlatónDatos

- Area de juegos

- enchufe

- políticas

- ventanas emergentes

- Publicación

- posible

- industria

- prácticas

- Vista previa

- Director de la escuela

- privada

- tratamiento

- Producción

- Progreso

- proporcionar

- previsto

- los proveedores

- proporciona un

- público

- Python

- consultas

- pregunta

- Preguntas

- con rapidez

- R

- Leer

- archivos

- reducir

- la reducción de

- remitir

- Independientemente

- región

- regiones

- remove

- Requisitos

- Recursos

- respuesta

- Resultados

- paseos

- Función

- También soy miembro del cuerpo docente de World Extreme Medicine (WEM) y embajadora europea de igualdad para The Transformational Travel Council (TTC). En mi tiempo libre, soy una incansable aventurera, escaladora, patrona de día, buceadora y defensora de la igualdad de género en el deporte y la aventura. En XNUMX, fundé Almas Libres, una ONG nacida para involucrar, educar y empoderar a mujeres y niñas a través del deporte urbano, la cultura y la tecnología.

- Ruta

- Ejecutar

- correr

- corre

- sabio

- Scala

- Escalabilidad

- escalable

- Escala

- la ampliación

- escenarios

- Ciencia:

- los científicos

- Sdk

- búsqueda

- Secreto

- EN LINEA

- ver

- selecciona

- mayor

- de coches

- Servicios

- set

- Configure

- Mostrar

- mostró

- sencillos

- simplificar

- soltero

- So

- a medida

- Soluciones

- Fuente

- Spark

- especialista

- especializada

- velocidad

- SQL

- montón

- Stacks

- comienzo

- fundó

- Comience a

- Estado

- paso

- pasos

- STORAGE

- sencillo

- estudio

- subredes

- tal

- Sobrealimentar

- seguro

- te

- mesa

- toma

- toma

- Tecnologías

- Tecnología

- plantilla

- texto

- esa

- La

- su

- Les

- luego

- ellos

- terceros.

- así

- pensamiento

- A través de esta formación, el personal docente y administrativo de escuelas y universidades estará preparado para manejar los recursos disponibles que derivan de la diversidad cultural de sus estudiantes. Además, un mejor y mayor entendimiento sobre estas diferencias y similitudes culturales permitirá alcanzar los objetivos de inclusión previstos.

- equipo

- calendario

- titán

- a

- parte superior

- tradicional

- ui

- bajo

- desbloquear

- actualizado

- Enlance

- utilizan el

- caso de uso

- usado

- Usuario

- usuarios

- usos

- usando

- propuesta de

- variedad

- diversos

- Vasto

- visualizar

- Camino..

- formas

- we

- web

- servicios web

- Basado en la Web

- cuando

- que

- mientras

- seguirá

- dentro de

- sin

- Actividades:

- trabajando

- funciona

- en todo el mundo

- escribir

- escrito

- años

- york

- Usted

- tú

- zephyrnet