1Departamento de Ingeniería Mecánica, Universidad de Tsinghua, 100084 Beijing, China

2Departamento de Estadística y Ciencia de Datos, Universidad de Pensilvania

3Centro sobre las Fronteras de los Estudios de Computación, Universidad de Pekín, 100871 Pekín, China

4Facultad de Informática, Universidad de Pekín, 100871 Pekín, China

¿Encuentra este documento interesante o quiere discutirlo? Scite o deje un comentario en SciRate.

Resumen

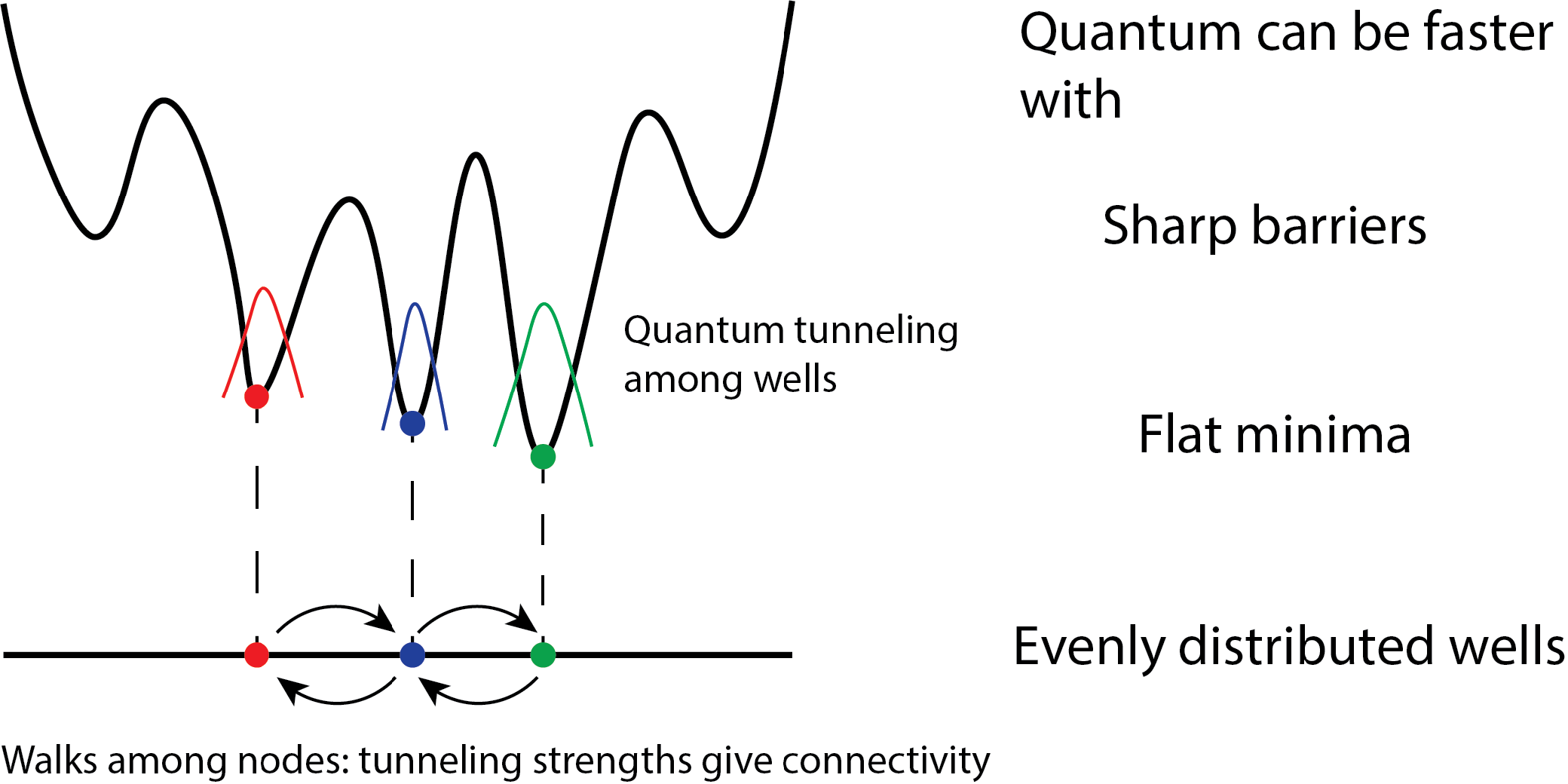

Los algoritmos clásicos a menudo no son efectivos para resolver problemas de optimización no convexos donde los mínimos locales están separados por barreras altas. En este artículo, exploramos posibles aceleraciones cuánticas para la optimización no convexa aprovechando el efecto $global$ de la tunelización cuántica. Específicamente, introducimos un algoritmo cuántico denominado caminata de tunelización cuántica (QTW) y lo aplicamos a problemas no convexos donde los mínimos locales son aproximadamente mínimos globales. Mostramos que QTW logra una aceleración cuántica sobre los descensos de gradientes estocásticos clásicos (SGD) cuando las barreras entre diferentes mínimos locales son altas pero delgadas y los mínimos son planos. Con base en esta observación, construimos un paisaje específico de doble pozo, donde los algoritmos clásicos no pueden alcanzar de manera eficiente un objetivo bien conociendo el otro bien, pero QTW sí puede hacerlo cuando se le dan los estados iniciales adecuados cerca del pozo conocido. Finalmente, corroboramos nuestros hallazgos con experimentos numéricos.

[Contenido incrustado]

Resumen popular

► datos BibTeX

► referencias

[ 1 ] Zeyuan Allen-Zhu y Yuanzhi Li. Neon2: encontrar mínimos locales a través de oráculos de primer orden. En Advances in Neural Information Processing Systems, páginas 3716–3726, 2018. URL http://papers.neurips.cc/paper/7629-neon2-finding-local-minima-via-first-order-oracles. pdf. arXiv:1711.06673.

arXiv: 1711.06673

http://papers.neurips.cc/paper/7629-neon2-finding-local-minima-via-first-order-oracles.pdf

[ 2 ] Animashree Anandkumar, Rong Ge, Daniel Hsu, Sham M Kakade y Matus Telgarsky. Descomposiciones tensoriales para el aprendizaje de modelos de variables latentes. Journal of machine learning research, 15: 2773–2832, 2014. URL https://jmlr.org/papers/volume15/anandkumar14b/. arXiv:1210.7559v4.

arXiv: 1210.7559v4

https://jmlr.org/papers/volume15/anandkumar14b/

[ 3 ] Ben Andrews y Julie Clutterbuck. Prueba de la conjetura de la brecha fundamental. Journal of the American Mathematical Society, 24 (3): 899–916, 2011. ISSN 08940347, 10886834. URL http://www.jstor.org/stable/23072145. arXiv:1006.1686.

arXiv: 1006.1686

http: / / www.jstor.org/ stable / 23072145

[ 4 ] Joran van Apeldoorn y András Gilyén. Mejoras en la resolución cuántica de SDP con aplicaciones. En Actas del 46º Coloquio Internacional sobre Autómatas, Lenguajes y Programación, volumen 132 de Leibniz International Proceedings in Informatics (LIPIcs), páginas 99:1–99:15. Schloss Dagstuhl–Leibniz-Zentrum fuer Informatik, 2019. 10.4230/LIPIcs.ICALP.2019.99. arXiv:1804.05058.

https: / / doi.org/ 10.4230 / LIPIcs.ICALP.2019.99

arXiv: 1804.05058

[ 5 ] Joran van Apeldoorn, András Gilyén, Sander Gribling y Ronald de Wolf. Solucionadores de Quantum SDP: mejores límites superior e inferior. En Actas del 58º Simposio Anual sobre Fundamentos de Ciencias de la Computación. IEEE, 2017. 10.1109/FOCS.2017.44. arXiv:1705.01843.

https: / / doi.org/ 10.1109 / FOCS.2017.44

arXiv: 1705.01843

[ 6 ] Joran van Apeldoorn, András Gilyén, Sander Gribling y Ronald de Wolf. Optimización convexa utilizando oráculos cuánticos. Cuántica, 4: 220, 2020. 10.22331/q-2020-01-13-220. arXiv:1809.00643.

https://doi.org/10.22331/q-2020-01-13-220

arXiv: 1809.00643

[ 7 ] Frank Arute, Kunal Arya, Ryan Babbush, Dave Bacon, Joseph C. Bardin, Rami Barends, Sergio Boixo, Michael Broughton, Bob B. Buckley, David A. Buell, Brian Burkett, Nicholas Bushnell, Yu Chen, Zijun Chen, Benjamin Chiaro , Roberto Collins, William Courtney, Sean Demura, Andrew Dunsworth, Edward Farhi, Austin Fowler, Brooks Foxen, Craig Gidney, Marissa Giustina, Rob Graff, Steve Habegger, Matthew P. Harrigan, Alan Ho, Sabrina Hong, Trent Huang, William J Huggins, Lev Ioffe, Sergei V. Isakov, Evan Jeffrey, Zhang Jiang, Cody Jones, Dvir Kafri, Kostyantyn Kechedzhi, Julian Kelly, Seon Kim, Paul V. Klimov, Alexander Korotkov, Fedor Kostritsa, David Landhuis, Pavel Laptev, Mike Lindmark, Erik Lucero, Orion Martin, John M. Martinis, Jarrod R. McClean, Matt McEwen, Anthony Megrant, Xiao Mi, Masoud Mohseni, Wojciech Mruczkiewicz, Josh Mutus, Ofer Naaman, Matthew Neeley, Charles Neill, Hartmut Neven, Murphy Yuezhen Niu, Thomas E. O'Brien, Eric Ostby, Andre Petukhov, Harald Putterman, Chris Quintana, Pedram Roushan, Nicholas C. Rubin, Daniel Sank, Kevin J. Satzinger, Vadim Smelyanskiy, Doug Strain, Kevin J. Sung, Marco Szalay , Tyler Y. Takeshita, Amit Vainsencher, Theodore White, Nathan Wiebe, Z. Jamie Yao, Ping Yeh y Adam Zalcman. Hartree-Fock en una computadora cuántica qubit superconductora. Ciencia, 369 (6507): 1084–1089, 2020. 10.1126/ciencia.abb9811. URL https://science.sciencemag.org/content/369/6507/1084.abstract. arXiv:2004.04174.

https: / / doi.org/ 10.1126 / science.abb9811

arXiv: 2004.04174

https://science.sciencemag.org/content/369/6507/1084.abstract

[ 8 ] Yosi Atia y Shantanav Chakraborty. Límites superiores mejorados para los tiempos de impacto de las caminatas cuánticas. Revisión física A, 104: 032215, septiembre de 2021. ISSN 2469-9934. 10.1103/physreva.104.032215. URL http://dx.doi.org/10.1103/PhysRevA.104.032215. arXiv:2005.04062v5.

https: / / doi.org/ 10.1103 / physreva.104.032215

arXiv: 2005.04062v5

[ 9 ] Carlo Baldassi y Riccardo Zecchina. Eficiencia del recocido cuántico frente al clásico en problemas de aprendizaje no convexos. Actas de la Academia Nacional de Ciencias, 115 (7): 1457–1462, enero de 2018. ISSN 1091-6490. 10.1073/pnas.1711456115. URL http://dx.doi.org/10.1073/pnas.1711456115. arXiv:1706.08470.

https: / / doi.org/ 10.1073 / pnas.1711456115

arXiv: 1706.08470

[ 10 ] Charles H. Bennett, Ethan Bernstein, Gilles Brassard y Umesh Vazirani. Fortalezas y debilidades de la computación cuántica. SIAM Journal on Computing, 26 (5): 1510–1523, 1997. 10.1137/S0097539796300933. URL https://doi.org/10.1137/S0097539796300933. arXiv:quant-ph/9701001.

https: / / doi.org/ 10.1137 / S0097539796300933

arXiv: quant-ph / 9701001

[ 11 ] Michael Betancourt, Michael I. Jordan y Ashia C Wilson. Sobre optimización simpléctica, 2018. arXiv:1802.03653.

arXiv: 1802.03653

[ 12 ] Sergio Boixo y Rolando D. Somma. Condición necesaria para la aproximación adiabática cuántica. Revisión física A, 81 (3): 032308, 2010. 10.1103/PhysRevA.81.032308. URL https://journals.aps.org/pra/abstract/10.1103/PhysRevA.81.032308. arXiv:0911.1362.

https: / / doi.org/ 10.1103 / PhysRevA.81.032308

arXiv: 0911.1362

[ 13 ] Fernando GSL Brandão y Krysta Svore. Aceleradores cuánticos para programación semidefinida. En Actas del 58º Simposio Anual sobre Fundamentos de Ciencias de la Computación, páginas 415–426, 2017. 10.1109/FOCS.2017.45. arXiv:1609.05537.

https: / / doi.org/ 10.1109 / FOCS.2017.45

arXiv: 1609.05537

[ 14 ] Fernando GSL Brandão, Amir Kalev, Tongyang Li, Cedric Yen-Yu Lin, Krysta M. Svore y Xiaodi Wu. Solucionadores Quantum SDP: grandes aceleraciones, optimización y aplicaciones para el aprendizaje cuántico. En Actas del 46º Coloquio Internacional sobre Autómatas, Lenguajes y Programación, volumen 132 de Leibniz International Proceedings in Informatics (LIPIcs), páginas 27:1–27:14. Schloss Dagstuhl–Leibniz-Zentrum fuer Informatik, 2019. 10.4230/LIPIcs.ICALP.2019.27. arXiv:1710.02581.

https: / / doi.org/ 10.4230 / LIPIcs.ICALP.2019.27

arXiv: 1710.02581

[ 15 ] Shouvanik Chakrabarti, Andrew M. Childs, Tongyang Li y Xiaodi Wu. Algoritmos cuánticos y límites inferiores para la optimización convexa. Cuántica, 4: 221, 2020. 10.22331/q-2020-01-13-221. arXiv:1809.01731.

https://doi.org/10.22331/q-2020-01-13-221

arXiv: 1809.01731

[ 16 ] Shantanav Chakraborty, Kyle Luh y Jérémie Roland. ¿Qué tan rápido se mezclan los paseos cuánticos? Physical Review Letters, 124: 050501, febrero de 2020. 10.1103/PhysRevLett.124.050501. URL https://link.aps.org/doi/10.1103/PhysRevLett.124.050501. arXiv:2001.06305v1.

https: / / doi.org/ 10.1103 / PhysRevLett.124.050501

arXiv: 2001.06305v1

[ 17 ] Pratik Chaudhari y Stefano Soatto. El descenso de gradiente estocástico realiza inferencia variacional, converge para limitar ciclos para redes profundas. En el Taller de aplicaciones y teoría de la información (ITA) de 2018, páginas 1–10, 2018. 10.1109/ITA.2018.8503224. arXiv:1710.11029v2.

https: / / doi.org/ 10.1109 / ITA.2018.8503224

arXiv: 1710.11029v2

[ 18 ] Andrew M. Childs, Richard Cleve, Enrico Deotto, Edward Farhi, Sam Gutmann y Daniel A. Spielman. Aceleración algorítmica exponencial por un paseo cuántico. En las Actas del Trigésimo Quinto Simposio Anual de ACM sobre Teoría de la Computación, STOC '03, página 59–68, Nueva York, NY, EE. UU., 2003. Asociación de Maquinaria de Computación. ISBN 1581136749. 10.1145/780542.780552. URL https://doi.org/10.1145/780542.780552. arXiv:quant-ph/0209131v2.

https: / / doi.org/ 10.1145 / 780542.780552

arXiv: quant-ph / 0209131v2

[ 19 ] Andrew M. Childs, Jin-Peng Liu y Aaron Ostrander. Algoritmos cuánticos de alta precisión para ecuaciones diferenciales parciales. Quantum, 5: 574, noviembre de 2021. ISSN 2521-327X. 10.22331/q-2021-11-10-574. URL http://dx.doi.org/10.22331/q-2021-11-10-574. arXiv:2002.07868.

https://doi.org/10.22331/q-2021-11-10-574

arXiv: 2002.07868

[ 20 ] Pierre Comon, Xavier Luciani y André LF De Almeida. Descomposiciones tensoriales, mínimos cuadrados alternos y otros cuentos. Journal of Chemometrics, 23: 393–405, agosto de 2009. 10.1002/cem.1236. URL https://hal.archives-ouvertes.fr/hal-00410057.

https:///doi.org/10.1002/cem.1236

https: / / hal.archives-ouvertes.fr/ hal-00410057

[ 21 ] Pedro CS Costa, Stephen Jordan y Aaron Ostrander. Algoritmo cuántico para la simulación de la ecuación de onda. Revisión física A, 99: 012323, enero de 2019. 10.1103/PhysRevA.99.012323. URL https://link.aps.org/doi/10.1103/PhysRevA.99.012323. arXiv:1711.05394.

https: / / doi.org/ 10.1103 / PhysRevA.99.012323

arXiv: 1711.05394

[ 22 ] Christopher Criscitiello y Nicolás Boumal. La curvatura negativa obstruye la aceleración para la optimización geodésicamente convexa, incluso con oráculos exactos de primer orden, 2021. arXiv:2111.13263.

arXiv: 2111.13263

[ 23 ] Elizabeth Crosson y Aram W. Harrow. El recocido cuántico simulado puede ser exponencialmente más rápido que el recocido simulado clásico. En 2016 IEEE 57th Annual Symposium on Foundations of Computer Science (FOCS), páginas 714–723. IEEE, octubre de 2016. 10.1109/focs.2016.81. URL http://dx.doi.org/10.1109/FOCS.2016.81. arXiv:1601.03030.

https: / / doi.org/ 10.1109 / focs.2016.81

arXiv: 1601.03030

[ 24 ] Mouez Dimassi y Johannes Sjöstrand. Asintóticas Espectrales en el Límite Semiclásico. Serie de notas de conferencias de la London Mathematical Society. Prensa de la Universidad de Cambridge, 1999. 10.1017/CBO9780511662195.

https: / / doi.org/ 10.1017 / CBO9780511662195

[ 25 ] Felix Draxler, Kambis Veschgini, Manfred Salmhofer y Fred Hamprecht. Esencialmente, no hay barreras en el panorama energético de la red neuronal. En Conferencia internacional sobre aprendizaje automático, páginas 1309–1318. PMLR, 2018. URL http://proceedings.mlr.press/v80/draxler18a.html. arXiv:1803.00885.

arXiv: 1803.00885

http:///proceedings.mlr.press/v80/draxler18a.html

[ 26 ] Runyao Duan. Revisión del teorema cuántico adiabático, 2020. arXiv:2003.03063v1.

arXiv: 2003.03063v1

[ 27 ] John Duchi, Elad Hazan y Yoram Singer. Métodos adaptativos de subgradiente para aprendizaje en línea y optimización estocástica. Journal of Machine Learning Research, 12 (61): 2121–2159, 2011. URL https://www.jmlr.org/papers/volume12/duchi11a/duchi11a.pdf.

https://www.jmlr.org/papers/volume12/duchi11a/duchi11a.pdf

[ 28 ] Sepehr Ebadi, Tout T. Wang, Harry Levine, Alexander Keesling, Giulia Semeghini, Ahmed Omran, Dolev Bluvstein, Rhine Samajdar, Hannes Pichler, Wen Wei Ho, Soonwon Choi, Subir Sachdev, Markus Greiner, Vladan Vuletić y Mikhail D. Lukin . Fases cuánticas de la materia en un simulador cuántico programable de 256 átomos. Nature, 595 (7866): 227–232, 2021. 10.1038/s41586-021-03582-4. URL https://www.nature.com/articles/s41586-021-03582-4.

https://doi.org/10.1038/s41586-021-03582-4

https: / / www.nature.com/ articles / s41586-021-03582-4

[ 29 ] Cong Fang, Chris Junchi Li, Zhouchen Lin y Tong Zhang. Araña: optimización no convexa casi óptima a través de un estimador diferencial integrado en la ruta estocástica. En Advances in Neural Information Processing Systems, páginas 689–699, 2018. URL https://dl.acm.org/doi/abs/10.5555/3326943.3327007. arXiv:1807.01695.

arXiv: 1807.01695

https: / / dl.acm.org/ doi / abs / 10.5555 / 3326943.3327007

[ 30 ] Cong Fang, Zhouchen Lin y Tong Zhang. Análisis agudo para SGD no convexo que se escapa de los puntos de silla. En Conference on Learning Theory, páginas 1192–1234, 2019. URL http://proceedings.mlr.press/v99/fang19a.html. arXiv:1902.00247.

arXiv: 1902.00247

http:///proceedings.mlr.press/v99/fang19a.html

[ 31 ] Edward Farhi, Jeffrey Goldstone, Sam Gutmann, Joshua Lapan, Andrew Lundgren y Daniel Preda. Un algoritmo de evolución adiabática cuántica aplicado a instancias aleatorias de un problema NP-completo. Science, 292 (5516): 472–475, abril de 2001. ISSN 1095-9203. 10.1126/ciencia.1057726. URL http://dx.doi.org/10.1126/science.1057726. arXiv:quant-ph/0104129.

https: / / doi.org/ 10.1126 / science.1057726

arXiv: quant-ph / 0104129

[ 32 ] AB Finnila, MA Gómez, C. Sebenik, C. Stenson y JD Doll. Recocido cuántico: un nuevo método para minimizar funciones multidimensionales. Chemical Physics Letters, 219 (5-6): 343–348, marzo de 1994. ISSN 0009-2614. 10.1016/0009-2614(94)00117-0. URL http://dx.doi.org/10.1016/0009-2614(94)00117-0. arXiv:chem-ph/9404003.

https://doi.org/10.1016/0009-2614(94)00117-0

arXiv:chem-ph/9404003

[ 33 ] Mauger François. Esquema Symplectic Leap Frog, 2020. URL https://www.mathworks.com/matlabcentral/fileexchange/38652-symplectic-leap-frog-scheme. https: //www.mathworks.com /matlabcentral /fileexchange /38652-symplectic-leap-frog-scheme.

https: / / www.mathworks.com/ matlabcentral / fileexchange / 38652-symplectic-leap-frog-esquema

[ 34 ] Alan Frieze, Mark Jerrum y Ravi Kannan. Aprendizaje de transformaciones lineales. En Proceedings of 37th Conference on Foundations of Computer Science, páginas 359–368, 1996. 10.1109/SFCS.1996.548495.

https: / / doi.org/ 10.1109 / SFCS.1996.548495

[ 35 ] Timur Garipov, Pavel Izmailov, Dmitrii Podoprikhin, Dmitry Vetrov y Andrew Gordon Wilson. Superficies de pérdida, conectividad de modo y ensamblaje rápido de DNN. En Advances in Neural Information Processing Systems, páginas 8803–8812, 2018. URL https://dl.acm.org/doi/abs/10.5555/3327546.3327556. arXiv:1802.10026.

arXiv: 1802.10026

https: / / dl.acm.org/ doi / abs / 10.5555 / 3327546.3327556

[ 36 ] Rong Ge y Tengyu Ma. Sobre el panorama de optimización de las descomposiciones tensoriales. Programación matemática, páginas 1 a 47, 2020. ISSN 1436-4646. 10.1007/s10107-020-01579-x. URL https://doi.org/10.1007/s10107-020-01579-x. arXiv:1706.05598v1.

https: / / doi.org/ 10.1007 / s10107-020-01579-x

arXiv: 1706.05598v1

[ 37 ] Rong Ge, Furong Huang, Chi Jin y Yang Yuan. Escapar de los puntos de silla: gradiente estocástico en línea para la descomposición de tensores. En Proceedings of the 28th Conference on Learning Theory, volumen 40 de Proceedings of Machine Learning Research, páginas 797–842, 2015. URL http://proceedings.mlr.press/v40/Ge15. arXiv:1503.02101.

arXiv: 1503.02101

http:///proceedings.mlr.press/v40/Ge15

[ 38 ] Rong Ge, Jason D. Lee y Tengyu Ma. La finalización de la matriz no tiene un mínimo local espurio. En Advances in Neural Information Processing Systems, páginas 2981–2989, 2016. URL https://dl.acm.org/doi/abs/10.5555/3157382.3157431. arXiv:1605.07272.

arXiv: 1605.07272

https: / / dl.acm.org/ doi / abs / 10.5555 / 3157382.3157431

[ 39 ] Ming Gong, Shiyu Wang, Chen Zha, Ming-Cheng Chen, He-Liang Huang, Yulin Wu, Qingling Zhu, Youwei Zhao, Shaowei Li, Shaojun Guo, Haoran Qian, Yangsen Ye, Fusheng Chen, Chong Ying, Jiale Yu, Daojin Fan, Dachao Wu, Hong Su, Hui Deng, Hao Rong, Kaili Zhang, Sirui Cao, Jin Lin, Yu Xu, Lihua Sun, Cheng Guo, Na Li, Futian Liang, VM Bastidas, Kae Nemoto, WJ Munro, Yong-Heng Huo, Chao-Yang Lu, Cheng-Zhi Peng, Xiaobo Zhu y Jian-Wei Pan. Quantum camina sobre un procesador superconductor bidimensional programable de 62 qubits. Ciencia, 372 (6545): 948–952, 2021. 10.1126/ciencia.abg7812. URL https://science.sciencemag.org/content/372/6545/948.abstract. arXiv:2102.02573.

https: / / doi.org/ 10.1126 / science.abg7812

arXiv: 2102.02573

https://science.sciencemag.org/content/372/6545/948.abstract

[ 40 ] Stephen K. Gray y David E. Manolopoulos. Integradores simplécticos adaptados a la ecuación de Schrödinger dependiente del tiempo. The Journal of Chemical Physics, 104 (18): 7099–7112, 1996. 10.1063/1.471428. URL https://doi.org/10.1063/1.471428.

https: / / doi.org/ 10.1063 / 1.471428

[ 41 ] Bernard Heffer. Análisis Semi-Clásico para el Operador de Schrödinger y Aplicaciones. Apuntes de clase en Matemáticas. Springer, 1988. 10.1007/BFb0078115.

https: / � € ‹/ � €‹ doi.org/� $$$ ‹10.1007 / � €‹ BFb0078115

[ 42 ] Bernard Helffer y Johannes Sjöstrand. Múltiples pozos en el límite semiclásico I. Communications in Partial Differential Equations, 9 (4): 337–408, 1984. 10.1080/03605308408820335.

https: / / doi.org/ 10.1080 / 03605308408820335

[ 43 ] Bernard Helffer y Johannes Sjöstrand. Múltiples pozos en el límite semiclásico III – interacción a través de pozos no resonantes. Mathematische Nachrichten, 124 (1): 263–313, 1985. https://doi.org/10.1002/mana.19851240117. URL https://onlinelibrary.wiley.com/doi/abs/10.1002/mana.19851240117.

https: / / doi.org/ 10.1002 / mana.19851240117

[ 44 ] Sepp Hochreiter. El problema del gradiente de fuga durante el aprendizaje de redes neuronales recurrentes y soluciones de problemas. Revista internacional de incertidumbre, borrosidad y sistemas basados en el conocimiento, 6 (02): 107–116, 1998. 10.1142/S0218488598000094. URL https://dl.acm.org/doi/abs/10.1142/S0218488598000094.

https: / / doi.org/ 10.1142 / S0218488598000094

[ 45 ] Aapo Hyvarinen. ICA rápido para datos ruidosos usando momentos gaussianos. En 1999 Simposio internacional IEEE sobre circuitos y sistemas (ISCAS), volumen 5, páginas 57–61, 1999. 10.1109/ISCAS.1999.777510.

https:///doi.org/10.1109/ISCAS.1999.777510

[ 46 ] Frédéric Hérau, Michael Hitrik y Johannes Sjöstrand. Efecto túnel y simetrías para operadores de tipo kramers-fokker-planck. Revista del Instituto de Matemáticas de Jussieu, 10 (3): 567–634, 2011. 10.1017/S1474748011000028.

https: / / doi.org/ 10.1017 / S1474748011000028

[ 47 ] Chi Jin, Rong Ge, Praneeth Netrapalli, Sham M. Kakade y Michael I. Jordan. Cómo escapar de los puntos de silla de manera eficiente. En Actas de la 34.ª Conferencia internacional sobre aprendizaje automático, volumen 70, páginas 1724–1732, 2017. URL http://proceedings.mlr.press/v70/jin17a. arXiv:1703.00887.

arXiv: 1703.00887

http:///proceedings.mlr.press/v70/jin17a

[ 48 ] Chi Jin, Lydia T. Liu, Rong Ge y Michael I. Jordan. Sobre los mínimos locales del riesgo empírico. En Advances in Neural Information Processing Systems, volumen 31, página 4901–4910. Curran Associates, Inc., 2018. URL https://proceedings.neurips.cc/paper/2018/file/da4902cb0bc38210839714ebdcf0efc3-Paper.pdf. arXiv:1803.09357.

arXiv: 1803.09357

https://proceedings.neurips.cc/paper/2018/file/da4902cb0bc38210839714ebdcf0efc3-Paper.pdf

[ 49 ] Chi Jin, Praneeth Netrapalli, Rong Ge, Sham M Kakade y Michael I. Jordan. Sobre la optimización no convexa para el aprendizaje automático: gradientes, estocasticidad y puntos de silla. Diario de la ACM (JACM), 68 (2): 1–29, 2021. 10.1145/3418526. URL https://dl.acm.org/doi/abs/10.1145/3418526. arXiv:1902.04811.

https: / / doi.org/ 10.1145 / 3418526

arXiv: 1902.04811

[ 50 ] Michael I. Jordán. Perspectivas dinámicas, simplécticas y estocásticas sobre la optimización basada en gradientes. En Actas del Congreso Internacional de Matemáticos: Río de Janeiro 2018, páginas 523–549. World Scientific, 2018. URL https://doi.org/10.1142/9789813272880_0022.

https: / / doi.org/ 10.1142 / 9789813272880_0022

[ 51 ] Kenji Kawaguchi, Jiaoyang Huang y Leslie Pack Kaelbling. Cada valor mínimo local es el valor mínimo global del modelo inducido en el aprendizaje automático no convexo. Computación neuronal, 31 (12): 2293–2323, 12 2019. ISSN 0899-7667. 10.1162/neco_a_01234. URL https://doi.org/10.1162/neco_a_01234. arXiv:1904.03673v3.

https:///doi.org/10.1162/neco_a_01234

arXiv: 1904.03673v3

[ 52 ] Diederik P. Kingma y Jimmy Ba. Adam: Un método para la optimización estocástica. En 3ra Conferencia Internacional para Representaciones de Aprendizaje, 2015. URL https://openreview.net/forum?id=8gmWwjFyLj. arXiv:1412.6980.

arXiv: 1412.6980

https:///openreview.net/forum?id=8gmWwjFyLj

[ 53 ] Alexei Kitaev y William A. Webb. Preparación y remuestreo de funciones de onda usando una computadora cuántica, 2008. arXiv:0801.0342.

arXiv: 0801.0342

[ 54 ] Bobby Kleinberg, Yuanzhi Li y Yang Yuan. Una visión alternativa: ¿Cuándo SGD escapa de los mínimos locales? En Conferencia internacional sobre aprendizaje automático, páginas 2698–2707. PMLR, 2018. URL http://proceedings.mlr.press/v80/kleinberg18a.html. arXiv:1802.06175.

arXiv: 1802.06175

http:///proceedings.mlr.press/v80/kleinberg18a.html

[ 55 ] Guy Kornowski y Ohad Shamir. Complejidad de Oracle en la optimización no convexa no suave. En Avances en sistemas de procesamiento de información neuronal, 2021. URL https://openreview.net/forum?id=aMZJBOiOOPg. arXiv:2104.06763v2.

arXiv: 2104.06763v2

https:///openreview.net/forum?id=aMZJBOiOOPg

[ 56 ] Rohith Kuditipudi, Xiang Wang, Holden Lee, Yi Zhang, Zhiyuan Li, Wei Hu, Rong Ge y Sanjeev Arora. Explicación de la conectividad del paisaje de soluciones de bajo costo para redes multicapa. Advances in Neural Information Processing Systems, 32: 14601–14610, 2019. URL http://papers.nips.cc/paper/9602-explaining-landscape-connectivity-of-low-cost-solutions-for- redes multicapa. arXiv:1906.06247.

arXiv: 1906.06247

http:///papers.nips.cc/paper/9602-explaining-landscape-connectivity-of-low-cost-solutions-for-multilayer-nets

[ 57 ] Harold J. Kushner y G. George Yin. Aproximación estocástica y algoritmos recursivos y aplicaciones, volumen 35. Springer Science & Business Media, 2003. 10.1007/978-1-4471-4285-0_3.

https://doi.org/10.1007/978-1-4471-4285-0_3

[ 58 ] Keren Li, Shijie Wei, Pan Gao, Feihao Zhang, Zengrong Zhou, Tao Xin, Xiaoting Wang, Patrick Rebentrost y Guilu Long. Optimización de una función polinomial en un procesador cuántico. npj Quantum Information, 7 (1): 1–7, 2021a. 10.1038/s41534-020-00351-5. arXiv:1804.05231.

https://doi.org/10.1038/s41534-020-00351-5

arXiv: 1804.05231

[ 59 ] Zhiyuan Li, Sadhika Malladi y Sanjeev Arora. Sobre la validez de modelar SGD con ecuaciones diferenciales estocásticas (EDS). En Avances en sistemas de procesamiento de información neuronal, 2021b. URL https://openreview.net/forum?id=goEdyJ_nVQI. arXiv:2102.12470.

arXiv: 2102.12470

https:///openreview.net/forum?id=goEdyJ_nVQI

[ 60 ] Guang Hao Low y Nathan Wiebe. Simulación hamiltoniana en la imagen de interacción, 2019. URL https://arxiv.org/abs/1805.00675v2. arXiv:1805.00675v2.

arXiv: 1805.00675v2

[ 61 ] Cong Ma, Kaizheng Wang, Yuejie Chi y Yuxin Chen. Regularización implícita en la estimación estadística no convexa: el descenso del gradiente converge linealmente para la recuperación de fase y la finalización de la matriz. En Conferencia internacional sobre aprendizaje automático, páginas 3345–3354. PMLR, 2018. URL http://proceedings.mlr.press/v80/ma18c.html. arXiv:1711.10467.

arXiv: 1711.10467

http:///proceedings.mlr.press/v80/ma18c.html

[ 62 ] Tengyu Ma. ¿Por qué los métodos locales resuelven problemas no convexos?, página 465–485. Prensa de la Universidad de Cambridge, 2021. 10.1017/9781108637435.027. arXiv:2103.13462.

https: / / doi.org/ 10.1017 / 9781108637435.027

arXiv: 2103.13462

[ 63 ] Yi-An Ma, Yuansi Chen, Chi Jin, Nicolas Flammarion y Michael I. Jordan. El muestreo puede ser más rápido que la optimización. Procedimientos de la Academia Nacional de Ciencias, 116 (42): 20881–20885, 2019. URL https://www.pnas.org/content/116/42/20881.short. arXiv:.

https: / / doi.org/ 10.1073 / pnas.1820003116

https://www.pnas.org/content/116/42/20881.short

[ 64 ] Peter A. Markowich y Cédric Villani. Sobre la tendencia al equilibrio de la ecuación de Fokker-Planck: una interacción entre la física y el análisis funcional. En Física y Análisis Funcional, Matemática Contemporánea (SBM) 19. Citeseer, 1999. URL http://citeseerx.ist.psu.edu/viewdoc/summary?doi=10.1.1.35.2278.

http:///citeseerx.ist.psu.edu/viewdoc/summary?doi=10.1.1.35.2278

[ 65 ] Laurent Michel. Sobre los pequeños valores propios del laplaciano de Witten. Análisis Puro y Aplicado, 1 (2): 149 – 206, 2019. 10.2140/paa.2019.1.149. URL https://doi.org/10.2140/paa.2019.1.149. arXiv:1702.01837.

https:///doi.org/10.2140/paa.2019.1.149

arXiv: 1702.01837

[ 66 ] Siddharth Muthukrishnan, Tameem Albash y Daniel A. Lidar. Tunelización y aceleración en la optimización cuántica para problemas de permutación simétrica. Revisión física X, 6: 031010, julio de 2016. ISSN 2160-3308. 10.1103/physrevx.6.031010. URL http://dx.doi.org/10.1103/PhysRevX.6.031010. arXiv:1511.03910.

https: / / doi.org/ 10.1103 / physrevx.6.031010

arXiv: 1511.03910

[ 67 ] Quynh Nguyen. En conjuntos de subniveles conectados en aprendizaje profundo. En Conferencia internacional sobre aprendizaje automático, páginas 4790–4799. PMLR, 2019. URL http://proceedings.mlr.press/v97/nguyen19a.html. arXiv:1901.07417.

arXiv: 1901.07417

http:///proceedings.mlr.press/v97/nguyen19a.html

[ 68 ] Michael A. Nielsen e Isaac L. Chuang. Computación cuántica e información cuántica: Edición del décimo aniversario. Cambridge University Press, 10. 2010 / CBO10.1017.

https: / / doi.org/ 10.1017 / CBO9780511976667

[ 69 ] Grigorios A. Pavliotis. Procesos estocásticos y aplicaciones: procesos de difusión, las ecuaciones de Fokker-Planck y Langevin, volumen 60. Springer, 2014. 10.1007/978-1-4939-1323-7.

https://doi.org/10.1007/978-1-4939-1323-7

[ 70 ] Qing Qu, Yuexiang Zhai, Xiao Li, Yuqian Zhang y Zhihui Zhu. Análisis de los paisajes de optimización para el aprendizaje de representación sobrecompleto, 2019. arXiv:1912.02427.

arXiv: 1912.02427

[ 71 ] Gianluca Rastelli. Fórmula semiclásica para la tunelización cuántica en potenciales asimétricos de doble pozo. Revisión física A, 86: 012106, julio de 2012. 10.1103/PhysRevA.86.012106. URL https://link.aps.org/doi/10.1103/PhysRevA.86.012106. arXiv:1205.0366.

https: / / doi.org/ 10.1103 / PhysRevA.86.012106

arXiv: 1205.0366

[ 72 ] Arthur G. Rattew, Yue Sun, Pierre Minssen y Marco Pistoia. La preparación eficiente de distribuciones normales en registros cuánticos. Cuántica, 5: 609, 2021. 10.22331/q-2021-12-23-609. URL https://quantum-journal.org/papers/q-2021-12-23-609/. arXiv:2009.06601.

https://doi.org/10.22331/q-2021-12-23-609

arXiv: 2009.06601

https: / / quantum-journal.org/ papers / q-2021-12-23-609 /

[ 73 ] Patrick Rebentrost, Maria Schuld, Leonard Wossnig, Francesco Petruccione y Seth Lloyd. Descenso de gradiente cuántico y método de Newton para la optimización de polinomios restringidos. New Journal of Physics, 21 (7): 073023, 2019. 10.1088/1367-2630/ab2a9e. arXiv:1612.01789.

https://doi.org/10.1088/1367-2630/ab2a9e

arXiv: 1612.01789

[ 74 ] Burak Şahinoğlu y Rolando D. Somma. Simulación hamiltoniana en el subespacio de baja energía. npj Quantum Information, 7 (1): 1–5, 2021. 10.1038/s41534-021-00451-w. URL https://www.nature.com/articles/s41534-021-00451-w. arXiv:2006.02660.

https: / / doi.org/ 10.1038 / s41534-021-00451-w

arXiv: 2006.02660

https:///www.nature.com/articles/s41534-021-00451-w

[ 75 ] JM Schmidt, AN Cleland y John Clarke. Tunelización resonante en pequeñas uniones Josephson polarizadas por corriente. Physical Review B, 43: 229–238, enero de 1991. 10.1103/PhysRevB.43.229. URL https://link.aps.org/doi/10.1103/PhysRevB.43.229.

https: / / doi.org/ 10.1103 / PhysRevB.43.229

[ 76 ] Alexander Shevchenko y Marco Mondelli. Conectividad de paisaje y estabilidad de abandono de soluciones SGD para redes neuronales sobreparametrizadas. En Conferencia internacional sobre aprendizaje automático, páginas 8773–8784. PMLR, 2020. URL http://proceedings.mlr.press/v119/shevchenko20a.html. arXiv:1912.10095.

arXiv: 1912.10095

http:///proceedings.mlr.press/v119/shevchenko20a.html

[ 77 ] Bin Shi, Weijie J. Su y Michael I. Jordan. Sobre tasas de aprendizaje y operadores de Schrödinger, 2020. arXiv:2004.06977.

arXiv: 2004.06977

[ 78 ] Bin Shi, Simon S. Du, Michael I. Jordan y Weijie J. Su. Entender el fenómeno de la aceleración mediante ecuaciones diferenciales de alta resolución. Programación matemática, páginas 1–70, 2021. 10.1007/s10107-021-01681-8. URL https://doi.org/10.1007/s10107-021-01681-8. arXiv:1810.08907.

https://doi.org/10.1007/s10107-021-01681-8

arXiv: 1810.08907

[ 79 ] Weijie Su, Stephen Boyd y Emmanuel J. Candes. Una ecuación diferencial para modelar el método de gradiente acelerado de Nesterov: teoría e ideas. The Journal of Machine Learning Research, 17 (1): 5312–5354, 2016. 10.5555/2946645.3053435. URL https://dl.acm.org/doi/abs/10.5555/2946645.3053435. arXiv:1503.01243.

https: / / doi.org/ 10.5555 / 2946645.3053435

arXiv: 1503.01243

[ 80 ] Sol Ruoyu. Optimización para el aprendizaje profundo: teoría y algoritmos, 2019. arXiv:1912.08957.

arXiv: 1912.08957

[ 81 ] Kunal Talwar. Separaciones computacionales entre muestreo y optimización. Advances in Neural Information Processing Systems, 32: 15023–15033, 2019. URL http://papers.nips.cc/paper/9639-computational-separations- between-sampling-and-optimization. arXiv:1911.02074.

arXiv: 1911.02074

http://papers.nips.cc/paper/9639-computational-separations- between-sampling-and-optimization

[ 82 ] Hao Tang, Xiao-Feng Lin, Zhen Feng, Jing-Yuan Chen, Jun Gao, Ke Sun, Chao-Yue Wang, Peng-Cheng Lai, Xiao-Yun Xu, Yao Wang, Lu-Feng Qiao, Ai-Lin Yang, y Xian-Min Jin. Paseo cuántico bidimensional experimental en un chip fotónico. Avances científicos, 4 (5): eaat3174, 2018. 10.1126/sciadv.aat3174. URL https://www.science.org/doi/10.1126/sciadv.aat3174. arXiv:1704.08242.

https: / / doi.org/ 10.1126 / sciadv.aat3174

arXiv: 1704.08242

[ 83 ] Cédric Villani. Hipocoercitividad, volumen 202 de Memoirs of the American Mathematical Society. Sociedad Matemática Estadounidense, 2009. 10.1090/S0065-9266-09-00567-5. arXiv:matemáticas/0609050.

https://doi.org/10.1090/S0065-9266-09-00567-5

arXiv: matemáticas / 0609050

[ 84 ] Andre Wibisono, Ashia C. Wilson y Michael I. Jordan. Una perspectiva variacional sobre métodos acelerados en optimización. Actas de la Academia Nacional de Ciencias, 113 (47): E7351–E7358, 2016. 10.1073/pnas.1614734113. URL https://doi.org/10.1073/pnas.1614734113. arXiv:1603.04245.

https: / / doi.org/ 10.1073 / pnas.1614734113

arXiv: 1603.04245

[ 85 ] Chenyi Zhang y Tongyang Li. Escape de los puntos de silla mediante un algoritmo simple basado en descenso de gradiente. En Advances in Neural Information Processing Systems, volumen 34, 2021. URL https://openreview.net/forum?id=lEf52hTHq0Q. arXiv:2111.14069.

arXiv: 2111.14069

https:///openreview.net/forum?id=lEf52hTHq0Q

[ 86 ] Chenyi Zhang, Jiaqi Leng y Tongyang Li. Algoritmos cuánticos para escapar de los puntos de silla. Cuántica, 5: 529, 2021a. 10.22331/q-2021-08-20-529. arXiv:2007.10253.

https://doi.org/10.22331/q-2021-08-20-529

arXiv: 2007.10253

[ 87 ] Kaining Zhang, Min-Hsiu Hsieh, Liu Liu y Dacheng Tao. Algoritmo cuántico para encontrar la dirección de curvatura negativa en optimización no convexa, 2019. arXiv:1909.07622.

arXiv: 1909.07622

[ 88 ] Yuqian Zhang, Qing Qu y John Wright. De la simetría a la geometría: problemas no convexos tratables, 2021b. arXiv:2007.06753.

arXiv: 2007.06753

Citado por

[1] Weiyuan Gong, Chenyi Zhang y Tongyang Li, "Robustez de los algoritmos cuánticos para la optimización no convexa", arXiv: 2212.02548, (2022).

Las citas anteriores son de ANUNCIOS SAO / NASA (última actualización exitosa 2023-06-02 12:31:17). La lista puede estar incompleta ya que no todos los editores proporcionan datos de citas adecuados y completos.

No se pudo recuperar Crossref citado por datos durante el último intento 2023-06-02 12:31:15: No se pudieron obtener los datos citados por 10.22331 / q-2023-06-02-1030 de Crossref. Esto es normal si el DOI se registró recientemente.

Este documento se publica en Quantum bajo el Creative Commons Reconocimiento 4.0 Internacional (CC BY 4.0) licencia. Los derechos de autor permanecen con los titulares de derechos de autor originales, como los autores o sus instituciones.

- Distribución de relaciones públicas y contenido potenciado por SEO. Consiga amplificado hoy.

- PlatoAiStream. Inteligencia de datos Web3. Conocimiento amplificado. Accede Aquí.

- Acuñando el futuro con Adryenn Ashley. Accede Aquí.

- Compra y Vende Acciones en Empresas PRE-IPO con PREIPO®. Accede Aquí.

- Fuente: https://quantum-journal.org/papers/q-2023-06-02-1030/

- :posee

- :es

- :no

- :dónde

- ][pag

- 1

- 10

- 1040

- 10

- 11

- 116

- 12

- 13

- 14

- 15%

- 17

- 1985

- 1994

- 1996

- 1998

- 1999

- 20

- 2001

- 2005

- 2006

- 2008

- 2011

- 2012

- 2014

- 2015

- 2016

- 2017

- 2018

- 2019

- 202

- 2020

- 2021

- 2022

- 22

- 220

- 23

- 24

- 26

- 27

- 28

- 28

- 30

- 31

- 39

- 3rd

- 40

- 49

- 50

- 60

- 66

- 67

- 7

- 70

- 72

- 77

- 8

- 80

- 84

- 87

- 9

- a

- Aaron

- Nuestra Empresa

- arriba

- RESUMEN

- Academia

- acelerado

- aceleración

- de la máquina

- Logra

- ACM

- Adam

- avances

- afiliaciones

- Alan

- Alexander

- algoritmo

- algorítmico

- algoritmos

- Todos

- alternativa

- American

- an

- análisis

- y

- Andrés

- Aniversario

- anual

- Antonio

- aplicaciones

- aplicada

- Aplicá

- aproximadamente

- abr

- somos

- Arturo

- AS

- Asociación

- AGOSTO

- Austin

- autor

- Autorzy

- las barreras

- basado

- BE

- Beijing

- bien

- Benjamin

- mejores

- entre

- BIN

- grano

- Bobby

- Descanso

- Brian

- pero

- by

- Cambridge

- PUEDEN

- no puede

- Chao Yang Lu

- Charles

- químico

- chen

- Cheng

- chip

- chong

- Chris

- Christopher

- Collins

- COM

- comentario

- Los comunes

- Comunicaciónes

- completar

- terminación

- complejidad

- cálculo

- computadora

- Ciencias de la Computación

- informática

- condición

- Congreso

- Congreso

- conjetura

- conectado

- Conectividad

- construir

- contenido

- Convexo

- derechos de autor,

- corroborar

- podría

- Craig

- de ciclos

- Daniel

- datos

- Ciencia de los datos

- David

- David

- profundo

- deep learning

- la

- una experiencia diferente

- Difusión

- dirección

- discutir

- distribuciones

- do

- sí

- durante

- e

- edición

- Edward

- efecto

- Eficaz

- eficiencia

- eficiente

- eficiente.

- integrado

- energía

- Ingeniería

- ecuaciones

- equilibrio

- escapar

- esencialmente

- Éter (ETH)

- Incluso

- Cada

- evolución

- experimentos

- explicando

- explorar

- exponencial

- exponencialmente

- ventilador

- RÁPIDO

- más rápida

- Feb

- Finalmente

- la búsqueda de

- Los resultados

- plano

- fórmula

- Fundamentos

- en

- Frontiers

- función

- funcional

- funciones

- fundamental

- GAO

- brecha

- ge

- geometría

- George

- Gilles

- dado

- Buscar

- Gómez

- gradientes

- gris

- Chico

- harold

- harvard

- Alta

- de alta resolución

- Golpear

- golpeando

- titulares

- Hong

- Cómo

- Como Hacer

- HTML

- http

- HTTPS

- huang

- i

- IEEE

- if

- mejorado

- mejoras

- in

- Inc.

- información

- inicial

- Insights

- Innovadora

- instituciones

- interacción

- interesante

- Internacional

- introducir

- IT

- Jamie

- Ene

- JavaScript

- Pan Jian-Wei

- Juan

- Jordania

- revista

- Kim

- Conocer

- conocido

- paisaje

- Idiomas

- large

- Apellido

- Saltar

- aprendizaje

- menos

- Abandonar

- Lectura

- Lee

- aprovechando

- li

- Licencia

- LIDAR

- LIMITE LAS

- lin

- Lista

- local

- Londres

- Largo

- de

- Baja

- de bajo costo

- máquina

- máquina de aprendizaje

- maquinaria

- Marco

- marca

- Martin

- matemático

- matemáticas

- Matrix

- Materia

- Mateo

- max-ancho

- Puede..

- Mcclean

- mecánica

- Medios

- Método

- métodos

- Michael

- micro

- minimizando

- mínimo

- Moda

- modelo

- modelado

- modelos

- Momentos

- Mes

- múltiples

- Nacional

- Naturaleza

- Cerca

- necesario

- negativas

- Nets

- del sistema,

- telecomunicaciones

- Neural

- red neural

- redes neuronales

- NeurIPS

- Nuevo

- New York

- Newton

- Nguyen

- Nicolas

- no

- normal

- Notas

- NY

- Oct

- of

- a menudo

- on

- ONE

- en línea

- Aprende digitalmente

- habiertos

- operador

- operadores

- optimización

- optimizando

- or

- oráculo

- Oráculos

- reconocida por

- Otro

- nuestros

- Más de

- .

- página

- PAN

- Papel

- Patricio

- Paul

- (PDF)

- Pekín

- realiza

- la perspectiva

- perspectivas

- Peter

- fase

- Fases de la materia

- un fenómeno mundial

- los libros físicos

- Física

- imagen

- Pierre

- de ping

- Platón

- Inteligencia de datos de Platón

- PlatónDatos

- puntos

- posible

- preparación

- prensa

- Problema

- problemas

- Proceso

- en costes

- tratamiento

- Procesador

- Programación

- prueba

- apropiado

- proporcionar

- publicado

- editor

- editores

- Cuántico

- algoritmos cuánticos

- Recocido cuántico

- Computadora cuántica

- computación cuántica

- información cuántica

- Qubit

- EXTRAÑO

- azar

- Tarifas

- recientemente

- recursiva

- referencias

- registrado

- registros

- permanece

- representación

- la investigación

- una estrategia SEO para aparecer en las búsquedas de Google.

- Dick

- rio de janeiro

- Riesgo

- robar

- robustez

- Roland

- Ryan

- s

- Diana

- esquema

- Ciencia:

- CIENCIAS

- partido socialdemócrata

- Sean

- SEON

- Serie

- Sets

- SGD

- agudo

- En Corto

- Mostrar

- siam

- Simon

- sencillos

- simulación

- simulador

- cantante

- chica

- Sociedades

- Soluciones

- RESOLVER

- Resolver

- soluciones y

- específicamente

- Espectral

- cuadrados

- Estabilidad

- Zonas

- estadístico

- statistics

- Stephen

- Steve

- fortalezas

- estudios

- Con éxito

- tal

- adecuado

- Dom

- simposio

- Todas las funciones a su disposición

- adaptado

- Target

- que

- esa

- El

- su

- teoría

- así

- A través de esta formación, el personal docente y administrativo de escuelas y universidades estará preparado para manejar los recursos disponibles que derivan de la diversidad cultural de sus estudiantes. Además, un mejor y mayor entendimiento sobre estas diferencias y similitudes culturales permitirá alcanzar los objetivos de inclusión previstos.

- veces

- Título

- a

- transformaciones

- Tendencia

- Tsinghua

- tipo

- Incertidumbre

- bajo

- comprensión

- universidad

- actualizado

- Enlance

- Estados Unidos de America

- usando

- propuesta de

- vía

- Ver

- volumen

- vs

- W

- quieres

- fue

- Trenzado

- we

- WELL

- Wells

- cuando

- complejo de salvador blanco

- porque

- Wilson

- Lobo

- taller

- mundo

- Wright

- wu

- X

- año

- YING

- york

- Youtube

- Yuan

- zephyrnet

- Zhao