Imagen del autor

Gemini es un nuevo modelo desarrollado por Google y Bard vuelve a ser utilizable. Con Gemini, ahora es posible obtener respuestas casi perfectas a sus consultas proporcionándoles imágenes, audio y texto.

En este tutorial, aprenderemos sobre la API de Gemini y cómo configurarla en su máquina. También exploraremos varias funciones de la API de Python, incluida la generación de texto y la comprensión de imágenes.

Gemini es un nuevo modelo de IA desarrollado mediante la colaboración entre equipos de Google, incluidos Google Research y Google DeepMind. Fue creado específicamente para ser multimodal, lo que significa que puede comprender y trabajar con diferentes tipos de datos como texto, código, audio, imágenes y video.

Gemini es el modelo de IA más grande y avanzado desarrollado por Google hasta la fecha. Ha sido diseñado para ser altamente flexible y poder operar de manera eficiente en una amplia gama de sistemas, desde centros de datos hasta dispositivos móviles. Esto significa que tiene el potencial de revolucionar la forma en que las empresas y los desarrolladores pueden crear y escalar aplicaciones de IA.

Aquí hay tres versiones del modelo Gemini diseñadas para diferentes casos de uso:

- Géminis Ultra: La IA más grande y avanzada capaz de realizar tareas complejas.

- Géminis profesional: Un modelo equilibrado que tiene buen rendimiento y escalabilidad.

- Géminis Nano: Más eficiente para dispositivos móviles.

Imagen de Presentando a Géminis

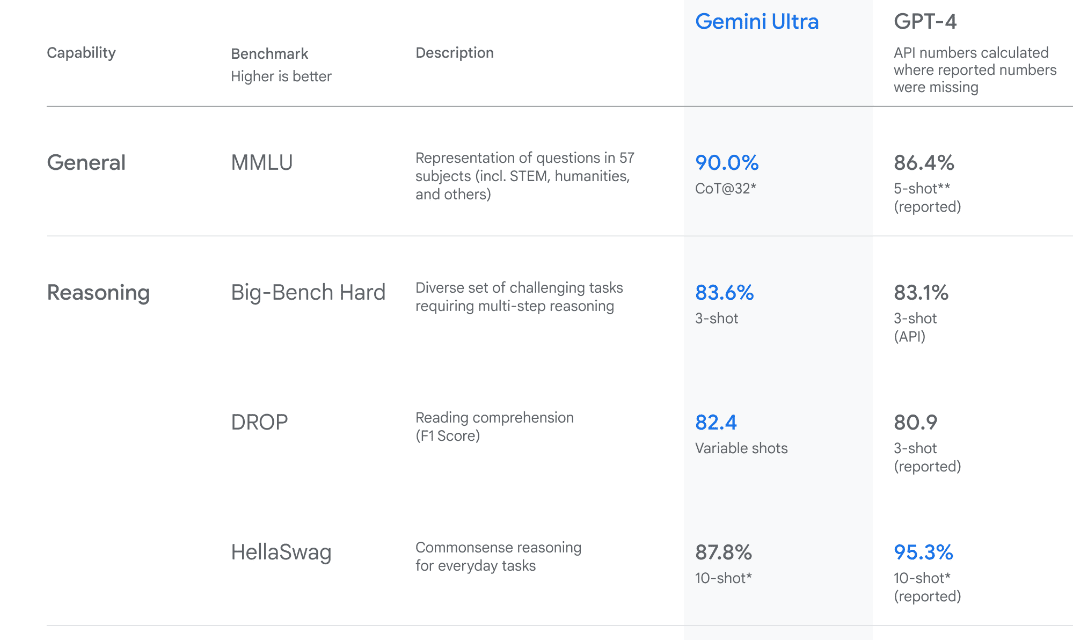

Gemini Ultra tiene un rendimiento de última generación, superando el rendimiento de GPT-4 en varias métricas. Es el primer modelo que supera a los expertos humanos en el punto de referencia Massive Multitask Language Understanding, que evalúa el conocimiento mundial y la resolución de problemas en 57 temas diversos. Esto muestra su comprensión avanzada y capacidades de resolución de problemas.

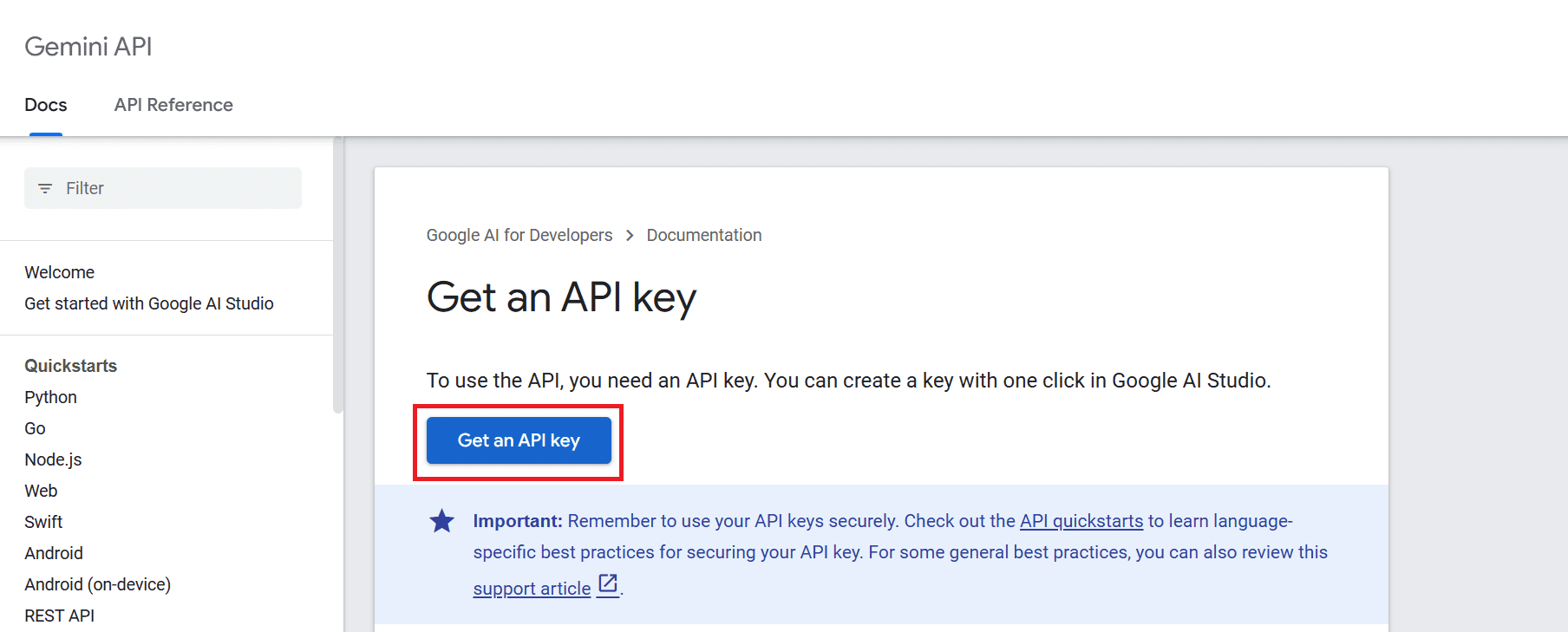

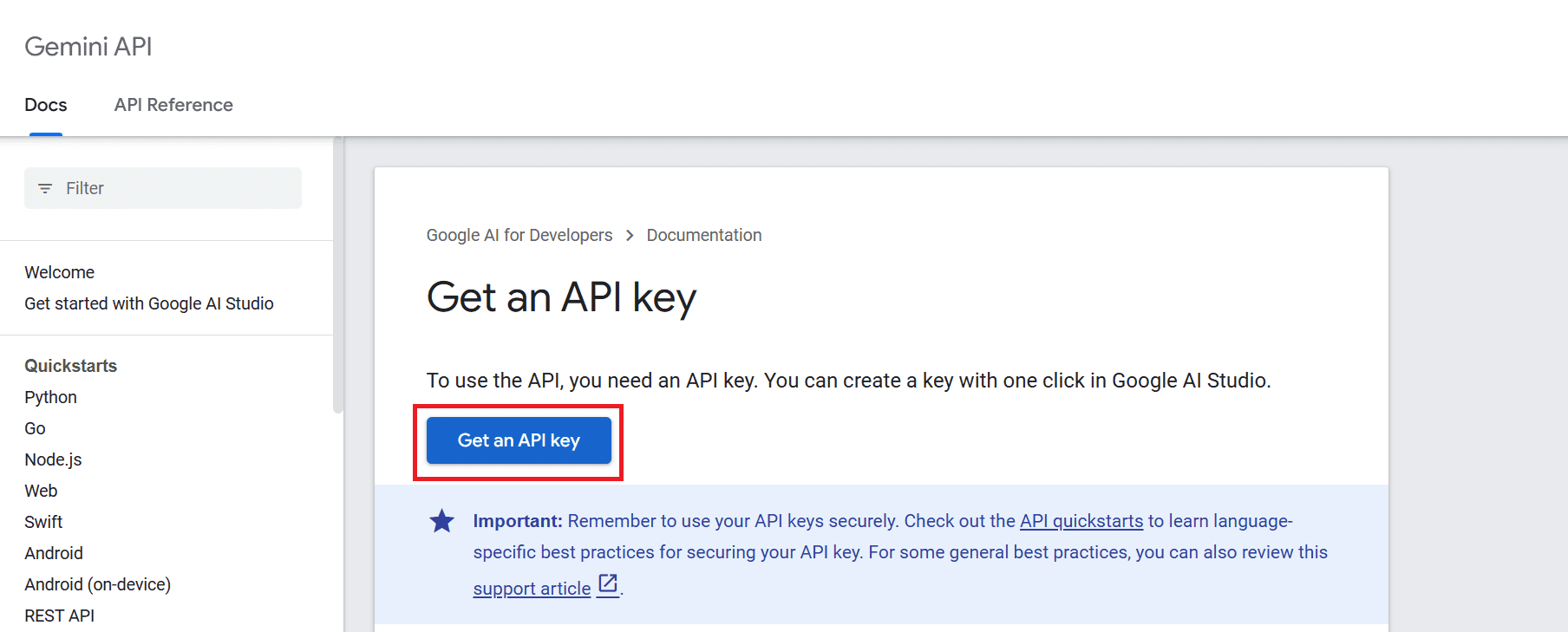

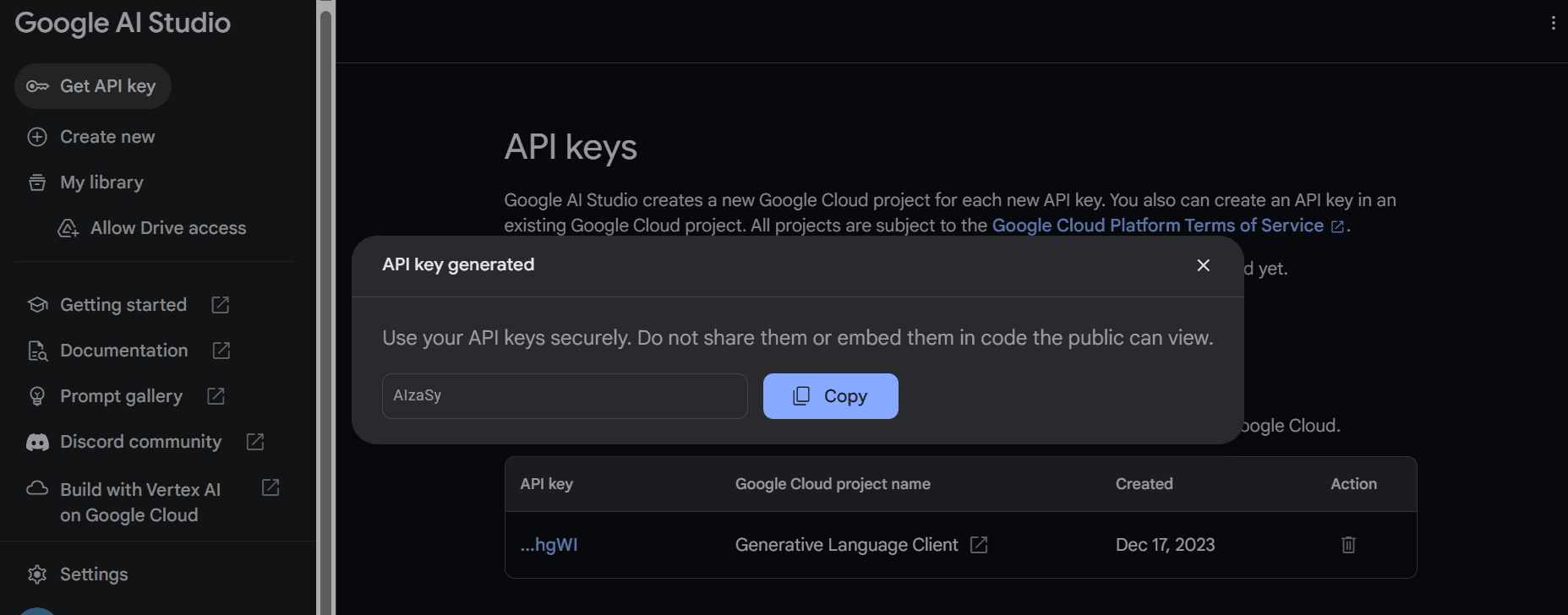

Para utilizar la API, primero debemos obtener una clave API que puede obtener desde aquí: https://ai.google.dev/tutorials/setup

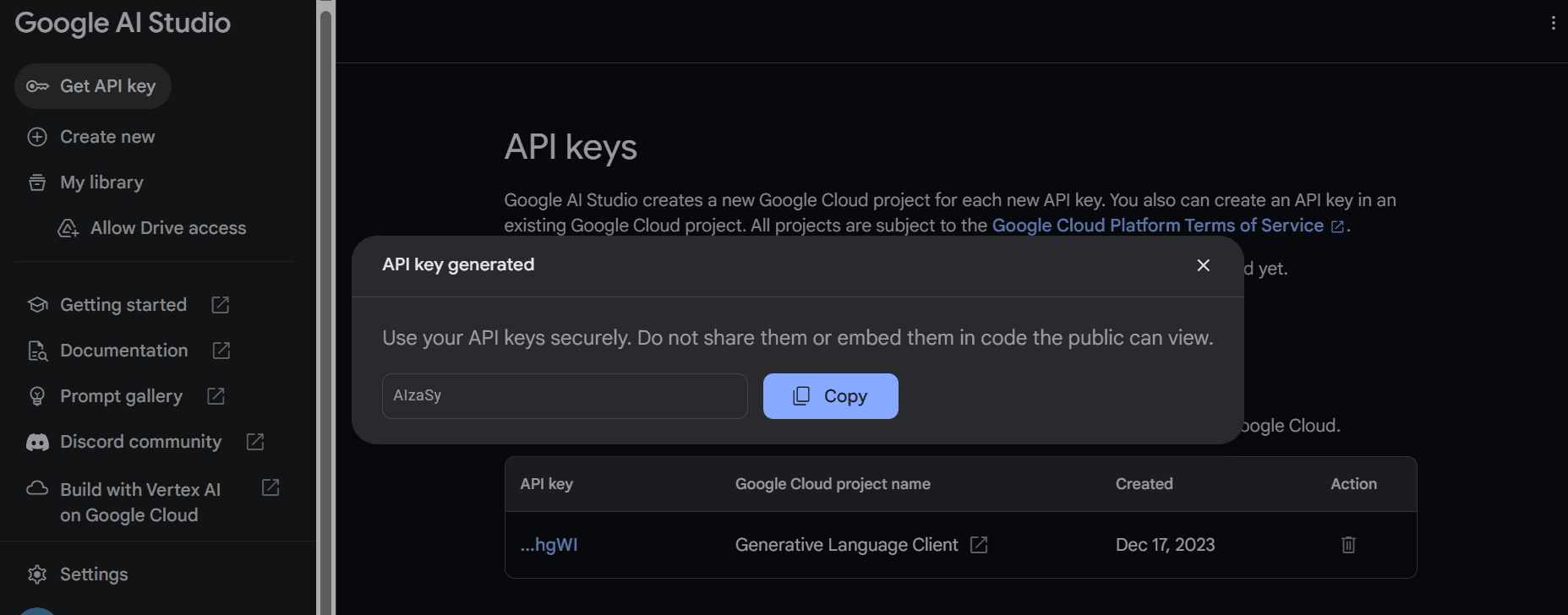

Después de eso, haga clic en el botón "Obtener una clave API" y luego haga clic en "Crear clave API en un nuevo proyecto".

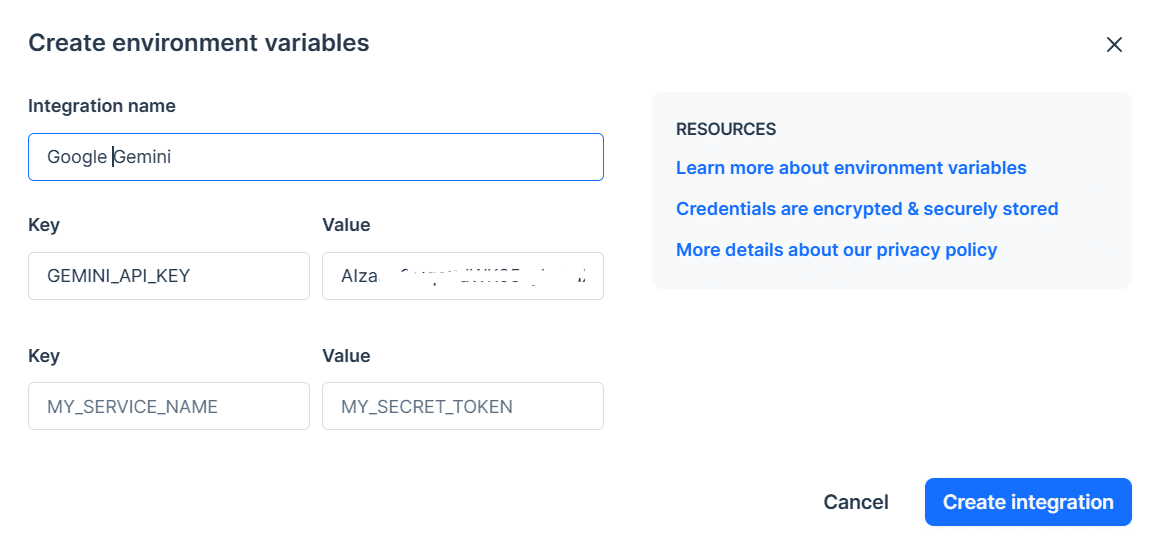

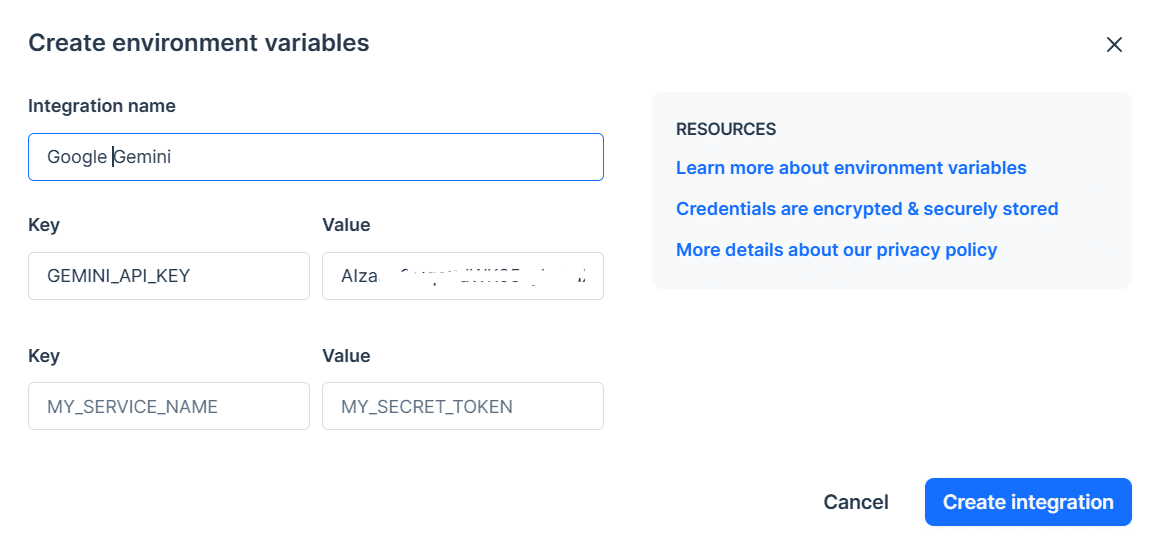

Copie la clave API y configúrela como una variable de entorno. Estamos usando Deepnote y nos resulta bastante fácil configurar la clave con el nombre "GEMINI_API_KEY". Simplemente vaya a la integración, desplácese hacia abajo y seleccione las variables de entorno.

En el siguiente paso, instalaremos la API de Python usando PIP:

pip install -q -U google-generativeaiDespués de eso, configuraremos la clave API en GenAI de Google e iniciaremos la instancia.

import google.generativeai as genai

import os

gemini_api_key = os.environ["GEMINI_API_KEY"]

genai.configure(api_key = gemini_api_key)Después de configurar la clave API, usar el modelo Gemini Pro para generar contenido es simple. Proporcione un mensaje a la función `generate_content` y muestre el resultado como Markdown.

from IPython.display import Markdown

model = genai.GenerativeModel('gemini-pro')

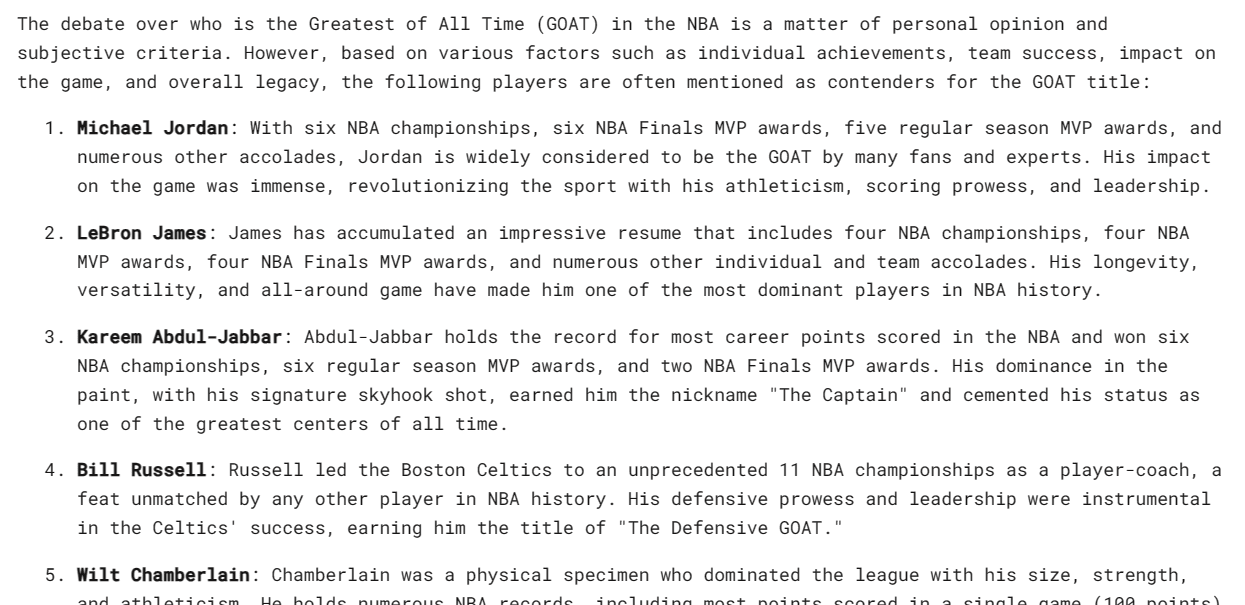

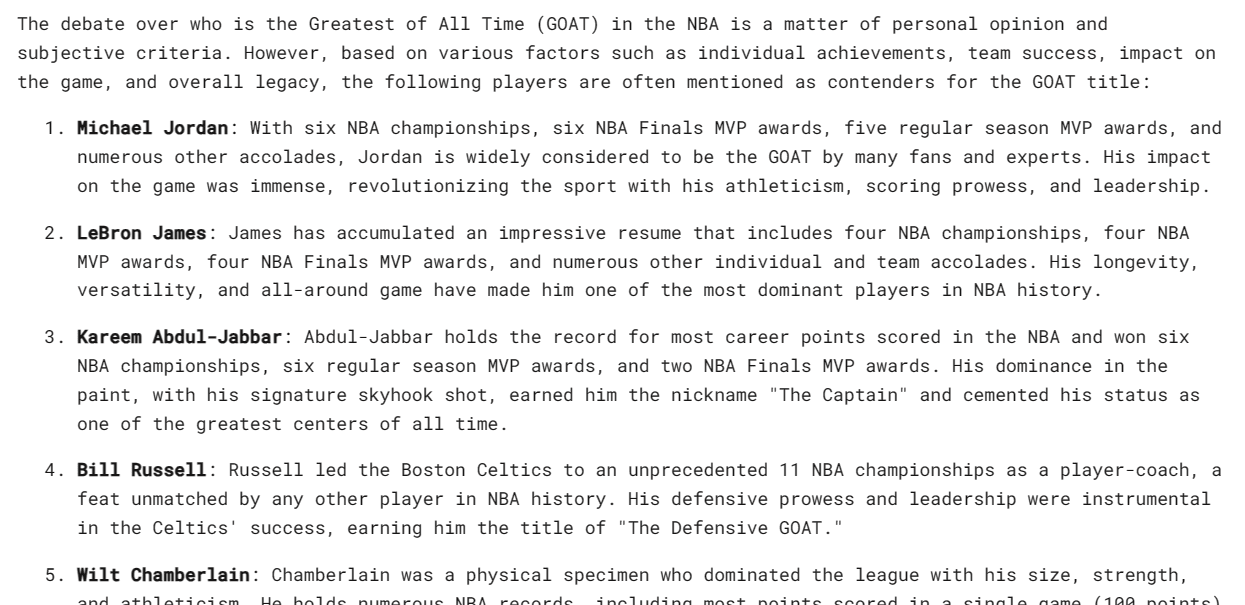

response = model.generate_content("Who is the GOAT in the NBA?")

Markdown(response.text)Esto es asombroso, pero no estoy de acuerdo con la lista. Sin embargo, entiendo que se trata de preferencias personales.

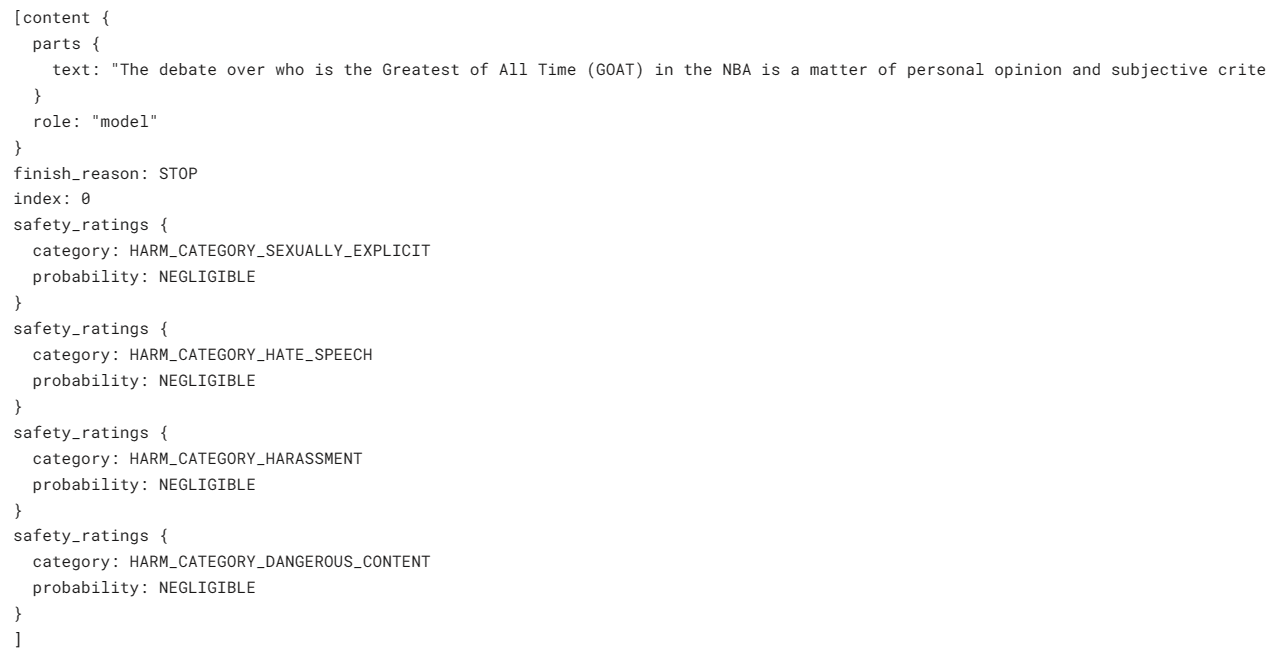

Gemini puede generar múltiples respuestas, llamadas candidatas, para un solo mensaje. Puedes seleccionar el más adecuado. En nuestro caso, solo tuvimos una respuesta.

response.candidates

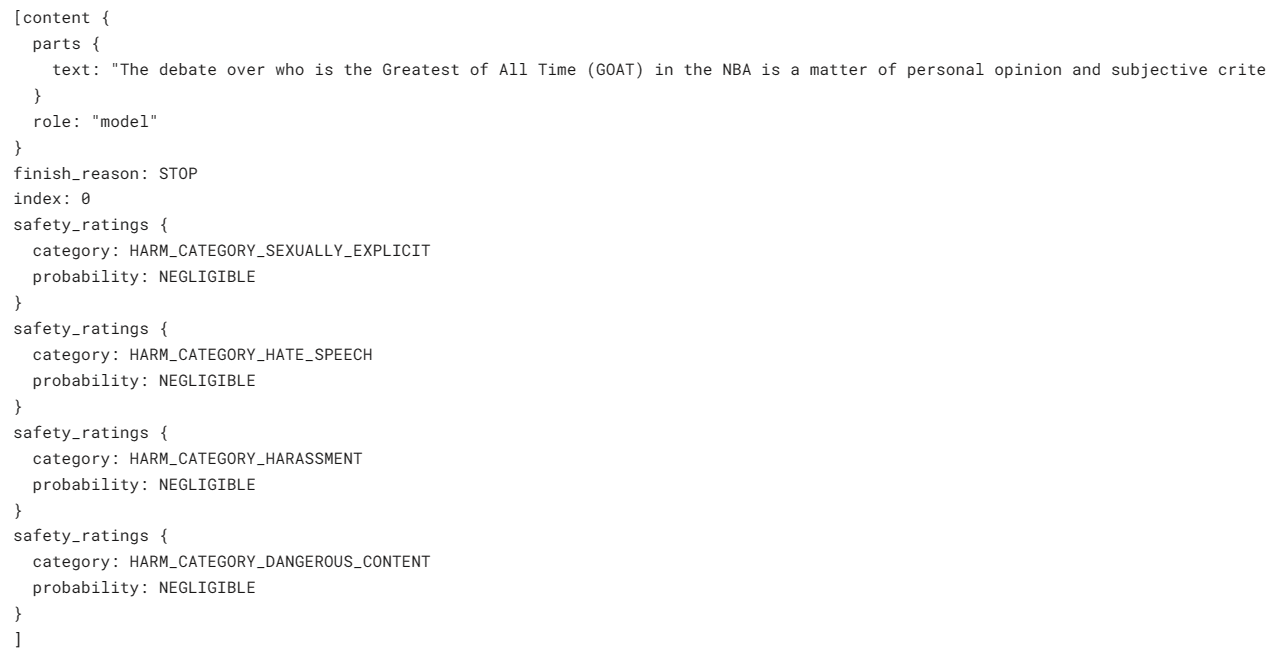

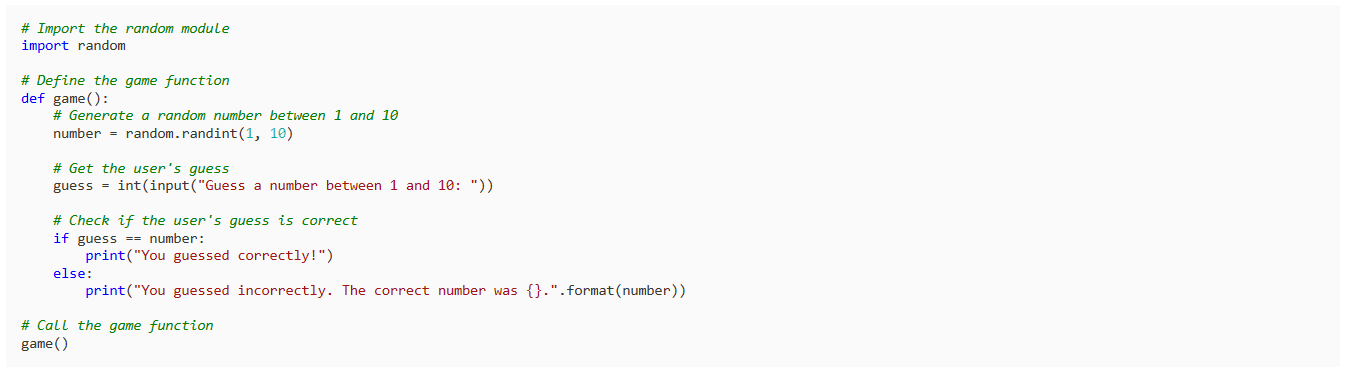

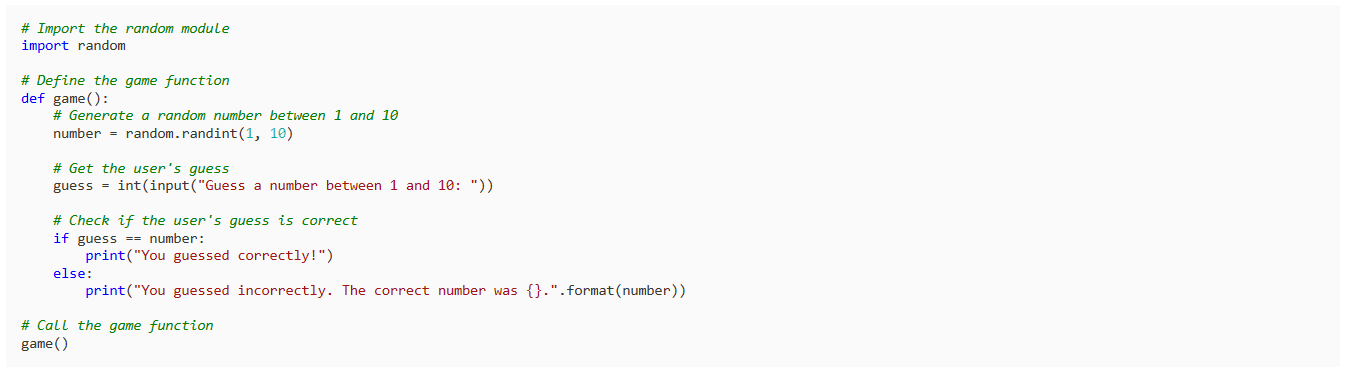

Pidámosle que escriba un juego sencillo en Python.

response = model.generate_content("Build a simple game in Python")

Markdown(response.text)El resultado es simple y va al grano. La mayoría de los LLM comienzan a explicar el código Python en lugar de escribirlo.

Puedes personalizar tu respuesta usando el argumento `generación_config`. Estamos limitando el recuento de candidatos a 1, agregando la palabra vacía "espacio" y estableciendo tokens y temperatura máximos.

response = model.generate_content(

'Write a short story about aliens.',

generation_config=genai.types.GenerationConfig(

candidate_count=1,

stop_sequences=['space'],

max_output_tokens=200,

temperature=0.7)

)

Markdown(response.text)Como puede ver, la respuesta se detuvo antes de la palabra "espacio". Asombroso.

También puede utilizar el argumento `stream` para transmitir la respuesta. Es similar a las API Anthropic y OpenAI pero más rápida.

model = genai.GenerativeModel('gemini-pro')

response = model.generate_content("Write a Julia function for cleaning the data.", stream=True)

for chunk in response:

print(chunk.text)

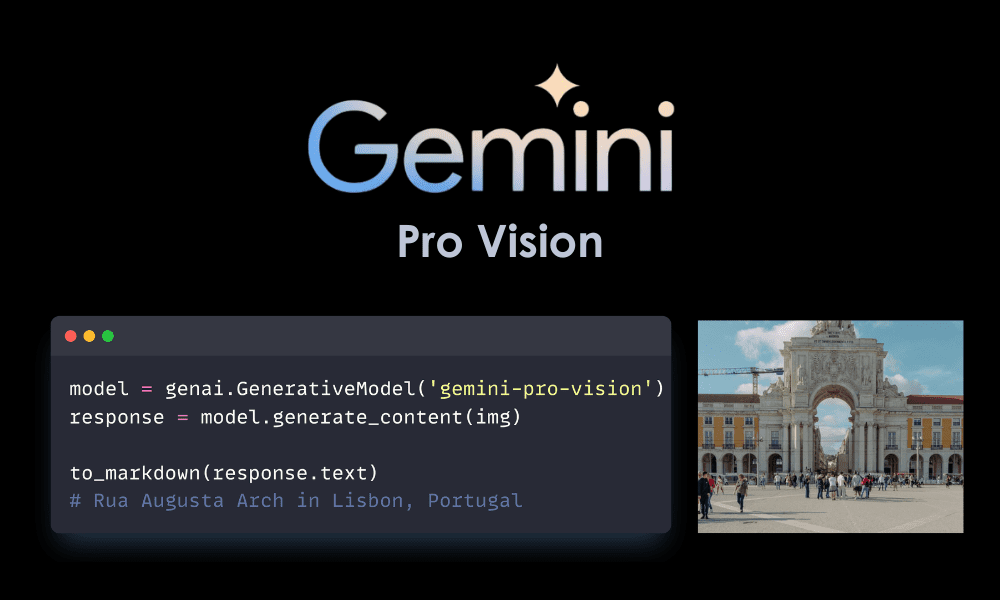

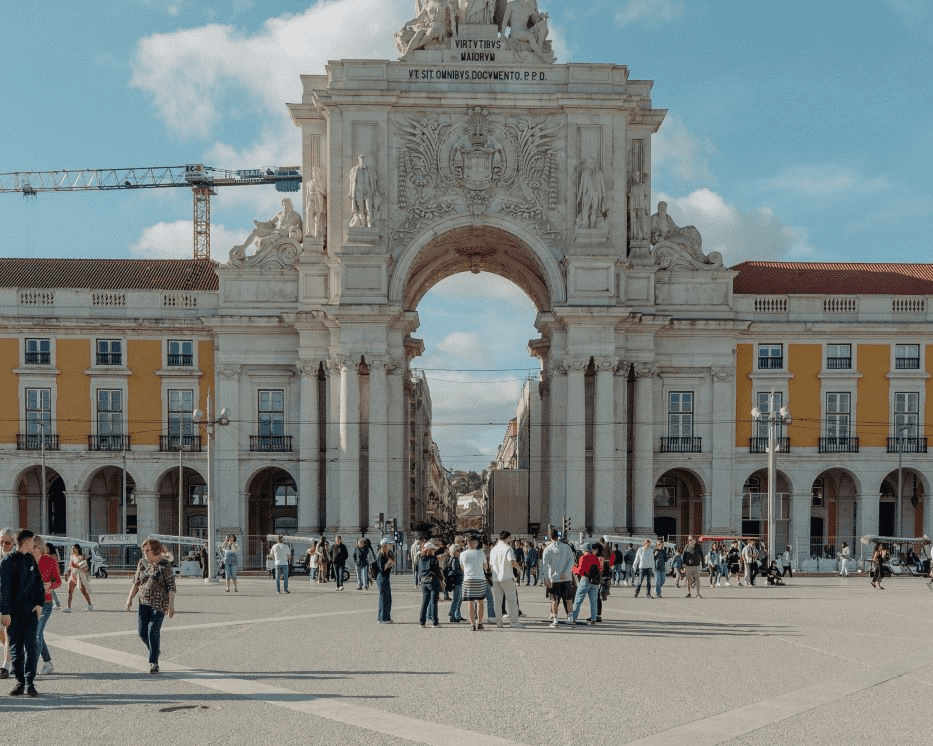

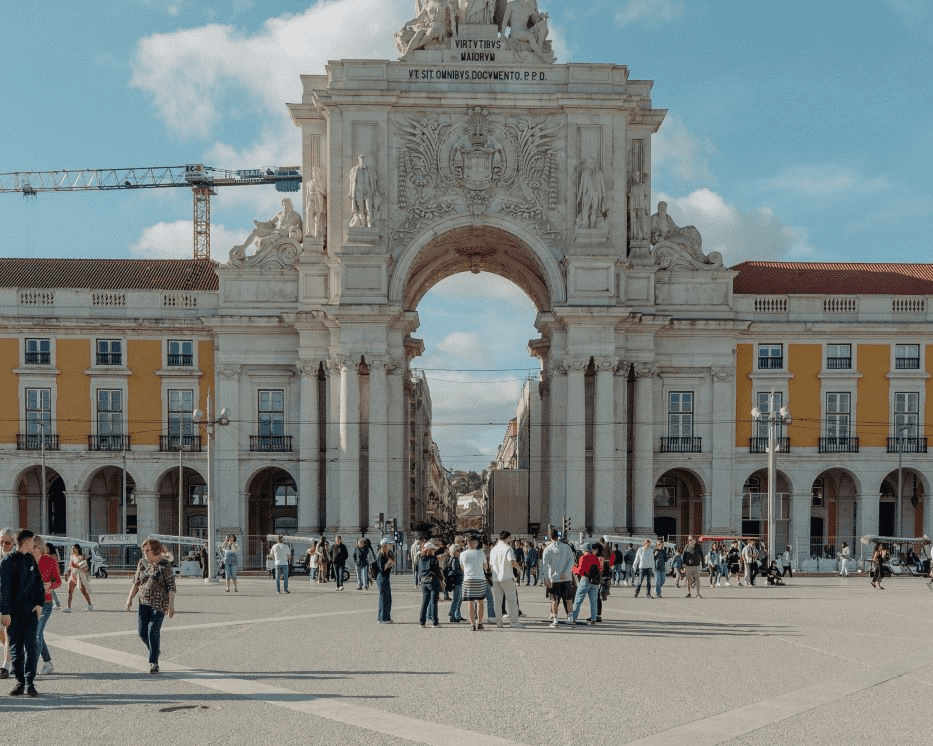

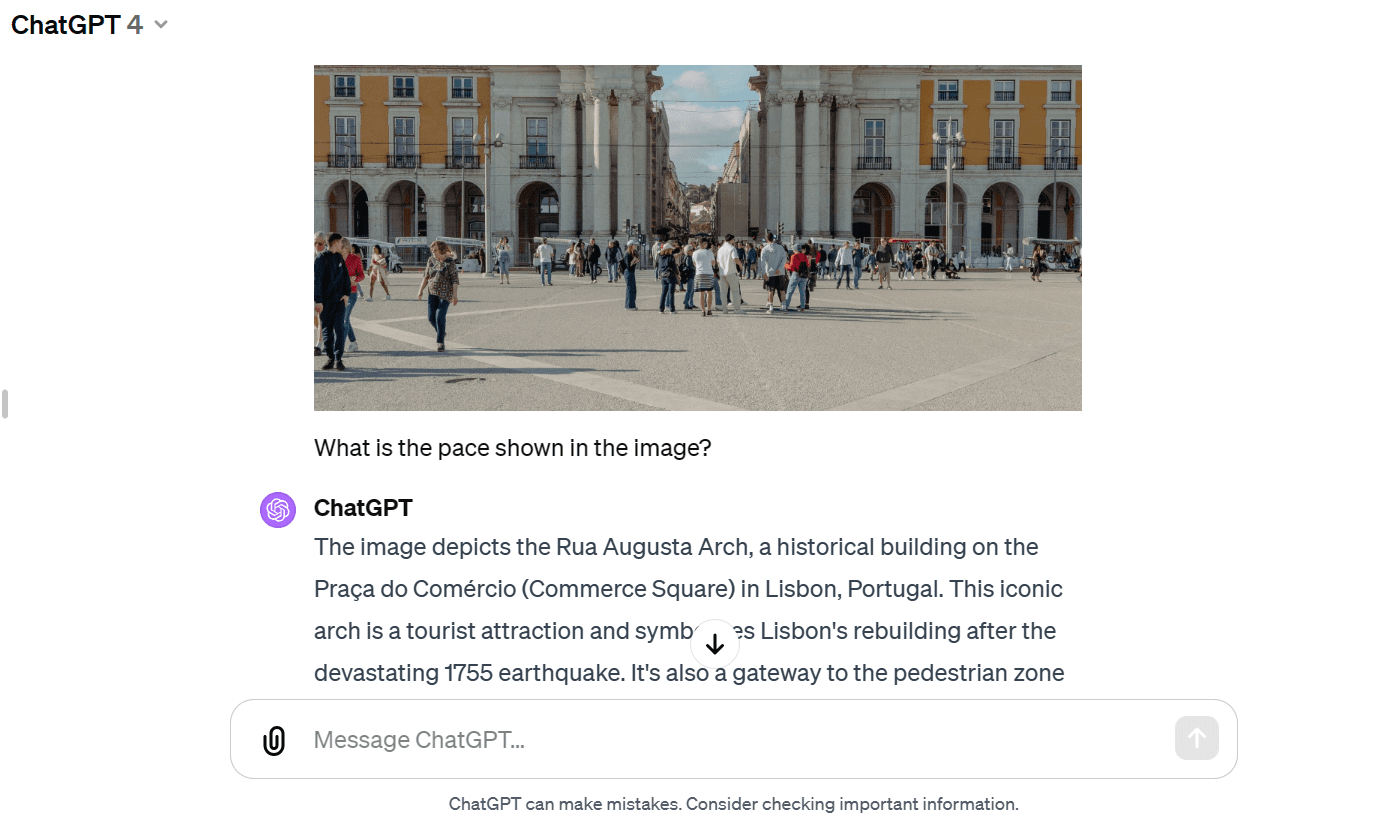

En esta sección cargaremos Masood Aslami foto y úsala para probar la multimodalidad de Gemini Pro Vision.

Cargue las imágenes en el `PIL` y muéstrelas.

import PIL.Image

img = PIL.Image.open('images/photo-1.jpg')

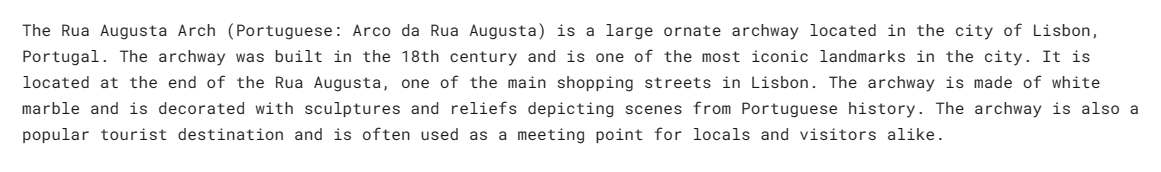

imgTenemos una foto de alta calidad del Arco de Rua Augusta.

Carguemos el modelo Gemini Pro Vision y proporcionemos la imagen.

model = genai.GenerativeModel('gemini-pro-vision')

response = model.generate_content(img)

Markdown(response.text)El modelo identificó con precisión el palacio y proporcionó información adicional sobre su historia y arquitectura.

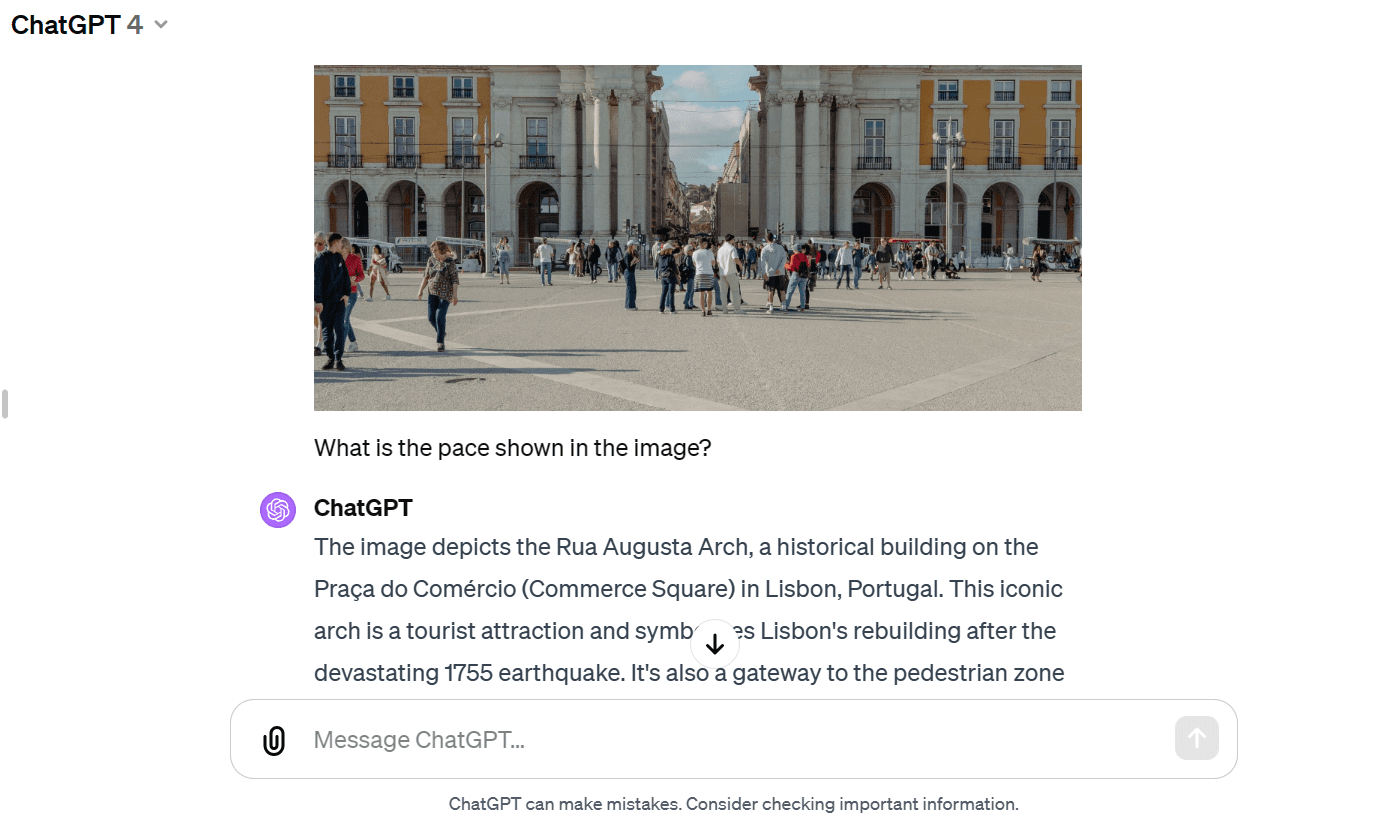

Proporcionemos la misma imagen al GPT-4 y pregúntele sobre la imagen. Ambos modelos han proporcionado respuestas casi similares. Pero me gusta más la respuesta del GPT-4.

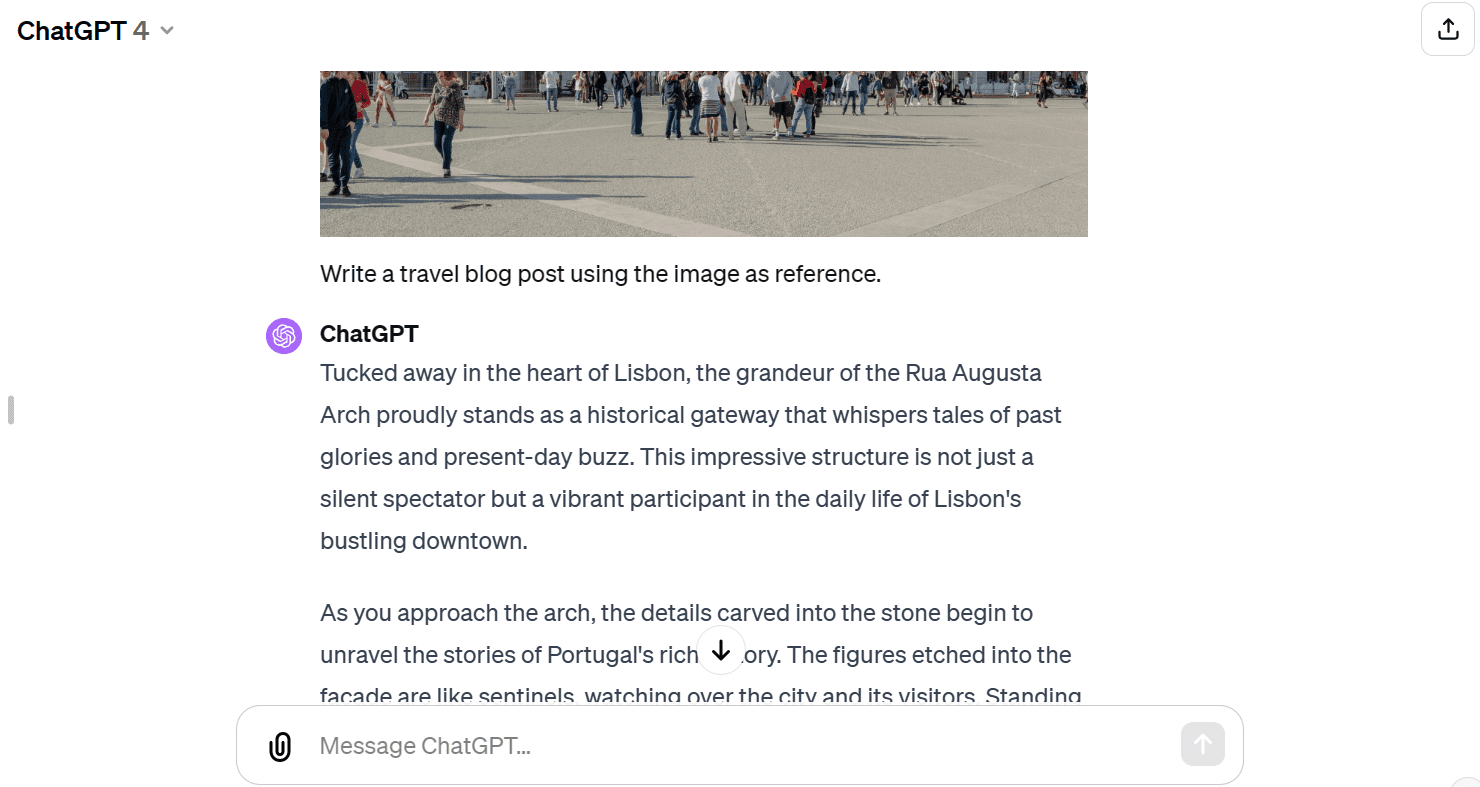

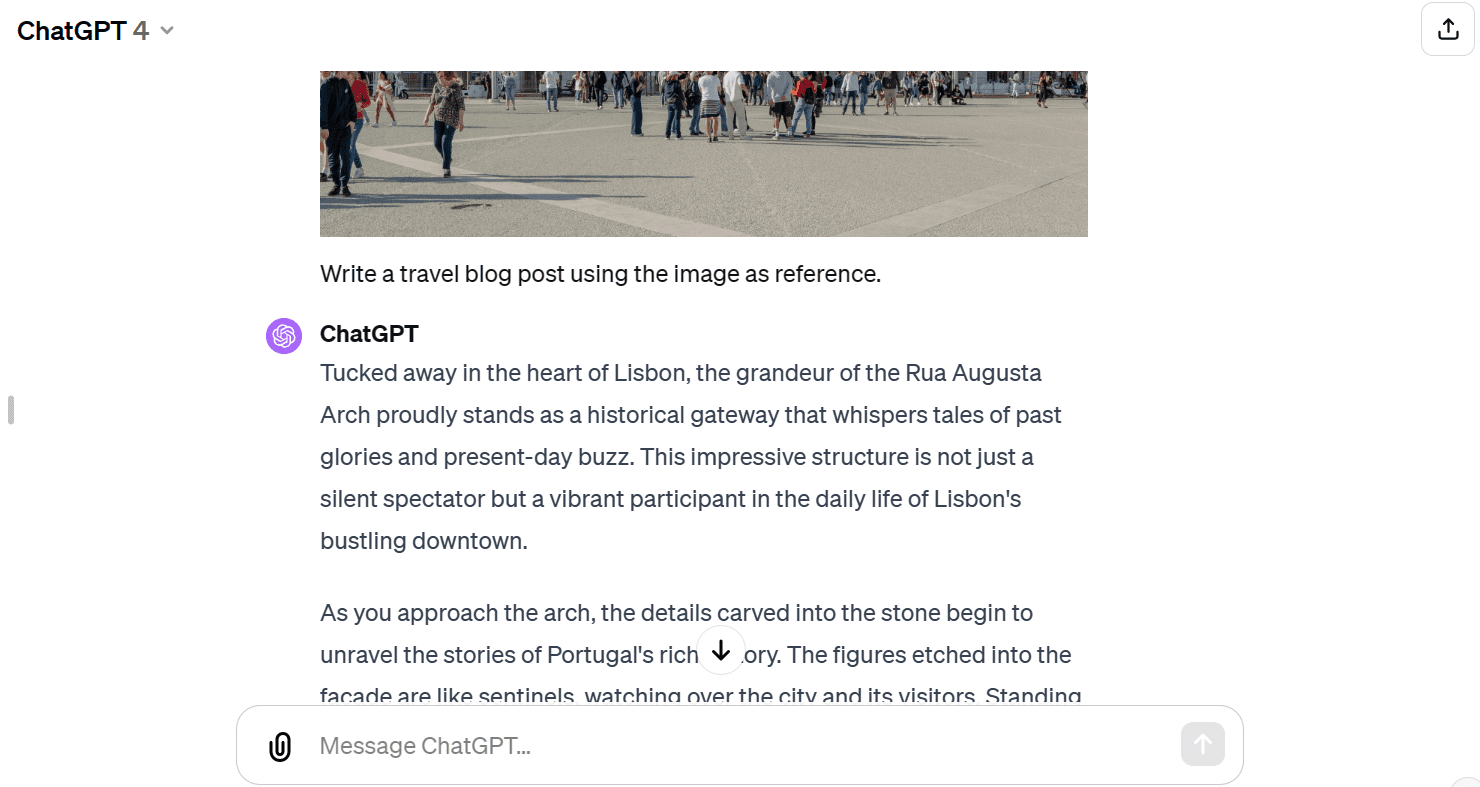

Ahora proporcionaremos el texto y la imagen a la API. Le hemos pedido al modelo de visión que escriba un blog de viajes utilizando la imagen como referencia.

response = model.generate_content(["Write a travel blog post using the image as reference.", img])

Markdown(response.text)Me ha proporcionado un breve blog. Esperaba un formato más largo.

En comparación con GPT-4, el modelo Gemini Pro Vision ha tenido dificultades para generar un blog de formato largo.

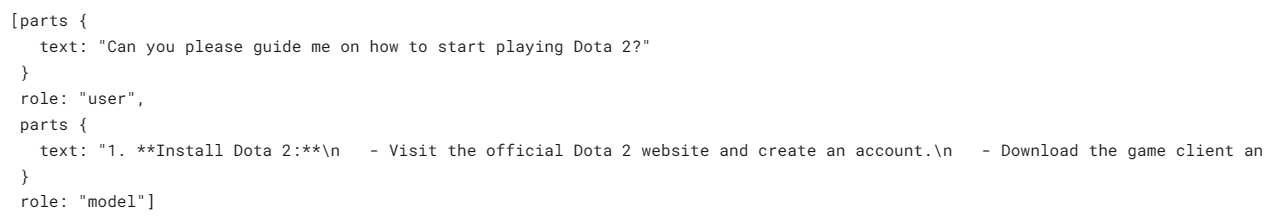

Podemos configurar el modelo para que tenga una sesión de chat de ida y vuelta. De esta forma, el modelo recuerda el contexto y la respuesta utilizando las conversaciones anteriores.

En nuestro caso, iniciamos la sesión de chat y le pedimos al modelo que me ayudara a comenzar con el juego Dota 2.

model = genai.GenerativeModel('gemini-pro')

chat = model.start_chat(history=[])

chat.send_message("Can you please guide me on how to start playing Dota 2?")

chat.historyComo puede ver, el objeto `chat` guarda el historial del usuario y el modo chat.

También podemos mostrarlos en estilo Markdown.

for message in chat.history:

display(Markdown(f'**{message.role}**: {message.parts[0].text}'))

Hagamos la pregunta de seguimiento.

chat.send_message("Which Dota 2 heroes should I start with?")

for message in chat.history:

display(Markdown(f'**{message.role}**: {message.parts[0].text}'))Podemos desplazarnos hacia abajo y ver la sesión completa con el modelo.

Los modelos de incrustación se están volviendo cada vez más populares para aplicaciones sensibles al contexto. El modelo Gemini embedding-001 permite representar palabras, oraciones o documentos completos como vectores densos que codifican significado semántico. Esta representación vectorial hace posible comparar fácilmente la similitud entre diferentes fragmentos de texto comparando sus correspondientes vectores de incrustación.

Podemos proporcionar el contenido a `embed_content` y convertir el texto en incrustaciones. Es así de simple.

output = genai.embed_content(

model="models/embedding-001",

content="Can you please guide me on how to start playing Dota 2?",

task_type="retrieval_document",

title="Embedding of Dota 2 question")

print(output['embedding'][0:10])[0.060604308, -0.023885584, -0.007826327, -0.070592545, 0.021225851, 0.043229062, 0.06876691, 0.049298503, 0.039964676, 0.08291664]Podemos convertir varios fragmentos de texto en incrustaciones pasando una lista de cadenas al argumento "contenido".

output = genai.embed_content(

model="models/embedding-001",

content=[

"Can you please guide me on how to start playing Dota 2?",

"Which Dota 2 heroes should I start with?",

],

task_type="retrieval_document",

title="Embedding of Dota 2 question")

for emb in output['embedding']:

print(emb[:10])[0.060604308, -0.023885584, -0.007826327, -0.070592545, 0.021225851, 0.043229062, 0.06876691, 0.049298503, 0.039964676, 0.08291664]

[0.04775657, -0.044990525, -0.014886052, -0.08473655, 0.04060122, 0.035374347, 0.031866882, 0.071754575, 0.042207796, 0.04577447]Si tienes problemas para reproducir el mismo resultado, consulta mi Espacio de trabajo de notas profundas.

Hay tantas funciones avanzadas que no cubrimos en este tutorial introductorio. Puede obtener más información sobre la API de Gemini yendo a API de Gemini: inicio rápido con Python.

En este tutorial, aprendimos sobre Gemini y cómo acceder a la API de Python para generar respuestas. En particular, hemos aprendido sobre generación de texto, comprensión visual, transmisión, historial de conversaciones, salida personalizada e incrustaciones. Sin embargo, esto sólo roza la superficie de lo que Géminis puede hacer.

No dudes en compartir conmigo lo que has creado utilizando la API gratuita de Gemini. Las posibilidades son ilimitadas.

Abid Ali Awan (@ 1abidaliawan) es un profesional científico de datos certificado al que le encanta crear modelos de aprendizaje automático. Actualmente, se está enfocando en la creación de contenido y escribiendo blogs técnicos sobre aprendizaje automático y tecnologías de ciencia de datos. Abid tiene una Maestría en Gestión de Tecnología y una licenciatura en Ingeniería de Telecomunicaciones. Su visión es construir un producto de IA utilizando una red neuronal gráfica para estudiantes que luchan contra enfermedades mentales.

- Distribución de relaciones públicas y contenido potenciado por SEO. Consiga amplificado hoy.

- PlatoData.Network Vertical Generativo Ai. Empodérate. Accede Aquí.

- PlatoAiStream. Inteligencia Web3. Conocimiento amplificado. Accede Aquí.

- PlatoESG. Carbón, tecnología limpia, Energía, Ambiente, Solar, Gestión de residuos. Accede Aquí.

- PlatoSalud. Inteligencia en Biotecnología y Ensayos Clínicos. Accede Aquí.

- Fuente: https://www.kdnuggets.com/how-to-access-and-use-gemini-api-for-free?utm_source=rss&utm_medium=rss&utm_campaign=how-to-access-and-use-gemini-api-for-free

- :posee

- :es

- $ UP

- 1

- 10

- 12

- 13

- 14

- 17

- 27

- 7

- 8

- 9

- a

- Nuestra Empresa

- de la máquina

- precisamente

- a través de

- la adición de

- Adicionales

- Información adicional

- avanzado

- de nuevo

- AI

- extranjeros

- Todos

- permite

- casi

- también

- las increíbles ofertas de

- an

- y

- respuestas

- Antrópico

- abejas

- API

- aplicaciones

- arquitectura

- somos

- argumento

- AS

- contacta

- At

- audio

- Equilibrado

- BE

- cada vez

- esto

- antes

- entre

- Blog

- Blogs

- ambas

- build

- Construir la

- construido

- negocios

- pero

- .

- by

- , que son

- PUEDEN

- candidato

- candidatos

- capacidades

- capaz

- case

- cases

- Centros

- Ingenieros

- chat

- comprobar

- Limpieza

- clic

- código

- colaboración

- comparar

- comparar

- integraciones

- contenido

- creación de contenido

- contexto

- Conversación

- conversaciones

- convertir

- Correspondiente

- Protectora

- creación

- En la actualidad

- personalizado

- personalizan

- datos

- los centros de datos

- Ciencia de los datos

- científico de datos

- Fecha

- Mente profunda

- Grado

- denso

- diseñado

- desarrollado

- desarrolladores

- Dispositivos

- no hizo

- una experiencia diferente

- Pantalla

- diverso

- do

- documentos

- don

- DotA

- Dota 2

- DE INSCRIPCIÓN

- pasan fácilmente

- de forma sencilla

- eficiente

- eficiente.

- incrustación

- Ingeniería

- Todo

- Entorno

- Éter (ETH)

- esperando

- expertos

- Explicar

- explorar

- más rápida

- Nombre

- flexible

- enfoque

- seguir

- formato

- Gratuito

- Desde

- función

- funciones

- juego

- Gemini

- generar

- generación de AHSS

- obtener

- gif

- Go

- va

- candidato

- De Google

- gráfica

- Red neuronal gráfica

- guía

- tenido

- Tienen

- es

- he

- ayuda

- esta página

- Héroes

- Alta

- altamente

- su

- historia

- mantiene

- Cómo

- Como Hacer

- Sin embargo

- HTTPS

- humana

- i

- no haber aun identificado una solucion para el problema

- enfermedad

- imagen

- imágenes

- importar

- in

- Incluye

- cada vez más

- información

- iniciar

- instalar

- ejemplo

- integración

- dentro

- tips para

- IT

- SUS

- jpg

- Julia

- solo

- nuggets

- Clave

- especialistas

- idioma

- mayor

- APRENDE:

- aprendido

- aprendizaje

- como

- sin límites

- Etiqueta LinkedIn

- Lista

- carga

- por más tiempo

- ama

- máquina

- máquina de aprendizaje

- HACE

- Management

- muchos

- masivo

- dominar

- max

- me

- sentido

- significa

- mental

- Enfermedad mental

- Métrica

- Móvil

- dispositivos móviles

- Moda

- modelo

- modelos

- más,

- MEJOR DE TU

- múltiples

- nombre

- nano

- NBA

- del sistema,

- Neural

- red neural

- Nuevo

- Next

- ahora

- objeto

- of

- on

- ONE

- , solamente

- OpenAI

- funcionar

- or

- OS

- nuestros

- salir

- Superar

- salida

- Palacio

- particular

- Pasando (Paso)

- perfecto

- actuación

- realizar

- con

- piezas

- Platón

- Inteligencia de datos de Platón

- PlatónDatos

- jugando

- Por favor

- punto

- Popular

- POSIBILIDADES

- posible

- Publicación

- posible

- anterior

- Pro

- Problema

- la resolución de problemas

- Producto

- Profesional

- proporcionar

- previsto

- proporcionando

- Python

- calidad

- consultas

- pregunta

- exactamente

- distancia

- RE

- referencia

- representación

- representado

- la investigación

- respuesta

- respuestas

- resultado

- revolucionar

- s

- mismo

- ahorro

- Escalabilidad

- Escala

- escala ia

- Ciencia:

- Científico

- mover

- Sección

- ver

- selecciona

- Sesión

- set

- pólipo

- Varios

- Compartir

- En Corto

- tienes

- similares

- sencillos

- soltero

- So

- Resolver

- Espacio

- específicamente

- comienzo

- fundó

- el estado de la técnica

- paso

- Detener

- detenido

- Historia

- stream

- en streaming

- Luchando

- Estudiantes

- papa

- adecuado

- Superficie

- Todas las funciones a su disposición

- T

- tareas

- equipos

- Técnico

- Tecnologías

- Tecnología

- telecomunicación

- test

- pruebas

- texto

- generación de texto

- esa

- La

- su

- Les

- luego

- así

- Tres

- A través de esta formación, el personal docente y administrativo de escuelas y universidades estará preparado para manejar los recursos disponibles que derivan de la diversidad cultural de sus estudiantes. Además, un mejor y mayor entendimiento sobre estas diferencias y similitudes culturales permitirá alcanzar los objetivos de inclusión previstos.

- a

- Tokens

- viajes

- problema

- tutoriales

- tipos

- Ultra

- entender

- comprensión

- us

- usable

- utilizan el

- Usuario

- usando

- variable

- diversos

- Video

- visión

- visual

- fue

- Camino..

- we

- ¿

- que

- QUIENES

- amplio

- Amplia gama

- seguirá

- Palabra

- palabras

- Actividades:

- mundo

- escribir

- la escritura

- Usted

- tú

- zephyrnet