Τα μοντέλα τεχνητής νοημοσύνης που δημιουργούνται μπορούν να απομνημονεύουν εικόνες από τα δεδομένα εκπαίδευσής τους, επιτρέποντας πιθανώς στους χρήστες να εξάγουν ιδιωτικά δεδομένα που προστατεύονται από πνευματικά δικαιώματα, σύμφωνα με έρευνα.

Εργαλεία όπως το DALL-E, το Stable Diffusion και το Midjourney εκπαιδεύονται σε δισεκατομμύρια εικόνες που έχουν αφαιρεθεί από το διαδίκτυο, συμπεριλαμβανομένων δεδομένων που προστατεύονται από πνευματικά δικαιώματα, όπως έργα τέχνης και λογότυπα. Μαθαίνουν να χαρτογραφούν οπτικές αναπαραστάσεις αντικειμένων και στυλ στη φυσική γλώσσα. Όταν τους δίνεται μια περιγραφή κειμένου ως είσοδος, δημιουργούν μια εικόνα που ταιριάζει με τη λεζάντα ως έξοδο.

Η νέα τεχνολογία έχει πυροδοτήσει μια νέα νομική συζήτηση σχετικά με τα πνευματικά δικαιώματα: παραβιάζουν αυτά τα εργαλεία δικαιώματα πνευματικής ιδιοκτησίας, δεδομένου ότι έλαβαν εικόνες που προστατεύονται από πνευματικά δικαιώματα χωρίς άδεια;

Έχουν γίνει αγωγές κατατεθεί ενάντια στους κατασκευαστές των πιο δημοφιλών εργαλείων παραγωγής τεχνητής νοημοσύνης για παραβίαση πνευματικών δικαιωμάτων. Οι εταιρείες που κατασκευάζουν μοντέλα κειμένου σε εικόνα υποστηρίζουν ότι δεδομένου ότι το λογισμικό τους δημιουργεί μοναδικές εικόνες, η χρήση των δεδομένων πνευματικών δικαιωμάτων είναι ορθή χρήση. Αλλά οι καλλιτέχνες που έχουν δει τα στυλ και τη δουλειά τους να μιμούνται από αυτά τα εργαλεία πιστεύουν ότι έχουν εξαπατηθεί.

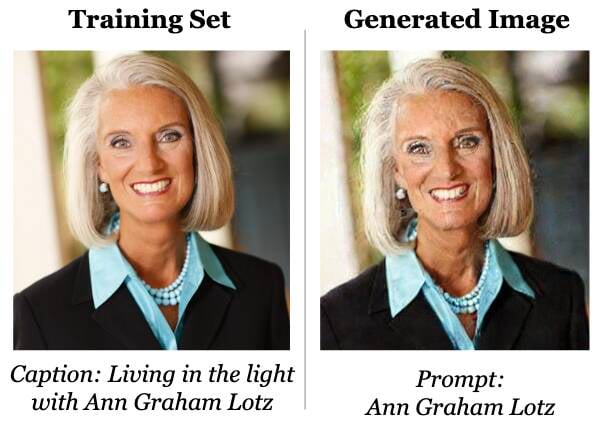

Τώρα, έρευνα με επικεφαλής ερευνητές που εργάζονται στη Google, το DeepMind, το Πανεπιστήμιο της Καλιφόρνια, το Μπέρκλεϋ, το ETH της Ζυρίχης και το Πανεπιστήμιο Πρίνστον αποδεικνύει ότι μπορούν να εξαχθούν εικόνες που χρησιμοποιούνται για την εκπαίδευση αυτών των μοντέλων. Τα μοντέλα γενετικής τεχνητής νοημοσύνης απομνημονεύουν εικόνες και μπορούν να δημιουργήσουν ακριβή αντίγραφά τους, εγείροντας νέες ανησυχίες σχετικά με τα πνευματικά δικαιώματα και το απόρρητο.

Μερικά παραδείγματα εικόνων που οι ερευνητές κατάφεραν να εξαγάγουν από το Stable Diffusion

«Σε μια πραγματική επίθεση, όπου ένας αντίπαλος θέλει να εξαγάγει ιδιωτικές πληροφορίες, θα μαντέψει την ετικέτα ή τη λεζάντα που χρησιμοποιήθηκε για μια εικόνα», είπαν οι συγγραφείς της μελέτης. Το μητρώο.

«Ευτυχώς για τον επιθετικό, η μέθοδός μας μπορεί μερικές φορές να λειτουργήσει ακόμα κι αν η εικασία δεν είναι τέλεια. Για παράδειγμα, μπορούμε να εξαγάγουμε το πορτρέτο της Ann Graham Lotz προτρέποντας απλώς τη Stable Diffusion με το όνομά της, αντί για την πλήρη λεζάντα από το σετ εκπαίδευσης («Living in the light with Ann Graham Lotz»).

Μόνο οι εικόνες που απομνημονεύονται από το μοντέλο μπορούν να εξαχθούν και το πόσο ένα μοντέλο μπορεί να απομνημονεύσει δεδομένα ποικίλλει ανάλογα με παράγοντες όπως τα δεδομένα εκπαίδευσης και το μέγεθός του. Τα αντίγραφα της ίδιας εικόνας είναι πιο πιθανό να απομνημονεύονται και τα μοντέλα που περιέχουν περισσότερες παραμέτρους είναι πιο πιθανό να μπορούν να θυμούνται και εικόνες.

Η ομάδα κατάφερε να εξαγάγει 94 εικόνες από 350,000 παραδείγματα που χρησιμοποιήθηκαν για την εκπαίδευση του Stable Diffusion και 23 εικόνες από 1,000 παραδείγματα από το Google Εικόνα μοντέλο. Για σύγκριση, το Stable Diffusion έχει 890 εκατομμύρια παραμέτρους και εκπαιδεύτηκε σε 160 εκατομμύρια εικόνες, ενώ το Imagen έχει δύο δισεκατομμύρια παραμέτρους – δεν είναι σαφές πόσες εικόνες χρησιμοποιήθηκαν ακριβώς για την εκπαίδευσή του.

«Για τη Σταθερή Διάχυση, διαπιστώνουμε ότι οι περισσότερες απομνημονευμένες εικόνες αντιγράφηκαν 100 φορές ή περισσότερες στο σετ εκπαίδευσης, αλλά μερικές μόνο 10 φορές», είπαν οι ερευνητές. «Για το μοντέλο Imagen της Google, το οποίο είναι μεγαλύτερο μοντέλο από το Stable Diffusion και εκπαιδευμένο σε μικρότερο σύνολο δεδομένων, η απομνημόνευση φαίνεται να είναι πολύ πιο συχνή. Εδώ βρίσκουμε μερικές ακραίες εικόνες που υπάρχουν μόνο μία φορά σε ολόκληρο το σετ προπόνησης, αλλά εξακολουθούν να μπορούν να εξαχθούν."

Δεν είναι σίγουροι γιατί τα μεγαλύτερα μοντέλα τείνουν να απομνημονεύουν περισσότερες εικόνες, αλλά πιστεύουν ότι μπορεί να έχει να κάνει με τη δυνατότητα αποθήκευσης περισσότερων από τα δεδομένα εκπαίδευσής τους στις παραμέτρους του.

Τα ποσοστά απομνημόνευσης για αυτά τα μοντέλα είναι αρκετά χαμηλά και στην πραγματικότητα η εξαγωγή εικόνων θα ήταν κουραστική και δύσκολη. Οι εισβολείς θα έπρεπε να μαντέψουν και να δοκιμάσουν πολλές προτροπές για να οδηγήσουν το μοντέλο στη δημιουργία απομνημονευμένων δεδομένων. Ωστόσο, η ομάδα προειδοποιεί τους προγραμματιστές να απέχουν από την εκπαίδευση μοντέλων τεχνητής νοημοσύνης που δημιουργούνται σε ευαίσθητα ιδιωτικά δεδομένα.

«Το πόσο κακή είναι η απομνημόνευση εξαρτάται από την εφαρμογή των μοντέλων παραγωγής. Σε εξαιρετικά ιδιωτικές εφαρμογές, όπως στον ιατρικό τομέα (π.χ. εκπαίδευση σε ακτινογραφίες θώρακος ή ιατρικά αρχεία), η απομνημόνευση είναι εξαιρετικά ανεπιθύμητη, ακόμα κι αν επηρεάζει μόνο ένα πολύ μικρό μέρος των χρηστών. Επιπλέον, τα σετ εκπαίδευσης που χρησιμοποιούνται σε εφαρμογές ευαίσθητες στο απόρρητο είναι συνήθως μικρότερα από αυτά που χρησιμοποιούνται για την εκπαίδευση των τρεχόντων μοντέλων γενετικής τέχνης. Επομένως, μπορεί να δούμε πολύ περισσότερη απομνημόνευση, συμπεριλαμβανομένων εικόνων που δεν είναι διπλές», μας είπαν.

Ένας τρόπος για να αποτραπεί η εξαγωγή δεδομένων είναι να μειωθεί η πιθανότητα απομνημόνευσης στα μοντέλα. Η απαλλαγή από τα διπλότυπα στο σύνολο δεδομένων εκπαίδευσης, για παράδειγμα, θα ελαχιστοποιούσε τις πιθανότητες απομνημόνευσης και εξαγωγής εικόνων. Η Stability AI, οι δημιουργοί του Stable Diffusion, φέρεται να έχουν εκπαιδεύσει το νεότερο μοντέλο τους σε ένα σύνολο δεδομένων που περιέχει λιγότερα διπλότυπα, ανεξάρτητα από τα ευρήματα των ερευνητών.

Τώρα που έχει αποδειχθεί ότι τα μοντέλα κειμένου σε εικόνα μπορούν να δημιουργήσουν ακριβή αντίγραφα εικόνων στις οποίες εκπαιδεύτηκαν, δεν είναι σαφές πώς αυτό θα μπορούσε να επηρεάσει υποθέσεις πνευματικών δικαιωμάτων.

«Ένα κοινό επιχείρημα που είχαμε δει τους ανθρώπους να κάνουν στο διαδίκτυο ήταν κάποια παραλλαγή του «αυτά τα μοντέλα δεν απομνημονεύουν ποτέ δεδομένα προπόνησης». Τώρα γνωρίζουμε ότι αυτό είναι ξεκάθαρα ψευδές. Αλλά αν αυτό έχει πραγματικά σημασία ή όχι στη νομική συζήτηση είναι επίσης αντικείμενο συζήτησης», κατέληξαν οι ερευνητές.

«Τουλάχιστον τώρα, και οι δύο πλευρές σε αυτές τις αγωγές έχουν μερικά πιο απτά γεγονότα στα οποία μπορούν να βασιστούν: ναι, η απομνημόνευση συμβαίνει. αλλά είναι πολύ σπάνιο? και κυρίως φαίνεται να συμβαίνει για πολύ διπλές εικόνες." ®

- SEO Powered Content & PR Distribution. Ενισχύστε σήμερα.

- Platoblockchain. Web3 Metaverse Intelligence. Ενισχύθηκε η γνώση. Πρόσβαση εδώ.

- πηγή: https://go.theregister.com/feed/www.theregister.com/2023/02/06/uh_oh_attackers_can_extract/

- 000

- 1

- 10

- 100

- a

- Ικανός

- Σύμφωνα με

- πραγματικά

- κατά

- AI

- Επιτρέποντας

- και

- Εφαρμογή

- εφαρμογές

- Υποστηρίζουν

- επιχείρημα

- Τέχνη

- Καλλιτέχνες

- έργα τέχνης

- επίθεση

- Κακός

- είναι

- Πιστεύω

- Berkeley

- Δισεκατομμύριο

- δισεκατομμύρια

- σύνορο

- Δυο πλευρες

- Κτίριο

- Καλιφόρνια

- περιπτώσεις

- Κέντρο

- πιθανότητα

- καθαρός

- σαφώς

- Κοινός

- Εταιρείες

- σύγκριση

- Πιθανά ερωτήματα

- Κατέληξε στο συμπέρασμα

- αντίγραφα

- πνευματική ιδιοκτησία

- θα μπορούσε να

- δημιουργούς

- Ρεύμα

- του νταλ

- ημερομηνία

- δημόσια συζήτηση

- μείωση

- Deepmind

- εξαρτάται

- περιγραφή

- προγραμματιστές

- Διάχυση

- τομέα

- αντίγραφα

- Ολόκληρος

- ETH

- ETH Zurich

- Αιθέρας (ΕΤΗ)

- Even

- ακριβώς

- παράδειγμα

- παραδείγματα

- εκχύλισμα

- εξαγωγή

- παράγοντες

- έκθεση

- λίγοι

- Εύρεση

- Ευτυχώς

- κλάσμα

- συχνάζω

- φρέσκο

- από

- πλήρη

- Επί πλέον

- παράγουν

- δημιουργεί

- παραγωγής

- γενετική

- Παραγωγική τεχνητή νοημοσύνη

- να πάρει

- δεδομένου

- συμβαίνω

- συμβαίνει

- εδώ

- υψηλά

- Πως

- HTTPS

- εικόνα

- εικόνες

- Επίπτωση

- in

- Συμπεριλαμβανομένου

- ανεξάρτητα

- πληροφορίες

- εισαγωγή

- αντί

- διανοούμενος

- πνευματικής ιδιοκτησίας

- Internet

- IT

- Ξέρω

- επιγραφή

- Γλώσσα

- μεγαλύτερος

- Αγωγές

- οδηγήσει

- ΜΑΘΑΊΝΩ

- Led

- Νομικά

- φως

- Πιθανός

- ζουν

- Παρτίδα

- Χαμηλός

- κάνω

- Makers

- διαχειρίζεται

- πολοί

- χάρτη

- ταιριάζουν

- Θέματα

- ιατρικών

- μέθοδος

- MidJourney

- ενδέχεται να

- εκατομμύριο

- μοντέλο

- μοντέλα

- περισσότερο

- πλέον

- Δημοφιλέστερα

- όνομα

- Φυσικό

- Φυσική γλώσσα

- Νέα

- Νέα

- πολυάριθμες

- αντικειμένων

- διαδικτυακά (online)

- παράμετροι

- People

- τέλειος

- άδεια

- Πλάτων

- Πληροφορία δεδομένων Plato

- Πλάτωνα δεδομένα

- Δημοφιλής

- πορτρέτο

- δυνατός

- παρόν

- αρκετά

- πρόληψη

- princeton

- μυστικότητα

- ιδιωτικός

- ιδιωτικές πληροφορίες

- περιουσία

- Δικαιώματα ιδιοκτησίας

- προστατεύονται

- αποδεδειγμένη

- αύξηση

- ΣΠΑΝΙΟΣ

- Τιμές

- RE

- πραγματικός

- Πραγματικότητα

- αρχεία

- θυμάμαι

- έρευνα

- ερευνητές

- Απαλλάσσω

- δικαιώματα

- σχισμένο

- Είπε

- ίδιο

- φαίνεται

- ευαίσθητος

- σειρά

- Σέτς

- Πλευρές

- αφού

- ενιαίας

- Μέγεθος

- small

- μικρότερος

- λογισμικό

- μερικοί

- κάτι

- σταθερότητα

- σταθερός

- Ακόμη

- κατάστημα

- Μελέτη

- τέτοιος

- Τεχνολογία

- Η

- τους

- επομένως

- ώρα

- φορές

- προς την

- πολύ

- εργαλεία

- Τρένο

- εκπαιδευμένο

- Εκπαίδευση

- μοναδικός

- πανεπιστήμιο

- Πανεπιστήμιο της Καλιφόρνια

- us

- χρήση

- Χρήστες

- συνήθως

- Παραλλαγή

- Ve

- προειδοποίηση

- αν

- Ποιό

- ενώ

- Ο ΟΠΟΊΟΣ

- χωρίς

- Εργασία

- εργαζόμενος

- θα

- zephyrnet

- Ζυρίχη