Εισαγωγή

Μετά την κυκλοφορία των μοντέλων Llama και Mistral, τα ανοιχτού κώδικα LLM τράβηξαν τα φώτα της δημοσιότητας από το OpenAI. Έκτοτε, έχουν κυκλοφορήσει πολλά μοντέλα με βάση την αρχιτεκτονική Llama και Mistral, τα οποία αποδίδουν ισάξια με ιδιόκτητα μοντέλα όπως GPT-3.5 Turbo, Claude, Gemini κ.λπ. Ωστόσο, αυτά τα μοντέλα είναι πολύ μεγάλα για να χρησιμοποιηθούν σε καταναλωτικό υλικό.

Αλλά πρόσφατα, έχει εμφανιστεί μια νέα κατηγορία LLMs. Αυτά είναι τα LLM στην κατηγορία παραμέτρων sub-7B. Λιγότερες παράμετροι τα καθιστούν αρκετά συμπαγή ώστε να λειτουργούν σε καταναλωτικό υλικό, διατηρώντας παράλληλα την απόδοση συγκρίσιμη με τα μοντέλα 7B. Μοντέλα όπως το Tiny-Llama-1B, το Phi-2 της Microsoft και το Qwen-3b της Alibaba μπορούν να είναι εξαιρετικά υποκατάστατα μεγαλύτερων μοντέλων για τοπική εκτέλεση ή ανάπτυξη στο edge. Ταυτόχρονα, η λεπτομέρεια είναι ζωτικής σημασίας για την αξιοποίηση των καλύτερων δυνατοτήτων από οποιοδήποτε βασικό μοντέλο για οποιεσδήποτε μεταγενέστερες εργασίες.

Εδώ, θα διερευνήσουμε πώς να τελειοποιήσετε μια βάση Μοντέλο Tiny-Llama σε ένα καθαρισμένο σύνολο δεδομένων Alpaca.

Στόχοι μάθησης

- Κατανοήστε τη λεπτομέρεια και τις διάφορες μεθόδους της.

- Μάθετε για τα εργαλεία και τις τεχνικές για αποτελεσματική λεπτομέρεια.

- Μάθετε για το WandB για την καταγραφή αρχείων καταγραφής εκπαίδευσης.

- Βελτιώστε το Tiny-Llama στο σύνολο δεδομένων Alpaca στο Colab.

Αυτό το άρθρο δημοσιεύθηκε ως μέρος του Data Science Blogathon.

Πίνακας περιεχομένων

Τι είναι το LLM Fine-Tuning;

Η τελειοποίηση είναι η διαδικασία που κάνει ένα προεκπαιδευμένο μοντέλο να μάθει νέες γνώσεις. Το προεκπαιδευμένο μοντέλο είναι ένα μοντέλο γενικής χρήσης που εκπαιδεύεται σε μεγάλο όγκο δεδομένων. Ωστόσο, στις περισσότερες περιπτώσεις, αποτυγχάνουν να αποδώσουν όπως προβλέπεται και η λεπτομέρεια είναι ο πιο αποτελεσματικός τρόπος προσαρμογής του μοντέλου σε συγκεκριμένες περιπτώσεις χρήσης. Για παράδειγμα, βάση LLMs τα πηγαίνετε καλά στη δημιουργία κειμένου με QA με μία στροφή, αλλά δυσκολεύεστε με συνομιλίες πολλαπλών στροφών όπως μοντέλα συνομιλίας.

Τα βασικά μοντέλα πρέπει να εκπαιδεύονται σε μεταγραφές διαλόγων για να μπορούν να διεξάγουν συνομιλίες πολλαπλών στροφών. Η λεπτή ρύθμιση είναι απαραίτητη για τη διαμόρφωση προεκπαιδευμένων μοντέλων σε διαφορετικά avatar. Η ποιότητα των μοντέλων με ακρίβεια εξαρτάται από την ποιότητα των δεδομένων και τις δυνατότητες των βασικών μοντέλων. Υπάρχουν πολλοί τρόποι για τη μοντελοποίηση του μικροσυντονισμού, όπως LoRA, QLoRA κ.λπ.

Ας δούμε εν συντομία αυτές τις έννοιες.

LoRA

Το LoRA σημαίνει Low-rank Adaptation, μια δημοφιλής τεχνική λεπτομέρειας στην οποία επιλέγουμε μερικές εκπαιδεύσιμες παραμέτρους αντί να ενημερώνουμε όλες τις παραμέτρους μέσω μιας προσέγγισης χαμηλής κατάταξης των αρχικών πινάκων βάρους. Το μοντέλο LoRA μπορεί να βελτιστοποιηθεί ταχύτερα σε λιγότερο υπολογιστικό υλικό.

QLoRA

Το QLoRA ή το Quantized LoRA είναι ένα βήμα πιο πέρα από το LoRA. Αντί για ένα μοντέλο πλήρους ακρίβειας, κβαντίζει τα βάρη του μοντέλου σε χαμηλότερη ακρίβεια κινητής υποδιαστολής πριν από την εφαρμογή του LoRA. Η κβαντοποίηση είναι η διαδικασία μείωσης των υψηλότερων τιμών bit σε χαμηλότερες τιμές. Μια διαδικασία κβαντοποίησης 4 bit περιλαμβάνει την κβαντοποίηση των βαρών των 16 bit σε τιμές float 4 bit.

Η κβαντοποίηση του μοντέλου οδηγεί σε σημαντική μείωση του μεγέθους του μοντέλου με συγκρίσιμη ακρίβεια με το αρχικό μοντέλο. Στο QLoRA, παίρνουμε ένα κβαντισμένο μοντέλο και εφαρμόζουμε το LoRA σε αυτό. Τα μοντέλα μπορούν να κβαντιστούν με πολλούς τρόπους, όπως μέσω llama.cpp, AWQ, bitsandbytes κ.λπ.

Βελτιστοποίηση με το Unsloth

Το Unsloth είναι μια πλατφόρμα ανοιχτού κώδικα για τη γρήγορη ρύθμιση των δημοφιλών μοντέλων μεγάλων γλωσσών. Υποστηρίζει δημοφιλείς LLMs, συμπεριλαμβανομένων των Llama-2 και Mistral, και των παραγώγων τους όπως Yi, Open-hermes, κ.λπ. Εφαρμόζει προσαρμοσμένους πυρήνες triton και έναν χειροκίνητο back-prop κινητήρα για τη βελτίωση της ταχύτητας της εκπαίδευσης του μοντέλου.

Εδώ, θα χρησιμοποιήσουμε το Unsloth για να βελτιστοποιήσουμε ένα βασικό κβαντισμένο μοντέλο Tiny-Llama 4 bit στο Αιγοκάμηλος σύνολο δεδομένων. Το μοντέλο κβαντοποιείται με bit και byte και οι πυρήνες βελτιστοποιούνται με το Triton του OpenAI.

Καταγραφή με WandB

Στη μηχανική μάθηση, είναι σημαντικό να καταγράφονται οι μετρήσεις εκπαίδευσης και αξιολόγησης. Αυτό μας δίνει μια πλήρη εικόνα της διαδρομής του τρένου. Βάρη και προκαταλήψεις Το (WandB) είναι μια βιβλιοθήκη ανοιχτού κώδικα για οπτικοποίηση και παρακολούθηση πειραμάτων μηχανικής μάθησης. Διαθέτει μια αποκλειστική εφαρμογή ιστού για την οπτικοποίηση μετρήσεων εκπαίδευσης σε πραγματικό χρόνο. Μας επιτρέπει επίσης να διαχειριζόμαστε κεντρικά τα μοντέλα παραγωγής. Θα χρησιμοποιήσουμε το WandB μόνο για να παρακολουθήσουμε την πορεία μικρορύθμισης Tiny-Llama.

Για να χρησιμοποιήσετε το WandB, εγγραφείτε για έναν δωρεάν λογαριασμό και δημιουργήστε έναν Κλειδί API.

Τώρα, ας αρχίσουμε να τελειοποιούμε το μοντέλο μας.

Πώς να ρυθμίσετε το Tiny-Llama;

Η μικρορύθμιση είναι μια βαριά εργασία. Απαιτεί ένα μηχάνημα με 10-15 GB VRAM ή μπορείτε να χρησιμοποιήσετε το δωρεάν χρόνο εκτέλεσης GPU Tesla T4 της Colab.

Τώρα εγκαταστήστε το Unsloth και το WandB

%%capture

import torch

major_version, minor_version = torch.cuda.get_device_capability()

!pip install wandb

if major_version >= 8:

# Use this for new GPUs like Ampere, Hopper GPUs (RTX 30xx, RTX 40xx, A100, H100, L40)

!pip install "unsloth[colab_ampere] @ git+https://github.com/unslothai/unsloth.git"

else:

# Use this for older GPUs (V100, Tesla T4, RTX 20xx)

!pip install "unsloth[colab] @ git+https://github.com/unslothai/unsloth.git"

passΤο επόμενο πράγμα είναι να φορτώσετε το 4-bit κβαντισμένο προεκπαιδευμένο μοντέλο με το Unsloth.

from unsloth import FastLanguageModel

import torch

max_seq_length = 4096 # Choose any! We auto support RoPE Scaling internally!

dtype = None # None for auto detection. Float16 for Tesla T4, V100, Bfloat16 for Ampere+

load_in_4bit = True # Use 4bit quantization to reduce memory usage. Can be False.

model, tokenizer = FastLanguageModel.from_pretrained(

model_name = "unsloth/tinyllama-bnb-4bit", # "unsloth/tinyllama" for 16bit loading

max_seq_length = max_seq_length,

dtype = dtype,

load_in_4bit = load_in_4bit,

)Αυτό θα εγκαταστήσει το μοντέλο τοπικά. Το μέγεθος μοντέλου 4 bit θα είναι περίπου 760 MB.

Τώρα εφαρμόστε PEFT στο μοντέλο 4-bit Tiny-Llama.

model = FastLanguageModel.get_peft_model(

model,

r = 32, # Choose any number > 0 ! Suggested 8, 16, 32, 64, 128

target_modules = ["q_proj", "k_proj", "v_proj", "o_proj",

"gate_proj", "up_proj", "down_proj",],

lora_alpha = 32,

lora_dropout = 0, # Currently only supports dropout = 0

bias = "none", # Currently only supports bias = "none"

use_gradient_checkpointing = True, # @@@ IF YOU GET OUT OF MEMORY - set to True @@@

random_state = 3407,

use_rslora = False, # We support rank stabilized LoRA

loftq_config = None, # And LoftQ

)Προετοιμασία δεδομένων

Το επόμενο βήμα είναι να προετοιμάσετε το σύνολο δεδομένων για τελειοποίηση. Όπως ανέφερα προηγουμένως, θα χρησιμοποιήσουμε ένα καθαρισμένο Δεδομένα αλπακά. Αυτή είναι μια καθαρισμένη έκδοση του αρχικού δεδομένων Alpaca. Ακολουθεί τη μορφή εντολής-εισόδου-απόκρισης. Εδώ είναι ένα παράδειγμα δεδομένων Alpaca

Τώρα, ας ετοιμάσουμε τα δεδομένα μας.

@title prepare data

#alpaca_prompt = """Below is an instruction that describes a task, paired with an input that

provides further context.

Write a response that appropriately completes the request.

### Instruction:

{}

### Input:

{}

### Response:

{}"""

EOS_TOKEN = tokenizer.eos_token

def formatting_prompts_func(examples):

instructions = examples["instruction"]

inputs = examples["input"]

outputs = examples["output"]

texts = []

for instruction, input, output in zip(instructions, inputs, outputs):

# Must add EOS_TOKEN, otherwise your generation will go on forever!

text = alpaca_prompt.format(instruction, input, output) + EOS_TOKEN

texts.append(text)

return { "text" : texts, }

pass

from datasets import load_dataset

dataset = load_dataset("yahma/alpaca-cleaned", split = "train")

dataset = dataset.map(formatting_prompts_func, batched = True,)Τώρα, χωρίστε τα δεδομένα σε δεδομένα αμαξοστοιχίας και αξιολόγησης. Έχω λάβει μικρά δεδομένα αξιολόγησης καθώς τα μεγαλύτερα δεδομένα επιβραδύνουν την εκπαίδευση.

dataset_dict = dataset.train_test_split(test_size=0.004)Διαμόρφωση WandB

Τώρα, διαμορφώστε τα βάρη και τις προκαταλήψεις στον τρέχοντα χρόνο εκτέλεσης.

# @title wandb init

import wandb

wandb.login()Δώστε το κλειδί API για να συνδεθείτε στο WandB όταν σας ζητηθεί.

Ρύθμιση μεταβλητών περιβάλλοντος.

%env WANDB_WATCH=all

%env WANDB_SILENT=trueΜοντέλο τρένων

Μέχρι στιγμής, φορτώσαμε το μοντέλο 4 bit, δημιουργήσαμε τη διαμόρφωση LoRA, ετοιμάσαμε το σύνολο δεδομένων και ρυθμίσαμε το WandB. Το επόμενο βήμα είναι να εκπαιδεύσετε το μοντέλο στα δεδομένα. Για αυτό, πρέπει να ορίσουμε έναν εκπαιδευτή από τη βιβλιοθήκη Trl. Θα χρησιμοποιήσουμε το SFTrainer από την Trl. Αλλά πριν από αυτό, αρχικοποιήστε το WandB και ορίστε τα κατάλληλα ορίσματα εκπαίδευσης.

import os

from trl import SFTTrainer

from transformers import TrainingArguments

from transformers.utils import logging

import wandb

logging.set_verbosity_info()

project_name = "tiny-llama"

entity = "wandb"

# os.environ["WANDB_LOG_MODEL"] = "checkpoint"

wandb.init(project=project_name, name = "tiny-llama-unsloth-sft")Επιχειρήματα εκπαίδευσης

args = TrainingArguments(

per_device_train_batch_size = 2,

per_device_eval_batch_size=2,

gradient_accumulation_steps = 4,

evaluation_strategy="steps",

warmup_ratio = 0.1,

num_train_epochs = 1,

learning_rate = 2e-5,

fp16 = not torch.cuda.is_bf16_supported(),

bf16 = torch.cuda.is_bf16_supported(),

optim = "adamw_8bit",

weight_decay = 0.1,

lr_scheduler_type = "linear",

seed = 3407,

output_dir = "outputs",

report_to="wandb", # enable logging to W&B

# run_name="tiny-llama-alpaca-run", # name of the W&B run (optional)

logging_steps=1, # how often to log to W&B

logging_strategy = 'steps',

save_total_limit=2,

)Αυτό είναι σημαντικό για την προπόνηση. Για να διατηρήσετε τη χρήση της GPU σε χαμηλά επίπεδα, διατηρήστε χαμηλά τα βήματα συσσώρευσης αμαξοστοιχίας, παρτίδας και κλίσης. Το logging_steps είναι ο αριθμός των βημάτων πριν από την καταγραφή των μετρήσεων στο WandB.

Τώρα, αρχικοποιήστε το SFTTrainer.

trainer = SFTTrainer(

model = model,

tokenizer = tokenizer,

train_dataset = dataset_dict["train"],

eval_dataset=dataset_dict["test"],

dataset_text_field = "text",

max_seq_length = max_seq_length,

dataset_num_proc = 2,

packing = True, # Packs short sequences together to save time!

args = args,

)Τώρα, ξεκινήστε την προπόνηση.

trainer_stats = trainer.train()

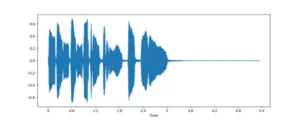

wandb.finish()Κατά τη διάρκεια του προγράμματος εκπαίδευσης, το WandB θα παρακολουθεί τις μετρήσεις εκπαίδευσης και αξιολόγησης. Επισκέπτεστε τον συγκεκριμένο σύνδεσμο του πίνακα ελέγχου και τον βλέπετε σε πραγματικό χρόνο.

Αυτό είναι ένα στιγμιότυπο οθόνης από την εκτέλεση μου σε ένα σημειωματάριο Colab.

Η ταχύτητα εκπαίδευσης θα εξαρτηθεί από πολλούς παράγοντες, συμπεριλαμβανομένων των μεγεθών δεδομένων εκπαίδευσης και αξιολόγησης, του μεγέθους της αμαξοστοιχίας και της αντίστοιχης παρτίδας και του αριθμού των εποχών. Εάν αντιμετωπίζετε προβλήματα με τη χρήση της GPU, δοκιμάστε να μειώσετε τα μεγέθη βημάτων συσσώρευσης παρτίδας και διαβάθμισης. Μέγεθος παρτίδας τρένου = batch_size_per_device * gradient_accumulation_steps. Και ο αριθμός των βημάτων βελτιστοποίησης = συνολικά δεδομένα εκπαίδευσης/μέγεθος παρτίδας. Μπορείτε να παίξετε με τις παραμέτρους και να δείτε ποια λειτουργεί καλύτερα.

Μπορείτε να απεικονίσετε την απώλεια εκπαίδευσης και αξιολόγησης της προπόνησής σας στον πίνακα εργαλείων WandB.

Απώλεια τρένου

Eval Loss

Συμπεράσματα

Μπορείτε να αποθηκεύσετε τους προσαρμογείς LoRA τοπικά ή να τους σπρώξετε στο αποθετήριο HuggingFace.

model.save_pretrained("lora_model") # Local saving

# model.push_to_hub("your_name/lora_model", token = "...") # Online savingΜπορείτε επίσης να φορτώσετε το αποθηκευμένο μοντέλο από το δίσκο και να το χρησιμοποιήσετε για εξαγωγή συμπερασμάτων.

if False:

from unsloth import FastLanguageModel

model, tokenizer = FastLanguageModel.from_pretrained(

model_name = "lora_model", # YOUR MODEL YOU USED FOR TRAINING

max_seq_length = max_seq_length,

dtype = dtype,

load_in_4bit = load_in_4bit,

)

inputs = tokenizer(

[

alpaca_prompt.format(

"capital of France?", # instruction

"", # input

"", # output - leave this blank for a generation!

)

]*1, return_tensors = "pt").to("cuda")

outputs = model.generate(**inputs, max_new_tokens = 64, use_cache = True)

tokenizer.batch_decode(outputs)Για απαντήσεις μοντέλου ροής.

from transformers import TextStreamer

text_streamer = TextStreamer(tokenizer)

_ = model.generate(**inputs, streamer = text_streamer, max_new_tokens = 64)Λοιπόν, όλα αυτά αφορούσαν την τελειοποίηση ενός μοντέλου Tiny-Llama με καταγραφή WandB.

Εδώ είναι η Σημειωματάριο Colab για το ίδιο.

Συμπέρασμα

Τα μικρά LLM μπορούν να είναι ωφέλιμα για την ανάπτυξη σε υλικό με περιορισμό υπολογιστών, όπως προσωπικούς υπολογιστές, κινητά τηλέφωνα και άλλα φορητά, κ.λπ. Η λεπτομέρεια επιτρέπει σε αυτά τα μοντέλα να αποδίδουν καλύτερα σε εργασίες κατάντη. Σε αυτό το άρθρο, μάθαμε πώς να βελτιστοποιούμε ένα μοντέλο βασικής γλώσσας σε ένα σύνολο δεδομένων.

Βασικές τακτικές

- Η μικρορύθμιση είναι η διαδικασία προσαρμογής ενός προεκπαιδευμένου μοντέλου σε μια συγκεκριμένη νέα εργασία.

- Το Tiny-Llama είναι ένα LLM με μόνο 1.1 δισεκατομμύρια παραμέτρους και εκπαιδεύεται σε 3 τρισεκατομμύρια μάρκες.

- Υπάρχουν διάφοροι τρόποι για να τελειοποιήσετε τα LLM, όπως το LoRA και το QLoRA.

- Το Unsloth είναι μια πλατφόρμα ανοιχτού κώδικα που παρέχει LLM βελτιστοποιημένα για CUDA για να επιταχύνει τη βελτίωση των LLM.

- Το Weights and Biases (WandB) είναι ένα εργαλείο για την παρακολούθηση και την αποθήκευση πειραμάτων ML.

Συχνές Ερωτήσεις

Α. Η λεπτομέρεια, στο πλαίσιο της μηχανικής μάθησης, ιδιαίτερα της βαθιάς μάθησης, είναι μια τεχνική όπου παίρνετε ένα προεκπαιδευμένο μοντέλο και το προσαρμόζετε σε μια νέα, συγκεκριμένη εργασία.

Α. Είναι δυνατό να βελτιστοποιήσετε μικρότερα LLM δωρεάν στο Colab μέσω της GPU Tesla T4 με QLoRA.

A. Η λεπτομέρεια ενισχύει σημαντικά την ικανότητα του LLM να εκτελεί εργασίες κατάντη, όπως παιχνίδι ρόλων, δημιουργία κώδικα κ.λπ.

A. Το Tiny-Llama που εκπαιδεύεται σε 3 τρισεκατομμύρια μάρκες είναι ένα LLM με παραμέτρους 1.1 B. Το μοντέλο υιοθετεί την αρχική αρχιτεκτονική Llama-2.

A. Το Unsloth είναι ένα εργαλείο ανοιχτού κώδικα που παρέχει ταχύτερη και πιο αποτελεσματική λεπτομέρεια στο LLM βελτιστοποιώντας τους πυρήνες GPU με το Triton.

Τα μέσα που εμφανίζονται σε αυτό το άρθρο δεν ανήκουν στο Analytics Vidhya και χρησιμοποιούνται κατά την κρίση του συγγραφέα.

Σχετικά:

- SEO Powered Content & PR Distribution. Ενισχύστε σήμερα.

- PlatoData.Network Vertical Generative Ai. Ενδυναμώστε τον εαυτό σας. Πρόσβαση εδώ.

- PlatoAiStream. Web3 Intelligence. Ενισχύθηκε η γνώση. Πρόσβαση εδώ.

- PlatoESG. Ανθρακας, Cleantech, Ενέργεια, Περιβάλλον, Ηλιακός, Διαχείριση των αποβλήτων. Πρόσβαση εδώ.

- PlatoHealth. Ευφυΐα βιοτεχνολογίας και κλινικών δοκιμών. Πρόσβαση εδώ.

- πηγή: https://www.analyticsvidhya.com/blog/2024/02/fine-tuning-a-tiny-llama-model-with-unsloth/

- :έχει

- :είναι

- :δεν

- :που

- $UP

- 1

- 11

- 12

- 15%

- 16

- 1b

- 258

- 32

- 7

- 8

- a

- A100

- Ικανός

- Σχετικα

- Λογαριασμός

- συσσώρευση

- ακρίβεια

- προσαρμόσει

- προσαρμογή

- προσθέτω

- Όλα

- επιτρέπει

- Επίσης

- ποσό

- an

- analytics

- Ανάλυση Vidhya

- και

- κάθε

- api

- app

- Εφαρμογή

- εφαρμόζοντας

- κατάλληλος

- κατάλληλα

- αρχιτεκτονική

- ΕΙΝΑΙ

- επιχειρήματα

- γύρω

- άρθρο

- AS

- At

- αυτόματη

- Avatars

- b

- βάση

- βασίζονται

- BE

- ήταν

- πριν

- παρακάτω

- ευεργετική

- οφέλη

- ΚΑΛΎΤΕΡΟΣ

- Καλύτερα

- προκατάληψη

- μεροληψίες

- Δισεκατομμύριο

- Κομμάτι

- bits

- κενό

- blogathon

- εν συντομία

- φέρω

- αλλά

- by

- CAN

- δυνατότητες

- ικανότητα

- κεφάλαιο

- περιπτώσεις

- κατηγορία

- chat

- Επιλέξτε

- τάξη

- κωδικός

- συμπαγής

- συγκρίσιμος

- πλήρης

- Ολοκληρώνει

- υπολογιστές

- έννοιες

- διαμόρφωση

- έχει ρυθμιστεί

- καταναλωτής

- Καταναλωτικό υλικό

- συμφραζόμενα

- συνομιλίες

- δημιουργία

- δημιουργήθηκε

- κρίσιμος

- Ρεύμα

- Τη στιγμή

- έθιμο

- παύλα

- ταμπλό

- ημερομηνία

- σύνολα δεδομένων

- αφιερωμένο

- βαθύς

- βαθιά μάθηση

- ορίζεται

- εξαρτηθεί

- εξαρτάται

- παρατάσσω

- ανάπτυξη

- Παράγωγα

- περιγράφει

- Ανίχνευση

- διαλόγους

- διαφορετικές

- διακριτικότητα

- do

- κάτω

- Νωρίτερα

- άκρη

- Αποτελεσματικός

- αποδοτικότητα

- αποτελεσματικός

- αλλιώς

- εμφάνιση

- ενεργοποιήσετε

- συνάντηση

- Κινητήρας

- Ενισχύει

- αρκετά

- οντότητα

- Περιβάλλον

- εποχές

- ειδικά

- ουσιώδης

- κ.λπ.

- Αιθέρας (ΕΤΗ)

- εκτίμηση

- παράδειγμα

- παραδείγματα

- πειράματα

- διερευνήσει

- παράγοντες

- ΑΠΟΤΥΓΧΑΝΩ

- ψευδής

- μακριά

- γρηγορότερα

- λίγοι

- λιγότερα

- φλοτέρ

- επιπλέων

- εξής

- Για

- μορφή

- Γαλλία

- Δωρεάν

- από

- περαιτέρω

- Gemini

- γενικού σκοπού

- γενεά

- παίρνω

- Git

- δεδομένου

- δίνει

- Go

- GPU

- GPU

- εξαιρετική

- υλικού

- Έχω

- εδώ

- Ψηλά

- υψηλότερο

- κρατήστε

- Πως

- Πώς να

- Ωστόσο

- HTTPS

- Πρόσωπο αγκαλιάς

- i

- if

- υλοποιεί

- εισαγωγή

- σημαντικό

- βελτίωση

- in

- Συμπεριλαμβανομένου

- εισαγωγή

- είσοδοι

- εγκαθιστώ

- αντί

- οδηγίες

- προορίζονται

- σε

- περιλαμβάνει

- θέματα

- IT

- jpg

- Διατήρηση

- τήρηση

- Κλειδί

- γνώση

- Kumar

- Γλώσσα

- large

- μεγαλύτερος

- Οδηγεί

- ΜΑΘΑΊΝΩ

- μάθει

- μάθηση

- Άδεια

- μείον

- Αφήνει

- Βιβλιοθήκη

- Μου αρέσει

- δημοσιότητα

- γραμμικός

- LINK

- Είδος μικρής καμήλας

- llm

- φορτίο

- φόρτωση

- τοπικός

- τοπικά

- κούτσουρο

- καταγραφεί

- ξύλευση

- off

- Χαμηλός

- χαμηλότερα

- μηχανή

- μάθηση μηχανής

- κάνω

- Κατασκευή

- διαχείριση

- Ταχύτητες

- max-width

- Εικόνες / Βίντεο

- Μνήμη

- που αναφέρθηκαν

- μέθοδοι

- Metrics

- ML

- Κινητό

- κινητά τηλέφωνα

- μοντέλο

- μοντέλα

- περισσότερο

- πιο αποτελεσματικό

- πλέον

- πολλαπλούς

- πρέπει

- my

- όνομα

- Ανάγκη

- Νέα

- επόμενη

- Ν/Α

- σημειωματάριο

- αριθμός

- of

- συχνά

- ηλικιωμένων

- on

- διαδικτυακά (online)

- αποκλειστικά

- ανοικτού κώδικα

- OpenAI

- βελτιστοποίηση

- βελτιστοποιημένη

- βελτιστοποίηση

- or

- πρωτότυπο

- OS

- ΑΛΛΑ

- αλλιώς

- δικός μας

- έξω

- παραγωγή

- εξόδους

- επί

- ανήκει

- πακέτα

- ζεύγη

- παράμετρος

- παράμετροι

- μέρος

- passieren

- εκτελέσει

- εκτέλεση

- προσωπικός

- Προσωπικοί υπολογιστές

- τηλέφωνα

- εικόνα

- πλατφόρμες

- Πλάτων

- Πληροφορία δεδομένων Plato

- Πλάτωνα δεδομένα

- Δοκιμάστε να παίξετε

- Σημείο

- Δημοφιλής

- δυνατός

- Ακρίβεια

- Προετοιμάστε

- έτοιμος

- διαδικασια μας

- παραγωγή

- ιδιόκτητο

- παρέχει

- δημοσιεύθηκε

- Σπρώξτε

- Ερωτήσεις και απαντήσεις

- ποιότητα

- R

- κατατάσσουν

- σε πραγματικό χρόνο

- μείωση

- μείωση

- μείωση

- κυκλοφόρησε

- Αποθήκη

- ζητήσει

- Απαιτεί

- έρευνα

- απάντησης

- απαντήσεις

- απόδοση

- Ρόλος

- rtx

- τρέξιμο

- ίδιο

- Αποθήκευση

- αποθηκεύονται

- οικονομία

- απολέπιση

- Επιστήμη

- δείτε

- σπόρος

- επιλέξτε

- σειρά

- Κοντά

- παρουσιάζεται

- υπογράψουν

- αφού

- Μέγεθος

- μεγέθη

- επιβραδύνει

- small

- μικρότερος

- συγκεκριμένες

- ταχύτητα

- διαίρεση

- στέκεται

- Εκκίνηση

- Βήμα

- Βήματα

- ροής

- Πάλη

- ουσιώδης

- τέτοιος

- υποστήριξη

- Υποστηρίζει

- Πάρτε

- λαμβάνεται

- Έργο

- εργασίες

- τεχνική

- τεχνικές

- Τέσλα

- δοκιμή

- κείμενο

- δημιουργία κειμένου

- από

- ότι

- Η

- τους

- Τους

- τότε

- Εκεί.

- Αυτοί

- αυτοί

- πράγμα

- αυτό

- Μέσω

- ώρα

- προς την

- μαζι

- ένδειξη

- κουπόνια

- πολύ

- πήρε

- εργαλείο

- εργαλεία

- δάδα

- Σύνολο

- τροχιά

- Παρακολούθηση

- Τρένο

- εκπαιδευμένο

- Εκπαίδευση

- μετασχηματιστές

- Τρισεκατομμύριο

- Τρίτωνος

- αληθής

- προσπαθώ

- ενημέρωση

- us

- Χρήση

- χρήση

- μεταχειρισμένος

- Αξίες

- εκδοχή

- μέσω

- Επίσκεψη

- φαντάζομαι

- ήταν

- Τρόπος..

- τρόπους

- we

- wearables

- ιστός

- webp

- βάρος

- ΛΟΙΠΌΝ

- ήταν

- Τι

- Τι είναι

- πότε

- Ποιό

- ενώ

- θα

- με

- λειτουργεί

- γράφω

- εσείς

- Σας

- zephyrnet