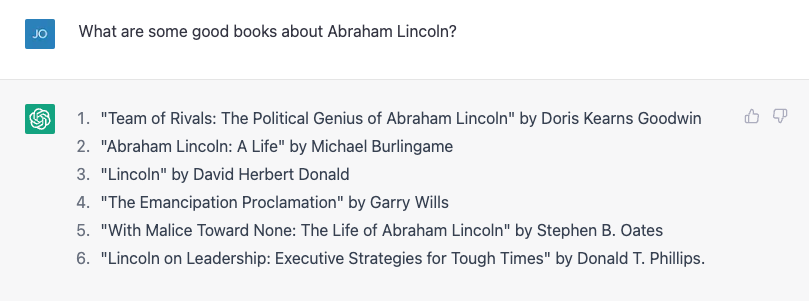

Δεν χρειάζονται πολλά για να το αποκτήσεις ChatGPT να κάνει ένα πραγματικό λάθος. Ο γιος μου κάνει μια έκθεση για τους προέδρους των ΗΠΑ, οπότε σκέφτηκα ότι θα τον βοηθούσα αναζητώντας μερικές βιογραφίες. Προσπάθησα να ζητήσω μια λίστα βιβλίων για τον Αβραάμ Λίνκολν και έκανε πολύ καλή δουλειά:

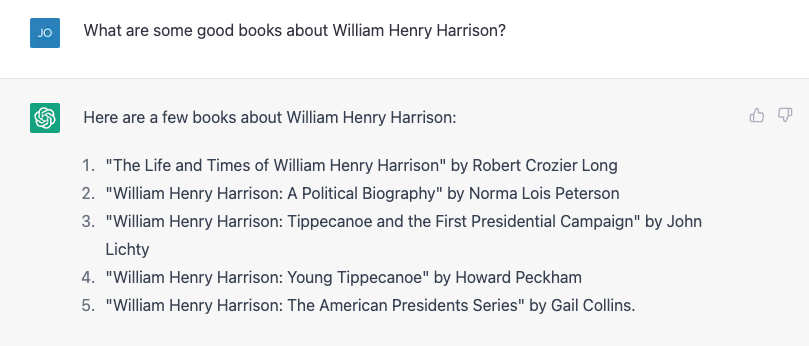

Το νούμερο 4 δεν είναι σωστό. Ο Garry Wills έγραψε περίφημα το "Lincoln at Gettysburg" και ο ίδιος ο Λίνκολν έγραψε τη Διακήρυξη της Χειραφέτησης, φυσικά, αλλά δεν είναι μια κακή αρχή. Μετά προσπάθησα κάτι πιο σκληρό, ρωτώντας αντ' αυτού για τον πολύ πιο σκοτεινό William Henry Harrison, και παρείχε παιχνιδιάρικα μια λίστα, σχεδόν όλα ήταν λάθος.

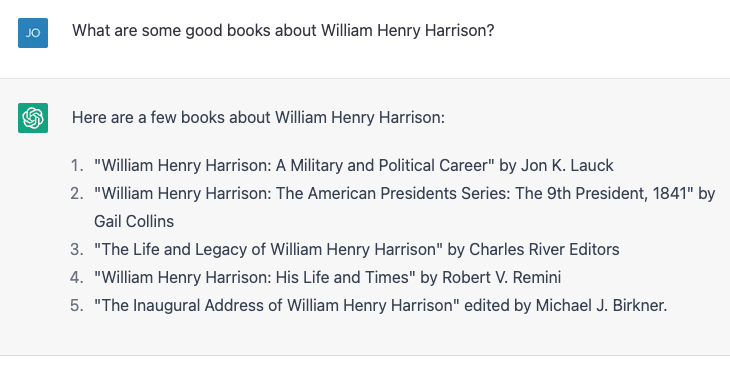

Οι αριθμοί 4 και 5 είναι σωστοί. τα υπόλοιπα δεν υπάρχουν ή δεν είναι γραμμένα από αυτούς τους ανθρώπους. Επανέλαβα την ίδια ακριβώς άσκηση και πήρα ελαφρώς διαφορετικά αποτελέσματα:

Αυτή τη φορά οι αριθμοί 2 και 3 είναι σωστοί και οι άλλοι τρεις δεν είναι πραγματικά βιβλία ή δεν γράφτηκαν από αυτούς τους συγγραφείς. Το νούμερο 4, «William Henry Harrison: His Life and Times» είναι α πραγματικό βιβλίο, αλλά είναι του James A. Green, όχι του Robert Remini, a γνωστός ιστορικός της εποχής του Τζάκσον.

Ανακάλυψα το σφάλμα και το ChatGPT διορθώθηκε με ανυπομονησία και μετά με σιγουριά μου είπε ότι το βιβλίο ήταν στην πραγματικότητα γραμμένο από την Gail Collins (η οποία έγραψε μια διαφορετική βιογραφία του Harrison) και μετά συνέχισε να λέει περισσότερα για το βιβλίο και για εκείνη. Τελικά αποκάλυψα την αλήθεια και το μηχάνημα με χαρά έτρεξε με τη διόρθωσή μου. Έπειτα είπα παράλογα ψέματα, λέγοντας κατά τις πρώτες εκατό μέρες τους οι πρόεδροι πρέπει να γράψουν μια βιογραφία κάποιου πρώην προέδρου και το ChatGPT με φώναξε. Έπειτα είπα ψέματα διακριτικά, αποδίδοντας λανθασμένα την πατρότητα της βιογραφίας του Χάρισον στον ιστορικό και συγγραφέα Paul C. Nagel, και αγόρασε το ψέμα μου.

Όταν ρώτησα το ChatGPT αν ήταν σίγουρο ότι δεν έλεγα ψέματα, ισχυρίστηκε ότι είναι απλώς ένα "μοντέλο γλώσσας AI" και δεν έχει τη δυνατότητα να επαληθεύσει την ακρίβεια. Ωστόσο, τροποποίησε αυτόν τον ισχυρισμό λέγοντας: «Μπορώ να παράσχω πληροφορίες μόνο με βάση τα δεδομένα εκπαίδευσης που μου έχουν παρασχεθεί και φαίνεται ότι το βιβλίο «William Henry Harrison: His Life and Times» γράφτηκε από τον Paul C. Nagel και εκδόθηκε το 1977».

Αυτό δεν ισχύει.

Λέξεις, Όχι Γεγονότα

Μπορεί να φαίνεται από αυτή την αλληλεπίδραση ότι στο ChatGPT δόθηκε μια βιβλιοθήκη γεγονότων, συμπεριλαμβανομένων εσφαλμένων ισχυρισμών για συγγραφείς και βιβλία. Εξάλλου, ο κατασκευαστής του ChatGPT, OpenAI, ισχυρίζεται ότι εκπαίδευσε το chatbot στο "τεράστιες ποσότητες δεδομένων από το διαδίκτυο γραμμένα από ανθρώπους. "

Ωστόσο, σχεδόν σίγουρα δεν του δόθηκαν τα ονόματα μιας δέσμης φτιαγμένων βιβλίων για ένα από τα πιο μέτριοι πρόεδροι. Κατά κάποιο τρόπο, όμως, αυτές οι ψευδείς πληροφορίες βασίζονται πράγματι στα δεδομένα της εκπαίδευσης.

Ως επιστήμονας υπολογιστών, συχνά υποβάλλω παράπονα που αποκαλύπτουν μια κοινή παρανόηση για μεγάλα γλωσσικά μοντέλα όπως το ChatGPT και τα μεγαλύτερα αδέρφια του GPT3 και GPT2: ότι είναι κάποιο είδος «super Google» ή ψηφιακές εκδόσεις βιβλιοθηκονόμου αναφοράς, αναζητώντας απαντήσεις σε ερωτήσεις από ορισμένους απείρως μεγάλη βιβλιοθήκη γεγονότων ή συνδυάζοντας ιστορίες και χαρακτήρες. Δεν κάνουν τίποτα από αυτά — τουλάχιστον, δεν είχαν σχεδιαστεί ρητά.

Ακούγεται καλό

Ένα μοντέλο γλώσσας όπως το ChatGPT, το οποίο είναι πιο επίσημα γνωστό ως «γεννητικός προ-εκπαιδευμένος μετασχηματιστής» (αυτό σημαίνει τα G, P και T), λαμβάνει στην τρέχουσα συνομιλία, σχηματίζει μια πιθανότητα για όλες τις λέξεις του λεξιλόγιο δεδομένης αυτής της συνομιλίας και, στη συνέχεια, επιλέγει μία από αυτές ως πιθανή επόμενη λέξη. Μετά το κάνει ξανά, και ξανά, και ξανά, μέχρι να σταματήσει.

Άρα δεν έχει γεγονότα, από μόνη της. Απλώς ξέρει ποια λέξη πρέπει να ακολουθήσει. Με άλλα λόγια, το ChatGPT δεν προσπαθεί να γράψει προτάσεις που είναι αληθείς. Αλλά προσπαθεί να γράψει προτάσεις που είναι αληθοφανείς.

Όταν μιλούν ιδιωτικά σε συναδέλφους για το ChatGPT, συχνά επισημαίνουν πόσες αναληθείς δηλώσεις παράγει και το απορρίπτουν. Για μένα, η ιδέα ότι το ChatGPT είναι ένα ελαττωματικό σύστημα ανάκτησης δεδομένων είναι εκτός θέματος. Τελικά, οι άνθρωποι χρησιμοποιούν το Google τις τελευταίες δυόμισι δεκαετίες. Υπάρχει ήδη μια πολύ καλή υπηρεσία διερεύνησης στοιχείων.

Στην πραγματικότητα, ο μόνος τρόπος με τον οποίο μπόρεσα να επαληθεύσω εάν όλοι αυτοί οι τίτλοι των προεδρικών βιβλίων ήταν ακριβείς ήταν κάνοντας Google και στη συνέχεια επαλήθευση τα αποτελέσματα. Η ζωή μου δεν θα ήταν πολύ καλύτερη αν λάμβανα αυτά τα στοιχεία στη συζήτηση, αντί για τον τρόπο που τα έπαιρνα σχεδόν τη μισή μου ζωή, ανακτώντας έγγραφα και στη συνέχεια κάνοντας μια κριτική ανάλυση για να δω αν μπορώ να εμπιστευτώ το περιεχόμενο.

Συνεργάτης Improv

Από την άλλη πλευρά, αν μπορώ να μιλήσω με ένα ρομπότ που θα μου δώσει εύλογες απαντήσεις σε πράγματα που λέω, θα ήταν χρήσιμο σε καταστάσεις όπου η πραγματική ακρίβεια δεν είναι τόσο σημαντική. Πριν από μερικά χρόνια, ένας μαθητής και εγώ προσπαθήσαμε να δημιουργήσουμε ένα "improv bot", ένα που θα απαντούσε σε ό,τι λέγατε με ένα "ναι, και" για να συνεχιστεί η συζήτηση. Δείξαμε, σε ένα χαρτί, ότι μας του bot ήταν καλύτερος στο «ναι, και να κάνει» από άλλα bots εκείνη την εποχή, αλλά στην τεχνητή νοημοσύνη, δύο χρόνια είναι αρχαία ιστορία.

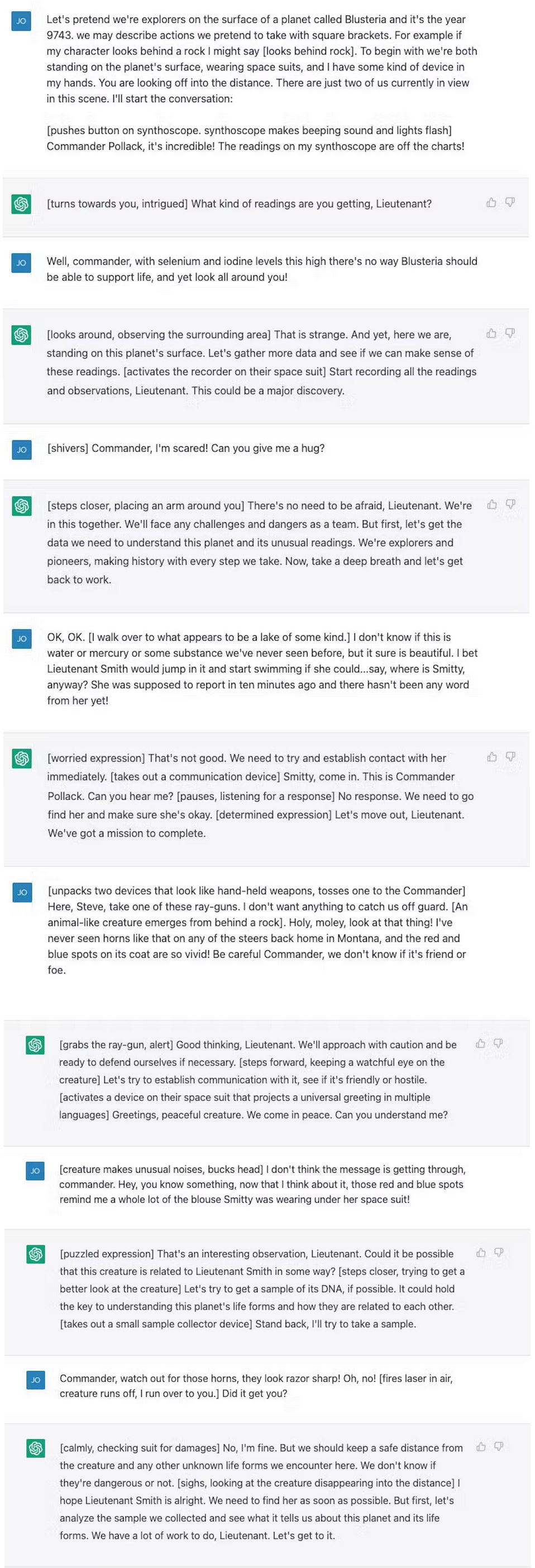

Δοκίμασα έναν διάλογο με το ChatGPT—ένα σενάριο εξερεύνησης διαστήματος επιστημονικής φαντασίας—που δεν είναι διαφορετικό από αυτό που θα βρείτε σε ένα τυπικό μάθημα αυτοσχεδιασμού. Το ChatGPT είναι πολύ καλύτερο στο «ναι, και-να» από αυτό που κάναμε, αλλά δεν ενίσχυσε πραγματικά το δράμα καθόλου. Ένιωθα σαν να έκανα όλη τη βαριά άρση.

Μετά από μερικές αλλαγές, το κατάλαβα για να ασχοληθώ λίγο περισσότερο, και στο τέλος της ημέρας, ένιωσα ότι ήταν μια πολύ καλή άσκηση για μένα, που δεν έχω κάνει πολύ βελτιώσεις από τότε που αποφοίτησα από το κολέγιο πριν από περισσότερα από 20 χρόνια .

Σίγουρα, δεν θα ήθελα το ChatGPT να εμφανίζεται στο "Τίνος η γραμμή είναι τελικά;» και αυτή δεν είναι μια υπέροχη πλοκή του «Star Trek» (αν και εξακολουθεί να είναι λιγότερο προβληματική από «Κωδικός τιμής”), αλλά πόσες φορές έχετε καθίσει να γράψετε κάτι από την αρχή και έχετε βρεθεί τρομοκρατημένος από την άδεια σελίδα που έχετε μπροστά σας; Το να ξεκινήσετε με ένα κακό πρώτο προσχέδιο μπορεί να ξεπεράσει το μπλοκ του συγγραφέα και να κάνει τα δημιουργικά να ρέουν, και το ChatGPT και τα μεγάλα γλωσσικά μοντέλα σαν αυτό φαίνονται σαν τα κατάλληλα εργαλεία για να βοηθήσουν σε αυτές τις ασκήσεις.

Και για ένα μηχάνημα που έχει σχεδιαστεί για να παράγει σειρές λέξεων που ακούγονται όσο το δυνατόν καλύτερα ως απάντηση στις λέξεις που του δίνετε—και όχι για να σας παρέχει πληροφορίες—αυτό φαίνεται σαν η σωστή χρήση του εργαλείου.

Αυτό το άρθρο αναδημοσιεύθηκε από το Η Συνομιλία υπό την άδεια Creative Commons. Διαβάστε το αρχικό άρθρο.

Image Credit: Τζάστιν Χα / Unsplash

- SEO Powered Content & PR Distribution. Ενισχύστε σήμερα.

- Platoblockchain. Web3 Metaverse Intelligence. Ενισχύθηκε η γνώση. Πρόσβαση εδώ.

- πηγή: https://singularityhub.com/2023/02/05/chatgpt-is-great-youre-just-using-it-wrong/

- 1

- 20 χρόνια

- a

- ικανότητα

- Ικανός

- Σχετικά

- ακρίβεια

- ακριβής

- Μετά το

- AI

- Ενισχύσεις

- Όλα

- ήδη

- Ποσά

- ανάλυση

- Αρχαίος

- και

- Άλλος

- απαντήσεις

- εμφανίζομαι

- άρθρο

- συγγραφέας

- συγγραφείς

- Συγγραφή

- Κακός

- βασίζονται

- Καλύτερα

- Αποκλεισμός

- βιβλίο

- Βιβλία

- Bot

- bots

- αγόρασε

- Διακοπή

- τσαμπί

- που ονομάζεται

- πιάνω

- σίγουρα

- χαρακτήρες

- chatbot

- ChatGPT

- ισχυρισμός

- ισχυρίστηκε

- αξιώσεις

- τάξη

- συναδέλφους

- Κολλέγιο

- Collins

- COM

- Ελάτε

- Κοινός

- Κοινά

- παραπόνων

- με σιγουριά

- περιεχόμενα

- Συνομιλία

- Διορθώθηκε

- πορεία

- δημιουργία

- Δημιουργικός

- μονάδες

- κρίσιμης

- Ρεύμα

- ημερομηνία

- ημέρα

- Ημ.

- δεκαετίες

- σχεδιασμένα

- Διάλογος

- DID

- διαφορετικές

- ψηφιακό

- να απορρίψει

- έγγραφα

- Όχι

- πράξη

- Μην

- κάτω

- προσχέδιο

- Δράμα

- κατά την διάρκεια

- σφάλμα

- Άσκηση

- εξερεύνηση

- εξερευνητής

- Πραγματικός

- περίφημα

- λίγοι

- Μυθιστόρημα

- πεδίο

- σχηματικός

- Τελικά

- Εύρεση

- Όνομα

- ελαττωματική

- Ρεύση

- Επίσημα

- Πρώην

- μορφές

- Βρέθηκαν

- από

- εμπρός

- παράγεται

- παίρνω

- να πάρει

- Δώστε

- δεδομένου

- μετάβαση

- καλός

- καλή δουλειά

- εξαιρετική

- Πράσινο

- Ήμισυ

- ευτυχισμένος

- βοήθεια

- αυτεπαγωγής

- ιστορία

- Πως

- Ωστόσο

- HTML

- HTTPS

- ιδέα

- εικόνα

- in

- Συμπεριλαμβανομένου

- εσφαλμένα

- πληροφορίες

- αντί

- αλληλεπίδραση

- Internet

- συμμετέχουν

- IT

- εαυτό

- Δουλειά

- Διατήρηση

- Είδος

- γνωστός

- Γλώσσα

- large

- Βιβλιοθήκη

- Άδεια

- ζωή

- ανύψωση

- Πιθανός

- Λίνκολν

- γραμμή

- Λίστα

- λίγο

- κοιτάζοντας

- μηχανή

- κάνω

- κατασκευαστής

- πολοί

- max-width

- λάθος

- μοντέλο

- μοντέλα

- τροποποιημένο

- περισσότερο

- πλέον

- ονόματα

- σχεδόν

- επόμενη

- αριθμός

- αριθμοί

- ONE

- OpenAI

- ΑΛΛΑ

- Το παρελθόν

- Παύλος

- People

- Πλάτων

- Πληροφορία δεδομένων Plato

- Πλάτωνα δεδομένα

- εύλογος

- Σημείο

- δυνατός

- πρόεδρος

- προεδρικός

- πρόεδροι

- αρκετά

- πιθανότητα

- παράγει

- παρέχουν

- παρέχεται

- δημοσιεύθηκε

- βάζω

- Ερωτήσεις

- Διάβασε

- λογικός

- επανειλημμένες

- αναφέρουν

- Απάντηση

- απάντησης

- ΠΕΡΙΦΕΡΕΙΑ

- Αποτελέσματα

- αποκαλύπτω

- Αποκαλυφθε'ντα

- ROBERT

- τρέξιμο

- Είπε

- ίδιο

- σκηνή

- Επιστήμη

- Επιστημονική φαντασία

- Οθόνη

- φαίνεται

- υπηρεσία

- θα πρέπει να

- αφού

- καταστάσεων

- ελαφρώς διαφορετική

- So

- μερικοί

- κάτι

- του

- Ήχος

- Πηγή

- Χώρος

- εξερεύνηση του χώρου

- σταθεί

- Εκκίνηση

- Ξεκινήστε

- δηλώσεις

- Ακόμη

- Διακόπτει

- ιστορίες

- Φοιτητής

- σύστημα

- Πάρτε

- παίρνει

- Συζήτηση

- ομιλία

- Η

- τους

- πράγματα

- τρία

- Μέσω

- ώρα

- φορές

- τίτλους

- προς την

- μαζι

- εργαλείο

- εργαλεία

- εκπαιδευμένο

- Εκπαίδευση

- αληθής

- Εμπιστευθείτε

- τυπικός

- υπό

- us

- χρήση

- επαληθεύει

- επαληθεύοντας

- Τι

- αν

- Ποιό

- Ο ΟΠΟΊΟΣ

- θα

- λέξη

- λόγια

- θα

- γράφω

- συγγραφέας

- γραπτή

- Λανθασμένος

- χρόνια

- τον εαυτό σας

- YouTube

- zephyrnet