Fremkomsten af kunstig intelligens (AI) skabte en bølge af bekymringer om sikkerhed og privatliv, især da disse teknologier bliver mere avancerede og integreret i vores daglige liv. Et af de mest fremtrædende eksempler på AI-teknologi er ChatGPT, en kunstig intelligens sprogmodel, som blev skabt af OpenAI og støttes af Microsoft. Hidtil har millioner af mennesker allerede brugt ChatGPT, siden det blev lanceret i november 2022.

I de seneste dage har søgninger efter "er ChatGPT sikkert?" er steget i vejret, da mennesker rundt om i verden giver udtryk for deres bekymringer over de potentielle risici forbundet med denne teknologi.

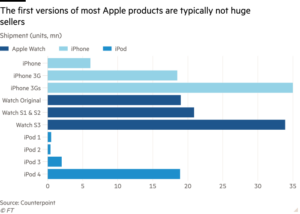

Ifølge data fra Google Trends, søgninger efter "er ChatGPT sikkert?" er steget med hele 614 % siden den 16. marts. Dataene blev opdaget af Cryptomaniaks.com, en førende kryptouddannelsesplatform, der er dedikeret til at hjælpe nybegyndere og cryptocurrency-begyndere med at forstå verden af blockchain og cryptocurrency.

Stigningen i søgninger efter information om ChatGPT-sikkerhed fremhæver behovet for større offentlig uddannelse og gennemsigtighed omkring AI-systemer og deres potentielle risici. Da AI-teknologi som ChatGPT fortsætter med at udvikle sig og integreres i vores daglige liv, er det vigtigt at løse de sikkerhedsproblemer, der opstår, da der kan være potentielle farer forbundet med at bruge ChatGPT eller enhver anden AI-chatbot.

ChatGPT er designet til at hjælpe brugere med at generere menneskelignende svar på deres forespørgsler og deltage i samtale. Så privatlivets fred er en af de mest væsentlige risici forbundet med at bruge ChatGPT. Når brugere interagerer med ChatGPT, kan de utilsigtet dele personlige oplysninger om sig selv, såsom deres navn, placering og andre følsomme data. Disse oplysninger kan være sårbare over for hacking eller andre former for cyberangreb.

En anden bekymring er muligheden for misinformation. ChatGPT er programmeret til at generere svar baseret på det input, det modtager fra brugere. Hvis inputtet er forkert eller vildledende, kan AI generere unøjagtige eller vildledende svar. Desuden kan AI-modeller fastholde skævheder og stereotyper, der er til stede i de data, de trænes på. Hvis de data, der bruges til at træne ChatGPT, inkluderer forudindtaget eller fordomsfuldt sprog, kan AI generere svar, der fastholder disse skævheder.

I modsætning til andre AI-assistenter som Siri eller Alexa, bruger ChatGPT ikke internettet til at finde svar. I stedet genererer den svar baseret på de mønstre og associationer, den har lært af den store mængde tekst, den blev trænet på. Den konstruerer en sætning ord for ord, og vælger den mest sandsynlige, baseret på dens dybe læringsteknikker, specifikt en neural netværksarkitektur kaldet en transformer, til at behandle og generere sprog.

ChatGPT er forudtrænet på en stor mængde tekstdata, herunder bøger, websteder og andet onlineindhold. Når en bruger indtaster en prompt eller et spørgsmål, bruger modellen sin forståelse af sproget og sin viden om konteksten af prompten til at generere et svar. Og det kommer endelig frem til et svar ved at lave en række gæt, hvilket er en del af grunden til, at det kan give dig forkerte svar.

Hvis ChatGPT er trænet i den kollektive skrivning af mennesker over hele verden, og fortsætter med at gøre det, mens det bliver brugt af mennesker, kan de samme skævheder, der findes i den virkelige verden, også optræde i modellen. Samtidig er denne nye og avancerede chatbot fremragende til at forklare komplekse begreber, hvilket gør den til et meget nyttigt og kraftfuldt værktøj til læring, men det er vigtigt ikke at tro på alt det siger. ChatGPT er bestemt ikke altid korrekt, ja, i hvert fald ikke endnu.

På trods af disse risici rummer AI-teknologi som ChatGPT et enormt potentiale til at revolutionere forskellige industrier, herunder blockchain. Brugen af kunstig intelligens i blockchain-teknologi har vundet indpas, især inden for områder som svindeldetektion, supply chain management og smarte kontrakter. Nye AI-drevne bots som f.eks KædeGPT, kan hjælpe nye blockchain-virksomheder med at fremskynde deres udviklingsproces.

Det er dog vigtigt at finde en balance mellem innovation og sikkerhed. Udviklere, brugere og regulatorer skal arbejde sammen om at skabe retningslinjer, der sikrer ansvarlig udvikling og implementering af AI-teknologi.

I de seneste nyheder er Italien blevet det første vestlige land til at blokere avanceret chatbot ChatGPT. Den italienske databeskyttelsesmyndighed udtrykte bekymringer om privatlivets fred i forbindelse med modellen. Regulatoren sagde, at den ville forbyde og undersøge OpenAI "med øjeblikkelig virkning."

Microsoft har brugt milliarder af dollars på det og tilføjede AI-chatværktøjet til Bing i sidste måned. Det har også sagt, at det planlægger at integrere en version af teknologien i sine Office-apps, herunder Word, Excel, PowerPoint og Outlook.

Samtidig har mere end 1,000 kunstig intelligens eksperter, forskere og bagmænd sluttet sig til en opfordring til en øjeblikkelig pause i skabelsen af AI'er i mindst seks måneder, så mulighederne og farerne ved systemer som GPT-4 kan studeres ordentligt.

Kravet fremsættes i et åbent brev underskrevet af store AI-aktører, herunder: Elon Musk, der var med til at stifte OpenAI, forskningslaboratoriet ansvarlig for ChatGPT og GPT-4; Emad Mostaque, der grundlagde London-baserede Stability AI; og Steve Wozniak, medstifter af Apple.

Det åbne brev udtrykte bekymring over at være i stand til at kontrollere, hvad der ikke fuldt ud kan forstås:

"De seneste måneder har set AI-laboratorier låst i et ude af kontrol kapløb om at udvikle og implementere stadigt mere kraftfulde digitale hjerner, som ingen - ikke engang deres skabere - kan forstå, forudsige eller pålideligt kontrollere. Kraftfulde AI-systemer bør kun udvikles, når vi er sikre på, at deres virkninger vil være positive, og deres risici vil være håndterbare."

Opfordringen til en øjeblikkelig pause i oprettelsen af AI'er viser behovet for at studere mulighederne og farerne ved systemer som ChatGPT og GPT-4. Da AI-teknologien fortsætter med at udvikle sig og integreres i vores daglige liv, er det afgørende at adressere sikkerhedsproblemer og sikre ansvarlig udvikling og implementering af AI.

Stigende bekymringer om ChatGPT-sikkerhed fremhæver behovet for offentlig uddannelse og gennemsigtighed om AI-risici kilde https://blockchainconsultants.io/rising-concerns-about-chatgpt-safety-highlight-the-need-for-public-education-and-transparency -on-ai-risici/

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- Platoblokkæde. Web3 Metaverse Intelligence. Viden forstærket. Adgang her.

- Kilde: https://blockchainconsultants.io/rising-concerns-about-chatgpt-safety-highlight-the-need-for-public-education-and-transparency-on-ai-risks/?utm_source=rss&utm_medium=rss&utm_campaign=rising-concerns-about-chatgpt-safety-highlight-the-need-for-public-education-and-transparency-on-ai-risks

- :er

- 000

- 1

- 2022

- a

- I stand

- Om

- absolutte

- præcis

- tværs

- tilføjet

- adresse

- adressering

- fremme

- fremskreden

- AI

- AI chatbot

- AI-systemer

- Alexa

- allerede

- altid

- beløb

- ,

- besvare

- svar

- vises

- Apple

- Indløs

- passende

- apps

- arkitektur

- ER

- områder

- omkring

- Ankommer

- kunstig

- kunstig intelligens

- Kunstig intelligens (AI)

- AS

- hjælpe

- forbundet

- foreninger

- At

- myndighed

- Backed

- Balance

- Forbyde

- baseret

- BE

- bliver

- begyndere

- være

- Tro

- mellem

- milliarder

- Bing

- Bloker

- blockchain

- blockchain-virksomheder

- Blockchain teknologi

- krop

- Bøger

- bots

- virksomheder

- by

- ringe

- kaldet

- CAN

- kan ikke

- kapaciteter

- sikkert

- kæde

- chatbot

- ChatGPT

- Medstifter

- kollektive

- komplekse

- begreber

- Bekymring

- Bekymringer

- sikker

- indhold

- sammenhæng

- fortsætter

- kontrakter

- kontrol

- Samtale

- kunne

- land

- skabe

- oprettet

- skabelse

- skabere

- afgørende

- krypto

- Kryptouddannelse

- cryptocurrency

- dagligt

- farer

- data

- Dage

- dc

- dedikeret

- dyb

- dyb læring

- Efterspørgsel

- demonstrerer

- indsætte

- implementering

- beskrivelse

- konstrueret

- Detektion

- udvikle

- udviklet

- udviklere

- Udvikling

- digital

- opdaget

- Er ikke

- dollars

- drevet

- Uddannelse

- effekt

- effekter

- smergel

- engagerende

- sikre

- sikring

- Går ind i

- væsentlig

- Endog

- NOGENSINDE

- at alt

- eksempler

- Excel

- fremragende

- eksperter

- forklarer

- udtrykt

- ekstern

- Endelig

- Finde

- Fornavn

- Til

- formularer

- Grundlagt

- bedrageri

- bedrageri afsløring

- fra

- fuldt ud

- Endvidere

- vinder

- generere

- genererer

- generere

- Giv

- google tendenser

- større

- retningslinjer

- hacking

- Have

- hjælpe

- hjælpe

- Fremhæv

- højdepunkter

- besidder

- http

- HTTPS

- Mennesker

- umiddelbar

- enorme

- vigtigt

- in

- forkert

- omfatter

- Herunder

- øget

- industrier

- oplysninger

- Innovation

- indgang

- i stedet

- integrere

- integreret

- Intelligens

- interagere

- Internet

- undersøge

- IT

- Italiensk

- Italiensk vin

- ITS

- sluttede

- jpg

- viden

- lab

- Labs

- Sprog

- Efternavn

- lanceret

- førende

- lærte

- læring

- brev

- LG

- ligesom

- Sandsynlig

- begrænsninger

- LINK

- Lives

- placering

- låst

- lavet

- større

- Making

- ledelse

- Marts

- massive

- microsoft

- millioner

- sind

- misinformation

- afbøde

- model

- modeller

- Måned

- måned

- mere

- mest

- navn

- Behov

- netværk

- Neural

- neurale netværk

- Ny

- nyheder

- november

- of

- Office

- on

- ONE

- online

- åbent

- OpenAI

- Andet

- Outlook

- del

- især

- mønstre

- Mennesker

- personale

- planlægning

- perron

- plato

- Platon Data Intelligence

- PlatoData

- spillere

- positiv

- potentiale

- vigtigste

- forudsige

- præsentere

- Beskyttelse af personlige oplysninger

- behandle

- programmerede

- fremtrædende

- korrekt

- forudsat

- offentlige

- spørgsmål

- Løb

- ægte

- virkelige verden

- grund

- modtager

- nylige

- regulator

- Regulators

- relaterede

- forskning

- forskere

- svar

- ansvarlige

- Revolutionerende

- Rise

- stigende

- risici

- sikker

- Sikkerhed

- Said

- samme

- siger

- udvælgelse

- følsom

- dømme

- Series

- Del

- bør

- underskrevet

- signifikant

- siden

- siri

- SIX

- Seks måneder

- Smart

- Smarte kontrakter

- So

- indtil nu

- Kilde

- specifikt

- brugt

- Stabilitet

- Steve

- Steve Wozniak

- strejke

- studeret

- Studere

- sådan

- forsyne

- forsyningskæde

- supply chain management

- bølge

- Systemer

- teknikker

- Teknologier

- Teknologier

- at

- verdenen

- deres

- selv

- Disse

- tid

- til

- sammen

- værktøj

- trækkraft

- Tog

- uddannet

- Gennemsigtighed

- Tendenser

- sand

- forstå

- forståelse

- forstået

- enestående

- brug

- Bruger

- brugere

- forskellige

- Vast

- udgave

- synlig

- Voice

- Sårbar

- W3

- Wave

- websites

- GODT

- Western

- Hvad

- som

- WHO

- vilje

- med

- ord

- Arbejde

- arbejde sammen

- world

- ville

- skrivning

- Forkert

- zephyrnet