Billede genereret med Leonardo.Ai

I dette enorme landskab af kunstig intelligens opstod en revolutionær kraft i form af store sprogmodeller (LLMS). Det er ikke kun et buzzword, men vores fremtid. Deres evne til at forstå og generere menneskelignende tekst bragte dem i søgelyset, og nu er det blevet et af de hotteste forskningsområder. Forestil dig en chatbot, der kan reagere på dig, som om du taler med dine venner eller forestiller dig et indholdsgenereringssystem, som det bliver svært at skelne mellem, om det er skrevet af et menneske eller en AI. Hvis ting som dette interesserer dig, og du ønsker at dykke længere ind i hjertet af LLM'er, så er du på det rigtige sted. Jeg har samlet en omfattende liste over ressourcer lige fra informative artikler, kurser og GitHub-repositories til relevante forskningsartikler, der kan hjælpe dig med at forstå dem bedre. Uden yderligere forsinkelse, lad os kickstarte vores fantastiske rejse i LLM'ernes verden.

Billede af Polina Tankilevitch på Pexels

1. Deep Learning Specialization – Coursera

Forbindelse: Deep Learning Specialisering

Beskrivelse: Dyb læring danner rygraden i LLM'er. Dette omfattende kursus undervist af Andrew Ng dækker de væsentlige emner i neurale netværk, det grundlæggende i computersyn og naturlig sprogbehandling, og hvordan du strukturerer dine maskinlæringsprojekter.

2. Stanford CS224N: NLP med Deep Learning – YouTube

Forbindelse: Stanford CS224N: NLP med Deep Learning

Beskrivelse: Det er en guldgrube af viden og giver en grundig introduktion til banebrydende forskning i deep learning til NLP.

3. HuggingFace Transformers Course – HuggingFace

Forbindelse: HuggingFace Transformers kursus

Beskrivelse: Dette kursus underviser i NLP ved at bruge biblioteker fra HuggingFace-økosystemet. Det dækker den indre funktion og brugen af følgende biblioteker fra HuggingFace:

- transformers

- Tokenizere

- datasæt

- Accelerate

4. ChatGPT Prompt Engineering for udviklere – Coursera

Forbindelse: ChatGPT Prompt Engineering kursus

Beskrivelse: ChatGPT er en populær LLM, og dette kursus deler den bedste praksis og de væsentlige principper for at skrive effektive prompter for bedre generering af svar.

Billede genereret med Leonardo.Ai

1. LLM University – Sammenhæng

Forbindelse: LLM Universitet

Beskrivelse: Cohere tilbyder et specialiseret kursus for at mestre LLM'er. Deres sekventielle spor, som dækker de teoretiske aspekter af NLP, LLM'er og deres arkitektur i detaljer, er målrettet begyndere. Deres ikke-sekventielle vej er for erfarne personer, der er mere interesserede i de praktiske anvendelser og brugscases af disse kraftfulde modeller frem for deres interne arbejde.

2. Stanford CS324: Store sprogmodeller – Stanford-websted

Forbindelse: Stanford CS324: Store sprogmodeller

Beskrivelse: Dette kursus dykker dybere ned i disse modellers forviklinger. Du vil udforske det grundlæggende, teori, etik og praktiske aspekter af disse modeller, mens du også får nogle praktiske erfaringer.

3. Princeton COS597G: Understanding Large Language Models – Princeton Site

Forbindelse: Forståelse af store sprogmodeller

Beskrivelse: Det er et kursus på kandidatniveau, der tilbyder en omfattende læseplan, hvilket gør det til et fremragende valg til dybdegående læring. Du vil udforske det tekniske grundlag, muligheder og begrænsninger af modeller som BERT, GPT, T5-modeller, blandings-af-ekspert-modeller, genfindingsbaserede modeller osv.

4. ETH Zürich: Store sprogmodeller (LLM'er) – RycoLab

Forbindelse: ETH Zürich: Store sprogmodeller

Beskrivelse: Dette nydesignede kursus tilbyder en omfattende udforskning af LLM'er. Dyk ned i sandsynlighedsgrundlag, neurale netværksmodellering, træningsprocesser, skaleringsteknikker og kritiske diskussioner om sikkerhed og potentielt misbrug.

5. Full Stack LLM Bootcamp – The Full Stack

Forbindelse: Full Stack LLM Bootcamp

Beskrivelse: Full Stack LLM-bootcampen er et brancherelevant kursus, der dækker emner såsom hurtige ingeniørteknikker, LLM-grundlæggende, implementeringsstrategier og brugergrænsefladedesign, hvilket sikrer, at deltagerne er velforberedte til at bygge og implementere LLM-applikationer.

6. Finjustering af store sprogmodeller – Coursera

Forbindelse: Finjustering af store sprogmodeller

Beskrivelse: Finjustering er teknikken, der giver dig mulighed for at tilpasse LLM'er til dine specifikke behov. Ved at gennemføre dette kursus vil du forstå, hvornår du skal anvende finjustering, dataforberedelse til finjustering, og hvordan du træner din LLM på nye data og evaluerer dens ydeevne.

Billede genereret med Leonardo.Ai

1. Hvad laver ChatGPT ... og hvorfor virker det? – Steven Wolfram

Forbindelse: Hvad laver ChatGPT ... og hvorfor virker det?

Beskrivelse: Denne korte bog er skrevet af Steven Wolfram, en kendt videnskabsmand. Han diskuterer de grundlæggende aspekter af ChatGPT, dets oprindelse i neurale net og dets fremskridt inden for transformatorer, opmærksomhedsmekanismer og naturlig sprogbehandling. Det er en fremragende læsning for en, der er interesseret i at udforske mulighederne og begrænsningerne ved LLM'er.

2. Understanding Large Language Models: A Transformative Reading List – Sebastian Raschka

Forbindelse: Forståelse af store sprogmodeller: En transformativ læseliste

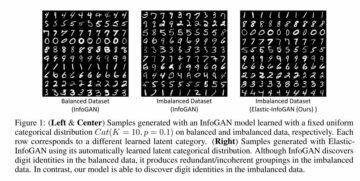

Beskrivelse: Den indeholder en samling af vigtige forskningsartikler og giver en kronologisk læseliste, startende fra tidlige artikler om tilbagevendende neurale netværk (RNN'er) til den indflydelsesrige BERT-model og videre. Det er en uvurderlig ressource for forskere og praktikere at studere udviklingen af NLP og LLM'er.

3. Artikelserie: Store sprogmodeller – Jay Alammar

Forbindelse: Artikelserie: Store sprogmodeller

Beskrivelse: Jay Alammars blogs er en skatkammer af viden for alle, der studerer store sprogmodeller (LLM'er) og transformatorer. Hans blogs skiller sig ud for deres unikke blanding af visualiseringer, intuitive forklaringer og omfattende dækning af emnet.

4. Opbygning af LLM-applikationer til produktion – Chip Huyen

Forbindelse: Opbygning af LLM-applikationer til produktion

Beskrivelse: I denne artikel diskuteres udfordringerne ved at producere LLM'er. Det giver indsigt i opgavekomponering og viser lovende use cases. Enhver, der er interesseret i praktiske LLM'er, vil finde det virkelig værdifuldt.

Billede af RealToughCandy.com på Pexels

1. Awesome-LLM ( 9k ⭐ )

Forbindelse: Fantastisk-LLM

Beskrivelse: Det er en kurateret samling af artikler, rammer, værktøjer, kurser, tutorials og ressourcer fokuseret på store sprogmodeller (LLM'er), med særlig vægt på ChatGPT.

2. LLMsPracticalGuide (6.9k ⭐)

Forbindelse: De praktiske vejledninger til store sprogmodeller

Beskrivelse: Det hjælper praktiserende læger med at navigere i det vidtstrakte landskab af LLM'er. Det er baseret på undersøgelsespapiret med titlen: Udnyttelse af kraften i LLM'er i praksis: En undersøgelse om ChatGPT og videre , denne blog.

3. LLMSurvey ( 6.1k ⭐ )

Forbindelse: LLMSurvey

Beskrivelse: Det er en samling af undersøgelsespapirer og ressourcer baseret på papiret med titlen: En undersøgelse af store sprogmodeller. Den indeholder også en illustration af den tekniske udvikling af GPT-seriens modeller samt en evolutionær graf over forskningsarbejdet udført på LLaMA.

4. Awesome Graph-LLM ( 637 ⭐ )

Forbindelse: Awesome-Graph-LLM

Beskrivelse: Det er en værdifuld kilde for folk, der er interesseret i krydsfeltet mellem grafbaserede teknikker og LLM'er. det giver en samling af forskningsartikler, datasæt, benchmarks, undersøgelser og værktøjer, der dykker ned i dette nye felt.

5. Awesome Langchain (5.4k ⭐)

Forbindelse: fantastisk langkæde

Beskrivelse: LangChain er den hurtige og effektive ramme for LLM-projekter, og dette lager er omdrejningspunktet for at spore initiativer og projekter relateret til LangChains økosystem.

- "En komplet undersøgelse om ChatGPT i AIGC-æra” – Det er et godt udgangspunkt for begyndere i LLM'er. Det dækker omfattende den underliggende teknologi, applikationer og udfordringer ved ChatGPT.

- "En undersøgelse af store sprogmodeller” – Det dækker de seneste fremskridt inden for LLM'er specifikt inden for de fire store aspekter af fortræning, tilpasningsjustering, udnyttelse og kapacitetsevaluering.

- "Udfordringer og anvendelser af store sprogmodeller” – Diskuterer udfordringerne ved LLM'er og de succesrige anvendelsesområder for LLM'er.

- "Opmærksomhed er alt hvad du behøver” – Transformers fungerer som grundstenen for GPT og andre LLM'er, og dette papir introducerer transformatorarkitekturen.

- "Den kommenterede transformator” – En ressource fra Harvard University, der giver en detaljeret og kommenteret forklaring af Transformer-arkitekturen, som er fundamental for mange LLM'er.

- "Den illustrerede transformator” – En visuel guide, der hjælper dig med at forstå Transformer-arkitekturen i dybden, hvilket gør komplekse koncepter mere tilgængelige.

- "BERT: Fortræning af dybe tovejstransformere til sprogforståelse” – Dette papir introducerer BERT, en meget indflydelsesrig LLM, der sætter nye benchmarks for adskillige NLP-opgaver (Natural Language Processing).

I denne artikel har jeg samlet en omfattende liste over ressourcer, der er vigtige for at mestre store sprogmodeller (LLM'er). Læring er dog en dynamisk proces, og videndeling er i centrum. Hvis du har yderligere ressourcer i tankerne, som du mener bør være en del af denne omfattende liste, så tøv ikke med at dele dem i kommentarfeltet. Dine bidrag kan være uvurderlige for andre på deres læringsrejse og skabe et interaktivt og samarbejdende rum for videnberigelse.

Kanwal Mehreen er en håbefuld softwareudvikler med en stor interesse for datavidenskab og anvendelser af AI i medicin. Kanwal blev valgt som Google Generation Scholar 2022 for APAC-regionen. Kanwal elsker at dele teknisk viden ved at skrive artikler om populære emner og brænder for at forbedre repræsentationen af kvinder i den teknologiske industri.

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk dig selv. Adgang her.

- PlatoAiStream. Web3 intelligens. Viden forstærket. Adgang her.

- PlatoESG. Kulstof, CleanTech, Energi, Miljø, Solenergi, Affaldshåndtering. Adgang her.

- PlatoHealth. Bioteknologiske og kliniske forsøgs intelligens. Adgang her.

- Kilde: https://www.kdnuggets.com/a-comprehensive-list-of-resources-to-master-large-language-models?utm_source=rss&utm_medium=rss&utm_campaign=a-comprehensive-list-of-resources-to-master-large-language-models

- :har

- :er

- :ikke

- 2022

- 4k

- a

- evne

- Om

- tilgængelig

- tilpasse

- tilpasning

- Yderligere

- fremskridt

- fremskridt

- AI

- AI i medicin

- aigc

- Alle

- tillader

- også

- forbløffende

- an

- ,

- Andrew

- andrew ng

- enhver

- nogen

- APAC

- Anvendelse

- applikationer

- Indløs

- arkitektur

- ER

- områder

- artikel

- artikler

- AS

- aspekter

- aspirerende

- At

- opmærksomhed

- Backbone

- baseret

- Grundlæggende

- BE

- bliver

- bliver

- begyndere

- Tro

- Benchmarks

- BEDSTE

- bedste praksis

- Bedre

- Beyond

- Blanding

- Blog

- blogs

- bog

- bragte

- bygge

- Bygning

- men

- buzzword

- by

- Camp

- CAN

- kapaciteter

- Kapacitet

- tilfælde

- udfordringer

- chatbot

- ChatGPT

- chip

- valg

- kollaborativ

- samling

- KOMMENTAR

- fuldføre

- færdiggøre

- komplekse

- omfattende

- computer

- Computer Vision

- begreber

- gennemført

- indeholder

- indhold

- bidrag

- kunne

- kursus

- Coursera

- kurser

- dækning

- dækker

- Oprettelse af

- kritisk

- cs

- kurateret

- Curriculum

- banebrydende

- data

- Dataforberedelse

- datalogi

- datasæt

- dyb

- dyb læring

- dybere

- deeplearning

- forsinkelse

- dykke

- indsætte

- implementering

- dybde

- Design

- konstrueret

- detail

- detaljeret

- Udvikler

- udviklere

- svært

- drøftet

- diskussioner

- skelne

- dyk

- gør

- gør

- Don

- dynamisk

- Tidligt

- økosystem

- Effektiv

- effektiv

- opstået

- smergel

- vægt

- Engineering

- sikring

- envision

- væsentlig

- etc.

- ETH

- ETH Zurich

- etik

- evaluere

- evaluering

- evolution

- fremragende

- ekspansiv

- erfaring

- erfarne

- forklaring

- udforskning

- udforske

- Udforskning

- omfattende

- FAST

- felt

- Finde

- ende

- fokuserede

- efter

- Til

- Tving

- formular

- formularer

- Foundation

- Fonde

- fire

- Framework

- rammer

- venner

- fra

- fuld

- Fuld stak

- fundamental

- Fundamentals

- yderligere

- fremtiden

- vinder

- indsamlede

- generere

- genereret

- generation

- GitHub

- graf

- stor

- vejlede

- Guides

- hands-on

- Harvard

- Harvard Universitet

- Have

- he

- Hjerte

- hjælpe

- hjælper

- stærkt

- hans

- hotteste

- Hvordan

- How To

- Men

- HTML

- http

- HTTPS

- Hub

- KrammerFace

- menneskelig

- i

- if

- billede

- vigtigt

- forbedring

- in

- dybdegående

- enkeltpersoner

- industrien

- Indflydelsesrig

- informative

- initiativer

- indsigt

- interaktiv

- interesse

- interesseret

- grænseflade

- interne

- vejkryds

- ind

- snørklede

- Introducerer

- Introduktion

- intuitiv

- uvurderlig

- IT

- ITS

- rejse

- jpg

- lige

- KDnuggets

- Keen

- viden

- landskab

- Sprog

- stor

- læring

- lad

- biblioteker

- ligesom

- begrænsninger

- Liste

- Llama

- elsker

- maskine

- machine learning

- større

- Making

- mange

- Master

- mastering

- Matter

- mekanismer

- medicin

- tankerne

- misbruge

- model

- modellering

- modeller

- mere

- Natural

- Naturligt sprog

- Natural Language Processing

- Naviger

- behov

- Nets

- netværk

- net

- Neural

- neurale netværk

- neurale netværk

- Ny

- nyligt

- NLP

- nu

- talrige

- of

- Tilbud

- on

- ONE

- or

- oprindelser

- Andet

- Andre

- vores

- ud

- Papir

- papirer

- del

- deltagere

- særlig

- lidenskabelige

- sti

- Mennesker

- ydeevne

- Place

- plato

- Platon Data Intelligence

- PlatoData

- Vær venlig

- Punkt

- Populær

- potentiale

- magt

- vigtigste

- Praktisk

- Praktiske anvendelser

- praksis

- praksis

- forberedelse

- Princeton

- principper

- behandle

- Processer

- forarbejdning

- produktion

- projekter

- lovende

- prompter

- giver

- spænder

- hellere

- Læs

- Læsning

- virkelig

- nylige

- tilbagevendende

- region

- relaterede

- relevant

- Kendt

- Repository

- repræsentation

- forskning

- forskere

- ressource

- Ressourcer

- Svar

- svar

- revolutionerende

- højre

- s

- skalering

- Scholar

- Videnskab

- Videnskabsmand

- Sektion

- sikkerhed

- valgt

- Series

- tjener

- sæt

- Del

- Aktier

- Kort

- bør

- Software

- nogle

- Nogen

- Kilde

- Space

- specialiserede

- specifikke

- specifikt

- Spotlight

- stable

- stå

- Stanford

- Starter

- steven

- STONE

- strategier

- struktur

- Studere

- studere

- emne

- vellykket

- sådan

- Kortlægge

- systemet

- T

- taler

- målrettet

- Opgaver

- opgaver

- undervist

- tech

- tech industri

- Teknisk

- teknik

- teknikker

- Teknologier

- tekst

- end

- at

- Grundlæggende

- navet

- verdenen

- deres

- Them

- derefter

- teoretisk

- teori

- Disse

- ting

- denne

- titlen

- til

- værktøjer

- Emner

- mod

- spor

- Tog

- Kurser

- transformative

- transformer

- transformers

- trend

- tutorials

- underliggende

- forstå

- forståelse

- enestående

- universitet

- Brug

- brug

- Bruger

- Brugergrænseflade

- brugergrænsefladesign

- ved brug af

- Værdifuld

- Vast

- Ve

- vision

- visuel

- ønsker

- var

- GODT

- Hvad

- Hvad er

- hvornår

- hvorvidt

- som

- mens

- hvorfor

- vilje

- med

- uden

- Dame

- kvinder inden for teknik

- Arbejde

- arbejder

- arbejdssteder

- world

- skriver

- skrivning

- skriftlig

- dig

- Din

- zephyrnet

- Zürich