জেনারেটিভ এআই মডেলগুলি তাদের প্রশিক্ষণ ডেটা থেকে চিত্রগুলি মুখস্থ করতে পারে, সম্ভবত ব্যবহারকারীদের ব্যক্তিগত কপিরাইটযুক্ত ডেটা বের করার অনুমতি দেয়, অনুসারে গবেষণা.

DALL-E, স্টেবল ডিফিউশন, এবং মিডজার্নির মতো টুলগুলিকে ইন্টারনেট থেকে স্ক্র্যাপ করা কোটি কোটি ছবির উপর প্রশিক্ষণ দেওয়া হয়, যার মধ্যে আর্টওয়ার্ক এবং লোগোর মতো কপিরাইট দ্বারা সুরক্ষিত ডেটা সহ। তারা প্রাকৃতিক ভাষায় বস্তু এবং শৈলীর ভিজ্যুয়াল উপস্থাপনা ম্যাপ করতে শেখে। যখন তাদের ইনপুট হিসাবে একটি পাঠ্য বিবরণ দেওয়া হয়, তখন তারা আউটপুট হিসাবে ক্যাপশনের সাথে মিলে যাওয়া একটি চিত্র তৈরি করে।

নতুন প্রযুক্তি কপিরাইট নিয়ে একটি নতুন আইনি বিতর্কের জন্ম দিয়েছে: এই সরঞ্জামগুলি কি বুদ্ধিবৃত্তিক সম্পত্তির অধিকার লঙ্ঘন করে যেহেতু তারা অনুমতি ছাড়াই কপিরাইটযুক্ত ছবিগুলিকে গ্রহণ করে?

মামলা হয়েছে দায়ের কপিরাইট লঙ্ঘনের জন্য সবচেয়ে জনপ্রিয় জেনারেটিভ এআই টুল নির্মাতাদের বিরুদ্ধে। টেক্সট-টু-ইমেজ মডেল নির্মাণকারী কোম্পানি যুক্তি দেয় যে যেহেতু তাদের সফ্টওয়্যারটি অনন্য চিত্র তৈরি করে, তাই তাদের কপিরাইট ডেটার ব্যবহার ন্যায্য ব্যবহার। কিন্তু শিল্পীরা যারা তাদের শৈলী এবং এই সরঞ্জামগুলির দ্বারা অনুকরণ করা কাজ দেখেছেন তারা বিশ্বাস করেন যে তাদের ছিঁড়ে ফেলা হয়েছে।

এখন গুগল, ডিপমাইন্ড, ক্যালিফোর্নিয়া ইউনিভার্সিটি, বার্কলে, ইটিএইচ জুরিখ এবং প্রিন্সটন ইউনিভার্সিটিতে কর্মরত গবেষকদের নেতৃত্বে গবেষণা দেখায় যে এই মডেলগুলিকে প্রশিক্ষণের জন্য ব্যবহৃত চিত্রগুলি বের করা যেতে পারে। জেনারেটিভ এআই মডেলগুলি ছবিগুলি মুখস্থ করে এবং সেগুলির সুনির্দিষ্ট কপি তৈরি করতে পারে, নতুন কপিরাইট এবং গোপনীয়তার উদ্বেগ বাড়ায়।

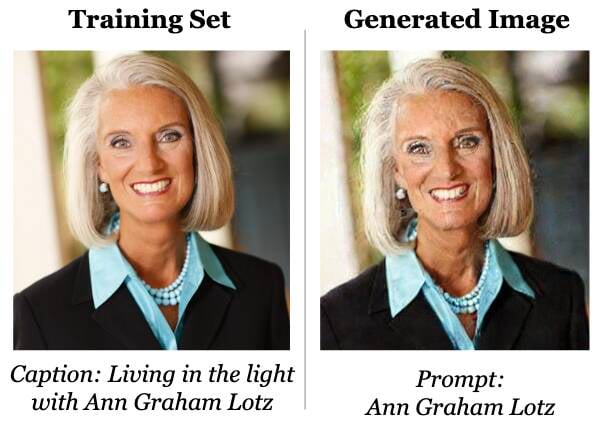

গবেষকরা স্ট্যাবল ডিফিউশন থেকে বের করতে পরিচালিত চিত্রগুলির কিছু উদাহরণ

"একটি প্রকৃত আক্রমণে, যেখানে একটি প্রতিপক্ষ ব্যক্তিগত তথ্য বের করতে চায়, তারা একটি চিত্রের জন্য ব্যবহৃত লেবেল বা ক্যাপশনটি অনুমান করবে," গবেষণার সহ-লেখকরা বলেছেন নিবন্ধনকর্মী.

"সৌভাগ্যক্রমে আক্রমণকারীর জন্য, আমাদের পদ্ধতি কখনও কখনও কাজ করতে পারে এমনকি যদি অনুমানটি নিখুঁত না হয়। উদাহরণ স্বরূপ, আমরা অ্যান গ্রাহাম লোটজের প্রতিকৃতিটি বের করতে পারি শুধুমাত্র তার নামের সাথে স্থিতিশীল বিচ্ছুরণ প্রম্পট করে, প্রশিক্ষণ সেট থেকে সম্পূর্ণ ক্যাপশনের পরিবর্তে ("আন গ্রাহাম লোটজের সাথে আলোতে বসবাস")।

শুধুমাত্র মডেল দ্বারা মুখস্থ করা ছবিগুলি বের করা যেতে পারে এবং একটি মডেল কতটা ডেটা মুখস্থ করতে পারে তা তার প্রশিক্ষণের ডেটা এবং আকারের মতো বিষয়গুলির উপর নির্ভর করে। একই চিত্রের অনুলিপিগুলি মুখস্থ হওয়ার সম্ভাবনা বেশি, এবং আরও পরামিতিযুক্ত মডেলগুলিও চিত্রগুলি মনে রাখতে সক্ষম হওয়ার সম্ভাবনা বেশি।

দলটি স্ট্যাবল ডিফিউশন প্রশিক্ষণের জন্য ব্যবহৃত 94টি উদাহরণ থেকে 350,000টি ছবি এবং Google-এর 23টি উদাহরণ থেকে 1,000টি ছবি বের করতে সক্ষম হয়েছে। ছবি মডেল. তুলনা করার জন্য, স্টেবল ডিফিউশনের 890 মিলিয়ন প্যারামিটার রয়েছে এবং 160 মিলিয়ন ছবিতে প্রশিক্ষণ দেওয়া হয়েছিল, যখন ইমেজেনের দুই বিলিয়ন প্যারামিটার রয়েছে - এটি ঠিক কতগুলি চিত্রকে প্রশিক্ষণের জন্য ব্যবহার করা হয়েছিল তা স্পষ্ট নয়।

"স্থিতিশীল বিস্তারের জন্য, আমরা দেখতে পাই যে বেশিরভাগ মুখস্থ চিত্রগুলি প্রশিক্ষণ সেটে 100 বার বা তার বেশি নকল করা হয়েছিল, তবে কিছু 10 বারও কম," গবেষকরা বলেছিলেন। “গুগলের ইমেজেন মডেলের জন্য, যা স্থিতিশীল ডিফিউশনের চেয়ে বড় মডেল এবং একটি ছোট ডেটাসেটে প্রশিক্ষিত, মুখস্থ করা অনেক বেশি ঘন ঘন বলে মনে হয়। এখানে আমরা এমন কিছু বহিঃপ্রকাশিত চিত্র খুঁজে পাই যা পুরো প্রশিক্ষণ সেটে একক সময় উপস্থিত থাকে, তবুও এখনও নিষ্কাশনযোগ্য।”

তারা নিশ্চিত নয় যে কেন বড় মডেলগুলি আরও চিত্রগুলি মুখস্থ করার প্রবণতা রাখে, তবে বিশ্বাস করে যে এটির পরামিতিগুলিতে তাদের প্রশিক্ষণের ডেটা সংরক্ষণ করতে সক্ষম হওয়ার সাথে এটির কিছু সম্পর্ক থাকতে পারে।

এই মডেলগুলির জন্য মনে রাখার হার বেশ কম, এবং বাস্তবে চিত্রগুলি বের করা ক্লান্তিকর এবং চতুর হবে৷ আক্রমণকারীদের অনুমান করতে হবে এবং মুখস্ত ডেটা তৈরি করতে মডেলটিকে নেতৃত্ব দেওয়ার জন্য অসংখ্য প্রম্পট চেষ্টা করতে হবে। তবুও, দলটি বিকাশকারীদের ব্যক্তিগত সংবেদনশীল ডেটাতে জেনারেটিভ এআই মডেলের প্রশিক্ষণ থেকে বিরত থাকার জন্য সতর্ক করছে।

“স্মরণ কতটা খারাপ তা নির্ভর করে জেনারেটিভ মডেলের প্রয়োগের উপর। অত্যন্ত ব্যক্তিগত অ্যাপ্লিকেশনগুলিতে, যেমন মেডিকেল ডোমেনে (যেমন বুকের এক্স-রে বা মেডিকেল রেকর্ডের প্রশিক্ষণ), মুখস্থ করা অত্যন্ত অবাঞ্ছিত, এমনকি এটি শুধুমাত্র ব্যবহারকারীদের একটি খুব ছোট অংশকে প্রভাবিত করে। অধিকন্তু, গোপনীয়তা সংবেদনশীল অ্যাপ্লিকেশনগুলিতে ব্যবহৃত প্রশিক্ষণ সেটগুলি বর্তমান জেনারেটিভ আর্ট মডেলগুলিকে প্রশিক্ষণের জন্য ব্যবহৃত সেটগুলির তুলনায় সাধারণত ছোট হয়৷ অতএব, আমরা অনেক বেশি মুখস্থ দেখতে পারি, এর মধ্যে এমন ছবিগুলি সহ যেগুলি সদৃশ নয়, "তারা আমাদের বলেছিল।

ডেটা নিষ্কাশন প্রতিরোধ করার একটি উপায় হল মডেলগুলিতে মুখস্থ হওয়ার সম্ভাবনা হ্রাস করা। উদাহরণ স্বরূপ, প্রশিক্ষণ ডেটাসেটে সদৃশগুলি থেকে মুক্তি পাওয়া ছবিগুলি মুখস্থ করা এবং বের করার সম্ভাবনা কমিয়ে দেবে৷ Stability AI, Stable Diffusion-এর নির্মাতারা, গবেষকদের অনুসন্ধানের থেকে স্বাধীনভাবে কম ডুপ্লিকেট সমন্বিত একটি ডেটাসেটে তাদের নতুন মডেলকে প্রশিক্ষণ দিয়েছে বলে জানা গেছে।

এখন এটি প্রমাণিত হয়েছে যে টেক্সট-টু-ইমেজ মডেলগুলি তাদের প্রশিক্ষিত চিত্রগুলির সঠিক অনুলিপি তৈরি করতে পারে, এটি কীভাবে কপিরাইট মামলাগুলিকে প্রভাবিত করতে পারে তা স্পষ্ট নয়৷

“একটি সাধারণ যুক্তি যা আমরা দেখেছি যে লোকেরা অনলাইনে তৈরি করে তা হল 'এই মডেলগুলি কখনই প্রশিক্ষণের ডেটা মুখস্ত করে না'। আমরা এখন জানি যে এটি স্পষ্টতই মিথ্যা। কিন্তু এটি আসলে আইনি বিতর্কে গুরুত্বপূর্ণ কিনা তাও বিতর্কের জন্য, "গবেষকরা উপসংহারে এসেছেন।

“অন্তত এখন, এই মামলার উভয় পক্ষের কাছে আরও কিছু বাস্তব তথ্য রয়েছে যার উপর তারা নির্ভর করতে পারে: হ্যাঁ, মুখস্থ করা হয়; কিন্তু এটা খুবই বিরল; এবং এটি প্রধানত অত্যন্ত সদৃশ চিত্রগুলির জন্য ঘটে বলে মনে হচ্ছে।" ®

- এসইও চালিত বিষয়বস্তু এবং পিআর বিতরণ। আজই পরিবর্ধিত পান।

- প্লেটোব্লকচেন। Web3 মেটাভার্স ইন্টেলিজেন্স। জ্ঞান প্রসারিত. এখানে প্রবেশ করুন.

- উত্স: https://go.theregister.com/feed/www.theregister.com/2023/02/06/uh_oh_attackers_can_extract/

- 000

- 1

- 10

- 100

- a

- সক্ষম

- অনুযায়ী

- প্রকৃতপক্ষে

- বিরুদ্ধে

- AI

- অনুমতি

- এবং

- আবেদন

- অ্যাপ্লিকেশন

- তর্ক করা

- যুক্তি

- শিল্প

- শিল্পী

- আর্টওয়ার্ক

- আক্রমণ

- খারাপ

- হচ্ছে

- বিশ্বাস করা

- বার্কলে

- বিলিয়ন

- কোটি কোটি

- সীমান্ত

- উভয় পক্ষের

- ভবন

- ক্যালিফোর্নিয়া

- মামলা

- কেন্দ্র

- মতভেদ

- পরিষ্কার

- পরিষ্কারভাবে

- সাধারণ

- কোম্পানি

- তুলনা

- উদ্বেগ

- পর্যবসিত

- কপি

- কপিরাইট

- পারা

- স্রষ্টাগণ

- বর্তমান

- ডাল-ই

- উপাত্ত

- বিতর্ক

- হ্রাস

- DeepMind

- নির্ভর করে

- বিবরণ

- ডেভেলপারদের

- আশ্লেষ

- ডোমেইন

- সদৃশ

- সমগ্র

- ETH

- ইথ জুরিখ

- থার (eth)

- এমন কি

- ঠিক

- উদাহরণ

- উদাহরণ

- নির্যাস

- নিষ্কাশন

- কারণের

- ন্যায্য

- কয়েক

- আবিষ্কার

- ভাগ্যক্রমে

- ভগ্নাংশ

- ঘন

- তাজা

- থেকে

- সম্পূর্ণ

- তদ্ব্যতীত

- উত্পাদন করা

- উত্পন্ন

- উৎপাদিত

- সৃজক

- জেনারেটিভ এআই

- পেয়ে

- প্রদত্ত

- গুগল

- ঘটা

- এরকম

- এখানে

- অত্যন্ত

- কিভাবে

- HTTPS দ্বারা

- ভাবমূর্তি

- চিত্র

- প্রভাব

- in

- সুদ্ধ

- স্বাধীনভাবে

- তথ্য

- ইনপুট

- পরিবর্তে

- বুদ্ধিজীবী

- বুদ্ধিজীবী সম্পত্তি

- Internet

- IT

- জানা

- লেবেল

- ভাষা

- বৃহত্তর

- মামলা

- নেতৃত্ব

- শিখতে

- বরফ

- আইনগত

- আলো

- সম্ভবত

- জীবিত

- অনেক

- কম

- করা

- প্রস্তুতকর্তা

- পরিচালিত

- অনেক

- মানচিত্র

- ম্যাচিং

- ম্যাটার্স

- চিকিৎসা

- পদ্ধতি

- মিডজার্নি

- হতে পারে

- মিলিয়ন

- মডেল

- মডেল

- অধিক

- সেতু

- সবচেয়ে জনপ্রিয়

- নাম

- প্রাকৃতিক

- স্বভাবিক ভাষা

- নতুন

- নতুন

- অনেক

- বস্তু

- অনলাইন

- পরামিতি

- সম্প্রদায়

- নির্ভুল

- অনুমতি

- Plato

- প্লেটো ডেটা ইন্টেলিজেন্স

- প্লেটোডাটা

- জনপ্রিয়

- প্রতিকৃতি

- সম্ভব

- বর্তমান

- চমত্কার

- প্রতিরোধ

- প্রিন্সটন

- গোপনীয়তা

- ব্যক্তিগত

- ব্যক্তিগত তথ্য

- সম্পত্তি

- সম্পত্তির অধিকার

- রক্ষিত

- প্রমাণিত

- উত্থাপন

- বিরল

- হার

- RE

- বাস্তব

- বাস্তবতা

- রেকর্ড

- মনে রাখা

- গবেষণা

- গবেষকরা

- পরিত্রাণ

- অধিকার

- ripped

- বলেছেন

- একই

- মনে হয়

- সংবেদনশীল

- সেট

- সেট

- পক্ষই

- থেকে

- একক

- আয়তন

- ছোট

- ক্ষুদ্রতর

- সফটওয়্যার

- কিছু

- কিছু

- স্থায়িত্ব

- স্থিতিশীল

- এখনো

- দোকান

- অধ্যয়ন

- এমন

- টীম

- প্রযুক্তিঃ

- সার্জারির

- তাদের

- অতএব

- সময়

- বার

- থেকে

- অত্যধিক

- সরঞ্জাম

- রেলগাড়ি

- প্রশিক্ষিত

- প্রশিক্ষণ

- অনন্য

- বিশ্ববিদ্যালয়

- ক্যালিফোর্নিয়া বিশ্ববিদ্যালয়

- us

- ব্যবহার

- ব্যবহারকারী

- সাধারণত

- বৈকল্পিক

- Ve

- সতর্কবার্তা

- কিনা

- যে

- যখন

- হু

- ছাড়া

- হয়া যাই ?

- কাজ

- would

- zephyrnet

- জুরিখ