• metaverse من يعد بأن يكون الشيء الكبير التالي بعد ثورة الإنترنت عبر الهاتف المحمول. لا يكفي ربط الأشخاص - فالشركات الطموحة تريد أن تجمعهم معًا في عالم افتراضي يكرر تمامًا العالم الحقيقي. سوف تتفاعل الصور الرمزية مع بعضها البعض ، وتقوم بأعمال تجارية وتستمتع تمامًا كما هو الحال في العالم المادي.

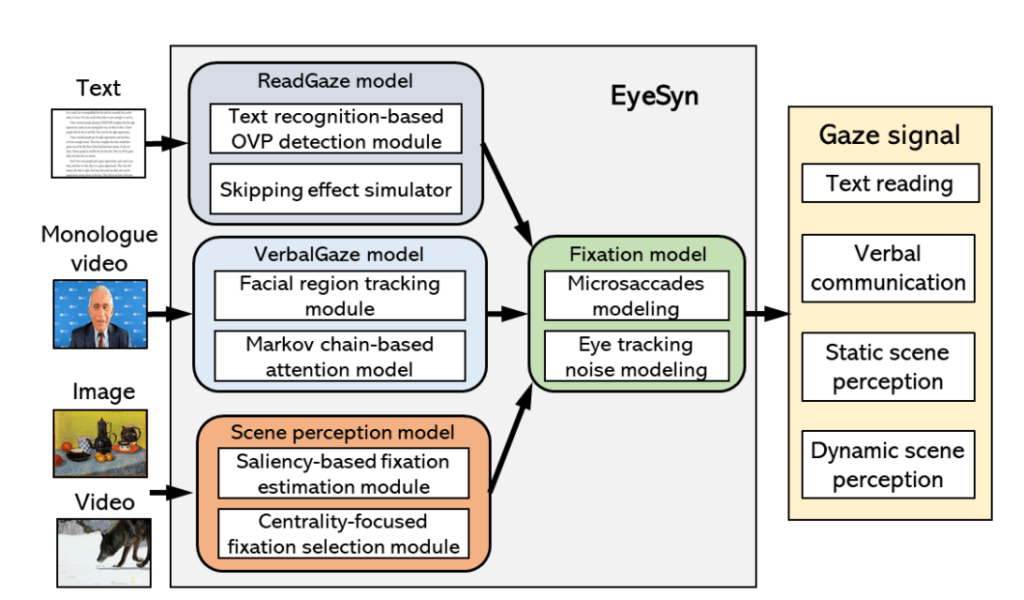

للوصول إلى هناك ، هناك حاجة مستمرة لتدريب مجموعات البيانات AI وتطوير منصات metaverse. و جامعة ديوك قدم للتو قطعة مهمة من اللغز. قام فريق من مهندسي الكمبيوتر مؤخرًا بتطوير EyeSyn - عيون افتراضية تحاكي حركة وتركيز العيون البشرية الحقيقية.

لماذا التركيز على تطوير العيون الافتراضية؟

يعتمد تطوير metaverse على كيفية تفاعل المستخدمين مع العالم الافتراضي وما يركزون عليه. حركة العين البشرية هي الطريقة الأكثر صلة لتقييم ما يجده المستخدمون ممتعًا ومثيرًا للفضول ويستحق النظر إليه. تتمتع العيون بالقدرة على إخبار المزيد عن مشاعر الشخص واهتماماته وتفضيلاته وتحيزاته أكثر من أي نوع آخر من التواصل غير اللفظي.

"إذا كنت مهتمًا باكتشاف ما إذا كان شخص ما يقرأ كتابًا فكاهيًا أو أدبًا متقدمًا من خلال النظر إلى أعينهم بمفردهم ، فيمكنك فعل ذلك ،" محمد ماريا جورلاتوفا ، الأستاذة المساعدة لشبكات نورتل في الهندسة الكهربائية وهندسة الحاسبات بجامعة ديوك ، تشرح المفهوم الكامن وراء برنامج EyeSyn. "عندما تعطي الأولوية لرؤيتك يخبرنا الكثير عنك كشخص أيضًا. يمكن أن تكشف عن غير قصد التحيزات الجنسية والعرقية ، والاهتمامات التي لا نريد أن يعرفها الآخرون ، والمعلومات التي قد لا نعرفها حتى عن أنفسنا ".

أهمية حركة العين في تطوير Metaverse

الجهود المبذولة لتطوير منصة حركة العين البشرية المحاكاة EyeSyn لها ما يبررها جيدًا. يمكن لمنشئي ومطوري محتوى AR و VR معرفة الكثير عن تفضيلات المستخدمين. وبالتالي ، فهم قادرون على:

- تقديم محتوى مخصص لهم ؛

- تقليل دقة الرؤية المحيطية لتوفير طاقة الحوسبة ؛

- اسمح للمستخدمين بتخصيص تفاعلاتهم مع الأصول الافتراضية وفقًا لتفضيلاتهم.

من خلال العيون الافتراضية التي طورها فريق الباحثين في جامعة Duke ، يمكن للشركات التي تعمل على بناء metaverse تدريب منصات وبرامج AR و VR دون الحاجة إلى الوصول إلى بيانات تتبع العين للمستخدمين الحقيقيين.

EyeSyn Virtual Eyes تفتح الفرص للشركات الصغيرة

في الوقت نفسه ، ستسمح العيون الافتراضية لمنشئي المحتوى الأصغر بالوصول إلى بيانات قيمة لتتبع العين ، دون إجراء اختبارات باهظة الثمن مع مستخدمين حقيقيين.

"أردنا تطوير برنامج ... يسمح للشركات الصغيرة التي ليس لديها تلك المستويات من الموارد بالدخول إلى لعبة metaverse ،" قال غورلاتوفا. "يمكن للشركات الصغيرة استخدامه بدلاً من إنفاق الوقت والمال لمحاولة إنشاء مجموعات بيانات في العالم الحقيقي (مع مواضيع بشرية) ".

ما مدى دقة العيون الافتراضية؟

اختبر فريق جامعة ديوك EyeSyn على مقاطع فيديو للدكتور أنتوني فوسي خلال المؤتمرات الصحفية وقارن النتائج مع حركات العين الفعلية للمشاهدين من البشر. تشير النتائج إلى تطابق وثيق بين تركيز العيون الافتراضية وتركيز الأشخاص الحقيقيين.

"البيانات التركيبية وحدها ليست مثالية ، لكنها نقطة انطلاق جيدة ،" قالت جورلاتوفا. "إذا أعطيت EyeSyn الكثير من المدخلات المختلفة وقمت بتشغيله مرات كافية ، فسوف تنشئ مجموعة بيانات من حركات العين الاصطناعية كبيرة بما يكفي لتدريب مصنف (التعلم الآلي) على برنامج جديد."

استخدام EyeSyn يعالج مشكلة مخاوف الخصوصية

الشركات لديها سبب آخر للجوء إلى العيون الافتراضية التي طورتها جامعة ديوك. يعني تسجيل حركات عيون الأشخاص الحقيقيين جمع البيانات الشخصية - وهي حاليًا مسألة حساسة للغاية.

لا تنتمي العيون الافتراضية إلى أي شخص - وبالتالي لا يوجد خرق محتمل لخصوصية البيانات في إنشاء مجموعات البيانات واستخدامها بهذه الطريقة.

سيتم تقديم التقرير الكامل عن العيون الافتراضية EyeSyn من قبل فريق البحث في المؤتمر الدولي لمعالجة المعلومات في شبكات الاستشعار، والتي ستقام تقريبًا في الفترة من 4 إلى 6 مايو.

- من نحن

- الوصول

- وفقا

- دقيق

- نشط

- نشاط

- عناوين

- متقدم

- آخر

- AR

- ممتلكات

- المساعد

- الآلهة

- حظر

- الحدود

- خرق

- نساعدك في بناء

- ابني

- الأعمال

- جمع

- Communication

- الشركات

- مقارنة

- الحوسبة

- القدرة الحاسوبية

- مفهوم

- مؤتمر

- المؤتمرات

- محتوى

- خلق

- المبدعين

- البيانات

- خصوصية البيانات

- مجموعة البيانات

- تطوير

- المتقدمة

- المطورين

- تطوير

- التطوير التجاري

- مختلف

- العرض

- دوق

- جهود

- الهندسة

- المهندسين

- عين

- تركز

- بالإضافة إلى

- مرح

- لعبة

- خير

- وجود

- كيفية

- HTTPS

- الانسان

- أهمية

- أهمية

- معلومات

- السريرية

- Internet

- قضية

- IT

- كبير

- تعلم

- تعلم

- أدب

- أبحث

- آلة

- آلة التعلم

- مباراة

- الوسائط

- ميتافيرس من

- الجوال

- مال

- الأكثر من ذلك

- أكثر

- حركة

- الشبكات

- جاكيت

- الفرص

- أخرى

- مجتمع

- الشخصية

- البيانات الشخصية

- مادي

- قطعة

- المنصة

- منصات التداول

- البوينت

- محتمل

- قوة

- صحافة

- خصوصية

- البرنامج

- لغز

- نادي القراءة

- النشرات

- ذات الصلة

- تقرير

- بحث

- الباحثين

- منتجع

- الموارد

- النتائج

- يجري

- قال

- طقم

- العدالة

- وسائل التواصل الاجتماعي

- تطبيقات الكمبيوتر

- الإنفاق

- فريق

- اختبارات

- الوقت

- سويا

- جامعة

- تستخدم

- المستخدمين

- مقاطع فيديو

- افتراضي

- العالم الافتراضي

- رؤيتنا

- vr

- ابحث عن

- سواء

- من الذى

- بدون

- للعمل

- العالم

- قيمة