A technical paper titled “WWW: What, When, Where to Compute-in-Memory” was published by researchers at Purdue University.

المستخلص:

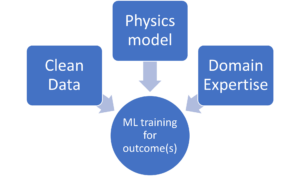

“Compute-in-memory (CiM) has emerged as a compelling solution to alleviate high data movement costs in von Neumann machines. CiM can perform massively parallel general matrix multiplication (GEMM) operations in memory, the dominant computation in Machine Learning (ML) inference. However, re-purposing memory for compute poses key questions on 1) What type of CiM to use: Given a multitude of analog and digital CiMs, determining their suitability from systems perspective is needed. 2) When to use CiM: ML inference includes workloads with a variety of memory and compute requirements, making it difficult to identify when CiM is more beneficial than standard processing cores. 3) Where to integrate CiM: Each memory level has different bandwidth and capacity, that affects the data movement and locality benefits of CiM integration.

In this paper, we explore answers to these questions regarding CiM integration for ML inference acceleration. We use Timeloop-Accelergy for early system-level evaluation of CiM prototypes, including both analog and digital primitives. We integrate CiM into different cache memory levels in an Nvidia A100-like baseline architecture and tailor the dataflow for various ML workloads. Our experiments show CiM architectures improve energy efficiency, achieving up to 0.12x lower energy than the established baseline with INT-8 precision, and upto 4x performance gains with weight interleaving and duplication. The proposed work provides insights into what type of CiM to use, and when and where to optimally integrate it in the cache hierarchy for GEMM acceleration.”

أعثر على ورقة فنية هنا. نُشرت في ديسمبر 2023 (نسخة ما قبل الطباعة).

Sharma, Tanvi, Mustafa Ali, Indranil Chakraborty, and Kaushik Roy. “WWW: What, When, Where to Compute-in-Memory.” arXiv preprint arXiv:2312.15896 (2023).

القراءة ذات الصلة

زيادة كفاءة طاقة الذكاء الاصطناعي من خلال الحوسبة في الذاكرة

كيفية معالجة أحمال عمل زيتاسكيل والبقاء ضمن ميزانية طاقة ثابتة.

نمذجة الحساب في الذاكرة بالكفاءة البيولوجية

يجبر الذكاء الاصطناعي التوليدي صانعي الرقائق على استخدام موارد الحوسبة بشكل أكثر ذكاءً.

SRAM In AI: The Future Of Memory

Why SRAM is viewed as a critical element in new and traditional compute architectures.

- محتوى مدعوم من تحسين محركات البحث وتوزيع العلاقات العامة. تضخيم اليوم.

- PlatoData.Network Vertical Generative Ai. تمكين نفسك. الوصول هنا.

- أفلاطونايستريم. ذكاء Web3. تضخيم المعرفة. الوصول هنا.

- أفلاطون كربون، كلينتك ، الطاقة، بيئة، شمسي، إدارة المخلفات. الوصول هنا.

- أفلاطون هيلث. التكنولوجيا الحيوية وذكاء التجارب السريرية. الوصول هنا.

- المصدر https://semiengineering.com/cim-integration-for-ml-inference-acceleration/

- :لديها

- :يكون

- :أين

- $ UP

- 1

- 2023

- a

- تسارع

- تحقيق

- AI

- تخفيف

- an

- و

- الأجوبة

- هندسة معمارية

- AS

- At

- عرض النطاق الترددي

- خط الأساس

- مفيد

- الفوائد

- على حد سواء

- ميزانية

- by

- مخبأ

- CAN

- الطاقة الإنتاجية

- قهري

- حساب

- إحصاء

- التكاليف

- حرج

- البيانات

- ديسمبر

- تحديد

- مختلف

- صعبة

- رقمي

- مهيمن

- كل

- في وقت مبكر

- كفاءة

- العنصر

- ظهرت

- طاقة

- كفاءة الطاقة

- أنشئ

- تقييم

- تجارب

- اكتشف

- ثابت

- في حالة

- القوات

- تبدأ من

- مستقبل

- الرأس مالية

- العلاجات العامة

- معطى

- هنا

- تسلسل

- مرتفع

- لكن

- HTTPS

- تحديد

- تحسن

- in

- يشمل

- بما فيه

- رؤى

- دمج

- التكامل

- إلى

- IT

- JPG

- القفل

- تعلم

- مستوى

- ومستوياتها

- خفض

- آلة

- آلة التعلم

- الآلات

- القيام ب

- نطاق واسع

- مصفوفة

- مكبر الصوت : يدعم، مع دعم ميكروفون مدمج لمنع الضوضاء

- ML

- الأكثر من ذلك

- حركة

- كثرة

- بحاجة

- جديد

- NVIDIA

- of

- on

- جاكيت

- عمليات

- لنا

- ورق

- موازية

- نفذ

- أداء

- منظور

- أفلاطون

- الذكاء افلاطون البيانات

- أفلاطون داتا

- يطرح

- قوة

- دقة

- عملية المعالجة

- معالجة

- المقترح

- نماذج

- ويوفر

- نشرت

- الأسئلة المتكررة

- بخصوص

- المتطلبات الأساسية

- الباحثين

- الموارد

- روي

- إظهار

- حل

- معيار

- إقامة

- ملاءمة

- أنظمة

- تقني

- من

- أن

- •

- المستقبل

- من مشاركة

- تشبه

- بعنوان

- إلى

- تقليدي

- نوع

- جامعة

- تستخدم

- تشكيلة

- مختلف

- شاهدوا

- من

- وكان

- we

- وزن

- ابحث عن

- متى

- مع

- في غضون

- للعمل

- زفيرنت