المُقدّمة

مع استمرار نمو مجال الذكاء الاصطناعي (AI) وتطوره، أصبح من المهم بشكل متزايد لمطوري الذكاء الاصطناعي الطموحين أن يظلوا على اطلاع بأحدث الأبحاث والتطورات. إحدى أفضل الطرق للقيام بذلك هي قراءة أوراق الذكاء الاصطناعي لمطوري GenAI، والتي توفر رؤى قيمة حول التقنيات والخوارزميات المتطورة. سوف تستكشف هذه المقالة 15 ورقة بحثية أساسية حول الذكاء الاصطناعي لمطوري GenAI. تغطي هذه الأوراق موضوعات مختلفة، بدءًا من معالجة اللغة الطبيعية وحتى رؤية الكمبيوتر. سوف تعزز فهمك للذكاء الاصطناعي وتعزز فرصك في الحصول على وظيفتك الأولى في هذا المجال المثير.

أهمية أوراق الذكاء الاصطناعي لمطوري GenAI

تسمح أوراق الذكاء الاصطناعي لمطوري GenAI للباحثين والخبراء بمشاركة نتائجهم ومنهجياتهم وإنجازاتهم مع المجتمع الأوسع. من خلال قراءة هذه الأوراق، يمكنك الوصول إلى أحدث التطورات في الذكاء الاصطناعي، مما يسمح لك بالبقاء في الطليعة واتخاذ قرارات مستنيرة في عملك. علاوة على ذلك، غالبًا ما يقدم مطورو AI Papers for GenAI شرحًا تفصيليًا للخوارزميات والتقنيات، مما يمنحك فهمًا أعمق لكيفية عملها وكيف يمكن تطبيقها على مشكلات العالم الحقيقي.

توفر قراءة أوراق الذكاء الاصطناعي لمطوري GenAI العديد من الفوائد لمطوري الذكاء الاصطناعي الطموحين. أولاً، يساعدك على البقاء على اطلاع بأحدث الأبحاث والاتجاهات في هذا المجال. تعد هذه المعرفة أمرًا بالغ الأهمية عند التقدم للوظائف المتعلقة بالذكاء الاصطناعي، حيث يبحث أصحاب العمل غالبًا عن مرشحين مطلعين على أحدث التطورات. بالإضافة إلى ذلك، تتيح لك قراءة أوراق الذكاء الاصطناعي توسيع معرفتك واكتساب فهم أعمق لمفاهيم ومنهجيات الذكاء الاصطناعي. يمكن تطبيق هذه المعرفة على مشاريعك وأبحاثك، مما يجعلك مطورًا أكثر كفاءة ومهارة في مجال الذكاء الاصطناعي.

جدول المحتويات

نظرة عامة: أوراق الذكاء الاصطناعي الأساسية لمطوري GenAI مع الروابط

الورقة 1: المحولات: الاهتمام هو كل ما تحتاجه

الرابط: اقرأ هنا

ملخص الورقة

تقدم الورقة المحول، وهو عبارة عن بنية شبكة عصبية جديدة لمهام نقل التسلسل، مثل الترجمة الآلية. على عكس النماذج التقليدية القائمة على الشبكات العصبية المتكررة أو التلافيفية، يعتمد المحول فقط على آليات الانتباه، مما يلغي الحاجة إلى التكرار والتلافيف. يرى المؤلفون أن هذه البنية تقدم أداءً فائقًا من حيث جودة الترجمة، وزيادة إمكانية التوازي، وتقليل وقت التدريب.

رؤى أساسية لأوراق الذكاء الاصطناعي لمطوري GenAI

- آلية الانتباه

تم بناء المحول بالكامل على آليات الانتباه، مما يسمح له بالتقاط التبعيات العالمية بين تسلسلات الإدخال والإخراج. يمكّن هذا النهج النموذج من النظر في العلاقات دون التقيد بالمسافة بين العناصر في التسلسلات.

- التوازي

إحدى المزايا الرئيسية لبنية المحولات هي قابلية التوازي المتزايدة. تعاني النماذج المتكررة التقليدية من الحساب المتسلسل، مما يجعل الموازاة أمرًا صعبًا. يسمح تصميم المحول بمعالجة متوازية أكثر كفاءة أثناء التدريب، مما يقلل من أوقات التدريب.

- جودة وكفاءة متفوقة

تعرض الورقة نتائج تجريبية على مهام الترجمة الآلية، مما يدل على أن المحول يحقق جودة ترجمة فائقة مقارنة بالنماذج الحالية. إنه يتفوق على أحدث النتائج السابقة، بما في ذلك نماذج المجموعة، بهامش كبير. بالإضافة إلى ذلك، يحقق المحول هذه النتائج بوقت تدريب أقل بكثير.

- أداء الترجمة

في مهمة الترجمة من الإنجليزية إلى الألمانية في WMT 2014، حقق النموذج المقترح درجة BLEU تبلغ 28.4، متجاوزًا أفضل النتائج الحالية بأكثر من 2 BLEU. في المهمة الإنجليزية إلى الفرنسية، يحدد النموذج درجة BLEU حديثة لنموذج واحد تبلغ 41.8 بعد التدريب لمدة 3.5 أيام فقط على ثماني وحدات معالجة رسوميات.

- التعميم على مهام أخرىيوضح المؤلفون أن بنية المحولات تعمم بشكل جيد على المهام التي تتجاوز الترجمة الآلية. لقد نجحوا في تطبيق النموذج على تحليل الدوائر الانتخابية باللغة الإنجليزية، مما يدل على قدرته على التكيف مع مشاكل تحويل التسلسل المختلفة.

الورقة الثانية: بيرت: التدريب المسبق للمحولات العميقة ثنائية الاتجاه لفهم اللغة

الرابط: اقرأ هنا

ملخص الورقة

أثبت التدريب المسبق على نموذج اللغة فعاليته في تحسين مهام معالجة اللغة الطبيعية المختلفة. وتميز هذه الورقة بين الأساليب القائمة على الميزات وأساليب الضبط الدقيق لتطبيق تمثيلات اللغة المدربة مسبقًا. تم تقديم BERT لمعالجة القيود في أساليب الضبط الدقيق، وخاصة قيد أحادية الاتجاه لنماذج اللغة القياسية. تقترح الورقة هدف التدريب المسبق لـ "نموذج اللغة المقنعة" (MLM)، مستوحى من مهمة Cloze، لتمكين التمثيل ثنائي الاتجاه. يتم أيضًا استخدام مهمة "التنبؤ بالجمل التالية" للتدريب المسبق المشترك على تمثيلات أزواج النص.

رؤى أساسية لأوراق الذكاء الاصطناعي لمطوري GenAI

- أهمية التدريب المسبق ثنائي الاتجاه

تؤكد الورقة على أهمية التدريب المسبق ثنائي الاتجاه لتمثيل اللغة. على عكس النماذج السابقة، يستخدم BERT نماذج لغة مقنعة لتمكين التمثيلات العميقة ثنائية الاتجاه، متجاوزًا نماذج اللغة أحادية الاتجاه المستخدمة في الأعمال السابقة.

- تخفيض في البنيات الخاصة بالمهمة

يوضح BERT أن التمثيلات المدربة مسبقًا تقلل من الحاجة إلى بنيات خاصة بالمهام شديدة الهندسة. يصبح أول نموذج تمثيلي قائم على الضبط الدقيق يحقق أداءً متطورًا عبر مجموعة متنوعة من المهام على مستوى الجملة والرمز المميز، متفوقًا على البنى الخاصة بالمهام المحددة.

- أحدث التطورات

يحقق BERT نتائج جديدة ومتطورة في أحد عشر مهمة لمعالجة اللغة الطبيعية، مما يعرض تنوعه. تتضمن التحسينات الملحوظة زيادة كبيرة في درجة GLUE، ودقة MultiNLI، وتحسينات في مهام الإجابة على الأسئلة SQuAD v1.1 وv2.0.

يمكنك أيضا قراءة: صقل BERT باستخدام نمذجة اللغة المقنعة

الورقة 3: GPT: نماذج اللغة هي عدد قليل من المتعلمين

الرابط: اقرأ هنا

ملخص الورقة

تناقش الورقة التحسينات التي تم تحقيقها في مهام معالجة اللغة الطبيعية (NLP) من خلال توسيع نطاق نماذج اللغة، مع التركيز على GPT-3 (المحول التوليدي المدرّب مسبقًا 3)، نموذج لغة انحدار ذاتي يحتوي على 175 مليار معلمة. يسلط المؤلفون الضوء على ذلك في حين أنه حديث نماذج البرمجة اللغوية العصبية وإثبات مكاسب كبيرة من خلال التدريب المسبق والضبط الدقيق، فإنها غالبًا ما تتطلب مجموعات بيانات خاصة بالمهمة مع آلاف الأمثلة للضبط الدقيق. وفي المقابل، يستطيع البشر أداء مهام لغوية جديدة بأمثلة قليلة أو تعليمات بسيطة.

رؤى أساسية لأوراق الذكاء الاصطناعي لمطوري GenAI

- يؤدي التوسيع إلى تحسين أداء اللقطات القليلة

يوضح المؤلفون أن توسيع نطاق نماذج اللغة يعزز بشكل كبير أداء المهام القليلة. يحقق GPT-3، بحجم المعلمة الكبير الخاص به، أحيانًا القدرة التنافسية من خلال أحدث أساليب الضبط الدقيق دون الحاجة إلى الضبط الدقيق لمهمة محددة أو تحديثات متدرجة.

- تطبيق واسع

يُظهر GPT-3 أداءً قويًا عبر مهام البرمجة اللغوية العصبية المختلفة، بما في ذلك الترجمة والإجابة على الأسئلة ومهام الإغلاق والمهام التي تتطلب التفكير الفوري أو التكيف مع المجال. - التحديات والقيود

في حين يُظهر GPT-3 قدرات تعليمية رائعة، يحدد المؤلفون مجموعات البيانات التي يواجه فيها صعوبات ويسلطون الضوء على القضايا المنهجية المتعلقة بالتدريب على مجموعات الويب الكبيرة. - الإنسان مثل المادة الجيل

يمكن لـ GPT-3 إنشاء مقالات إخبارية يجد المقيِّمون البشريون صعوبة في تمييزها عن المقالات التي يكتبها البشر. - التأثيرات المجتمعية والاعتبارات الأوسع

تناقش الورقة التأثيرات المجتمعية الأوسع لقدرات GPT-3، خاصة في إنشاء نص يشبه الإنسان. ويتم النظر في الآثار المترتبة على أدائها في مختلف المهام من حيث التطبيقات العملية والتحديات المحتملة. - حدود مناهج البرمجة اللغوية العصبية الحالية

يسلط المؤلفون الضوء على القيود المفروضة على أساليب البرمجة اللغوية العصبية الحالية، ولا سيما اعتمادهم على مجموعات بيانات الضبط الدقيق الخاصة بمهمة محددة، والتي تشكل تحديات مثل الحاجة إلى مجموعات بيانات كبيرة مصنفة وخطر الإفراط في التخصيص لتوزيعات المهام الضيقة. بالإضافة إلى ذلك، تنشأ مخاوف بشأن قدرة هذه النماذج على التعميم خارج حدود توزيع التدريب الخاص بها.

الورقة 4: شبكات CNN: تصنيف ImageNet مع الشبكات العصبية التلافيفية العميقة

الرابط: اقرأ هنا

ملخص الورقة

تصف الورقة تطوير وتدريب شبكة عصبية تلافيفية كبيرة وعميقة (CNN) لتصنيف الصور على مجموعات بيانات تحدي التعرف البصري واسع النطاق (ILSVRC) من ImageNet. يحقق النموذج تحسينات كبيرة في دقة التصنيف مقارنة بالطرق الحديثة السابقة.

رؤى أساسية لأوراق الذكاء الاصطناعي لمطوري GenAI

- العمارة النموذجية

الشبكة العصبية المستخدمة في الدراسة هي شبكة CNN عميقة تحتوي على 60 مليون معلمة و650,000 ألف خلية عصبية. وتتكون من خمس طبقات تلافيفية، بعضها يتبعه طبقات تجميع قصوى، وثلاث طبقات متصلة بالكامل مع 1000 طريقة softmax نهائية للتصنيف.

- بيانات التدريب

تم تدريب النموذج على مجموعة بيانات كبيرة مكونة من 1.2 مليون صورة عالية الدقة من مسابقة ImageNet ILSVRC-2010. تتضمن عملية التدريب تصنيف الصور إلى 1000 فئة مختلفة.

- الأداء

يحقق النموذج أعلى 1 وأعلى 5 معدلات خطأ تبلغ 37.5% و17.0% في بيانات الاختبار، على التوالي. وتعد معدلات الخطأ هذه أفضل بكثير من المعدلات المتقدمة السابقة، مما يشير إلى فعالية النهج المقترح.

- تحسينات في التجهيز الزائد

تقدم الورقة العديد من التقنيات لمعالجة مشكلات التجاوز، بما في ذلك الخلايا العصبية غير المشبعة، وتنفيذ GPU الفعال للتدريب بشكل أسرع، وطريقة تنظيم تسمى "التسرب" في الطبقات المتصلة بالكامل. - الكفاءة الحسابية

على الرغم من المتطلبات الحسابية لتدريب شبكات CNN الكبيرة، تشير الورقة إلى أن وحدات معالجة الرسوميات الحالية والتطبيقات المحسنة تجعل من الممكن تدريب مثل هذه النماذج على صور عالية الدقة.

- مساهمات

تسلط الورقة الضوء على مساهمات الدراسة، بما في ذلك تدريب واحدة من أكبر الشبكات العصبية التلافيفية على مجموعات بيانات ImageNet وتحقيق أحدث النتائج في مسابقات ILSVRC.

يمكنك أيضا قراءة: برنامج تعليمي شامل لتعلم الشبكات العصبية التلافيفية

الورقة 5: GATs: شبكات الرسم البياني للانتباه

الرابط: اقرأ هنا

ملخص الورقة

تقدم هذه الورقة بنية قائمة على الاهتمام لتصنيف العقد في البيانات المنظمة بالرسوم البيانية، مع عرض كفاءتها وتعدد استخداماتها وأدائها التنافسي عبر مختلف المعايير. أثبت دمج آليات الانتباه أنه أداة قوية للتعامل مع الرسوم البيانية المنظمة بشكل تعسفي.

رؤى أساسية لأوراق الذكاء الاصطناعي لمطوري GenAI

- شبكات الرسم البياني للانتباه (GATs)تستفيد GATs من طبقات الانتباه الذاتي المقنعة لمعالجة القيود في الطرق السابقة بناءً على تلافيف الرسم البياني. تسمح البنية للعقد بالاهتمام بميزات أحيائها، مع تحديد ضمني أوزان مختلفة لعقد مختلفة دون الاعتماد على عمليات المصفوفة المكلفة أو معرفة مسبقة ببنية الرسم البياني.

- معالجة التحديات القائمة على الطيف

تعالج GATs في وقت واحد العديد من التحديات في الشبكات العصبية الرسومية الطيفية. تتضمن تحديات شبكة الرسم البياني (GAT) مرشحات محلية مكانية، وحسابات مكثفة، ومرشحات غير محلية مكانية. بالإضافة إلى ذلك، تعتمد GATs على الأساس الذاتي اللابلاسي، مما يساهم في إمكانية تطبيقها على المشكلات الاستقرائية والتحويلية.

- الأداء عبر المعايير

تحقق نماذج GAT أحدث النتائج أو تطابقها عبر أربعة معايير رسم بياني ثابتة: مجموعات بيانات شبكة الاقتباسات Cora وCiteseer وPubmed، بالإضافة إلى مجموعة بيانات التفاعل بين البروتين والبروتين. تغطي هذه المعايير سيناريوهات التعلم التحويلية والاستقرائية، مما يوضح تنوع GATs.

- مقارنة مع النهج السابقة

تقدم هذه الورقة لمحة شاملة عن الأساليب السابقة، بما في ذلك الشبكات العصبية العودية، الرسم البياني الشبكات العصبية (GNNs)، الطرق الطيفية وغير الطيفية، وآليات الانتباه. تتضمن GATs آليات الاهتمام، مما يسمح بالتوازي الفعال عبر أزواج العقدة المجاورة وتطبيقها على العقد بدرجات مختلفة.

- الكفاءة وقابلية التطبيقتوفر GATs عملية فعالة وقابلة للتوازي يمكن تطبيقها على عقد الرسم البياني بدرجات مختلفة عن طريق تحديد أوزان عشوائية للجيران. ينطبق النموذج مباشرة على مشاكل التعلم الاستقرائي، مما يجعله مناسبًا للمهام التي تحتاج إلى تعميمها على الرسوم البيانية غير المرئية تمامًا.

- العلاقة بالنماذج السابقة

لاحظ المؤلفون أنه يمكن إعادة صياغة GATs كمثال معين لـ MoNet، ومشاركة أوجه التشابه مع الشبكات العلائقية، والاتصال بالأعمال التي تستخدم عمليات انتباه الحي. تتم مقارنة نموذج الاهتمام المقترح بالمناهج ذات الصلة مثل Duan et al. (2017) ودينيل وآخرون. (2017).

الورقة 6: ViT: الصورة تستحق 16×16 كلمة: محولات للتعرف على الصور على نطاق واسع

الرابط: اقرأ هنا

ملخص الورقة

تعترف الورقة بهيمنة البنى التلافيفية في الرؤية الحاسوبية على الرغم من نجاح البنى المحولة في معالجة اللغة الطبيعية. مستوحاة من كفاءة المحولات وقابلية التوسع في البرمجة اللغوية العصبية، قام المؤلفون بتطبيق محول قياسي مباشرة على الصور مع الحد الأدنى من التعديلات.

يقدمون محول الرؤية (ViT)، حيث يتم تقسيم الصور إلى تصحيحات، ويعمل تسلسل التضمين الخطي لهذه التصحيحات كمدخل إلى المحول. يتم تدريب النموذج على مهام تصنيف الصور بطريقة خاضعة للإشراف. في البداية، عند التدريب على مجموعات بيانات متوسطة الحجم مثل ImageNet دون تنظيم قوي، يحقق ViT دقة أقل بقليل من ResNets القابلة للمقارنة.

ومع ذلك، يكشف المؤلفون أن التدريب على نطاق واسع أمر بالغ الأهمية لنجاح ViT، متجاوزًا القيود التي يفرضها غياب بعض التحيزات الاستقرائية. عندما يتم تدريب ViT مسبقًا على مجموعات البيانات الضخمة، فإنه يتفوق في الأداء على أحدث الشبكات التلافيفية في معايير متعددة، بما في ذلك ImageNet وCIFAR-100 وVTAB. تؤكد الورقة على تأثير القياس في تحقيق نتائج ملحوظة مع بنيات المحولات في رؤية الكمبيوتر.

رؤى أساسية لأوراق الذكاء الاصطناعي لمطوري GenAI

- محول في رؤية الكمبيوتر

تتحدى هذه الورقة الاعتماد السائد على الشبكات العصبية التلافيفية (CNN) لمهام رؤية الكمبيوتر. إنه يوضح أن المحول النقي، عند تطبيقه مباشرة على تسلسلات تصحيحات الصور، يمكنه تحقيق أداء ممتاز في مهام تصنيف الصور.

- محول الرؤية (ViT)

يقدم المؤلفون محول الرؤية (ViT)، وهو نموذج يستخدم آليات الاهتمام الذاتي المشابهة للمحولات في البرمجة اللغوية العصبية. يمكن لـ ViT تحقيق نتائج تنافسية في معايير التعرف على الصور المختلفة، بما في ذلك ImageNet، وCIFAR-100، وVTAB.

- التدريب المسبق ونقل التعلم

تؤكد الورقة على أهمية التدريب المسبق على كميات كبيرة من البيانات، على غرار النهج في البرمجة اللغوية العصبية، ومن ثم نقل التمثيلات المستفادة إلى مهام محددة للتعرف على الصور. عند تدريب ViT مسبقًا على مجموعات بيانات ضخمة مثل ImageNet-21k أو JFT-300M، فإنه يتفوق في الأداء على الشبكات التلافيفية الحديثة في معايير مختلفة.

- الكفاءة الحسابيةيحقق ViT نتائج ملحوظة بموارد حسابية أقل بكثير أثناء التدريب مقارنة بـ أحدث الشبكات التلافيفية. تكون هذه الكفاءة ملحوظة بشكل خاص عندما يتم تدريب النموذج مسبقًا على نطاق واسع.

- تأثير التحجيم

تسلط الورقة الضوء على أهمية التوسع في تحقيق الأداء المتفوق باستخدام بنيات المحولات في رؤية الكمبيوتر. يساعد التدريب واسع النطاق على مجموعات البيانات التي تحتوي على ملايين إلى مئات الملايين من الصور ViT في التغلب على نقص بعض التحيزات الاستقرائية الموجودة في شبكات CNN.

الورقة 7: AlphaFold2: بنية بروتينية دقيقة للغاية باستخدام AlphaFold

الرابط: اقرأ هنا

ملخص الورقة

تقدم الورقة البحثية "AlphaFold2: بنية البروتين عالية الدقة باستخدام AlphaFold" AlphaFold2، وهو نموذج للتعلم العميق يتنبأ بدقة بهياكل البروتين. يستفيد AlphaFold2 من بنية جديدة قائمة على الاهتمام ويحقق اختراقًا في طي البروتين.

رؤى أساسية لأوراق الذكاء الاصطناعي لمطوري GenAI

- ألفا فولد 2 يستخدم شبكة عصبية عميقة مع آليات الانتباه للتنبؤ بالبنية ثلاثية الأبعاد للبروتينات من خلال تسلسل الأحماض الأمينية الخاصة بها.

- تم تدريب النموذج على مجموعة كبيرة من هياكل البروتين المعروفة وحقق دقة غير مسبوقة في مسابقة طي البروتين للتقييم النقدي الرابع عشر للتنبؤ ببنية البروتين (CASP14).

- يمكن للتنبؤات الدقيقة لـ AlphaFold2 أن تُحدث ثورة في اكتشاف الأدوية، وهندسة البروتين، ومجالات أخرى من الكيمياء الحيوية.

الورقة 8: شبكات GAN: شبكات الخصومة التوليدية

الرابط: اقرأ هنا

ملخص الورقة

تتناول الورقة التحديات التي تواجه تدريب النماذج التوليدية العميقة وتقدم نهجًا مبتكرًا يسمى شبكات الخصومة. في هذا الإطار، تنخرط النماذج التوليدية والتمييزية في لعبة حيث يهدف النموذج التوليدي إلى إنتاج عينات لا يمكن تمييزها عن البيانات الحقيقية. وفي المقابل، يفرق النموذج التمييزي بين العينات الحقيقية والمولدة. تؤدي عملية التدريب التنافسي إلى حل فريد من نوعه، حيث يستعيد النموذج التوليدي توزيع البيانات.

رؤى أساسية لأوراق الذكاء الاصطناعي لمطوري GenAI

- إطار الخصومة

يقدم المؤلفون إطارًا تنافسيًا حيث يتم تدريب نموذجين في وقت واحد - النموذج التوليدي (G) الذي يلتقط توزيع البيانات والنموذج التمييزي (D) الذي يقدر احتمالية أن تأتي العينة من بيانات التدريب بدلاً من النموذج التوليدي.

- لعبة ميني ماكسيتضمن إجراء التدريب تعظيم احتمالية ارتكاب النموذج التمييزي للخطأ. تمت صياغة هذا الإطار كلعبة minimax ثنائية اللاعبين، حيث يهدف النموذج التوليدي إلى توليد عينات لا يمكن تمييزها عن البيانات الحقيقية، ويهدف النموذج التمييزي إلى تصنيف ما إذا كانت العينة حقيقية أو تم إنشاؤها بشكل صحيح.

- حل فريد

يوجد حل فريد في الوظائف العشوائية لـ G وD، حيث يستعيد G توزيع بيانات التدريب ويكون D مساويًا لـ 1/2 في كل مكان. يتم الوصول إلى هذا التوازن من خلال عملية التدريب الخصومة.

- متعدد الطبقات Perceptrons (MLPs)يوضح المؤلفون أنه يمكن تدريب النظام بأكمله باستخدام الانتشار العكسي، عندما تمثل الإدراكات الحسية متعددة الطبقات G وD. وهذا يلغي الحاجة إلى سلاسل ماركوف، أو شبكات الاستدلال التقريبية غير المسجلة، أثناء التدريب وتوليد العينات.

- لا يوجد استنتاج تقريبي

يتجنب الإطار المقترح صعوبات تقريب الحسابات الاحتمالية المستعصية في تقدير الاحتمال الأقصى. كما أنه يتغلب على التحديات في الاستفادة من فوائد الوحدات الخطية المتعددة التعريف في السياق التوليدي.

الورقة 9: RoBERTa: نهج التدريب المسبق المحسّن بقوة لـ BERT

الرابط: اقرأ هنا

ملخص الورقة

تتناول الورقة مشكلة نقص التدريب لدى BERT وتقدم RoBERTa، وهي نسخة محسنة تتفوق على أداء BERT. تساهم التعديلات في إجراءات تدريب RoBERTa واستخدام مجموعة بيانات جديدة (CC-NEWS) في تحقيق أحدث النتائج في مهام معالجة اللغات الطبيعية المتعددة. تؤكد النتائج على أهمية اختيارات التصميم واستراتيجيات التدريب في فعالية التدريب المسبق على نموذج اللغة. تساهم الموارد التي تم إصدارها، بما في ذلك نموذج ورمز RoBERTa، في مجتمع البحث.

رؤى أساسية لأوراق الذكاء الاصطناعي لمطوري GenAI

- تدريب بيرت

يجد المؤلفون ذلك بيرت، وهو نموذج لغوي مستخدم على نطاق واسع، لم يتم تدريبه بشكل كبير. ومن خلال التقييم الدقيق لتأثير ضبط المعلمات الفائقة وحجم مجموعة التدريب، أظهروا أنه يمكن تحسين BERT ليطابق أو يتجاوز أداء جميع النماذج المنشورة بعده.

- وصفة التدريب المحسنة (RoBERTa)

يقدم المؤلفون تعديلات على إجراءات تدريب BERT، مما أسفر عن RoBERTa. تتضمن هذه التغييرات فترات تدريب ممتدة مع دفعات أكبر، وإلغاء هدف التنبؤ بالجملة التالية، والتدريب على تسلسلات أطول، وتعديلات نمط الإخفاء الديناميكي لبيانات التدريب.

- مساهمة مجموعة البياناتتقدم هذه الورقة مجموعة بيانات جديدة تسمى CC-NEWS، والتي يمكن مقارنتها في الحجم بمجموعات البيانات الأخرى المستخدمة بشكل خاص. يساعد تضمين مجموعة البيانات هذه على التحكم بشكل أفضل في تأثيرات حجم مجموعة التدريب ويساهم في تحسين الأداء في المهام النهائية.

- إنجازات الأداء

تحقق RoBERTa، مع التعديلات المقترحة، أحدث النتائج في العديد من المهام المعيارية، بما في ذلك GLUE وRACE وSQuAD. إنه يطابق أو يتجاوز أداء جميع أساليب ما بعد BERT في مهام مثل MNLI وQNLI وRTE وSTS-B وSQuAD وRACE.

- القدرة التنافسية للتدريب المسبق لنموذج اللغة المقنعة

تؤكد الورقة من جديد أن هدف التدريب المسبق لنموذج اللغة المقنعة، مع اختيارات التصميم الصحيحة، ينافس أهداف التدريب الأخرى المقترحة مؤخرًا.

- الموارد الصادرة

أطلق المؤلفون نموذج RoBERTa الخاص بهم، جنبًا إلى جنب مع كود التدريب المسبق والضبط الدقيق المطبق في PyTorch، مما ساهم في إمكانية التكرار ومواصلة استكشاف النتائج التي توصلوا إليها.

اقرأ أيضا: مقدمة لطيفة لRoBERTa

الورقة 10: NeRF: تمثيل المشاهد كمجالات إشعاع عصبية لتركيب العرض

الرابط: اقرأ هنا

ملخص الورقة

يتضمن التحسين تقليل الخطأ بين الصور التي تمت ملاحظتها بأوضاع الكاميرا المعروفة وطرق العرض المقدمة من تمثيل المشهد المستمر. تتناول الورقة التحديات المتعلقة بالتقارب والكفاءة من خلال إدخال التشفير الموضعي للتعامل مع وظائف التردد الأعلى واقتراح إجراء أخذ العينات الهرمي لتقليل عدد الاستعلامات اللازمة لأخذ العينات الكافية.

رؤى أساسية لأوراق الذكاء الاصطناعي لمطوري GenAI

- تمثيل المشهد المستمر

يقدم البحث طريقة لتمثيل المشاهد المعقدة كمجالات إشعاع عصبية خماسية الأبعاد باستخدام شبكات الإدراك الحسي الأساسية متعددة الطبقات (MLP).

- التقديم المتباين

يعتمد إجراء العرض المقترح على تقنيات عرض الحجم الكلاسيكية، مما يسمح بالتحسين القائم على التدرج باستخدام صور RGB القياسية.

- استراتيجية أخذ العينات الهرمية

تم تقديم إستراتيجية أخذ العينات الهرمية لتحسين قدرة MLP نحو المناطق ذات محتوى المشهد المرئي، ومعالجة مشكلات التقارب.

- ترميز موضعييتيح استخدام التشفير الموضعي لتعيين إحداثيات الإدخال 5D في مساحة ذات أبعاد أعلى التحسين الناجح لحقول الإشعاع العصبي لمحتوى المشهد عالي التردد.

تتفوق الطريقة المقترحة على أحدث أساليب تركيب العرض، بما في ذلك تركيب التمثيلات العصبية ثلاثية الأبعاد وتدريب الشبكات التلافيفية العميقة. تقدم هذه الورقة تمثيلاً مستمرًا للمشهد العصبي لتقديم مناظر واقعية جديدة عالية الدقة من صور RGB في الإعدادات الطبيعية، مع مقارنات إضافية معروضة في الفيديو التكميلي لتسليط الضوء على فعاليتها في التعامل مع هندسة المشهد المعقد ومظهره.

الورقة الحادية عشرة: البحث المرح: الاكتشافات الرياضية من بحث البرامج باستخدام نماذج لغوية كبيرة

الرابط: اقرأ هنا

ملخص الورقة

تقدم هذه الورقة البحثية FunSearch، وهو نهج جديد للاستفادة من نماذج اللغات الكبيرة (LLMs) لحل المشكلات المعقدة، وخاصة في الاكتشافات العلمية. التحدي الرئيسي الذي يتم تناوله هو حدوث التباسات (الهلوسة) في LLMs، مما يؤدي إلى عبارات معقولة ولكنها غير صحيحة. يجمع FunSearch بين LLM مدرب مسبقًا ومقيم منهجي في إجراء تطوري للتغلب على هذا القيد.

رؤى أساسية لأوراق الذكاء الاصطناعي لمطوري GenAI

- حل المشكلات مع LLMs

تتناول الورقة قضية ماجستير إدارة الأعمال الذي يخلط أو يفشل في توليد أفكار جديدة وحلول صحيحة للمشكلات المعقدة. ويؤكد على أهمية إيجاد أفكار جديدة وصحيحة يمكن التحقق منها، وخاصة بالنسبة للتحديات الرياضية والعلمية.

- الإجراء التطوري – FunSearch

يجمع FunSearch بين LLM مدرب مسبقًا ومقيم في عملية تطورية. فهو يطور بشكل متكرر البرامج ذات الدرجات المنخفضة إلى برامج ذات درجات عالية، مما يضمن اكتشاف المعرفة الجديدة. تتضمن العملية المطالبة بأفضل اللقطات، وتطوير هياكل البرنامج، والحفاظ على تنوع البرنامج، وتوسيع نطاقه بشكل غير متزامن.

- تطبيق على التوافقيات المتطرفة

يوضح البحث فعالية FunSearch في مشكلة مجموعة الغطاء في التوافقيات المتطرفة. تكتشف FunSearch إنشاءات جديدة لمجموعات كبيرة الحجم، متجاوزة أفضل النتائج المعروفة وتوفر أكبر تحسن خلال 20 عامًا إلى الحد الأدنى المقارب.

- مشكلة خوارزمية - تعبئة الصناديق عبر الإنترنت

تم تطبيق FunSearch على مشكلة تعبئة الصناديق عبر الإنترنت، مما أدى إلى اكتشاف خوارزميات جديدة تتفوق على الخوارزميات التقليدية في التوزيعات المدروسة جيدًا. وتشمل التطبيقات المحتملة تحسين خوارزميات جدولة الوظائف.

- البرامج مقابل الحلوليركز FunSearch على إنشاء برامج تصف كيفية حل المشكلة بدلاً من إخراج الحلول مباشرة. تميل هذه البرامج إلى أن تكون أكثر قابلية للتفسير، وتسهل التفاعلات مع خبراء المجال، كما أنها أسهل في النشر من الأنواع الأخرى من الأوصاف، مثل الشبكات العصبية.

- تأثير متعدد التخصصات

تسمح منهجية FunSearch باستكشاف مجموعة واسعة من المشكلات، مما يجعلها طريقة متعددة الاستخدامات مع تطبيقات متعددة التخصصات. تسلط الورقة الضوء على قدرتها على تحقيق اكتشافات علمية يمكن التحقق منها باستخدام LLMs.

الورقة 12: VAEs: التشفير التلقائي للبايز المتغيرة

الرابط: اقرأ هنا

ملخص الورقة

تعالج ورقة "التشفير التلقائي للتباين بايز" التحدي المتمثل في الاستدلال الفعال والتعلم في النماذج الاحتمالية الموجهة ذات المتغيرات الكامنة المستمرة، خاصة عندما تكون التوزيعات الخلفية مستعصية على الحل وتتعامل مع مجموعات كبيرة من البيانات. يقترح المؤلفون استدلالًا تباينيًا عشوائيًا وخوارزمية تعلم تتناسب بشكل جيد مع مجموعات البيانات الكبيرة، وتظل قابلة للتطبيق حتى في التوزيعات الخلفية المستعصية.

رؤى أساسية لأوراق الذكاء الاصطناعي لمطوري GenAI

- إعادة قياس الحد الأدنى المتغير

توضح الورقة إعادة قياس الحد الأدنى المتغير، مما يؤدي إلى مقدر الحد الأدنى. هذا المقدر قابل للتحسين باستخدام أساليب التدرج العشوائي القياسية، مما يجعله فعالاً من الناحية الحسابية.

- الاستدلال الخلفي الفعال للمتغيرات الكامنة المستمرةيقترح المؤلفون خوارزمية التشفير التلقائي VB (AEVB) لمجموعات البيانات ذات المتغيرات الكامنة المستمرة لكل نقطة بيانات. تستخدم هذه الخوارزمية مُقدِّر Stochastic Gradient Variational Bayes (SGVB) لتحسين نموذج التعرف، مما يتيح الاستدلال الخلفي التقريبي الفعال من خلال أخذ عينات الأسلاف. يتجنب هذا النهج مخططات الاستدلال التكراري باهظة الثمن مثل Markov Chain Monte Carlo (MCMC) لكل نقطة بيانات.

- المزايا النظرية والنتائج التجريبية

وتنعكس المزايا النظرية للطريقة المقترحة في النتائج التجريبية. تشير الورقة إلى أن نموذج إعادة القياس والتعرف يؤدي إلى الكفاءة الحسابية وقابلية التوسع، مما يجعل النهج قابلاً للتطبيق على مجموعات البيانات الكبيرة وفي المواقف التي يكون فيها الجزء الخلفي مستعصيًا على الحل.

اقرأ أيضا: الكشف عن جوهر العشوائية في التعلم الآلي

الورقة 13: الذاكرة الطويلة وقصيرة المدى

الرابط: اقرأ هنا

ملخص الورقة

تتناول هذه الورقة التحدي المتمثل في تعلم تخزين المعلومات على مدى فترات زمنية طويلة في الشبكات العصبية المتكررة. إنه يقدم طريقة جديدة وفعالة قائمة على التدرج تسمى "الذاكرة طويلة المدى" (LSTM)، للتغلب على مشكلات التدفق العكسي للأخطاء غير الكافية والمتدهورة. يفرض LSTM تدفقًا ثابتًا للأخطاء من خلال "دوامات الأخطاء الثابتة" ويستخدم وحدات البوابة المضاعفة للتحكم في الوصول. مع تعقيد الزمكان المحلي (O(1) لكل خطوة زمنية ووزن)، تظهر النتائج التجريبية أن LSTM يتفوق على الخوارزميات الموجودة فيما يتعلق بسرعة التعلم ومعدلات النجاح، خاصة بالنسبة للمهام ذات الفترات الزمنية الطويلة.

رؤى أساسية لأوراق الذكاء الاصطناعي لمطوري GenAI

- تحليل المشكلة

تقدم هذه الورقة تحليلاً مفصلاً للتحديات المرتبطة بالتدفق العكسي للأخطاء في الشبكات العصبية المتكررة، مع تسليط الضوء على مشكلات إشارات الخطأ التي إما تنفجر أو تختفي بمرور الوقت.

- مقدمة عن LSTM

يقدم المؤلفون LSTM كبنية جديدة مصممة لمعالجة مشاكل اختفاء إشارات الخطأ وانفجارها. يتضمن LSTM تدفقًا ثابتًا للأخطاء من خلال وحدات متخصصة ويستخدم وحدات بوابة مضاعفة لتنظيم الوصول إلى تدفق الأخطاء هذا.

- نتائج تجريبية

من خلال التجارب مع البيانات الاصطناعية، يوضح البحث أن LSTM يتفوق على خوارزميات الشبكة المتكررة الأخرى، بما في ذلك BPTT، وRTRL، والارتباط المتتالي المتكرر، وشبكات Elman، وتقطيع التسلسل العصبي. تُظهر LSTM تعلمًا أسرع ومعدلات نجاح أعلى، خاصة في حل المهام المعقدة ذات فترات زمنية طويلة.

- المحلية في المكان والزمان

يوصف LSTM بأنه بنية محلية في المكان والزمان، مع التعقيد الحسابي لكل خطوة زمنية ووزن O(1).

- القابلية للتطبيق

تعمل بنية LSTM المقترحة على حل المهام المعقدة والمصطنعة ذات التأخير الطويل بشكل فعال والتي لم تتم معالجتها بنجاح بواسطة خوارزميات الشبكة المتكررة السابقة.

- القيود والمزايا

تناقش الورقة قيود ومزايا LSTM، وتقدم نظرة ثاقبة للتطبيق العملي للبنية المقترحة.

اقرأ أيضا: ما هو LSTM؟ مقدمة للذاكرة طويلة المدى

الورقة 14: تعلم النماذج المرئية القابلة للتحويل من الإشراف على اللغة الطبيعية

الرابط: اقرأ هنا

ملخص الورقة

تستكشف الورقة تدريب أنظمة الرؤية الحاسوبية الحديثة من خلال التعلم المباشر من النص الخام حول الصور بدلاً من الاعتماد على مجموعات ثابتة من فئات الكائنات المحددة مسبقًا. يقترح المؤلفون مهمة تدريب مسبق للتنبؤ بالتسمية التوضيحية التي تتوافق مع صورة معينة، باستخدام مجموعة بيانات مكونة من 400 مليون زوج (صورة، نص) تم جمعها من الإنترنت. يوضح النموذج الناتج، CLIP (التدريب المسبق على اللغة المتباينة والصورة)، تعلمًا فعالاً وقابلاً للتطوير لتمثيلات الصور. بعد التدريب المسبق، تشير اللغة الطبيعية إلى المفاهيم المرئية، مما يتيح النقل الفوري إلى المهام المختلفة. يتم تقييم CLIP على أكثر من 30 مجموعة بيانات للرؤية الحاسوبية، مما يعرض الأداء التنافسي دون تدريب خاص بالمهام.

رؤى أساسية لأوراق الذكاء الاصطناعي لمطوري GenAI

- التدريب على اللغة الطبيعية لرؤية الكمبيوتر

تستكشف الورقة استخدام الإشراف على اللغة الطبيعية لتدريب نماذج الرؤية الحاسوبية بدلاً من نهج التدريب التقليدي على مجموعات البيانات ذات التصنيف الجماعي مثل ImageNet.

- مهمة ما قبل التدريبيقترح المؤلفون مهمة بسيطة قبل التدريب: التنبؤ بالتعليق الذي يتوافق مع صورة معينة. تُستخدم هذه المهمة للتعرف على أحدث تمثيلات الصور من الصفر على مجموعة بيانات ضخمة مكونة من 400 مليون زوج (صورة ونص) تم جمعها عبر الإنترنت.

- نقل صفر النار

بعد التدريب المسبق، يستخدم النموذج اللغة الطبيعية للإشارة إلى المفاهيم المرئية التي تم تعلمها أو وصف المفاهيم الجديدة. يتيح ذلك نقل النموذج بدون طلقة إلى المهام النهائية دون الحاجة إلى تدريب محدد على مجموعة البيانات.

- قياس الأداء في المهام المختلفة

تقوم الورقة بتقييم أداء النهج المقترح على أكثر من 30 مجموعة مختلفة من بيانات الرؤية الحاسوبية، والتي تغطي مهام مثل التعرف الضوئي على الحروف، والتعرف على الإجراءات في مقاطع الفيديو، وتحديد الموقع الجغرافي، وتصنيف الكائنات الدقيقة.

- أداء تنافسي

يوضح النموذج أداءً تنافسيًا مع خطوط أساس خاضعة للإشراف الكامل في مهام مختلفة، وغالبًا ما يطابق أو يتجاوز دقة النماذج المدربة على مجموعات البيانات الخاصة بالمهام دون تدريب إضافي خاص بمجموعة البيانات.

- دراسة قابلية التوسع

يدرس المؤلفون قابلية التوسع في نهجهم من خلال تدريب سلسلة من ثمانية نماذج بمستويات مختلفة من الموارد الحسابية. تم العثور على أن أداء النقل هو وظيفة حوسبة يمكن التنبؤ بها بسلاسة.

- نموذج المتانة

تسلط الورقة الضوء على أن نماذج CLIP ذات اللقطة الصفرية أكثر قوة من نماذج ImageNet الخاضعة للإشراف على الدقة المكافئة، مما يشير إلى أن تقييم اللقطة الصفرية للنماذج الحيادية للمهمة يوفر مقياسًا أكثر تمثيلاً لقدرة النموذج.

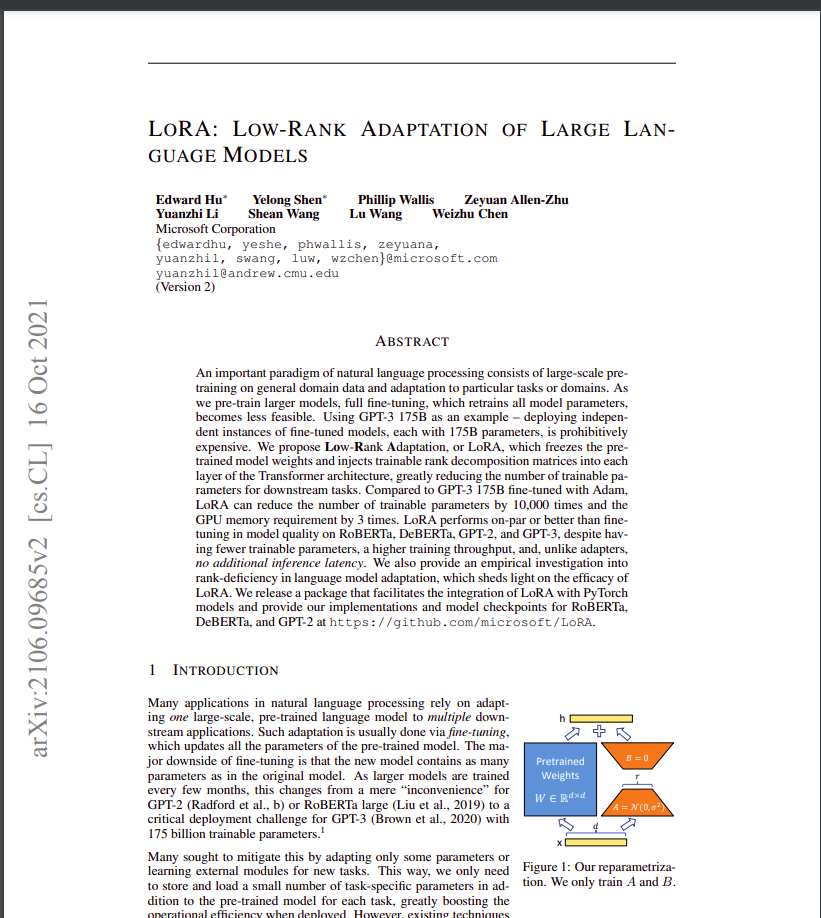

الورقة 15: لورا: التكيف المنخفض لنماذج اللغات الكبيرة

الرابط: اقرأ هنا

ملخص الورقة

تقترح الورقة LoRA كوسيلة فعالة لتكييف نماذج اللغة الكبيرة المدربة مسبقًا لمهام محددة، ومعالجة تحديات النشر المرتبطة بحجمها المتزايد. تعمل هذه الطريقة على تقليل المعلمات القابلة للتدريب ومتطلبات ذاكرة وحدة معالجة الرسومات بشكل كبير مع الحفاظ على جودة النموذج أو تحسينها عبر معايير مختلفة. يسهل التنفيذ مفتوح المصدر أيضًا اعتماد LoRA في التطبيقات العملية.

رؤى أساسية لأوراق الذكاء الاصطناعي لمطوري GenAI

1. المشكلة بيان

- يعد التدريب المسبق واسع النطاق الذي يتبعه الضبط الدقيق أسلوبًا شائعًا في معالجة اللغة الطبيعية.

- يصبح الضبط الدقيق أقل جدوى مع نمو النماذج بشكل أكبر، خاصة عند نشر النماذج ذات المعلمات الضخمة، مثل GPT-3 (175 مليار معلمة).

2. الحل المقترح: التكيف ذو الرتبة المنخفضة (LoRA)

- تقدم الورقة LoRA، وهي طريقة تجمد أوزان النماذج المدربة مسبقًا وتقدم مصفوفات تحليل الرتب القابلة للتدريب في كل طبقة من بنية المحولات.

- يقلل LoRA بشكل كبير من عدد المعلمات القابلة للتدريب للمهام النهائية مقارنة بالضبط الدقيق الكامل.

3. فوائد لورا

- تقليل المعلمات: بالمقارنة مع الضبط الدقيق، يمكن لـ LoRA تقليل عدد المعلمات القابلة للتدريب بما يصل إلى 10,000 مرة، مما يجعلها أكثر كفاءة من الناحية الحسابية.

- كفاءة الذاكرة: تعمل تقنية LoRA على تقليل متطلبات ذاكرة وحدة معالجة الرسومات بما يصل إلى 3 مرات مقارنة بالضبط الدقيق.

- جودة النموذج: على الرغم من وجود عدد أقل من المعلمات القابلة للتدريب، فإن أداء LoRA على قدم المساواة أو أفضل من الضبط الدقيق من حيث جودة النموذج في نماذج مختلفة، بما في ذلك RoBERTa وDeBERTa وGPT-2 وGPT-3.

4. التغلب على تحديات النشر

- تتناول الورقة التحدي المتمثل في نشر النماذج ذات العديد من المعلمات من خلال تقديم LoRA، مما يسمح بتبديل المهام بكفاءة دون إعادة تدريب النموذج بأكمله.

5. الكفاءة وانخفاض الكمون الاستدلال

- تسهل LoRA مشاركة نموذج تم تدريبه مسبقًا لبناء وحدات LoRA متعددة لمهام مختلفة، مما يقلل متطلبات التخزين والحمل العام لتبديل المهام.

- أصبح التدريب أكثر كفاءة، مما أدى إلى خفض حاجز الأجهزة أمام الدخول بما يصل إلى 3 مرات عند استخدام أدوات التحسين التكيفية.

6. التوافق والتكامل

- يتوافق LoRA مع العديد من الطرق السابقة ويمكن دمجه معها، مثل ضبط البادئة.

- يسمح التصميم الخطي المقترح بدمج المصفوفات القابلة للتدريب مع الأوزان المجمدة أثناء النشر، دون تقديم أي زمن انتقال إضافي للاستدلال مقارنة بالنماذج المضبوطة بالكامل.

7. التحقيق التجريبي

- تتضمن الورقة تحقيقًا تجريبيًا في نقص الترتيب في التكيف مع نموذج اللغة، مما يوفر نظرة ثاقبة حول فعالية نهج LoRA.

8. التنفيذ مفتوح المصدر

- يقدم المؤلفون حزمة تسهل تكامل LoRA مع نماذج PyTorch وتطبيقات الإصدار ونقاط التفتيش النموذجية لـ RoBERTa وDeBERTa وGPT-2.

يمكنك أيضًا قراءة: ضبط دقيق فعال للمعلمات لنماذج اللغات الكبيرة باستخدام LoRA وQLoRA

وفي الختام

في الختام، فإن الخوض في 15 ورقة بحثية أساسية حول الذكاء الاصطناعي لمطوري GenAI والتي تم تسليط الضوء عليها في هذه المقالة ليس مجرد توصية ولكنه ضرورة استراتيجية لأي مطور طموح. تقدم أوراق الذكاء الاصطناعي هذه رحلة شاملة عبر المشهد المتنوع للذكاء الاصطناعي، والتي تغطي المجالات الحيوية مثل معالجة اللغة الطبيعية، ورؤية الكمبيوتر، وما بعدها. ومن خلال الانغماس في الرؤى والابتكارات المقدمة في هذه الأوراق، يكتسب المطورون فهمًا عميقًا للتقنيات والخوارزميات المتطورة في هذا المجال.

مقالات ذات صلة

- محتوى مدعوم من تحسين محركات البحث وتوزيع العلاقات العامة. تضخيم اليوم.

- PlatoData.Network Vertical Generative Ai. تمكين نفسك. الوصول هنا.

- أفلاطونايستريم. ذكاء Web3. تضخيم المعرفة. الوصول هنا.

- أفلاطون كربون، كلينتك ، الطاقة، بيئة، شمسي، إدارة المخلفات. الوصول هنا.

- أفلاطون هيلث. التكنولوجيا الحيوية وذكاء التجارب السريرية. الوصول هنا.

- المصدر https://www.analyticsvidhya.com/blog/2024/01/essential-ai-papers-every-gen-ai-developer-must-read/

- :لديها

- :يكون

- :ليس

- :أين

- $ UP

- 000

- 1

- 10

- 11

- 12

- 13

- 14

- 15%

- 17

- 20

- 20 سنة

- 2014

- 2017

- 28

- 30

- 3d

- 400

- 41

- 60

- 7

- 8

- 9

- 913

- a

- القدرة

- من نحن

- AC

- الوصول

- دقة

- دقيق

- بدقة

- التأهيل

- تحقق

- يحقق

- تحقيق

- في

- اكشن

- تكيف

- على التكيف

- إضافي

- وبالإضافة إلى ذلك

- العنوان

- تناولت

- عناوين

- معالجة

- تعديلات

- تبني

- التطورات

- مميزات

- مزايا

- الخصومة

- بعد

- قدما

- AI

- وتهدف

- AL

- خوارزمية

- خوارزميات

- الكل

- السماح

- السماح

- يسمح

- على طول

- أيضا

- المبالغ

- an

- تحليل

- و

- أي وقت

- ذو صلة

- تطبيق

- التطبيقات

- تطبيقي

- ينطبق

- التقديم

- تطبيق

- نهج

- اقتراب

- تقريبي

- هندسة معمارية

- هي

- المناطق

- تجادل

- تنشأ

- البند

- مقالات

- مصطنع

- الذكاء الاصطناعي

- الذكاء الاصطناعي (منظمة العفو الدولية)

- AS

- تطمح

- التقييم المناسبين

- أسوشيتد

- At

- حضر

- اهتمام

- الكتاب

- حاجز

- على أساس

- الأساسية

- BE

- يصبح

- يجري

- أقل من

- مؤشر

- وقيم

- المعايير

- الفوائد

- أفضل

- أفضل

- ما بين

- Beyond

- التحيزات

- مليار

- BIN

- زيادة

- على حد سواء

- ملزم

- اختراق

- اختراقات

- أوسع

- ابني

- بنيت

- لكن

- by

- تسمى

- أتى

- وكاميرا

- CAN

- المرشحين

- قبعة

- قدرات

- قدرة

- الطاقة الإنتاجية

- أسر

- يلتقط

- بعناية

- الشلالات

- الفئات

- معين

- سلسلة

- السلاسل

- تحدى

- التحديات

- تحدي

- فرص

- التغييرات

- الخيارات

- فصول

- تصنيف

- صنف

- سي ان ان

- الكود

- الجمع بين

- يجمع بين

- مشترك

- مجتمع

- مماثل

- مقارنة

- مقارنات

- متوافق

- مختص

- منافسة

- المسابقات

- تنافسي

- القدرة التنافسية

- تماما

- مجمع

- تعقيد

- شامل

- حساب

- الحسابية

- الحسابات

- الكمبيوتر

- رؤية الكمبيوتر

- الحوسبة

- المفاهيم

- اهتمامات

- اختتام

- التواصل

- متصل

- نظر

- نظرت

- يتكون

- ثابت

- محتوى

- مسابقة

- سياق الكلام

- تواصل

- متواصل

- تباين

- المساهمة

- يساهم

- المساهمة

- مساهمات

- مراقبة

- التقاء

- شبكة عصبية تلافيفية

- تصحيح

- بشكل صحيح

- ارتباط

- يتوافق

- مكلفة

- بهيكل

- تغطية

- حرج

- حاسم

- حالياًّ

- منحنى

- المتطور والحديث

- البيانات

- قواعد البيانات

- أيام

- تعامل

- القرارات

- يقلل

- عميق

- التعلم العميق

- الشبكة العصبية العميقة

- أعمق

- مطالب

- شرح

- يوضح

- التظاهر

- تعتمد

- التبعيات

- نشر

- نشر

- نشر

- وصف

- وصف

- يصف

- تصميم

- تصميم

- على الرغم من

- مفصلة

- المطور

- المطورين

- تطوير

- مختلف

- صعبة

- الصعوبات

- توجه

- مباشرة

- يكتشف

- اكتشاف

- مسافة

- تميز

- يميز

- توزيع

- التوزيعات

- عدة

- تنوع

- do

- نطاق

- المجالات

- هيمنة

- عقار

- اكتشاف المخدرات

- أثناء

- ديناميكي

- E & T

- كل

- أسهل

- الطُرق الفعّالة

- على نحو فعال

- فعالية

- الآثار

- فعالية

- كفاءة

- فعال

- ثمانية

- إما

- عناصر

- أحد عشر

- يقضي على

- القضاء

- التأكيد

- يؤكد

- أرباب العمل

- توظف

- تمكين

- تمكن

- تمكين

- ترميز

- جذب

- الهندسة

- انجليزي

- تعزيز

- التحسينات

- يعزز

- ضمان

- كامل

- تماما

- دخول

- متساو

- توازن

- معادل

- خطأ

- خاصة

- جوهر

- أساسي

- أنشئ

- يؤسس

- تقديرات

- الأثير (ETH)

- تقييم

- تقييم

- حتى

- نتواجد في كل مكان

- يتطور

- يتطور

- المتطورة

- أمثلة

- تجاوز

- يتجاوز

- ممتاز

- المثيره

- المعارض

- القائمة

- موجود

- وسع

- ذو تكلفة باهظة

- تجريبي

- تجارب

- خبرائنا

- استكشاف

- اكتشف

- يستكشف

- استكشاف

- مدد

- يسهل

- تيسير

- الفشل

- مألوف

- أسرع

- قابليه

- المميزات

- قليل

- أقل

- حقل

- مجال

- مرشحات

- نهائي

- العثور على

- النتائج

- الاسم الأول

- تركيبات

- خمسة

- ثابت

- تدفق

- ويركز

- التركيز

- يتبع

- في حالة

- وجدت

- أربعة

- الإطار

- تردد

- تبدأ من

- مجمد

- بالإضافة إلى

- تماما

- وظيفة

- وظائف

- إضافي

- ربح

- الرأس مالية

- لعبة

- شبكات GAN

- بوابة

- جيناي

- توليد

- ولدت

- توليد

- توليدي

- نموذج توليدي

- لطيف

- علم الهندسة

- معطى

- إعطاء

- العالمية

- وحدة معالجة الرسوميات:

- وحدات معالجة الرسومات

- رسم بياني

- رسم بياني للشبكات العصبية

- الرسوم البيانية

- النمو

- مقبض

- معالجة

- أجهزة التبخير

- وجود

- يساعد

- الهرمية

- مرتفع

- تردد عالي

- عالية الدقة

- أعلى

- تسليط الضوء

- سلط الضوء

- تسليط الضوء

- ويبرز

- جدا

- كيفية

- كيفية

- HTTPS

- الانسان

- البشر

- مئات

- مئات الملايين

- ضبط Hyperparameter

- الأفكار

- تحديد

- صورة

- تصنيف الصورة

- التعرف على الصور

- IMAGEnet

- صور

- التأثير

- الآثار

- صيغة الامر

- التنفيذ

- تطبيقات

- نفذت

- آثار

- أهمية

- أهمية

- مفروض

- تحسن

- تحسين

- تحسينات

- يحسن

- تحسين

- in

- تتضمن

- يشمل

- بما فيه

- دمج

- يدمج

- القيمة الاسمية

- زيادة

- في ازدياد

- على نحو متزايد

- مبينا

- معلومات

- وأبلغ

- في البداية

- الابتكارات

- مبتكرة

- إدخال

- رؤى

- موحى

- مثل

- بدلًا من ذلك

- تعليمات

- التكامل

- رؤيتنا

- شديد

- تفاعل

- التفاعلات

- مصلحة

- Internet

- إلى

- تقديم

- أدخلت

- يدخل

- إدخال

- المُقدّمة

- تحقيق

- تنطوي

- ينطوي

- قضية

- مسائل

- IT

- انها

- وظيفة

- المشــاريــع

- رحلة

- JPG

- المعرفة

- معروف

- نقص

- هبوط

- المشهد

- لغة

- كبير

- على نطاق واسع

- أكبر

- أكبر

- كمون

- آخر

- طبقة

- طبقات

- قيادة

- يؤدي

- تعلم

- تعلم

- تعلم

- أقل

- ومستوياتها

- الرافعة المالية

- روافع

- الاستفادة من

- مثل

- أرجحية

- تحديد

- القيود

- محدود

- محلي

- طويل

- وقت طويل

- بحث

- منخفض

- خفض

- تخفيض

- آلة

- الترجمة الآلية

- صنع

- المحافظة

- رائد

- جعل

- القيام ب

- أسلوب

- كثير

- رسم خريطة

- هامش

- هائل

- مباراة

- اعواد الثقاب

- مطابقة

- رياضي

- مصفوفة

- ماكس العرض

- تعظيم

- أقصى

- قياس

- آليات

- مكبر الصوت : يدعم، مع دعم ميكروفون مدمج لمنع الضوضاء

- مجرد

- دمج

- طريقة

- المنهجيات

- آلية العمل

- طرق

- مليون

- ملايين

- أدنى

- التقليل

- خطأ

- نموذج

- عارضات ازياء

- التعديلات

- الوحدات

- الأكثر من ذلك

- أكثر فعالية

- علاوة على ذلك

- أكثر

- متعدد

- يجب

- يجب أن يقرأ

- طبيعي

- اللغة الطبيعية

- معالجة اللغات الطبيعية

- الطبيعة

- حاجة

- بحاجة

- إحتياجات

- نيرف

- شبكات

- شبكة

- الشبكات

- عصبي

- الشبكة العصبية

- الشبكات العصبية

- NeurIPS

- الخلايا العصبية

- جديد

- أخبار

- التالي

- البرمجة اللغوية العصبية

- لا

- العقدة

- العقد

- جدير بالذكر

- لاحظ

- ملاحظة

- رواية

- عدد

- موضوع

- موضوعي

- أهداف

- ملاحظ

- ظهور

- التعرف الضوئي على الحروف

- of

- عرض

- عروض

- غالبا

- on

- ONE

- منها

- online

- فقط

- المصدر المفتوح

- عملية

- عمليات

- التحسين

- الأمثل

- الأمثل

- or

- أخرى

- يتفوق على

- التفوق على

- يتفوق

- الناتج

- في الخارج

- على مدى

- تغلب

- التغلب على

- نظرة عامة

- صفقة

- أزواج

- بانكاج

- ورق

- أوراق

- موازية

- المعلمة

- المعلمات

- خاص

- خاصة

- بقع

- نمط

- إلى

- نفذ

- أداء

- ينفذ

- فترات

- واقعي

- أفلاطون

- الذكاء افلاطون البيانات

- أفلاطون داتا

- معقول

- البوينت

- يطرح

- محتمل

- يحتمل

- قوي

- عملية

- التطبيقات العملية

- تنبأ

- قابل للتنبؤ

- توقع

- تنبؤ

- تنبؤات

- تتوقع

- يقدم

- قدم

- الهدايا

- سابق

- ابتدائي

- قبل

- الاحتمالات

- المشكلة

- مشاكل

- الإجراءات

- عملية المعالجة

- معالجة

- إنتاج

- عميق

- البرنامج

- البرامج

- مشروع ناجح

- اقترح

- المقترح

- يقترح

- اقتراح

- بروتين

- البروتينات

- ثبت

- يثبت

- تزود

- ويوفر

- توفير

- نشرت

- pytorch

- جودة

- الاستفسارات

- سباق

- نطاق

- <font style="vertical-align: inherit;"></font> في ايم بي بي ايس

- الأجور

- بدلا

- الخام

- التي تم الوصول إليها

- عرض

- نادي القراءة

- يعيد التأكيد

- حقيقي

- العالم الحقيقي

- الأخيرة

- مؤخرا

- وصفة

- اعتراف

- توصية مجاناً

- يتعافى

- تكرار

- متكرر

- العودية

- تخفيض

- عقار مخفض

- يقلل

- تقليص

- تخفيض

- مرجع

- المراجع

- عكست

- بخصوص

- ضبط

- ذات صلة

- العلاقات

- الافراج عن

- صدر

- اعتماد

- الاعتماد

- بقايا

- لافت للنظر

- المقدمة

- أداء

- مثل

- التمثيل

- ممثل

- تمثل

- تطلب

- المتطلبات

- المتطلبات الأساسية

- بحث

- مجتمع الأبحاث

- الباحثين

- الموارد

- على التوالي

- مما أدى

- النتائج

- إعادة التدريب

- كشف

- ثور

- RGB

- حق

- المخاطرة

- قوي

- التدرجية

- تحجيم

- حجم

- النطاقات

- التحجيم

- سيناريوهات

- مشهد

- مشاهد

- جدولة

- مخططات

- علمي

- أحرز هدفاً

- خدش

- بحث

- عقوبة

- تسلسل

- مسلسلات

- يخدم

- طقم

- باكجات

- إعدادات

- عدة

- مشاركة

- مشاركة

- المدى القصير

- إظهار

- عرضت

- التفضيل

- تبين

- يظهر

- إشارات

- أهمية

- هام

- بشكل ملحوظ

- مماثل

- التشابه

- الاشارات

- معا

- حالات

- المقاس

- ماهر

- بسلاسة

- مجتمعي

- فقط

- حل

- الحلول

- حل

- يحل

- حل

- بعض

- أحيانا

- الفضاء

- المكان والزمان

- توتر

- متخصص

- محدد

- طيفي

- سرعة

- انقسم

- معيار

- دولة من بين الفن

- البيانات

- إقامة

- خطوة

- تخزين

- متجر

- إستراتيجي

- استراتيجيات

- الإستراتيجيات

- قوي

- بناء

- منظم

- الهياكل

- النضالات

- دراسة

- جوهري

- جوهريا

- تحقيق النجاح

- ناجح

- بنجاح

- هذه

- وتقترح

- مناسب

- أعلى

- إشراف

- تفوق

- متجاوزا

- SVG

- تركيب

- نظام

- أنظمة

- مهمة

- المهام

- تقنيات

- تميل

- سياسة الحجب وتقييد الوصول

- تجربه بالعربي

- نص

- من

- أن

- •

- الرسم البياني

- من مشاركة

- منهم

- then

- نظري

- تشبه

- هم

- الآلاف

- ثلاثة

- عبر

- الوقت

- مرات

- إلى

- أداة

- المواضيع

- نحو

- تقليدي

- قطار

- متدرب

- قادة الإيمان

- تحويل

- نقل

- محول

- محولات

- خدمات ترجمة

- جودة الترجمة

- جديد الموضة

- البرنامج التعليمي

- اثنان

- أنواع

- يؤكد

- فهم

- فريد من نوعه

- الوحدات

- مختلف

- غير مسبوق

- تحديث

- آخر التحديثات

- تستخدم

- مستعمل

- يستخدم

- استخدام

- يستخدم

- v1

- القيمة

- مختلف

- يمكن التحقق منها

- متعدد الجوانب

- طلاقة الحركة

- الإصدار

- فيديو

- مقاطع فيديو

- المزيد

- الرؤى

- مرئي

- رؤيتنا

- أنظمة الرؤية

- بصري

- التعرف البصري

- حجم

- vs

- وكان

- طرق

- الويب

- وزن

- حسن

- متى

- سواء

- التي

- في حين

- واسع

- مدى واسع

- على نحو واسع

- على نطاق أوسع

- المجتمع الأوسع

- ويكيبيديا

- سوف

- مع

- في غضون

- بدون

- كلمات

- للعمل

- أعمال

- قيمة

- مكتوب

- سنوات

- العائد

- لصحتك!

- حل متجر العقارات الشامل الخاص بك في جورجيا

- زفيرنت